Mar

21

Sobre el metabolismo de seres muy especiales.

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Biologia ~

Clasificado en Biologia ~

Comments (1)

Comments (1)

El metabolismo heterótrofo

![]()

Los seres autótrofos siguen dos vías diferentes para transformar la biomasa que ingieren en los compuestos complejos de los que se componen sus tejidos. Esta transformación puede ser mediante fermentación anaeróbica o a través de respiración aeróbica. La primera vía se restringe a las células procariotas simples, como las fermentadoras, las bacterias metanogénicas y los hongos Ascomycota responsables de la fermentación del etanol (alcohol etílico). La segunda vía se hizo posible a partir del momento en que la cantidad de oxígeno atmosférico, generado por los vegetales, alcanzó un nivel suficientemente alto como para que algunos seres procariotes pudieran utilizar la respiración aeróbica para generar trifosfato de adenosina más eficientemente que por fermentación. Desde un punto de vista energético, la oxidación es claramente ventajosa. Así, por cada mol de glucosa se liberan 197 KJ por fermentación en ácido láctico, 232 KJ por fermentación alcohólica y 2’87 MJ por la oxidación completa, lo que representa para esta última una ganancia que está comprendida entre 12 y 14 veces.

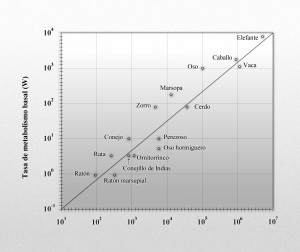

Los nutrientes necesarios para el metabolismo de tipo heterótrofo proceden de la digestión de los tejidos vegetales o de otros heterótrofos. En el metabolismo heterótrofo hay notables regularidades orgánicas. Entre ellas destaca claramente el hecho de que al representar en un gráfico logarítmico la tasa metabólica basal (TMB), – metabolismo mínimo cuando el animal se encuentra en reposo absoluto – frente al peso, los resultados relativos a los animales comprendidos entre el ratón y el elefante se dispongan a lo largo de una línea recta.

Representación de Kleiber del metabolismo basal de los mamíferos desde el ratón al elefante.

Mar

20

¡Fisica! Siempre la Física

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (5)

Comments (5)

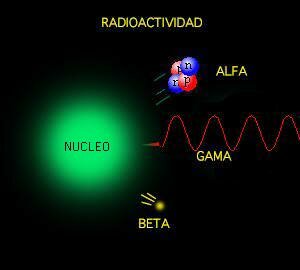

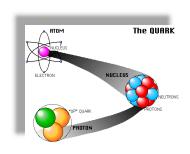

Las sustancias formadas por una sola clase de átomos se llaman elementos químicos. La palabra “átomo” procede del griego ατομος, que significa “indivisible” y el uso de la palabra “elemento” sugiere que se ha llegado a los ladrillos básicos con los que está formada la materia. De hecho, esta es la imagen que se tenía a mediados del siglo XIX cuando se acuñaron estos términos. Sin embargo, hoy sabemos que todo esto es falso, que los átomos se pueden dividir y que, de esta manera, los elementos han dejado de ser verdaderamente elementales. Los físicos continúan con esta nomenclatura aunque sea formalmente incorrecta, ya que, la costumbre, como dicen los juristas, no pocas veces rigen la jerga de las leyes.

Serán así los electrones, los que tomaron la imagen dicen que sí

A todo esto y hablando de los átomos, por fuerza, nos tenemos que acordar del electrón que da al átomo su forma esférica. Son partículas cargadas eléctricamente que se mueven alegremente alrededor del núcleo. El electrón es muy ligero: su masa es solamente 1/1.8836 de la del núcleo más ligero (el hidrógeno). La carga eléctrica del electrón es de signo opuesto a la del núcleo, de manera que los electrones están fuertemente atraídos hacia el núcleo y se repelen mutuamente. Si la carga eléctrica total de los electrones en un átomo iguala a la del núcleo, para lo que generalmente se necesitan varios electrones, se dice que el átomo está en equilibrio o que es eléctricamente neutro.

Un experimento realizado por científicos del Centro de Viena para la Ciencia y Tecnología Cuánticas ha demostrado que, en el mundo cuántico, la transición hacia el equilibrio térmico es más interesante y más complicada de lo que se pensaba.

Según destaca el trabajo, publicado en ‘Science’, entre un estado ordenado inicial y un estado final estadísticamente mixto, puede emerger un “cuasi-estacionario estado intermedio”. Este estado intermedio ya exhibe algunas propiedades como el equilibrio, pero parte de las características del estado inicial permanecen visibles durante un período de tiempo muy largo.

Este fenómeno se denomina “pre-termalización” y desempeña un papel importante en diversos procesos de no equilibrio en la física cuántica. Podría, por ejemplo, ayudarnos a comprender el estado del universo temprano.

La fuerza a la que obedecen los electrones, la denominada fuerza electrostática o de Coulomb, es matemáticamente bastante sencilla y, sin embargo, los electrones son los responsables de las importantes propiedades de los “enlaces químicos”. Esto se debe a que las leyes de movimiento de los electrones están regidas completamente por la “mecánica cuántica”, teoría que se completó a principios del siglo XX. Es una teoría paradójica y difícil de entender y explicar, pero al mismo tiempo es muy interesante, fantástica y revolucionaria. Cuando uno se introduce en las maravillas de la mecánica cuántica es como si hiciera un viaje a un universo que está situado fuera de este mundo nuestro, ya que, las cosas que allí se ven, desdicen todo lo que dicta nuestro sentido común de cómo tiene que ser el mundo que nos rodea.

Sincronización perfecta, es una sinfonía

No solamente los electrones, sino también los núcleos atómicos y los átomos en su conjunto obedecen y se rigen por la mecánica cuántica. La Física del siglo XX empezó exactamente en el año 1900, cuando el físico alemán Max Planck, escribió un artículo de ocho páginas y allí propuso una posible solución a un problema que había estado intrigando a los físicos durante años. Es el problema de la luz que emiten los cuerpos calentados a una cierta temperatura, y también la radiación infrarroja emitida, con menos intensidad, por los objetos más fríos.

Estaban bien aceptados entonces que esta radiación tenía un origen electromagnético y que se conocían las leyes de la naturaleza que regían estas ondas electromagnéticas. También se conocían las leyes para el frío y el calor, la así llamada “termodinámica”, o al menos eso parecía. Pero si usamos las leyes de la termodinámica para calcular la intensidad de la radiación, el resultado no tiene ningún sentido. Los cálculos nos dicen que se emitiría una cantidad infinita de radiación en el ultravioleta más lejano, y, desde luego, esto no es lo que sucede. Lo que se observa es que la intensidad de la radiación muestra un pico a una cierta longitud de onda característica, y que la intensidad disminuye tanto para las longitudes mayores como para las longitudes menores. Esta longitud característica es inversamente proporcional a la temperatura absoluta del objeto radiante (la temperatura absoluta se define por una escala de temperatura que empieza a 273 ºC bajo cero). Cuando a 1.000 ºC un objeto se pone al “rojo vivo”, el objeto está radiando en la zona de luz visible.

El espectro electromagnético se extiende desde la radiación de menor longitud de onda, como los rayos gamma y los rayos X, pasando por la luz ultravioleta, la luz visible y los rayos infrarrojos, hasta las ondas electromagnéticas de mayor longitud de onda, como son las ondas de radio. Se cree que el límite para la longitud de onda más pequeña posible es la longitud de Planck mientras que el límite máximo sería el tamaño del Universo.

Lo que Planck propuso fue simplemente que la radiación sólo podía ser emitida en paquetes de un tamaño dado. La cantidad de energía de uno de esos paquetes, o cuantos, es inversamente proporcional a la longitud de la onda y, por lo tanto, proporcional a la frecuencia de la radiación emitida. La sencilla fórmula es:

E = h x v

Donde E es la energía del paquete, v la frecuencia y h es una nueva constante fundamental de la naturaleza, la constante de Planck. Cuando Planck calculó la intensidad de la radiación térmica imponiendo esta nueva condición, el resultado coincidió perfectamente con las observaciones.

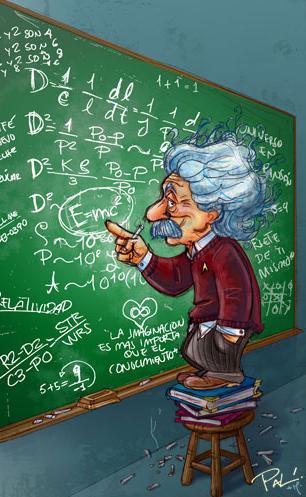

Poco tiempo después, en 1905, Einstein formuló esta teoría de una forma mucho más tajante: el sugirió que los objetos calientes no son los únicos que emiten radiación en paquetes de energía, sino que toda la radiación consiste en múltiplos de los paquetes de energía de Planck. El príncipe francés Louis-Victor de Broglie, dándole otra vuelta a la teoría, propuso que no sólo cualquier cosa que oscila tiene una energía, sino que cualquier cosa con energía se debe comportar como una “onda” que se extiende en una cierta región del espacio, y que la frecuencia, v, de la oscilación verifica la ecuación de Planck. Por lo tanto, los cuantos asociados con los rayos de luz deberían verse como una clase de partículas elementales: el fotón. Todas las demás clases de partículas llevan asociadas diferentes ondas oscilatorias de campos de fuerza.

El curioso comportamiento de los electrones en el interior del átomo, descubierto y explicado por el famoso físico danés Niels Bohr, se pudo atribuir a las ondas de De Broglie. Poco después, en 1926, Erwin Schrödinger descubrió como escribir la teoría ondulatoria de Debroglie con ecuaciones matemáticas exactas. La precisión con la cual se podían realizar cálculos era asombrosa, y pronto quedó claro que el comportamiento de todos los objetos pequeños estaban exactamente determinados por la recién descubiertas “ecuaciones de onda cuánticas”.

Pocas dudas nos pueden caber a estas alturas de que la mecánica cuántica (de Planck) y, la Relatividad –tanto especial como general- (de Einstein), además de ser las dos teorías más importantes de la Física de nuestro tiempo, funcionan de tal forma que uno, cuando profundiza en sus predicciones y las compara con lo que ocurre en el Universo, no puede por menos que, asombrarse, al comprobar como unas mentes humanas han sido capaces de llegar a estos profundos pensamientos que nos acerca a la realidad de la Naturaleza, al mismo tiempo que nos aleja de nuestra propia realidad.

Sí, están ahí pero, en realidad, no sabemos, a ciencia cierta, ni cómo se formaron las galaxias

¿Qué encontraremos cuando sea posible verificar la Teoría de cuerdas? ¿Qué hay más allá de los Quarks? ¿Sabremos alguna vez lo que es una singularidad? ¿Será verdad la existencia de esa materia oscura de la que tanto se habla? ¿Podremos al fín, encontrar esa fuente de energía que tanto necesita la Humanidad para dar ese segundo paso hacia el futuro? ¿Tendremos, acaso, algún destino que no sea el de la irremisible extinción?

¡Preguntas! Preguntas y más preguntas que no podemos contestar. Es desesperante estar inmersos en este inmenso océano de ignorancia. ¿Cuándo sabremos? El el epitafio que Hilbert ordenó esculpir en su Tumba, nos lo prometía: “Tenemos que saber, sabremos”. Si, ¿pero cuándo?

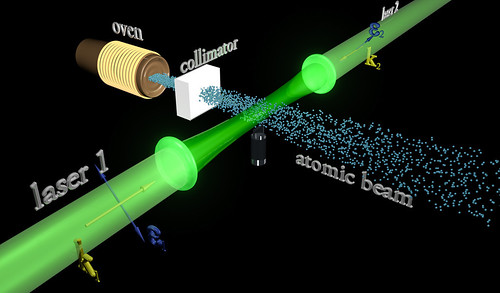

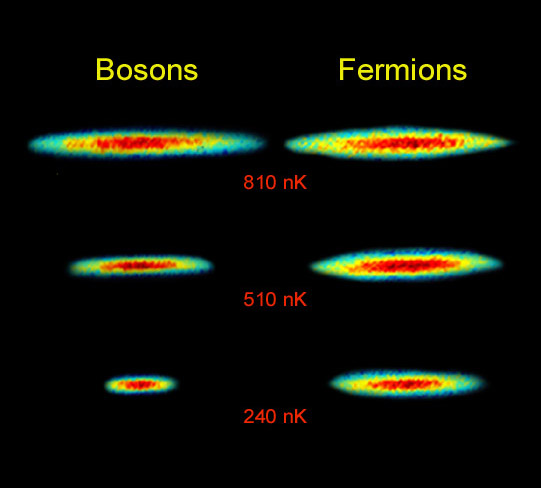

Lo cierto es que, las reglas de la mecánica cuántica tienen que ser aplicadas si queremos describir estadísticamente un sistema de partículas que obedece a reglas de ésta teoría en vez de las de la mecánica clásica. En estadística cuantica, los estados de energía se considera que están cuantizados. La estadística de Bose-Einstein se aplica si cualquier número de partículas puede ocupar un estado cuántico dado. Dichas partículas (como dije antes) son los bosones que, tienden a juntarse.

Los bosones tienen un momento angular n h / 2p, donde n es cero o un entero y h es la constante de Planck. Para bosones idénticos, la función de ondas es siempre simétrica. Si solo una partícula puede ocupar un estado cuántico, tenemos que aplicar la estadística Fermi-Dirac y las partículas (como también antes dije) son los fermiones que tienen momento angular (n+½) h/2p y cualquier función de ondas de fermiones idénticos es siempre antisimétrica.

La mejor teoría para explicar el mundo subatómico nació en 1928 cuando el teórico Paul Dirac combinó la mecánica cuántica con la relatividad especial para explicar el comportamiento del electrón. El resultado fue la mecánica cuántica relativista, que se transformó en un ingrediente primario en la teoría cuántica de campos. Con unas pocas suposiciones y unos ajustes, la teoría cuántica de campos ha probado ser suficientemente poderosa para formar la base del modelo estándar de las partículas y las fuerzas que rigen el universo.

La relación entre el espín y la estadística de las partículas está demostrada por el teorema espín-estadística. En un espacio de dos dimensiones es posible que existan partículas (o cuasipartículas) con estadística intermedia entre bosones y fermiones. Estas partículas se conocen con el nombre de aiones; para aniones idénticos la función de ondas no es simétrica (un cambio de fase de+1) o antisimétrica (un cambio de fase de -1), sino que interpola continuamente entre +1 y -1. Los aniones pueden ser importantes en el análisis del efecto Hall cuántico fraccional y han sido sugeridos como un mecanismo para la superconductividad de alta temperatura.

Debido al principio de exclusión de Pauli es imposible que dos fermiones ocupen el mismo estado cuántico (al contrario de lo que ocurre con los bosones). Y, precisamente por eso, se degeneran electrones y neutrones dando lugar a la formación de estrellas enanas blancas y de neutrones que, encuentran la estabilidad frenando la fuerza de gravedad.

La condensación de Bose-Einstein es de importancia fundamental para explicar el fenómeno de la superfluidez. A temperaturas muy bajas (del orden de 2×10-7k) se puede formar un condensado de Bose-Einstein, en el que varios miles de átomos forman una única entidad (un superátomo). Este efecto ha sido observado con átomos de rubidio y litio. Este efecto (condensación Bose-Einstein), como ya habréis podido suponer, es llamado así en honor al físico Satyendra Naht Bose (1.894-1.974) y de Albert Einstein.

Más reciente es la obtención del Condensado de Bose-Einstein (BEC); en este caso las bases teóricas se postularon en la década de los 20 en manos de Satyendra Nath Bose y Albert Einstein. El primero describe ciertas reglas para determinar si dos fotones deberían considerarse idénticos o diferentes (Estadísticas de Bose) y Einstein aplica dichas reglas a los átomos intentando averiguar como se comportarían. Así, halla los efectos de que a muy bajas temperaturas los átomos están al mismo nivel cuántico produciendo fenómenos como la superfluidez o la superconductividad.

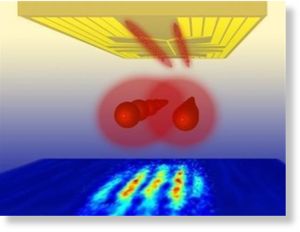

Distribución de momentos que confirma la existencia de un nuevo estado de agregación de la materia, el condensado de Bose-Einstein. Datos obtenidos en un gas de átomos de rubidio, la coloración indica la cantidad de átomos a cada velocidad, con el rojo indicando la menor y el blanco indicando la mayor. Las áreas blancas y celestes indican las menores velocidades. A la izquierda se observa el diagrama inmediato anterior al condensado de Bose-Einstein y al centro el inmediato posterior. A la derecha se observa el diagrama luego de cierta evaporación, con la sustancia cercana a un condensado de Bose-Einstein puro. El pico no es infinitamente angosto debido al Principio de indeterminación de Heisenberg: dado que los átomos están confinados en una región del espacio, su distribución de velocidades posee necesariamente un cierto ancho mínimo. La distribución de la izquierda es para T > Tc (sobre 400 nanokelvins (nK)), la central para T < Tc (sobre 200 nK) y la de la derecha para T << Tc (sobre 50 nK).

Así que, el principio de exclusión de Pauli tiene aplicación no sólo a los electrones, sino también a los fermiones; pero no a los bosones. Si nos fijamos en todo lo que estamos hablando aquí, nos daremos cuenta de que la mecánica cu´çantica es extraña y siendo fácil comprender como forma un campo magnético la partícula cargada que gira, no resulta tan fácil saber por qué ha de hacer lo mismo un neutrón descargado.

Lo cierto es que ocurre así. La prueba directa más evidente de ello es que cuando un rayo de neutrones incide sobre un hierro magnetizado, no se comporta de la misma forma que lo haría si el hierro no estuviese magnetizado. El magnetismo del neutrón sigue siendo un misterio; los físicos sospechan que contiene cargas positivas y negativas equivalentes a cero, aunque por alguna razón desconocida, lograr crear un campo magnético cuando gira la partícula.

emilio silver

Mar

20

¡El Universo! ¿Sería eso lo que pasó?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo ~

Clasificado en El Universo ~

Comments (0)

Comments (0)

Se cree que cuando el universo se expandió y se enfrió a unos 3000 ºK, se volvió transparente a la radiación, que es la que observamos en la actualidad, mucho más fría y diluida, como radiación térmica de microondas. El descubrimiento del fondo de microondas en 1.956 puso fin a una larga batalla entre el Big Bang y su rival, la teoría del universo estacionario de Fred Hoyle y otros, que no podía explicar la forma de cuerpo negro del fondo de microondas. Es irónico que el término Big Bang tuviera inicialmente un sentido burlesco y fue acuñado por Hoyle, contrario a la teoría del universo inflacionario que se inventó el término “¡La Gran Explosión!” para burlarse de la teoría.

Según los datos con los que podemos contar se ha elaborado un trayecto que nos cuenta la historia del Universo ¿Será cierta?

|

Cronología del Big Bang |

||

|

Era |

Duración de |

Temperatura |

| Era de Planck |

0 a 10-43 seg. |

a 10-34 K |

| Era de radiación |

10-43 a 30.000 años |

desde 10-34 a 104 K |

| Era de la materia | 30.000 años al presente (13.500.000.000 años). |

desde 104 a 3 K actual |

Los expertos han diseñado un proceso para fijar más claramente los hechos se queriendo extender la explicación evolutiva del universo en las fases principales que son: Eras en la Historia del Big Bang

De la Materia

Es la era que comenzó cuando el efecto gravitacional de la materia comenzó a dominar sobre el efecto de presión de radiación. Aunque la radiación es no masiva, tiene un efecto gravitacional que aumenta con la intensidad de la radiación. Es más, a altas energías, la propia materia se comporta como la radiación electromagnética, ya que se mueve a velocidades próximas a la de la luz. En las etapas muy antíguas del universo, el ritmo de expansión se encontraba dominado por el efecto gravitacional de la presión de radiación, pero a medida que el universo se enfrió, este efecto se hizo menos importante que el efecto gravitacional de la materia. Se piensa que la materia se volvió predominante a una temperatura de unos 104 K, aproximadamente 30.000 años a partir del Big Bang. Este hecho marcó el comienzo de la era de la materia.

De la Radiación

Periodo entre 10-43 s (la era de Planck) y 300.000 años después del Big Bang. Durante este periodo, la expansión del universo estaba dominada por los efectos de la radiación o de las partículas rápidas (a altas energías todas las partículas se comportan como la radiación). De hecho, la era leptónica y la era hadrónica son ambas subdivisiones de la era de radiación. La era de radiación fue seguida por la era de la materia que antes he reseñado, durante la cual los partículas lentas dominaron la expansión del universo.

Con nuestro conocimiento actual de física de partículas de altas energías, podemos hacer avanzar el reloj hacia atrás a través de la teoría leptónica y la era hadrónica hasta una millonésima de segundo después del Big Bang, cuando la temperatura era de 1013 K. Utilizando una teoría más especulativa, los cosmólogos han intentado llevar el modelo hasta 1035 s después de la singularidad, cuando la temperatura era de 1028 K. Esa infinitesimal escala de longitud es conocida como límite de Planck, = 10-35 m, que en la ley de radiación de Planck, es distribuida la energía radiada por un cuerpo negro mediante pequeños paquetes deiscretos llamados cuantos, en vez de una emisión continua. A estas distancias, la Graverdad está ausente para dejar actuar a la mecánica cuántica.

La teoría del Big Bang es capaz de explicar la expansión del universo, la existencia de una radiación de fondo cósmica y la abundancia de núcleos ligeros como el helio, el helio-3, el deuterio y el litio-7, cuya formación se predice que ocurrió alrededor de un segundo después del Big Bang, cuando la temperatura reinante era de 1010 K.

Abundancia de núcleos ligeros en el universo temprano

Era Hadrónica

Corto periodo de tiempo entre 10-6 s y 10-5 s después del Big Bang en el que se formaron las partículas atómicas pesadas, como protones, neutrones, piones y kaones entre otras. Antes del comienzo de la era hadrónica, los quarks se comportaban como partículas libres. El proceso por el que se formaron los quarks se denomina transición de fase quark-hadrón. Al final de la era hadrónica, todas las demás especies hadrónicas habían decaído o se habían desintegrado, dejando sólo protones o neutrones. Inmediatamente después de esto el universo entró en la era leptónica.

Era Leptónica

Intervalo que comenzó unos 10-5 s después del Big Bang, en el que diversos tipos de leptones eran la principal contribución a la densidad del universo. Se crearon pares de leptones y antileptones en gran número en el universo primitivo, pero a medida que el universo se enfrió, la mayor parte de las especies leptónicas fueron aniquiladas. La era leptónica se entremezcla con la hadrónica y ambas, como ya dije antes, son subdivisiones de la era de la radiación. El final de la era leptónica se considera normalmente que ocurrió cuando se aniquilaron la mayor parte de los pares electrón-positrón, a una temperatura de 5×109 K, más o menos un segundo después del Big Bang. Después, los leptones se unieron a los hadrónes para formar átomos.

Así creemos que se formó nuestro universo, a partir de una “singularidad” que explotó expandiendo toda la densidad y energía a unas temperaturas terroríficas, y a partir de ese mismo instante conocido como Big Bang, nacieron, como hermanos gemelos, el tiempo y el espacio junto con la materia que finalmente desembocó en lo que ahora conocemos como universo.

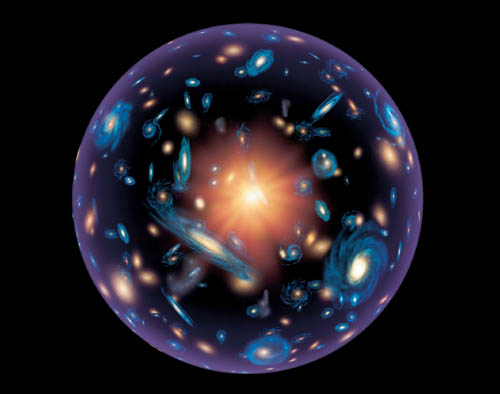

El universo es el conjunto de todo lo que existe, incluyendo el espacio, el tiempo y la materia. El estudio del universo se conoce como cosmología. Los cosmólogos distinguen al Universo con “U” mayúscula, significando el cosmos y su contenido, y el universo con “u” minúscula, que es normalmente un modelo matemático deducido de alguna teoría física como por ejemplo, el universo de Friedmann o el universo de Einstein–de Sitter. El universo real está constituido en su mayoría de espacios que aparentemente están vacíos, existiendo materia concentrada en galaxias formadas por estrellas, planetas, gases y otros objetos cosmológicos.

De los estudios y observaciones realizadas ahora sabemos que, el universo se está expandiendo, de manera que el espacio entre las galaxias está aumentando gradualmente, provocando un desplazamiento al rojo cosmológico en la luz procedente de los objetos distantes.

Un Universo cada vez más grande y más frío, dado que la expansión sigue y la materia se dispersa

Los astrónomos opinan que el 90 por 100 de los átomos de universo son hidrógeno, el 9 por 100 helio y el 1 por 100 elementos más complejos. Una muestra de 100 gramos, o mejor 100 átomos, consistiría entonces en 90 átomos de hidrógeno, 9 de helio y 1 de oxígeno (por ejemplo). Los núcleos de los átomos de hidrógeno contendrían 1 nucleón cada uno: 1 protón. Los núcleos de los átomos de helio contendrían 4 nucleones cada uno: 2 protones y 2 neutrones. El núcleo del átomo de oxígeno contendría 16 nucleones: 8 protones y 8 neutrones. Los 100 átomos juntos contendrían, por tanto, 145 nucleones: 116 protones y 26 neutrones.

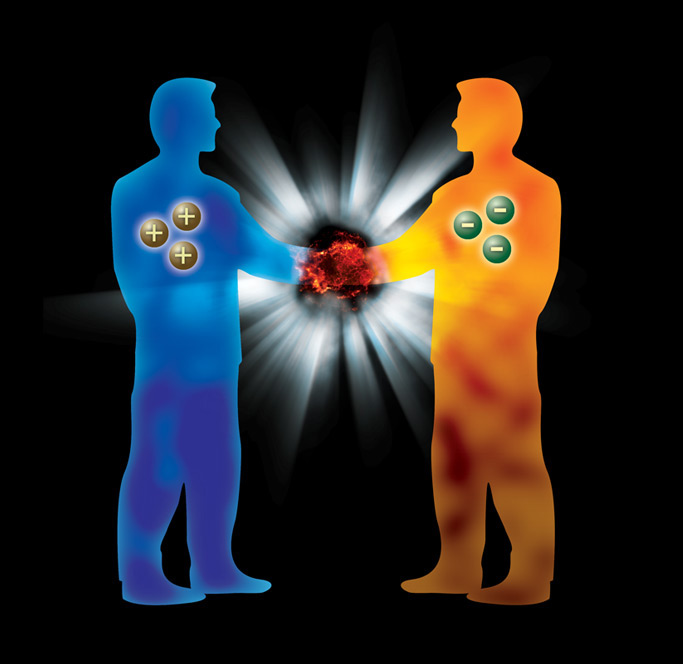

Existe una diferencia entre estos dos tipos de nucleones. El neutrón no tiene carga eléctrica y no es preciso considerar ninguna partícula que lo acompañe. Pero el protón tiene una carga eléctrica positiva, y como el universo es, según creemos, eléctricamente neutro en su conjunto, tiene que existir un electrón (con carga eléctrica negativa) por cada protón, creando así el equilibrio existente.

El Universo, en su conjunto, resulta neutro al estar las fuerzas compensadas y anularse las unas a las otras, es decir, en el núcleo de un átomo están los protones con carga positiva y para que el átomo alcance su estabilidad, el núcleo está orbitado por tantos electrones como protones allí existen y, de esa manera, nuestro mundo, el Universo en su conjunto es como lo podemos ver y, también, es posible nuestra presencia aquí gracias a ese equilibrio de dos fuerzas contrapuestas que se igualan para que todo eso ocurra.

De las demás partículas, las únicas que existen en cantidades importantes en el universo son los fotones, los neutrinos y posiblemente los gravitones, pero son partículas sin masa. Lo cierto es que nadie sabe dar una explicación consistente del origen de la materia y a partir de qué semilla pudo surgir. Sí, sabemos de esas partículas que la forman pero… ¿No habrá algo más que desconocemos?

Isaac Asimov decía que por su parte,

“La respuesta podía estar en la existencia de “energía negativa” que igualara la “energía positiva” ordinaria, pero con la particularidad de que cantidades iguales de ambos se unirían para dar nada como resultado” (es decir, que +1 y -1 sumados dan 0).”

Claro que también, lo que antes era nada podría cambiar de pronto y convertirse en una pompa de “energía positiva” y otra pompa igual de “energía negativa”. De ser así, la pompa de energía positiva se convirtió en el universo que conocemos, mientras que en alguna otra parte, existiría el universo contrario, paralelo negativo.

El universo, en sus comienzos, produjo enormes cantidades de partículas de materia y de antimateria, y el número de una y otra no era igual sino que, no se sabe por qué razón, las partículas positivas eran más que las negativas. Todos sabemos que un protón, cuando se encuentra con un antiprotón (materia con antimateria) ambos se destruyen. Una vez destruidos todos los pares materia antimateria, quedó el sobrante de partículas positivas que es la materia de nuestro universo.

De esa manera se formaron, con esas partículas positivas y los electrones negativos (hadrones y leptones), grandes conglomerados de gas y polvo que giraban lentamente, fragmentándose en vórtices turbulentos que se condensaban finalmente en estrellas. Estos conglomerados de gas y polvo podían tener extensiones de años luz de diámetro y, en algunas regiones donde la formación de estrellas fue muy activa, casi todo el polvo y el gas fue a parar a una estrella u otra. Poco o nada fue lo que quedo en los espacios intermedios. Esto es cierto para los cúmulos globulares, las galaxias elípticas y el núcleo central de las galaxias espirales.

En ese inmenso cúmulo de estrellas está presente una, la estrella π, de la que nos hablaba Camilo Flammarion que imaginó como una gran flota de naves se dirigía hacia aquella lejana estrella, y, se hacía la pregunta: ¿Llegaremos allí algún día? Los que hemos tenido la suerte de leer algunas de sus obras, recordamos algunas como:

La pluralidad de los mundos habitados.

Mundos imaginarios y reales los mundos.

Historias del infinito.

Está claro que hemos podido acceder a muchos conocimientos que no hace mucho tiempo eran impensables pero, las teorías de Einstein y Planck, deben ser sobrepasadas y debemos ir mucho más lejos, allí donde residen esas respuestas que hasta el momento nadie ha sabido dar y que responderán a preguntas que fueron posibles formular, gracias a Einstein y Planck, ya que, sin los conocimientos que ellos nos hicieron llegar, no podríamos intuir que hay muchas cosas que están más allá de sus postulados.

Como a otros muchos antes que yo, me gusta imaginar otros mundos que podrían ser y, si somos capaces de imaginarlos… ¡En alguna parte estarán! De la misma manera, los científicos deben dar rienda suelta a su imaginación y, apoyados en la ciencia que ya nos es familiar, dar un paso más hacia adelante y llegar, a esos otros postulados, a esas nuevas teorías que, haciendo viejas las anteriores, nos lleven hacia el futuro conociendo, ahora sí, un universo real y sin fantasías que, como la del Big Bang, nos tenga inmersos en una gran mentira.

emilio silvera

Mar

18

Las fuerzas de la Naturaleza

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo asombroso ~

Clasificado en El Universo asombroso ~

Comments (2)

Comments (2)

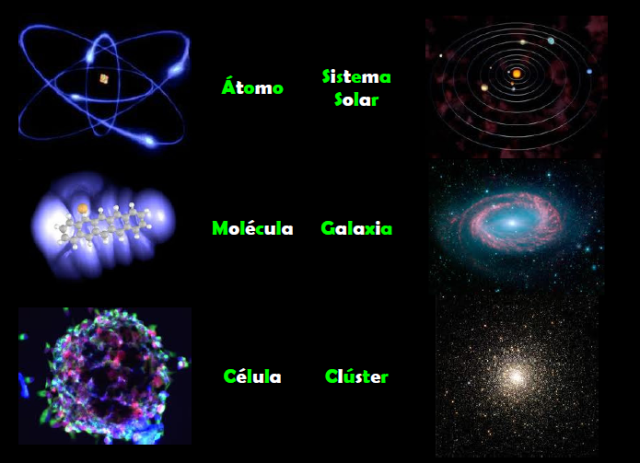

Las fuerzas fundamentales del Universo que rigen en todas sus regiones y son las responsables de imponer el ritmo con el que se comporta la materia que con ellas interacciona y, en consecuencia, hace que cada objeto y cada cosa que en el Cosmos existe, tenga un comportamiento particular que lo define y que va, desde la materia inerte hasta ese otro nivel, mucho más elevado en el que la materia, evolucionada, alcanzó la facultad, no solo ya de moverse por sí misma, sino de generar pensamientos y…¡hasta sentimientos!

El cuadro que arriba nos explica de manera sencilla la interacción nuclear fuerte, interacción nuclear débil, interacción electromagnética e interacción gravitatoria. (WikipediA).

Fuerza nuclear fuerte

Su alcance en metros: < 3 × 10-15, se dice que la propiedad de los quarks conocida como libertad asintótica hace que la interacción entre ellos sea débil cuanto más cerca están los unos de los otros, están confinados con los gluones en un radio o región de: r » hc/L » 10-13 cm. Al contrario de las otras fuerzas, esta crece con la distancia. Tiene una fuerza relativa de 1041. Es la responsable de mantener unidos a los protones y neutrones en el núcleo atómico.

La partícula portadora de la fuerza es el gluón (glue en inglés, es pegamento) que en número de ocho, actúa como un espeso pegamento en forma de muelle que, cuanto más se estira más fuerza genera. La interacción nuclear fuerte es la mayor, la de más potencia de las cuatro fuerzas fundamentales, es 102 veces mayor que la fuerza electromagnética, aparece sólo entre los hadrones (protones, neutrones, etc). Como dijimos al principio, actúa a tan corta distancia como 10-15 metros, mediado por mesones virtuales que llamamos gluones.

Fuerza nuclear débil

Su alcance es de < 10-15 metros, su fuerza relativa de 1028, intervienen en la radiación radiactiva, ocurre entre leptones (electrones, muones, tau y los correspondientes neutrinos asociados) y en la desintegración de los hadrones, la desintegración beta de las partículas y núcleos. Está mediada por el intercambio de partículas virtuales, llamadas bosones vectoriales intermediarios: en este caso, las partículas W+, W– y Z0. Esta interacción se describe por la teoría electrodébil que la unifica con las interacciones electromagnéticas.

Las interacciones electromagnéticas

Tiene un alcance infinito, su fuerza relativa es de 1039, es la responsable de las fuerzas que controlan la estructura atómica, reacciones químicas y todos los fenómenos electromagnéticos. Unen los átomos para formar moléculas, propaga la luz, las ondas de radio y otras formas de energías.

Puede explicar las fuerzas entre las partículas cargadas, pero al contrario de las interacciones gravitacionales, puede ser tanto atractiva como repulsiva. Algunas partículas neutras se desintegran por interacciones electromagnéticas. La interacción se puede interpretar tanto como un campo clásico de fuerzas (ley de Coulomb) como por el intercambio de unos fotones virtuales. Igual que en las interacciones gravitatorias, el hecho de que las interacciones electromagnéticas sean de largo alcance significa que tienen una teoría clásica bien definida dada por las ecuaciones de Maxwell. La teoría cuántica de las interacciones electromagnéticas, se describen con la electrodinámica cuántica, que es una forma sencilla de teoría gauge.

Todo cae por su peso, fuera del espoacio

La interacción gravitacional

La interacción gravitacional, conocida como la fuerza de gravedad, es unas 1040 veces más débil que la interacción electromagnética; es la más débil de todas las fuerzas de la naturaleza. Su alcance, como el de la fuerza electromagnética, es infinito, y su fuerza relativa es de 1. Su función es actuar entre los cuerpos masivos sobre los que ejerce una fuerza atractiva en función de sus masas y de las distancias que los separa, mantienen unidos los planetas alrededor del Sol, las estrellas en las galaxias y nuestros pies pegados a la superficie de la Tierra.

La interacción puede ser comprendida utilizando un campo clásico en el que la intensidad de la fuerza disminuye con el cuadrado de la distancia entre los cuerpos interaccionantes (Ley de Newton). El hipotético cuanto de gravitación, el bosón denominado gravitón, es también un concepto útil en algunos contextos. En la escala atómica, la fuerza gravitacional es despreciablemente débil, pero a escala cosmológica, donde las masas son enormes, es inmensamente importante para mantener el equilibrio entre los componentes del universo.

Sin la fuerza de gravedad, el universo sería un completo caos, todos los planetas, estrellas y demás objetos cosmológicos estarían vagando sin rumbo por el vacío estelar y las colisiones serían lo cotidiano. Debido a que las interacciones gravitacionales son de largo alcance, hay una teoría macroscópica bien definida, que es la relatividad general.

Nuestro Universo (no sabemos si podrían existir otros), es como es, porque las fuerzas que lo rigen son tal y como las hemos descrito más arriba; si alguna de estas fuerzas fueran mínimamente distintas, si la carga o la masa del electrón variaran sólo una millonésima, el universo sería otro muy distinto y, seguramente, nosotros no estaríamos aquí para contarlo.

Todo el conjunto está sometido a un equilibrio que, entre otras cuestiones, hizo posible la existencia de vida inteligente en nuestro universo, al menos, que sepamos, en un planeta insignificante de un sistema solar insignificante situado en la periferia de una de las más de cien mil millones de galaxias que se supone pueblan el Universo. Estadísticamente hablando, sería casi imposible que no existieran otros muchos planetas, en otros sistemas solares, ocupados por seres inteligentes similares o distintos a nosotros. El problema está en que podamos coincidir en el tiempo y en que podamos, de alguna manera, vencer las distancias que nos separan.

Los procesos científicos que comentamos en este lugar, los fenómenos del Universo que hemos debatido y, también, los misterios y secretos que el inmenso Cosmos nos oculta han contribuido, aunque inadvertidamente, a comprometer e involucrar a nuestra especie en la vastedad del universo que ha sido una fuente de misterio y curiosidad para todas las civilizaciones que poblaron la Tierra desde tiempos inmemoriales. La astronomía ha venido a descorrer el velo, que supuestamente, aislaban la Tierra de los ámbitos interestelares que están situados mucho más allá de nuestro Sistema solar, y todo eso nos llevó lejos, al auténtico Universo que ahora, sí conocemos. La Física cuántica llegó para destruir esa barrera invisible que separaba lo grande de lo muy pequeño y que supuestamente, separaba al observador distante del mundo observado; descubrimos que estamos inevitablemente enredados en aquello que estudiamos.

Goethe dice en su Fausto: “primero que todo debéis estudiar la metafísica”. La metafísica es la auténtica disciplina de las grandes escuelas de oriente y occidente afirman enfáticamente que todo fenómeno de la naturaleza se halla íntimamente conectado con todos los fenómenos que le rodean. Ningún fenómeno puede estar aislado y cuando se le estudia aisladamente puede parecer un absurdo. La ley de causa y efecto es el engranaje secreto de la mecánica de la naturaleza.

Hay cuestiones que van mucho más allá de nuestros pensamientos, sobrepasan la propia filosofía y entran en el campo inmaterial de la Metafísica, quizá el único ámbito que realmente pueda explicar lo que la Mente es. Allí reside la esencia de lo complejo, del SER. Ya sabéis:

“Todo estado presente de una sustancia simple es naturalmente una consecuencia de su estado anterior, de modo que su presente está cargado de su futuro.”

En esta “fragua” se forjan estrellas y mundos mediante la transmutación de la materia simple en material complejo que…

La Astrofísica, al demostrar que la materia es la misma en todas partes y que en todas partes obedece a las mismas leyes, reveló una unidad cósmica que se extiende desde la fusión nuclear en las estrellas hasta la química de la vida que allí se produce a lo largo de todo el Universo. La evolución darwiniana, al destacar que todas las especies de la vida terrestre están relacionadas y que todas surgieron de la materia ordinaria, puso de manifiesto que no hay ninguna muralla que nos separe de las otras criaturas de la Tierra, o del planeta que nos dio la vida: que estamos hechos del mismo material del que están hechos los mundos y, de la misma manera (creo), estarán también, formados los otros mundos y las posibles formas de vida que en ellos puedan estar presentes y surjan en el futuro.

Aquel no era un mundo para nosotros y, del espacio llegó la salvación

Hay que pensar en las especies que a lo largo de miles de millones de años se han extinguido en nuestro planeta. Hace ahora algo más de 65 millones de años que desaparecieron los dinosaurios, que reinaron en nuestro planeta durante 150 millones de años. Podemos decir entonces que nuestra especie es una recién llegada al planeta y, aunque es la primera -al menos así parece ser- que tiene conciencia de ser y algo de “racionalidad”, no sabemos por cuánto tiempo estaremos aquí, si nos extinguiremos antes de tener la oportunidad o los medios de contactar con otras inteligencias, o si nuestra manera de ser no nos lleva a la autodestrucción. Pero somos jóvenes, nuestra presencia más rudimentaria en el planeta -el origen- data de sólo 3 millones de años y, habrá que tener la ilusión de que, finalmente, seremos capaces de comprender, donde está el camino a seguir, dejar de lado las cosas superfluas y atender, a lo realmente importante para poder salvar, si la Naturaleza nos deja, a nuestra especie que, tiene su futuro en otros mundos, en otras estrellas que, como ahora el Sol, estén brillando en la secuencia principal… ¡de la Vida!

emilio silvera

Mar

18

¡Estrellas de Quarks! Materia extraña

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física, Misterios del Universo ~

Clasificado en Física, Misterios del Universo ~

Comments (7)

Comments (7)

La Hipótesis de estrella de Quarks (EQs) podrían responder a muchos interrogantes surgidos a partir de observaciones astrofísicas que no coinciden con los modelos canónicos teóricos de las Estrellas de Neutrones ( ENs ). Decimos que son hipotéticas porque se conjetura que estarían formadas por Materia Extraña ( ME ). La comunidad astrofísica espera evidencias observacionales que permitan diferenciarlas de las ENs, ya que podrían explicar un conjunto de observaciones astronómicas que aún resultan una incógnita. Es sabido que una EN es el remanente del colapso de una estrella masiva. El colapso de la estrella, la supernova, da lugar a un núcleo compacto hiperdenso de hierro y otros metales pesados que sigue comprimiéndose y calentándose. Su densidad continúa aumentando, dando lugar a una “neutronización“ (recombinación de electrones con protones que resultan en neutrones) y el gas degenerado de neutrones frena el colapso del remanente.

Se especula con la posibilidad de que existan estrellas de Quarks que estarían hechas de materia extraña de Quaks y Gluones.

Una EQ, a diferencia de una EN, no se originaría necesariamente de una evolución estelar después del agotamiento del combustible nuclear de una estrella normal. Sería, probablemente, producto de la transición de fase hadrón-quark a altísima densidad. La Cromodinámica Cuántica (CDC), la Teoría de las Interacciones Fuertes que ocurren dentro de los nucleones (protones y neutrones), concibe teóricamente la idea de la transición de fase hadrón-quark a temperaturas y/ o densidades extremadamente altas con el consecuente desconfinamiento de quarks y gluones, que formarían una especie de “sopa “. Sin embargo, los quarks libres no se han encontrado aún, en uno u otro límite, en ningún experimento terrestre.

La “sopa“ que mencionamos antes, se conoce como Plasma Quark-Gluón ( PQG ). En el límite de altas temperaturas, el PQG está tratando de obtenerse en el laboratorio y existen fuertes indicios de que se logre con éxito experimentos de altas energías como el Colisionador Relativista de Iones Pesados (conocido por sus siglas en ingles como RHIC) de Brookhaven, New York.

Totales: 83.324.492

Totales: 83.324.492 Conectados: 66

Conectados: 66