Oct

19

¡Imaginación! Un gran tesoro

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Rumores del Saber ~

Clasificado en Rumores del Saber ~

Comments (0)

Comments (0)

Séneca, filósofo estoico romano del siglo primero, dejó para la posteridad una buena muestra de su ingenio

“Llegará un tiempo en los últimos años en que el Océano aflojará los lazos en los que hemos estado atados, en que se revelará una tierra inmensa…y Tule ya no será el más remoto de los paises. Así se expresaba Séneca y quería significar que los lazos que nos atan a nuestro planeta serán rotos algún día, cuando en posesión del conocimiento necesario, podamos volar hacia las lejanas estrellas, a otros mundos, otras “Tierras”, otras gentes y, el concepto de lo remoto, no tendrá sentido entonces, ya que, todo será lo mismo y el aquí y allí, formarán parte de un todo simplemente más grande y sin limitaciones.”

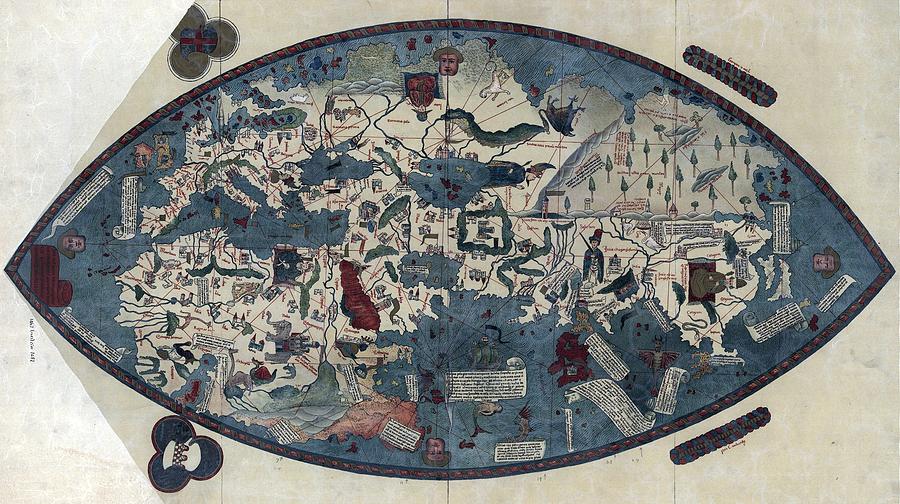

El nuevo despertar de la indagación inteligente de la Naturaleza del espacio cosmológico que asociamos con el Renacimiento tuvo sus raíces en una época de exploraciones terrestres que se inició aproximadamente en el tiempo de las aventuras de Marco Polo en China, en el siglo XIII, y culminó doscientos años más tarde con el (re) descubrimiento de América por Cristobal Colón. La Astronomía y la exploración de la Tierra, por supuesto, estaban relacionadas desde hacía tiempo. Durante milenios los navegantes se habían guiado por las estrellas utilizando sus entonces rísticos instrumentos.

Así lo prueba la costumbre china de llamar “balsas estelares” a sus juncos de mar abierto y la leyenda de que Jasón el argonauta fue el primer hombre que recurrió a las constelaciones para memorizar el cielo nocturno. Cuando Magallanes cruzó el Pacífico, su flota siguió una estrella artificial que consistía en una antorcha encendida colocada en la popa de su barco, y navegó por aguas que habían atravesado miles de años antes los colonizadores de Micronesia, Australia y Nueva Guinea, aventureros tripulantes de canoas que llevaban sus mapas estelares en su cabeza. Virgilio puso de relieve la importancia de observar las estrellas en su relato de la fundación de Roma por Eneas

Y todavía la noche, impulsada por las horas,

No había llegado a la mitad de su curso: de su lecho

Se levanta Palinuro, siempre vigilante,

Examina todos los vientos y capta en su oido

Las brisas; en los cielos silenciosos

Observa las estrellas que los atraviesan,

Arturo, y las lluviosas Híades.

Y las Osas gemelas y Orion cubierta de oro.

Y cuando todo lo que ve está en calma en el cielo despejado,

Da desde la popa la clara señal.

Levantamos el campo, reiniciamos nuestro camino

Ydesplegamos nuestrasa velas.

Y ya el Alba el cielo

Enrojecía mientras huían las estrellas,

Cuando a lo lejos contmplamos las sombreadas colinas

Y abajo Italia. “¡Italia!”

Los exploradores terrestres y los indios también se guiaban por las estrellas, cuando perdidos en el bosque, se reconfortaban mirando el cielo cuyas manos eran la gan endidura que divide la región del Cisne y Sagittario, y a los esclavos que huían hacia el norte a través de los pinos achaparrados de Georgia y el Mississippi se les aconsejaba seguir la calabaza para beber, que se refería a la Osa Mayor. Tolomeo usó su considerable conocimiento de la geografía como apoyo de sus estudios en astronomía; su afirmación de que la Tierra sólo es un punto comparada con la esfera celeste se basaba en parte en el testimonio de viajeros que se aventuraron en dirigirse al sur, en África central, o al norte, hacia Tule, e informaron no haber visto ninguna prueba de que sus desplazamientos los hubiera acercado ni en un mínimo grado a las estrellas en esos parajes del cielo.

La latitud ha sido un parámetro el cual tomaban para guiarse a partir de la polaris y junto con el uso del instrumento llamado sextante. Por la noche, la única guía para los marineros la constituía la esfera del firmamento estrellado. Para el observador terrestre, los astros parecen estar situados sobre la superficie de una gran esfera.

Esta “ esfera” era lo que los antiguos navegantes creían una superficie esférica imaginaria sobre la cual situaban los astros. Esta creencia que sostenian los antiguos marineros reforzaba la idea de que nosotros eramos en centro del universo por miles de años. Las estrellas mas importantes en esta bodeda celeste y que ocupaban para guiarse eran la estrella polar, la cruz del sur, kochab y la canope. tuvieron que aprovechar las constelaciones como las únicas acompañantes nocturnas.

Así, aunque el principal motivo de aquella oleada de exploraciones europeas era económico -aquellos aventureros esperaban obtener grandes fortunas y conquistar grandes tesoros- y se lanzaban al océano esperando poder orientarse, navegando por la ruta oceánica hacia el Este guiado por las estrellas -no es sorprendente enterarse de que uno de sus instigadores fue un astrónomo. Era un florentino llamado Paolo Pozzo Toscanelli, quien subrayaba que en el Este se encontraría conocimiento tanto como riqueza-. En Asia, Toscanelli le escribió tentadoramente a Colón:

En su carta, Toscanelli le decía a Colón:

“…es digna de ser buscada por los latinos, no sólo porque permitiría adquirir una enorme riqueza en forma de oro, plata, gemas preciosas de toda clase y especias que nunca llegan a nosotros, sino también por los hombres eruditos, los sabios filósofos y astrólogos mediante cuyo genio y artes son gobernados esos poderosos y magnificos paises”

Buena parte del atractivo novelesco que coloreaban la imagen Occidental del Este provenían del extraordinario libro de Marco Polo que relataban sus igualmente extraordinarios viajes en China. Marco venía de Venecia, que no era ningún lugar atrasado, pero nada lo había preparado para algo como Hangzhou, que visitó en 1276 y de cuyo impacto nunca se recuperó totalmente. “La más grande ciudad del mundo” -la llamó- donde pueden encontrarse tantos placeres que uno cree estar en el Paraiso”.

Hangzhou estaba a orillas de un lago y en medio de montañas difusas y brumosas, cuya pintira fiel por pintores paisajistas Sung aún sorprende a los ojos occidentales como algo casi demasiado bello para ser verdadero, Marco Polo informaba.

“En medio del lago hay dos islas, en cada una de las cuales se eleva un palacio con un número increíble de grandes habitaciones y pabellones separados. Y cuando alguien desea celebrar una fiesta matrimonial o dar un gran banquete, solía hacerlo en uno de esos pabellones. Y allí se encontraba todo lo necesario para ello gracias a la contribución de todos los ciudadanos que habían contribuído en la medida de sus posibilidades para que, cuando alguien lo necesitara, los pudiera utilizar en esos bellos palacios.”

El espíritu de ese nuevo epicentro aventurero era Segres, una punta terrestre del extremo suroccidental de Europa que penetra en el Océano como un Cabo Cañaveral del Renacimiento. Alli, en 1419, el Principe Enrique el Navegante creo una especie de puerto espacial. En la Biblioteca de Segres se contenía una edición de Marco Polo (traducida por su vagabundo hermano Pedro) y una serie de otros libros que estimulñaron la creencia de muchos de aquellos navegantes aventureros que llegaron a abrior una rura hacia el Este circunnavegando África y abriendo una nueva ruta marina.

Herodoto, Euxodo, Cízico, Estrabón…todos nos hablaron de aquellos viajeros que llegaron más allá de las Columnas de Hércules, en la lejana Tule, esa región en la que Platón sitúo a la Atlántida.

Pero eso es otra historia y, me tengo que preguntar cómo he podido llegar hasta aquí…¡Yo sólo quería hablar de Astronomía!

emilio silvera

Oct

19

¡La Física! Que en su apartado cuántico…¡es extraña!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Sí, muy extraña pero…funciona. Cuando nos sumergimos en el mundo cuántico somos conscientes de que todo ese mundo fantástico de lo muy pequeño va contra la intuición, en nada se parece a nuestro mundo macroscópico y, allí, suceden cosas que nos parecen imposibles. Allí, en el “universo cuántico” se sustituye la continuidad por lo discreto. Se podría decir que no es el agua compacta que forma un todo, sino que, es como la fina arena que está formada por muchos granos que logran pasar desapercibidos en ese conjunto total.

¿Cómo podríamos suponer el carácter fantasmagórico del experimento de la doble rendija?

“El experimento de Young, también denominado experimento de la doble rendija, fue realizado en 1801 por Thomas Young, en un intento de discernir sobre la naturaleza corpuscular u ondulatoria de la luz. Young comprobó un patrón de interferencias en la luz procedente de una fuente lejana al difractarse en el paso por dos rejillas, resultado que contribuyó a la teoría de la naturaleza ondulatoria de la luz.

Posteriormente, la experiencia ha sido considerada fundamental a la hora de demostrar la dualidad onda corpúsculo, una característica de la mecánica cuántica. El experimento también puede realizarse con electrones, protones o neutrones, produciendo patrones de interferencia similares a los obtenidos cuando se realiza con luz.”

Otro fenómeno que va contra la intuición es el “efecto túnel”. Los electrones son capaces de atravesar un túnel a través de una barrera de potencial estrecha hacia una región que estaría prohibida si los electrones fuesen tratados como partículas clásicas. El que haya una probabilidad finita de que un electrón haga un túnel entre una región clásicamente permitida a otra surge como consecuencia de la mecánica cuántica. El efecto túnel es usado en el diodo túnel. La desintegración alfa es un ejemplo de proceso de efecto túnel.

Nuestra descripción de lo que les pasa a los electrones que se dirigren hacia una barrera de energía o a un electrón atrapado entre dos barreras debe tener en cuenta las ondas probabilistas. Hay una probabilidad finita de que la partícula atrapada aparezca fuera de la trampa. Esto no sólo va contra la intuición, sino que se puede considerar una paradoja de orden mayor, pues el electrón a su paso por la barrera debía tener una energía cinética negativa, lo que, desde el punto de vista clásico, es absurdo.

Claro que, cuando se desarrolla la intuición cuántica, uno puede responder que la condición de que el electrón “esté en el túnel” no mes aobservable y por lo tanto no es un problema de la física. Lo que uno observa es que se sale fuera. Este fenómeno, el paso por efecto túnel, se utilizó (como ya he dicho) para explicar la radiactividad Alfa. Por fantasmagórico que sea, este “efecto túnel” les es esencial a los ordenadores modernos y a otros muchos dispositivos electrónicos.

Partículas puntuales, paso por efecto túnel, radiactividad, la tortura de la rendija doble: todo esto contribuyó a las nuevas intuiciones que los físicos cuánticos necesitaron a medida que fue posible desplegar todo su armamento intelectual a la búsqueda de fenómenos inexplicables.

Todo son átomos: Los mundos con sus ríos y montañas, los seres vivos, las estrellas y las galaxias, todo sin excepción… ¡átomos! Y, lo sorprendente es que, nosotros, hayamos podido llegar tan lejos y conocer lo que la materia es (al menos en parte), poder dilucidar entre esos dos “universo” de lo grande y lo pequeño.

Gracias a los acontecimientos que están recogidos en el período que va desde 1923 a 1927, se pudo comprender el átomo. Aún así, en esos días previos a los ordenadores, sólo se podían utilizar adecuadamente los átomos simples -el hidrógeno, el helio, el litio y los átomos a los que se les han quitado algunos electrones (ionizado)-. Aquí, no cabe más remedio que reconocer el gran avance debido a Wolfgan Pauli, él entendió la mecánica cuántica desde muy joven, con 19 años ya era todo un experto y supo, intuir, dónde estaba la “materia perdida”.

Los físicos se vieron durante mucho tiempo turbados por el hecho de que a menudo, la partícula beta emitida en una desintegración del núcleo no alberga energía suficiente para compensar la masa perdida por el núcleo. En realidad, los electrones no eran igualmente deficitarios. Emergían con un amplio espectro de energías, y el máximo (conseguido por muy pocos electrones), era casi correcto, pero todos los demás no llegaban a alcanzarlo en mayor o menor grado. Las partículas alfa emitidas por un nucleido particular poseían iguales energías en cantidades inesperadas. En ese caso, ¿qué era errónea en la emisión de partículas beta? ¿Qué había sucedido con la energía perdida?

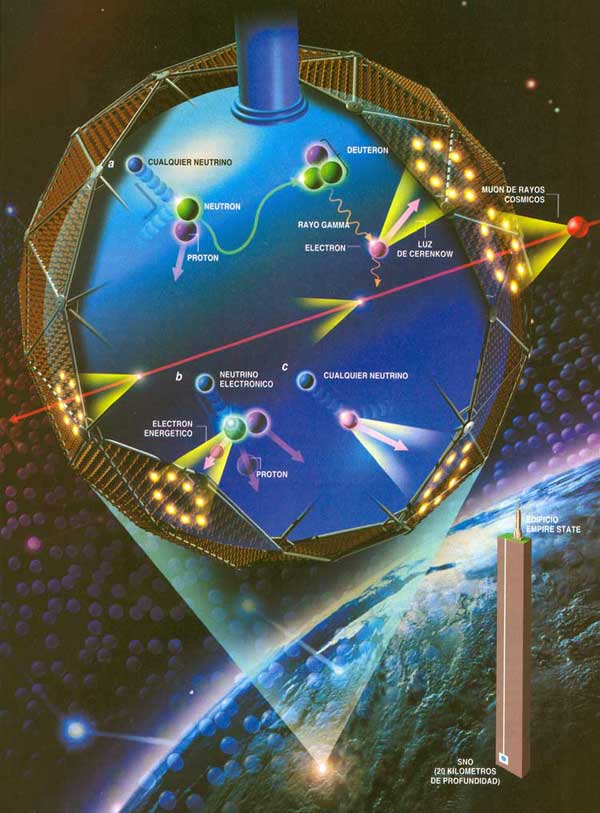

Todo parece indicar que los neutrinos…¡sí tienen masa!

En 1.922, Lise Maitner se hizo por primera vez esta pregunta, y, hacia 1.930, Niels Bohr estaba dispuesto a abandonar el gran principio de conservación de la energía, al menos en lo concerniente a partículas subatómicas. En 1.931, Wolfgang Pauli sugirió una solución para el enigma de la energía desaparecida.

Tal solución era muy simple: junto con la partícula beta del núcleo se desprendía otra, que se llevaba la energía desaparecida. Esa misteriosa segunda partícula tenía propiedades bastante extrañas. No poseía carga ni masa. Lo único que llevaba mientras se movía a la velocidad de la luz era cierta cantidad de energía. A decir verdad, aquello parecía un cuerpo ficticio creado exclusivamente para equilibrar el contraste de energías.

Sin embargo, tan pronto como se propuso la posibilidad de su existencia, los físicos creyeron en ella ciegamente. Y esta certeza se incrementó al descubrirse el neutrón y al saberse que se desintegraba en un protón y se liberaba un electrón, que, como en la decadencia beta, portaba insuficientes cantidades de energía. Enrico Fermi dio a esta partícula putativa el nombre de “neutrino”, palabra italiana que significa “pequeño neutro”.

“Las partículas gamma son radiaciones electromagnéticas de la misma naturaleza que los rayos X pero de menor longitud de onda. Su poder de penetración es muy elevado frente al de las partículas alfa o beta, pudiendo atravesar el cuerpo humano. Quedan frenadas con espesores de 1 m de hormigón o unos pocos cm de plomo, por lo que cuando se utilizan fuentes radiactivas que emiten este tipo de radiación, hay que utilizar blindajes adecuados.”

Pero sigamos con nuestro trabajo de hoy. El neutrón dio a los físicos otra prueba palpable de la existencia del neutrino. Como ya he comentado en otras ocasiones, casi todas las partículas describen un movimiento rotatorio. Esta rotación se expresa, más o menos, en múltiples de una mitad según la dirección del giro. Ahora bien, el protón, el neutrón y el electrón tienen rotación de una mitad. Por tanto, si el neutrón con rotación de una mitad origina un protón y un electrón, cada uno con rotación de una mitad, ¿qué sucede con la ley sobre conservación del momento angular? Aquí hay algún error. El protón y el electrón totalizan una mitad con sus rotaciones (si ambas rotaciones siguen la misma dirección) o cero (si sus rotaciones son opuestas); pero sus rotaciones no pueden sumar jamás una mitad. Sin embargo, por otra parte, el neutrino viene a solventar la cuestión.

Supongamos que la rotación del neutrón sea +½. Y admitamos también que la rotación del protón sea +½ y la del electrón -½, para dar un resultado neto de o. Demos ahora al neutrino una rotación de +½, y la balanza quedará equilibrada.

+½(n)=+½(p)-½(e)+½(neutrino)

Pero aun queda algo por equilibrar. Una sola partícula (el neutrón) ha formado dos partículas (el protón y el electrón), y, si incluimos el neutrino, tres partículas. Parece más razonable suponer que el neutrón se convierte en dos partículas y una antipartícula. En otras palabras: lo que realmente necesitamos equilibrar no es un neutrino, sino un antineutrino.

“25 noviembre 2011. Físicos investigadores trabajando en el experimento Double Chooz han detectado la desaparición de antineutrinos electrónicos durante su recorrido desde el núcleo de los reactores hasta el detector situado a algo mas de 1 Km de distancia.

Este resultado, que ha sido presentado en la Conferencia LowNu de Seul, en Corea, servirá para determinar el valor del hasta ahora desconocido ángulo de mezcla q13, que es un parametro fundamental con importantes implicaciones para la física de partículas y de astropartículas.”

Pero sigamos con lo nuestro. El propio neutrino surgiría de la conversación de un protón en un neutrón. Así, pues, los productos serían un neutrón (partícula), un positrón (antipartícula) y un neutrino (partícula). Esto también equilibra la balanza.

En otras palabras, la existencia de neutrinos y antineutrinos debería salvar no una, sino tres, importantes leyes de conservación: la conservación de la energía, la de conservación del espín y la de conservación de partícula/antipartícula.

Es importante conservar esas leyes puesto que parece estar presentes en toda clase de reacciones nucleares que no impliquen electrones o positrones, y sería muy útil si también se hallasen presentes en reacciones que incluyesen esas partículas.

Las más importantes conversiones protón–neutrón son las relaciones con las reacciones nucleares que se desarrollan en el Sol y en los astros. Por consiguiente, las estrellas emiten radiaciones rápidas de neutrinos, y se calcula que tal vez pierdan a causa de esto el 6 u 8 % de su energía. Pero eso, sería meternos en otra historia y, por mi parte, con la anterior explicación solo trataba de dar una muestra del ingenio del hombre que, como habréis visto, no es poco.

Desde que puedo recordar, he sido un amante de la Física. Me asombran cuestiones como la luz, su naturaleza de un conglomerado de colores, ondas y partículas, su velocidad que nos marca el límite del máximo que podemos correr en nuestro Universo, y en fin, muchos otros misterios que encierra esa cosa tan cotidiana que nos rodea y lo inunda todo haciendo posible que podamos ver por donde vamos, que las plantas vivan y emitan oxígeno o que nos calentemos. Realmente, sin luz, nuestra vida no sería posible.

Entonces, ¿qué es realmente la luz?

Sí, hemos llegado a saber muchas cosas pero… lo que realmente es la luz…queda lejos aún

Generalmente es sabido que “todos” opinan que la luz, es algo inmaterial. Los objetos materiales, grandes o muy pequeños como las galaxias o los electrones, son materia. La luz, sin embargo, se cree que es inmaterial, dos rayos de luz se cruzan sin afectarse el uno al otro. Sin embargo, yo opino que la luz es simplemente una forma de energía lumínica, otra forma en la que se puede presentar la materia. Ya nos lo dijo Einstein: E = mc2, y, si materia es energía y energía materia… ¿qué es el fotón?

Está claro que, los estudiosos de la época antigua y medieval estaban por completo a oscuras acerca de la naturaleza de la luz. Especulaban sobre que consistía en partículas emitidas por objetos relucientes o tal vez por el mismo ojo. Establecieron el hecho de que la luz viajaba en línea recta, que se reflejaba en un espejo con un ángulo igual a aquel con el que el rayo choca con el espejo, y que un rayo de luz se inclina (se refracta) cuando pasa del aire al cristal, al agua o a cualquier otra sustancia transparente.

Cuando la luz entra en un cristal, o en alguna sustancia transparente, de una forma oblicua (es decir, en un ángulo respecto de la vertical), siempre se refracta en una dirección que forma un ángulo menor respecto de la vertical. La exacta relación entre el ángulo original y el ángulo reflejado fue elaborada por primera vez en 1.621 por el físico neerlandés Willerbrord Snell. No publicó sus hallazgos y el filósofo francés René Descartes descubrió la ley, independientemente, en 1.637.

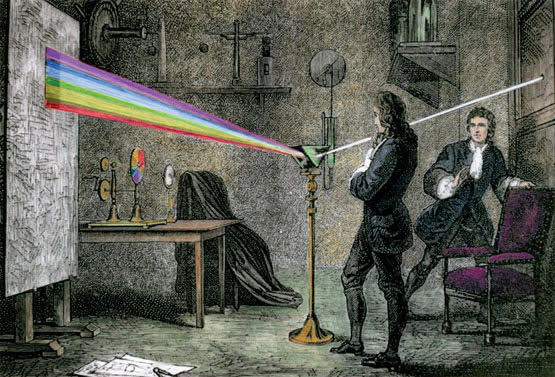

Los primeros experimentos importantes acerca de la naturaleza de la luz fueron llevados a cabo por Isaac Newton en 1.666, al permitir que un rayo de luz entrase en una habitación oscura a través de una grieta e las persianas, cayendo oblicuamente sobre una cara de un prisma de cristal triangular. El rayo se refracta cuando entra en el cristal y se refracta aún más en la misma dirección cuando sale por una segunda cara del prisma. (Las dos refracciones en la misma dirección se originan por que los dos lados del prisma de se encuentran en ángulo en vez de en forma paralela, como sería el caso en una lámina ordinaria de cristal.)

Newton atrapó el rayo emergente sobre una pantalla blanca para ver el efecto de la refracción reforzada. Descubrió que, en vez de formar una mancha de luz blanca, el rayo se extendía en una gama de colores: rojo, anaranjado, amarillo, verde, azul, y violeta, en este orden.

Newton dedujo de ello que la luz blanca corriente era una mezcla de varias luces que excitaban por separado nuestros ojos para producir las diversas sensaciones de colores. La amplia banda de sus componentes se denominó spectrum (palabra latina que significa “espectro” fantasma). Newton llegó a la conclusión de que la luz se componía de diminutas partículas (“corpúsculos”), que viajaban a enormes velocidades.

Le surgieron y se planteó algunas inquietudes cuestiones. ¿Por qué se refractaban las partículas de luz verde más que los de luz amarilla? ¿Cómo se explicaba que dos rayos de luz se cruzaran sin perturbase mutuamente, es decir, sin que se produjeran colisiones entre partículas?

En 1.678, el físico neerlandés christian Huyghens (un científico polifacético que había construido el primer reloj de péndulo y realizado importantes trabajos astronómicos. Hoy, la sonda en Titán, lleva su nombre) propuso una teoría opuesta: la de que la luz se componía de minúsculas ondas. Y si sus componentes fueran ondas, no sería difícil explicar los diversos difracciones de los diferentes tipos de luz a través de un medio refractante, siempre y cuando se aceptara que la luz se movía más despacio en ese medio refractante que en el aire. La cantidad de refracción variaría con la longitud de las ondas: cuanto más corta fuese tal longitud, tanto mayor sería la refracción. Ello significaba que la luz violeta (la más sensible a este fenómeno) debía de tener una longitud de onda mas corta que la luz azul, ésta, más corta que la verde, y así sucesivamente.

Lo que permitía al ojo distinguir los colores eran esas diferencias entre longitudes de onda. Y, como es natural, si la luz estaba integrada por ondas, dos rayos podrían cruzarse sin dificultad alguna. (Las ondas sonoras y las del agua se cruzan continuamente sin perder sus respectivas identidades.)

Pero la teoría de Huyqhens sobre las ondas tampoco fue muy satisfactoria. No explicaba por qué se movían en línea recta los rayos luminosos; ni por qué proyectaban sobras recortadas; ni aclaraba por qué las ondas luminosas no podían rodear los obstáculos, del mismo modo que pueden hacerlo las ondas sonoras y de agua. Por añadidura, se objetaba que si la luz consistía en ondas, ¿cómo podía viajar por el vacío, ya que cruzaba el espacio desde el Sol y las Estrellas? ¿Cuál era esa mecánica ondulatoria?

Muchos otros han tratado de profundizar en la naturaleza de la Luz, y, aunque sabemos bastante de ella, no por eso podemos decir a ciencia cierta: ¡Sabemos lo que la luz es!, ya que, la Naturaleza, escondealgunos secretos que tenemos que desvelar y, al igual que nos pasa con nuestras mentes, no hemos podido resolver el problema, principalmente, porque nosotros somos parte integrante de él:

¡Somos Universo, Somos luz, Somos Pensamientos!

Pero, ¿no estaba hablando de los extraños fenómenos de la mecánica cuántica? No puedo remediarlo, veo pasar una idea por delante de mi mente y…la sigo. Como nos decía el inolvidable Richard Feyman;

“Creo que es justo decir que nadie comprende la mecánica cuántica. No siga diciéndose a sí mismo, si puede evitarlo, “¿pero cómo puede ser así?” porque usted se meterá “hasta el fondo” en un callejón sin salida del que nadie ha escapado. Nadie sabe como puede ser eso”. De hecho, a menudo se ha dicho que de todas las teorías propuestas en el siglo XX, la más absurda es la teoría cuántica. Algunos dicen que la única cosa que la teoría tiene a su favor es que “es indudablemente correcta”.

La física cuántica empezó a enseñarnos que no debemos estar tan seguros de las reglas del espacio y del tiempo, que hasta ese entonces parecían muy confiables e invariables.

Hace algún tiempo que salió la noticia un descubrimiento en la universidad de Oxford que confirma una polémica teoría sobre el espacio y el tiempo. La teoría de los Muchos Mundos, presentada a la comunidad científica hace exactamente 50 años, proponía que existen un número infinito de realidades: una para cada posible escenario producto de cada decisión que cada ser viviente toma en cada momento de su vida.

Esto nos lleva a un escenario con tantos universos como decisiones e interacciones posibles, multiplicado por tantos seres vivientes como existan. La teoría de los Muchos Mundos se planteó como una respuesta al extraño comportamiento que tiene la materia a nivel subatómico. En la primera mitad del siglo XX la ciencia permitió por primera vez observar lo muy pequeño, y la realidad a ese nivel dejó perplejos a los científicos.

En esas dimensiones hay paradojas que chocan contra el sentido común, como por ejemplo el hecho de que una partícula subatómica puede estar en dos sitios al mismo tiempo. Esta revista puede estar en sus manos o en el librero, pero no puede estar en sus manos y en el librero al mismo tiempo. La física cuántica empezó a enseñarnos que no debemos estar tan seguros de las reglas del espacio y del tiempo, que hasta ese entonces parecían muy confiables e invariables.

Es difícil comprender que podamos estar, al mismo tiempo, en este mundo y en otro mucho más lejano que, situado en otra galaxia, nos pueda estar dando acogida al mismo tiempo que lo hace la Vía Láctea. Sin embargo, en el caso de las partículas subatómicas y, según la extraña mecánica cuántica, eso sería posible.

Sí, amigo Jackie Chan, esto puede volver loco a cualquiera… ¡También a mi!

emilio silvera

Oct

19

La Física es imaginativa

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (1)

Comments (1)

Para no viajar muy atrás en el tiempo, fijaremos el punto de partida en 1687, fecha en que salió a la luz la Obra de Newton, sus Principas. El tiempo transcurrió hasta 1900, fecha en la que Planck publicó un artículo de ocho páginas con su idea del cuanto que sería la semilla que daría lugar al nacimiento de la mecánica cuántica. En 1905, aquel joven de la Oficina de Patentes de Berna, sorprendió al mundo de la Física con su Teoría de la Relatividad Especial. Se produjeron muchos desarrollos importantes para nuestras imágenes de la Física Fundamental. Uno de los mayores cambios ocurrido en ese período fue la comprensión, básicamente mediante los trabajos de Faraday y Maxwell en el siglo XIX, de que cierta noción de campo físico, que permea en el espacio, debe cohexistir con la previamente aceptada “realidad newtoniana” de las partículas individuales que interaccionan por medio de fuerzas instantáneas.

Mundos que giran alrededor de una estrella formando sistemas planetarios, galaxias que forman inmensos cúmulos, fuerzas electromagnéticas y de gravedad que hacen posibles fenómenos que ponen en marcha los mecanismos del universo visible y, con su presencia “invisible”, hacen sin embargo posible una serie de resultados físicos que en la vida cotidiana tenemos y constatamos a nuestro alrededor.

La noción de “campo” se convirtió también en un ingrediente crucial de la teoría de la Gravedad en un espaciotiempo curvo a la que llegó Einstein en 1915. Lo que ahora denominamos campos clásicos son el Campo Electromagnético de Maxwell y el Campo Gravitatorio de Einstein.

Estamos inmersos en un Universo regido por cuatro fuerzas fundamentales que hacen posible, entre otras cosas, que estemos aquí.

La presencia del campo gravitatorio de una masa afecta al tiempo y al espacio. La gravedad hace que dos relojes atrasen. Un reloj en la superficie de la Tierra atrasa con respecto a un reloj en la Luna, toda vez que el campo gravitatorio de la Tierra es más potente. De la misma manera, nos podríamos preguntar ¿por qué la gravedad actúa sobre el espacio y alarga el tamaño de los objetos (estirándolos). ¿Dónde podríamos crecer más, si viviéramos en la Tierra o en la Luna?

Pero sigamos. Hoy día sabemos que hay mucho más en la Naturaleza del mundo físico que la sola física clásica. Ya en 1900 -como decimos antes- Max Planck había reveleado los primeros indicios de la necesidad de una “teoría cuántica”, aunque se necesitó un cuarto de siglo más antes de que pudiera ofrecerse una teoría bien formulada y global. También debería quedar claro que, además de todos estos profundos cambios que se han producido en los fundamentos “newtonianos” de la física, ha habido otros desarrollos importantes, tanto previos a dichos cambios como coexistentes con algunos de ellos en forma de poderosos avances matemáticos, dentro de la propia teoría newtoniana.

En 1905 un desconocido Albert Einstein publicaría unos espectaculares estudios sobre la teoría de la relatividad, pero muy pocos científicos, entre ellos Planck, reconocerían inmediatamente la relevancia de esta nueva teoría científica. Tanta fue su importancia que incluso Planck contribuyo a ampliarla.

Pero igualmente, la hipótesis de Einstein sobre la ligereza del quantum (el fotón), basada en el descubrimiento de Philipp Lenard de 1902 sobre el efecto fotoeléctrico fue rechazada por Planck, al igual que la teoría de James Clerk Maxwell sobre la electrodinámica.

En 1910 Einstein desafía la explicación de la física clásica poniendo el ejemplo del comportamiento anómalo del calor específico en bajas temperaturas. Planck y Nernst decidieron organizar la primera Conferencia de Solvay, para clarificar las contradicciones que aparecían en la física. En esta reunión celebrada en Bruselas en 1911, Einstein consiguió convencer a Planck sobre sus investigaciones y sus dudas, lo que hizo forjar una gran amistad entre ambos científicos, y conseguir ser nombrado profesor de física en la universidad de Berlín mientras que Planck fue decano.

Otra área importante de avance sobre la que había que llamar la atención es la termodinámica (y su refinamiento conocido como mecánica estadística). Esta estudia el comportamiento de sistemas de un gran número de cuerpos, donde los detalles de los mocimientos no se consideran importantes y el comportamiento del sistema se describe en términos de promedios de las magnitudes adecuadas. Esta fue una empresa iniciada entre mediados del XIX y principios del XX, y los nombres de Carnot Clausius, Maxwell, Boltzmann, Gibbs y Einstein son los protagonistas.

Termodinámica.- Parte de la física que estudia las relaciones existentes entre los fenómenos dinámicos y los caloríficos. Trata de la transformación de la energía mecánica en calor y del calor en trabajo. También describe y relaciona las propiedades físicas de sistemas macroscópicos de materia y energía. La termodinámica estudia los sistemas que se encuentran en equilibrio. Esto significa que las propiedades del sistema—típicamente la presión, la temperatura, el volumen y la masa— son constantes.

Un concepto esencial de la termodinámica es el de sistema macroscópico, que se define como un conjunto de materia que se puede aislar espacialmente y que coexiste con un entorno infinito e imperturbable. El estado de un sistema macroscópico en equilibrio puede describirse mediante propiedades medibles como la temperatura, la presión o el volumen, que se conocen como variables termodinámicas. Es posible identificar y relacionar entre sí muchas otras variables (como la densidad, el calor específico, la compresibilidad o el coeficiente de expansión térmica), con lo que se obtiene una descripción más completa de un sistema y de su relación con el entorno. Cuando un sistema macroscópico pasa de un estado de equilibrio a otro, se dice que tiene lugar un proceso termodinámico. Las leyes o principios de la termodinámica, descubiertos en el siglo XIX a través de meticulosos experimentos, determinan la naturaleza y los límites de todos los procesos termodinámicos.

¿Cuales son los Principios de la Termodinámica?

Cuando dos sistemas están en equilibrio mutuo, comparten una determinada propiedad. Esta propiedad puede medirse, y se le puede asignar un valor numérico definido. Una consecuencia de ese hecho es el principio cero de la termodinámica, que afirma que si dos sistemas distintos están en equilibrio termodinámico con un tercero, también tienen que estar en equilibrio entre sí. Esta propiedad compartida en el equilibrio es la temperatura. Si uno de estos sistemas se pone en contacto con un entorno infinito situado a una determinada temperatura, el sistema acabará alcanzando el equilibrio termodinámico con su entorno, es decir, llegará a tener la misma temperatura que éste.

Primer Principio.-

La cantidad de calor entregado a un sistema es igual al trabajo realizado por el sistema más la variación de su energía interna. Cuando un sistema se pone en contacto con otro más frío que él, tiene lugar un proceso de igualación de las temperaturas de ambos. Para explicar este fenómeno, los científicos del siglo XVIII conjeturaron que una sustancia que estaba presente en mayor cantidad en el cuerpo de mayor temperatura fluía hacia el cuerpo de menor temperatura. El primer principio es una ley de conservación de la energía. Afirma que, como la energía no puede crearse ni destruirse —dejando a un lado las posteriores ramificaciones de la equivalencia entre masa y energía— la cantidad de energía transferida a un sistema en forma de calor más la cantidad de energía transferida en forma de trabajo sobre el sistema debe ser igual al aumento de la energía interna del sistema. A veces, el primer principio se enuncia como la imposibilidad de la existencia de un móvil perpetuo de primera especie.

Flujo de la energía en los ecosistemas. En los ecosistemas se cumplen pues el primer y segundo principio de la termodinámica.

Segundo Principio.-

El segundo dice que solamente se puede realizar un trabajo mediante el paso del calor de un cuerpo con mayor temperatura a uno que tiene menor temperatura. Al respecto, siempre se observa que el calor pasa espontáneamente de los cuerpos calientes a los fríos hasta quedar a la misma temperatura. La segunda ley afirma que la entropía, o sea, el desorden, de un sistema aislado nunca puede decrecer. Por tanto, cuando un sistema aislado alcanza una configuración de máxima entropía, ya no puede experimentar cambios: ha alcanzado el equilibrio. La naturaleza parece pues ‘preferir’ el desorden y el caos. Puede demostrarse que el segundo principio implica que, si no se realiza trabajo, es imposible transferir calor desde una región de temperatura más baja a una región de temperatura más alta. El segundo principio impone una condición adicional a los procesos termodinámicos. No basta con que se conserve la energía y cumplan así el primer principio. Una máquina que realizara trabajo violando el segundo principio se denomina “móvil perpetuo de segunda especie”, ya que podría obtener energía continuamente de un entorno frío para realizar trabajo en un entorno caliente sin coste alguno. A veces, el segundo principio se formula como una afirmación que descarta la existencia de un móvil perpetuo de segunda especie.

![[espejo.jpg]](http://1.bp.blogspot.com/_RbcHwhHyNUU/ShpFYOgM4zI/AAAAAAAAAYM/_aVI4zFB9pQ/s1600/espejo.jpg)

Tercer principio de termodinámica o principio onfalóscópico, (mirarse el ombligo): La televisión se retroalimenta a sí misma. Se hace televisión para hablar sobre televisión.

Tercer Principio.-

El cero absoluto es el cero en la escala Kelvin, el equivalente a -273,15º C, pero… ¿qué significa? ¿la ausencia de calor? ¿la temperatura más baja posible?

El tercer principio de la termodinámica afirma que el cero absoluto no puede alcanzarse por ningún procedimiento que conste de un número finito de pasos. Es posible acercarse indefinidamente al cero absoluto, pero nunca se puede llegar a él.

Ciclos termodinámicos.-

Todas las relaciones termodinámicas importantes empleadas en ingeniería se derivan del primer y segundo principios de la termodinámica. Resulta útil tratar los procesos termodinámicos basándose en ciclos: procesos que devuelven un sistema a su estado original después de una serie de fases, de manera que todas las variables termodinámicas relevantes vuelven a tomar sus valores originales. En un ciclo completo, la energía interna de un sistema no puede cambiar, puesto que sólo depende de dichas variables. Por tanto, el calor total neto transferido al sistema debe ser igual al trabajo total neto realizado por el sistema. Un motor térmico de eficiencia perfecta realizaría un ciclo ideal en el que todo el calor se convertiría en trabajo mecánico. El científico francés del siglo XIX Sadi Carnot, que concibió un ciclo termodinámico que constituye el ciclo básico de todos los motores térmicos, demostró que no puede existir ese motor perfecto. Cualquier motor térmico pierde parte del calor suministrado. El segundo principio de la termodinámica impone un límite superior a la eficiencia de un motor, límite que siempre es menor del 100%. La eficiencia límite se alcanza en lo que se conoce como ciclo de Carnot.

- Gravitación

- Luz

- Atracción y repulsión eléctricas

- Atracción y repulsión magnéticas

Pero sigamos con el objeto principla de este trabajo del que, como siempre me pasa, me he desviado a la termodinámica (veo pasar una mosca y la sigo). Aquí hablamos de los “campos clásicos” y, sobre las teorías físicas de campos de Maxwell y Einstein: la física “clásica” ¿Cómo pudieron hablar y describir a la perfección suscesos que el ojo no podía ver, y, simplemente con la imaginación, lo hicieron posible, hasta tal punto que, cuando hablamos de campos electromagnéticos o gravitatorios, en nuestras mentes se instalan las imágenes de unos y otros que podemos “ver” con toda precisión.

La teoría del electromagnetismo desempeña también un papel importante en la teoría cuántica, pues proporciona el “campo” arquetípico para el desarrollo posterios de la teoría cuántica de campos. Por el contrario, el enfoque cuántico apropiado del campo gravitatorio sigue siendo enigmático, escurridizo y controvertido y, abordar ahora aquí estas complejas cuestiones, seguramente daría lugar a explicaciones farragosas debido a mi ignorancia profunda en esos conocimientos y a la levedad de los que puedo poseer.

Los campos de fuerza de Faraday han dado lugar a que, la imaginación se desboque y corriendo hacia el futuro, haya imaginado inmensas ciudades que, situadas en lugares imposibles, sostienen sin problema a sus habitantes que, resguardados por un “campo de fuerza” están al resguardo de cualquier peligro que del exterior les pueda venir.

Por ahí arriba me refería al hecho de que ya en el siglo XIX se había iniciado un cambio profundo en los fundamentos newtonianos, antes de las revoluciones de la relatividad y la teoría cuántica en el siglo XX. El primer indicio de que sería necesario un cambio semejante se produjo con los maravillosos descubriumientos experimentales de Faraday (del que hablamos hoy) hacia 1833, y de las representaciones de la realidad que encontró necesarias para acomodar dichos descubrimientos. Básicamente, el cambio fundamental consistió en considerar que las “partículas newtonianas” y las fuerzas” que actúan entre ellas no son los únicos habitantes de nuestro universo.

A partir de ahí había que tomar en serio la idea de un “campo” con una existencia propia incorpórea. Y, fue entonces cuando se produjo la providencial llegada de Maxwell que, al contrario de Faraday, él si entendía bien el complejo mundo de las matemáticas y, en 1864, formuló las ecuaciones que debe satisfacer este “campo” incorpóreo, y quien demostró que estos campos pueden transportar energía de un lugar a otro.

¿ Transmutando energía?

Las ecuaciones de Maxwell unificaban el comportamiento de los campos eléctricos, los campos magnéticos e incluso la luz, y hoy día son conocidas como las ecuaciones de Maxwell, las primeras entre las ecuaciones de campo relativistas. Desde la perspectiva del siglo XX se han hecho profundos cambios y se ha producido profundos avances en las técnicas matemáticas, las ecuaciones de Maxwell parecen tener una naturalidad y simplicidad concincentes que nos hacen preguntarnos cómo pudo considerarse alguna vez que el campo electromagnético pudiera obedecer a otras leyes. Pero semejante perspectiva ignora el hecho de que fueron las propias ecuaciones de Maxwell las que llevaron a muchos de estos desarrollos matemáticos. Fue la forma de estas ecuaciones la que indujo a Lorentz, Poincaré y Einstein a las transformaciones espaciotemporales de la relatividad especial, que, a su vez, condujeron a la concepción de Minkowaki del espaciotiempo.

¡La Mente Humana! ¿Hasta donde podrá llegar? ¿Qué limite tendrá impuesto? La respuesta es sencilla: ¡No hay límites! Y, aunque dicha afirmación la repita en muchos de mis escritos, y, aunque a algunos les parezca un sueño…, esa es….amigos míos, la realidad.

emilio silvera

Totales: 86.896.144

Totales: 86.896.144 Conectados: 71

Conectados: 71