Oct

23

¿Dos verdades incompatibles?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (3)

Comments (3)

El mundo de la Física tiene planteado un gran problema y los físicos son muy conscientes de ello, conocen su existencia desde hace décadas. El problema centra la gran aventura de la Física actual y consiste en hallar una formulación que combine las dos grandes teorías de la Ciencia: La Relatividad y la Mecánica Cuántica. Aunque parece que, tal matrimonio, resulta imposible y que, los contrayentes son imcompatibles.

Lo grande y lo pequeño: La Escala del Universo.

Existen dos pilares fundamentales en los cuales se apoya toda la Física moderna. Uno es la relatividad general de Albert Einstein, que nos proporciona el marco teórico para la comprensión del Universo a una escala máxima: estrellas, Galaxias, cúmulos (o clusters) de Galaxias, y aún más allá, hasta la inmensa expansión del propio Universo. Allí donde exista un cuerpo masivo está presente la fuerza gravitatoria que atraerá la masa circundante. Dos galaxias de grandes dimensiones se atraeran siempre hasta unirse en “matrimonio” para crear una galaxia mayor.

El otro pilar es la mecánica cuántica que, en un primer momento vislumbro Max Planck y posteriormente fue desarrollada por W.Heisemberg, Schrödinger, el mismo Einstein, Dirac, Niels Bohr y otros y que nos ofrece un marco teórico para comprender el Universo en su escala mínima: moléculas, átomos, y así hasta las partículas subatómicas, como los electrones y quarks.

Durante años de investigación los físicos han confirmado experimentalmente, con una exactitud casi inimaginable, la practica totalidad de las predicciones que hacen las dos teorías. Sin embargo, estos mismos instrumentos teóricos nos llevan a una conclusión inquietante: Tal como se formulan actualmente, la relatividad general y la mecánica cuántica no puede ser ambas ciertas a la vez.

Nos encontramos con que las dos teorías en las que se basan los enormes avances realizado por la física durante el último siglo (avances que han explicado la expansión de los cielos y la estructura fundamental de la materia) son mutuamente incompatibles. Cuando se juntan ambas teorías, aunque la formulación propuesta parezca lógica, aquello explota, la respuesta es un sinsentido que nos arroja un sin fin de infinitos a la cara.

Las diferencias entre la relatividad general y la mecánica cuántica son tan grandes que, por el momento, ha fallado cualquier intento de reconciliarlas. Sin embargo, estos intentos han sido completamente teóricos y eso les ofrece una utilidad limitada.

Así que si tú, lector no has oído nunca previamente hablar de este feroz antagonismo, te puedes preguntar a que es debido. No es tan difícil encontrar la respuesta. Salvo en algunos casos muy especiales, los físicos estudian cosas que son o bien pequeñas y ligeras (como los átomos y sus partes constituyentes), o cosas que son enormes y pesadas (como estrellas de Neutrones y Agujeros Negros), pero no ambas al mismo tiempo. Esto significa que sólo necesitan utilizar la mecánica cuántica, o la relatividad general, y pueden minimizar el problema que se crea cuando las acercan demasiado, las dos teorías no pueden estar juntas. Durante más de medio siglo este planteamiento no ha sido tan feliz como la ignorancia, pero ha estado muy cerca de serlo.

No obstante, el Universo puede ser un caso extremo. En las profundidades centrales de un agujero negro se aplasta una descomunal masa hasta reducirse a un tamaño minúsculo. En el momento del Bing Bang, la totalidad del Universo salió de la explosión de una bolita microscópica cuyo tamaño hace que un grano de arena parezca gigantesco. Estos contextos son diminutos y, sin embargo, tienen una masa increíblemente grande, por lo que necesitan basarse tanto en la mecánica cuántica como en la relatividad general.

Según los primeros trabajos sobre la teoría cuántica de la gravedad, el propio espaciotiempo varió en su topografía, dependiendo de las dimensiones del universo recien nacido. Cuando el universo era del tamaño de un núcleo atómico (ver imagen de abajo), las condiciones eran relativamente lisas y uniformes; a los 10-30 cm (centro) es evidente una cierta granulidad; y a la llamada longitud de Planck, todavía unas 1.000 veces más pequeño (abajo), el espacio tiempo fluctúa violentamente.

Los físicos han intentado con denuedo elaborar una teoría completa de la gravedad que incluya la mecánica cuántica. Los cálculos de la mayoría de las teorías propuesta de la «gravedad cuántica» arrojan numerosos infinitos. Por ciertas razones, las fórmulas de la relatividad general y las de la mecánica cuántica, cuando se combinan, empiezan a agitarse, a traquetear y tener escapes de vapor como el motor de un viejo automóvil. O dicho de manera menos figurativa, hay en la Física preguntas muy bien planteadas que ocasionan esas respuestas sin sentido, a que me referí antes, a partir de la desafortunada amalgama de las ecuaciones de las dos teorías.

Aunque se desee mantener el profundo interior de un agujero negro y el surgimiento inicial del Universo envueltos en el misterio, no se puede evitar sentir que la hostilidad entre la mecánica cuántica y la relatividad general está clamando por un nivel más profundo de comprensión.

No creo que el Universo esté dividido en dos partes

¿Puede ser creíble que para conocer el Universo en su conjunto tengamos que dividirlo en dos y, conocer cada parte por separado? Las cosas grandes una ley, las cosas pequeñas otra.

No creo que eso pueda ser así. Mi opinión es que aún no hemos encontrado la llave que habré la puerta de una teoría cuántica de la gravedad, es decir, una teoría que unifique, de una vez por todas las dos teorías más importantes de la Física: Mecánica Cuántica+Relatividad General. La respuesta, si es que la hay, parece estar en la Teoría de Supercuerdas o la más moderna versión de la Teoría M.

Recordemos que Einstein se pasó los últimos 30 años de su vida en Princeton tratando de buscar la fórmula maravillosa que uniera éstas dos grandes teorías, la R.G. y la M.C., no lo consiguió por que aún no existían las matemáticas necesarias para poder llegar a tales profundidades del conocimiento.

Y, aún hoy, tampoco existen.

emilio silvera

Oct

23

¡La Naturaleza! De ella aprendemos y nos sugiere las ideas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo y los pensamientos ~

Clasificado en El Universo y los pensamientos ~

Comments (0)

Comments (0)

Parece que se llevan bien

El psicólogo Eric Ericsson llegó a proponer una teoría de estadios psicológicos del desarrollo. Un conflicto fundamental caracteriza cada fase. Si este conflicto no queda resuelto, puede enconarse e incluso provocar una regresión a un periodo anterior. Análogamente, el psicólogo Jean Piaget demostró que el desarrollo mental de la primera infancia tampoco es un desarrollo continuo de aprendizaje, sino que está realmente caracterizado por estadios discontinuos en la capacidad de conceptualización de un niño. En un mes, un niño puede dejar de buscar una pelota una vez que ha rodado fuera de su campo de visión, sin comprender que la pelota existe aunque no la vea. Al mes siguiente, esto resultará obvio para el niño.

Los precesos siguen, las cosas cambian, el Tiempo inexorable transcurre, si hay vida vendrá la muerte, lo que es hoy mañana no será.

Esta es la esencia de la dialéctica. Según esta filosofía, todos los objetos (personas, gases, estrellas, el propio universo) pasan por una serie de estadios. Cada estadio está caracterizado por un conflicto entre dos fuerzas opuestas. La naturaleza de dicho conflicto determina, de hecho, la naturaleza del estadio. Cuando el conflicto se resuelve, el objeto pasa a un objetivo o estadio superior, llamado síntesis, donde empieza una nueva contradicción, y el proceso pasa de nuevo a un nivel superior.

Los filósofos llaman a esto transición de la “cantidad” a la “cualidad”. Pequeños cambios cuantitativos se acumulan hasta que, eventualmente, se produce una ruptura cualitativa con el pasado. Esta teoría se aplica también a las sociedades o culturas. Las tensiones en una sociedad pueden crecer espectacularmente, como la hicieron en Francia a finales del siglo XVIII. Los campesinos se enfrenaban al hambre, se produjeron motines espontáneos y la aristocracia se retiró a sus fortalezas. Cuando las tensiones alcanzaron su punto de ruptura, ocurrió una transición de fase de lo cuantitativo a lo cualitativo: los campesinos tomaron las armas, tomaron París y asaltaron la Bastilla.

Las transiciones de fases pueden ser también asuntos bastante explosivos. Por ejemplo, pensemos en un río que ha sido represado. Tras la presa se forma rápidamente un embalse con agua a enorme presión. Puesto que es inestable, el embalse está en el falso vacío. El agua preferiría estar en su verdadero vacío, significando esto que preferiría reventar la presa y correr aguas abajo, hacia un estado de menor energía. Así pues, una transición de fase implicaría un estallido de la presa, que tendría consecuencias desastrosas.

También podría poner aquí el ejemplo más explosivo de una bomba atómica, donde el falso vacío corresponde al núcleo inestable de uranio donde residen atrapadas enormes energías explosivas que son un millón de veces más poderosas, para masas iguales, que para un explosivo químico. De vez en cuando, el núcleo pasa por efecto túnel a un estado más bajo, lo que significa que el núcleo se rompe espontáneamente. Esto se denomina desintegración radiactiva. Sin embargo, disparando neutrones contra los núcleos de uranio, es posible liberar de golpe esta energía encerrada según la formula de Einstein E = mc2. Por supuesto, dicha liberación es una explosión atómica; ¡menuda transición de fase! De nefasto recuerdo por cierto.

Las transiciones de fase no son nada nuevo. Trasladémoslo a nuestras propias vidas. En un libro llamado Pasajes, el autor, Gail Sheehy, destaca que la vida no es un flujo continuo de experiencias, como parece, sino que realmente pasa por varios estadios, caracterizados por conflictos específicos que debemos resolver y por objetivos que debemos cumplir.

Los contornos recubiertos muestran la estructura de la galaxia al ser reconstruida desde las observaciones hechas bajo el fenómeno de lente gravitatorio con el radiotelescopio Submillimeter Array. La formación de nuevas estrellas en el Universo es imparable y, la materia más sencilla se constituye en una estructura que la transformará en más compleja, más activa, más dispuesta para que la vida, también pueda surgir en mundos ignotos situados muy lejos del nuestro.

Sí, todo cambia y nada permanece: transiciones de fases hacia la complejidad

Las nuevas características descubiertas por los científicos en las transiciones de fases es que normalmente van acompañadas de una ruptura de simetría. Al premio Nobel Abdus Salam le gusta la ilustración siguiente: consideremos una mesa de banquete circular, donde todos los comensales están sentados con una copa de champán a cada lado. Aquí existe simetría. Mirando la mesa del banquete reflejada en un espejo, vemos lo mismo: cada comensal sentado en torno a la mesa, con copas de champán a cada lado. Asimismo, podemos girar la mesa de banquete circular y la disposición sigue siendo la misma.

Rompamos ahora la simetría. Supongamos ahora que el primer comensal toma la copa que hay a su derecha. Siguiendo la pauta, todos los demás comensales tomaran la copa de champán de su derecha. Nótese que la imagen de la mesa del banquete vista en el espejo produce la situación opuesta. Cada comensal ha tomado la copa izquierda. De este modo, la simetría izquierda-derecha se ha roto.

El niño del espejo le da a su amiguito reflejado la mano derecha y aquel, le saluda, con la izquierda. ¡La simetría especular…! Así pues, el estado de máxima simetría es con frecuencia también un estado inestable, y por lo tanto corresponde a un falso vacío.

Con respecto a la teoría de supercuerdas, los físicos suponen (aunque todavía no lo puedan demostrar) que el universo decadimensional original era inestable y pasó por efecto túnel a un universo de cuatro y otro de seis dimensiones. Así pues, el universo original estaba en un estado de falso vacío, el estado de máxima simetría, mientras que hoy estamos en el estado roto del verdadero vacío.

Al principio, cuando el universo era simétrico, sólo existía una sola fuerza que unificaba a todas las que ahora conocemos, la gravedad, las fuerzas electromagnéticas y las nucleares débil y fuerte, todas emergían de aquel plasma opaco de alta energía que lo inundaba todo. Más tarde, cuando el universo comenzó a enfriarse, se hizo transparente y apareció la luz, las fuerzas se separaron en las cuatro conocidas, emergieron las primeras quarks para unirse y formar protones y neutrones, los primeros núcleos aparecieron para atraer a los electrones que formaron aquellos primeros átomos. Doscientos millones de años más tarde, se formaron las primeras estrellas y galaxias. Con el paso del tiempo, las estrellas sintetizaron los elementos pesados de nuestros cuerpos, fabricados en supernovas que estallaron, incluso antes de que se formase el Sol. Podemos decir, sin temor a equivocarnos, que una supernova anónima explotó hace miles de millones de años y sembró la nube de gas que dio lugar a nuestro sistema solar, poniendo allí los materiales complejos y necesarios para que algunos miles de millones de años más tarde, tras la evolución, apareciéramos nosotros.

Las estrellas evolucionan desde que en su núcleo se comienza a fusionar hidrógeno en helio, de los elementos más ligeros a los más pesados. Avanza creando en el horno termonuclear, cada vez, metales y elementos más pesados. Cuando llega al hierro y explosiona en la forma explosiva de una supernova. Luego, cuando este material estelar es otra vez recogido en una nueva estrella rica en hidrógeno, al ser de segunda generación (como nuestro Sol), comienza de nuevo el proceso de fusión llevando consigo materiales complejos de aquella supernova.

Puesto que el peso promedio de los protones en los productos de fisión, como el cesio y el kriptón, es menor que el peso promedio de los protones de uranio, el exceso de masa se ha transformado en energía mediante la conocida fórmula E = mc2. Esta es la fuente de energía que también subyace en la bomba atómica. Es decir, convertir materia en energía.

Así pues, la curva de energía de enlace no sólo explica el nacimiento y muerte de las estrellas y la creación de elementos complejos que también hicieron posible que nosotros estemos ahora aquí y, muy posiblemente, será también el factor determinante para que, lejos de aquí, en otros sistemas solares a muchos años luz de distancia, puedan florecer otras especies inteligentes que, al igual que la especie humana, se pregunten por su origen y estudien los fenómenos de las fuerzas fundamentales del universo, los componentes de la materia y, como nosotros, se interesen por el destino que nos espera en el futuro.

Cuando alguien oye por vez primera la historia de la vida de las estrellas, generalmente (lo sé por experiencia), no dice nada, pero su rostro refleja escepticismo. ¿Cómo puede vivir una estrella 10.000 millones de años? Después de todo, nadie ha vivido tanto tiempo como para ser testigo de su evolución y poder contarlo.

Pero no parece que todo evolucione… algunas cosas siempre siguen igual… ¡A pesar de todo!

Pero volviendo a las cosas de la Naturaleza y de la larga vida de las estrellas, sí, tenemos los medios técnicos y científicos para saber la edad que tiene, por ejemplo, el Sol. Nuestro Sol, la estrella alrededor de la que giran todos los planetas de nuestro Sistema Solar, la estrella más cercana a la Tierra (150 millones de Km = 1 UA), con un diámetro de 1.392.530 Km, tiene una edad de 4.500 millones de años, y, como todo en el Universo, su discurrir la va desgantando, evoluciona hacia su imparable destino como gigante roja primero y enana blanca después.

Una gigante roja engulle a un planeta cercano. La escena se repetirá con el Sol y la Tierra si nada lo remedia y las cosas naturales siguen su curso.

Cuando ese momento llegue, ¿dónde estaremos? Pues nosotros, si es que estamos, contemplaremos el acontecimiento desde otros mundos. La Humanidad habrá dado el gran salto hacia las estrellas y, colonizando otros planetas se habrá extendido por regiones lejanas de la Galaxia.

El Universo siempre nos pareció inmenso, y, al principio, aquellos que empezaron a preguntarse cómo sería, lo imaginaron como una esfera cristalina que dentro contenía unos pocos mundos y algunas estrellas, hoy, hemos llegado a saber un poco más sobre él. Sin embargo, dentro de unos cuantos siglos, los que detrás de nosotros llegaran, hablarán de universos en plural, y, cuando pasen algunos eones, estaremos de visita de un universo a otro como ahora vamos de una ciudad a otra.

¡Quién pudiera estar allí!

¡Es todo tan extraño! ¡Es todo tan complejo! y, sobre todo…¡sabemos tan poco!

Todo lo grande está hecho de cosas pequeñas

Según lo que podemos entender y hasta donde han podido llegar nuestros conocimientos actuales, ahora sabemos donde están las fronteras: donde las masas o las energías superan 1019 veces la masa del protón, y esto implica que estamos mirando a estructuras con un tamaño de 10-33 centímetros.

Esta masa la conocemos con el nombre demasa de Planck y a la distancia correspondiente la llamamos distancia de Planck. La masa de Planck expresada en gramos es de 22 microgramos, que la es la masa de un grano muy pequeño de azúcar que, por otra parte, es el único número de Planck que parece más o menos razonable, ¡los otros números son totalmente extravagantes!.

Esto significa que tratamos de localizar una partícula con la precisión de una longitud de Planck, las fluctuaciones cuánticas darán tanta energía que su masa será tan grande como la masa de Planck, y los efectos de la fuerza gravitatoria entre partículas, así, sobrepasarán los de cualquier otra fuerza. Es decir, para estas partículas la gravedad es una interacción fuerte.

Lo cierto es que, esas unidades tan pequeñas, tan lejanas en las distancias más allá de los átomos, son las que marcan nuestros límites, los límites de nuestras teorías actuales que, mientras que no puedan llegar a esas distancias… No podrán avanzar en el conocimiento de la Naturaleza y, tampoco, como es natural, en la teoría de supercuerdas o en poder saber, lo que pasó en el primer momento del supuesto big bang, hasta esos lugares, nunca hemos podido llegar.

emilio silvera

Oct

23

Seguiremos desvelando secretos de la Naturaleza

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Descubrir y aprender ~

Clasificado en Descubrir y aprender ~

Comments (0)

Comments (0)

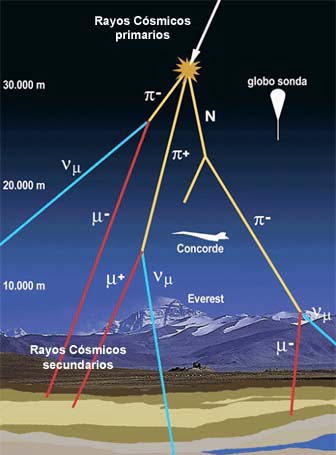

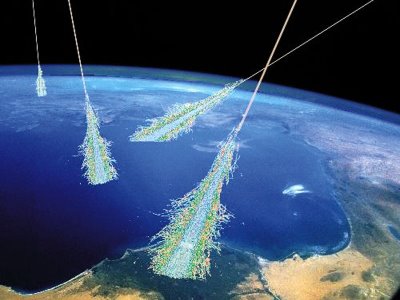

Los rayos cósmicos son impredecibles en cuanto a su energía aleatoria. Hace ya aproximadamente un siglo que fueron descubiertos por un padre jesuita de nombre Theodor Wolf en lo alto de la Torre Eiffel en París. Desde entonces, el conocimiento adquirido de estos rayos es bastante aceptable; se buscan y miden mediante el envio de contadores de radiación en cohetes e incluso en satélites a gran altura alrededor del planeta Tierra para minimizar agentes interceptores como los efectos atmosféricos que contaminan las señales. Cuando los rayos energéticos, altamente energéticos, inciden en la atmósfera, rompen los átomos que encuentran a su paso y los fragmentos que se forman caen a tierra donde son detectados por aparatos colocados al efecto en la superficie.

El detector de Utah, a unos 140 Km al suroeste de Salt Lake City, es lo suficientemente sensible como para detectar la procedencia, el origen de los rayos cósmicos más energéticos. Hasta el momento, Cygnus X-1, Hércules X-1 y Sagittarius A, han sido identificados como poderosos emisores de rayos cósmicos. Probablemente son grandes estrellas de neutrones, o incluso agujeros negros en rotación engullendo a sus estrellas vecinas que, inocentes, han osado traspasar el horizonte de sucesos. Cuando el material de la estrella traspasa ese punto de no regreso, crea un gran vórtice de energía y escupe cantidades gigantescas de radiación (por ejemplo, protones) al espacio exterior.

Grandes fuentes de rayos cósmicos están situadas en las radiogalaxias activas, en explosiones supernovas, en colisiones de estrellas de neutrones y en los agujeros negros. Es decir, los rayos cósmicos muy energéticos son partículas electricamente cargadas en un alto nivel que no se puede conseguir en ninguno de nuestros ingenios que, son juegos de niños comparados con la propia Naturaleza.

Hasta la fecha, el rayo cósmico más energético detectado tenía una energía de 1020 electrón voltios. Esta cifra supone una increíble energía diez millones de veces mayor de la que se pueda producir en el LHC. Dentro de este siglo, seguramente, será difícil alcanzar con nuestras máquinas, energías aproximadas. Aunque esta fantástica energía es todavía cien millones de veces menor que las energías necesarias para sondear la décima dimensión, se espera que energías producidas en el interior profundo de los agujeros negros en nuestra galaxia se acercaran a la energía de Planck. Con grandes naves espaciales en orbita deberíamos ser capaces (seremos) de sondear en lo más profundo de estas estructuras gigantescas de fuentes energéticas que, abundantemente, están repartidas a lo largo y ancho del universo.

El corazón de nuestra Galaxia: Lugar poco recomensable para instalarse

Según una teoría favorita, la mayor fuente de energía dentro de nuestra galaxia (mucho más allá de cualquier cosa imaginable), está en el mismo corazón de la Vía Láctea, en el centro, a 30.000 años luz de nuestro Sistema Solar, donde reside Sagittarius A, un agujero negro con millones de masas solares, un enorme mostruo estelar que engulle toda la materia que pueda acercarse al lugar emitiendo enormes ráfagas energías al espacio interestelar en forma de radiación cósmica.

En física nada se puede descartar, la inaccesibilidad de hoy a la energía de Planck se puede suplir por descubrimientos inesperados que, poco a poco, nos lleve cada vez más cerca de ella, hasta que finalmente tengamos el conocimiento y la tecnología necesarias para poder alcanzarla. Dicen los entendidos que de ser así, sí podríamos verificar de manera experimental, la Teoría de Cuerdas.

30 Doradus, región de formación de estrellas nuevas que radian en intenso ultravioleta

No olvidemos que en el siglo XIX, algunos científicos declararon que la composición de las estrellas estaría siempre fuera del alcance del experimento, y que la única manera que tendríamos de conocerlas sería la de mirar al cielo y verlas allí, inalcanzables como puntos de luz brillantes y lejanos en la oscuridad del vacío del cosmos. Sin embargo, podemos decir hoy, a comienzos del siglo XXI, en los comienzos del año 2.013, que no sólo podemos saber la composición de las estrellas, sino también como nacen y mueren, en que se convierten al final de sus vidas -dependiendo de sus masas-, así como las distancias que las separan de nosotros y un sin fin de datos más que las hacen más familiares y cotidianas. ¡Lo imposible se hizo posible!

Los resultados de investigaciones científicas y los logros de múltiples proyectos, nos llevan a creer que, dentro de unos límites racionales, y razonables, podremos, en un futuro no muy lejano, conseguir muchos de los sueños del pasado: alargar de manera considerable la media de vida, colonizar otros planetas y explotar recurso mineros en las lunas de nuestro Sistema Solar; los turistas irán al planeta Marte o a las lunas Ganímedes o Europa. Los transportes de hoy serán reliquias del pasado y nos trasladaremos mediante sistemas de transportes más limpios, rápidos y en ausencia de trágicas colisiones que evitarán censores que a tal efecto, llevarán incorporados los vehículos. Tendremos computadoras de cifrado cuántico que harán más seguras las comunicaciones y el intercambio de datos será realmente el de la velocidad de c, y, de esa manera, en todos los campos del saber humano.

Mucho hemos avanzado ya desde entonces

Estamos inmersos en un avance exponencial imparable. La lista de ideas inverivicables cada vez será más corta. Otro ejemplo de una idea “inverificable” la tenemos en la existencia del átomo. En el siglo XIX, la hipótesis atómica se reveló como el paso decisivo en la comprensión de las leyes de la química y la termodinámica. Sin embargo, muchos físicos se negaban a creer que los átomos existieran realmente, los aceptaban como un concepto o herramienta matemática para operar en su trabajo que, por accidente, daba la descripción correcta del mundo.

Hoy somos todavía incapaces de tomar imágenes directas del átomo debido al principio de incertidumbre de Heisemberg, aunque ahora existen métodos indirectos. En 1905, Einstein proporcionó la evidencia más convincente, aunque indirecta, de la existencia de átomos cuando demostró que el movimiento browniano (es decir, el movimiento aleatorio de partículas de polvo suspendidas en un líquido) puede ser explicado como colisiones aleatorias entre las partículas y los átomos del líquido.

Por analogía, podríamos esperar la confirmación experimental de la física de la décima dimensión utilizando métodos indirectos que aún ni se han inventado o descubierto. En lugar de fotografiar el objeto que deseamos, quizá nos conformaríamos, de momento, con fotografiar la “sombra” del mismo.

También la existencia de los neutrinos, propuestos por Wolfgang Pauli en 1930 para dar cuenta de la energía perdida en ciertos experimentos sobre radiactividad que parecían violar la conservación de la materia y la energía, también digo, era inverificable (en aquel momento). Pauli comprendió que los neutrinos serían casi imposibles de observar experimentalmente, porque interaccionarían muy débilmente y, por consiguiente, muy raramente con la materia. La materia, toda la materia, si profundizamos en ella a niveles microscópicos, podremos comprobar el hecho de que en un 90% está constituida de espacios vacíos y, siendo así, los neutrinos pueden atravesarla sin rozar siquiera sus átomos; de hecho, pueden atravesar la Tierra como si ni siquiera existiera y, al mismo tiempo, también nosotros somos atravesados continuamente por billones de neutrinos emitidos por el sol, incluso por la noche.

Pauli admitió:

“He cometido el pecado más grave, he predicho la existencia de una partícula que nunca puede ser observada”.

Pero incluso Pauli, con todos sus enormes conocimientos, se equivocaba, y el neutrino ha sido comprobado mediante distintos métodos que no dejan dudas de su existencia. Incluso producimos regularmente haces de neutrinos en colisionadores de átomos, realizamos experimentos con los neutrinos emitidos por reactores nucleares y detectamos su presencia en enormes depósitos de agua pesada colocados en profundas minas abandonadas en las entrañas de la Tierra. Cuando una espectacular supernova se iluminó en el cielo del hemisferio sur en 1987, los físicos registraron una ráfaga de neutrinos que atravesaron sus detectores situados, precisamente, en profundas minas.

Echando una larga mirada a la historia de la ciencia, creo que existen motivos para un moderado optimismo. Witten está convencido de que la ciencia sería algún día capaz de sondear hasta las energías de Planck.

E. Witten, padre de la versión más avanzada de la teoría de supercuerdas, la teoría M, dice:

“No siempre es tan fácil decir cuáles son las preguntas fáciles y cuáles las difíciles. En el siglo XIX, la pregunta de por qué el agua hierve a 100 grados era desesperadamente inaccesible. Si usted hubiera dicho a un físico del siglo XIX que hacia el S. XX sería capaz de calcularlo, le habría parecido un cuento de hadas… La teoría cuántica de campos es tan difícil que nadie la creyó completamente durante veinticinco años.”

Lo mismo que otros muchos, espero que no tengamos que esperar un siglo antes de que nuestro ingenio y nuestras máquinas puedan sondear de manera indirecta la teoría de cuerdas, sería interesante saber si nos lleva a alguna parte, o, si por el contrario, estamos perdiendo el tiempo. De todas las maneras, parece que algunos resultados son esperanzadores. Esperémos que alguien sepa, durante ese periodo de tiempo, resolver esa teoría de campos de cuerdas o alguna otra fórmula no perturbativa. El problema es teórico, no experimental. Necesitamos alguien con el ingenio y la inteligencia necesaria (además de un enorme índice de observación), para saber “ver” lo que probablemente tenemos ante nuestras narices, utilizando para ello todos los datos e indicios existentes de gente como Einstein, Kaluza y Klein, Veneziano y Suzuki, el cuarteto de cuerdas de Princeton, Michio Kaku, Witten…, y tantos otros.

Si esas cuerdas vibrantes de cuyas resonancias nacen las partículas elementales están ahí…, ¡debemos encontrarlas!

Suponiendo que algún físico brillante resuelva la teoría de campos de cuerdas y derive las propiedades conocidas de nuestro universo, sigue existiendo el problema práctico de cuándo seríamos capaces de aprovechar el poder de la teoría del hiperespacio. Existen dos posibilidades:

- Esperar que nuestra civilización alcance la capacidad para dominar energías billones de veces mayores que las de hoy.

- Encontrar civilizaciones extraterrestres que, más avanzadas, hayan dominado el arte de manipular el hiperespacio.

Antes de que Edison y sus colaboradores aprovecharan los descubrimientos de Faraday y las ecuaciones de Maxwell sobre la electricidad y el magnetismo, para explotarlos de manera práctica pasaron unos setenta años. Todo en el Universo tiene marcado un tiempo, nada surge por arte de magia y, algunas veces, nuestra natural impaciencia, nos hace olvidar tan insignificante detalla y pretendemos que “el parto sea de 3 meses”. ¡Qué humanidad!

La civilización moderna depende crucialmente del aprovechamiento de esta fuerza. La fuerza nuclear fue descubierta casi con el cambio de siglo. Pasó todo el siglo XX y estamos en la primera década del XXI, han pasado 100 años y, sin embargo, todavía no tenemos medios de aprovecharla con éxito en reactores de fusión, la energía limpia que produce el Sol.

emilio silvera

Oct

23

¡El Núcleo Atómico! Y mucho más

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (4)

Comments (4)

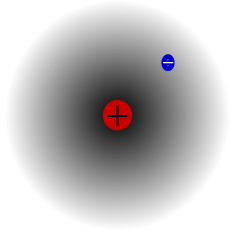

El propio Rutherford empezó a vislumbrar la respuesta a la pregunta que arriba hacemos. Entre 1.906 y 1.908 (hace más de un siglo) realizó constantes experimentos disparando partículas alfa contra una lámina sutil de metal (como oro o platino), para analizar sus átomos. La mayor parte de los proyectiles atravesaron la barrera sin desviarse (como balas a través de las hojas de un árbol), pero no todos.

En la placa fotográfica que le sirvió de blanco tras el metal, Rutherford descubrió varios impactos dispersos e insospechados alrededor del punto central. Comprobó que algunas partículas habían rebotado. Era como si en vez de atravesar las hojas, algunos proyectiles hubiesen chocado contra algo más sólido. Rutherford supuso que aquella “balas” habían chocado contra una especie de núcleo denso, que ocupaba sólo una parte mínima del volumen atómico y ese núcleo de intensa densidad desviaban los proyectiles que acertaban a chocar contra él. Ello ocurría en muy raras ocasiones, lo cual demostraba que los núcleos atómicos debían ser realmente ínfimos, porque un proyectil había de encontrar por fuerza muchos millones de átomos al atravesar la lámina metálica

Era lógico suponer, pues, que los protones constituían ese núcleo duro. Rutherford representó los protones atómicos como elementos apiñados alrededor de un minúsculo “núcleo atómico” que servía de centro (después de todo eso, hemos podido saber que el diámetro de ese núcleo equivale a algo más de una cienmilésima del volumen total del átomo).

En 1.908 se concedió a Rutherford el premio Nobel de Química por su extraordinaria labor de investigación sobre la naturaleza de la materia. Él fue el responsable de importantes descubrimientos que permitieron conocer la estructura de los átomos en esa primera avanzadilla.

Átomo de hidrógeno, núcleo y electrón.

Desde entonces se pueden describir con términos más concretos los átomos específicos y sus diversos comportamientos. Por ejemplo, el átomo de hidrógeno posee un solo electrón. Si se elimina, el protón restante se asocia inmediatamente a alguna molécula vecina; y cuando el núcleo desnudo de hidrógeno no encuentra por este medio un electrón que participe, actúa como un protón (es decir, una partícula subatómica), lo cual le permite penetrar en la materia y reaccionar con otros núcleos si conserva la suficiente energía.

El helio, que posee dos electrones, no cede uno con tanta facilidad. Sus dos electrones forman un caparazón hermético, por lo cual el átomo es inerte. No obstante, si se despoja al helio de ambos electrones, se convierte en una partícula alfa, es decir, una partícula subatómica portadora de dos unidades de carga positiva.

Hay un tercer elemento, el litio, cuyo átomo tiene tres electrones. Si se despoja de uno o dos, se transforma en ión, y si pierde los tres, queda reducida a un núcleo desnudo, con una carga positiva de tres unidades.

Las unidades de carga positiva en el núcleo atómico deben ser numéricamente idénticas a los electrones que contiene por norma, pues el átomo suele ser un cuerpo neutro, y esta igualdad de lo positivo con lo negativo es el equilibrio. De hecho, los números atómicos de sus elementos se basan en sus unidades de carga positiva, no en las de carga negativa, porque resulta fácil hacer variar el número de electrones atómicos dentro de la formación iónica, pero en cambio se encuentran grandes dificultades si se desea alterar el número de sus protones.

Apenas esbozado este esquema de la construcción atómica, surgieron nuevos enigmas. El número de unidades con carga positiva en un núcleo no equilibró, en ningún caso, el peso nuclear ni la masa, exceptuando el caso del átomo de hidrógeno. Para citar un ejemplo, se averiguó que el núcleo de helio tenía una carga positiva dos veces mayor que la del núcleo de hidrógeno; pero como ya se sabía, su masa era cuatro veces mayor que la de este último. Y la situación empeoró progresivamente a medida que se descendía por la tabla de elementos, e incluso cuando se alcanzó el uranio, se encontró un núcleo con una masa igual a 238 protones, pero una carga que equivalía sólo a 92.

¿Cómo era posible que un núcleo que contenía cuatro protones (según se suponía el núcleo de helio) tuviera sólo dos unidades de carga positiva? Según la más simple y primera conjetura emitida, la presencia en el núcleo de partículas cargadas negativamente y con peso despreciable neutralizaba dos unidades de carga. Como es natural, se pensó también en el electrón. Se podría componer el rompecabezas si se suponía que en núcleo de helio estaba integrado por cuatro protones y dos electrones neutralizadores, lo cual deja libre una carga positiva neta de dos, y así sucesivamente, hasta llegar al uranio, cuyo núcleo tendría, pues, 238 protones y 146 electrones, con 92 unidades libres de carga positiva. El hecho de que los núcleos radiactivos emitieran electrones (según se había comprobado ya, por ejemplo, en el caso de las partículas beta), reforzó esta idea general. Dicha teoría prevaleció durante más de una década, hasta que por caminos indirectos, llegó una respuesta mejor como resultado de otras investigaciones.

Pero entre tanto se habían presentado algunas objeciones rigurosas contra dicha hipótesis. Por lo pronto, si el núcleo estaba constituido esencialmente de protones, mientras que los ligeros electrones no aportaban prácticamente ninguna contribución a la masa, ¿cómo se explicaba que las masas relativas de varios núcleos no estuvieran representadas por número enteros? Según los pesos atómicos conocidos, el núcleo del átomo cloro, por ejemplo, tenía una masa 35’5 veces mayor que la del núcleo de hidrógeno. ¿Acaso significaba esto que contenía 35’5 protones? Ningún científico (ni entonces ni ahora) podía aceptar la existencia de medio protón.

Este singular interrogante encontró una respuesta incluso antes de solventar el problema principal, y ello dio lugar a una interesante historia.

Los tres isótopos naturales del carbono: carbono-12 (6 protones y 6 neutrones), carbono-13 (6 protones y 7 neutrones) y carbono-14 (6 protones y 8 neutrones). En los tres casos es carbono, tiene el aspecto de carbono y se comporta químicamente como carbono, por tener seis protones (y forma parte de nuestro organismo, por ejemplo). Sin embargo, sus propiedades físicas varían. Por ejemplo, mientras que el carbono-12 y el carbono-13 son estables, el carbono-14 es inestable y radioactivo: emite radiación beta, uno de sus neutrones “extras” se transforma así en un protón y el núcleo se convierte en nitrógeno-14 (que tiene 7 protones y 7 neutrones), con el aspecto y las propiedades del nitrógeno (por tener 7 protones). Dado que la mitad de la masa del carbono-14 pasa a ser nitrógeno-14 cada 5.730 años aproximadamente (más o menos lo que llevamos de civilización humana), la presencia de este isótopo natural resulta especialmente útil para la datación precisa de objetos históricos.

Isótopos; construcción de bloques uniformes

Allá por 1.816, el físico inglés William Prout había insinuado ya que el átomo de hidrógeno debía entrar en la constitución de todos los átomos. Con el tiempo se fueron desvelando los pesos atómicos, y la teoría de Prout quedó arrinconada, pues se comprobó que muchos elementos tenían pesos fraccionarios (para lo cual se tomó el oxígeno, tipificado al 16). El cloro, según dije antes, tiene un peso atómico aproximado de 35’5, o para ser exactos, 35’457. otros ejemplos son el antimonio, con un peso atómico de 121’75, el galio con 137’34, el boro con 10’811 y el cadmio con 112’40.

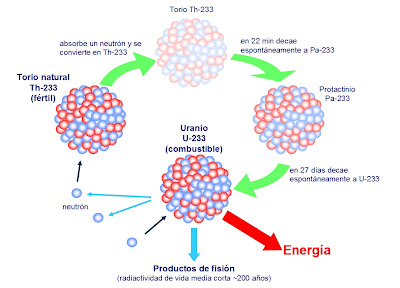

El Uranio 235 que es el único que de manera natural es apto para la fisión nuclear, es escaso, sólo el 7 por 1.000 es uranio 235, el resto, es uranio 238 que, no es combustible nuclear y, como la madera mojada, no arde. Sin embargo, si se bombardea con neutrones lentos del uranio 235, resulta que se convierte en Plutonio 239 que sí, es combustible nuclear válido. ¡Qué no idearemos para conseguir los objetivos!

El Uranio es muy radiactivo y si está enriquecido… ¡Ya sabemos las consecuencias!

Hacia principios de siglo se hizo una serie de observaciones desconcertantes, que condujeron al esclarecimiento. El inglés William Crookes (el del tubo Crookes) logró disociar del uranio una sustancia cuya ínfima cantidad resultó ser mucho más radiactiva que el propio uranio. Apoyándose en su experimento, afirmó que el uranio no tenía radiactividad, y que ésta procedía exclusivamente de dicha impureza, que él denominó uranio X. Por otra parte, Henri Becquerel descubrió que el uranio purificado y ligeramente radiactivo adquiría mayor radiactividad con el tiempo, por causas desconocidas. Si se deja reposar durante algún tiempo, se podía extraer de él repetidas veces uranio activo X. Para decirlo de otra manera, por su propia radiactividad, el uranio se convertía en el uranio X, más radiactivo aún.

Por entonces, Rutherford, a su vez, separó del torio un torio X muy radiactivo, y comprobó también que el torio seguía produciendo más torio X. Hacia aquellas fechas se sabía ya que el más famoso de los elementos radiactivos, el radio, emitía un gas radiactivo, denominado radón. Por tanto, Rutherford y su ayudante, el químico Frederick Soddy, dedujeron que durante la emisión de sus partículas los átomos radiactivos se transformaron en otras variedades de átomos radiactivos.

El Radón, uno de los llamados gases nobles, es incoloro, inodoro e insípido, además de –para nuestro mal- radioactivo. Suele presentarse según el tipo de suelos de determinadas zonas y con la descomposición de uranio, concentrándose en la superficie y siendo “arrastrado” en y por el aire que respiramos, y es en grandes cantidades es un gas perjudicial para la salud… y que anticipa terremotos.

Varios químicos que investigaron tales transformaciones lograron obtener un surtido muy variado de nuevas sustancias, a las que dieron nombres tales como radio A, radio B, mesotorio I, mesotorio II y actinio C. Luego los agruparon todos en tres series, de acuerdo con sus historiales atómicos. Una serie se originó del uranio disociado; otra del torio, y la tercera del actinio (si bien más tarde se encontró un predecesor del actinio, llamado protactinio).

En total se identificaron unos cuarenta miembros de esas series, y cada uno se distinguió por su peculiar esquema de radiación. Pero los productos finales de las tres series fueron idénticos: en último término, todas las cadenas de sustancias conducían al mismo elemento, el plomo.

Ahora bien, esas cuarenta sustancias no podían ser, sin excepción, elementos disociados. Entre el uranio (92) y el plomo (82) había sólo diez lugares en la tabla periódica, y todos ellos, salvo dos, pertenecían a elementos conocidos.

En realidad, los químicos descubrieron que aunque las sustancias diferían entre sí por su radiactividad, algunas tenían propiedades químicas idénticas. Por ejemplo, ya en 1.907 los químicos americanos Herbert Newby McCoy y W. H. Ross descubrieron que el radiotorio (uno entre los varios productos de la desintegración del torio) mostraba el mismo comportamiento químico que el torio, y el radio D, el mismo que el plomo, tanto que a veces era llamado radioplomo. De todo lo cual se infirió que tales sustancias eran en realidad variedades de mismo elemento: el radiotorio, una forma de torio; el radioplomo, un miembro de una familia de plomos; y así sucesivamente.

En 1.913, Soddy esclareció esta idea y le dio más amplitud. Demostró que cuando un átomo emitía una partícula alfa, se transformaba en un elemento que ocupaba dos lugares más abajo en la lista de elementos, y que cuando emitía una partícula beta, ocupaba, después de su transformación, el lugar inmediatamente superior. Con arreglo a tal norma, el radiotorio descendía en la tabla hasta el lugar del torio, y lo mismo ocurría con las sustancias denominadas uranio X y uranio Y, es decir, que los tres serían variedades del elemento 90. Así mismo, el radio D, el radio B, el torio B y el actinio B compartirían el lugar del plomo como variedades del elemento 82.

Soddy dio el nombre de isótopos (del griego iso y topos, “el mismo lugar”) a todos los miembros de una familia de sustancias que ocupaban el mismo lugar en la tabla periódica. En 1.921 se le concedió el premio Nobel de Química.

El modelo protón-electrón del núcleo concordó perfectamente con la teoría de Soddy sobre los isótopos. Al retirar una partícula alfa de un núcleo, se reducía en dos unidades la carga positiva de dicho núcleo, exactamente lo que necesitaba para bajar dos lugares en la tabla periódica. Por otra parte, cuando el núcleo expulsaba un electrón (partícula beta), quedaba sin neutralizar un protón adicional, y ello incrementaba en una unidad la carga positiva del núcleo, lo cual era como agregar una unidad al número atómico, y por tanto, el elemento pasaba a ocupar la posición inmediatamente superior en la tabla periódica de los elementos. ¡Maravilloso!

¿Cómo se explica que cuando el torio se descompone en radiotorio después de sufrir no una, sino tres desintegraciones, el producto siga siendo torio? Pues bien, en este proceso el átomo de torio pierde una partícula alfa, luego una partícula beta, y más tarde una segunda partícula beta. Si aceptamos la teoría sobre el bloque constitutivo de los protones, ello significa que el átomo ha perdido cuatro electrones (dos de ellos contenidos presuntamente en la partícula alfa) y cuatro protones. (La situación actual difiere bastante de este cuadro, aunque en cierto modo, esto no afecta al resultado).

El núcleo de torio constaba inicialmente (según se suponía) de 232 protones y 142 electrones. Al haber perdido cuatro protones y otros cuatro electrones, quedaba reducido a 228 protones y 138 electrones. No obstante, conservaba todavía el número atómico 90, es decir, el mismo de antes.

Así pues, el radiotorio, a semejanza del torio, posee 90 electrones planetarios, que giran alrededor del núcleo. Puesto que las propiedades químicas de un átomo están sujetas al número de sus electrones planetarios, el torio y el radiotorio tienen el mismo comportamiento químico, sea cual fuere su diferencia en peso atómico (232 y 228 respectivamente).

Los isótopos de un elemento se identifican por su peso atómico, o número másico. Así, el torio corriente se denomina torio 232, y el radiotorio, torio 228. Los isótopos radiactivos del plomo se distinguen también por estas denominaciones: plomo 210 (radio D), plomo 214 (radio B), plomo 212 (torio B) y plomo 211 (actinio B).

Se descubrió que la noción de isótopo podía aplicarse indistintamente tanto a los elementos estables como a los radiactivos. Por ejemplo, se comprobó que las tres series radiactivas anteriormente mencionadas terminaban en tres formas distintas de plomo. La serie del uranio acababa en plomo 206, la del torio en plomo 208 y la del actinio en plomo 207. cada uno de estos era un isótopo estable y corriente del plomo, pero los tres plomos diferían por su peso atómico.

Mediante un dispositivo inventado por cierto ayudante de J. J. Thomson, llamado Francis William Aston, se demostró la existencia de los isótopos estables. En 1.919, Thomson, empleando la versión primitiva de aquel artilugio, demostró que el neón estaba constituido por dos variedades de átomos: una cuyo número de masa era 20, y otra con 22. El neón 20 era el isótopo común; el neón 22 lo acompañaba en la proporción de un átomo cada diez. Más tarde se descubrió un tercer isótopo, el neón 21, cuyo porcentaje en el neón atmosférico era de un átomo por cada 400.

Entonces fue posible, al fin, razonar el peso atómico fraccionario de los elementos. El peso atómico del neón (20, 183) representaba el peso conjunto de los tres isótopos, de pesos diferentes, que integraban el elemento en su estado natural. Cada átomo individual tenía un número másico entero, pero el promedio de sus masas (el peso atómico) era un número fraccionario.

Aston procedió a mostrar que varios elementos estables comunes eran, en realidad, mezclas de isótopos. Descubrió que el cloro, con un peso atómico fraccionario de 35’453, estaba constituido por el cloro 35 y el cloro 37, en la proporción de cuatro a uno. En 1.922 se le otorgó el premio Nobel de Química.

Sabiendo todo lo anteriormente explicado, hemos llegado a comprender cómo parte de la Astronomía que estudia las características físicas y químicas de los cuerpos celestes, la astrofísica es la parte más importante de la astronomía en la actualidad debido a que, al avanzar la física moderna: Efecto Doppler-Fizeau, el efecto Zeeman, las teorías cuánticas y las reacciones termonucleares aplicadas al estudio de los cuerpos celestes han permitido descubrir que el campo magnético solar, el estudio de las radiaciones estelares y sus procesos de fusión nuclear, y determinar la velocidad radial de las estrellas, etc . radiación electromagnética de los cuerpos celestes permite realizar análisis de los espectros que nos dicen de qué están hechas las estrellas y los demás cuerpos del espacio interestelar y, de esa manera, hemos ido conociendo la materia y sus secretos que, cada vez, van siendo menos.

emilio silvera

Totales: 75.362.486

Totales: 75.362.486 Conectados: 36

Conectados: 36