Oct

15

¡Definir la Ciencia! ?Y sus curiosidades?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en La Ciencia ~

Clasificado en La Ciencia ~

Comments (3)

Comments (3)

Para lo que este simple comentario trata de reflejar, bastaría decir que la Ciencia es un estudio lógico y sistemático de la Naturaleza y del mundo físico que abarca todo el Universo y todo lo que dentro de él está presente. Generalmente incluye tanto experimento como teorías que son verificadas por aquellos.

’El túnel de la ciencia’, en el Museo de Artes e Historia del Forum Cultural de Guanajuato. México

La ciencia (del Latín scientia “conocimiento”) es el conjunto de conocimientos sistemáticamente estructurados, y susceptibles de ser articulados unos con otros hasta formar un todo en un entendimiento “general” de la Naturaleza del Universo.

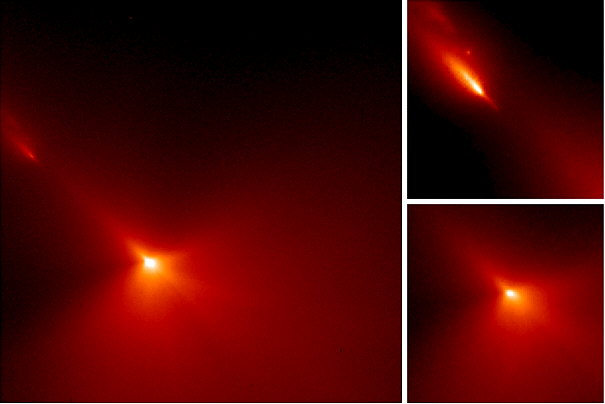

Aunque la definición pueda resultar algo floja, es, sin embargo un compendio general de lo que entendemos por ciencia. Más arriba escribo “generalmente” en cursiva, porque si planteáramos una exigencia absoluta de experimentos, tendríamos que excluir la Astronomía, la más antigua de todas las ciencias, ya que no es posible recrear nuevas estrellas o galaxias en Laboratorio, ni escenificar la creación del sistema solar. Sin embargo, en Astronomía las observaciones son a menudo tan valiosas como los mismos experimentos. El Cometa Halley regresa con una regularidad sorprendente; el Sol sale cada mañana.

El filósofo Karl Popper añadió el requisito de la “refutación” La Ciencia es refutable; la Religión no lo es. Una Teoría o una Ley científica nunca pueden ser demostradas de manera absoluta; de ahí que sea posible refutarlas. Por ejemplo, Newton dijo que la fuerza es igual al producto de la masa por la aceleración (D = ma). No podemos demostrar que todos los objetos de todas las galaxias obedecen esta ley o que todos los objetos obedecerán siempre esta Ley. Sin embargo, para demostrar la falsedad de esta Ley bastaría un solo experimento. (Albert Einstein y varios expertos en física cuántica han demostrado que algunos de los conceptos de Newton son erróneos.) Por lo tanto, los científicos deben proponer sólo teorías que puedan ser refutadas, tal como afirmó Popper. Estas Teorías han de ser comprobables. No existe tal requisito en el caso de la Religión.

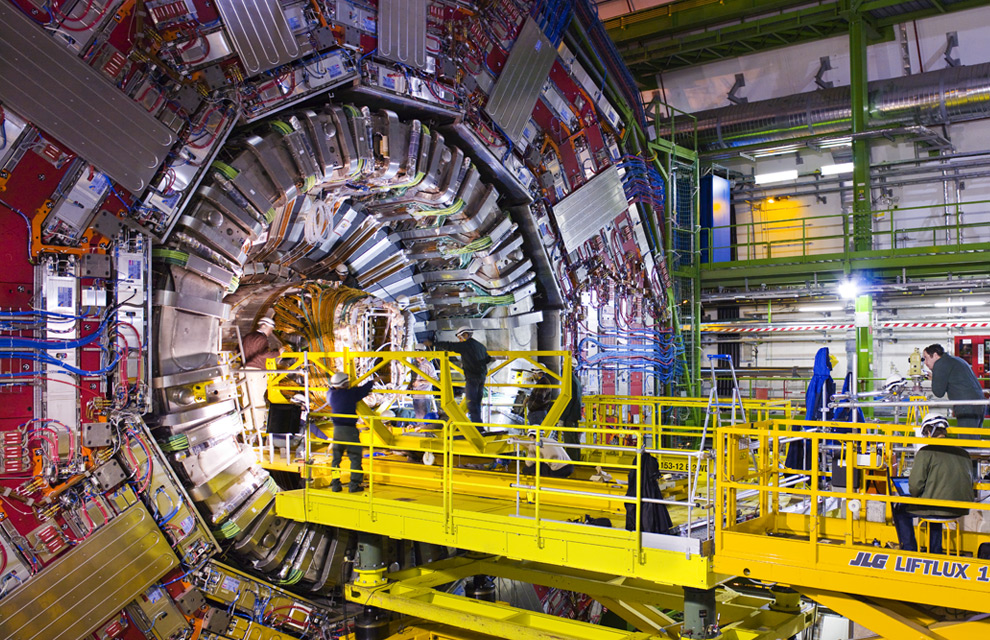

La Mente Humana está en conexión con el Universo

Dicho esto, sigue habiendo problemas con la definición. La Astrología, por ejemplo, es refutable. Si nuestros astrólogos nos dicen que nos encontraremos con una guapa extranjera el martes, esto puede comprobarse. Por otra parte, la teoría de las supercuerdas, planteada por algunos físicos como la “teoría del todo”, requeriría un acelerador de partículas con un diámetro de diez años-luz para poder refutarla. La mayor parte de la Biología evolutiva tampoco puede comprobarse experimentalmente. No se puede reproducir la evolución de una especie, ni recrear los dinosaurios comenzando con un animal unicelular. Si aplicamos la regla de la refutación demasiado estrictamente, tendremos que incluir la astrología en el campo de la ciencia y excluir la biología evolutiva, la teoría de cuerdas e incluso quizá la Astronomía.

En consecuencia, es mejor que no nos tomemos demasiado en serio lo de la “refutación” del filósofo de la Ciencia, ya que, de otro modo, podríamos vernos obligados a excluir toda la Ciencia de los antiguos griegos. Estos no sólo eludían el experimento, sino que abominaban de ellos, confiando en que la razón estaba por encima de la evidencia empírica.

Yo, sí he llegado a tener mi propia definición de la Ciencia: “Es el estudio que nos lleva, a través de la observación y el experimento, a la verdadera realidad de la Naturaleza, y, para ello, utilizamos nuestra imaginación para construir modelos y teorías que nos acerquen a esa verdad que presentimos y tratamos de desvelar”.

Los que bebemos de la Ciencia, sentimos que “lo divino” se aleja más y más. Sin embargo, no podemos dejar de sentir que, de alguna manera, algo superior nos vigila, yo lo achaco a ese miedo ancestral que, desde siempre, hemos tenido por lo desconocido y que, inmerso en una profunda ignorancia, no pocas veces hemos querido explicar mediante causas “divinas”, y, sin embargo, cuando, finalmente, hemos dado con las respuestas, estas eran de este mundo y, siempre, eran respuestas lógicas que la Naturaleza nos ofrecía y que no sabíamos compreneder.“ ¿El Creador? Es el Universo con sus complejos sistemas de ritmos y energías el que nos lleva hacia ese futuro que deseamos alcanzar. No existe ningún creador.

Bueno, la definición que de la Ciencia hago y reseño encima de la imagen de arrina, no será perfecta pero, para cumplir los objetivos propuestos es válida y suficiente aunque (como es el caso) le falten algunos matices.

Aquí, en esta página, siempre nos hemos limitado a aquellas disciplinas más estrictas: La Física, La Astronomía, La Cosmología, La Geología, La Química y La Tecnología, Sin olvidar las matemáticas, ya que son indispensables para la Ciencia y están ineludiblemente conexionada con todas ellas que, de una u otra manera, las necesita para poder expresar, en su más alto grado, lo más profundo que esa Ciencia nos quiere decir. Es decir, las matemáticas son el lenguaje del que se vale la Ciencia para decir al mundo lo que realmente son en cada una de sus vertientes. He dejado aparte y sin querer tratar de ellas, las disciplinas más ligeras –La Antropología, La Agronomía, La Psicología, La Medicina y otras del mismo estilo o parecidas- para otros momentos.

Algo que nunca he tomado en consideración ha sido el pragmatismo de la Ciencia o la motivación de los científicos. Estas cuestiones se han utilizado a menudo para desacreditar las Ciencias no occidentales: sí es un trabajo bien hecho, pero no es “puro”, o, a la inversa, no resulta práctico. En cuanto a la motivación, muchos descubrimientos científicos fueron impulsados por la religión: los matemáticos árabes perfeccionaron el álgebra en parte para facilitar las leyes islámicas de la herencia, del mismo modo que los védicos de la India resolvieron raíces cuadradas para construir los altares de los sacrificios con unas dimensiones adecuadas. En estos casos la Ciencia estuvo al servicio de la religión, pero no obstante era Ciencia.

La ley de los epónimos de Stigler, formulada por el experto en estadística Stephen Stigler, afirma que ningún descubrimiento científico lleva el nombre de su descubridor original. El periodista Jim Holt indica que la propia Ley Stigler confirma lo que dice, ya que Stigler admite que la Ley que lleva su nombre fue descubierta por otra persona, concretamente por Robert K. Merton, un especialista en Sociología de la Ciencia.

El área del cuadrado construido sobre la hipotenusa de un triángulo rectángulo, es igual a la suma de las áreas de los cuadrados construidos sobre los catetos.

Entre todos los casos en que se cumple la Ley de Stigler, el más famoso es el del Teorema de Pitágoras (a²+ b² = c², donde a y b son los lados perpendiculares y c es la hipotenusa). Jakob Bronowski escribe lo siguiente:

“Hasta la fecha, el Teorema de Pitágoras sigue siendo el teorema más importante de todas las matemáticas. Esta afirmación puede parecer atrevida y extraordinaria, pero no es extravagante, ya que lo que el teorema de Pitágoras establece es una caracterización fundamental del espacio en que nos movemos y es en este teorema donde dicha caracterización se expresa por primera vez traducida a números. Además, el encaje exacto de los números describe las leyes exactas que rigen el universo. De hecho, se ha propuesto que los números correspondientes a las dimensiones de los triángulos rectángulos sean mensajes que podrían enviarse (de hecho se ha hecho) a planetas de otros sistemas estelares a modo de test, para comprobar si estos planetas tienen ocupación debida a seres dotados de vida racional.

La placa con el mensaje que llevan la Pioneer 10 y 11

Claro que el problema está en que, no fue Pitágoras el primero que propuso “su” teorema. Los hindúes, los egipcios y los babilonios utilizaban “tríos de números pitagóricos” para determinar ángulos rectos en la construcción de edificios. Un trío de números pitagóricos es un conjunto de tres números que representan las dimensiones de los lados de un triángulo rectángulo. El trío más habitual es 3 : 4 : 5 (3² + 4² = 5² o 9 + 16 = 25). Pitágoras “inventó” este teorema hacia el año 550 a. C. Los Babilonios, según todos los indicios, ya habían catalogado quizá cientos de tríos antes del año 2000 a. C., en una época muy anterior a la de Pitágoras. Uno de los tríos que hallaron los babilonios tienen unos números tan enormes como: 3.367 : 3.456 : 4.825.”

El ojo humano tiene sus limitaciones para ver, sin embargo, la imaginación no tiene barreras y, a lo largo de la historia de la Humanidad se han dado pruebas de lo lejos que pueden llegar nuestros pensamientos.Los Babilonios, egipcios e Hindúes le dejaron un campo sembrado a Pitágoras que, en realidad, sólo tuvo que recoger la abundante cosecha. Él sí supo “ver”.

Ahí están y existen indicios de que los babilonios utilizaron diversas técnicas algebraicas derivadas de la fórmula a² + b² = c². Lo que puede reconocerse como un logro de Pitágoras, que impresionó a muchos, fue la elaboración de una demostración geométrica del teorema… El área del cuadrado construido sobre la hipotenusa de un triángulo rectángulo, es igual a la suma de las áreas de los cuadrados construidos sobre los catetos.

Fue Euclides quien proclamó dos siglos más tardes la idea de que la demostración podía ser algo más importante que el propio teorema. Por consiguiente, las matemáticas no occidentales han quedado consideradas como unas matemáticas de segunda categoría debido a que se apoyan sobre una base empírica y no sobre demostraciones.

Ambos métodos son útiles. La Geometría euclidiana que aprendimos la mayoría de nosotros es axiomática. Parte de un axioma, es decir, una ley que se supone cierta, y los teoremas se deducen razonando de manera descendente a partir de ahí. Es deductiva y axiomática. Siglos más tarde, al-Hazin en Oriente y Galileo en Occidente contribuyeron a popularizar un método inductivo y empírico para la Ciencia, algo más parecido a lo que los babilonios, los egipcios y los hindúes habían utilizado. No se parte de suposiciones sino de datos y mediciones, para luego razonar de forma ascendente hacia verdades que recubren los datos conocidos. Lo que actualmente llamamos Ciencia es una materia que en su mayor parte es empírica. Cuando Isaac Newton recopiló datos relativos al paso de los cometas, a las lunas de Júpiter y de Saturno y a las mareas que se producían en el estudio del río Támesis para elaborar una gran síntesis en los Principia, estaba trabajando de una manera empírica e inductiva.

Las matemáticas son ligeramente diferentes, pero muchos matemáticos ven la necesidad de realizar tanto trabajos basados en las demostraciones como trabajos basados en las observaciones empíricas. Un caso puntero que podemos mencionar es el del gran matemático indio Srinivasa Ramanujan, cuyos “cuadernos perdidos” de anotaciones contienen el germen de la teoría de las supercuerdas y cuyos trabajos han sido utilizados para calcular el número π hasta millones de dígitos en su parte decimal.

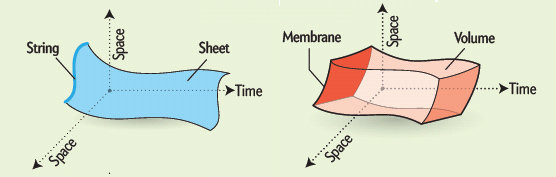

Uno de los secretos más profundos de la teoría de cuerdas, que aún no es bien comprendido, es por qué está definida sólo en diez, once y veintiséis dimensiones. Es ahí, donde la Teoría se hace fuerte y nos facilita la posibilidad de continuar su desarrollo.

Si calculamos cómo se rompen y se vuelven a juntar las cuerdas en el espacio N-dimensional, constantemente descubrimos que pululan términos absurdos que destruyen las maravillosas propiedades de la teoría. Afortunadamente, estos términos indeseados aparecen multiplicados por (N-10). Por consiguiente, para hacer que desaparezcan estas anomalías, no tenemos otra elección cuántica que fijar N = 10. La teoría de cuerdas, de hecho, es la única teoría cuántica conocida que exige completamente que la dimensión del espacio-tiempo esté fijada en un número único, el diez.

Por desgracia, los teóricos de cuerdas están, por el momento, completamente perdidos para explicar por qué se discriminan las diez dimensiones. La respuesta está en las profundidades de las matemáticas, en un área denominada funciones modulares (¿Las de Ramanujan?).

Al manipular los diagramas de lazos de Kikkawa, Sakita y Virasoro creados por cuerdas en interacción, allí están esas extrañas funciones modulares en las que el número 10 aparecen en los lugares más extraños.

Estas funciones modulares son tan misteriosas como el hombre que las investigó, el místico del este. Quizá si entendiéramos mejor el trabajo de este genio indio, comprenderíamos por qué vivimos en nuestro universo actual.

Una partícula, una cuerda abierta y

una cerrada, describiendo sus órbitas en el

espacio-tiempo 4D.

El misterio de las funciones modulares podría ser explicado por quien ya no existe, Srinivasa Ramanujan, el hombre más extraño del mundo de los matemáticos. Igual que Riemann, murió antes de cumplir cuarenta años, y como Riemann antes que él, trabajó en total aislamiento en su universo particular de números y fue capaz de reinventar por sí mismo lo más valioso de cien años de matemáticas occidentales que, al estar aislado del mundo en las corrientes principales de los matemáticos, le eran totalmente desconocidos, así que los buscó sin conocerlos. Perdió muchos años de su vida en redescubrir matemáticas conocidas.

Dispersas entre oscuras ecuaciones en sus cuadernos están estas funciones modulares, que figuran entre las más extrañas jamás encontradas en matemáticas. Ellas reaparecen en las ramas más distantes e inconexas de las matemáticas. Una función que aparece una y otra vez en la teoría de las funciones modulares se denomina (como ya he dicho otras veces) hoy día “función de Ramanujan” en su honor. Esta extraña función contiene un término elevado a la potencia veinticuatro.

El número 24 aparece repetidamente en la obra de Ramanujan. Este es un ejemplo de lo que las matemáticas llaman números mágicos, que aparecen continuamente donde menos se les esperan por razones que nadie entiende. Milagrosamente, la función de Ramanujan aparece también en la teoría de cuerdas. El número 24 que aparece en la función de Ramanujan es también el origen de las cancelaciones milagrosas que se dan en la teoría de cuerdas. En la teoría de cuerdas, cada uno de los veinticuatro modos de la función de Ramanujan corresponde a una vibración física de la cuerda. Cuando quiera que la cuerda ejecuta sus movimientos complejos en el espacio-tiempo dividiéndose y recombinándose, deben satisfacerse un gran número de identidades matemáticas altamente perfeccionadas. Estas son precisamente las entidades matemáticas descubiertas por Ramanujan. Puesto que los físicos añaden dos dimensiones más cuando cuentan el número total de vibraciones que aparecen en una teoría relativista, ello significa que el espacio-tiempo debe tener 24 + 2 = 26 dimensiones espacio-temporales.

Una interacción general entre cuerdas se puede representar como la suma de interacciones más “elementales”, empezando con el diagrama árbol que representa la interacción con la mayor probabilidad de ocurrir, seguida por las correcciones perturbativas, es decir, por los demás diagramas de la serie infinita. Como puede observarse en dicha figura, las superficies que representan las interacciones no se vuelven increiblemente complicadas como los digramas de partículas, ya que sólo hay que agregarle agujeros a una superficie dada.

Para comprender este misterioso factor de dos (que añaden los físicos), consideramos un rayo de luz que tiene dos modos físicos de vibración. La luz polarizada puede vibrar, por ejemplo, o bien horizontal o bien verticalmente. Sin embargo, un campo de Maxwell relativista Aµ tiene cuatro componentes, donde µ = 1, 2, 3, 4. Se nos permite sustraer dos de estas cuatro componentes utilizando la simetría gauge de las ecuaciones de Maxwell. Puesto que 4 – 2 = 2, los cuatro campos de Maxwell originales se han reducido a dos. Análogamente, una cuerda relativista vibra en 26 dimensiones. Sin embargo, dos de estos modos vibracionales pueden ser eliminados cuando rompemos la simetría de la cuerda, quedándonos con 24 modos vibracionales que son las que aparecen en la función de Ramanujan.

Ramanujan en Cambridge

Con tan solo doce años dominaba la trigonometría; unos años después se hizo con una copia del libro de George Carr <<A sinopsis of Elementary Results in Pure and Applied Mathematics>>. El libro contenía una lista de los 4.400 resultados clásicos de la matemática, pero sin demostraciones, así es que Ramanujan lo asumió como un reto. Durante los siguientes años se dedicó a fondo en este libro, y comenzó a llenar su libreta de resultados e ideas que no aparecían en el libro original. Al igual que Euler poseía un talento y una intuición excepcional, esto hacía que jugase y trasformarse las fórmulas hasta conseguir nuevas perspectivas.

Cuando se generaliza la función de Ramanujan, el 24 queda reemplazado por el número 8. Por lo tanto, el número crítico para la supercuerda es 8+2=10. Este es el origen de la décima dimensión que exige la teoría. La cuerda vibra en diez dimensiones porque requiere estas funciones de Ramanujan generalizadas para permanecer auto consistente. Dicho de otra manera, los físicos no tienen la menor idea de por qué 10 y 26 dimensiones se seleccionan como dimensión de la cuerda. Es como si hubiera algún tipo de numerología profunda que se manifestara en estas funciones que nadie comprende. Son precisamente estos números mágicos que aparecen en las funciones modulares elípticas los que determinan que la dimensión del espacio-tiempo sea diez.

En el análisis final, el origen de la teoría decadimensional es tan misterioso como el propio Ramanujan. Si alguien preguntara a cualquier físico del mundo por qué la naturaleza debería existir en diez dimensiones, estaría obligado a responder “no lo sé”. Se sabe en términos difusos, por qué debe seleccionarse alguna dimensión del espacio tiempo (de lo contrario la cuerda no puede vibrar de una forma cuánticamente autoconsistente), pero no sabemos por qué se seleccionan estos números concretos.

Quizá la respuesta a todo esto esté esperando a ser descubierta cuando alguien (algún genio matemático como Perelman) sea capaz de entender el contenido de los cuadernos perdidos de Ramanujan.

Está claro que, este simple comentario no explica lo que la Ciencia es y, desde luego, tendríamos que ir a una complejidad mucho más profunda y elevada para poder hablar de algunas ramas de la Ciencia que requieren de un nivel de comprensión de la Naturaleza que, de ninguna manera poseo. ¿Cómo he terminado este trabajo como lo he hecho? Empecé con una intención y, por el camino, como si tuviera vida propia, los pensamientos te llevan por otros senderos que, nunca habías pensado recorrer. ¡Qué cosas!

emilio silvera

Oct

14

¡Los materiales para la vida!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Bioquímica ~

Clasificado en Bioquímica ~

Comments (1)

Comments (1)

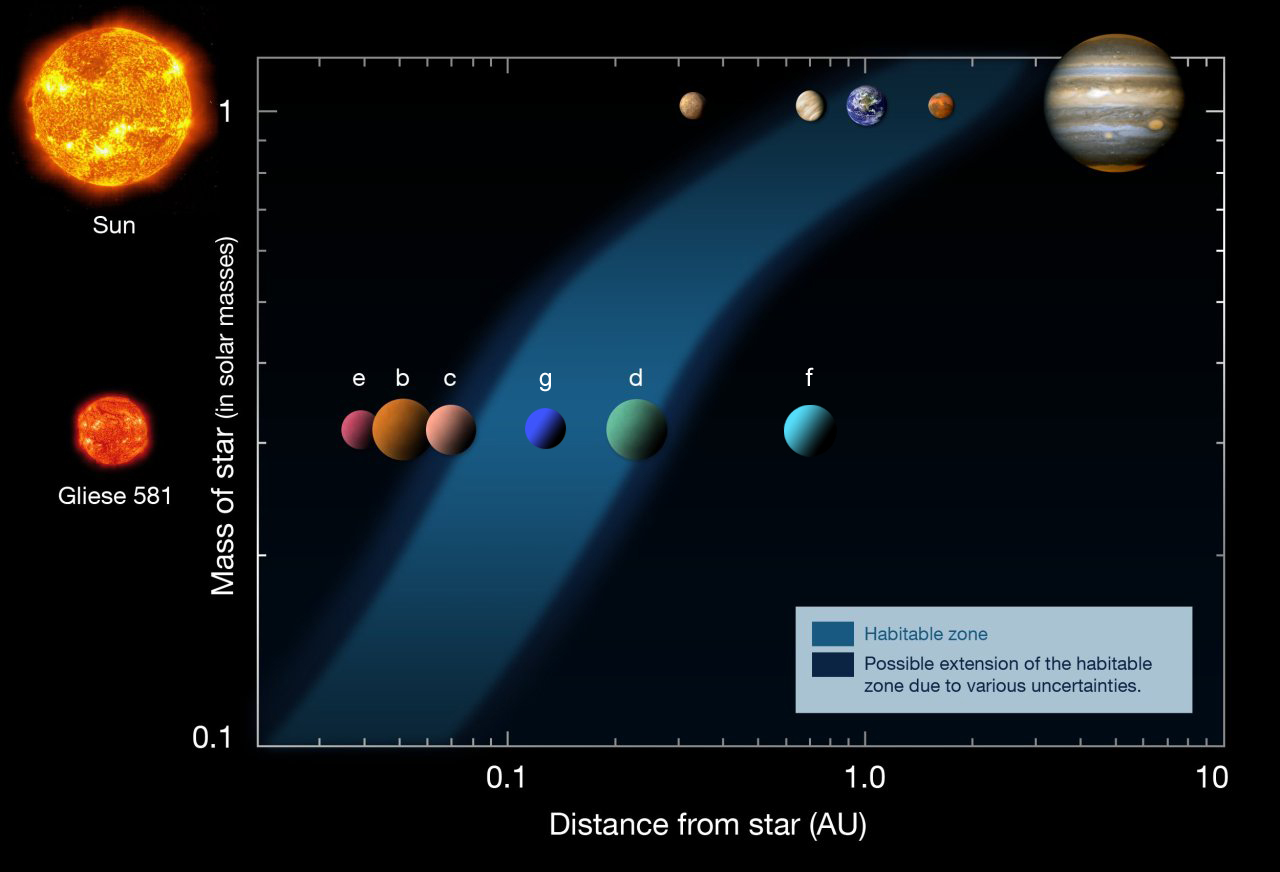

¡La Física! Cuando se asocia a otras disciplinas ha dado siempre un resultado espectacular y, en el caso de la Astronomía, cuando se juntó con la Física, surgió esa otra disciplina que llamamos Astrofísica. La Astrofísica es esa nueva rama de la Astronomía que estudia los procesos físicos y químicos en los que intervienen los fenómenos astronómicos. La Astrofísica se ocupa de la estructura y evolución estelar (incluyendo la generación y transporte de energía en las estrellas), las propiedades del medio interestelar y sus interacciones en sus sistemas estelares y la estructura y dinámica de los sistemas de estrellas (como cúmulos y galaxias) y sistemas de galaxias. Se sigue con la Cosmología que estudia la naturaleza, el origen y la evolución del universo. Existen varias teorías sobre el origen y evolución del universo (big bang, teoría del estado estacionario, etc.

Las estrellas, como todo en el Universo, no son inmutables y, con el paso del Tiempo, cambian para convertirse en objetos diferenters de los que, en un principio eran. Por el largo trayecto de sus vidas, transforman los materiales simples en materiales complejos sobre los que se producen procesos biológico-químicos que, en algunos casos, pueden llegar hasta la vida.

Una de las cosas que siempre me han llamado poderosamente la atención, han sido las estrellas y las transformaciones que, dentro de ellas y los procesos que en su interior se procesan, dan lugar a las transiciones de materiales sencillos hacia materiales más complejos y, finalmente, cuando al final de sus vidas expulsan las capas exteriores al espacio interestelar dejando una extensa región del espacio interestelar sembrada de diversas sustancias que, siguiendo los procesos naturales e interacciones con todo lo que en el lugar está presente, da lugar a procesos químicos que transforman esas sustancias primeras en otras más complejas, sustancias orgánicas simples como, hidrocarburos y derivados que, finalmente, llegan a ser los materiales necesarios para que, mediante la química-biológica del espacio, den lugar a moléculas y sustancias que son las propicias para hacer posible el surgir de la vida.

La Química de los Carbohidratos es una parte de la Química Orgánica que ha tenido cierta entidad propia desde los comienzos del siglo XX, probablemente debido a la importancia química, biológica (inicialmente como sustancias de reserva energética) e industrial (industrias alimentaria y del papel) de estas sustancias. Ya muy avanzada la segunda mitad del siglo XX han ocurrido dos hechos que han potenciado a la Química de Carbohidratos como una de las áreas con más desarrollo dentro de la Química Orgánica actual.

Todos los animales, plantas y microbios están compuestos fundamentalmente, por las denominadas sustancias orgánicas. Sin ellas, la vida no tiene explicación (al menos que sepamos). De esta manera, en el primer período del origen de la vida tuvieron que formarse dichas sustancias, o sea, surgimiento de la materia prima que más tarde serviría para la formación de los seres vivos.

La característica principal que diferencia a las sustancias orgánicas de las inorgánicas, es que en el contenido de las primeras se encuentra como elemento fundamental el Carbono.

En las sustancias orgánicas, el carbono se combina con otros elementos: hidrógeno y oxígeno (ambos elementos juntos forman agua), nitrógeno (este se encuentra en grandes cantidades en el aire, azufre, fósforo, etc. Las distintas sustancias orgánicas no son más que las diferentes combinaciones de los elementos mencionados, pero en todas ellas, como elemento básico, siempre está el Carbono.

En el primer nivel (abajo) están los productores, o sea las plantas como maíz, frijol, papaya, cupesí, mora, yuca, árboles, hierbas, lianas, etc., que producen hojas, frutas, raíces, semillas, que comen varios animales y la gente.

En el segundo nivel están los primeros consumidores, que comen hierbas, hojas (herbívoros) y frutas (frugívoros). Estos primeros consumidores incluyen a insectos como hormigas, aves como loros y mamíferos como ratones, urina, chanchos, chivas, vacas.

En el tercer nivel están los segundos consumidores (carnívoros), es decir los que se comen a los animales del segundo nivel: por ejemplo el oso bandera come hormigas, el jausi come insectos y la culebra come ratones.

Nosotros, los humanos, somos omnívoros, es decir comemos de todo: plantas y animales. Algunos de los carnívoros comen, a veces, plantas también, como los perros. Otros, como el chancho, comen muchas plantas y a veces también carne.

Las sustancias orgánicas más sencillas y elementales son los llamados hidrocarburos o composiciones donde se combinan el Oxígeno y el Hidrógeno. El petróleo natural y otros derivados suyos, como la gasolina, el keroseno, etc., son mezcolanzas de varios hidrocarburos. Con todas estas sustancias como base, los químicos obtienen sin problemas, por síntesis, gran cantidad de combinados orgánicos, en ocasiones muy complejos y otras veces iguales a los que tomamos directamente los seres vivos, como azúcares, grasas, aceites esenciales y otros. Debemos preguntarnos como llegaron a formarse en nuestro planeta las sustancias orgánicas. Está claro que, para los iniciados en estos temas, la cosa puede parecer de una complejidad inalcanzable, nada menos que llegar a comprender ¡el origen primario de las sustancias orgánicas!

Es nuestro planeta y el único habitado (que se sepa hasta el momento). Está en la ecosfera, un espacio que rodea al Sol y que tiene las condiciones necesarias para que exista vida. Claro que, ¡son tantos los mundos! Cómo vamos a ser nosotros nos únicos que poblemos el Universo? ¡Que despercidicio de espacio!

La observación directa de la Naturaleza que nos rodea nos puede facilitar las respuestas que necesitamos. En realidad, si ahora comprobamos todas las sustancias orgánicas propias de nuestro mundo en relación a los seres vivos podemos ver que, todas, son producidas hoy día en la Tierra por efecto de la función activa y vital de los organismos.

Las plantas verdes absorben el carbono inorgánico del aire, en calidad de anhídrido carbónico, y con la energía de la luz crean, a partir de éste, sustancias orgánicas necesarias para ellas. Los animales, los hongos, también las bacterias y el resto de organismos, menos los de color verde, se alimentan de animales o vegetales vivos o descomponiendo estos mismos, una vez muertos, pueden proveerse de las sustancias orgánicas que necesitan. Con esto, podemos ver como todo el mundo actual de los seres vivos depende de los dos hechos análogos de fotosíntesis y quimiosíntesis, aplicados en las líneas anteriores.

Incluso las sustancias orgánicas que se encuentran bajo tierra como la turba, la hulla o el petróleo, han surgido, básicamente, por efecto de la acción de diferentes organismos que en un tiempo remoto se encontraban en el planeta Tierra y que con el transcurrir de los siglos quedaron ocultos bajo la maciza corteza terrestre.

Todo esto fue causa de que muchos científicos de finales del siglo XIX y principios del XX, afirmaran que era imposible que las sustancias orgánicas produjeran en la Tierra, de forma natural, solamente mediante un proceso biogenético, o sea, con la única intervención de los organismos. Esta opinión predominante entre los científicos de hace algunas décadas, constituyó un obstáculo considerable para hallar una respuesta a la cuestión del origen de la vida.

Para tratar esta cuestión era indispensable saber cómo llegaron a constituirse las sustancias orgánicas; pero ocurría que éstas sólo podían ser sintetizadas por organismos vivos. Sin embargo, únicamente podemos llegar a esta síntesis si nuestras observaciones no van más allá de los límites del planeta Tierra. Si traspasamos esa frontera nos encontraremos con que en diferentes cuerpos celestes de nuestra Galaxia se están creando sustancias orgánicas de manera abiogenética, es decir, en un ambiente que excluye cualquier posibilidad de que existan seres orgánicos en aquel lugar.

Estrella de carbono (estrella gigante roja)

Con un espectroscopio podemos estudiar la fórmula química de las atmósferas estelares, y en ocasiones casi con la misma exactitud que si tuviéramos alguna muestra de éstas en el Laboratorio. El Carbono, por ejemplo, se manifiesta ya en las atmósferas de las estrellas tipo O, que son las que están a mayor temperatura, y su increíble brillo es lo que las diferencia de los demás astros (Ya os hablé aquí de R. Lepori, la estrella carmesí, o, también conocida como la Gota de Sangre, una estrella de Carbono de increíble belleza).

En la superficie de las estrellas de Carbono existe una temperatura que oscila los 20.000 y los 28.000 grados. Es comprensible, entonces, que en esa situación no pueda prevalecer aún alguna combinación química. La materia está aquí en forma relativamente simple, como átomos libres disgregados, sueltos como partículas minúsculas que conforman la atmósfera incandescente de estos cuerpos estelares.

La atmósfera de las estrellas tipo B, característica por su luz brillante blanco-azulada y cuya corteza tiene una temperatura que va de 15.000 a 20.000 grados, también tienen vapores incandescentes de carbono. Pero aquí este elemento tampoco puede formar cuerpos químicos compuestos, únicamente existe en forma atómica, o sea, en forma de pequeñísimas partículas sueltas de materia que se mueven a una velocidad de vértigo.

Sólo la visión espectral de las estrellas Blancas tipo A, en cuya superficie hay una temperatura de unos 12.000º, muestras unas franjas tenues, que indican, por primera vez, la presencia de hidrocarburos –las más primitiva combinaciones químicas de la atmósfera de estas estrellas. Aquí, sin que existan antecedentes, los átomos de dos elementos (el carbono y el hidrógeno) se combinan resultando un cuerpo más perfecto y complejo, una molécula química.

Observando las estrellas más frías, las franjas características de los hidrocarburos son más limpias cuando más baja es la temperatura y adquieren su máxima claridad en las estrellas rojas, en cuya superficie la temperatura nunca es superior a los 4.000º.

Es curioso el resultado obtenido de la medición de Carbono en algunos cuerpos estelares por su temperatura:

- Proción: 8.000º

- Betelgeuse: 2.600º

- Sirio: 11.000º

- Rigel: 20.000º

Como es lógico pensar, las distintas estrellas se encuentran en diferentes períodos de desarrollo. El Carbono se encuentra presente en todas ellas, pero en distintos estados del mismo. Las estrellas más jóvenes, de un color blanco-azulado son a la vez las más calientes. Éstas poseen una temperatura muy elevada, pues sólo en la superficie se alcanzan los 20.000 grados. Así todos los elementos que las componen, incluido el Carbono, están en forma de átomos, de diminutas partículas sueltas.

Existen estrellas de color amarillo y la temperatura en su superficie oscila entre los 6.000 y los 8.000º. En estas también encontramos Carbono en diferentes combinaciones.

El Sol, pertenece al grupo de las estrellas amarillas y en la superficie la temperatura es de 6.000º. El Carbono en la atmósfera incandescente del Sol, lo encontramos en forma de átomo, y además desarrollando diferentes combinaciones: Átomos de Carbono, Hidrógeno y Nitrógeno, Metino, Cianógeno, Dicaerbono, es decir:

- Átomos sueltos de Carbono, Hidrógeno y Nitrógeno.

- Miscibilidad combinada de carbono e hidrógeno (metano)

- Miscibilidad combinada de carbono y nitrógeno (cianógeno); y

- Dos átomos de Carbono en combinación (dicarbono).

En las atmósferas de las estrellas más calientes, el carbono únicamente se manifiesta mediante átomos libres y sueltos. Sin embargo, en el Sol, como sabemos, en parte, se presenta ya, formando combinaciones químicas en forma de moléculas de hidrocarburo de cianógeno y de dicarbono.

La tormenta interminable de Júpiter y su enrarecida atmósfera

Para hallar las respuestas que estamos buscando en el conocimiento de las sustancias y materiales presentes en los astros y planetas, ya se está realizando un estudio en profundidad de la atmósfera de los grandes planetas del Sistema solar. Y, de momento, dichos estudios han descubierto, por ejemplo, que la atmósfera de Júpiter está formada mayoritariamente por amoníaco y metano. Lo cual hace pensar en la existencia de otros hidrocarburos. Sin embargo, la masa que forma la base de esos hidrocarburos, en Júpiter permanece en estado líquido o sólido a causa de la abaja temperatura que hay en la superficie del planeta (135 grados bajo cero). En la atmósfera del resto de grandes planetas se manifiestan estas mismas combinaciones.

Ha sido especialmente importante el estudio de los meteoritos, esas “piedras celestes” que caen sobre la Tierra de vez en cuando, y que provienen del espacio interplanetario. Estos han representado para los estudiosos los únicos cuerpos extraterrestres que han podido someter a profundos análisis químico y mineralúrgico, de forma directa. Sin olvidar, en algunos casos, los posibles fósiles.

Estos meteoritos están compuestos del mismo material que encontramos en la parte más profunda de la corteza del planeta Tierra y en su núcleo central, tanto por el carácter de los elementos que los componen como por la base de su estructura. Es fácil entender la importancia capital que tiene el estudio de los materiales de estas piedras celestes para resolver la cuestión del origen de las primitivas composiciones durante el período de formación de nuestro planeta que, al fin y al cabo, es la misma que estará presente en la conformación de otros planetas rocosos similares al nuestro, ya que, no lo olvidemos, en todo el universo rigen las mismas leyes y, la mecánica de los mundos y de las estrellas se repiten una y otra vez aquí y allí, a miles de millones de años-luz de nosotros.

Así que, se forman hidrocarburos al contactar los carburos con el agua. Las moléculas de agua contienen oxígeno que, combinado con el metal, forman los hidróxidos metálicos, mientras que el hidrógeno del agua mezclado con el carbono forman los hidrocarburos.

Los hidrocarburos originados en la atmósfera terrestre se mezclaron con las partículas de agua y amoníaco que en ella existían, creando sustancias más complejas. Así, llegaron a hacerse presentes la formación de cuerpos químicos. Moléculas compuestas por partículas de oxígeno, hidrógeno y carbono.

Todo esto desembocó en el saber sobre los Elementos que hoy podemos conocer y, a partir de Mendeléiev (un eminente químico ruso) y otros muchos…se hizo posible que el estudio llegara muy lejos y, al día de hoy, podríamos decir que se conocen todos los elementos naturales y algunos artificiales que, nos llevan a tener unos valiosos datos de la materia que en el universo está presente y, en parte, de cómo funciona cuando, esas sustancias o átomos, llegan a ligarse los unos con los otros para formar, materiales más complejos que, aparte de los naturales, están los artificiales o transuránicos.

Aquí en la Tierra, las reacciones de hidrocarburos y sus derivados oxigenados más simples con el amoníaco generaron otros cuerpos con distintas combinaciones de átomos de carbono, hidrógeno, oxígeno y nitrógeno (CHON) en su moléculas llamadas paras la vida una vez que, más tarde, por distintos fenómenos de diversos tipos, llegaron las primeras sustancias proteínicas y grasas que, dieron lugar a los aminoácidos, las Proteínas y el ADN y RDN que, finalmente desembocó en eso que llamamos vida y que, evolucionado, ha resultado ser tan complejo y, a veces, en ciertas circunstancias, peligroso: ¡Nosotros!

emilio silvera

Oct

14

¡La Vida! sigue siendo misteriosa

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Biologia ~

Clasificado en Biologia ~

Comments (3)

Comments (3)

Aunque no podamos ubicar con exactitud dónde empezó la vida de una manera categórica, parece cada vez más probable que, una vez acabado el bombardeo al que fue sometida la Tierra en su juventud, la vida surgió confinada en lugares situadosm o bien por debajo del lecho marino, o bien cerca de las chimeneas volcánicas, o dentro de los sistemas hidrotermales en las margenes de las dorsales oceánicas. Una vez establecida al resguardo de lugares semejantes, el camino quedó abierto para la proliferación y diversificación.

Está claro que, a partir de todas estas suposiciones, hemos seguido especulando acerca de lo que pudo ser y, a partir de todo lo anterior, admitamos que aquellos microbios primitivos eran termófilos y que podían soportar temperaturas de entre 100 y 150 grados Celcius. Moraban al menos a un kilómetro bajo la superficie, posiblemente en el lecho marino, pero más probablemente en las rocas porosas que hay debajo. Inmersos en agua supercaliente repleta de minerales, ingerían rápidamente y procesaban hierro, azufre, hidrógeno y otras sustancias disponibles, liberando energía a partir de ciclos químicos primitivos y más bien ineficientes. Estas células primitivas eran comedoras de roca en bruto. Ni la luz ni el oxígeno desempeñaban ningún papel en su metabolismo. Ni tampoco requerían material orgánico, hacían lo que necesitaban directamente, a partir de las rocas y el dióxido de carbono disuelto en el agua.

La primera colonia microbiana tenía todo el mundo a su disposición, y un completo suministro de materiales y energía. Se habría extendido con sorprendente velocidad. La capacidad de los microbios para multiplicarse a velocidad explosiva garantizaba que ellos invadirían rápidamente cualquier nicho accesible. Sin ninguna competencia de los residentes, podrían heredar rápidamente la Tierra. Sin embargo, dada la explosión de población, la colonia habría alcanzado pronto los limites de su habitat. Impedidos para ir a mayor profundidad por las temperaturas crecientes, e incapaces de reproducirse en los estratos superficiales más fríos, los microbios sólo podían expandirse horizontalmente a lo largo de las cordilleras volcánicas, y lateralmente a través del basalto del suelo oceánico.

La capa rígida y más externa de la Tierra, que comprende la corteza y el manto superior, es llamada litosfera. La corteza oceánica contiene un 0,147% de la masa de la corteza terrestre. La mayor parte de la corteza terrestre fue creada a través de actividad volcánica. El sistema de cordilleras oceánicas, una red de 40.000 kilómetros de volcanes (25.000 millas), genera nueva corteza oceánica a un ritmo de 17 km3 por año, cubriendo el suelo oceánico con basalto. Hawai e Islandia son dos ejemplos de la acumulación de material basáltico.

En alguna etapa, quizá hace 3.800 millones de años se alcanzó la primera gran división evolutiva, cuando un grupo de microbios se encontraron repentinamente aislados de su habitat caliente y acogedor debido a alguna catástrofe geológica, como un terremoto o una gran erupción volcánica.

Aquel grupo, islados de la colonia principal, y encerrados en una región más fría, hizo que los microbios se quedaran en estado latente o simplemente murieron, pues sus membranas eran demasiado rígidas a estas temperaturas inferiores para que su metabolismo pudiera funcionar. Sin embargo, un mutante feliz, que accidentalmente tenía una membrana más flexible, sobrevivió y se multiplicó. Al hacer la transición a condiciones más frías, el microbio mutante allanó el camino para acceder a la superficie inhabitada del planeta. Mientras tanto, para los miembros de la colonia original, confinada confortablemente en el reino subterráneo, la vida ha continuado prácicamente igual hasta nuestros días.

Un primer desarrollo clave fue un cambio que hicieron algunos organismos de las sustancias químicas a la luz como fuente de energía, y por entonces la vida debió de extenderse hasta la superficie. Probablemente, el primero de tales “fotótrofos” no utilizaba la moderna fotosíntesis de clorofila, sino algún proceso más elemental. Algunas arqueobacterias del Mar Muerto siguen utilizando una forma más bien primitiva de fotosíntesis basada en una sustancia roja relacionada con la vitamina A. La captura de la luz solar comenzó en serio con las bacterias, que descubrieron una forma de arrancar electrones de minerales, potenciarlos con fotones solares y utilizar la energía almacenada para fabricar material orgánico.

En las profundidades abisales del oceano, las bacterias usan hidrógeno y producen materia orgánica.

Un refinamiento posterior los liberó de la dependencia de minerales, permitiendo a las bacterias arrancar electrones del agua y liberar oxígeno en consecuencia. El componente crucial en este ingenioso proceso era la clorofila, la sustancia que da el color verde a las plantas. Puesto que sólo se necesitaba agua, dióxido de carbono y luz, estaba abierto el camino para el verdor del planeta.

Todavía queda por responder cómo y cuando aparecieron los tres grandes dominios: arqueobacterias, bacterias y eucarias. Parece probable que la gran división en el árbol de la vida entre arqueobacterias y bacterias tuvo lugar antes de la invención de la fotosíntesis, quizá tan temprano como hace 3.900 o 4.000 millones de años, bien entrada la era del bombardeo intenso.

La evidencia apunta a que las arqueobacterias sean los organismos más viejos y más primitivos, y que las bacterias aparecieron algo más tarde. Tan profunda era la división entre las arqueobacterias y las bacterias que ellas no han sido nunca rivales; siguen ocupando nichos diferentes después de varios miles de millones de años de evolución.

Finalmente, la profunda escisión que produjo el dominio de las eucarias ocurrió probablemente cuando las condiciones eran algo más frías. Por alguna razón, quizá por estar espuestas a los desafíos de un entorno menos estable, las eucarias de temperatura más baja se desarrollaron a un ritmo mucho más rápido.

El posterios florecimiento de la vida, su diversificación en muchas especies, y el enorme aumento de la complejidad biológica derivan directamente de la ramificación de las eucarias en el árbol de la vida. Sin este paso trascendental, es poco probable que nosotros -o cualesquiera otros seres sintientes- existiéramos hoy en la Tierra para poder reflexionar sobre el significado de la vida en la Tierra desde sus comienzos hasta el momento presente.

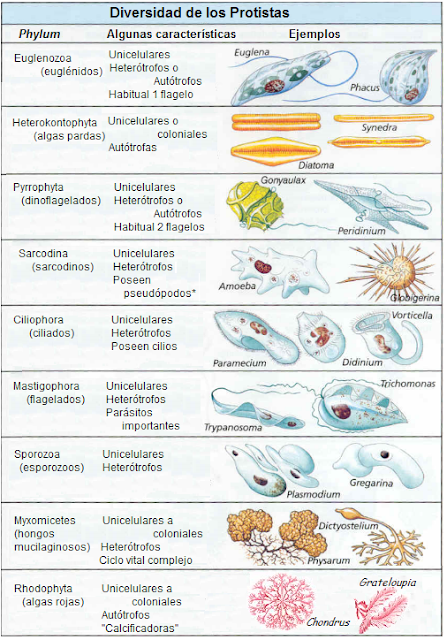

Mas tarde, en 1969, Robert Whuttaker propone una clasificación de los seres vivos en cinco reinos, en la que incorpora la distinción procariota-eucariota (ésta se considera actualmente mucho más importante que la de vegetal-aminal del sistema tradicional). Así quedan patente las diferencias entre las algas verde-azuladas(cuanolíceas) y las bacterias (ambas sin núcleo patente (procariotas) y todos los demás organismos que tienen un núcleo rodeado por membrana (eucqariotas). Los procariotas fueron incluídos en el reino Monera y los eucariotas en los cuatro restantes.

A partir de esta clasificación ha surgido la de Margulis- Schwartz (1985), también en cinco reinos (es la que aúin aparedce en lso libros de texto). Se basa en estudios fologenéticos y tiene la ventaja de hacer grupos más homogéneos. Cambia el reino protistas por el de Protostistas, en el que incluye a Protozoos, todas las algas (excepto cianofíceas) y los hongos inferiores.

Difícilmente podríamos aquí, en un simple repaso a lo que fue el comienzo y la evolución de la vida primigenia en nuestro planeta, hacer una relación pormenorizada de todo lo que ello implica y, nos limitamos, como podeís ir comprobando, a dejar trabajos sueltos con retazos de lo que “pudo haber sucedido” para que, de alguna manera, podamos llegar a una más amplia comprensión de tan complejo problema. Nada más y nada menos que…¡La Vida!

emilio silvera

Oct

14

¡La Humanidad! Una muestra de vida interesante

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Biologia ~

Clasificado en Biologia ~

Comments (1)

Comments (1)

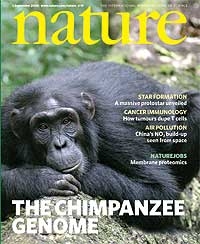

“El primer estudio del genoma completo del chimpancé y su comparación con el humano representan un tesoro de información sobre la biología humana y los mecanismos de la evolución, aseguraron ayer los científicos del Consorcio Internacional para el Genoma del Chimpancé al presentar el trabajo que hoy publica la revista Nature. Esta investigación concluye que los chimpancés y los humanos tienen en común casi el 99% de la secuencia básica del ADN. Trabajos anteriores han fijado en seis millones de años el tiempo que llevan evolucionando por separado chimpancés y homínidos (el único superviviente de los últimos es el Homo sapiens actual).”

“Podemos explicar las similitudes entre humanos y chimpances atribuyéndolas a su descendencia de un antepasado común que poseía las distintas características que los dos grupos comparten”

Así nos lo dice Andrew H. Knoll en su maravilloso libro La vida en un planeta joven, del cual, dejamos a continuación algunas impresiones.

El registro fósil de la ascendencia humana es notablemente incompleto, pero los restos de esqueletos hallados en África y Asia confirman esta predicción. Los humanos no descienden de los chimpancés, divergieron a partir de un antepasado común que no era ni Homo ni Pan.

Puesto que somos grandes animales, se nos puede perdonar que tengamos una visión del mundo que tiende a celebrar lo nuestro, pero en realidad, esa perspectiva es errónea. Somos nosotros quienes hemos evolucionado para encajar en el mundo microbiano, y no al revés. Que esto sea así se debe, en parte4 a una cuestión histórica, pero también tiene una explicación en términos de diversidad y funcionamiento del ecosistema. Si los animales son la guinda de la evolución, las bacterias son el pastel.

¿Cómo está constituido el reino protista?

Está constituido por los organismos eucarióticos unicelulares, con excepción de unos pocos que presentan una estructura multicelular bastante simple. El hecho de ser unicelulares no significa que sean seres simples y sencillos; en realidad, la célula que los constituye es , quizás una de las mas complejas, con una gran variedad de estructuras altamente especializadas.

- ¿Cómo se explica la presencia de cloroplastos y mitocondrias en los eucariotas?

Se debe a que estas células provienen de bacterias especializadas: 1) las mitocondrias contienen su propio ADN bacterial 2) tanto las mitocondrias como las bacterias presentan las mismas enzimas en las membranas celulares 3) los ribosomas de las mitocondrias se parecen en tamaño y composición química ; y 4) las mitocondrias solo se reproducen a través de otras mitocondrias, por división dentro de la célula huésped.

Las plantas, los animales, los hongos, las algas y los protozoos son todos organismos eucariotas, genealógicamente vinculados por un modo de organización celular en el que el material genético aparece encerrado en el interior de una estructura membranosa llamada núcleo (arriba en la imagen se aprecia).

Las bacterias y otros procariotas son distintos: sus células carecen de núcleo. Por lo que respecta a su importancia biológica, los eucariotas parecen jugar con con una clara ventaja: los organismos eucariotas se presentan en una gran diversidad y variedad de tamaños y formas que van desde los escorpiones, los elefantes y las setas hasta los geranios, las laminarias y las amebas. Los procariotas, en cambio, son en su mayoría diminutas esferas, cilindros o espirales. Algunas bacterias forman filamentos sencillos de células unidas por sus extremos, pero son muy pocas las que llegan a construir estructuras multicelulares más complejas.

Todos eucariotas

El tamaño y la forma sin duda dan ventaja a los eucariotas, pero la morfología es sólo uno de los criterios posibles para medir la importancia ecológica. El metabolismo -el modo como un organismo obteiene materia y energía- es otro criterio, y de acuerdo con este son los procariotas los que destacan por su diversidad.

En la actualidad se acepta que los procariotas fueron los precursores de los organismos eucariotas. Sin embargo hay grandes diferencias entre esos dos grupos celulares. Una de esas diferencias reside en la organización génica y en los mecanismos de sintetizar el ARN mensajero. Un trabajo publicado esta semana en PLoS Biology afirma que los eucariotas podrían proceder de cianobacterias termófilas ya que su organización génica recuerda rudimentariamente a la de los eucariotas.

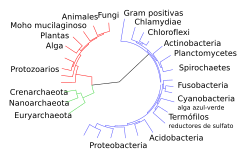

El árbol filogenético

Todos los seres vivos comparten su origen: todos provienen del reino móneras. Este reino abarca los seres unicelulares procariotas, que carecen de núcleo celular. Son las arqueobacterias y las eubacterias.

De los móneras surgieron los protoctistas. Este reino reúne seres eucariotas unicelulares heterótrofos y con digestión interna (protozoos), y eucariotas unicelulares o pluricelulares sin tejidos, autótrofos fotosintéticos (algas).

Los organism os eucariotas básicamente viven de alguno de los tres modos siguientes:

Algunos organismos, incluidos nosotros mismos, somos heterótrofos, es decir, obtenemos tanto el carbono como la energía que necesitamos para el crecimiento de ingerir moléculas orgánicas producidas por otros organismos. Para obtener ener´gia nuestras células utilizan oxígeno para descomponer azúcares en dióxido de carbono y agua mediante el proceso denominado respiración aeróbica (es decir, que utiliza oxígeno). En caso de necesidad, podemos conseguir un poco de energía por medio de un segundo tipo de metabolismo llamado fermentación, un proceso anaeróbico (sin oxígeno) por el que una molécula orgánica se desompone en dos (sólo las levaduras y unos pocos eucariotas más viven fundamentalmente con este metabolismo).

La química de la fotosíntesis  Una de las más importantes reacciones químicas que se producen en la naturaleza es la fotosíntesis. Por medio de este proceso, las plantas absorben la energía del Sol utilizándola para convertir el agua y el dióxido de carbono en su alimento y también en oxígeno, es decir, en compuestos orgánicos reducidos.

Una de las más importantes reacciones químicas que se producen en la naturaleza es la fotosíntesis. Por medio de este proceso, las plantas absorben la energía del Sol utilizándola para convertir el agua y el dióxido de carbono en su alimento y también en oxígeno, es decir, en compuestos orgánicos reducidos.

Para esto, es necesaria la participación de la clorofila, contenida en los cloroplastos de las células vegetales. La fotosíntesis se lleva a cabo en dos etapas, llamadas luminosa y oscura.

Donde más intensamente se desarrolla esta reacción química es en las hojas de las plantas verdes. Y el oxígeno que se libera es aprovechado por nosotros para respirar. De hecho, sin plantas y sin este proceso químico, simplemente nosotros tampoco existiríamos.

El tercer tipo principal de metabolismo energético que se encuentra en los eucariotas es la fotosíntesis que realizan las plantas y las algas: la clorofila y otros pigmentos asociados captan la energía del Sol, y esta permite a las plantas fijar dióxido de carbono en forma de materia orgánica. Para convertir la luz en energía bioquímica las plantas necesitan un electrón, que proporciona el agua, y en el proceso se libera oxígeno como producto secundario.

Exponer aquí y ahora la diversidad metabólica de los microorganismos procariotas, sería un aspecto clave para entender y explorar la historia de la vida primigenia y, son tan numerosas las formas de metabolismo que utilizan los procariotas para vivir que, me resulta imposible, exponer tanta diversidad en nun trabajo de tan reducido tamaño.

De gran diversidad, los procariotas sustentan un metabolismo extraordinariamente complejo, en algunos casos exclusivo de ciertos taxa, como algunos grupos de bacterias, lo que incide en su versatilidad ecológica.Los procariotas se clasifican, según Carl Woese, en arqueas y bacterias.

Al igual que los eucariotas, muchas bacterias respiran oxígeno. Pero otras bacterias utilizan nitrato disuelto y otras iones de sulfato u óxidos metálicos de hierro o manganeso. Unos pocos procariotas suelen incluso utilizar CO2, que hacen reaccionar con ácido acético en un proceso que genera gas natural, que es el gas metano (CH4) como el detectado en el Planeta Marte por la NASA. Los organismos procariotas han desarrollado, además, toda suerte de reacciones de fermentación.

Las bacterias también exhiben variaciones sobre el tema de la fotosíntesis. Las cianobacterias, un grupo de bacterias fotosintéticas teñidas de color verde azulado por la clorofila y otros pigmentos, captan la luz del Sol y fijan C2 de forma muy parecida a como lo hacen las algas y plantas terrestres eucariotas. Sin embargo, cuando en el medio hay sulfuro de hidrógeno (H2S, bien conocido por su característico olor a “huevos podridos”), muchas cianobacterias utilizan este gas en lugar de agua para obtener los electrones que requiere la fotosíntesis. Como producto secundario se forman entonces azufre y sulfato, no oxígeno.

Las variaciones bacterianas sobre temas metabólicos de la respiración, la fermentación y la fotosíntesis son, pues, impresionantes, pero los organismos procarióticos han desarrollado todavía otro modo de crecer que es completamente desconocido en los eucariotas: la quimiosíntesis.

Bacterias según su forma

Muchos son los modos metabólicos que me he tenido que dejar por detrás por impedirmelo el tiempo del que dispongo ahora para poner aquí este trabajo, sin embargo, una caso queda clara, estos minñusculos “seres vivos” pueden vivir en “cualquier medio” nada les impide adaptarse y asumir una forma metabólica que les venga bien para subsistir, y, siendo así (que lo es), ¿cómo podemos dudar de que en Marte y en otros planetas o lunas del espacio exterior esté presente la vida?

Todos estos “personajes”, a pesar de sus minúsculas estructuras, son, en realidad, los responsables del ecosistema planetario, sin ellos, amigos míos, no podríamos estar aquí. Las condiciones de las que podemos gozar estan generadas por ellos y, sin embargo, somos nosotros los que nos damos toda la importancia.

¡Vivir para ver!

emilio silvera

Oct

13

Nuestras Mentes, como el Universo, también se expanden

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (5)

Comments (5)

Ya me gustaría contemplar, como contemplo la de arriba, a nuestra Galaxia, La Vía Láctea

Sólo en nuestra Galaxia existen más de 100.000 millones de estrellas. El Universo está poblado por cientos de miles de millones de Galaxias cuyo promedio es de 100 mil millones de estrellas cada una. En cada galaxia existen miles de miles de millones de soles con sus planetas, lo que supone una cantidad enorme de mundos. ¿Podemos pensar que de entre cientos y cientos de miles de millones de planetas, solo la Tierra alberga la vida inteligente? Parece algo pretencioso, ¿no te parece?

¿Qué clase de vida reinará en la Tierra dentro de 10.000 años?

Si nos asomamos al pasado y al presente, veremos que múltiples formas de vida han poblado el planeta. Ahora, solo el 1 por 100 de todas las especies que vivieron en nuestro planeta existen y, son millones las que disfrutan de este planeta con nosotros ¿cuántos miles de millones habrán desaparecido? El registro fósil no puede facilitarnos la respuesta a esa pregunta.

El Universo está lleno de vida que se aparece en mil formas diferentes, unas inteligentes y otras vegetativas, de distintas morfologías e incluso distintas en sus componentes básicos que, a diferencia de la nuestra, basada en el carbono, aquellas podrán tener u origen vital en el silicio o vaya usted a saber de qué componentes podrían estar formadas y si han dado origen a civilizaciones inteligentes que ni podemos imaginar.

No tenemos que asombrarnos de nada, nosotros mismos, de seguro asombraríamos a una raza inteligente que nos pudiera observar y viera que la patente n° 6.754.472, ha sido concedida a Microsoft y ampara los mecanismos o procedimientos para “transmitir datos y energía utilizando el cuerpo humano”. Se trata, según aparece, de aprovechar la conductividad de la piel para conectar una serie de dispositivos electrónicos por todo el cuerpo.

EL MICROCHIP EN EL CUERPO HUMANO Por más prácticas que sean las tarjetas comunes al microchip pueden ser siempre robadas, perdidas o dañadas. Ahora los grandes financieros presentaron la última solución: ligar físicamente a la persona con su carta, de modo que no haya posibilidad alguna de perderla. El microchip no estará más inserto en una tarjeta plástica, sino implantado directamente en el cuerpo humano, bajo la piel, como se hace actualmente con los animales con fines identificatorios. Se puede así saber a cada momento dónde se encuentra el animal, gracias a los satélites y a las antenas celulares. Pero, si esto sigue así, ¿dónde queda nuestra supuesta libertad?

Además, muchos tratan de apagar esta llama de la libertad y del libre pensamiento. Hay que dejar transcurrir, dentro de una dinámica lógica del pensamiento que, las ideas fluyan y los proyectos se plasmen.

![[matrix.gif]](http://2.bp.blogspot.com/_S8PHWfTYANI/SWEUPu9ghVI/AAAAAAAAAcs/Jih9KxxyOQA/s1600/matrix.gif)

Con certeza no sabemos hasta dónde podremos llegar. Sin embargo, por el camino emprendido…da un poco de miedo pensarlo. Me viene a la mente una escena futurista en la cual, una raza avanzada, conecta un dispositivo metálico en la sien de un humano y, en una pantalla, aparecen las imágenes de sus recuerdos. Sí, pueden parecer exageraciones, pero a mí particularmente, me parecen escenas cotidianas de cualquier día del siglo XXIII.

Es increíble lo que puede desarrollar la mente humana y, sus logros, no parece que puedan tener barreras. En cada época aparece un científico que mejora los descubrimientos de sus antecesores, así ocurrió con Newton y Einstein, por ejemplo.

De momento, no sabemos despejar la incognita. Existe una gran interrogación cuando se hace la pregunta de ¿hasta donde podrá evolucionar nuestra mente? y, si esa es la pregunta, lLa respuesta es… ¡No lo sabemos!Pero demos un giro a nuestros pensamientos y recpordemos que…

El Lago de Como está en Lombardía en las provincias de Lecco y Como y a unos 199 metros sobre el nivel del mar. Mide 142 km2 y tiene 416 metros de profundidad, lo que lo hace uno de los lagos mas profundos de Europa y el tercer lago mas grande de Italia.

En el año 1.927, en un Congreso de Física celebrado en Como (Lago de Italia, provincia de Como, en Lombardía, al pie de los Alpes, atravesado por el río Adda y rodeado por colinas cubiertas de bosques que lo hacen muy pintoresco), Niels Bohr habló por primera vez del “Principio de complementariedad”, una idea que tuvo fortuna científica y fortuna literaria. Esta mezcla suele poner de los nervios a los científicos, que consideran escandaloso, y con razón, que se usen conceptos científicos fuera de su contexto. Todos hemos visto aplicar las ideas de relatividad, caos, fractales, indeterminación, singularidad (que no tienen sentido fuera de su expresión matemática) para hablar de todo lo divino y lo humano.

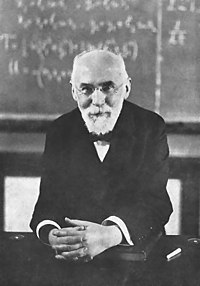

Lorentz en 1927

En su enunciado Bohr dijo que quería resolver las diferencias insalvables que había entre la descripción clásica de los fenómenos físicos y la descripción cuántica. La diferencia fundamental (dicho en plan coloquial) era que la Física clásica creía en la realidad de los fenómenos, mientras que la cuántica pensaba que el estado del sistema depende del observador. Puso como ejemplo la naturaleza de la luz.

¿ Es una onda o una partícula ? Son las dos cosas, siempre dependiedo del momento y del cómo la observemos.

Para explicar los fenómenos de interferencia hay que considerarla onda, pero para explicar la interacción entre radiación y materia, conviene considerarla corpúsculo. Bohn propuso su “Principio de complementariedad”. El fenómeno depende del sistema de observación y, en último término, la realidad no sería más que el resultado de todos los sistemas posibles de observación.

Muchos años después, Richar Feynman, con su contundencia habitual dijo: “La dualidad de la luz es el único misterio de la Física”. Bueno, añadió otra cosa: “La teoría cuántica está simplemente más allá de cualquier explicación”.

A partir del Congreso de Como, todos los físicos (menos Einstein) se hicieron Kartianos. Recordad que Kant había separado la “cosa en sí” de las cosas tal y como aparecen en nuestro conocimiento, es decir, de los fenómenos. Nosotros sólo podemos conocer los fenómenos, nunca las cosas tal como son en realidad. Esto ha suscitado muchas disputas entre los físicos, que no saben si la realidad sometida al Principio de complementariedad es la última realidad, o hay otra más real por debajo, escondida allí donde no podemos verla. Es interesante seguir el proceso de invención de ese Principio, porque demuestra una vez más que un científico no llega a una teoría por un procedimiento racional, sino por una especie de golpe – intuición que salta en su cerebro y le sugiere la solución ¿ Saltará en mi cabeza por fin el secreto de las fluctuaciones de vacío en esa dichosa quinta dimensión, donde está escondida -si realmente existe- la “materia oscura” ?

Se ha dicho que el Amor es instinto y cultura pero, también es locura y desenfreno, es ver lo que no hay y obviar lo que está a la vista, es como entrar en otro mundo sin salir de este nuestro y, el enamorado, está dotado de un “algo espacial” que puede ver en su amada, cosas que nadie puede…¡El Amor!, o, ¿El motor del mundo?

Jerome Bruner, un avispado psicólogo del pasado siglo, contó una conversación que había mantenido con Bohr acerca de la complementariedad del pensamiento y la emoción. El físico le confesó que su Principio se le había ocurrido meditando sobre si debía castigar o no a su hijo que había hecho una trastada. “Me di cuenta de que no se puede juzgar al mismo tiempo a la luz del amor y a la luz de la justicia”. En fin, había caído en el mismo problema en que se habían enfrascado los teólogos medievales al preguntarse si Dios podía ser a la vez justiciero y misericordioso. Simplemente, a Bohr le ocurrió como a tantos otros que, cuando el problema les toca de cerca, la objetividad se evapora, el sentido de la justicia decrece y, deja de tener la capacidad de decidir. Lo que nos pasa a todos.

¡Valiente personaje! Muchas veces el querer destacar hace que se pierdan…valores

¡Valiente personaje! el tal Shabriar S. Afshar, quiere mandar a Einstein al rincón de los castigados y eliminar al fotón. algunos no tienen límite a la hora de conquistar un poco de notoriedad. Ahí está el hombre ante su ordenador y los micrófonos para decir sus…¿tonterías? Bueno quería decir sus teorías.

Todo esto viene a cuento porque cuando escribí esto, acababa de leer un artículo sobre un tal Shabriar S. Afshar y sus experimentos en el Institute for Radiation Induce Studies (Boston). Este señor, cree haber encontrado, o mejor, dice haber demostrado que Borh estaba equivocado. Dicho más técnicamente, se puede seguir el rastro de un fotón sin alterar el patrón de interferencias. Considera que la realidad tiene propiedades definidas y evaluables.

Pero da un paso más. Entre el fotón y la onda, escoge la onda. Más aún, piensa que si el resultado de sus experimentos se repite usando otras partículas, es la mecánica cuántica entera la que está en dificultades. Y ya en el disparadero, obtiene una última consecuencia. Si el fotón no existe, habría que retirarle a Einstein el Premio Nobel que ganó en 1.921.

Desde luego algunos no se paran en barra a la hora de ganar notoriedad, y, además, siempre encuentran una cohorte de acólitos que están dispuestos a seguirles. Llama la atención el editorial que ha publicado “New Scientist”. Reconociendo que los experimentos de Afshar tienen que ser corroborados, sin embargo, aplaude fervorosamente su intento. “La ortodoxia cuántica ha sido aceptada durante demasiado tiempo sin cuestionar su autoridad. Afshar, continúa, sigue el mejor camino de la tradición científica: explorar los misterios, no oscurecerlos.

Es increíble la cancha que le dan al tal Afshar, me gustaría saber qué dicen los físicos al respecto. Claro que, los medios, siempre que el asunto (¡”la noticia”!) sea escandalosa y polémica…están encantados para ganar audicencia.

¿ Tendremos que cantar el réquiem por el fotón? ¡No! Eso iría en contra de la realidad física del mundo en el que vivímos. Gracias al cuanto de luz que llamamos fotón, podemos ver todo lo que nos rodea. Sería un auténtico contratiempo, yo estoy encariñado con él. Está claro que es la condición humana, siempre estaremos dispuestos para hacerles la puñeta a los otros. ¡ Mira que pretender quitarle a Einstein el Nobel ! ¡ Sí, el que le dieron por su trabajo del Efecto Fotoelectrico ! Hay veces en las que está bien tomarse las cosas desde el punto de vista más distendido y coloquial, no siempre podemos estar tan serios.

La ironía es otro de los aspectos inteligentes de nuestra mente, es una vía de escape para evitar tensiones innecesarias.

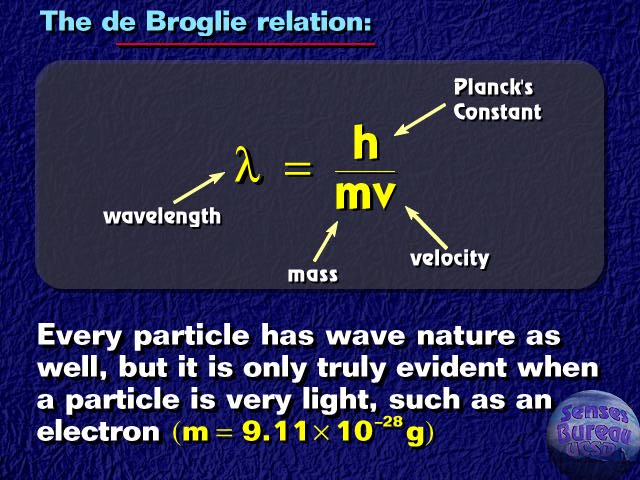

Son tantas las pruebas y los exámenes que ha pasado con éxito la Mecánica Cuántica que, lo de ese tal Afshar, me parece una broma. El cuanto de energía de Planck como punto de partida, desarrolló un sistema de teoría cuántica que se utilizó para explicar las propiedades de los átomos y moléculas, donde ese “cuanto” era el punto de partida. Se incorporó el principio de indeterminación de Heisemberg y la longitud de onda de De Broglie para establecer la dualidad onda-corpúsculo, en la cual está basada la ecuación de Schrödinger y su función de onda. Esta forma de mecánica cuántica se llama mecánica ondulatoria. Un formalismo alternativo, pero equivalente, es la mecánica matricial, basada en operadores matemáticos.

Así que, la ecuación de Einstein Sabiendo todo esto, y conociendo algo de las bases sobre las que opera la mecánica cuántica, la pretensión de ese tal Afsbar, me parece muy pretenciosa y algo ridícula, además de osada e impertinente ¿ No sabe que en boquita cerrada no entran moscas ? Que demuestre primero y hable después.

Em=hf-ø donde la energía cinética máxima está dada precisamente por esta ecuación, según el tal Afshar, es una falsa. ¡ Que tío !

Creo haberle dedicado más tiempo del necesario a este comentario, así que pasaremos a otra cosa.

El fotón, neutrino, electrón, protón, neutrón, muón, tau, kaón, sigma, omega, W y X, gluón, quarks, gravitón, etc, son nombres muy familiares y, cada uno de ellos nos trae una imagen o un recuerdo a nuestras mentes que, los asocia a aquello de o que forma parte en las diferentes familias de partículas y la función que cada una de ellas tiene encomendada en el universo infinitesimal de lo muy pequeño.

El fotón es el cuanto de luz, radiación electromagnética de una longitud de onda comprendida entre 380 y 780 mm, que produce percepción visual. Se define como el producto de visibilidad por el poder radiante, sinedo éste último la intensidad de propagación de la energía radiante.

El fotón, como partícula, con masa en reposo nula que corre el espacio vacío a 299.792.458 metros por segundo, puede ser considerado como una unidad de energía igual a hf, donde h es la constante de Planck y f es la frecuencia de la radiación en hertzios. Son necesarios para explicar el fenómeno fotoeléctrico y otros fenómenos que requieren que la luz tenga carácter de partícula.

Hay cosas que te hacen sonreir. La “Reflexología Celular por Estimulación Fotónica”, que se vende a 200€ la sesión, asegura un rápido exito en acabar con el tabaquismo, asegurando que aplica la física para conseguir desengancharse del tabaco. Sin embargo, analizando las bases de la supuesta revolución médica no encontramos más que pura charalatanería típica de cualquier remedio mágico.

No pocas veces se utiliza la física y sus términos para que, unos aprovechados, saquen partido aunque sea a base de “estafar” con falsos anuncios -que los medios no tendrían que admitir- a personas que están con problemas de todo tipo. Y, por ejemplo, el problema que arriba se menciona (tabaquismo), tiene una sóla solución quen está en nosotros mismos, es la mente la única medicina. La voluntad de no seguir fumando.

Fotoquímica y Fotografía

La luz está siempre presente en nuestras vidas (aunque sea de noche)

De la luz, nos podríamos estar hablando horas y horas, de sus propiedades en fotónica, fotoquímica, fotosfera y otros muchos ámbitos del saber humano con la luz relacionados, como por ejemplo, la claridad luminosa que irradian los cuerpos en combustión, ignición o incandescencia y miles de ejmplos más que nos llevan al convencimiento de que la luz, es muy importante en nuestras vidas. Entre otras cosas, hace posible que podamos ver los objetos sobre los que inciden los fotones para hacerlo posible.

Newton nos descubrió que la luz del Sol o luz blanca, era el producto de la mezcla de todos los componentes coloreados, hizo pasar un rayo de luz por un prisma y, la habitación donde hacía el experimento, sus paredes, se llenaron de luciérnagas luminosas de muchos colores, el arcoiris estaba allí, del rojo al violeta, descompuestos en mariposas luminosas.

Aunque el tema de la luz me fascina, n quiero repetirme, y, hace poco, en uno de mis últimos trabajos, traté ampliamente el tema. El estado natural (último) de la materia, no será sólido, líquido, gaseoso, plasma o materia oscura, el estado final de la materia, cuando pase por todas las fases y trascienda a un estado superior de conexión total con el Universo, será la LUZ. Ahí, dentro de los rayos luminosos, estarán gravados todos los recuerdos, toda la conciencia de la Humanidad que, para entonces, será otra cosa y, sonreirá al ver que un día muy lejano, discutían de Espacio – Tiempo, de Materia, de Vacío, de Energía, de………¿materia oscura?, de Masa…

Si hablamos de neutrinos, estaremos hablando de Leptones

Tenemos que tener en cuenta que la fuerza que lo liga al núcleo es enorme y no existe físicamente entre los materiales conocido, es una fuerza ATOMICA DE ATRACCIÓN ETRE CARGA ELÉCTRICAS POSITIVAS Y NEGATIVAS, es decir, entre el protón y el electrón. Sin la existencia del electrón, a pesar de su pequeñez es importantísimo, no podría existir…

El electrón es la partícula principal de la familia y está presente en todos los átomos en agrupamientos llamados capas electrónicas alrededor del núcleo. Tiene una masa en reposo (me) de numeración 9,1093897(54)X10-31 Kg y una carga negativa de 1,602 17733(49)x10-19 culombios. La antipartícula es el positrón que, en realidad, es copia exacta de todos sus parámetros, a excepción de la carga que es positiva.

La familia de Leptones esta formada por:

Electrón (e¯ ) muón ( μ ) tau ( τ) -todos tienen sus partículas contrarias como por ejemplo, el positrón para el electrón. y están acompañadas por sus respectivos neutrinos.

Neutrino electrónico (ν) Neutrino múonico (vμ) y canónico (vT)

Si el electrón se considerara como una carga puntual, su autoenergía es infinita y surgen dificultades de la ecuación de Lorentz-Dirac. Es posible dar al electrón un tamaño no nulo con un radio ro‘ llamado el radio clásico del electrón. El electrón es muy importante en nuestras vidas, es un componente insustituible de la materia y los átomos que son posibles gracias a sus capas electrónicas alrededor de los núcleos positivos que se ven, de esta forma equilibrados por la energía igual, negativa, de los electrones.

Los protones están entre las partículas más comunes. junto a los neutrones, quienes forman los núcleos de cada átomo que hay en el Universo. Pese a su cotidianidad, los protones aún representan un msiterio para los físicos nucleares, añade dice Randolf Pohl, investigador del Instituto Max Planck de Óptica Cuántica en Garching, Alemania, y autor del artículo de Nature. “No comprendemos gran parte de su estructura interna”, comenta.

Parece que los protones son un pequeño punto de carga positiva, pero al estudiarlos de cerca, resulta ser una partícula más compleja. Cada protón está formado de partículas fundamentales menores, llamados quarks, y esto hace que su carga esté aproximadamente extendida sobre un área esférica.

Los físicos pueden medir el tamaño de un protón observando cómo los electrones interactúan con un protón. Un único electrón orbitando un protón puede ocupar sólo ciertos niveles discretos de energía, los cuales se describen a través de las leyes de la mecánica cuántica. Algunos de esos niveles de energía dependen en parte del tamaño del protón, y desde la década de 1960, los físicos han realizado cientos de medidas del tamaño del protón con una asombrosa precisión. Las estimaciones más recientes, realizadas por Sick usando datos anteriores, colocan el radio del protón alrededor de los 0,8768 femtometros (1 fentómetro = 10-15 metros).”

Los átomos están formados por un núcleo que conforman los nucleones (protones y neutrones) que, a su vez, están formados por Quarks que son confinados por los Grluones, la partícula mediadorade la fuerza fuerte. Ese núcleo está ropdeado de electrones para el que átomo quede conformado y, su estabilidad está asegurada al tener los protones carga positiva que es igual en fuerza a la negativa de los electrones. Los átomos se enlazan formando moléculas y estas a su vez macromoléculas como la doble esperiral de ADN.

Los protones, como los neutrones, son de la familia de los Hadrones. El protón es una partícula (no elemental) que tiene carga positiva igual en magnitud a la del electrón y posee una masa de 1,672614×10-27 kg, que es 1836,12 veces la del electrón. El protón aparece en los núcleos atómicos, por eso, junto al neutrón, también son conocidos como nucleones.

La familia de los Hadrones es la clase de partícula subatómica que interaccionan fuertemente, e incluye protones, neutrones y piones. Los hadrones son o bien bariones, que se desintegran en protones y que se cree están formados por tres quarks, o mesones, que se desintegran en leptones o fotones o en pares de protones y que se cree que están formado por un quark y un antiquark.

La materia bariónica, es la que forman planetas, estrellas y Galaxias, y la pódennos ver por todas partes. Nosotros mismos estamos hechos de Bariones. La otra materia, esa que no podemos ver y que, nuestra ignorancia nos ha llevado a llamar oscura, esa, de momento no sabemos lo que es.

Las partículas conocidas como bosones: fotón, gluón,gravitón, partícula W+ W– y Z° son las que median en el transporte de las fuerzas fundamentales de la naturaleza. El Fotón, transporta el electromagnetismo, la luz. El Gluón, transporta la fuerza nuclear fuerte que se desarrolla en el núcleo del átomo. El Gravitón (aún por localizar), nos trae y nos lleva la Gravitación Universal, haciendo posible que nuestros pies estén bien asentados sobre la superficie del planeta. Y, por último, las partículas W y Z, responsables de la radiación natural y espontánea de algunos elementos como el Uranio.

El hombre no dejará de valerse de todos los medios a su alcance para desvelar los secretos de la Naturaleza

Este pequeño repaso a modo de recordatorio, es algo inevitable, si hablamos de materia, las partículas se nos cuelan y, como si tuvieran vida propia (que la tienen), nos obliga a hablar de ellas, lo que, por otra parte no esta mal. Como la única verdad del Universo es que todo es lo mismo, sino que, en cada momento, cada cosa ocupa su lugar exacto, resulta que, al final, se hable de lo que se hable, aunque sea de la conciencia y del ser, venimos a parar al mismo sitio: El Universo, la materia, la luz, el tiempo…….

Parece mentira como a veces, cuando estoy inmerso en mis más profundos pensamientos, y tengo una conexión directa con algo que instruyo superior, lo veo todo más claro, todo es más fácil. Haber si en uno de estos momentos puedo enganchar esas fluctuaciones de vacío en la 5ª dimensión. Me parece que debe estar cerca, ronda mi cabeza, me induce ideas nebulosas y se van corriendo a sumergirse en las neblinas de mi ignorancia.

¡ Ya veremos en que desemboca todo esto !

emilio silvera

Totales: 75.671.699

Totales: 75.671.699 Conectados: 31

Conectados: 31