Mar

10

La Física es la llave del futuro

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física... ¡Y mucho más! ~

Clasificado en Física... ¡Y mucho más! ~

Comments (1)

Comments (1)

Makoto Kobayashi (1944). Japón, que descubrió el origen de la ruptura de simetría que predice la existencia de, al menos tres familias de Quarks en la Naturaleza.

Toshihide Maskawa

Yoichiro Nambu, descubrió el mecanismo de riptura espontánea de la simetría

¿Por qué hay algo en vez de nada? ¿Por qué hay tantas partículas elementales diferentes? Los laureados con el Premio Nobel de Física de este año han presentado ideas teóricas que nos suministran una comprensión más profunda de lo que sucede en el interior de los bloques más pequeños que forman la materia.

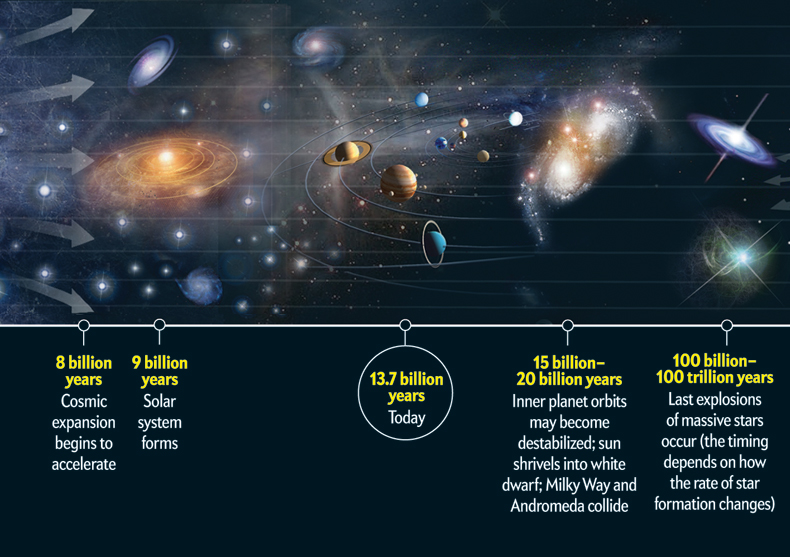

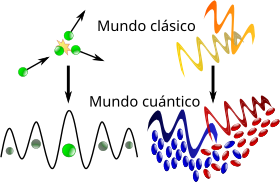

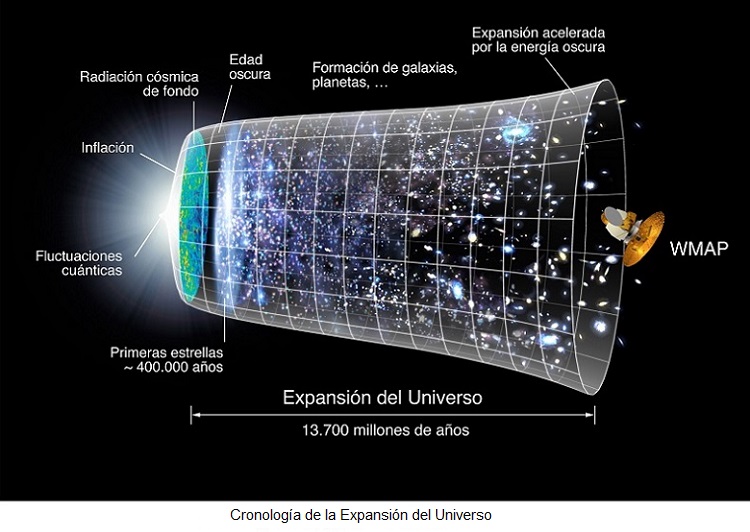

La naturaleza de las leyes de simetría se encuentran en el corazón de este asunto. O más bien, la ruptura de las simetrías, tanto las que parecen haber existido en nuestro universo desde el principio como aquellas que han perdido su simetría original en alguna parte del camino. De hecho, todos somos hijos de la simetría rota. Ello debió ocurrir inmediatamente después del Big Bang, hace unos 14.000 millones de años cuando fueron creadas la materia y la antimateria. El contacto de materia y antimateria es fatal para ambas, se aniquilan mutuamente y se transforman en radiación. Es evidente que la materia, al final, ganó la partida a la antimateria, de otra manera nosotros no estaríamos aquí. Pero estamos, y una pequeña desviación de la simetría perfecta parece que ha sido suficiente –un exceso de una partícula de materia por cada diez mil millones de partículas de antimateria fueron suficientes para hacer que nuestro mundo exista-. Este exceso de la materia fue la semilla de nuestro universo, lleno de galaxias, estrellas y planetas y, eventualmente, de vida. Pero lo que hay detrás de esta violación de la simetría en el cosmos es aún un gran misterio y un activo para seguir buscando lo que no sabemos.

La mayoría de los físicos piensa que el llamado mecanismo de Higgs es el responsable de que la simetría original entre fuerzas fuera destruido dando a las partículas sus masas en las primeras etapas del universo. El camino hacia ese descubrimiento fue trazado por Yoichiro Nambu quien, en 1960, fue el primero en introducir la violación espontánea de la simetría en la física de partículas. Es por este descubrimiento por el que se le concede el Premio Nobel de Física.

Tenemos algunos ejemplos banales de violación espontánea de la simetría en la vida diaria. Un lápiz en equilibrio sobre su punta lleva una existencia totalmente simétrica en la cual todas las direcciones son equivalentes. Pero esta simetría se pierde cuando cae -ahora sólo una dirección cuenta-. Por otro lado su condición es ahora más estable, el lápiz no puede volver a caer, ha llegado a su nivel más bajo de energía.

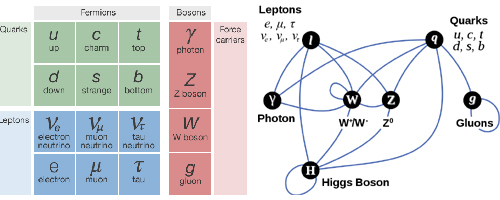

El modelo que tenenos de la física de partículas se llama Modelo Estándard y, nos habla de las interacciones entre partículas y las fuerzas o interraciones que están presentes, las leyes que rigen el Universo físico y que, no hemos podido completar al no poder incluir una de las fuerzas: La Gravedad. Claro que, no es esa la única carencia del Modelo, tiene algunas más y, a estas alturas, se va necesitando un nuevo Modelo, más completo y audaz, que incluya a todas las fuerzas y que no tengá parámetros aleatorios allí donde nuestros conocimientos no llegan.

La fealdad del Modelo Estándar puede contrastarse con la simplicidad de las ecuaciones de Einstein, en las que todo se deducía de primeros principios. Para comprender el contraste estético entre el Modelo Estándar y la teoría de la relatividad general de Einstein debemos comprender que, cuando los físicos hablan de “belleza” en sus teorías, realmente quieren decir que estas “bellas” teorías deben poseer al menos dos características esenciales:

- Una simetría unificadora.

- La capacidad de explicar grandes cantidades de datos experimentales con las expresiones matemáticas más económicas.

E = mc2 . Esta es la mejor prueba de lo que decimos arriba.

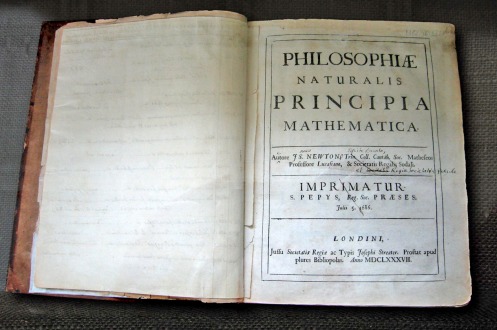

El Modelo Estándar falla en ambos aspectos, mientras que la relatividad general los exhibe, ambos, de manera bien patente. Nunca una teoría dijo tanto con tan poco; su sencillez es asombrosa y su profundidad increíble.De hecho, desde que se publicó en 1.915, no ha dejado de dar frutas, y aún no se han obtenido de ella todos los mensajes que contiene.

El principio director del modelo estándar dicta que sus ecuaciones son simétricas. De igual modo que una esfera ofrece el mismo aspecto desde cualquier punto de vista, las ecuaciones del modelo estándar subsisten sin variación al cambiar la perspectiva desde la que son definidas. Las ecuaciones permanecen invariables, además, cuando esta perspectiva se desplaza en distinta magnitud a diferentes puntos del espacio y el tiempo.

Al contrario de la relatividad general, la simetría del Modelo Estándar, está realmente formada empalmando tres simetrías más pequeñas, una por cada una de las fuerzas; el modelo es espeso e incómodo en su forma. Ciertamente no es económica en modo alguno. Por ejemplo, las ecuaciones de Einstein, escritas en su totalidad, sólo ocupan unos centímetros y ni siquiera llenaría una línea de esta página. A partir de esta escasa línea de ecuaciones, podemos ir más allá de las leyes de Newton y derivar la distorsión del espacio, el Big Bang y otros fenómenos astronómicos importantes como los agujeros negros. Por el contrario, sólo escribir el Modelo Estándar en su totalidad requeriría, siendo escueto, un par de páginas y parecería un galimatías de símbolos complejos sólo entendibles por expertos.

Los científicos quieren creer que la naturaleza prefiere la economía en sus creaciones y que siempre parece evitar redundancias innecesarias al crear estructuras físicas, biológicas y químicas.

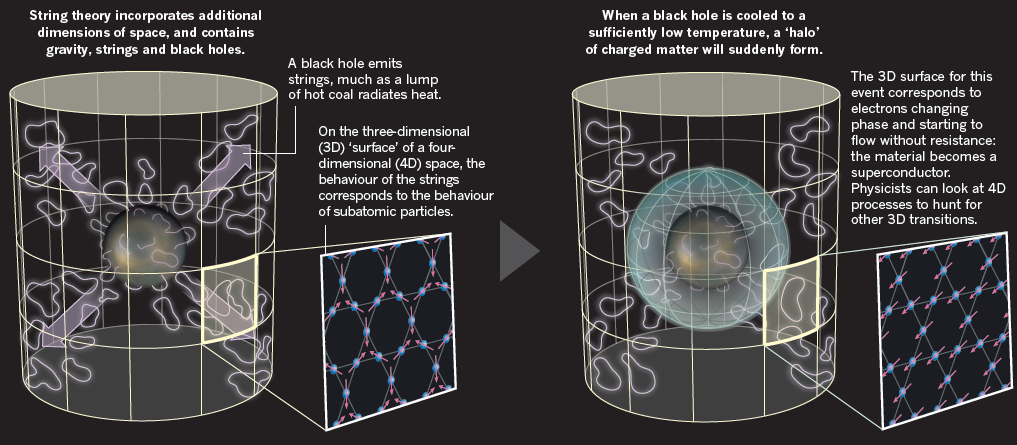

La luz antigua absorbida por átomos de hidrógeno neutro podría usarse para probar ciertas predicciones de la Teoría de Cuerdas, dicen los cosmólogos de la Universidad de Illinois. Realizar tales medidas, sin embargo, requeriría que se construyese un gigantesco conjunto de radio telescopios en la Tierra, el espacio, o la Luna.

El matemático francés Henri Poincaré lo expresó de forma aún más franca cuando escribió: “El científico no estudia la Naturaleza porque es útil; la estudia porque disfruta con ello, y disfruta con ello porque es bella”

E. Rutherford, quien descubrió el núcleo del átomo (entre otras muchas cosas), dijo una vez: “Toda ciencia es o física o coleccionar sello”.Se refería a la enorme importancia que tiene la física para la ciencia, aunque se le olvidó mencionar que la física está sostenida por las matemáticas que la explica.

Pero, a pesar de todos sus inconvenientes, el Modelo Estándar, desde su implantación, ha cosechado un éxito tras otro, con sus inconvenientes y sus diecinueve parámetros aleatorios, lo cierto es que es lo mejor que tenemos por el momento para explicar las familias de partículas que conforman la materia y cómo actúan las fuerzas de la naturaleza, todas las fuerzas menos la gravedad; esa nos la explica a la perfección y sin fisuras las ecuaciones de Einstein de la relatividad general.

Hace tiempo que los físicos tratan de mejorar el Modelo Estándar con otras teorías más avanzadas y modernas que puedan explicar la materia y el espacio-tiempo con mayor amplitud y, sobre todo, incluyendo la gravedad.Así que retomando la teoría de Kaluza de la quinta dimensión, se propuso la teoría de supergravedad en 1.976 por los físicos Daniel Freedman, Sergio Ferrara y Peter van Nieuwenhuizen, de la Universidad del Estado de Nueva York en Stoney Brook que desarrollaron esta nueva teoría en un espacio de once dimensiones.

Para desarrollar la superteoría de Kaluza-Klein en once dimensiones, uno tiene que incrementarenormemente las componentes del interior del Tensor métrico de Riemann (que Einstein utilizó en cuatro dimensiones, tres de espacio y una de tiempo para su relatividad general y más tarde, Kaluza, añadiendo otra dimensión de espacio, la llevó hasta la quinta dimensión haciendo así posible unir la teoría de Einstein de la gravedad, con la teoría de Maxwell del electromagnetismo), que ahora se convierte en el supertensor métrico de Riemann.

Hasta hoy, no se ha logrado, ni mucho menos, inventar una teoría de campo consistente totalmente unificadora que incluya la gravedad. Se han dado grandes pasos, pero las brechas «científicounificantes» siguen siendo amplias. El punto de partida ha sido siempre la teoría de la relatividad general y conceptos con ella relacionados, por la excelencia que manifiesta esa teoría para explicar la física gravitatoria macrocósmica. El problema que se presenta surge de la necesidad de modificar esta teoría sin perder por ello las predicciones ya probadas de la gravedad a gran escala y resolver al mismo tiempo los problemas de la gravedad cuántica en distancias cortas y de la unificación de la gravedad con las otras fuerzas de la naturaleza.

Su tensor métrico es un tensor de rango 2 que se utiliza para definir … Sin embargo, en otras teorías se ha elevado el rango y se pueden definir múltiples universos de dimensiones más altas.

El tensor métrico se podría adaptar a las necesidades de la búsqueda estableciendo la multiplicidad de dimensiones que la teoría exigía para su desarrollo.

Más allá de lo que nos permiten captar nuestros sentidos físicos, hay que tener nuestra mente abierta a la posibilidad de que puedan existir otras realidades diferentes a lo que nos dicta nuestra experiencia, realidades capaces de ser descubiertas por la fuerza del intelecto cuando nos atrevemos a cuestionar aquello que creíamos como absoluto.

Esta nueva teoría de supergravedad pretendía la unificación de todas las fuerzas conocidas con la materia, y, como en un rompecabezas, encajarlas en el Tensor de Riemann tan solo con elevar el número de dimensiones que exigía más componentes y nos daba el espacio necesario para poder ubicar en sus apartados correspondientes, todas las fuerzas fundamentales y también la materia, la que podía satisfacer, casi en su totalidad, el sueño de Einstein.

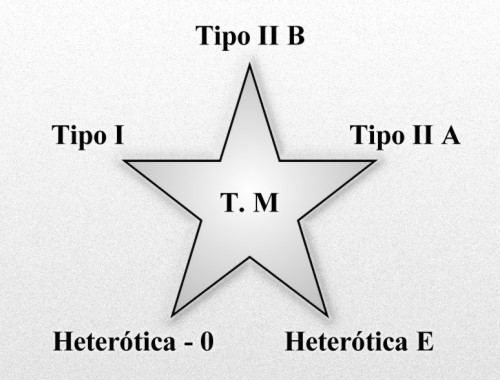

A partir de aquí, de estas ecuaciones, surgió todo. Este fue el puerto de donde salió el bajel de la teoría de Kaluza-Gleim, la supergravedad y supersimetría, la cuerda heterótica y la Teoría de cuerdas, todo ello, rematado con la finalmente expuesta, teoría M. También, con el nacimiento de esta ecuación que es la imagen que mejor refleja hasta dónde puede3 llegar el intelecto humano, comenzó la verdadera cosmología.

La supergravedad casi consigue satisfacer el sueño de Einstein de dar una derivación puramente geométrica de todas las fuerzas y partículas del universo. Al añadir la supersimetría al Tensor métrico de Riemann, la métrica se duplica en tamaño, dándonos la supersimetría de Riemann. Las nuevas componentes del súper tensor de Riemann corresponden a quarks y leptones, casi todas las partículas y fuerzas fundamentales de la naturaleza: la teoría de la gravedad de Einstein, los campos de Yang-Mills y de Maxwell y los quarks y leptones. Pero el hecho de que ciertas partículas no estén en esta imagen nos obliga a buscar un formalismo más potente:

La materia con todas las fuerzas fundamentales de la naturaleza. Los bosones intermediarios o partículas portadoras de las fuerzas como el fotón para el electromagnetismo, los gluones para la fuerza nuclear fuerte, las partículas W y Z para la nuclear débil y, en la partícula portadora de la gravedad, el gravitón, ponemos el signo de interrogación, ya que se sabe que esta ahí en algún sitio pero hasta la fecha no ha sido detectado.

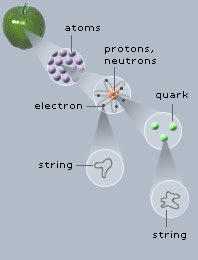

Antes de continuar con la teoría de súper cuerdas, o con su versión más avanzada la teoría M, parece conveniente recordar que hasta el momento los ladrillos del universo eran los quarks, las partículas más pequeñas detectadas en los aceleradores del CERN y FERMILAB. Pero ¿están hechos de cosas más pequeñas?, eso no lo sabemos. El Modelo Estándar, menos avanzado que las otras teorías, nos dice que los quarks son las partículas más pequeñas y forman protones y neutrones constituyendo la formación interna del átomo, el núcleo. En la actualidad, nuestros aceleradores de partículas no tienen capacidad para ahondar más allá de los quarks y averiguar si a su vez, éstos están formados por partículas aún más pequeñas.

No podemos saber (aún) que es lo que pueda haber (si es que lo hay) más allá de los Quarks, los constituyentes de la materia más pequeños conocidos hasta el momento actual. Sin embargo, no se descarta que puedan existir partículas más simples dentro de los Quarks que, al fin y al cabo, no serían tan elementales.

Por otro lado, los físicos están casi seguros de que los leptones no están compuestos de partículas más pequeñas. Sin embargo, esta sospecha no se tiene en el caso de los quarks; no se sabe qué puede haber detrás de ellos. Tan sólo se ha llegado a desconfinarlos junto con los gluones y por un breve periodo de tiempo de los protones y neutrones que los mantenían aprisionados, formando – en esos breves instantes – una materia plasmosa. No es raro oir dentro de la comunidad científica a los físicos teóricos hablando de prequarks.

Como antes hemos comentado de pasada, el Modelo Estándar agrupa las partículas en familias:

Claro, son muchos más. Además de los Bariones, también forman parte de la familia hadrónica los mesones y la lista de unos y otros es larga y cada individuo, como es natural, tiene sus propias características que lo hacen único.

| Hadrones: | Bariones: protón, neutrón , Lambda, omega, etc. |

| Mesones: pión, kaón, psí, etc. | |

| Quarks: | up, down, charmed, strange, top y botton |

| Leptones: | electrón, muón y tau (y sus neutrinos asociados), neutrino electrónico, muónico y tauónico |

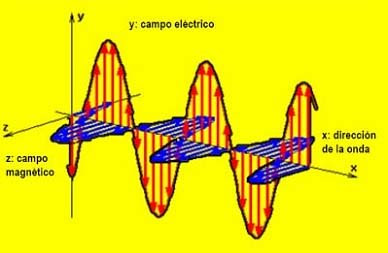

Y describe las interacciones que estas partículas tienen con las cuatro fuerzas fundamentales de la naturaleza, sobre todo con las nucleares fuerte y débil y la electromagnética; la gravedad se queda aparte del Modelo Estándar, ya que su incidencia con las partículas elementales es inapreciable como consecuencia de las infinitesimales masas de éstas, y ya sabemos que la gravedad se deja sentir y se hace presente cuando aparecen las grandes masas como planetas, estrellas y galaxias.

Grandes estructuras que vienen a ser como pequeños ”universos islas” en los que podemos estudiar, a menos tamaño, todo lo que en el Gran Universo puede pasar. Partiendo de la base de que las leyes del universo son las mismas en todas partes, podemos tomar cualquier región del mismo y ver que, allí está ocurriendo lo mismo que aquí ocurre, es decir, están presentes las fuerzas fundamentales: nucleares débiles y fuertes, electromagnetismo y Gravedad y, todo, absolutamente todo, funciona al ritmo que dichas leyes nos marcan.

Como el Modelo Estándar es limitado, los físicos buscan desesperadamente nuevas teorías que puedan corregir y perfeccionar este modelo. Así aparecieron las teorías de súper simetría, súper gravedad, súper cuerdas, y ahora por último, la teoría M propuesta por Edward Witten en 1.995 y que nos quiere explicar, de manera más perfecta, el universo desde su origen, cómo y por qué está conformado ese universo, las fuerzas que lo rigen, las constantes de la naturaleza que establecen las reglas, y todo ello, a partir de pequeños objetos infinitesimales, las cuerdas, que sustituyen a las partículas del modelo estándar que creíamos elementales.

Esas partículas súper simétricas que pronostican algunas teorías, aún no han sido observadas y se espera que en el LHC puedan aparecer algunas que, desde luego, si así ocurre, sería un buen adelanto para conocer el mundo que nos acoge y la Naturaleza del Universo.

Esta nueva teoría, permite además, unificar o incluir la gravedad con las otras fuerzas, como teoría cuántica de la gravedad, todo ello mediante una teoría estructurada y fundamentada con originalidad y compactificación de las cuatro fuerzas de la naturaleza y dejando un gran espacio matemático para eliminar anomalías o perturbaciones, y se propugna con coherencia quela cuerda es el elemento más básico de la estructura de la materia; lo que estaría bajo los quarks serían unas diminutos círculos semejantes a una membrana vibrante circular y de diferentes conformaciones.

Universos Paralelos, Teorías de Cuerdas, Súper gravedad, La Teoría M, y ¿Los pensamientos de la Mente, podrán dar para tanto?

Una vez se escucha sobre los fundamentos de la teoría cuántica uno no puede mas que sobrecogerse, ampliar la mente y galopar entre las múltiples posibilidades acerca de lo real e imaginario que por momentos y depende que conceptos se entrelazan intercambiables. Lo que llama la atención es que por mucho que hayan sido los físicos cuánticos más prestigiosos entre la sociedad científica los que hayan puesto sobre la mesa conceptos cuanto menos rimbombantes e inverosímiles como las multi-dimensiones, los universos paralelos, los efectos túneles y demás, sean los propios miembros de la academia los que grandilocuentemente se ofenden cuando se hace alusión al paralelismo evidente del comportamiento y extensión de la energía en referencia al universo preconizado por los místicos de muchas culturas. No tenemos los conocimientos necesarios para poder decir que no a esto o aquello, cada cosa tiene su lugar y tendremos que analizarlas muy a fondo y adentrarnos en esos mundos de misterio para poder decidir lo que es y lo que no puede ser.

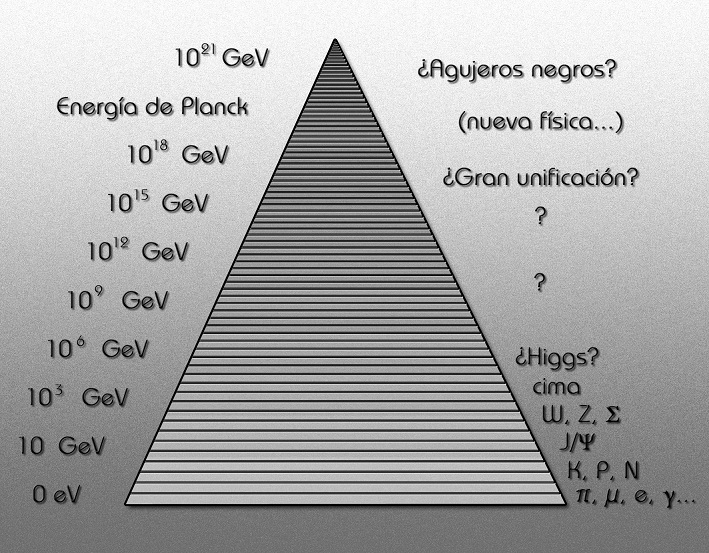

Aquí hemos llegado a una región de la Física de las partículas donde la energía (por partícula) es mucho mayor de la que actualmente podemos estudiar en nuestros laboratorios. Claro que especulamos, pero con los datos de los que disponemos, la realidad estará muy cerca de la expuesta en el gráfico, y, en él se señalan energía que no están a nuestro alcance para conseguir lo que se quiere saber.

Ed Witten, en su trabajo, presentó amplias evidencias matemáticas de que las cinco teorías obtenidas de la primera revolución, junto con la más reciente conocida como la súper gravedad (súper cuerda después), en 11 dimensiones, eran de hecho parte de una teoría inherentemente cuántica y no perturbativa conocida como teoría M. Las seis teorías están conectadas entre sí por una serie de simetrías de dualidad T, S, y U. Además, de la teoría propuesta por Witten se encuentran implícitas muchas evidencias de que la teoría M no es sólo la suma de las partes, sino que se vislumbra un alentador horizonte que podría concluir como la teoría definitiva tan largamente buscada.

Los resultados de la segunda revolución de las súper cuerdas han demostrado que las cinco teorías de cuerdas forman parte de un solo marco unificado, llamado Teoría M.

Las súper cuerdas, en realidad, sólo es otra manera utilizada por los científicos a la búsqueda de la verdad que la Humanidad necesita y reclama para continuar con su propia evolución que, sin esos conocimientos, quedaría estancada.

Como se puede ver, las partículas implicadas en el Modelo Estándar están en un mundo microscópico de 10-17cm que sí dominan nuestros aceleradores, mientras que la cuerda está en una distancia de 10-33 cm que les está prohibida, allí no podemos llegar, no disponemos de la energía suficiente para ello.

Igual que con la energía disponible por el momento, nos pasa con las distancias, que también nos tiene paralizados en nuestros deseos de visitar mundos lejanos, no podemos, al no disponer de los medios necesarios para poder soslayar las distancias de tantos años-luz como tendríamos que recorrer. ¿Habrá otro camino?

Está muy claro para los físicos que, aunque teóricamente, en la Teoría de Súper cuerdas se pueden unir todas las fuerzas, todavía tenemos que seguir sosteniendo que la gravedad resulta una fuerza solitaria para todos los efectos, ya que ha resistido todos los intentos para saber, con certeza, si finalmente se podrá unir a las otras fuerzas de la Naturaleza. La gravedad está descrita por la teoría de la relatividad general de Einstein y tiene una naturaleza esencialmente geométrica. Se entiende como la curvatura del espacio-tiempo alrededor de un objeto masivo. En los gráficos, generalmente, se representa como un objeto pesado sobre una superficie fina y tensa (una pelota o bola pesada de jugar a los bolos que dejamos encima de una sábana extendida tirando de las cuatro esquinas). El peso de la bola (materia) hundirá la sábana (espacio-tiempo) con mayor intensidad en la distancia más cercana a donde se encuentre masa.

El espacio tiempo se distorsiona allí donde residen objetos pesados como los planetas, las estrellas, galaxias y cualesquiera otros cuerpos masivos.

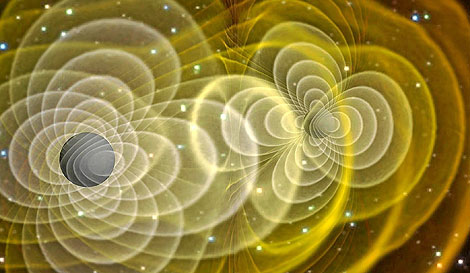

La teoría de Einstein goza de una amplia aceptación debido a los aciertos macroscópicos que han sido verificados de manera experimental. Los más recientes están referidos a los cambios de frecuencia de radiación en púlsares binarios debido a la emisión de ondas gravitacionales, que actualmente estudia Kip S. Thorne, en relación a los agujeros negros. Entre las predicciones que Einstein propugna en su teoría se encuentran, por ejemplo, la existencia de ondas gravitacionales, que el universo está en constante expansión y que, por lo tanto, tuvo un inicio: el Big Bang o los agujeros negros.

Se trata de regiones donde la gravedad es tan intensa que ni siquiera la luz puede escapar de su atracción. Estas regiones se forman por el colapso gravitatorio de estrellas masivas en la etapa final de su existencia como estrella, acabado el combustible nuclear y no pudiendo fusionar hidrógeno en helio, fusiona helio en carbono, después carbono en neón, más tarde neón en magnesio y así sucesivamente hasta llegar a elementos más complejos que no se fusionan, lo que produce la última resistencia de la estrella contra la fuerza de gravedad que trata de comprimirla, se degeneran los neutrones como último recurso hasta que, finalmente, la estrella explota en supernova lanzando al espacio las capaz exteriores de su material en un inmenso fogonazo de luz; el equilibrio queda roto, la fuerza de expansión que contrarrestaba a la fuerza de gravedad no existe, así que, sin nada que se oponga la enorme masa de la estrella supermasiva, se contrae bajo su propio peso, implosiona hacia el núcleo, se reduce más y más, su densidad aumenta hasta lo inimaginable, su fuerza gravitatoria crece y crece, hasta que se convierte en una singularidad, un lugar en el que dejan de existir el tiempo y el espacio.

Allí no queda nada, ha nacido un agujero negro y a su alrededor nace lo que se ha dado en llamar el Horizonte de Sucesos, que es una región del espacio, alrededor del agujero negro que una vez traspasada no se podrá regresar; cualquier objeto que pase esta línea mortal, será literalmente engullida por la singularidad del agujero negro. De hecho, el telescopio espacial Hubble, ha enviado imágenes captadas cerca de Sagitario X-1, en el centro de nuestra galaxia, donde reside un descomunal agujero negro que, en las fotos enviadas por el telescopio, aparece como atrapa la materia de una estrella cercana y se la engulle.

.Ondas gravitacionales que se forman a partir de los agujeros negros que, en su dinámica cotidiana y que, actualmente, estamos tratando de captar para saber de un njhuevo Universo que nos diría muchas cosas de las que ocurren a partir de fenómenos que sabemos existen pero, que hasta el momento no hemos podido “leer”.

Esta es la fuerza que se pretende unir a la Mecánica Cuántica en la teoría de supercuerdas, es decir, que Einstein con su relatividad general que nos describe el cosmos macroscópico, se pueda reunir con Max Planck y su cuanto infinitesimal del universo atómico, lo muy grande con lo muy pequeño.

La llamada gravedad cuántica trata de fundir en una sola las dos teorías físicas más soberbias con las que contamos, la relatividad general y la mecánica cuántica, que en el estado actual de nuestro conocimiento parecen incompatibles. Su estudio, ahora mismo, es en algunos aspectos análogo a la física de hace cien años, cuando se creía en los átomos, pero se ignaraban los detalles de su estructura.

Hasta el momento, Einstein se ha negado a esta reunión y parece que desea caminar solo. Las otras fuerzas están presentes en el Modelo Estándar, la gravedad no quiere estar en él, se resiste.

De hecho, cuando se ha tratadode unir la mecánica cuántica con la gravedad, aunque el planteamiento estaba muy bien formulado, el resultado siempre fue desalentador; las respuestas eran irreconocibles, sin sentido, como una explosión entre materia y antimateria, un desastre.

Sin embargo, es preciso destacar que las nuevas teorías de súper-simetría, súper-gravedad, súper-cuerdas o la versión mas avanzada de la teoría M de Ed Witten, tienen algo en común: todas parten de la idea expuesta en la teoría de Kaluza-Klein de la quinta dimensión que, en realidad, se limitaba a exponer la teoría de Einstein de la relatividad general añadiendo otra dimensión en la que se incluían las ecuaciones de Maxwell del electromagnetismo.

Hasta hoy no se ha logrado, ni mucho menos, inventar una teoría de campo que incluya la gravedad. Se han dado grandes pasos, pero la brecha “científicounificante” es aún muy grande. El punto de partida, la base, ha sido siempre la relatividad y conceptos en ella y con ella relacionados, por la excelencia que manifiesta esa teoría para explicar la física gravitatoria cósmica. El problema que se plantea surge de la necesidad de modificar esta teoría de Einstein sin perder por ello las predicciones ya probadas de la gravedad a gran escala y resolver al mismo tiempo el problema de la gravedad cuántica en distancias cortas y de la unificación de la gravedad con las otras fuerzas de la naturaleza. Desde la primera década del siglo XX se han realizado intentos que buscan la solución a este problema, y que han despertado gran interés.

Después de la explosión científica que supuso la teoría de la relatividad general de Einstein que asombró al mundo, surgieron a partir e inspiradas por ella, todas esas otras teorías que antes he mencionado desde la teoría Kaluza-Klein a la teoría M.

Esas complejas teorías cuánticas nos quieren acercar al misterio que encierra la materia: ¡el Espíritu de la Luz!

Es de enorme interés el postulado que dichas teorías expone. Es de una riqueza incalculable el grado de complejidad que se ha llegado a conseguir para desarrollar y formular matemáticamente estas nuevas teorías que, como la de Kaluza-Klein o la de supercuerdas (la una en cinco dimensiones y la otra en 10 ó 26 dimensiones) surgen de otra generalización de la relatividad general tetradimensional einsteniana que se plantea en cuatro dimensiones, tres espaciales y una temporal, y para formular las nuevas teorías se añaden más dimensiones de espacio que, aunque están enrolladas en una distancia de Planck, facilitan el espacio suficiente para incluir todas las fuerzas y todos los componentes de la materia, tratando de postularse como la Teoría de Todo.

Dimensiones enrolladas ¿En un espaciotiempo fractal? La Naturaleza sabe de eso

La Gran Teoría Unificada que todo lo explique es un largo sueño acariciado y buscado por muchos. El mismo Einstein se pasó los últimos treinta años de su vida buscando el Santo Grial de la teoría del todo en la física, unificadora de las fuerzas y de la materia. Desgraciadamente, en aquellos tiempos no se conocían elementos y datos descubiertos más tarde y, en tales condiciones, sin las herramientas necesarias, Einstein no podría alcanzar su sueño tan largamente buscado. Si aún viviera entre nosotros, seguro que disfrutaría con la teoría de súper-cuerdas o la teoría M, al ver como de ellas, sin que nadie las llame, surgen, como por encanto, sus ecuaciones de campo de la relatividad general.

La fuerza de la Naturaleza, en el universo primitivo del Big Bang, era una sola fuerza y el estado de la materia es hoy conocido como “plasma”; las enormes temperaturas que regían no permitía la existencia de protones o neutrones, todo era como una sopa de quarks. El universo era opaco y estaba presente una simetría unificadora.

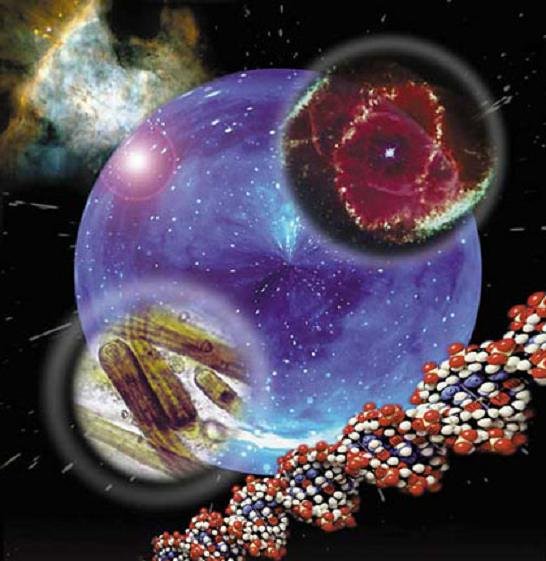

Más tarde, con la expansión, se produjo el enfriamiento gradual que finalmente produjo la rotura de la simetría reinante. Lo que era una sola fuerza se dividió en cuatro. El plasma, al perder la temperatura necesaria para conservar su estado, se trocó en quarks que formaron protones y neutrones que se unieron para formar núcleos. De la fuerza electromagnética, surgieron los electrones cargados negativamente y que, de inmediato, fueron atraídos por los protones de los núcleos, cargados positivamente; así surgieron los átomos que, a su vez, se juntaron para formar células y éstas para formar los elementos que hoy conocemos. Después se formaron las estrellas y las galaxias que sirvieron de fábrica para elementos más complejos surgidos de sus hornos nucleares hasta completar los 92 elementos naturales que conforma toda la materia conocida. Existen otros elementos que podríamos añadir a la Tabla, pero estos son artificiales como el plutonio o el einstenio.

La materia ha evolucionado hasta límites increíbles: ¡la vida! y, aún no sabemos, lo que más allá pueda esperar.

¿Quizás hablar sin palabras, o, Incluso algo más?

Estos conocimientos y otros muchos que hoy posee la ciencia es el fruto de mucho trabajo, de la curiosidad innata al ser humano, del talento de algunos y del ingenio de unos pocos, todo ello después de años y años de evolución pasando los descubrimientos obtenidos de generación en generación.

¿Cómo habría podido Einstein formular su teoría de la relatividad general sin haber encontrado el Tensor métrico del matemático alemán Riemann?

¿Qué formulación del electromagnetismo habría podido hacer James C. Maxwell sin el conocimiento de los experimentos de Faraday?

La relatividad especial de Einstein, ¿habría sido posible sin Maxwell y Lorentz?

¿Qué unidades habría expuesto Planck sin los números de Stoney?

En realidad… ¿Cómo comenzaría todo? Mientras encontramos la respuesta, observamos como el Universo se expande y se vuelve viejo y frío.

Así podríamos continuar indefinidamente, partiendo incluso, del átomo de Demócrito, hace ahora más de dos milenios. Todos los descubrimientos e inventos científicos están apoyados por ideas que surgen desde conocimientos anteriores que son ampliados por nuevas y más modernas formulaciones.

Precisamente, eso es lo que está ocurriendo ahora con la teoría M de las supercuerdas de Witten. Él se inspira en teorías anteriores que, a su vez, se derivan de la original de A. Einstein que pudo surgir, como he comentado, gracias al conocimiento que en geometría aportó Riemann con su tensor métrico.

emilio silvera

Mar

10

El colapso del núcleo de las estrellas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo asombroso ~

Clasificado en El Universo asombroso ~

Comments (0)

Comments (0)

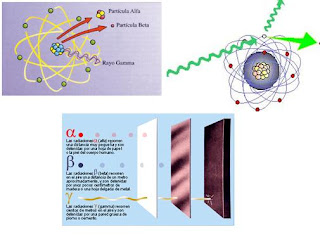

Átomos, sustancias, elementos, química…

Los electrones volantes constitutivos de esta última radiación son, individualmente, partículas beta. Así mismo, se descubrió que los rayos alfa estaban formados por partículas, que fueron llamadas partículas alfa. Como ya sabemos, alfa y beta son las primeras letras del alfabeto griego y se escriben con los gráficos α y β.

Hablemos del colapso en el Núcleo de las Estrellas.

En la imagen podemos contemplar lo que se clasifica NGC 3603, es un cúmulo abierto de estrellas en una vasta región estelar, rodeada de una región H II (una enorme nube de gas y plasma en el que constantemente están naciendo estrellas), situado en el brazo espiral Carina de la Vía Láctea, a unos 20.000 años-luz de distancia en la constelación de Carina. Es uno de los jóvenes cúmulos de estrellas más luminosas e impresionante en la Vía Láctea, y la concentración más densa de estrellas muy masivas conocidas en la galaxia. Se estima que se ha formado hace alrededor de un millón de años. Las estrellas azules calientes en el núcleo son responsables de la fuerte radiación ultravioleta y los vientos estelares, tallando una gran cavidad en el gas.

NGC 3603 alberga miles de estrellas de todo tipo : la mayoría tienen masas similares o menores a la de nuestro Sol, pero las más espectaculares son algunas de las estrellas muy masivas que están cerca del final de sus vidas. Ahí están presentes algunas estrellas supergigantes que se agolpan en un volumen de menos de un año luz cúbico, se han localizado en la misma zona a tres llamadas Wolf-Rayet, estrellas muy brillantes y masivas que expulsan grandes cantidades de material antes de convertirse en supernovas.

Una de estas estrellas (NGC 3603-A1), una estrella doble azul que orbita alrededor de la otra una vez cada 3,77 días, es la estrella más masiva conocida hasta en la Vía Láctea. La más masiva de estas dos estrellas tiene una masa estimada de 116 masas solares, mientras que su compañera tiene una masa de 89 masas solares.

Las estrellas supermasivas cuando colapsan forman extrañas y, a veces, fantásticas imágenes que podemos captar por nuestros más sofisticados telescopios. Hace veinte años, los astrónomos fueron testigos de uno de los más brillantes explosiones estelares en más de 400 años. La supernova titánica, llamada SN 1987A, ardió con la fuerza de 100 millones de soles varios meses después de su descubrimiento el 23 de febrero de 1987.

Las observaciones de SN 1987A, hechas en los últimos 20 por el Telescopio Espacial Hubble de NASA / ESA y muchos otros grandes telescopios terrestres y espaciales, han servido para cambiar la perspectiva que los astrónomos tenían de cómo las estrellas masivas terminan sus vidas.Estudiando estos sucesos sus comienzos se pueden ver los detalles más significativos del acontecimiento, cosa que, estuadinado los remanentes de supernovas muy antiguas no se podían ver.

Arriba podemos contemplar observaciones realizadas en distintas fechas que nos muestran la evolución de los anillos de SN 1987 A

El clúster abierto NGC 3603 contiene a Sher 25, una super gigante B1a que inevitablemente morirá en un masivo suceso supernova en los próximos 20,000 . ¡Esto emitirá una luz tan potente que competirá en el cielo con el planeta Venus! Un detalle muy emocionante es que Sher 25 presenta anillos similares a los que dejó la supernova SN 1987 A.

Cuando colapsa el núcleo de una estrella, ocurre en la formación de una estrella de neutrones, es preciso que la estrella esté evolucionada hasta el punto de que su núcleo esté compuesto completamente por hierro, que se niega a ser quemado en reacciones nucleares, no se puede producir la fusión y, por tanto, no produce la energía suficiente como soportar la inmensa fuerza de gravedad que propia masa de la estrella genera y que, solamente era frenada por la energía que produce la fusión nuclear que tiende a expandir la estrella, mientras que la gravedad tiende a contraerla.

El núcleo entonces se contrae, liberando energía potencial gravitatoria, se rompen los núcleos de los átomos de hierro en sus protones y sus neutrones constiituyentes. A medida que aumenta la densidad, los protones se combinan con los electrones para formar neutrones. El colapso sólo se detiene la presión de degeneración del gas de neutrones compensa el empuje hacia adentro de la Gravedad. El proceso completo hasta que se fija como la estrella de neutrones dura de un segundo.

Han sido muy variados los grupos de astrónomos investigadores que han realizado observaciones durante largos períodos de tiempo llevar a cabo la no fácil tarea de comprender cómo se forman las estrellas de neutrones y púlsares cuando estrellas masivas llegan al final de sus vidas y finalizan el proceso de la fusión nuclear, momento en el que -como explicaba antes- la estrella se contrae, implosiona sobre sí misma, se produce la explosión supernova y queda el remanente formado por material más complejo en forma de gases que han sido expulsados por la estrella en este proceso final en el que, las capas exteriores de la estrella, forman una nebulosa y la estrella en sí misma, al contraerse y hacerse más densa, es decir de 1017 kg/m3.

Se ha podido llegar a saber que las supernovas por colapso de núcleo suelen ocurrir en los brazos de galaxias espirales, así como también en las regiones HII, donde se concentran regiones de formación estelar. Una de las consecuencias de esto es que las estrellas, con masas a partir de 8 veces la masa del Sol, son las estrellas progenitoras de estos estos sucesos cósmicos. También es muy interesante y se está estudiando cómo se forman los inmensos campos magnéticos alreddor de estas estrellas de neutrones y púlsares que se conviertan en magnétares.

Cuando hace un año se descubrió la estrella de neutrones SGR0418, poco podían pensar los astrónomos que su funcionamiento alteraría todas las teorías existentes hasta ahora acerca del funcionamiento de los magnétares. Sin embargo es así, ya que funciona como uno de éstos y no como sería propio de su condicción. Este hallazgo, según la investigadora Nanda Rea del Instituto de Ciencias del Espacio, obliga a la ciencia a replantearse las teorías que se manejaban hasta ahora acerca del origen y evolución de los magnétares.

El “universo” de los procesos que siguen al colapso de los núcleos de las estrellas masivas es fascinante. Así, cuando se un púlsar que es una estrella de neutrones que gira sobre sí misma a una gran velocidad y tambien una fuente de ondas de radio que vibran con periodos regulares, este de estrellas tan extrañas son fruto -como antes decía- de una supernova o por consecuencías de la acreción de materia en estrellas enanas blancas en sistemas binarios. Una enana blanca que también es muy masiva, si tiene una estrella compañera cercana, genera mucha fuerza gravitatoria comienza a tirar del material de la estrella vecina y se lo queda hasta tal punto que, se transforma en una estrella de neutrones en una segunda etapa en la que se producen nuevos procesos de implosión.

La densidad de estas estrellas es increiblemente grande, tanto que un cubo de arena lleno del material de una estrella de neutrones tendría un peso parecido al de la montaña mas grande de la tierra, el monte . Los púlsares fueron descubiertos en 1970 y hasta solo se conece unas 300 estrellas de este tipo. Sin embargo, se calcula que sólo en nuestra Galaxia podrían ser un millón. La rápida rotación de los pùlsares los mantiene fuertemente magnetizados y sus rotaciones vertiginosas generan y son inmensas fuentes de electricidad. Llegan a producir mil millones de millones de voltios. Cuando nustros aparatos los observan y estudian detectan intensos haces de radiación en toda la gama del espectro (radio, luz, rayos X, Gamma).

Imagen de rayos-X en falso color de la región del cielo alrededor de SGR 1627-41 obtenida con XMM-Newton. La emisión indicada en rojo procede de los restos de una estrella masiva que estalló. Cubre una región más extendida de lo que se deducía anteriormente de las observaciones de radio, alrededor del SGR. Esto sugiere que la estrella que estalló fue el progenitor del magnetar. Crédito: ESA/XMM-Newton/EPIC (P. Esposito et al.)

Por ahora se conoce que de cada diez supernovas una se convierte en magnetar, si la supernova posee 6 y 12 masas solares, se convierte en una estrella de neutrones de no más de 10 a 20 km de diámetro. En el caso de las estrellas supermasivas de decenas de masas solares, el resultado es muy diferente y nos encontramos con los agujeros negros, esos monstruos del espacio devoradores de materia.

una estrella supermasiva muere, las consecuencias energéticas son inmensas. Ahí, en esa explosión se producen transiciones de fase que producen materiales pesados y complejos. En una supernova, en orden decreciente tenemos la secuencia de núcleos H, He, O, C, N, Fe, que coincide bastante bien con una ordenación en la tabla periódica de elementos.

La explosión de una estrella gigante y supermasiva hace que brille más que la propia galaxia que la acoge y, en su ese tránsito de estrella a púlsar o agujero negro, se forman elementos que, el oro o el platino, se riegan por el espacio interestelar en las inmensas nebulosas de las que, más tarde, naceran nuevas estrellas y nuevos mundos.

Pero está claro que todo el proceso estelar evolutivo inorgánico nos condujo el simple gas y polvo cósmico a la formación de estrellas y nebulosas solares hasta los planetas, la Tierra en particular, en cuyo medio ígneo describimos la formación de las estructuras de los silicatos, desplegándose con ello una enorme diversidad de composiciones, formas y colores, asistiéndose, por primera vez en la historia de la materia, a unas manifestaciones que contrastan con las que hemos mencionado en relación al proceso de las estrellas. Porque, en última instancia, debemos ser conscientes de un hecho cierto: En las estrellas se ¡ “fabrican los materiales que darán lugar al surgir de la vida”!.

El remanente estelar después de la explosiòn puede ser muy variado

Es posible que lo que nosotros llamamos materia inerte, no lo sea tanto, y, puede que incluso tenga memoria que transmite por medios que no sabemos reconocer. Esta clase de materia, se alía con el tiempo y, en momento adopta una forma predeterminada y de esa manera sigue evolucionando hasta llegar a su máximo ciclo o nivel en el que, de “materia inerte” llega a la categoría de “materia viva”, y, por el camino, ocupará siempre el lugar que le corresponda. No olvidemos de aquel sabio que nos dijo: “todas las cosas son”. El hombre, con aquellas sencillas palabras, elevó a todas las cosas a la categoría de ¡SER!

¿No os pensar que nosotros estemos hechos, precisamente, de lo que llamamos materia inerte?

Claro que, el mundo inorgánico es sólo una del inmenso mundo molecular. El resto lo constituye el mundo orgánico, que es el de las moléculas que contienen carbono y otros átomos y del que quedan excluidos, por convenio y características especiales, los carbonatos, bicarbonatos y carburos metálicos, los cuales se incluyen en el mundo inorgánico.

Según expliqué muchas veces, los quarks u y d se hallan en el seno de los nucleones (protones y neutrones) y, por tanto, en los núcleos atómicos. Hoy día, éstos se consideran una subclase de los hadrones. La composición de los núcleos (lo que en química se llama análisis cualitativo) es extraordinariamente sencilla, ya que como es sabido, constan de neutrones y protones que se pueden considerar como unidades que dentro del núcleo mantienen su identidad. Tal simplicidad cualitativa recuerda, por ejemplo, el caso de las series orgánicas, siendo la de los hidrocarburos saturados la más conocida. Recordad que su fórmula general es CnH2n+2, lo que significa que una molécula de hidrocarburo contiene n átomos de carbono (símbolo C) y (2n+2) átomos de hidrógeno (símbolo H).

Bueno, otra vez, como tantas veces me pasa, me desvío del camino que al principio del me propuse seguir y me pierdo en las elucubraciones que imaginan mis pensamientos. Mejor lo dejamos aquí.

emilio silvera

Mar

10

¿Cuerdas Cósmicas? Podría ser.

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo asombroso ~

Clasificado en El Universo asombroso ~

Comments (0)

Comments (0)

Podrían estar por todas partes y formar parte de todo

Aunque no todas si son muchas las Grandes Teorías Unificadas y teorías de supersimetría las que predicen la formación de cuerdas en la congelación del segundo 10-35 despues del comienzo del tiempo, cuando la fuerza fuerte se congeló y el universo se infló. Las cuerdas se deben considerar como un subproducto del proceso mismo de congelación. Es cierto que aunque las diversas teorías no predicen cuerdas idénticas, sí predicen cuerdas con las mismas propiedades generales. En primer lugar las cuerdas son extremadamente masivas y también extremadamente delgadas; la anchura de una cuerda es mucho menor que la anchura de un protón1. Las cuerdas no llevan carga eléctrica, así que no interaccionan con la radiación como las partículas ordinarias. Aparecen en todas las formas; largas lineas ondulantes, lazos vibrantes, espirales tridimensionales, etc. Sí, con esas propiedades podrían un candidato perfecto para la “materia oscura”. Ejercen una atracción gravitatoria, pero no pueden ser rotas por la presión de la radiación en los inicios del Universo.

El espesor estimado de una cuerda es de 10-30 centímetros, comparados con los 10-13 de un protón. Además de ser la más larga, y posiblemente la más vieja estructura del universo conocido, una cuerda cósmica sería también la más delgada: su diámetro sería 100.000.000.000.000.000 veces más pequeño que el de un protón.. Y cada cuerda sería terriblemente inquieta, algo así como un látigo agitándose por el espacio casi a la velocidad de la luz. Las curvas vibrarían como enloquecidas bandas de goma, emitiendo una corriente continua de ondas gravitacionales: rizos en la misma tela del espacio-tiempo. ¿Qué pasaría si una cuerda cósmica tropezara con un planeta? Al ser tan delgada, podría traspasarlo sin tropezar con un solo núcleo atómico. Pero de todos modos, su intenso campo gravitatorio causaría el caos.

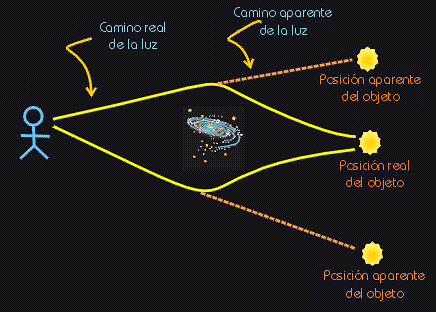

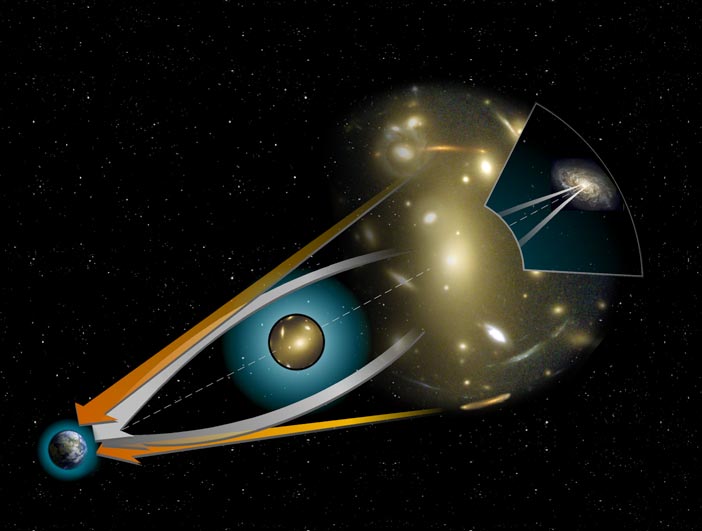

Simulación del efecto de lente generado por una cuerda cósmica. Crédito: PhysicsWorld.com

Por tanto, cuando observásemos un objeto con una cuerda cósmica en la trayectoria de nuestra mirada, deberíamos ver este objeto dos veces, con una separación entre ambas imágenes del orden del defecto de ángulo del cono generado por la curvatura del espaciotiempo. Esta doble imagen seríacaracterística de la presencia de una cuerda cósmica, pues otros cuerpos, como estrellas o agujeros negros, curvan el espaciotiempo de manera distinta, generando al menos cuatro imágenes deformadas. Por tanto, una observación de este fenómeno no podría dar lugar a un falso positivo.

En este sentido, el nombre de cuerda cósmica está justificado debido a que son impresionantemente pesadas, pasando a ser objetos macroscópicos aun cuando su efecto es pequeño. Una cuerda de seis kilómetros de longitud cuya separación entre ambas geodésicas es de apenas 4 segundos de arco tendría ¡la masa de la Tierra!. Evidentemente, cuerdas de este calibre no se espera que existan en la naturaleza, por lo que los defectos de ángulo esperados son aún menores y, por tanto, muy difíciles de medir.

Y esta es una de las razones de que todavía no se haya encontrado ninguna cuerda de este tipo. Si bien en los últimos años han surgido muchas imágenes candidatas a estar formadas por un efecto de lente de este tipo, la mayoría han resultado ser dos cuerpos distintos pero muy similares entre sí. Pese a ello, los astrofísicos y los teóricos de cuerdas no puerden la esperanza de encontrar en los próximos años, y gracias a telescopios cada vez más potentes, como el GTC; evidencias directas de la existencia de este tipo de cuerdas; evidencias que no sólo nos indicarían que las teorías de cuerdas van por buen camino, si no que el modelo del Big Bang es un modelo acertado.

Esquema del trazado de rayos para el efecto de lente gravitatoria de una cuerda cósmica

Las cuerdas cósmicas, desde el momento de su formación en el segundo 10-35, constituyen un entorno masivo, apelmazado, contra el que se desarrolla la evolución de las partículas, núcleos y átomos. Como no son afectadas por la presión de la radiación,como el plasma, pueden servir como núcleos de condensación -las semillas- para la formación de galaxias, cúmulos galácticos y supercúmulos, siempre que puedan sobrevivir lo necesario para hacerlo.

Neil Turok, titular de la cátedra de Física Matemática en el Departamento de Matemáticas Aplicadas y Física Teórica de la Universidad de Cambridge. Es coautor, con Paul Steinhardt, de Universo Infinito: Más allá del Big Bang. El principal portavoz de la idea de las cuerda cósmica es Niel Turok, un joven físico teórico que trabaja en el Imperial College de Londres y pasa muicho tiempo en EE UU haciendo un periplo por diversas Universidades. Ha hecho del desciframiento de la conducta de las cuerdas cósmicas el trabajo de su vida (al menos por el momento) y, se aplica en las complejas ecuaciones de la teoría de campos cuánticos que describen dichas cuerdas. Su enfoque es admirable por su integridad:

En lugar de seguir el camino normal desarrollando la conducta de las cuerdas y dejando a otros hallar el efecto que las cuerdas tienen sobre el problema de las galaxias, Turok y los jovenes que le rodean han decidido aprender cosmología. Dicha decisión no es frecuenta y por inusual, ha llamado la atención que se quieran especializar de manera específica en otro campo distinto al suyo para poder hacer y comprender mejor su trabajo. Y, otra curiosidad es que, el más duro crítico de las cuerdas cósmicas, P.J.E. Peebles, de Princeton, haya estado actuando como su tutor, lo cual, es tan significativo que se podría valorar como uno de los gestos más desinteresados y de alta calidad que en la Física se pueda haber producido.

Una de las virtudes de esta teoría es que puede “verse” por la observación. Aunque las cuerdas en sí son invisibles, sus efectos no tienen por qué serlo. La idea de las supercuerdas nació de la física de partículas, más que en el campo de la cosmología (a pesar del nombre, la cuerdas cósmicas no tienen nada que ver con la teoría de las “supercuerdas”, que mantiene que las partículas elementales tienen forma de cuerda). Surgió en la década de los sesenta cuando los físicos comenzaron a entrelazar las tres fuerzas no gravitacionales – electromagnetismo y fuerzas nucleares fuertes y débiles – en una teoría unificada.

En 1976, el concepto de las cuerdas se había hecho un poco más tangible, gracias a Tom Kibble. Kibble estudiaba las consecuencias cosmológicas de las grande teorías unificadas. Estaba particularmente interesado en las condiciones del 10^-35 segundo después del Big Bang, cuando las temperaturas en el cosmos embrionario bajaron más de billones de billones de grados. Ese fue el momento en que las fuerzas y las partículas se diferenciaron unas de otras.

El misterioso “universo” de los campos cuánticos que nadie sabe lo que puede esconde

A los cosmólogos les gusta visualizar esta revolucionaria transición como una especie de “cristalización”: el espacio, en un principio saturado de energía, cambió a la forma más vacía y más fría que rodea actualmente nuestro planeta. Pero la cristalización fue, probablemente, imperfecta. En el cosmos recién nacido podría haberse estropeado con defectos y grietas, a medida que se enfriaba rápidamente y se hinchaba.

Otras cuerdas están en La Teoría M de E. Witten que nos explica muy bien las implicaciones de las cuerdas en el contexto del Universo, y, ademas, lleva implícita la Gravedad Cuántica que tantos físicos buscan desde hace mucho tiempo para explicar cuestiones que hasta el momento carecen de ella. Sin embargo, estas son otras cuerdas que, implicadas en las profundidades de la materia, nos podría explicar otras muchas cosas a diferente nivel de lo que la cuerda cósmica pretende explicar.

Turok nos dice:

“Durante los últimos diez años he estado trabajando principalmente en la cuestión de cómo empezó el universo – o no comenzar. ¿Qué sucedió en el Big Bang? Para mí, esto parece ser una de las cuestiones más fundamentales de la ciencia, porque todo lo que sabemos, según todos los indicios, debe de haber salido de la Gran Explosión. Ya se trate de partículas o los planetas o las estrellas o, en última instancia, incluso la vida misma.”

En los últimos años, la búsqueda de las leyes fundamentales de la Naturaleza nos ha obligado a pensar en el Big Bang, mucho más profundamente. De acuerdo con nuestras más modernas y mejores teorías – la teoría de cuerdas y la teoría M – todos los detalles de las leyes de la física son en realidad determinada por la estructura del universo, en concreto, por la disposición de pequeñas enrollada dimensiones extra del espacio. Este es un cuadro muy hermoso: la física de partículas en sí es ahora más que otro aspecto de la cosmología. Pero si se quiere entender por qué las dimensiones extra están dispuestas como están, hay que entender el Big Bangporque ahí es de donde todo proviene.

De alguna manera, hasta hace muy poco, la física fundamental se había llevado bien sin realmente hacer frente a un gran problema que no dejaba juntarse a las dos teorías más influyentes e importantes que tenemos: La mecánica cuántica y la relatvidad. Los infinitos surgían y aquello era un sinsentido descomunal que nos hablaba de la incompatibilidad existente entre los muy pequeño y lo muy grande.

Sin embargo, en todo esto existe un sinsentido que debemos desvelar. ¿Si todo lo grande está hecho de cosas pequeñas, cómo pueden ser incompatibles? En la Teoría de Cuerdas no resultan así, y, la mecánica cuántica y la relatividad conviven en paz sin que aparezcan los indeseados infinitos. Es decir, en la Teoría de Cuerdas, subyace de manera automática, una teoría de la Gravedad Cuántica.

El mismo Einstein no interpretó todo esto como el principio de los tiempos y llegó a decir, bueno, mi teoría falla. La mayoría de las teorías fallan en algún régimen, y entonces ustedes necesita una teoría mejor, más moderno y adelantada. La teoría de Isaac Newton no falla cuando las partículas se muevan muy rápidas, sino que no logra describir eso y necesitó la relatividad. Del mismo modo, Einstein dijo:”… necesitamos una mejor teoría de la gravedad que la mía.”

Pero en la década de 1960, cuando la evidencia observacional para el Big Bang se hizo muy fuerte, los físicos de alguna manera llegaron a la conclusión de que todo lo que no sabemos debió gestarse al principio del tiempo, más allá del tiempo de Planck, esa fracción de segundo inaccesible. No estoy seguro de por qué llegaron a tal conclusión, pero tal vez se debió a Fred Hoyle –el principal impulsor de la teoría rival del Big Bang, la del estado estacionariorival– que parece haber ridiculizado con éxito la teoría del Big Bang, diciendo que no tenía sentido porque implicaba un principio de los tiempos y que sonaba absurdo.

A continuación, el Big Bang (parece que) fue confirmado por la observación, al menos todos lo dieron por bueno y, a partir de aquel momento, ese es, el Principio de Todo por el que nos estamos guiando: Allí comenzó el Tiempo y el Espacio y fue el inicio de la creación de todo lo que existe. Todo lo que vemos a nuestro alrededor se basa por completo en ese primer momento que llamamos Big Bang, y sin embargo, ese primer momento inicial (¡qué casualidad!), es el que nadie ha podido nunca describir.

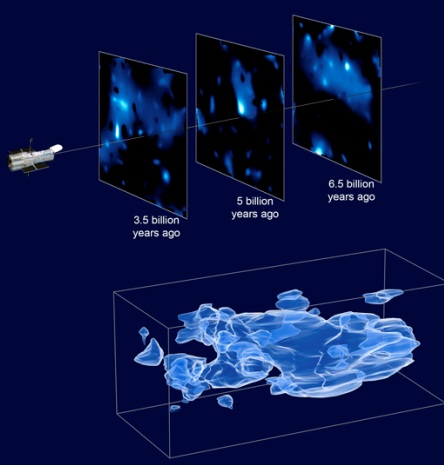

Alrededor de las cuerdas cósmicas se crearon las grandes estructuras

Para algunos, no parece que pueda caber la menor duda en el sentido de que, fueron las cuerdas cósmicas las que posibilitaron que se puedieran formar las grandes estructuras del universo surviendo de semilla o núcleo sobre el que se fueron adhiriendo inmensas porciones de materia que conformarían el objeto final. Es posible que las cuerdas cósmicas nos den una visión particularmente atractiva del universo y nos hace pensar en que, en el núcleo de cada galaxia hay una cuerda cósmica que, como el esqueleto de nuestros cuerpos, es la que la mantiene firme tal como la podemos contemplar y hace posible su existencia. Sin embargo, la teoría nos dice que las cuerdas cósmicas (como todo en el universo), tienen un tiempo de vida que una vez cumplido, desaparecen.

Poco a poco se va diluyendo en energía, se vuelve transparente y desaparece

Está claro que la cuerda cósmica tal y como la presenta la teoría, es todo energía. Cuando comienza a despedir ondas gravitatorias, el proceso sigue hasta que la cuerda se ha radiado a si misma simplemente fuera de la existencia. Cuando su energía se agota, no queda nada. Por tanto sería posible utilizar las proporciones de pérdida de energía que predice la teoría de la relatividad general para calcular cuanto tiempo durará la energía almacenada en cualquier cuerda cósmica.

De hecho hubo un período de nervios cuando en cierto tiempo pareció que la cuerda cósmica tendrían una vida demasiado corta para poder realizar su trabajo de formar las galaxias, que romperían los anillos y se radiarian así misma fuera de la existencia antes que la materia y la radiación y la materia ordinaria se desparejaran. Sin embargo, los nuevos cálculos parecen mostrar ahora que los anillos capaces de formar las semillas de las galaxias durarían lo suficiente para llevar a cabo su función.

Lo cierto es que, andamos un poco perdidos y no pocos físicos (no sabemos si de forma interesada), insisten una y otra vez, en cuestiones que parecen no ser muy viables. Sin embargo, en la Física cuántica hemos tenido tantas sorpresas ya que, dudar de que algo sea posible… ¿Resulta arriesgado! Y, allí, en lo más profundo, en ese lugar que está situado más allá del Límite de Planck… ¿Podrían estar esas cuerdas vibrantes que todo lo conforman como la partícula más infinitesimal y primordial de todas.

Claro que estas teorías de cuerdas, como tantas otras antes que ella, también han desarrollado una gran avalancha de excepticismo que es mostrado por algunos en esos momentos de la última cerveza en charlas distendidas entre compañeros físicos y cosmólogos que están unidos por esa curiocidad por saber si, en realidad, esas cuerdas han existido alguna vez. Y, esos excepticos, en verdad, no eran más duros en las críticas a las teorías de los demás que con las suyas propias. El el fondo, todos los buenos físicos saben… ¡que no saben! Lo suficiente como para poder emitir juicios certeros sobre eso ni sobre nada.Lo que hoy es… mañana no será.

Pero claro, nunca se debe decir que no. Hay maneras de comprobar las evidencias, al menos dos. Una, la llamada lente gravitatoria, se apoya en los efectos que las cuerdas cósmicas tendrían sobre la luz de las galaxias distantes. El otro método, algo más indirecto, implica la búsqueda de ondas gravitatorias despedidas por las cuerdas al comienzo de la vida del Universo.

La lente gravitacional es el efecto en el que los rayos de luz son doblados por el campo gravitacional de un objeto masivo (en este caso serían las cuerdas cósmicas las responsables), también las galaxias y los agujeros negros producen el efecto de Lente gravitacional que es una propiedad de todos los objetos masivos.

Buscarlas la estamos buscando pero… ¡No se dejan ver!

Las ondas gravitatorias están siendo buscadas por varios programas y proyectos construídos para tal fin, como LIGO y otros, y, hasta el momento, no parece que se haya tenido muchos resultados a pesar de que, la teoría nos dice que las cuerdas cósmicas emitían una gran cantidad de radiación gravitatoria en los primeros días del Universo. Sin embargo, sí se ha localizado la radiación cósmica del fondeo de microondas y las ondas gravitacionales no.

Está claro que la idea de la cuerda cósmica es sugestiva y nos podría explicar (por fín) como se pudieron formar las galaxias. La gran masa de la cuerda apunta a que debieron ser creadas muy pronro en la vida del Universo, probablemente mucho antes que la materia ordinaria cuando las temperaturas eran muy altas y había disponible mucha energía para formar objetos exóticos.

Si en verdad estuvieron allí, no lo podemos saber a ciencia cierta, y, se trabaja en la búsqueda de pruebas irrefutables que nos confirmen su presencia y su trabajo y contibución en la formación de las grandes estructuras del Universo.

Las grandes estructuras de nuestro Universo se pudieron haber formado a partir de unas semillas (cuerdas cósmicas) de gran densidad que atraían a la materia ordinaria para formarlas, y, de esa manera, pudieron haberse formado las galaxias y estrellas de aquel Espacio Interestelar primigenio. De momento, ninguna explicación mejor que esa nos puede aclarar esa incognita que persiste desde siempre y que, en no pocas ocasiones, produce verguenza a los cosmólogos que, en realidad, no saben qué contestar a una simple pregunta:

¿Cómo se formaron las galaxias?

emilio silvera

Mar

9

NASA Ames Reproduces the Building of Life in Laboratory

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Noticias ~

Clasificado en Noticias ~

Comments (2)

Comments (2)

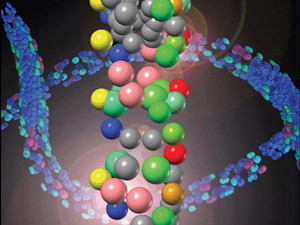

NASA scientists studying the origin of life have reproduced uracil, cytosine, and thymine, three key components of our hereditary material, in the laboratory. They discovered that an ice sample containing pyrimidine exposed to ultraviolet radiation under space-like conditions produces these essential ingredients of life.

Pyrimidine is a ring-shaped molecule made up of carbon and nitrogen and is the central structure for uracil, cytosine, and thymine, which are all three part of a genetic code found in ribonucleic (RNA) and deoxyribonucleic acids (DNA). RNA and DNA are central to protein synthesis, but also have many other roles.

“We have demonstrated for the first time that we can make uracil, cytosine, and thymine, all three components of RNA and DNA, non-biologically in a laboratory under conditions found in space,” said Michel Nuevo, research scientist at NASA’s Ames Research Center, Moffett Field, California. “We are showing that these laboratory processes, which simulate conditions in outer space, can make several fundamental building blocks used by living organisms on Earth.”

An ice sample is deposited on a cold (approximately –440 degrees Fahrenheit) substrate in a chamber, where it is irradiated with high-energy ultraviolet (UV) photons from a hydrogen lamp. The bombarding photons break chemical bonds in the ices and break down the ice’s molecules into fragments that then recombine to form new compounds, such as uracil, cytosine, and thymine.

NASA Ames scientists have been simulating the environments found in interstellar space and the outer Solar System for years. During this time, they have studied a class of carbon-rich compounds, called polycyclic aromatic hydrocarbons (PAHs), that have been identified in meteorites, and which are the most common carbon-rich compound observed in the universe. PAHs typically are structures based on several six-carbon rings that resemble fused hexagons, or a piece of chicken wire.

The molecule pyrimidine is found in meteorites, although scientists still do not know its origin. It may be similar to the carbon-rich PAHs, in that it may be produced in the final outbursts of dying, giant red stars, or formed in dense clouds of interstellar gas and dust.

“Molecules like pyrimidine have nitrogen atoms in their ring structures, which makes them somewhat wimpy. As a less stable molecule, it is more susceptible to destruction by radiation, compared to its counterparts that don’t have nitrogen,” said Scott Sandford, a space science researcher at Ames. “We wanted to test whether pyrimidine can survive in space, and whether it can undergo reactions that turn it into more complicated organic species, such as the nucleobases uracil, cytosine, and thymine.”

In theory, the researchers thought that if molecules of pyrimidine could survive long enough to migrate into interstellar dust clouds, they might be able to shield themselves from destructive radiation. Once in the clouds, most molecules freeze onto dust grains (much like moisture in your breath condenses on a cold window during winter).

These clouds are dense enough to screen out much of the surrounding outside radiation of space, thereby providing some protection to the molecules inside the clouds.

Scientists tested their hypotheses in the Ames Astrochemistry Laboratory. During their experiment, they exposed the ice sample containing pyrimidine to ultraviolet radiation under space-like conditions, including a very high vacuum, extremely low temperatures (approximately –440 degrees Fahrenheit), and harsh radiation.

They found that when pyrimidine is frozen in ice mostly consisting of water, but also ammonia, methanol, or methane, it is much less vulnerable to destruction by radiation than it would be if it were in the gas phase in open space. Instead of being destroyed, many of the molecules took on new forms, such as the RNA/DNA components uracil, cytosine, and thymine, which are found in the genetic make-up of all living organisms on Earth.

“We are trying to address the mechanisms in space that are forming these molecules. Considering what we produced in the laboratory, the chemistry of ice exposed to ultraviolet radiation may be an important linking step between what goes on in space and what fell to Earth early in its development,” said Christopher Materese, another researcher at NASA Ames who has been working on these experiments.

“Nobody really understands how life got started on Earth. Our experiments suggest that once the Earth formed, many of the building blocks of life were likely present from the beginning. Since we are simulating universal astrophysical conditions, the same is likely wherever planets are formed,” says Sandford.

Additional team members who helped perform some of the research are Jason Dworkin, Jamie Elsila, and Stefanie Milam, three NASA scientists at NASA’s Goddard Space Flight Center in Greenbelt, Maryland.

The research was funded by the NASA Astrobiology Institute (NAI) and the NASA Origins of Solar Systems Program. The NAI is a virtual, distributed organization of competitively-selected teams that integrates and funds astrobiology research and training programs in concert with the national and international science communities.

Ruth Marlaire

Ames Research Center, Moffett Field, Calif.

650-604-4789

ruth.marlaire@nasa.gov

To receive local-only NASA Ames news, email local-reporters-request@lists.arc.nasa.gov with “subscribe” in the subject line. To unsubscribe, email the same address with “unsubscribe” in the subject line.

Mar

9

Nanofotónica: luz + nanopartículas = Futuro tecnológico

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Nanotecnología ~

Clasificado en Nanotecnología ~

Comments (0)

Comments (0)

Entradas anteriores

En el Big Bang: Hidrógeno, Helio, Litio.

En las estrellas de la serie principal: Carbono, Nitrógeno, Oxígeno.

En las estrellas moribundas: Sodio, Magnesio, Aluminio, Silicio, Azufre, Cloro, Argón, Potasio, Titanio, Hierro, Cobalto, Níquel, Cobre, Cinc, Plomo, Torio y Uranio.

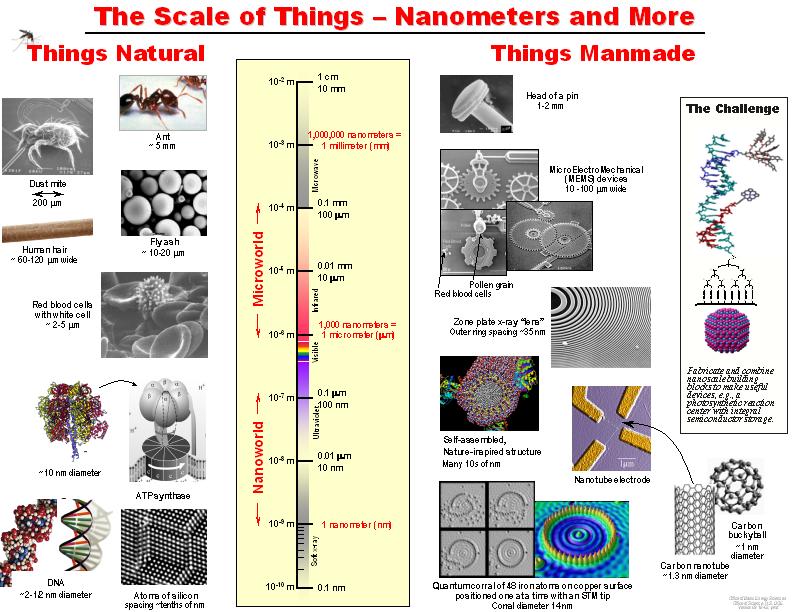

Han pasado ya cincuenta años que Richard Feynman dictara su famosa charla: There is plenty of room at the bottom: An invitation to enter a new field of physics (Hay suficiente espacio en el fondo: Una invitación a entrar en un campo en la Física). En ella estableció que las leyes de la Física no impiden manipular las cosas átomo a átomo; –“es algo que no se ha hecho debido a que somos demasiado grandes para hacerlo”-. Eso ha quedado atrás y, en la actualidad, sí que se manipulan los átomos.

Desde entonces se ha buscando la manera de poder diseñar los materiales átomo a átomo. De hecho, los materiales nanoestructurados ya han sido utilizados en aplicaciones prácticas, siendo importantes en nuestra vida diaria. El color rojo de los vitrales en las catedrales góticas de Europa se obtenía utilizando nanopartículas de oro; la película fotográfica utiliza nanopartículas de plata; los bloqueadores solares utilizan nanopartículas de dióxido de titanio y de zinc como parte activa.

El resultado más vistoso de estas nanoestructuras es la capacidad para poder sintonizar la longitud de onda o color de la emisión.

El primer caso es una aplicación del efecto nano del oro y es quizás la primera aplicación de la nanotecnología. Quizás el mayor desarrollo de las nanoestructuras se dio con el descubrimiento de la microscopia de fuerza atómica ya que con esta se podía manipular a los átomos o partículas muy pequeñas. Hoy día, la investigación en el campo de los materiales nanoestructurados se ha multiplicado y sus aplicaciones abarcan todas las disciplinas convirtiendo a la nanotecnología en un campo interdisciplinario. Muchos países han implementado programas especiales para la investigación en este campo invirtiendo grandes cantidades de dinero. La apuesta puede ser de alto riesgo, pero el premio promete ser enorme.

Richard Feynman

Hoy día se estima el mercado de la nanotecnología en cientos de miles de millones de dólares. Nuestro país también ha apoyado la iniciativa aunque en menor proporción. De hecho la nanotecnología no es una prioridad dentro de nuestro sistema de investigación, no hay programas especiales de apoyo económico en este tópico y se compite por igual con todas las áreas. Con pocos recursos económicos se poca infraestructura y en general grupos pequeños lo que dificulta la capacidad para competir. Aún con estas limitaciones, se han obtenido excelentes resultados y hay grupos en nuestro país que cuentan con reconocimiento internacional.

Materiales nanoestructurados y nanotecnología

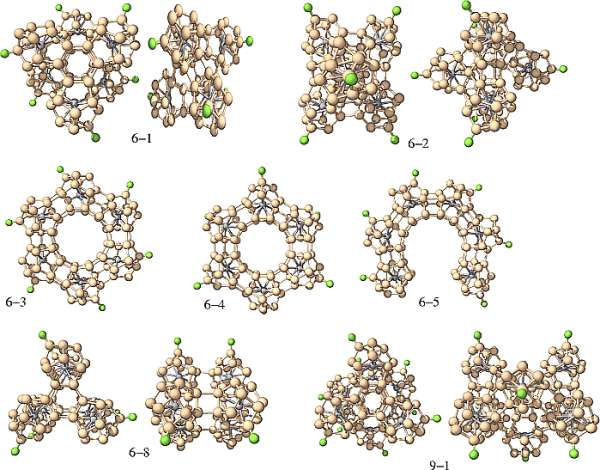

Los materiales nanoestructurados (NEMs, por siglas en inglés) han despertado rápidamente un gran interés debido a la diversidad de sus aplicaciones. De acuerdo a la definición más aceptada, los materiales nanoestructurados son aquellos en los que por lo una de sus dimensiones se encuentra en el rango de 1-100 nm. Es decir, los NEMs son tres órdenes de magnitud más pequeños que los MEMS (sistemas microelectromecánicos, por sus siglas en inglés), e incluyen nanopartículas, nanocristales, nanoalambres, nanobarras, nanotubos, nanofibras, nanoespumas, etc. Los NEMs pueden ser semiconductores, dieléctricos, metales, orgánicos, inorgánicos, aleaciones, biomateriales, biomoléculas, oligómeros, polímeros, etc.

Nos sorprendería saber en qué lugares están presentes los cristales fotónicos con las nuevas técnicas alcanzadas en la nanotecnología

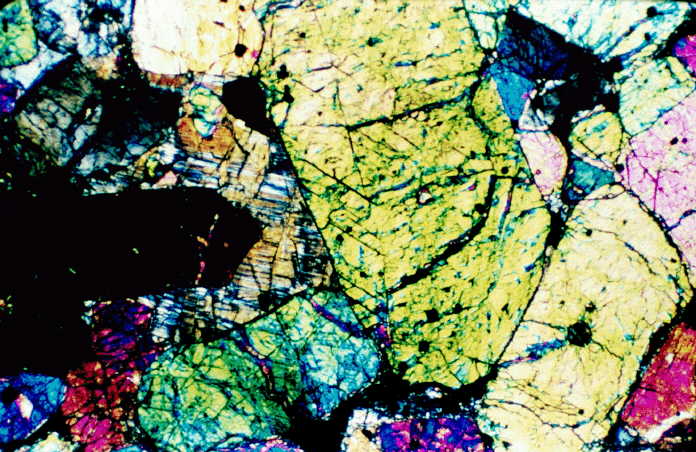

Aunque existen sistemas nanoestructurados de dimensiones mayores son los cristales fotónicos. En el rango de nanómetros, los materiales presentan propiedades ópticas, eléctricas, magnéticas y mecánicas únicas y totalmente diferentes de los materiales en el rango de los micrómetros o milímetros llamados materiales en bulto.

tener una idea de que tan pequeño es un nanómetro podemos mencionar que un milímetro tiene un millón de nanómetros; el diámetro del cabello humano mide 10,000 y 50,000 nanómetros; los glóbulos rojos y blancos miden 2 y 5 nanómetros mientras que el ADN mide 2.5 nanómetros.

Los superátomos de silicio pueden formar, por ejemplo, nanotubos. Además, se les agregar un metal de transición con el objetivo de cambiar sus propiedades eléctricas, lo que se denomina dopaje. el superátomo es de anión ( carga eléctrica negativa, le sobran electrones), “se le dopa con un metal alcalino, el potasio”, que tiene un electrón en su nivel energético más externo. Del mismo modo, cuando son cationes (con carga negativa, al perder electrones) se les dopa con un metal halógeno, que necesita un electrón más completar su último nivel energético.

Las propiedades de los NEMs son dominadas por los efectos de superficie mientras que las de los materiales en bulto son debidas a un efecto de volumen. La tecnología su producción y uso se ha convirtiendo en una industria muy poderosa: la nanotecnología. La nanotecnología es la ciencia e ingeniería de producir materiales o estructuras funcionales de cuantos nanómetros. Es la tecnología del futuro con la cual se desarrollarán los nuevos materiales y dispositivos. Las aplicaciones son sorprendentes así como variadas, por ejemplo, la industria optoelectrónica y fotónica, biomedicina, sensores, celdas solares y de combustible, catálisis, memorias ópticas, procesadores de computadoras, fotodetectores, herramientas de corte, industria aeronáutica, moduladores e interruptores, cosméticos, etc. Aunque todas las aplicaciones son de gran interés, sin duda alguna las aplicaciones en sistemas biológicos son las más sobresalientes. Especialmente las aplicaciones de las propiedades ópticas de los sistemas nanoestructurados.

La Tecnología fundamental del siglo XXI: Nano Tecnología

Uno de sus apartados es la Nanofotónica

Esas nuevas formas, la nanotecnología, entrará en el “universo” de la mecánica cuántica, en el mundo infinitesimal, y, se lograrán cosas que , serían impensables. Posiblemente, la primera visita que hagamos a un mundo habitado por otros seres, estará tripulada por seres nanotecnológicos que, al igual que la misma nave, tengan medidas tan pequeñas que serán imposibles de observar y, sin embargo, estarán dotadas de adelantos tales que, podrán medir, evaluar, estudiar, captar imágenes, enviar por medios desconocidos, y, en fin, serán las avanzadillas de lo que irá después, la visita de humanos a otros mundos.

La nanofotónica es la fusión de la nanotecnología y la fotónica. Es un campo multidisciplinario que estudia las propiedades ópticas de los sistemas nanoestructurados y la interacción luzmateria a nivel nanoscópico. Ya mencionamos que las propiedades ópticas de las nanopartículas son dominadas por los efectos de superficie. Así, controlando el tamaño de las nanopartículas o nanoestructuras podemos controlar o amplificar ciertas propiedades de los sistemas bajo estudio. En general, las nanoestructuras pueden ser de tres tipos, semiconductoras, dieléctricas y metálicas.

La Nanotecnología marcará nuestro futuro. De ella partirán las nuevas ideas e instrumentos, los nuevos modos de construir lo que queda por venir, nuevas maneras de sondear el espacio “infinito”, de curar enfermedades, de sustituir órganos vitales, de construir robots.

Curiosamente, existe una creencia bastante arraigada en amplios sectores de la comunidad científica de que la fotónica (conjunto de tecnologías relacionadas con la luz) es un campo que cae fuera del universo de la nanotecnología. La creencia se apoya en el clásico criterio de Rayleigh de que la resolución espacial de un sistema óptico está limitada por la longitud de onda de la luz (≈ 500 nm), y por ello es próxima al micrómetro, muy lejos de los requisitos de la nanotecnología.

Yo, por mi , estimo que división es sin duda errónea, y hoy en día la fotónica está íntimamente implicada con la nanotecnología, e incluso se hablar propiamente de nanofotónica, de igual manera que se hablar de nanoelectrónica o de nanomagnetismo.

Cuando sepamos conectar de manera conveniente todas las disciplinas del sabe Humano… ¡Las cosas cambiaran!

Decía que: “En general, las nanoestructuras pueden ser de tres tipos, semiconductoras, dieléctricas y metálicas”. una de ellas produce fenómenos de especial interés interactúan con una señal óptica, pudiendo así ser aplicadas en diferentes campos. Un campo de especial interés es la biología.

El estudio de las propiedades luminiscentes de sistemas nanoestructurados en sistemas biológicos es el campo de estudio de la bionanofotónica. Especialmente trata sobre el estudio de sistemas nanoestructurados en aplicaciones biomédicas. Diferentes nanopartículas han sido propuestas ser utilizadas en la detección de bajas concentraciones de diferentes elementos como células cancerigenas, virus, ADN, ARN, proteínas, etc. También han sido utilizadas para la entrega de medicamentos en dirigida y controlada así como para la destrucción de tumores cancerigenos. En la última década, los avances han sido sorprendentes pero aún hay mucho por . En el CIO, durante los últimos 6 años hemos trabajando en la síntesis de nanopartículas y estudiado sus propiedades ópticas a fin de poder ser utilizadas en distintas aplicaciones.

Las propiedades luminescentes de nuestras nanopartículas son muy interesantes y prometen grandes oportunidades de aplicación en diferentes áreas.

Nanopartículas semiconductoras o puntos cuánticos

Los nanocristales semiconductores llamados puntos cuánticos son nanoestructuras a base de materiales semiconductores inorgánicos y representan el grupo donde el efecto del tamaño es más evidente. El tamaño nano da lugar a lo que se conoce confinamiento cuántico, que no es más que la localización de los electrones en un espacio definido, es poner un electrón en una caja. Mientras que tamaños mayores los electrones están no localizados. El confinamiento produce un ensanchamiento de la banda de energía prohibida del semiconductor así la aparición de sub-bandas discretas en la banda de valencia y de conducción. Las dimensiones típicas oscilan uno y diez nanómetros.

Con frecuencia se les describe átomos artificiales debido a que los electrones están dimensionalmente confinados como en un átomo y sólo se tiene niveles de energía discretos. las nanoestructuras más estudiadas se encuentran las de CdSe/ZnS, CdSe/CdS, InP/ZnSe, CdTe/CdSe, entre otras. El resultado más vistoso de estas nanoestructuras es la capacidad poder sintonizar la longitud de onda o color de la emisión.

Así, con un solo material y variando el tamaño de la nanopartícula es posible obtener múltiples colores o longitudes de onda de la señal emitida. Las aplicaciones son impresionantes y apuntan en todas las direcciones. Por ejemplo, podrían ser utilizados como colorantes inorgánicos sin problemas de degradación a diferencia de los colorantes orgánicos. También podrían ser utilizados en el diseño de los nuevos amplificadores ópticos de amplio ancho de banda tan importantes en los sistemas de comunicación óptica; en caso nanopartícula con un diámetro determinado funcionaría como un amplificador, así el ancho de banda se determina con la selección adecuada de los diámetros de las partículas. O bien la producción de fuentes de luz blanca mediante excitación con un LED u OLED o por electroluminiscencia.

Quizás una de las aplicaciones que mayor atención ha recibido es en su uso como etiquetas fluorescentes con emisión en la región visible del espectro, la detección de una gran variedad de compuestos entre ellas células cancerigenas. Las técnicas actuales no detectan bajas concentraciones de células cancerigenas o compuestos de interés, por lo que la técnica de detección de fluorescencia de nanopartículas es una gran promesa para la detección temprana de este mal, para así incrementar el éxito en el tratamiento. Dado el tamaño tan pequeño de los puntos cuánticos actualmente se intenta desarrollar nanoestructuras más complejas formadas por puntos cuánticos o nanocristales acomplejados con diferentes componentes que desempeñan distintas funciones, detección, entrega de medicamento dirigido, efecto de la terapia, etc. Es decir, se busca una nanoestructura inteligente con múltiples funciones. El problema que presentan los puntos cuánticos es que son poco estables ya que tienden a aglomerarse, además de que se excitan con una fuente de luz UV donde la mayoría de los compuestos que se pueden encontrar en interior del cuerpo humano emiten luz lo que significa pérdida de contraste en la imagen de la célula deseada.