May

2

Siempre elucubrando ¡Imaginación!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo y la Entropía ~

Clasificado en El Universo y la Entropía ~

Comments (3)

Comments (3)

Descartan que los efectos atribuidos a la energía oscura sean explicables por nuestra presencia en el centro de un gran vacío cósmico. Es curioso como la Ciencia (mejor algunos científicos), cuando no saben dar una explicación autosuficiente y realmente científica de los fenómenos observados, hacen un ejercicio de imaginación y se inventan las respuestas alegando causas que, de ninguna manera han podido ser probadas, sino que, como simples conjeturas, a base de repetirlas, finalmente quedan como algo que realmente puede existir.

El “descubrimiento de la energía oscura”, esa energía que no podemos ver y que parece aumentar el ritmo de expansión del Universo, supuso, en su momento, mucha agitación en la comunidad científica. A la incredulidad inicial se impusieron las medidas. Pero al cabo de un tiempo el trabajo de los teóricos empezó a cuestionar, no los efectos observados, sino la existencia misma de tal energía.

El “Principio Copernicano”, invocado frecuentemente en la Cosmología moderna, insiste en la homogeneidad del Universo, negando cualquier primacía de posición o propiedades asociadas con la existencia humana. Toma su nombre de la propuesta de Copérnico (ya anteriormente formulada por Aristarco) de desplazar a la Tierra de la posición central ocupada en el sistema de Tolomeo, aunque tal centralidad se debiese a la falta de paralaje estelar y no a una sobrevaloración de nuestra existencia en el planeta.

El paso siguiente lo dio Shapley hace un siglo, al mostrar que tampoco el Sol ocupa el centro de la Via Láctea. Finalmente, el Universo “finito pero ilimitado” de Einstein niega la posibilidad de encontrar un centro en su volumen tridimensional, y afirma la equivalencia de posición de todos los puntos del espacio. No tiene sentido preguntar dónde estamos en el continuo expandirse de un Universo que contiene probablemente más de 100.000 millones de galaxias, y que vuelve a la insignificancia aunque majestuosa estructura de la Vía Láctea, nuestra ciudad cósmica.

En esta imagen captada por el Hubble podemos ver un “trocito” de universo que es inmenso

Sin embargo, a partir de la década de los años 30, se da una reacción interesante, que afirma, cada vez con argumentos más fuertes y detallados, que el Hombre está en un tiempo y un lugar atípicos y privilegiados en muchos respectos, que obligan a preguntarnos si nuestra existencia está ligada en un modo especial a características muy poco comunes en el Universo. Esta pregunta adquiere un significado especial al considerar las consecuencias previsibles (según las leyes físicas) de cualquier alteración en las condiciones iniciales del Universo. Con un eco de las palabras de Einstein: ¿tuvo Dios alguna alternativa al crear?. No solamente debemos dar razón de que el Universo exista, sino de que exista de tal manera y con tales propiedades que la vida inteligente puede desarrollarse en él. Tal es la razón de que se formule el Principio Antrópico, en que el Hombre (entendido en el sentido filosófico de “animal racional”, independientemente de su hábitat y su morfología corporal) aparece como condición determinante de que el Universo sea como es.

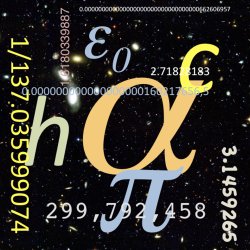

No podemos ser tan egoistas y creer, que en miles de millones de mundos repartidos por las “infinitas” galaxias del Universo, sólo un planeta rocoso y pequeño como la Tierra, ha tenido el privilegio de albergar la vida. Si echamos una mirada a la Historia del planeta, podemos constatar que en él han vivido muchísimas criaturas que ya no están presentes, no supieron adaptarse a los cambios y se extinguieron. Ahora mismo sólo el 1% de las especies que han existido, están aquí presentes. Si nos paramos a pensar que el Universo es homogéneo y que las leyes que lo rigen son las mismas en todas partes, que los elementos formados en las estrellas son siempre los mismos, que las constantes unioversales como la velocidad de la luz, la constante de estructura fina o la constante de Planck, nunca varian… Entonces debemos pensar que, la Vida, también estará presente en todos aquellos lugares que las condiciones lo permitan.

Las primeras sugerencias de una conexión entre vida inteligente y las propiedades del Universo en su momento actual aparecen en las relaciones adimensionales hechas notar por Eddington: la razón de intensidad entre fuerza electromagnética y fuerza gravitatoria entre dos electrones, entre la edad del Universo y el tiempo en que la luz cruza el diámetro clásico de un electrón, entre el radio del Universo observable y el tamaño de una partícula subatómica, nos da cifras del orden de 10 elevado a la potencia 40. El número de partículas nucleares en todo el cosmos se estima como el cuadrado de ese mismo número. ¿Son éstas coincidencias pueriles o esconden un significado profundo?. La hipótesis de los grandes números sugiere que el Hombre solamente puede existir en un lugar y momento determinado, cuando tales coincidencias se dan, aunque no se avanza una explicación de estas relaciones.”

Arthur Eddintong

Una versión más especulativa, el principio antrópico fuerte, asegura que las leyes de la física deben tener propiedades que permitan evolucionar la vida. La implicación de que el universo fue de alguna manera diseñado para hacer posible de la vida humana hace que el principio antrópico fuerte sea muy controvertido, ya que nos quiere adentrar en dominios divinos que, en realidad, es un ámbito incompatible con la certeza comprobada de los hechos a que se atiene la ciencia, en la que la fe, no parece tener cabida.

Una cosa es lo que la Ciencia nos enseña y otra, muy distinta, lo que la religión y la fe nos predica.

Es decir, problema del ajuste fino significa que las las constantes fundamentales de un modelo físico para el universo deben ser ajustados de forma precisa para permitir la existencia de vida. Sobre estas constantes fundamentales no hay nada en la teoría que nos indique que deban tomar esos valores que toman. Podemos fijarlas de acuerdo con las observaciones, pero esto supone fijarlas de entre un rango de valores colosal. Esto da la impresión de cierta arbitrariedad y sugiere que el universo podría ser una realización improbable entre tal rango de valores. He ahí el problema.

No, no tenemos el mundo en nuestras manos… sino al revés, es el mundo el que nos tiene a nosotros… al menos de momento es así. ¿El futuro? ¿Quién puede conocerlo? Lo que pasará y hasta donde podamos llegar es algo impredecible y sólo nos podemos contentar con imaginar lo que podría ser. De momento, formamos una Población del Tipo Cero, es decir, no controlamos ni nuestro propio planeta.

Es cierto que, al tener el conocimiento de cómo funciona el Universo, es difícil imaginar la presencia de una divinidad hacedora de mundos, forjadora de estrellas y constructora de galaxias. Lejos quedan ya aquellas historias que de pequeños nos contaban en la escuela primaria y nos hablaban de hacer el mundo en siete días. Si contáramos los mundos que existen en el Universo y la divinidad tuvciera que haberlos hechos a razón de siete días cada uno, ni los 13.700 millones de años que tiene el Universo, hubiera sido tiempo suficiente para tanto trabajo.

¿Cuál es el verdadero sentido de la teoria del diseño inteligente?

Lamarck, en 1809, en su obra filosofia zoologica.

El principio antrópico nos invita al juego mental de probar a “cambiar” las constantes de la naturaleza y entrar en el juego virtual de ¿qué hubiera pasado si…? A lo que somos tan aficionados para tratar, aunque sólo sea mentalmente, lo que pudo o no pudo ser en función de éste o aquél parámetro que introducimos de manera imaginaria.

Especulamos con lo que podría haber sucedido si algunos sucesos no hubieran ocurrido de tal o cual manera para ocurrir de esta otra. ¿Qué hubiera pasado en el planeta Tierra si no aconteciera en el pasado la caída del meteorito que acabó con los dinosaurios? ¿Habríamos podido estar aquí hoy nosotros? ¿Fue ese cataclismo una bendición para nosotros y nos quitó de encima a unos terribles rivales?

Fantasean con lo que pudo ser…. Es un ejercicio bastante habitual; sólo tenemos que cambiar la realidad de la historia o de los sucesos verdaderos para pretender fabricar un presente distinto. Cambiar el futuro puede resultar más fácil, nadie lo conoce y no pueden rebatirlo con certeza. ¿Quién sabe lo que pasará mañana?

Lo cierto es que, todos son Quarks y Leptones que interactuan con energías y fuerzas que no podemos controlar y, el devenir del Universo será imparable para nosotros, simples mortales que, a veces nos olvidamos de ese pequeño detalle y pensamos en realizar y conseguir logros que quedan muy lejos de nuestro alcance.

Siempre estamos imaginando el futuro que vendrá. Los hombres tratan de diseñarlo pero, finalmente, será el Universo el que tome la última palabra de lo que deba ser. Por mucho que nosotros nos empeñemos, las estructuras del Universo nunca podrán ser cinceladas por nuestras manos ni por nuestros ingenios, sólo las inmensas fuerzas de la Naturaleza puede transformar las estrellas, las galaxias o los mundos…lo demás, por muy bello que pudiera ser, siempre será lo artificial.

Lo que ocurra en la naturaleza del universo está en el destino de la propia naturaleza del cosmos, de las leyes que la rigen y de las fuerzas que gobiernan su mecanismo sometido a principios y energías que, en la mayoría de los casos se pueden escapar a nuestro actual conocimiento.

Lo que le pueda ocurrir a nuestra civilización, además de estar supeditado al destino de nuestro planeta, de nuestro Sol y de nuestro Sistema Solar y la galaxia, también está en manos de los propios individuos que forman esa civilización y que, con sensibilidades distintas y muchas veces dispares, hace impredecibles los acontecimientos que puedan provocar individuos que participan con el poder individual de libre albedrío.

Siempre hemos sabido especular con lo que pudo ser o con lo que podrá ser si…, lo que, la mayoría de las veces, es el signo de cómo queremos ocultar nuestra ignorancia. Bien es cierto que sabemos muchas cosas pero, también es cierto que son más numerosas las que no sabemos.

Cuando el Sol agote todo su combustible nuclear, estará acercándose el final de la Tierra como planeta que albergó la vida. Los cambios serán irreversibles, los océanos se evaporarán y sus aguas hirvientes comenzarán a llenar la atmósfera de gases. La Gigante roja engullirá a los planetas Mercurio, Venus y probablemente se quedará muy cerca de la Tierra calcinada y sin vida.

Sabiendo que el destino irremediable de nuestro mundo, el planeta Tierra, es de ser calcinado por una estrella gigante roja en la que se convertirá el Sol cuando agote la fusión de su combustible de hidrógeno, helio, carbono, etc, para que sus capas exteriores de materia exploten y salgan disparadas al espacio exterior, mientras que, el resto de su masa se contraerá hacia su núcleo bajo su propio peso, a merced de la gravedad, convirtiéndose en una estrella enana blanca de enorme densidad y de reducido diámetro. Sabiendo eso, el hombre está poniendo los medios para que, antes de que llegue ese momento (dentro de algunos miles de millones de años), poder escapar y dar el salto hacia otros mundos lejanos que, como la Tierra ahora, reúna las condiciones físicas y químicas, la atmósfera y la temperatura adecuadas para acogernos.

Esto podría ser lo que quede de nuestro Sol

Pero el problema no es tan fácil y se extiende a la totalidad del universo que, aunque mucho más tarde, también está abocado a la muerte térmica, el frío absoluto si se expande para siempre como un universo abierto y eterno, o el más horroroso de los infiernos, si estamos en un universo cerrado y finito en el que, un día, la fuerza de gravedad, detendrá la expansión de las galaxias que comenzarán a moverse de nuevo en sentido contrario, acercándose las unas a las otras de manera tal que el universo comenzará, con el paso del tiempo, a calentarse, hasta que finalmente, se junte toda la materia-energía del universo en una enorme bola de fuego de millones de grados de temperatura, el Big Crunch.

Un universo replegándose sobre sí mismo

El irreversible final está entre los dos modelos que, de todas las formas que lo miremos, es negativo para la Humanidad (si es que para entonces aún existe). En tal situación, algunos ya están buscando la manera de escapar.

Stephen Hawking ha llegado a la conclusión de que estamos inmersos en un multiuniverso, esto es, que existen infinidad de universos conectados los unos a los otros. Unos tienen constantes de la naturaleza que permiten vida igual o parecida a la nuestra, otros posibilitan formas de vida muy distintas y otros muchos no permiten ninguna clase de vida.

Este sistema de inflación autorreproductora nos viene a decir que cuando el universo se expande (se infla) a su vez, esa burbuja crea otras burbujas que se inflan y a su vez continúan creando otras nuevas más allá de nuestro horizonte visible. Cada burbuja será un nuevo universo, o mini-universo en los que reinarán escenarios diferentes o diferentes constantes y fuerzas.

¿Quién sabe la realidad? ¿Donde estamos? ¿Está solo el Universo? ¿Y nosotros, que vecinos tendremos?

El escenario que describe el diagrama dibujado antes, ha sido explorado y el resultado hallado es que en cada uno de esos mini-universos, puede haber muchas cosas diferentes; pueden terminar con diferentes números de dimensiones espaciales o diferentes constantes y fuerzas de la naturaleza, pudiendo unos albergar la vida y otros no.

El reto que queda para los cosmólogos es calcular las probabilidades de que emerjan diferenta mini-universos a partir de esta complejidad inflacionaria ¿Son comunes o raros los mini-universos como el nuestro? Existen, como para todos los problemas planteados, diversas conjeturas y consideraciones que influyen en la interpretación de cualquier teoría cosmológica futura cuántico-relativista. Hasta que no seamos capaces de exponer una teoría que incluya la relatividad general de Einstein (la gravedad-cosmos) y la mecánica cuántica de Planck (el cuanto-átomo), no será posible contestar a ciertas preguntas.

En diez y once dimensiones nos quiere explicar todo el universo

La teoría de cuerdas tiene un gancho tremendo. Te transporta a un mundo de 11 dimensiones, universos paralelos, y partículas formadas por cuerdecitas casi invisibles vibrando a diferentes frecuencias. Además, te dice que no se trata de analogías sino de la estructura más profunda de la realidad, y que ésta podría ser la teoria final que unificara por fin a toda la física. ¿No estaremos hablando de Filosofía?

Todas las soluciones que buscamos parecen estar situadas en teorías más avanzadas que, al parecer, sólo son posibles en dimensiones superiores, como es el caso de la teoría de supercuerdas situada en 10, 11 ó 26 dimensiones. Allí, si son compatibles la relatividad y la mecánica cuántica, hay espacio más que suficiente para dar cabida a las partículas elementales, las fuerzas gauge de Yang-Mill, el electromagnetismo de Maxwell y, en definitiva, al espacio-tiempo y la materia, la descripción verdadera del universo y de las fuerzas que en él actúan.

Si algún día encontramos la llave del Hiperespacio… ¡Podremos burlar la velocidad de la Luz!

Científicamente, la teoría del hiperespacio lleva los nombres de Teoría de Kaluza-Klein y supergravedad. Pero en su formulación más avanzada se denomina Teoría de Supercuerdas, una teoría que desarrolla su potencial en nueve dimensiones espaciales y una de tiempo: diez dimensiones. Así pues, trabajando en dimensiones más altas, esta teoría del hiperespacio puede ser la culminación que conoce dos milenios de investigación científica: la unificación de todas las fuerzas físicas conocidas. Como el Santo Grial de la Física, la “teoría de todo” que esquivó a Einstein que la buscó los últimos 30 años de su vida.

El sueño incumplido de Einstein fue hallar esa Teoría del Todo, Que todos los engranajes del Universo funcionaran al unísono y que lo pudiéramos comprender.

Es cierto, los mejores siempre han buscado el Santo Grial de la Física. Una Teoría que lo pueda explicar todo, la más completa que mediante una sencilla ecuación, responda a los misterios del Universo. Claro que tal hazaña, no depende siquiera de la inteligencia del explorador que la busca, es más bien un problema de que, las herramientas necesarias (matemáticas) para hallarla, aún no han sido inventadas.

Durante el último medio siglo, los científicos se han sentido intrigados por la aparente diferencia entre las fuerzas básicas que mantienen unido al cosmos: la Gravedad, el electromagnetismo y las fuerzas nucleares fuerte y débil. Los intentos por parte de las mejores mentes del siglo XX para proporcionar una imagen unificadora de todas las fuerzas conocidas han fracasado. Sin embargo, la teoría del hiperespacio permite la posibilidad de explicar todas las fuerzas de la naturaleza y también la aparentemente aleatoria colección de partículas subatómicas, de una forma verdaderamente elegante. En esta teoría del hiperespacio, la “materia” puede verse también como las vibraciones que rizan el tejido del espacio y del tiempo. De ello se sigue la fascinante posibilidad de que todo lo que vemos a nuestro alrededor, desde los árboles y las montañas a las propias estrellas, no son sino vibraciones del hiperespacio.

Estoy convencido de que nuestro universo no es el único universo. Lo mismo que existen cientos de miles de millones de mundos y de estrellas, de la misma manera que en nuestro universo se pueden contar más de cien mil millones de galaxias… ¿Por qué el Universo que conocemos no podría tener otros “hermanos”. Recientemente se hicieron unas pruebas muy precisas que midieron lo que podría haber más allá del “borde” del nuestro universo, y, ¡sorpresa! Se detectaron inmensas estructuras lejanas que, posiblemente, podían estar tirrando de nosotros mediante una gran fuerza gravitatoria… No será eso lo que realmente hace que nuestro Universo se expanda y no la dichosa materia oscura.

Antes mencionábamos los universos burbujas nacidos de la inflación y, normalmente, el contacto entre estos universos burbujas es imposible, pero analizando las ecuaciones de Einstein, los cosmólogos han demostrado que podría existir una madeja de agujeros de gusano, o tubos, que conectan estos universos paralelos.

Aunque muchas consecuencias de esta discusión son puramente teóricas, el viaje en el hiperespacio puede proporcionar eventualmente la aplicación más práctica de todas: salvar la vida inteligente, incluso a nosotros mismos, de la muerte de este universo cuando al final llegue el frío o el calor.

Lo cierto es que, son muchas, las cosas que no sabemos

Esta nueva teoría de supercuerdas tan prometedora del hiperespacio es un cuerpo bien definido de ecuaciones matemáticas. Podemos calcular la energía exacta necesaria para doblar el espacio y el tiempo o para cerrar agujeros de gusano que unan partes distantes de nuestro universo. Por desgracia, los resultados son desalentadores. La energía requerida excede con mucho cualquier cosa que pueda existir en nuestro planeta. De hecho, la energía es mil billones de veces mayor que la energía de nuestros mayores colisionadores de átomos. Debemos esperar siglos, o quizás milenios, hasta que nuestra civilización desarrolle la capacidad técnica de manipular el espacio-tiempo utilizando la energía infinita que podría proporcionar un agujero negro para de esta forma poder dominar el hiperespacio que, al parecer, es la única posibilidad que tendremos para escapar del lejano fin que se avecina. ¿Que aún tardará mucho? Sí, pero el tiempo es inexorable, la debacle del frío o del fuego llegaría.

No existen dudas al respecto, la tarea es descomunal, imposible para nuestra civilización de hoy, ¿pero y la de mañana?, ¿no habrá vencido todas las barreras? Creo que el hombre es capaz de plasmar en hechos ciertos todos sus pensamientos e ideas, sólo necesita tiempo: Tiempo tenemos mucho por delante.

¿Sabremos aprovecharlo?

emilio silvera

May

2

La Física de Partículas al Servicio de la Salud

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física... ¡Y mucho más! ~

Clasificado en Física... ¡Y mucho más! ~

Comments (0)

Comments (0)

Transferencias tecnológicas del CERN a la Biomedicina

Partículas y mucho más

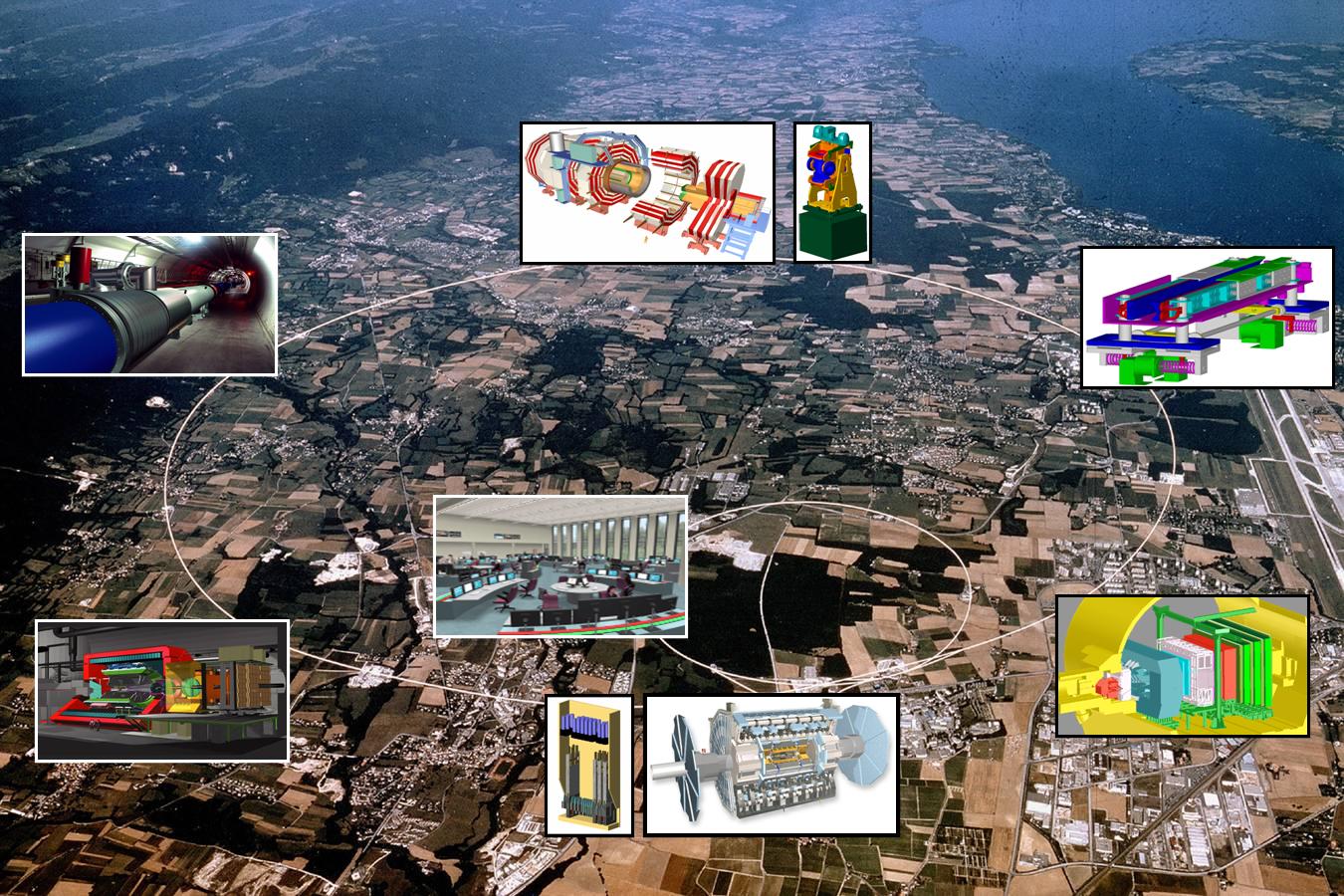

Seguramente la mayoría de los lectores de la Revista Española de Física han oído más de una vez hablar del CERN. Fundado en 1954, constituye el mayor laboratorio de física de partículas del mundo, con veinte países miembros y un personal de unas 3.000 personas entre físicos, ingenieros y personal técnico y administrativo de todo tipo. Seguramente están también al tanto de los grandes experimentos que se están preparando en este centro como el Large Hadron Collider (LHC), situado en un túnel circular de 27 km de longitud, destinado a elucidar el origen de la llamada ruptura de la simetría electrodébil y en última instancia el origen de las masas de las partículas elementales (no de la masa del protón o del neutrón como erróneamente se dice a veces en los medios de comunicación), o del proyecto CERN Neutrino Gran Sasso (CNGS), que consiste en enviar un haz de neutrinos de alta energía desde el CERN al laboratorio subterráneo italiano del Gran Sasso que se encuentra a 730 km, para estudiar las oscilaciones de estas huidizas partículas.

También es muy probable que muchos lectores asocien de manera natural la palabra acelerador de partículas a los instrumentos que utilizan los físicos modernos para estudiar y comprender mejor la estructura y el comportamiento de la materia a pequeñas escalas. Sin embargo, de los 17.000 aceleradores de partículas que se estima existen en la actualidad en todo el mundo, aproximadamente la mitad de ellos se usan en medicina y sólo una parte muy pequeña se usan para investigación fundamental. Por este y otros motivos que se discutirán más adelante, en este número especial de la Revista Española de Física dedicado a la física y las ciencias de la vida, ha parecido conveniente incluir un artículo en el que, al menos brevemente, se describieran algunas de las transferencias tecnológicas (spinoffs) importantes que la actividad del CERN aporta a dichas ciencias.

Mucho de lo que aquí se descubre, se aplica a nuestra Salud

Es bastante razonable que, como ocurre con las ciencias del espacio, mucha gente se pregunte cuál es la utilidad social de la física de partículas más allá de la adquisición de conocimientos fundamentales de la naturaleza. Sin embargo, es preciso señalar que los aceleradores y detectores de partículas del CERN y otros laboratorios similares requieren el uso, y muchas veces el desarrollo, de tecnologías de punta que obligan a una estrecha colaboración con la industria que redunda en beneficio de ambas partes. Las transferencias tecnológicas que se producen en este proceso se incorporan inmediatamente a nuestra vida diaria en áreas tales como la electrónica, procesamiento industrial y médico de imágenes, manejo y usos de la radiación , metrología, nuevos materiales, tecnologías de la computación y la información, tratamiento del cáncer, etc. En este artículo se pondrá el énfasis en aquellas actividades del CERN que han redundado de una forma más clara en beneficio de las ciencias biomédicas.

PET/TC o más allá de los rayos X

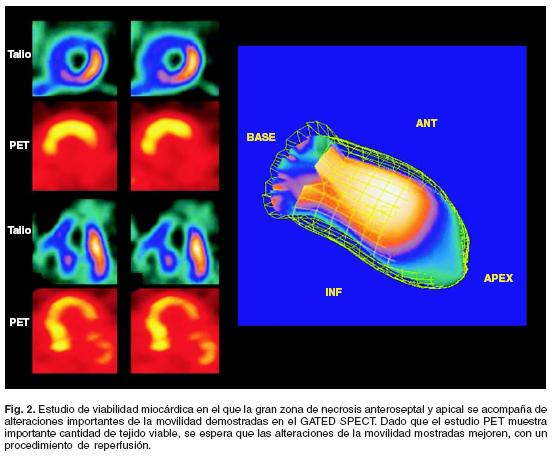

En el ámbito de la medicina los aceleradores de partículas se utilizan con dos finalidades; una para la formación de imágenes con propósitos diagnósticos y otra, para terapia, principalmente oncológica. Desde el descubrimiento de los rayos X por Röntgen en 1895, este tipo de radiación electromagnética ha proporcionado una información de valor incalculable y aún sigue proporcionándola. Sin embargo, mucho más recientemente, se han desarrollado otras técnicas complementarias de diagnóstico basadas en los llamados radiofármacos. Estas sustancias radiactivas presentan idealmente la propiedad de poder ser inyectadas en el organismo humano de forma segura y de fijarse exclusivamente a determinados tejidos. Posteriormente, a medida que van desintegrándose, emiten ciertas partículas que pueden ser detectadas y analizadas produciendo de esta forma imágenes estáticas o incluso dinámicas de los órganos en los que se depositaron los radiofármacos y, en definitiva, proporcionando información no solamente sobre la morfología de aquellos, sino también, en muchos casos, sobre su función y metabolismo.Los radiofármacos se producen utilizando haces de protones de alta intensidad y, como tienen una vida media muy baja, deben utilizarse cerca de donde se han creado. Se calcula que unos 20 millones de personas son diagnosticadas cada año mediante el uso de este tipo de sustancias.

Son técnicas no invasivas que dejan al descubierto lo que interesa ver y eliminar.

Una de las técnicas de este tipo más utilizada en la actualidad es la Positron Emission Tomography (PET). En su aplicación se utiliza normalmente un ciclotrón para irradiar alguna sustancia que se convierte en radiactiva por desintegración beta positiva (emisora de positrones). Esta sustancia se une por ejemplo a la glucosa y se inyecta al paciente. Los positrones producidos se aniquilan con los electrones circundantes dando lugar a dos fotones de energía muy bien definida, emitidos en direcciones opuestas. Estos fotones interaccionan con un material escintilador dando lugar a la emisión de otros fotones que pueden ser detectados por fotomultiplicadores o fotodiodos para formar la imagen de los tejidos que se pretenden estudiar en función de la distribución de la glucosa radiactiva. Por ejemplo, en el caso del diagnóstico del cáncer las células cancerosas suelen consumir más glucosa que las células sanas debido a su mayor vascularización y a su mayor actividad metabólica y reproductiva, produciendo por tanto una mayor emisión de fotones. Por el contrario, las zonas donde el tejido presente mayor número de células muertas brillarán menos debido a la menor concentración de glucosa radioactiva, lo cual puede ser muy útil para el diagnóstico de infartos y otras lesiones.

Tecnológias que llegan más allá

De acuerdo con David Townsend, uno de los pioneros en el desarrollo de la tecnología PET, aunque ésta no fue inventada en el CERN, una cantidad esencial e inicial de trabajo desarrollado en el CERN a partir de 1977 contribuyó de forma significativa al desarrollo del PET 3D. La tecnología PET alcanza su grado más alto de utilidad diagnóstica cuando se combina con la Computed Tomography (CT). La CT es un método de formación de imágenes tridimensionales a partir del procesamiento digital de un gran número de imágenes bidimensionales de rayos X. Inicialmente, las diferentes imágenes se obtenían alrededor de un solo eje de rotación y de ahí su nombre original de Computed Axial Tomography (CAT).

La técnica combinada PET/CT es uno de los desarrollos más excitantes de la medicina nuclear y la radiología modernas. Las reconstrucciones de imágenes CT permiten el diagnóstico precoz de tumores basándose en sus características morfológicas, mientras que la tecnología PET es capaz de diferenciar con grane eficiencia los tejidos malignos de los benignos. La fusión PET/CT permite ahora integrar las imágenes morfológica y fisiológica en una única imagen. El prototipo del scanner ART, el Partial Ring Tomograph (PRT), fue desarrollado en el CERN en 1980 y 1990 por David Townsend, Martín Wensveen y Henri Tochon-Danguy, y evaluado clínicamente en el departamento de medicina nuclear del Hospital Cantonal de Ginebra. ART puede considerarse como el precursor de la parte PET del moderno scanner PET/CT, que ha producido un impacto extraordinario en la tecnología de imágenes con fines médicos. Además, el CERN continua hoy en día contribuyendo a este campo fundamental de la medicina moderna mediante proyectos como Clear PET, Clear PEM, HPD PET etc.

Sin embargo, la importancia del CERN en el desarrollo de las tecnologías PET o CT, y en general de todo tipo de scanner, va mucho más allá. En efecto, todo este tipo de dispositivos se basa, de una forma u otra, en los detectores desarrollados a finales de los sesenta en el CERN por George Charpak. Su trabajo fue reconocido en 1992 con la concesión del Premio Nobel de Física por su invención y desarrollo de detectores de partículas, en particular de la cámara proporcional multihilos, que produjo una revolución en la técnica de exploración de las partes más íntimas de la materia. Los detectores desarrollados por Charpak se usan aún para todo tipo de investigaciones médicas y biológicas y podrían eventualmente sustituir completamente a las placas fotográficas en la radio-biología aplicada. La velocidad creciente con la que permiten registrar las imágenes en radio medicina conducen a una menor tiempo de exposición y a menores dosis de radiación indeseada recibida por los pacientes.

Hadronterapia, o las partículas contra el cáncer

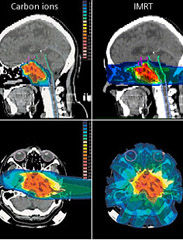

Como es bien sabido, una de las herramientas terapéuticas esenciales en el campo de la oncología es la radioterapia. Dicho tratamiento se aplica hoy en día aproximadamente a la mitad de los pacientes de cáncer. En cierto modo se puede considerar como una forma sutil de cirugía donde el bisturí es reemplazado por un haz colimado de partículas capaz de esterilizar las células malignas mediante la inactivación de su ADN, impidiendo así su reproducción. Tradicionalmente, la radioterapia se ha basado en el uso de rayos X (fotones), electrones y, más recientemente, hadrones, es decir, partículas capaces de interaccionar fuerte o nuclearmente, si bien no es ésta la propiedad más interesante de estas partículas para las aplicaciones radioterapeúticas. Los haces de rayos X y los electrones se obtienen normalmente a partir de aceleradores lineales como los del CERN, aunque mucho más pequeños, y se apuntan hacia los tumores con la energía, dirección y colimación apropiadas para optimizar su efecto destructivo sobre los mismos. Por su parte, los neutrones pierden energía en el interior del organismo de una forma diferente, lo cual les hace más indicados para el tratamiento de ciertos tipos especiales de tumores. Se obtienen a partir de las colisiones de protones, previamente acelerados en un ciclotrón, con núcleos de berilio. Este hecho hace que esta terapia sea bastante más cara que las anteriores, pero a cambio el ciclotrón puede ser usado también para la producción de radiofármacos.

Cintíficos del CERN aplivcan antimateria contra el Cáncer

El estudio de las posibilidades de utilización de haces de hadrones en la terapia del cáncer tuvo su origen en el trabajo seminal de R.R Wilson titulado Radiological Use of Fast Protons (Radiology 47, 1946). En dicho artículo se ponía de manifiesto que los protones, así como otras partículas cargadas pesadas, presentan la propiedad única de que al penetrar en el cuerpo humano depositan la mayor parte de su energía a una preofundidad que depende de su energía inicial. Este hecho permite seleccionar cuidadosamente el área que se quiere irradiar, preservando de dicha radiación al tejido sano que pudiera encontrarse a menor profundidad. Además, como las partículas se detienen a una distancia de la superficie bien definida por la energía del haz, tampoco resultarían dañadas las células situadas detrás del blanco seleccionado.

Sin embargo, la importancia del CERN en el desarrollo de las tecnologías PET o CT, y en general de todo tipo de scanner, va mucho más allá.

En contraste, la energía depositada por los rayos X alcanza su máximo cerca de la superficie de entrada y decae exponencialmente hasta que abandona el cuerpo humano en el lado opuesto, haciendo por tanto muy difícil seleccionar la zona que quiere irradiarse sin dañar otras áreas de células sanas. El trabajo de Wilson de 1946 condujo a toda una nueva línea de investigación experimental, principalmente en el Lawrence Berkeley Laboratory, que ha dado lugar al desarrollo de una nueva clase de terapias antitumorales basadas en la irradiación con protones y más recientemente con iones de carbono. Estas técnicas han sido aplicadas en más de 40 centros de todo el mundo, y de ellas se han beneficiado hasta la fecha más de 50.000 pacientes. No obstante, continúan investigándose nuevas formas de intentar mejorar el ratio entre la energía depositada en las células tumorales y en el tejido sano.

En la actualidad, el CERN se encuentra involucrado en diversos proyectos relacionados con la hadronterapia. Por ejemplo, en el diseño de un acelerador de protones e iones de carbono dedicado exclusivamente a usos médicos conocido como Proton Ion Medical Machine Study (PIMMS). Otro proyecto interesante es la realización de las pruebas del Linear Booster ( LIBO), capaz de acelerar una haz de protones hasta 200 Mev (los hospitales habiualmente utilizan energías en torno a los 65 MeV) y que estaría especializado en el tartamiento de tumores profundos.

Finalmente, y situándonos en un plano de investigación a un nivel más básico, es interesante señalar que en octubre de 2006 se presentaron los primeros resultados de un experimento llevado a cabo en el CERN con potencial para futuras aplicaciones en la terapia del cáncer. Se trataba del Antiproton Cell Experiment (ACE), que constituye la primera investigación realizada hasta la fecha sobre efectos biológicos de los antiprotones. Los antiprotones se comportan como los protones cuando entran en el organismo, pero generan mucha más energía en el blanco seleccionado debido a du aniquilación con los protones existentes en los núcleos de los átomos de las células, y además depositan esta energía de una forma biológicamente más efectiva.

Se busca antimateria contra el Cáncer. Los resultados muestran que los antiprotones son cuatro veces más efectivos que los protones para destruir células vivas. (Foto: Especial CERN )

Evaluando la fracción de células supervivientes después de la irradiación con el haz de antiprotones, el experimento ACE ha encontrado que a eficiencia de éstos es unas cuatro veces mayor que la de los protones, mientras que el daño producido a las células situadas antes del blanco era básicamente el mismo. De acuerdo con Michael Holzscheiter, portavoz del experimento ACE, este hecho podría ser extremadamente importante para el tratamiento de casos de cáncer recurrente, donde este tipo de propiedad es vital. La tecnología desarrollada previamente en el CERN para la obtención de haces de antiprotones de buena calidad a la energía apropiada es esencial para este prometedor experimento, que difícilmente podría haberse realizado en ningún otro laboratorio. Éste es por tanto un magnífico ejemplo de cómo la investigación en física de partículas desarrollada en el CERN puede generar soluciones innovadores con excelentes beneficios médicos potenciales.

Los investigadores de ACE, en colaboración con otras instituciones de todo el mundo, están realizando en la actualidad nuevos tests para comprobar la eficacia de este método en el caso de tumores situados a mayor profundidad, y comparando sus resultados con los de otros métodos más convencionales como la irradiación mediante iones de carbono. Si todo sale como se espera, los beneficios clínicos de esta nueva técnica podrían empezar a producirse dentro de la próxima década.

Otro ejemplo importante de tecnología creada en el CERN con aplicaciones a la terapia del cáncer es el Neutron Driven Element Trasmuter. Se trata de un sistema de producción de radioisótopos específicos específicos a partir de un acelerador de protones cuyo desarrollo fue liderado por Carlo Rubbia, Premio Nobel de Física en 1984 por el descubrimiento de los bosones W y Z y ex director general del CERN. La idea es utilizar el haz de protones para producir neutrones los cuales provocan reacciones en un ambiente apropiado donde ciertos elementos son convertidos en los isótopos deseados.

La diferencia principal entre este método, seguro y barato, y el método más tradicional de utilizar los neutrones provenientes de un reactor nuclear, es que no requiere el uso de material fisionable ni funciona críticamente, es decir las reacciones se detienen en el momento en el que el acelerador es apagado. Más aún, el método tiene la ventaja de que sólo se producen los isótopos requeridos, lo que redunda en una importante reducción de impacto ambiental. Normalmente, el blanco utilizado es plomo, elemento idóneo por presentar el menor ritmo de captura de neutrones. Los neutrones se producen por espalación a partir del haz de protones y permanecen en el interior del blanco de plomo, que está rodeado de un deflector de grafito, hasta que su espectro se suaviza suficientemente para cubrir un gran rango de energías que permiten su utilización para la transmutación de los elementos necesarios para la obtención de los isótopos deseados.

El Neutron Driven Element Trasmuter ha permitido, entre otras cosas, la producción de radioisótopos beta emisores como el 166Ho, 186 Re o el 188Re que son de gran importancia en braquiterapia. Dicha técnica, muy utilizada en el tratamiento de cánceres ginecológicos y en el de cáncer de próstata, es un tipo de radioterapia de proximidad donde la fuente radiactiva se sitúa dentro o muy cerca de los tejidos que requieren irradiación. Típicamente, la fuente radiactiva, de alta actividad y corta vida media, se encapsula en una semilla, filamento o tubo y se implanta en quirófano en la zona deseada. Las diferentes dosis requeridas en cada caso hacen que sea fundamental disponer del mayor muestrario posible de radioisótopos con la actividad y vida media apropiadas, lo cual convierte al Neutron Driven Element Trasmuter en una herramienta valiosísima para el futuro de este tipo de técnica terapéutica.

Información y computación sin fronteras

CERN, … where the web was born; éste es uno de los reclamos publicitarios que suelen utilizarse para hacer ver al público la importancia de los retornos tecnológicos que en este laboratorio tienen lugar. Y en efecto, fue a finales de los ochenta cuando Tim Berners-Lee desarrolló estándar de Hyper Text Transfer Protocol (HTTP) e implementó los primeros servidores web en el CERN. Su esfuerzo permitió la comunicación fácil y segura y el intercambio de todo tipo de información entre todos los ordenadores del mundo conectados a internet, dando lugar de esta forma a una de las revoluciones tecnológicas más importantes de las últimas décadas. Las repercusiones científicas, tecnológicas, culturales, comerciales y de ocio de la web son ya tan conocidas que apenas merecen comentario alguno.

El término Grid fue acuñado por Ian Foster and Carl Kesselman en su libro The Grid, Blueprint for new Computing Infraestructure (Morgan Kaufman, 1998), aunque las ideas básicas habían sido consideradas con anterioridad. No existe un acuerdo general sobre cual debería ser la definición precisa de las tecnologías Grid, pero hay un amplio concenso en que esta debería contener elementos tales como recursos compartidos, virtualización, abstracción del acceso a los recursos y estandarización. La filosofía Grid consistería, no sólo en compartir información entre diferentes usuarios, sino también recursos, como por ejemplo, procesadores, tiempo de CPU, unidades de almacenamiento, así como otros aparatos e instrumentos, de tal forma que eventualmente cada usuario tendría acceso virtual, por ejemplo, a la capacidad de cálculo de todos los demás usuarios de esa Grid. En los primeros tiempos de esta tecnología de la información se llegó a hablar de la Grid, refiriéndose a la posibilidad de existencia de una única World Wide Grid.

Todo surgió del CERN

Hasta el momento,, sin embargo, este concepto no es una realidad y más bien lo que se encuentra es que diferentes grupos de proyectos crean su propia Grid usando sus propias implementaciones, estándares y protocolos y dando acceso restringido solamente a una cierta comunidad de usuarios autorizados. Así, aunque se siguen realizando importantes esfuerzos en cuanto a la estandarización de los protocolos, no está claro cual será el camino que este tipo de tecnología seguirá en el futuro en lo que se refiere a la futura existencia de un única Grid.

En cualquier caso es importante resaltar que una vez más el CERN ha sido pionero en este tipo de tecnología. Los detectores que se están instalando (a estas alturas, todos instalados y en marcha) en el LHC (ATLAS, CMS, ALICE, LHCb, SUSY, etc.), son tan complejos, que han requerido cada uno de ellos el concurso de muchas instituciones de todo el mundo para su construcción, y lo seguirán requiriendo para su mantenimiento cuando el acelerador empiece a funcionar (ya está en marcha), y, como no, para el análisis de los datos que se obtengan. Para hacerse una idea de la dimensión y complejidad de estos análisis baste mencionar que el compact Muon Selenoid (CMS), una vez pasado su primer filtro, deberá almacenar información sobre el resultado de las colisiones producidas en su interior a un ritmo del orden de 100 a 200 MB por segundo durante un tiempo esperado de unos cien días por año. Resulta obvio que sólo una tecnología tipo Grid puede afrontar con posibilidades de éxito un reto semejante y de hecho el CERN ha inspirado varios proyectos Grid multinacionales por este motivo. Posiblemente, el más grande de ellos hasta la fecha sea el EGEE (Enablinbg Grids for E-Science), que conecta más de 150 paises y ofrece 20 000 CPUs y más de 10 Petabytes de memoria.

De manera análoga a como ocurrió con las tecnologías de la detección y aceleración, las tecnologías Grid tendrán, y de hecho ya empiezan a tener, un fuerte impacto en las ciencias de la vida y de la salud. En este sentido, uno de los campos obvios de aplicación es la bioinformática. Gracias a los espectaculares avances llevados a cabo en los últimos años en el campo de la biología molecular, se dispone hoy en día de cantidades crecientes de información genética de diferentes especies e individuos. Dicha información codificada en el ADN en forma de secuencia de tripletes o codones de ácidos nucleicos, que constituyen los genes que contienen la estructura primaria de las diferentes proteínas, ha sido y está siendo obtenida por centenares de grupos diferentes distribuidos por todo el mundo y debe almacenarse en gigantescas bases de datos de forma eficiente para su compartición, contrastación y análisis.

Ejemplos típicos serían la búsqueda de determinadas secuencias, comparaciones, búsqueda de determinadas mutaciones o alelos, etc. Resulta evidente que esta ingente labor puede verse enormemente beneficiada por el uso de tecnologías Grid. De hecho, la Bioinformática, y en particular sus aplicaciones biomédicas, han sido una parte importante del proyecto EGEE desde el comienzo del mismo.

Finalmente, y como última muestra de cómo puede revertir en la sociedad las tecnologías de la información y la computación provenientes de la física de partículas, es interesante mencionar el Proyecto Mammogrid y su continuación Mammogrid Plus. Liderado por el CERN, dicho proyecto de la UE utiliza la tecnología Grid para crear una base de datos de mamografías que pueda ser usada para investigar un gran conjunto de datos e imágenes que, aparte de otras aplicaciones sanitarias, sea útil para estudiar el potencial de esta tecnología para servir de soporte a la colaboración entre los profesionales de la salud de la UE.

Ciencia, Tecnología y Sociedad

A estas alturas debería haber quedado claro que los centros científicos de élite internacionales como el CERN, no sólo nos proporcionan un conocimiento más profundo de la naturaleza, sino que las tecnologías de punta que en ellos se desarrollan acaban permeando a la Sociedad y se incorporan a nuestras vidas cotidianas. El autor del artículo, Antonio Dobado, del Departamento de Física Teórica I de la Universidad Complutense de Madrid, ha pretendido ilustrar el hecho innegable de la conexión existente entre temas tan aparentemente dispares como el de la Física de Partículas y la Biomedicina, pero ejemplos semejantes podrían haberse encontrado en prácticamente cualquier área de la actividad humana.

La Sociedad no puede permanecer por más tiempo ajena a la Ciencia y a todo lo que trae consigo. Precisamente por eso la RSEF dedica un gran esfuerzo a la difícil tarea de convencer al público de la importancia de la Física como valor científico, cultural y social, como una forma rigurosa y profunda del acercamiento al conocimiento de la naturaleza, y a la vez como generadora de nuevas tecnologías. En este sentido, es una espléndida noticia la inminente creación de un nuevo Grupo especializado en el seno de la RSEF denominado Física Médica. Y, desde aquí, aprovechamos la oportunidad para darles la bienvenida y desearles el mayor éxito en sus futuras andaduras en la búsqueda de la verdad científica.

Fuente: Revista Española de FÍSICA.

Publicada por la RSEF con el Nº 3 Volumen 21 de 2007

La presente transcripción es de: Emilio Silvera

Miembro numerario de la RSEF y adscrito a los Grupos Especializados de Física Teórica y Astrofísica.

Totales: 75.576.218

Totales: 75.576.218 Conectados: 46

Conectados: 46