Sep

4

Todo es Universo… ¡También nosotros!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo misterioso ~

Clasificado en El Universo misterioso ~

Comments (0)

Comments (0)

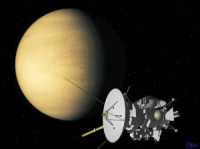

Recordemos la Misión Cassini Huygens

Sobrevuelos a Venus, la Tierra y Júpiter

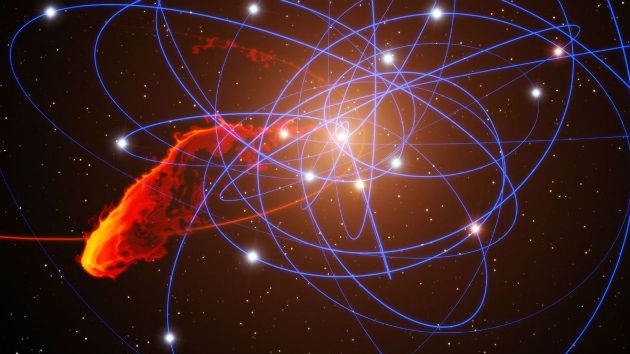

La masa de la sonda Cassini es tan grande que no fue posible emplear un vehículo de lanzamiento que la dirigiese directamente a Saturno. Para alcanzar este planeta fueron necesarias cuatro asistencias gravitacionales; de esta forma, Cassini empleó una trayectoria interplanetaria que la llevaría a Venus en dos ocasiones, posteriormente hacia la Tierra y después hacia Júpiter. Después de sobrevolar Venus en dos ocasiones a una altitud de 284 Km, el 26 de abril de 1998 y a 600 Km, el 24 de junio de 1999, el vehículo se aproximó a la Tierra, acercándose a 1171 Km de su superficie el 18 de agosto de 1999. Gracias a estas tres asistencias gravitacionales, Cassini adquirió el momento suficiente para dirigirse al Sistema Solar externo. La cuarta y última asistencia se llevaría a cabo en Júpiter, el 30 de diciembre de 2000, sobrevolándolo a una distancia de 9.723.890 Km, e impulsándose hacia Saturno.

La masa de la sonda Cassini es tan grande que no fue posible emplear un vehículo de lanzamiento que la dirigiese directamente a Saturno. Para alcanzar este planeta fueron necesarias cuatro asistencias gravitacionales; de esta forma, Cassini empleó una trayectoria interplanetaria que la llevaría a Venus en dos ocasiones, posteriormente hacia la Tierra y después hacia Júpiter. Después de sobrevolar Venus en dos ocasiones a una altitud de 284 Km, el 26 de abril de 1998 y a 600 Km, el 24 de junio de 1999, el vehículo se aproximó a la Tierra, acercándose a 1171 Km de su superficie el 18 de agosto de 1999. Gracias a estas tres asistencias gravitacionales, Cassini adquirió el momento suficiente para dirigirse al Sistema Solar externo. La cuarta y última asistencia se llevaría a cabo en Júpiter, el 30 de diciembre de 2000, sobrevolándolo a una distancia de 9.723.890 Km, e impulsándose hacia Saturno.

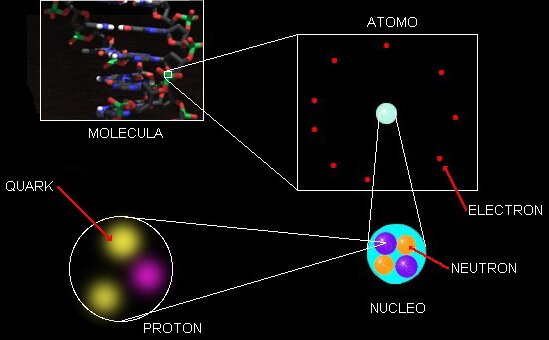

¿Que es el núcleo atómico?

El propio Rutherford empezó a vislumbrar la respuesta a la pregunta que arriba hacemos. Entre 1.906 y 1.908 (hace más de un siglo) realizó constantes experimentos disparando partículas alfa contra una lámina sutil de metal (como oro o platino), para analizar sus átomos. La mayor parte de los proyectiles atravesaron la barrera sin desviarse (como balas a través de las hojas de un árbol), pero no todos. Algunas de aquellas partículas no aparecían por ninguna parte, parecían que chocaban con algo sólido… ¿Qué sería?

Pero centrémonos en el trabajo que aquí se expone que se anuncia arriba como: Todo es Universo… ¡También nosotros!

El Universo lo es todo. El Espacio y el Tiempo, la Materia y las fuerzas que con ella interaccionan, las Constantes de la Naturaleza y todo ello, implica una serie de cuestiones de una complejidad inmensa que aún, no hemos podido resolver. La cantidad de teorías, de modelos, de experimentos y de posibilidades que están en marcha en los distintos campos del saber, son enormes, y, finalmente, todas deberán ser unidas en un solo y complementado conocimiento que nos lleve a ese entendimiento profundo de nuestro Universo como un todo que es, lo que podremos ver, trás unir las piuezas del rompecabezas con el que ahora estamos trabajando al dilucidar parcelas de esa inmensidad que no podemos abarcar con la vista y menos con el conocimiento, sólo la imaginación se acerca a ese todo que pretendemos construir.

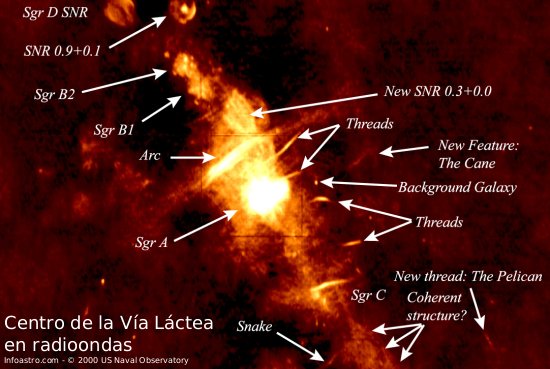

No podemos tener una imagen del Universo completo, es demasiado grande para que eso sea posible y sólo, pequeñas regiones del mismo podemos captar con nuestros telescopios que nos enseñan regiones más o menos lejanas del inmenso Cosmos. En cualquir parte que podamos mirar y observar, nos daremos cuenta de que las cosas que allí puedan pasar, son las mismas que pasan en otros lugares, toda vez que, el Universo se rige por leyes que actúan en todas partes de la misma manera. Muchos, desde hace mucho tiempo, pensaron en todas esas cuestiones.

Tales nació en la ciudad de Mileto en el año 639 a. de C. Fue el primero de los 7 sabios de Grecia y era matemático, geógrafo, pensador, astrónomo y astrólogo. Hijo de Examio e Cleóbula. Se marchó a Egipto para formarse con los sacerdotes del faraón en Geometría, astrología y física, allí aprendió cosas tan útiles como medir las pirámides por la longitud de la sombra. Era experto en astrosofía (algo que unía astronomía con filosofía) y que le daba el título de rudito en el más alto nivel. Se cuenta de él que, un día caminaba, de noche, observando las estrellas y cayó en un socabon que había en el suelo. Él fue el primero en dar al Agua la importancia que tiene para la vida.

Hoy trataré de dejar aquí una insignificante brizna de toda esa búsqueda, desesperada, por ese saber incansablemente perseguido por la especie humana que,deseosa de conocer todos aquellos misterios encerrados dentro de esa burbuja que llamamos Universo, no ha dejado, desde que Tales de Mileto desterró la mitología para emplear la lógica, de buscar el por qué del mundo, de los cielos y, en fin, de la Naturaleza. Claro que, desde aquel entonces hasta ahora, mucho es lo que nuestra curiosidad nos ha podido dar de ese saber que buscamos y del que no todos, hanestado siempre seguros de lograr.

Por ejemplo:

No olvidemos que, en el siglo XIX, algunos científicos declararon que la composición de las estrellas estaría siempre fuera del alcance del experimento, y, que la única manera que tendríamos de conocerlas sería la de mirar al cielo y verlas allí, inalcanzables como puntos de luz brillantes y lejanos en la oscuridad del vacío del cosmos.Sin embargo, podemos decir hoy, recien cumplida la primera década del siglo XXI, , que no solo podemos saber la composición de las estrellas, sino también como nacen, “viven” y mueren, las distancias que las separan de nosotros y un sin fin de datos más que el estudio y la investigación nos ha posibilitado descubrir.

Las estrellas del cielo, ¡tan lejanas! ¡tan misteriosas! que en las noches oscuras nos envían guiños de complicidad, como si trataran de decirnos alguna cosa, como si nos estuvieran llamando. Fue tanto el misterio que en nuestras mentes sembraron las estrellas que, no hemos parado ni un momento por saber, no sólo de qué estaban hechas, sino como surgen a la vida, como se desarrollan sus mecanismos, como mueren y en qué se convierten después. Sabemos que las estrellas son importantes en nuestras vidas hasta el punto de que, sin ellas, no podríamos estar aquí. Una de ellas, a la que llamamos Sol, nos envía su luz y su calor haciendo posible la vida en el planeta Tierra, otra antes que el Sol, hace seguramente muchos miles de millones de años, regó el espacio con su materia estelar y, pasado el tiempo, se condenso (ayudada por la Fuerza de Gravedad) en lo que hoy conocemos como el Sistema Solar.

Nada más cierto que lo que quiere simbolizar esa enorme imagen del Pensador. Es un fiel reflejo de lo que, a través de los tiempos, ha sido el SER Humano. Nunca hemos dejado ni dejaremos de pensar, en ello está nuestro futuro. A las pruebas de la Historia me remito.

Particularmente creo que el ser humano es capaz de realizar todo aquello en lo que piensa dentro de unos limites racionales.Podremos, en un futuro no muy lejano, alargar de manera considerable la media de vida.Podremos colonizar otros planetas (terraformarlos) y explotar recurso mineros en las lunas de nuestro sistema solar (las grandes compañias petroleras estarían encantadas en Titán), los turistas irán al planeta Marte o a las lunas Ganímedes o Europa.Los transportes de hoy serán reliquias del pasado y nos trasladaremos mediantes sistemas de transportes aéreos más limpios, rápidos y exentos de colisiones, sus modernos censores lo impedirán.Tendremos computadoras de cifrado cuántico que harán más seguras las comunicaciones y el intercambio de datos será realmente el de la velocidad de c, y así en todos los campos del saber humano.

En el nombre “Internet del Futuro” se asocian una serie de conceptos y tecnologías que abarcan desde la infraestructura de red, dispositivos e interfaces, software y aplicaciones que compondrán el que en unos años conformará el panorama de las Tecnologías de Información y Comunicaciones.

Entre estos temas, aparece la red de redes de gran velocidad y llegando a todas partes, mediante nuevos dispositivos, con nuevas formas de interaccionar con el mundo digital, acceso fácil e inteligente los diferentes tipos de contenidos con mención especial a 3D, y todo ello soportado por innovadores modelos de negocio adaptados a este nuevo panorama.

A los jóvenes no hay que convencerles de que Internet es imprescindible. El futuro para ellos es ya hoy. Una reciente encuesta pone de relieve la enorme vocación juvenil de tomar la red como bandera generacional. De hecho ellos, los jóvenes lo van a construir y modelar a su gusto y, probablemente, el Internet del futuro poco se parecerá al Internet que conocemos hoy. Alguien ha dicho: “Hoy, Internet está en su Prehistoria”. Lleva toda la razón

Estamos inmersos en un avance exponencial, imparable.

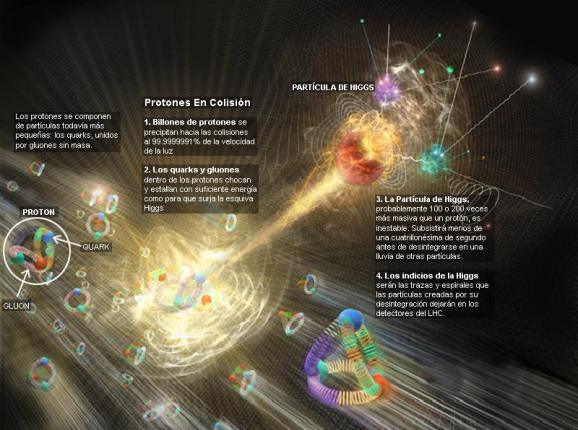

Se podría decir que, gracias a los Aceleradores de Partículas, podemos jugar con los átomos para mirar en su interior y saber, de qué está hecha la Materia que nos confroma a nosotros, a las estrellas y a los mundos de las galaxias del Universo.

Otro ejemplo de una idea “inverificable” la tenemos en la existencia del átomo.En el siglo XIX, la hipótesis atómica se reveló como el paso decisivo en la comprensión de las leyes de la química y la termodinámica.Sin embargo, muchos físicos se negaban a creer que los átomos existieran realmente, los aceptaban como un concepto o herramienta matemática para operar en su trabajo que, por accidente, daba la descripción correcta del mundo.Hoy somos todavía incapaces de tomar imágenes directas del átomo debido al principio de incertidumbre de Heisemberg, aunque ahora existen métodos indirectos.En 1.905, Einstein proporcionó la evidencia más convincente, aunque indirecta, de la existencia de átomos cuando demostró que el movimiento browniano (es decir, el movimiento aleatorio de partículas de polvo suspendidas en un líquido) puede ser explicado como colisiones aleatorias entre las partículas y los átomos del líquido.

Ejemplo en el que se observa la variación de los valores de la dimensión de masa y de la dimensión del contorno calculada por el método del compás en los siguientes DLA.

Otra posibilidad de crecimiento DLA es el vertical. Las partículas se lanzan desde lo alto y las partículas fijas se sitúan en el fondo del recipiente. Se puede observar en la siguiente figura como cuando una formación sobresale, las de sus lados dejan de crecer. Esto es debido a que las más grandes absorben los recursos de las más pequeñas e impiden su crecimiento, fenómenoque se da en la naturaleza cuando un árbol grande impide que crezcan los que están a su alrededor quitándoles los recursos de luz, agua…

Por analogía, podríamos esperar la confirmación experimental de la física de la décima dimensión utilizando métodos indirectos que aún ni se han inventado o descubierto.En lugar de fotografiar el objeto que deseamos, quizá nos conformaríamos, de momento, con fotografiar la “sombra” del mismo.

Bueno, con la imagen de la sombra podemos tener una idea, bastante acertada de la imagen original, el movimiento lo delata

También la existencia de los neutrinos, propuestos por Wolfgang Pauli en 1.930, para dar cuenta de la energía perdida en ciertos experimentos sobre radiactividad que parecían violar la conservación de la materia y la energía, también digo, era inverificable (en aquel momento).Pauli comprendió que los neutrinos serían casi imposibles de observar experimentalmente, porque interaccionarían muy débilmente y, por consiguiente muy raramente con la materia.La materia, toda la materia, si profundizamos en ella a niveles microscópicos, podremos comprobar el hecho de que, en un 99% está constituida de espacios vacíos y, siendo así, los neutrinos pueden atravesarla sin rozar siquiera sus átomos, de hecho, pueden atravesar la Tierra como si ni siquiera existiera y, al mismo tiempo, también nosotros somos atravesados continuamente por billones de neutrinos emitidos por el sol, incluso por la noche.

Unos quieren pesar planetas y otros neutrinos pero, todos quieren saber sobre los misterios del Universo

Hablando de neutrinos recuerdo cuando el experimento Opera de los neutrinos pusiera en tela de juicio la teoría de Einstein, la medición de la luz proveniente de las galaxias confirmaron por primera vez a escala cósmica la teoría de la relatividad del genio físico.Sin embargo, no en una, sino en varias ocasiones han querido quitarle al bueno de Einstein el honor de haber marcado el límite de velocidad en nuestro Universo

Pauli admitió: ”He cometido el pecado más grave, he predicho la existencia de una partícula que nunca puede ser observada”. Él predijo la existencia del neutrino para explicar “la masa perdida” en procesos de desintegración.

Pero incluso Pauli, con todos sus enormes conocimientos, se equivocaba, y el neutrino ha sido comprobado mediante distintos métodos que no dejan dudas de su existencia. Incluso producimos regularmente haces de neutrinos en colisionadores de átomos, realizamos experimentos con los neutrinos emitidos por reactores nucleares y, detectamos su presencia en enormes depósitos de agua pesada colocados en profundas minas abandonadas en las entrañas de la Tierra. Cuando una espectacular supernova de iluminó en el cielo del hemisferio sur en 1.987, los físicos registraron una ráfaga de neutrinos que atravesaron sus detectores situados, precisamente, en profundas minas.

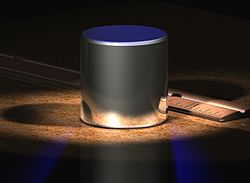

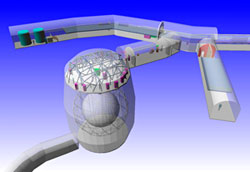

El Enorme recipiente lleno de agua pesada (SNOLSB), delatará a los neutrinos que lo atraviesen.

Dentro de una antigua mina de Sudbury (Ontario, Canadá) está ubicado el complejo de investigación astrofísica SNOLAB. Una de sus instalaciones es el Observatorio de Neutrinos (ONS, en la imagen). Los neutrinos son partículas subatómicas con una masa tan ínfima —se ha calculado que menos de una milmillonésima parte de la masa de un átomo de hidrógeno— que pueden atravesar la materia ordinaria sin apenas perturbarla. La materia está “compuesta” en su mayor parte de vacío aunque nuestros ojos y nuestro cerebro (en primera instancia) no lo interpreten así.

Para evitar la interferencia de otras partículas cósmicas este peculiar observatorio no está situado en la superfície, sino nada menos que a dos kilómetros de profundidad en el interior de la corteza terrestre. La instalación ONS es básicamente un “cazador de neutrinos” capaz de detectar estas partículas producidas por las reacciones de fusión en el interior Sol y así poder analizar la composición del núcleo de nuestra estrella. La cubierta acrílica del ONS contiene un kilotón (1.000 toneladas) de agua pesada (D2O) que al reaccionar con los neutrinos hacen que se produzcan unos azulados destellos de radiación o luz Cherenkov, llamada así en honor del destacado miembro de la Academia de Ciencias de la Unión Soviética Pável Alekséyevich Cherenkov (1904-1990), Premio Nobel de Física de 1958 por el descubrimiento e interpretación de este fenómeno. El primer detector orbital de partículas de estas características —Detector Cherenkov— fue uno de los equipos científicos instalados en el satélite Sputnik-3, lanzado por la URSS el mismo año en que Cherenkov recibiera el Nobel.

Si hablamos de la masa de Planck, lo hacemos de la masa de una partícula cuya longitud de onda Compton es igual a la Longitud de Planck, está dada por la ecuación de arriba, donde tenemos la constante de Planck racionalizada (la h cortada con ese palito arriba), c que es la velocidad de la luz y G la constante gravitacional, la descripción de una partícula elemental de esta masa.o partículas que interacionan con energías por partículas equivalentes a ellas a través de E = mc2, requiere una teoría cuántica de la Gravedad. Como la masa de Planck es del orden de 10-8 kg (equivalente a una energía de 1019 GeV) y, por ejemplo, la masa del protón es del ordende 10-27 Kg y las mayores energías alcanzables en nuestros aceleradores de partículas actuales son de un orden (aún pequeño) los efectos de gravitación cuántica no aparecen en los laboratorios de física de partículas. Sin embargo, en el universo primitivo se cree quen las partículas tenían ejnergías del orden de la energía de Planck (representada en la ecuación de abajo) que sería la energía necesaria para llegar hasta las cuerdas.

![[energia_de_Planck.png]](http://4.bp.blogspot.com/_js6wgtUcfdQ/SoRBCBYB-xI/AAAAAAAAG4Y/xVWzNgLGads/s1600/energia_de_Planck.png)

Echando una larga mirada a la historia de la ciencia, creo que existen motivos para un moderado optimismo. Witten está convencido de que la ciencia sería algún día capaz de sondear hasta las energías de Planck.

E. Witten, padre de la versión más avanzada de la teoría de supercuerdas, la teoría M, dice:

“No siempre es tan fácil decir cuáles son las preguntas fáciles y cuáles las difíciles.En el S.XIX, la pregunta de por qué el agua hierve a 100 grados era desesperadamente inaccesible.Si usted hubiera dicho a un físico del siglo XIX que hacia elS. XX sería capaz de calcularlo, le habría parecido un cuento de hadas…. La teoría cuántica de campos es tan difícil que nadie la creyó completamente durante veinticinco años.”

Lo mismo que otros muchos, no creo que tengamos que esperar un siglo antes de que nuestro ingenio y nuestras máquinas puedan sondear de manera indirecta la décima dimensión, alguien sabrá, durante ese periodo de tiempo, resolver esa teoría de campos de cuerdas o alguna otra formula no perturbativa.El problema es teórico, no experimental.Necesitamos alguien con el ingenio y la inteligencia necesaria (además de un enorme índice de observación), para saber “ver” lo que probablemente tenemos ante nuestras narices, utilizando para ello todos los datos e indicios existentes de gente como Einstein, Kaluza y Klein, Veneziano y Suzuki, el cuarteto de cuerdas de Princeton, Michio Kaku, Witten…, y tantos otros.

Suponiendo que algún físico brillante resuelva la teoría de campos de cuerdas y derive las propiedades conocidas de nuestro Universo, sigue existiendo el problema practico de cuándo seríamos capaces de aprovechar el poder de la teoría del hiperespacio.Existen dos posibilidades:

- Esperar que nuestra civilización alcance la capacidad para dominar energías millones de veces mayores que las de hoy.

- Encontrar civilizaciones extraterrestres que, más avanzadas, hayan dominado el arte de manipular el Hiperespacio.

Pero, si no son como esta…¡Mejor!

Antes de que Edison (robara las ideas de Tesla) y con sus otros colaboradores aprovecharan los descubrimientos de Faraday y las ecuaciones de Maxwell, sobre la electricidad y el magnetismo, para explotarlos de manera práctica, pasaron unos setenta años.

La civilización moderna depende crucialmente del aprovechamiento de esta fuerza.La fuerza nuclear fue descubierta casi con el cambio de siglo, pasó todo el siglo XX y estamos en la primera década del XXI, han pasado 100 años, y, sin embargo, todavía no tenemos medios de aprovecharla con éxito en reactores de fusión, la energía limpia que produce el Sol.

El próximo paso, el aprovechar la potencia de la teoría de campo unificado, requiere un salto mucho mayor en nuestra tecnología, aunque sea un salto que probablemente tendrá implicaciones muchísimo más importantes.

El problema reside en que obligamos a la teoría de supercuerdas a responder preguntas sobre energías cotidianas, cuando su “ámbito natural” está en la energía de Planck.Energía que sólo fue liberada en el propio instante de la creación.Es decir, la teoría de supercuerdas es una teoría de la propia creación, así nos puede explicar todas las partículas y la materia, las fuerzas fundamentales y el espacio-tiempo, es decir, es la teoría del propio Universo.

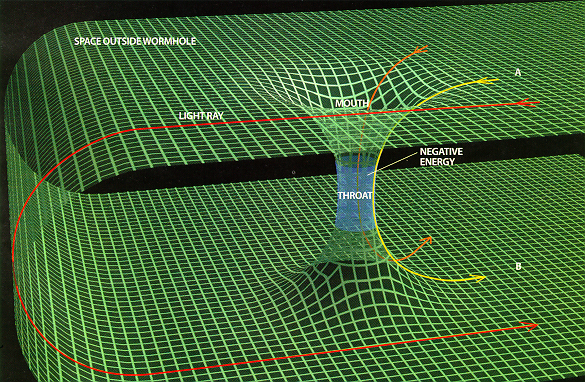

El dolor de cabezas que nos causa pensar en el espacio-tiempo y en el cómo podemos desplazarnos por él a grandes distancias de tiempo y también de espacio. ¿Se conseguirá alguna vez? ¿Será cierto que existen los Agujeros de Gusano? ¿Podremos alguna vez construir naves que surquen el Hiperespacio hacia otras galaxias y otros mundos?

Durante estos comentarios, frecuentemente he reseñado la palabra “espacio-tiempo” refiriéndome a una geometría que incluye las tres dimensiones espaciales y una cuarta dimensión temporal.En la física newtoniana, el espacio y el tiempo se consideraban como entidades separadas y el que los sucesos fueran simultáneos o no era una materia que se consideraba como obvia para cualquier observador capacitado.

En el concepto de Einstein del universo físico, basado en el sistema de geometría inventada por H. Minkowski (1864-1909), el espacio y el tiempo estaban considerados como enlazados, de manera que dos observadores en movimiento relativo podían estar en desacuerdo sobre la simultaneidad de sucesos distantes.En la Geometría de Minkowski (inspirada a partir de la teoría de la relatividad especial de Einstein), un suceso se consideraba como un punto de universo en un continuo de cuatro dimensiones.

Pero volvamos a las supercuerdas.El problema fundamental al que se enfrenta esta teoría es este: de los millones de universos posibles que pueden ser generados matemáticamente por la teoría de supercuerdas, ¿cuál es el correcto? Como ha dicho David Gross:

“Existen millones y millones de soluciones con tres dimensiones espaciales. Existe una enorme abundancia de soluciones clásicas posibles… Esta abundancia de riqueza era originalmente muy satisfactoria porque proporcionaba evidencia de que una teoría como la de la cuerda heterótica podía tener un aspecto muy parecido al mundo real. Estas soluciones, además de tener cuatro dimensiones espacio-temporales, tenían otras muchas propiedades que se asemejaban a nuestro mundo: el tipo correcto de partículas tales como quarks y Leptones, y el tiempo correcto de interacciones… Esto constituyó una fuente de excitación en su momento.”

Es difícil escenificar lo que las supercuerdas son, nunca nadie pudo ver ninguna.

Gross, sin embargo, advierte que aunque alguna de estas soluciones están muy próximas al modelo estándar, otras dan lugar a propiedades físicas muy embarazosas e indeseables, lo que finalmente se traduce en una auténtica incomodidad o problema, ya que tenemos muchas soluciones pero ninguna forma aceptable de escoger entre ellas.Además algunas tienen propiedades deseadas y otras potencialmente desastrosas.

Un profano, al oir esto por primera vez, puede quedar intrigado para preguntar: ¿por qué no calcular simplemente que solución se adapta o prefiere la cuerda? Puesto que la teoría de cuerdas es una teoría bien definida, parece enigmático que los físicos no puedan calcular la respuesta.

Lo único seguro es que los físicos seguirán trabajando a la búsqueda de la solución que, más pronto o más tarde, llegará.

Efecto túnel a través del espacio y del tiempo

¡Extraña mecánica cuántica!

Estaría bien poder saber como un electrón, cuando absorbe un fotón, desaparece del lugar que ocupa y, de manera instántanea, aparece en otro lugar más ener´getico sin haber recorrido la distancia que separa ambos lugares, es el efecto túnel o salto cuántico. ¿Cuánto podríamos ganar si aprendiéramos como se hacer eso?

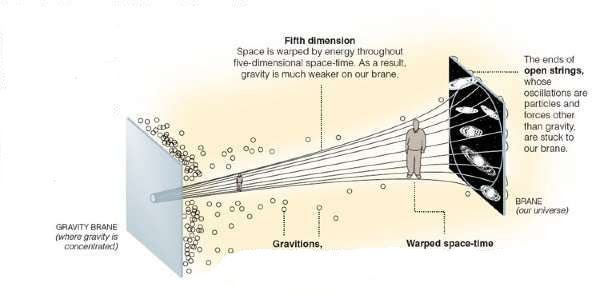

En definitiva, estamos planteando la misma cuestión propuesta por Kaluza, cuando en 1.919, escribió una carta a Einstein proponiéndole su teoría de la quinta dimensión para unificar el electromagnetismo de James Clark Maxwell y la propia teoría de la relatividad general. ¿Dónde está la quinta dimensión?, pero ahora en un nivel mucho más alto.Como Klein señaló en 1.926, la respuesta a esta cuestión tiene que ver con la teoría cuántica.Quizá el fenómeno más extraordinario (y complejo) de la teoría cuántica es el efecto túnel.

El efecto túnel se refiere al hecho de que los electrones son capaces de atravesar una barrera al parecer infranqueable hacia una región que estaría prohibida si los electrones fuesen tratados como partículas clásicas.El que haya una probabilidad finita de que un electrón haga un túnel entre una región clásicamente permitida a otra que no lo está, surge como consecuencia de la mecánica cuántica.El efecto es usado en el diodo túnel.La desintegración alfa es un ejemplo de proceso de efecto túnel.

Antes preguntábamos, en relación a la teoría de Kaluza – Klein, el destino o el lugar en el que se encontraba la quinta dimensión.

El profesor Teodor Kaluza nos hablaba de la Quinta Dimensión que unificaba la Relatividad de Einstein con la Teoría de Maxwell. Todo en cinco dimensiones…Ahí comenzó toda la historia que después, desembocaron enm las supersimetrías, supergravedad, cuerdas y supercuerdas, cuerda heteráotica y teoría M…¿Qué vendrá después?

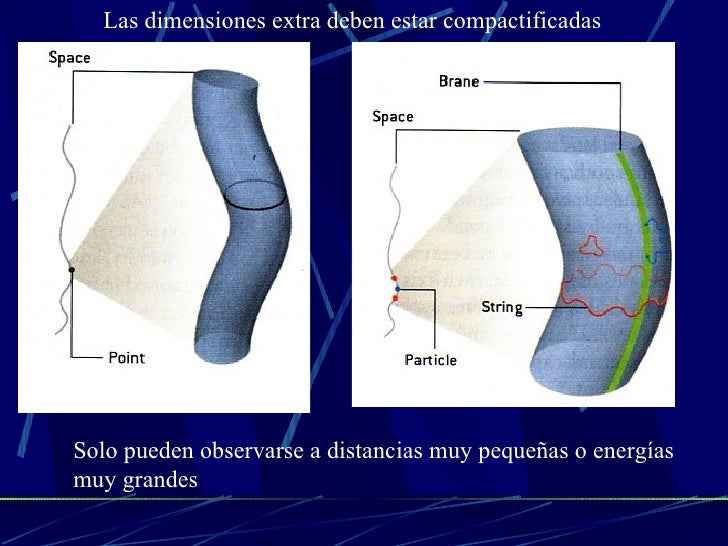

La respuesta de Klein a esta pregunta fue ingeniosa al decir que estaba enrollada o compactada en la distancia o límite de Planck, ya que, cuando comenzó el Big Bang, el Universo se expandió sólo en las cuatro dimensiones conocidas de espacio y una de tiempo, pero esta dimensión no fue afectada por la expansión y continua compactada en Lp=√(Għ/c3),cuyo valor es del orden de 10-35 metros, distancia que no podemos ni tenemos medios de alcanzar, es 20 ordenes de magnitud menor que el protón que está en 10 con exponente -15 metro.

Pues las dimensiones que nos faltan en la teoría decadimensional, como en la de Kaluza – Klein, también están compactada en una recta o en un círculo en esa distancia o límite de Planck que, al menos por el momento, no tenemos medios de comprobar dada su enorme pequeñez menor que un protón.

¿Cómo pueden estar enrolladas unas dimensiones?

Bueno, igual que para explicar de manera sencilla la gravedad mediante el ejemplo de una sábana estirada por los 4 extremos, en la que ponemos un enorme peso en su centro y se forma una especie de hondonada que distorsiona la superficie antes lisa de la sábana, al igual que un planeta distorsiona el espacio a su alrededor, de manera tal que cualquier objeto que se acerca a la masa del objeto pesado, se ve atraído hacia él.Pues bien, en las dimensiones de espacio enrolladas, utilizamos el símil de la sábana con bandas elásticas en las esquinas.

La sábana que tenemos es pequeña y la cama es grande.Con esfuerzo logramos encajar las cuatro esquinas, pero la tensión es demasiado grande; una de las bandas elásticas salta de una esquina, y la sábana se enrolla. Este proceso se llama ruptura de simetría.La sábana uniformemente estirada posee un alto grado de simetría.La sábana se enrolla.Se puede girar la cama 180º alrededor de cualquier eje y la sábana permanece igual.Este estado altamente simétrico se denomina falso vacío.Aunque el falso vacío aparece muy simétrico, no es estable. La sábana no quiere estar en esta condición estirada. Hay demasiada tensión y la energía es demasiado alta.Pero, la sábana elástica salta y se enrolla.La simetría se rompe, y la sábana pasa a un estado de energía más baja con menor simetría. Si notamos la sábana enrollada 180º alrededor de un eje ya no volvemos a tener la misma sábana.

Reemplacemos ahora la sábana por el espacio-tiempo decadimensional, es espacio-tiempo de simetría definitiva.En el comienzo del tiempo, el universo era perfectamente simétrico.Si alguien hubiera estado allí en ese instante, podría moverse libremente y sin problemas por cualquiera de las diez dimensiones. En esa época la Gravedad y las fuerzas débiles y fuertes y electromagnéticas estaban todas ellas unificadas por la supercuerda.Sin embargo, esta simetría no podía durar.El Universo decadimensional, aunque perfectamente simétrico, era inestable, la energía existente muy alta, exactamente igual que la sábana, estaba en un falso vacío. Por lo tanto, el paso por efecto túnel hacia un estado de menor energía era inevitable. Cuando finalmente ocurrió el efecto túnel, tuvo lugar una transición de fase y se perdió la simetría.

La imaginación no tiene límites y, la Naturaleza tampoco

Puesto que el Universo empezó a dividirse en un Universo de cuatro y otro de seis dimensiones, el universo ya no era simétrico. Seis dimensiones se habían enrollado (como la sábana elástica).Pero nótese que la sábana puede enrollarse de cuatro maneras, dependiendo de qué esquina haya saltado.Para el universo decadimensional, sin embargo, existen aparentemente millones de modos de enrollarse.Para calcular que estado prefiere el Universo decadimensional, necesitamos resolver la teoría de campos de cuerdas utilizando la teoría de transiciones de fase, el problema más difícil en la teoría cuántica.

Las transiciones de fase no son nada nuevo. Trasladémoslo a nuestras propias vidas.En un libro llamado PASAJES, el autor, Gail Sheehy destaca que la vida no es un flujo continuo de experiencias, como parece, sino que realmente pasa por varios estadios, caracterizados por conflictos específicos que debemos resolver y por objetivos que debemos cumplir.

El psicólogo Eric Ericsson llegó a proponer una teoría de estadios psicológicos del desarrollo.Un conflicto fundamental caracteriza cada fase.Si este conflicto no queda resuelto, puede enconarse e incluso provocar una regresión a un periodo anterior.Análogamente, el psicólogo Jean Piaget demostró que el desarrollo mental de la primera infancia tampoco es un desarrollo continuo de aprendizaje, sino que está realmente caracterizado por estadios discontinuos en la capacidad de conceptualización de un niño.Con un mes de edad, un niño puede dejar de buscar una pelota una vez que ha rodado fuera de su campo de visión.Sin comprender que la pelota existe aunque no la vea.Al mes siguiente, esto resultará obvio para el niño.

¡Siempre aprendiendo! Jugando comenzamos a conocer cómo es el mundo.

Esta es la esencia de la dialéctica.Según esta filosofía, todos los objetos (personas, gases, estrellas, el propio Universo) pasan por una serie de estadios.Cada estadio está caracterizado por un conflicto entre dos fuerzas opuestas.La naturaleza de dicho conflicto determina, de hecho, la naturaleza del estadio.Cuando el conflicto se resuelve, el objeto pasa a un objetivo o estadio superior, llamado síntesis, donde empieza una nueva contradicción, y el proceso pasa de nuevo a un nivel superior.

Los filósofos llaman a esto transición de la “cantidad” a la “cualidad”.Pequeños cambios cuantitativos se acumulan hasta que, eventualmente, se produce una ruptura cualitativa con el pasado.Esta teoría se aplica también a las sociedades o culturas.Las tensiones en una sociedad pueden crecer espectacularmente, como la hicieron en Francia a finales del siglo XVIII.Los campesinos se enfrenaban al hambre, se produjeron motines espontáneos y la aristocracia se retiró a sus fortalezas.Cuando las tensiones alcanzaron su punto de ruptura, ocurrió una transición de fase de lo cuantitativo a los cualitativo: los campesinos tomaron las armas, tomaron Paris y asaltaron la Bastilla.

Parece que el “vacio” está bastante lleno de cosas…que no llegamos a comprender.

Las transiciones de fases pueden ser también asuntos bastante explosivos.Por ejemplo, pensemos en un río que ha sido represado.Tras la presa se forma rápidamente un embalse con agua a enorme presión Puesto que es inestable, el embalse está en el falso vacío.El agua preferiría estar en su verdadero vacío, significando esto que preferiría reventar la presa y correr aguas abajo, hacia un estado de menor energía.Así pues, una transición de fase implicaría un estallido de la presa, que tendría consecuencias desastrosas.

También podría poner aquí el ejemplo más explosivo de una bomba atómica, donde el falso vacío corresponde al núcleo inestable de uranio donde residen atrapadas enormes energías explosivas que son un millón de veces más poderosas, para masas iguales, que para un explosivo químico.De vez en cuando, el núcleo pasa por efecto túnel a un estado más bajo, lo que significa que el núcleo se rompe espontáneamente.Esto se denomina desintegración radiactiva.Sin embargo, disparando neutrones contra los núcleos de uranio, es posible liberar de golpe esta energía encerrada según la formula de Einstein E=mc2, por supuesto, dicha liberación, es una explosión atómica ¡menuda transición de fase!

Una transición de fase que perseguimos, es dominar la Galaxia, poder moldearla con nuestras manos, y, si eso llega a ser posible alguna vez, seremos los señores del Hiperespacio.Para entonces, los misteriosos agujeros negros no tendrán secretos para nosotros, las energías perdidas tampoco y…los viajes en el tiempo, serán cosa cotidiana. ¿Será realidad algún día ese pensamiento?

Las nuevas características descubiertas por los científicos en las transiciones de fases es que normalmente van acompañadas de una ruptura de simetría.Al premio Nobel Abdus Salam le gusta la ilustración siguiente: consideremos una mesa de banquete circular, donde todos los comensales están sentados con una copa de champán a cada lado.Aquí existe simetría.Mirando la mesa del banquete reflejada en un espejo, vemos lo mismo: cada comensal sentado en torno a la mesa, con copas de champán a cada lado.Asimismo, podemos girar la mesa de banquete circular y la disposición sigue siendo la misma.

Rompamos ahora la simetría.Supongamos ahora que el primer comensal toma la copa que hay a su derecha.Siguiendo la pauta, todos los demás comensales tomaran la copa de champán de su derecha.Nótese que la imagen de la mesa del banquete vista en el espejo produce la situación opuesta.Cada comensal ha tomado la copa izquierda.De este modo, la simetría izquierda-derecha se ha roto.

Así pues, el estado de máxima simetría es con frecuencia también un estado inestable, y por lo tanto corresponde a un falso vacío.

Con respecto a la teoría de supercuerdas, los físicos suponen (aunque todavía no lo puedan demostrar) que el universo decadimensional original era inestable y pasó por efecto túnel a un universo de cuatro y otro de seis dimensiones.Así pues, el universo original estaba en un estado de falso vacío, el estado de máxima simetría, mientras que hoy estamos en el estado roto del verdadero vacío.

Al principio, cuando el Universo era simétrico, solo existía una sola fuerza que unificaba a todas las que ahora conocemos, la gravedad, las fuerzas electromagnéticas y las nucleares débil y fuerte, todas emergían de aquel plasma opaco de alta energía que lo inundaba todo.Más tarde, cuando el Universo comenzó a enfriarse, se hizo transparente y apareció la luz, las fuerzas se separaron en las cuatro conocidas, emergieron las primeras quarks para unirse y formar protones y neutrones, los primeros núcleos aparecieron para atraer a los electrones que formaron aquellos primeros átomos.Doscientos millones de años más tarde, se formaron las primeras estrellas y Galaxias. Con el paso del tiempo, las estrellas sintetizaron los elementos pesados de nuestros cuerpos, fabricados en supernovas que estallaron, incluso antes de que se formase el Sol.Podemos decir, sin temor a equivocarnos, que una supernova anónima explotó hace miles de millones de años y sembró la nube de gas que dio lugar a nuestro sistema solar, poniendo allí los materiales complejos y necesarios para que algunos miles de millones de años más tarde, tras la evolución, apareciéramos nosotros.

Las estrellas evolucionan desde que en su núcleo se comienza a fusionar Hidrógeno en Helio, de los elementos más ligeros a los más pesados.Avanza creando en el Horno termonuclear, cada vez, metales y elementos más pesados.Cuando llega al hierro y explosiona en la forma explosiva deuna super nova.Luego, cuando este material estelar es otra vez recogido en una nueva estrella rica en hidrógeno, al ser de segunda generación (como nuestro Sol), comienzo de nuevo el proceso de fusión llevando consigo materiales complejos de aquella supernova.

Puesto que el peso promedio de los protones en los productos de fisión, como el cesio y el kripton, es menor que el peso promedio de los protones de uranio, el exceso de masa se ha transformado en energía mediante E=mc2.Esta es la fuente de energía que subyace en la bomba atómica.

Restos de Hipernova que produce cambios hacia el futuro del Universo

Así pues, la curva de energía de enlace no solo explica el nacimiento y muerte de las estrellas y la creación de elementos complejos que también hicieron posible que nosotros estemos ahora aquí y, muy posiblemente, será también el factor determinante para que, lejos de aquí, en otros sistemas solares a muchos años – luz de distancia, puedan florecer otras especies inteligentes que, al igual que la especie humana, se pregunten por su origen y estudien los fenómenos de las fuerzas fundamentales del Universo, los componentes de la materia y, como nosotros, se interesen por el destino que nos espera en el futuro.

Cuando alguien oye por vez primera la historia de la vida de las estrellas, generalmente (lo sé por experiencia), no dice nada, pero su rostro refleja escepticismo. ¿Cómo puede vivir una estrella 10.000 millones de años? Después de todo, nadie ha vivido tanto tiempo como para ser testigo de su evolución.

Sin embargo, tenemos los medios técnicos y científicos para saber la edad que tiene, por ejemplo, el Sol.

El Sol que nos da la vida con su luz y su calor

Nuestro Sol, la estrella alrededor de la que giran todos los planetas de nuestro Sistema Solar (hay que eliminar a Plutón de la lista, ya que, en el último Congreso Internacional, han decidido, después de más de 20 años, que no tiene categoría para ser un planeta), la estrella más cercana a la Tierra (150 millones de km=UA), con un diámetro de 1.392.530 km, tiene una edad de 4.500 millones de años.

Es tal su densidad, es tal su enormidad que, como se explicó en otro ensayo anterior de este mismo trabajo, cada segundo, transforma por medio de fusión nuclear, 4.654.000 Toneladas de Hidrógeno en 4.650.000 Toneladas de Helio, las 4.000 toneladas restantes, son lanzadas al espacio exterior en forma de luz y calor de la que, una parte nos llega a la Tierra y hace posible la vida. Se calcula que al Sol le queda material de fusión para otros 4.500 millones de años.Cuando transcurra dicho periodo de tiempo, se convertirá en una gigante roja, eyectará sus materiales exteriores al espacioy se transformará finalmente en una estrella enana blanca.Para entonces, ya no podremos estar aquí.

Cuándo mentalmente me sumerjo en las profundidades inmensas del Universo que nos acoge, al ser consciente de su enormidad, veo con claridad meridiana lo insignificante que somos, en realidad, en relación al universo, como una colonia de bacterias que habitan en una manzana, allí tienen su mundo, lo más importante para ellas, y no se paran a pensar que puede llegar un niño que, de un simple puntapié, las envíe al infierno.

Sólo somos importantes a nivel local, pretendemos serlo a otros niveles pero, ¿será posible eso?

Igualmente, nosotros nos creemos importantes dentro de nuestro cerrado y limitado mundo en el que, de momento, estamos confinados.Podemos decir que hemos dado los primeros pasos para dar el salto hacia otros mundos, pero aún nos queda un largo recorrido por delante.

Tendremos que dominar la energía del Sol, ser capaces de fabricar naves espaciales que sean impenetrables a las partículas que a cientos de miles de trillones circulan por el espacio a la velocidad de la luz, poder inventar una manera de imitar la gravedad terrestre dentro de las naves para poder hacer la vida diaria y cotidiana dentro de la nave sin estar flotando todo el tiempo, y, desde luego, buscar un combustible que procure velocidades relativistas, cercanas a c, ya que, de otra manera, el traslado por los mundos cercanos se haría interminable.Finalmente, y para escapar del sistema solar, habría que buscar la manera de romper la barrera de la velocidad de la luz.

¿Viajar en el tiempo?

Nuestra imaginación sólo es comparable a la inmensidad del Universo. Ahí radica nuestra verdadera riqueza. La curiosidad del SER humano le empuja de manera irremediable hacia su destino en las estrellas.

emilio silvera

Sep

3

Llega el futuro y las cosas nuevas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Nanotecnología ~

Clasificado en Nanotecnología ~

Comments (0)

Comments (0)

Y recordar… ¡Tántas cosas!

Las galaxias; Pequeños universos creadores de mundos y vida

En todas ellas existen mundos que, ¡quién sabe lo que contendrán?

Una investigación ha desarrollado una nueva estructura cuántica capaz de emitir fotones individuales de color rojo. El avance, que se publica en la revista Nature Materials, se basa en el confinamiento cuántico que se genera en uno de los puntos y que les permite modular la energía de la luz que emiten.

En trabajo han participado investigadores de la Universidad de Zaragoza, el Institut de Recerca en Energia de Catalunya (IREC), la Universidad de Barcelona y del Instituto de Ciencia de Materiales de Barcelona del CSIC. El investigador Jordi Arbiol de este último explica:

“El resultado final son hilos unidimensionales, de tamaño nanométrico, compatibles con la tecnología electrónica actual, que permitirían crear dispositivos a mayor escala con un control total de la emisión de luz, fotón a fotón”.

Pero centrémonos en el que aquí se prenta hoy y que comienza hablando de los…

Los Nanohilos abrirán las puertas al ordenador cuántico

No sólo las moléculas, los Nanotubos o el grafeno son las apuestas para sustituir al silicio. Otros elementos como los Nanohilos fabricados a partir de materiales semiconductores o los Nanohilos metálicos tendrán también cierto protagonismo. En concreto, los Nanohilos semiconductores presentan un gran potencial como transistores pero también presentan aplicaciones en campos como octoelectrónica o en la fabricación de censores biológicos. Por otro lado los Nanohilos metálicos, cuya síntesis controlada es más difícil, poseen gran interés como interconectores. En el caso de los Nanohilos formados de materiales Ni, Co o Fe se aprovechar también su potencial comportamiento magnetorresisitivo para ser usados en dispositivos de almacenamiento magnético. Los Nanohilos metálicos son interesantes a su vez porque los efectos de tamaño inducen en ellos la aparición de transiciones de fase martensíticas y la aparición de configuraciones no cristalinas.” Veamos que pasa con las Nanopartículas.

Nanopartículas

Quizás, junto a los nanotubos de carbono, las nanopartículas representan los materiales que tienen una repercución tecnológica más inmediata. Además de sus propiedades intrínsecas, las nanopartículas representan los materiales que tienen una repercusión tecnológica más inmediata. Además de sus propiedades intrínsecas, las nanopartículas, debido a su pequeño tamaño, pueden convertirse en diminutos dispositivos capaces de realizar otras funciones, transportar un medicamento específico por el torrente sanguíneo sin obstruirlo. Para lograr esto, las nanopartículas deben ser el soporte de capas de moléculas autoensambladas que confieren una funcionalidad adicional a las mismas.

Como su propio nombre indica, el término “nanopartícula” designa una agrupación de átomos o moléculas que dan lugar a una partícula con dimensiones nanométricas. Es decir, que su tamaño está comprendido entre 1 y 100 nm. Dependiendo de cuáles sean los átomos o moléculas que se agrupan se originarán diferentes tipos de nanopartículas. Así, por ejemplo, tendremos nanopartículas de oro, de plata o nanopartículas magnéticas si están formadas por átomos de Fe o Co. Su pequeño tamaño hace que la relación superficie/volumen crezca y por tanto que estas estructuras tengan unas propiedades características y esencialmente distintas a las que presenta el material en volumen.

En la Naturaleza todo es posible

Una estrategia la formación de nanopartículas es recubrirlas con distintas capas de manera tal que cada una aporte funcionalidades diferentes al sistema. Así, por ejemplo, recientemente se han descrito nanopartículas cuyo interior está formado por un material magnético, como el Co, seguido de una capa intermedia de SiO2 que aporta estabilidad al sistema y finalmente una superficie de oro.

El tamaño final de la nanopartícula es de 3 nm, y estructura laminar hace que tengan un núcleo magnético que posibilite su guiado, y una superficie de oro que facilite el autoensamblado de moléculas orgánicas o biológicas para diferentes aplicaciones. Entre éstas destaca su uso como biosensores. Para ello se inmoviliza material biológico, como ácido desoxirribonucleico (ADN) o el llamado ácido nucléico péptidico (PNA, del inglés peptide nucleic acid), que siendo un ácido nucléico artificial, presenta un “esqueleto” molecular formado por enlaces peptidicos y una estructura de bases nucleicas exactamente igual a la del ADN. El PNA puede reconocer cadenas complementarias de ADN, incluso con mayor eficiencia para la hibridación que la que representa el ADN para reconocer su hebra complementaria. Por este motivo, el PNA se ha propuesto como sonda para la fabricación de biosensores altamente eficientes. Estas macromoléculas unidas a superficies o nanopartículas son capaces de detectar diferentes analítos de interés, particularmente otars moléculas biológicas.

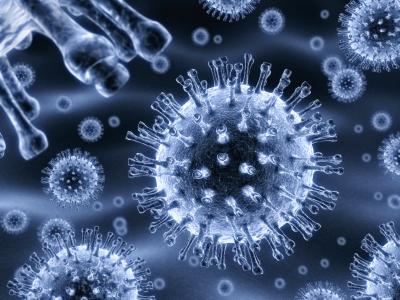

Sin embargo, el concepto de nanopartícula debe concebirse en un sentido más amplio ya que no sólo estar basada en un núcleo inorgánico, pudiéndose sintetizar nanopartículas poliméricas. Yendo un poco más allá una cápsida vírica puede entenderse como una nanopartícula formada por una carcasa proteica. Esta cápsida vírica tiene dimensiones nanométricas y, en muchos casos, burla con facilidad las membranas celulares. Por esta razón este tipo de “nanopartículas” se proponen para su uso en nanomedicina, y son el objeto de estudios básicos en los que las herramientas como los microscopios de fuerzas atómicas juegan un papel esencial. En particular, estas herramientas nos permiten caracterizar las propiedades mecánicas y las de ruptura de cápsidas víricas así como la en la que dichas cápsidas se comportan ante, por ejemplo, cambios controlados de humedad.

En un discurso recientemente impartido en la Universidad Europea de Madrid, William F. Clinton, ex-Presidente de los EE.UU, afirmó que ” el cometido del siglo XXI será salvar al mundo del cambio climático, regenerar la economía y crear . El futuro más allá será la Nanotecnología y la biotecnología”. El propio W.F. Clinton fue el impulsor de la Iniciativa Nacional de Nanotecnología durante su mandato, convirtiendo durante los últimos 10 años a EE.UU en el líder mundial en la generación de conocimientos básicos y aplicados en el ámbito de la Nanotecnología.

Nadie pone en duda las afirmaciones de W.F. Clinton sobre el papel de la Nanotecnología en nuestro futuro a medio y largo plazo, por lo uqe es imperativo estar suficientemente preparados para construir este paradigma científico. En el caso concreto de España, las dos últimas ediciones del Plan Nacional de I+D+I han encumbrado las investigaciones en Nanociencia y Nanotecnología a la categoría de Acción Estratégica. En la actualidad se están poniendo en marcha varios centros dedicados a Nanotecnología. Dichas iniciativas son producto, por lo general, de costosos impulsos puntuales, locales, dirigidos por científicos con iniciativa, pero no son fruto de una actuación de conjunto, planificada siguiendo una estrategia quiada por unos objetivos ambiciosos, en los que impere la coordinación y el uso eficiente de los recursos. La actual coyuntura económica no invita al optimismo a este respecto, por lo que sería necesario poner en marcha iniciativas que promuevan la adquisición de infraestructuras, la formación de técnicos, la coordinación entre centros emergentes, etc.

Otro punto sobre el que no hay que descuidarse tiene que ver con la formación, en todos los niveles educativos, en Nanotecnología. En este sentido son numerosas las universidades españolas que ofrecen cursos de master y/o doctorado con contenidos relacionados con la Nanotecnología. Sin embargo, muchos de estos cursos tienen pocos estudiantes inscritos, al igual que ocurre con muchos estudios de grado relacionados con las ciencias básicas. La tarea de fascinar y atraer a nuestros jóvenes hacia la ciencia debe comenzar mucho antes. En este sentido, los conceptos inherentes a la Nanotecnología deben formar parte del conocimiento que debe llegar a los estudiantes de educación secundaria, como ocurre en países como Alemania, Finlandia, Taiwán, Japón, EE.UU., etc.

Además, la Nanotecnología es una materia que causa cierta fascinación a los adolescentes por lo que puede ser un buen punto de partida para incentivar las vocaciones científicas. Esta ha sido una de las principales razones por las que los autores de este artículo junto con otros investigadores (Carlos Briones del Centro de Astrobiología y Elena Casero de la Universidad Autónoma de Madrid) accedieron a la petición de la Fundación Española de Ciencia y Tecnología (FECyT) para escribir una Unidad Didáctica de Ciencia y Tecnología. Dicho libro ya se encuentra en todos los institutos españoles de educación secundaria y bachillerato, y se puede desde la web de la FECyT. Esperemos que esta pequeña contribución, junto con otras de mayor calado que deben promoverse desde las diversas administraciones públicas, permita tomar la senda que nos lleve a medio plazo hacia la tan ansiada sociedad basada en el conocimiento.

Fuente: Revista Española de Física. Volumen 23 Nº 4 de 2009

Los Autores:

D. José Ángel Martín Gago, del Instituto de Ciencia de Materiales de Madrid, Concejo Superior de Investigaciones científicas, Centro de Astrobiología /CSIC/INTA), Instituto Nacional de Técnica Aerpespacial, y, D. Pedro A. Serena Domingo, del Instituo de Ciencia y Materiales de Madrid y del Consejo Superior de Investigaciones Científicas.

Sep

3

La masa y la energía ¿De donde vienen?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

No es ningún secreto que la obra más famosa de la denominada literatura árabe, Alf Laylah wa-Laylah (Las mil y una noches), era en realidad una antigua obra persa. Hazar Afsana ( un millar de cuentos), que contenía distintos relatos, muchos de los cuales eran de origen Indio. Con el paso del tiempo, se hicieron adiciones a obra, no sólo a partir de fuentes árabes, sino también griegas, hebreas, turcas y egipcias. La obra que hemos leído (casi) todos, en realidad, es un compendio de historias y cuentos de distintas nacionalidades, aunque la ambientación que conocemos, es totalmente árabe.

Los físicos que abordan el multiverso coinciden en que sería imposible visitar los universos vecinos, pero pueden estar ahí. / The Washington Post (Washington Post)

Nuestro universo, con lo inmenso que es, con centenares de miles de millones de galaxias visibles y tantos millones de estrellas en cada una de ellas, puede que no sea el único que exista. Tal vez hay otros universos, distintos del que conocemos, y alguno parecido… ¿Sería posible visitarlos? ¿Echarles un vistazo? ¿Comprobar siquiera si efectivamente están por ahí como burbujas aisladas… a no ser que entren algunas en colisión? Medio centenar de expertos estadounidenses, europeos y españoles se han reunido esta semana en un encuentro científico de alto nivel celebrado en la Universidad Autónoma de Madrid (UAM) para discutir precisamente los multiversos y las teorías en las que emerge su existencia.

En realidad, cuando observamos el Universo y vemos los fenómenos que ahí ocurren, las transiciones de fase que se producen en la materia, las energías desatadas que por todas partes son proyectadas en explosiones de supernovas y colisiones de estrellas de neutrones o agujeros negros, cuando dos inmensas galaxias se funden en una y se fusionan mediante un Vals de Gravedad que dura algunos millones de años… Cuando todo eso ocurre, podríamos pensar que, la Vida, no está preparada para ese entorno. Sin embargo, ¡aquí estamos!

Como nos dice la filosofía, nada es como se ve a primera vista, todo depende del punto de vista desde el que miremos las cosas, de la perspectiva que nos permita nuestra posición física y, la intelectual también. No todos podemos ver las cosas de la misma manera. La imagen de abajo que es una Nebulosa como otras tantas, ¿qué te dice a tí? ¿qués es lo que ahí puedes ver? ¿qué deduces de los componentes de la nebulosa? ¿qué puede surgir de ahí y de otros lugares como este de abajo? ¿Cómo llegó a formarse tal conglomerado de gas y polvo?

Richard Feynman

“Siempre me ha intrigado que, cuando se trata de aplicar las leyes tal como las entendemos actualmente, una computadora necesite hacer un número infinito de operaciones lógicas para efectuar cálculos relativos a lo que sucede en cualquier zona insignificante del tiempo. ¿Cómo puede suceder todo eso en un espacio diminuto? ¿Por qué se necesita una cantidad infinita de operaciones lógicas para averiguar lo que va a pasar en un fragmento diminuto de espacio-tiempo? A menudo he formulado la hipótesis de que en última instancia la física no necesitará una expresión matemática, ya que al fin se descubrirá la maquinaria y las leyes llegagarán a ser sencillas, como un juego de ajedrez con todas sus aparentes complejidades.”

Patrón de un kilogramo.

Todos los intentos y los esfuerzos por hallar una pista del cuál era el origen de la masa fallaron. Feynman escribió su famosa pregunta: “¿Por qué pesa el muón?”. , por lo menos, tenemos una respuesta parcial, en absoluto completa. Una voz potente y ¿segura? nos dice: “!Higgs¡” Durante más de 60 años los físicos experimentadores se rompieron la cabeza con el origen de la masa, y ahora el campo Higgs presenta el problema en un contexto ; no se trata sólo del muón. Proporciona, por lo menos, una fuente común todas las masas. La nueva pregunta feynmaniana podría ser: ¿Cómo determina el campo de Higgs la secuencia de masas, aparentemente sin patrón, que da a las partículas la matería?

La variación de la masa con el de movimiento, el cambio de masa con la configuración del sistema y el que algunas partículas (el fotón seguramente y los neutrinos posiblemente) tengan masa en reposo nula son tres hechos que ponen dicho que el concepto de masa sea un atributo fundamental de la materia. Habrá que recordar aquel cálculo de la masa que daba infinito y nunca pudimos resolver; los físicos sólo se deshicieron de él “renormalizándolo”, ese truco matemático que emplean cuando no saben encontrar la respuesta al problema planteado.

Ese es el problema de trasfondo con el que tenemos que encarar el problema de los quarks, los leptones y los vehículos de las fuerzas, que se diferencian por sus masas. que la historia de Higgs se tenga en pie: la masa no es una propiedad intrinseca de las partículas, sino una propiedad adquirida por la interacción de las partículas y su entorno.

La idea de que la masa no es intrinseca la carga o el espín resulta aún más plausible por la idílica idea de que todos los quarks y fotones tendrían masa cero. En ese caso, obedecerían a una simetría satisfactoria, la quiral, en laque los espines estarían asociados siempre con su dirección de movimiento. Pero ese idilio queda oculto por el fenómeno de Higgs.

¡Ah, una cosa más! Hemos hablado de los bosones gauge y de su espín de una unidad; hemos comentado también las partículas fermiónicas de la materia (espin de media unidad). ¿Cuál es el pelaje de Higgs? Es un bosón de espin cero. El espín supone una direccionalidad en el espacio, pero el campo de Higgs da masa a los objetos dondequiera que estén y sin direccionalidad. Al Higgs se le llama a veces “bosón escalar” [sin dirección] por esa razón.

La interacción débil, recordareis, fue inventada por E. Fermin describir la desintegración radiactiva de los núcleos, que era básicamente un fenómeno de poca energía, y a medida que la teoría de Fermi se desarrolló, llegó a ser muy precisa a la hora de predecir un enorme de procesos en el dominio de energía de los 100 MeV. Así que ahora, con las nuevas tecnologías y energías del LHC, las esperanzas son enormes para, por fin, encontrar el bosón Higgs origen de la masa… y algunas cosas más.

Fabiola Gianotti, portavoz del experimento ATLAS, ofreció algunos avances:

“En nuestros observamos claros signos de una nueva partícula compatible con la teoría de Higgs, con un nivel aproximado de 5 sigma [99,977% de eficiencia], en la región de masa alrededor de los 126 GeV. El increíble rendimiento del LHC y el ATLAS y los enormes esfuerzos de mucha gente nos han traído a excitante punto, pero hace falta un poco más de tiempo para preparar estos resultados cara a su publicación.”

El Modelo Estándar describe las partículas de todo cuanto nos rodea, incluso de nosotros mismos. Toda la materia que podemos observar, sin embargo, no parece significar más que el 4% del total. Higgs podría ser el puente para comprender el 96% del universo que permanece oculto.

El 4 de julio de 2012 se anunció el descubrimiento de un bosón. Punto. En diciembre de 2012 se empezó a hablar de “un” Higgs (en lugar de “el” Higgs), pero oficialmente seguía siendo un nuevo bosón. ¿Importa el ? El Premio Nobel de Física para el bosón de Higgs sólo será concedido cuando el CERN afirme con claridad y rotundidad que se ha descubierto “el” Higgs, si el CERN es conservador, la Academia Sueca lo es aún más. Sin embargo, el rumor es que quizás baste con que el CERN diga que se ha descubierto “un” Higgs.

¿Por qué, a pesar de todas las noticias surgidas el CERN, creo que no ha llegado el momento de celebrarlo? ¿Es acaso el Higgs lo encontrado? Al menos a mí me faltan expliaciones sobre el verdadero mecanismo mediante el cual las partículas adquieren masa.

Hay que responder montones de preguntas. ¿Cuáles son las propiedades de las partículas de Higgs y, lo que es más importante, cuál es su masa? ¿Cómo reconoceremos una si nos la encontramos en una colisión de LHC? ¿Cuántos tipos hay? ¿Genera el Higgs todas las masas, o las hace incrementarse? ¿Y, cómo podemos saber más al respecto? También a los cosmólogos les fascina la idea de Higgs, pues casi se dieron de bruces con la necesidad de tener campos escalares que participasen en el complejo proceso de la expansión del Universo, añadiendo, pues, un peso más a la carga que ha de soportar el Higgs.

El campo de Higgs, tal y como se lo concibe , se puede destruir con una energía grande, o temperaturas altas. Estas generan fluctuaciones cuánticas que neutralizan el campo de Higgs. Por lo tanto, el cuadro que las partículas y la cosmología pintan juntas de un universo primitivo puso y de resplandeciente simetría es demasiado caliente Higgs. Pero cuando la temperatura cae bajo los 10’5 grados kelvin o 100 GeV, el Higgs empieza a actuar y hace su generación de masas. Así por ejemplo, de Higgs teníamos unos W, Z y fotones sin masa y la fuerza electrodébil unificada.

El Universo se expande y se enfría, y entonces viene el Higgs (que engorda los W y Z, y por alguna razón ignora el fotón) y de ello resulta que la simetría electrodébil se rompe. Tenemos entonces una interacción débil, transportada por los vehículos de la fuerza W+, W–, Z0, y por otra una interacción electromagnética, llevada por los fotones. Es como si algunas partículas del campo de Higgs fuera una especie de aceite pesado a través del que se moviera con dificultad y que las hiciera parecer que tienen mucha masa. Para otras partículas, el Higgs es el agua, y para otras, los fotones y quizá los neutrinos, es invisible.

Cada suceso, la línea del haz es el eje común de los cilindros de malla de alambre ECAL y HCAL. ¿Cuál es el mejor candidato W? el mejor candidato Z? En cada evento, ¿dónde ocurrió la colisión y el decaimiento de las partículas producidas? Lo cierto es que, en LHC se hacen toda clase de pruebas para saber del mundo de las partículas, de dónde vienen y hacia dónde se dirigen y, el Bosón de Higgs, es una asignatura pendiente a pesar de las noticias y de los premios

De todas las maneras, es tanta la ignorancia que tenemos sobre el origen de la masa que, nos agarramos como a un clavo ardiendo el que se ahoga, en caso, a la partícula de Higgs que viene a ser una de las soluciones que le falta al Modelo Estándar para que todo encaje con la teoría.

¡Ya veremos en que termina todo esto! Y, aunque el que suena siempre es Higgs, lo cierto es que los autores de la teoría del “Bosón de Higgs”, son tres a los que se ha concedido, junto al CERN, el Premio Principe de Asturias. Peter Ware Higgs —el primero en predecir la existencia del bosón— junto a los físicos François Englert, y el belga Robert Brout—fallecido en el año 2011—.

Peter Higgs, de la Universidad de Edimburgo, introdujo la idea en la física de partículas. La utilizaron los teóricos Steven Weinberg y V. Salam, que trabajaban por separado, comprender como se convertía la unificada y simétrica fuerza electrodébil, transmitida por una feliz familia de cuatro partículas mensajeras de masa nula, en dos fuerzas muy diferentes: la QED con un fotón carente de masa y la interacción débil con sus W+, W– y Z0 de masa grande. Weinberg y Salam se apoyaron en los trabajos previos de Sheldon Glasgow, quien tras los pasos de Julian Schwinger, sabía sólo que había una teoría electrodébil unificada, coherente, pero no unió todos los detalles. Y estaban Jeffrey Goldstone y Martines Veltman y Gerard’t Hooft. También hay otras a los que había que mencionar, pero lo que siempre pasa, quedan en el olvido de manera muy injusta. Además, ¿Cuántos teóricos hacen falta para encender una bombilla?

La verdad es que, casi siempre, han hecho falta muchos. Recordemos el largo recorrido de los múltiples detalle sueltos y físicos que prepararon el terreno para que, llegara Einstein y pudiera, uniéndolo todo, exponer su teoría relativista.

Sobre la idea de Peter Higgs, Veltman, uno de sus arquitectos, dice que es una alfombra bajo la que barremos nuestra ignorancia. Glasgow es menos amable y lo llamó retrete donde echamos las incoherencias de nuestras teorías actuales. La objeción principal: que no teníamos la menor prueba experimental que parece que va asomando la cabeza en el LHC.

![]()

Esperemos que la partícula encontrada, el bosón hallado, sea en realidad el Higgs dador de masa a las demás partículas pero… ¡Cabe la posibilidad de que sólo sea el hermano menor! de la familia. El modelo estándar es lo bastante fuerte decirnos que la partícula de Higgs de menor masa (podría haber muchas) debe “pesar” de 1 TeV. ¿Por qué? Si tiene más de 1 TeV, el modelo estándar se vuelve incoherente y tenemos la crisis de la unitariedad.

Después de todo esto, tal como lo están planteando los del CERN, se llegar a la conclusión de que, el campo de Higgs, el modelo estándar y nuestra idea de cómo se hizo el Universo dependen de que se encuentre el Bosón de Higgs. Y , por fin, el mayor Acelerador del mundo, el LHC, nos dice que el Bosón ha sido encontrado y las pruebas tienen una fiabilidad enorme.

¡La confianza en nosotros mismos, no tiene límites! Pero el camino no ha sido recorrido por completo y quedan algunos tramos que tendremos que andar para poder, al fín, dar una explicación más completa, menos oscura y neblinosa que lo que hasta el momento tenemos, toda vez que, del Bosón de Higgs y de su presencia veráz, dependen algunos detalles de cierta importancia para que sean confirmados nuestros conceptos de lo que es la masa y, de paso, la materia.

¿Pasará igual con las cuerdas?

Pero volviendo al principal tema aquí tratado, ya todo eso quedó sobrepasado y el Bosón de Higgs (según nos dijeron los del CERN), ha sido descubierto para que le concedieran el Nobel de Física a Peter Ware Higgs —el primero en predecir la existencia del bosón— junto al físico François Englert. Desgraciadamente, el belga Robert Brout -también merecedor al premio- no pudo estar presente, se marchó antes de tiempo para hacerlo posible.

emilio silvera

Fuente principal: León Lederman

Sep

2

Partículas “bellas” de materia y antimateria

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

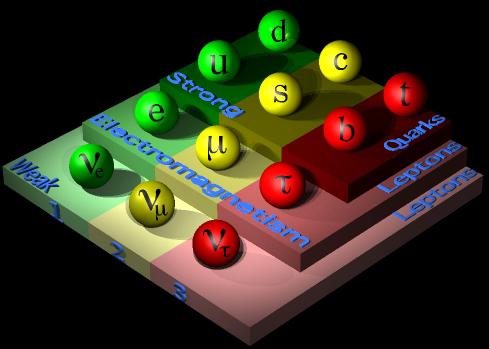

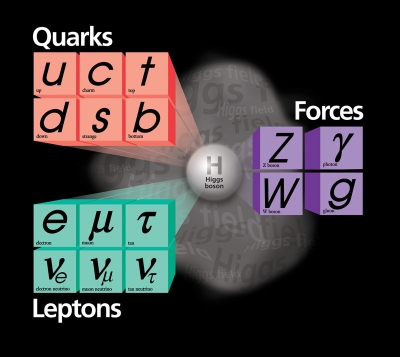

¿Cuántas generaciones de partículas existen? El modelo estándar no predice el número de generaciones de fermiones (quarks y leptones). Hoy conocemos tres generaciones, pero podrían existir más. Una cuarta generación dentro del modelo estándar estaría formada por dos quarks pesados y

y dos leptones pesados

y

. Cualquier otra opción implicaría física más allá del modelo estándar. En este caso SM4 sustituiría a SM3, como SM3 sustituyó a SM2 en los 1970. (Fuente Francis (th)E mule Science’s News).

Pero hablemos de partículas “bellas” de materia y antimateria. Así se titula un magnifico artículo de Don Alberto Ruiz Jimeno, miembro del Grupo de Altas Energías del Instituto de Física Moderna Universidad de Cantabria y Jefe del Grupo de Altas Energías. En él nos dice que:

El resultado procede del análisis de CDF de miles de millones de colisiones de protones y antiprotones producidos en el colisionador Tevatron del Fermilab. De acuerdo con la Teoría de la Relatividad de Einstein, energía es igual a masa, por lo que esas colisiones de alta energía pueden lanzar a la existencia a partículas subatómicas masivas no vistas en nuestro mundo cotidiano. Los físicos intentan entonces identificar esas partículas estudiando las combinaciones de partículas más familiares en las que decaen.

“Nuevos bariones constituidos por tres Quarks, como los protones, pero conteniendo el quarks b (“belleza”) han sido observado en el experimento CDF del Acelerador del Tevatrón de protones y antiprotones. Por otra parte (nos dice), se ha observado por primera vez la oscilación de los mesones B, entre materia y antimateria. Dado que el artículo puede tener un alto interés para ustedes, he creído positivo transcribirlo aquí para gozo del personal que, con estos nuevos conocimientos (como me pasó a mí), podrán aumentar los suyos.

La física de partículas elementales tiene por objeto el estudio de los constituyentes más elementales de la materia y de las fuerzas fundamentales que rigen su comportamiento. La dinámica de estos bloques fundamentales viene formulada por la mecánica cuántica relativista.

El denominado Modelo Estándar establece que los bloques elementales de la materia tienen un momento magnético intrínseco (spín) de valor ½, denominándose fermiones por verificar las leyes de la estadística cuántica que formularon Fermi y Dirac a comienzos del siglo XX. A su vez, las fuerzas fundamentales vienen determinadas por el intercambio de cuantos de energía, con spin 1 (salvo el hipotético gravitón que tendría spin 2), llamado bosones al verificar las leyes estadísticas cuántica establecidas por Bose y Einstein, en el mismo siglo XX.

Los Bosones de interacción son el fotón, causante de la interacción electromagnética; los bosones vectoriales W+, W– y Z0, causantes de la interacción nuclear débil; los ocho tipos de Gluones que confinan a los Quarks en hadrones (como el protón o el neutrón) a causa de la interacción fuerte nuclear, y el gravitón u onda gravitacional que explicaría la interacción gravitatoria. La fuerza gravitacional es despreciable a escala subatómica, pero es la dominante a grandes escalas. Su portador aún no ha sido observado; de hecho, su existencia requeriría una teoría cuántica de la gravitación, que aún no ha sido formulada.

Los fermiones de materia se denominan quarks o leptones, siendo los primeros los que están sometidos a los cuatro tipos de interacciones y los segundos los que no están sometidos a la interacción nuclear fuerte; en cualquiera de los casos, la interacción electromagnética solo afecta a las partículas que poseen carga eléctrica y la interacción gravitatoria a las que poseen masa.

Los quarks son de seis tipos o sabores, así como los leptones. Unos y otros se clasifican en familias o generaciones, siendo la más ligera la constituida por los quarks y los leptones electrón y neutrino electrónico. Los nucleones, protón y neutrón, tienen la estructura de quarks, respectivamente uud y udd. Los átomos tienen un núcleo interno constituido por nucleones y electrones orbitando en torno al mismo.

El resto de quarks y leptones constituyen materia exótica, siendo producidos en los aceleradores de partículas y en la radiación cósmica, pero formaban parte de la materia original del Universo primitivo. Los quarks pueden tener, además, tres tipos de carga fuerte o “color”.

Además existen otros doce sabores correspondientes a la antimateria, en forma de anti-quarks y anti-leptones, con las mismas masas que los quarks y leptones correspondientes, pero con sus cargas invertidas. No se ha observado antimateria en el Universo actual, pero el Universo primigenio tenía igual cantidad de materia que de antimateria. Toda la antimateria actual es producida en los choques de partículas aceleradas, como consecuencia de la transformación de energía en pares materia-antimateria.

La ecuación cuántica relativista que gobierna el comportamiento de los fermiones es la ecuación de Dirac, debida al famoso físico inglés. Las soluciones de dicha ecuación incluyen las denominadas partículas de antimateria, que poseen la misma masa que la partícula correspondiente, pero tienen todas sus “cargas” internas, como la carga eléctrica, con el signo opuesto. Así por cada quark tenemos un antiquark y por cada leptón un antileptón. Cuando un fermión y su correspondiente antifermión se encuentran se aniquilan mutuamente, convirtiéndose en energía y, a la viceversa, si tenemos energía superior a la suma de las masas de fermión y antifermión, puede convertirse en un par fermión-antifermión.

El 7 de agosto de 1912, el físico austriaco Victor Franz Hess descubrió esta potentísima fuente de energía llegada del espacio, lo que años después le supuso el premio Nobel ABC.ES / MADRID V.F. SOCIETY Víctor F. Hess, en un globo entre 1911 y 1912.

La historia de la Física de Partículas debe mucho al descubrimiento de los rayos cósmicos, realizada por el físico austríaco Francis Hess, en 1912, y apodados como tales por el físico americano Robert Millikan, en 1925. Los experimentos de Hess, utilizando globos aerostáticos, concluyeron que la cantidad de radiación crecía por encima de los 2000 metros de altura y la fuente de los mismos eran el Sol y otras fuentes procedentes del firmamento.

A partir de esa fecha y hasta mediados del siglo XX, gracias a los experimentos con rayos cósmicos, el número de tipos diferentes de partículas observadas, que previamente se reducían al protón y el electrón, se multiplicó, creándose un auténtico caos que obligó a pensar en esquemas de clasificación de las mismas.

Esquema de un sincrotrón

El sincrotrón es un tipo deacelerador de partículas. Se diferencia de otros aceleradores en que las partículas se mantienen en una órbita cerrada. Los primeros sincrotrones se derivaron del ciclotron. que usa un campo magnético constante para curvar la trayectoria de las partículas, aceleradas mediante un campo eléctrico también constante, mientras que en el sincrotrón ambos campos varían. La velocidad máxima a la que las partículas se pueden acelerar está dada por el punto en que la radiación sincrotrón emitida por las partículas al girar es igual a la energía suministrada. Los sincrotrones también se utilizan para mantener las partículas circulando a una energía fija; en este casos reciben el nombre de «anillos de almacenamiento».

En 1947, los físicos del Laboratorio Lawrence Berkeley, de California, construyeron el primer gran acelerador, un ciclotrón, comenzando la era de los grandes aceleradores de partículas, que continuaron descubriendo nuevos tipos de las mismas, de modo que, en 1960, había cientos de tipos de partículas observadas, sin que hubiera, aún, un esquema de clasificación adecuado. Este fue desarrollado durante la década de 1960, en la que el análisis de las colisiones de partículas, y las propiedades de los diferentes tipos de interacción observadas, establecieron la base para la construcción del Modelo Estándar.

Sí, las fuerzas fundamentales, o, interaciones… ¡Están presentes en todas partes por el Universo! Son las que marcan el ritmo.

Las leyes que rigen el comportamiento de las interacciones fundamentales y sus propiedades de simetría permitieron establecer un marco de clasificación de los hadrones (partículas compuestas por quarks, como es el caso del protón) que pueden ser de dos tipos: Bariones, si en su constitución tenemos tres quarks, o mesones, si si están constituidos de un quark y un antiquark.

En realidad, la dinámica de los hadrones está determinada, esencialmente, por la interacción nuclear fuerte, de modo que los quarks constituyentes son los quarks de “valencia”, en analogía con los electrones de valencia de los átomos (los que fijan sus propiedasdes químicas). En la dinámica de la interacción fuerte nuclear hay un continuo intercambio de Gluones entre los quarks y reacciones de producción y aniliquilación de quarks y antiquarks mediante Gluones.

Esta dinámica es debida a la existencia de una propiedad intrínseca de los quarks que denominamos “color”, que es intercambiada en las reacciones de Quarks y Gluones. Los hadrones son, globalmente, neutros de color (como los átomos son neutros de carga eléctrica) y es tan fuerte y característica la interacción que los quarks están confinados en unas dimensiones especiales inferiores al tamaño de los núcleos de los átomos, siendo paradójicamente casi libres en el interior de los hadrones (libertad asintótica de los quarks).

La fuerza nuclear fuerte es la más potente de la Naturaleza y mantiene el núcleo de los átomos unidos

El Modelo Estándar ha sido comprobado desde su desarrollo formal, a mediados de 1960, y sus parámetros han sido medidos con extraordinaria precisión, gracias al desarrollo de experimentos muy potentes, entre los que destacan los realizados en el acelerador LEP (“Large Electrón Positrón”) del CERN ( Centro Europeo de Física de Partículas, en Ginebra), durante la última década del siglo XX, y del Tevatrón del Laboratorio Fermilab (Chicago, USA), aún en funcionamiento.

A continuación viene una referencia al LHC que, a estas alturas está sobrepasada por conocer todos nosotros lo que ha pasó en su inauguración y sus primeras pruebas. Así que, no me parece oportuno plasmar aquí esa referencia que conoceremos de primera mano cuando sucedieron los hechos y toda la prensa los publicó.

emilio silvera

Sep

2

¿Dónde están las respuestas?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo asombroso ~

Clasificado en El Universo asombroso ~

Comments (0)

Comments (0)

¡Son posibles tántas cosas!

Algunos quieren encontrar las respuestas en la religión (que si ha sido escogida voluntariamente… ¡bien está!). Pero, como todos sabemos, es cosa de fe. Creer en aquello que no podemos ver ni comprobar no es precisamente el camino de la ciencia que empieza por imaginar, después conjeturar, más tarde teorizar, se comprueba una y mil veces la teoría aceptada a medias y sólo cuando todo está amarrado y bien atado, todas esas fases pasan a la categoría de una ley o norma que se utiliza para continuar investigando en la buena dirección. Einstein solía decir: “La religión sin Ciencia es ciega.”

Otros han sido partidarios de la teoría del caos y argumentan que a medida que el nivel de complejidad de un sistema aumenta, entran en juego nuevos tipos de leyes. Entender el comportamiento de un electrón o un quark es una cosa; utilizar este conocimiento para comprender el comportamiento de un tornado es otra muy distinta. La mayoría está de acuerdo con este aspecto. Sin embargo, las opiniones divergen con respecto a si los fenómenos diversos y a veces inesperados que pueden darse en sistemas más complejos que las partículas individuales son realmente representativos del funcionamiento de los nuevos principios de la física, o si los principios implicados son algo derivado y están basados, aunque sea de un modo terriblemente complicado, en los principios físicos que gobiernan el ingente número de componentes elementales del universo.

“La teoría del todo o teoría unificada fue el sueño incumplido de Einstein. A este empeñó dedicó con pasíón los últimos 30 años de su vida. No lo logró, y hoy continúa sin descubrirse. Consiste en una teoría definitiva, una ecuación única que dé respuesta a todas las preguntas fundamentales del Universo. Claro que, Einstein no sabía que las matemáticas para plasmar esa Teoría mágica… ¡No se habían inventado en su tiempo ni tampoco en el nuestro!

La teoría del todo debe explicar todas la fuerzas de la Naturaleza, y todas las características de la energía y la materia. Debe resolver la cuestión cosmológica, es decir, dar una explicación convincente al origen del Universo. Debe unificar relatividad y cuántica, algo hasta ahora no conseguido. Y además, debe integrar otros universos en caso de que los haya. No parece tarea fácil. Ni siquiera se sabe si existe una teoría del todo en la Naturaleza. Y, en caso de que exista, si es accesible a nuestro entendimiento y a nuestras limitaciones tecnológicas para descubrirla.”

Einstein se pasó los últimos treinta años de su vida en la bíusqueda de esa teoría que nunca pudo encontrar. En los escaparates de la 5ª Avenida de Nueva York, exponían sus ecuaciones y la gente, sin entender lo que veían, se arremolinaban ante el cristal para verlas.

Casi todo el mundo está de acuerdo en que el hallazgo de la Gran Teoría Unificada (teoría del Todo), no significaría de modo alguno que la psicología, la biología, la geología, la química, y también la física, hubieran resuelto todos sus problemas.