Jul

5

Nada es eterno ni infinito

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Lo cierto es que, nadie sabe el destino final del Universo. Sin embargo, especular…especulan todos.

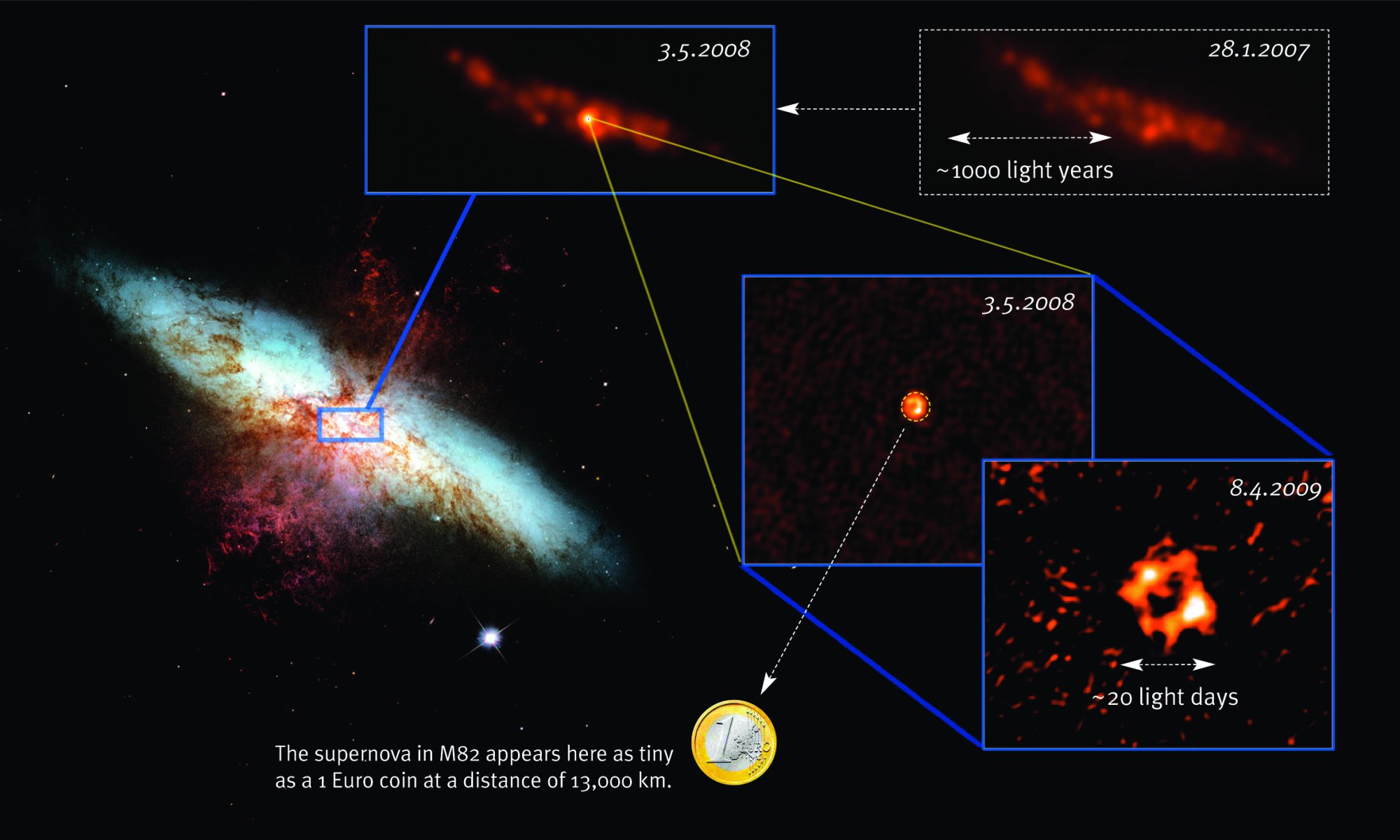

“Sabiendo” que el destino irremediable de nuestro mundo, el planeta Tierra, es el de ser calcinado por una estrella gigante roja en la que se convertirá el Sol cuando agote la fusión de su combustible de hidrógeno, helio, carbono, etc, para que sus capas exteriores de materia exploten y salgan disparadas al espacio exterior formando una nebulosa planetaria, mientras que el resto de su masa se contraerá hacia su núcleo bajo su propio peso, a merced de la gravedad, convirtiéndose en una estrella enana blanca de enorme densidad y de reducido diámetro que solo sera frenada por la degeneración de los electrones al ponerse en marcha en Principio de exclusión de Pauli. Sabiendo eso, el hombre debe poner los medios para que antes de que llegue ese momento (dentro de algunos miles de millones de años), la Humanidad pueda escapar y dar el salto hacia otros mundos lejanos que, como la Tierra ahora, reúna las condiciones físicas y químicas, tenga agua corriente por estar situados en la zona habitable y tengan la atmósfera y las temperaturas adecuadas para acogerla.

Lo de saber el destino final de nuestro mundo es un decir, si antes no ocurren cosas que cambien ese destino, otros acontecimientos ahora desconocidos por nosotros y que, siendo el Universo dinámico como lo es, entra dentro de lo posible que ese futuro que vislumbramos, pudiera ser diferente. En realidad, no podemos aseguar nada cuando nos referimos al mañana.

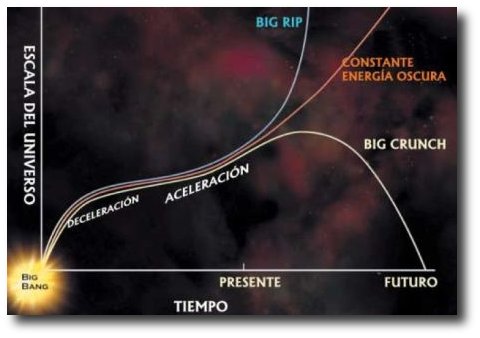

Pero el problema no es sólo de nosotros, y se extenderá a la totalidad del universo que, aunque mucho más tarde, también está abocado a la muerte térmica, el frío absoluto si se expande para siempre como un universo abierto y eterno, o el más horroroso de los infiernos, si estamos en un universo cerrado y finito en el que un día, la fuerza de gravedad, detendrá la expansión de las galaxias que comenzarán a moverse de nuevo en sentido contrario, acercándose las unas a las otras de manera tal que el universo comenzará, con el paso del tiempo, a calentarse, hasta que finalmente se junte toda la materia-energía del universo en una enorme bola de fuego de millones de grados de temperatura, el Big Crunch. Según los datos con los que contamos, la Densidad Crítica del Universo puede ser la ideal para que se expanda para siempre.

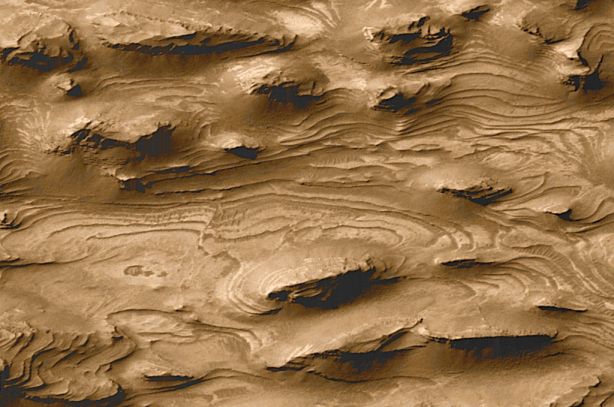

Las regiones del Universo, como nuestro Sistema Solar, están todas ellas regidas por las mismas leyes y fuerzas de la Naturaleza. El irreversible final está entre los dos modelos que, de todas las formas que lo miremos, es negativo para la Humanidad (si es que para entonces aún existe). En tal situación, algunos ya están buscando la manera de escapar.

Stephen Hawking ha llegado a la conclusión de que estamos inmersos en un metaverso, esto es, que existen infinidad de universos conectados los unos a los otros. Unos tienen constantes de la naturaleza que permiten la vida igual o parecida a la nuestra, otros posibilitan formas de vida muy distintas y otros muchos no permiten ninguna clase de vida.

Este sistema de inflación-contracción auto-reproductora nos viene a decir que cuando el universo se expande (se infla) a su vez, esa burbuja crea otras burbujas que se inflan y a su vez continúan creando otras nuevas más allá de nuestro horizonte visible. Cada burbuja será un nuevo universo, o mini-universo en los que reinarán escenarios diferentes o diferentes constantes y fuerzas.

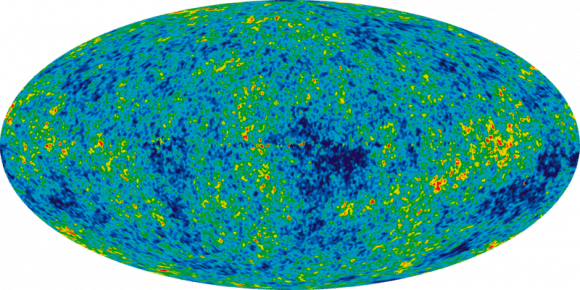

Representación artística de WMAP. La Wilkinson Microwave Anisotropy Probe (WMAP) es una sonda de la NASA cuya misión es estudiar el cielo y medir las diferencias de temperatura que se observan en la radiación de fondo de microondas, un remanente del Big Bang.

(“Los científicos han visto pruebas de tiempo antes del Big Bang, y tal vez una verificación de la idea del universo cíclico?. Uno de los grandes físicos de nuestra época, Roger Penrose de la Universidad de Oxford, ha publicado un nuevo documento diciendo que los patrones circulares visto en el WMAP mision de datos sobre el fondo cósmico de microondas sugieren que el espacio y el tiempo tal vez no se originó en el Big Bang, sino que nuestro universo continuamente los ciclos a través de una serie de “eones”, y tenemos un eterno y cíclico cosmos.”)

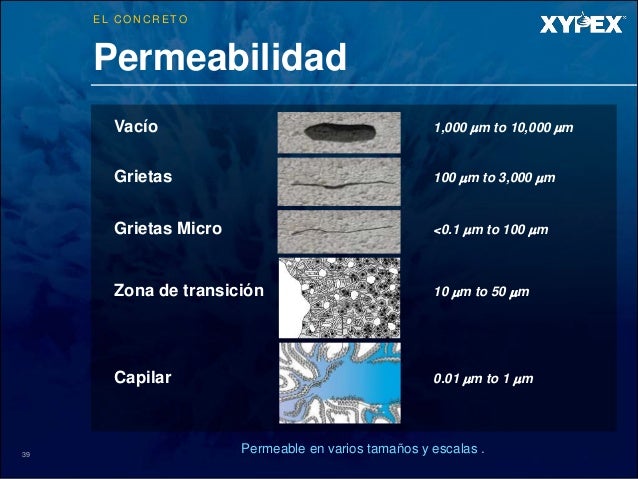

“La Física depende de distintos parámetros, desde la carga o masa del electrón hasta la permeabilidad del vacío pasando por la constante de gravitación universal. Si construir un universo fuera como cocinar usaríamos una receta de cocina. Los ingredientes que se usarían seguirían ciertos parámetros, como la composición de fuerzas y partículas, mientras que la preparación serían la cantidad de masa o la intensidad de la constante cosmológica.Sin embargo la receta del Universo no admite errores en los ingredientes. Pareciera que el Universo esta predispuesto para producir y albergar vida, pero al mínimo cambio las condiciones ya no son favorables. Así, una pequeña alteración en los valores de las constantes fundamentales haría que no se produzcan en las estrellas los elementos necesarios para la vida; más masa en el Universo y éste implosionará al poco de darse el Big Bang y no habrá dado tiempo para que se forme la vida; una constante cosmológica más intensa y el Universo se diluirá en la nada sin que se formen galaxias, estrellas y planetas.”

El escenario que describen algunos el diagramas en otras ocasiones aquí reseñado, ha sido explorado y el resultado hallado es que en cada uno de esos posibles universos, como hemos dicho ya, puede haber muchas cosas diferentes; pueden terminar con diferentes números de dimensiones espaciales o diferentes constantes y fuerzas de la naturaleza, pudiendo unos albergar la vida y otros no.

El reto que queda para los cosmólogos es calcular las probabilidades de que emerjan de esos diferentes universos a partir de esta complejidad inflacionaria ¿Son comunes o raros los universos como el nuestro? Existen, como para todos los problemas planteados, diversas conjeturas y consideraciones que influyen en la interpretación de cualquier teoría cosmológica futura cuántico-relativista. Hasta que no seamos capaces de exponer una teoría que incluya la relatividad general de Einstein (la gravedad-cosmos) y la mecánica cuántica de Planck (el cuanto-átomo), no será posible contestar a ciertas preguntas.

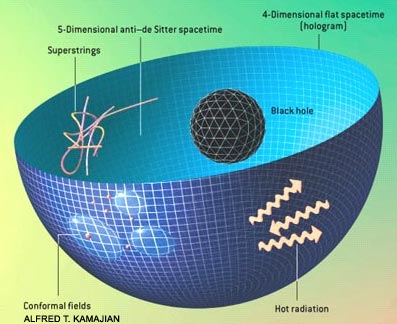

Todas las soluciones que buscamos parecen estar situadas en teorías más avanzadas que, al parecer, sólo son posibles en dimensiones superiores, como es el caso de la teoría de supercuerdas situada en 10, 11 ó 26 dimensiones. Allí, si son compatibles la relatividad y la mecánica cuántica, hay espacio más que suficiente para dar cabida a las partículas elementales, las fuerzas gauge de Yang-Mill, el electromagnetismo de Maxwell y la Gravedad que ahora está fuera del Modelo, en definitiva, una descripción real del espacio-tiempo y la materia, la descripción verdadera del universo y de las fuerzas que en él actúan.

No es fácil imaginar una teoría que lo explique todo. Siempre habrá una imperfección

Científicamente, la teoría del hiperespacio lleva los nombres de Teoría de Kaluza-Klein y supergravedad. Pero en su formulación más avanzada se denomina Teoría de Supercuerdas o Teoría M, una teoría que desarrolla su potencial en nueve dimensiones espaciales y una de tiempo: diez dimensiones, o, en la versión más avanzada de dies dimensiones de espacio y una de tiempo. Así pues, trabajando en dimensiones más altas, esta teoría del hiperespacio puede ser la culminación que conoce dos milenios de investigación científica: la unificación de todas las fuerzas físicas conocidas. Como el Santo Grial de la Física, la “Teoría de Todo” que esquivó a Einstein que la buscó los últimos 30 años de su vida.

Durante el último medio siglo, los científicos se han sentido intrigados por la aparente diferencia entre las fuerzas básicas que mantienen unido al cosmos: la Gravedad, el electromagnetismo y las fuerzas nucleares fuerte y débil. Los intentos por parte de las mejores mentes del siglo XX para proporcionar una imagen unificadora de todas las fuerzas conocidas han fracasado. Sin embargo, la teoría del hiperespacio permite la posibilidad de explicar todas las fuerzas de la naturaleza y también la aparentemente aleatoria colección de partículas subatómicas, de una forma verdaderamente elegante. En esta teoría del hiperespacio, la “materia” puede verse también como las vibraciones que rizan el tejido del espacio y del tiempo. De ello se sigue la fascinante posibilidad de que todo lo que vemos a nuestro alrededor, desde los árboles y las montañas a las propias estrellas, no son sino vibraciones del hiperespacio.

“Mañana” podría ser realidad la teoría de cuerdas y la Gravedad cuántica

Es tanta nuestra ignorancia que, a falta de datos fiables, nuestra imaginación es la que dentro de nuestras mentes, dibuja aquellos mundos y universos que sea capaz de idear, y, no pocas veces, esos “sueños”, sin nosotros saberlo, podrían ser el retrato de la realidad.

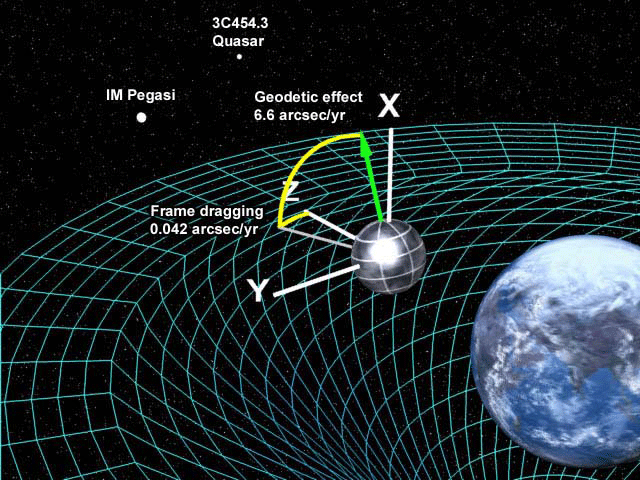

Antes mencionábamos los universos burbujas nacidos de la inflación y, normalmente, el contacto entre estos universos burbujas es imposible, pero analizando las ecuaciones de Einstein, los cosmólogos han demostrado que podría existir una madeja de agujeros de gusano, o tubos, que conectan estos universos paralelos.

¿Quién sabe lo que encontraremos mañana?

Hasta las cosas más extrañas pueden estar ahí fuera esperando que las encontremos. ¿No existen Agujeros Negros? ¿Por qué no otros extraños Objetos e incluso universos diferentes al nuestro?

Aunque muchas consecuencias de todos estos pensamientos son puramente teóricas, el viaje en el hiperespacio (si algún día fuera posible) podría proporcionar eventualmente la aplicación más práctica de todas: salvar la vida inteligente de la muerte de este universo nuestro cuando al final llegue el frío o el calor.

Claro que, ¡tenemos tanto “tiempo” por delante! que, mentes pensantes que por el Universo podrían ser más abundantes de lo que muchos piensan, tienen un margen aceptable para buscar esa fórmula que bien aplicada, evite el desastre final.

Otros, sin embargo, opinan que el Universo es el resultado de fluctuaciones del vacío pero, eso será objeto de otro comentario.

emilio silvera

Jul

2

¡El Modelo Estándar

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física, Física Cuántica, General ~

Clasificado en Física, Física Cuántica, General ~

Comments (1)

Comments (1)

Precisamente, en los dos últimos comentarios de Fandila y otro mío, nos estábamos refiriendo a las teorías y, los dos coincidimos en que, a medida que se avanza y se descubren nuevos parámentros, tienen que ser refinadas para que reflejen de manera más real lo que quieren representar de los fenómenos que vemos en la Naturaleza.

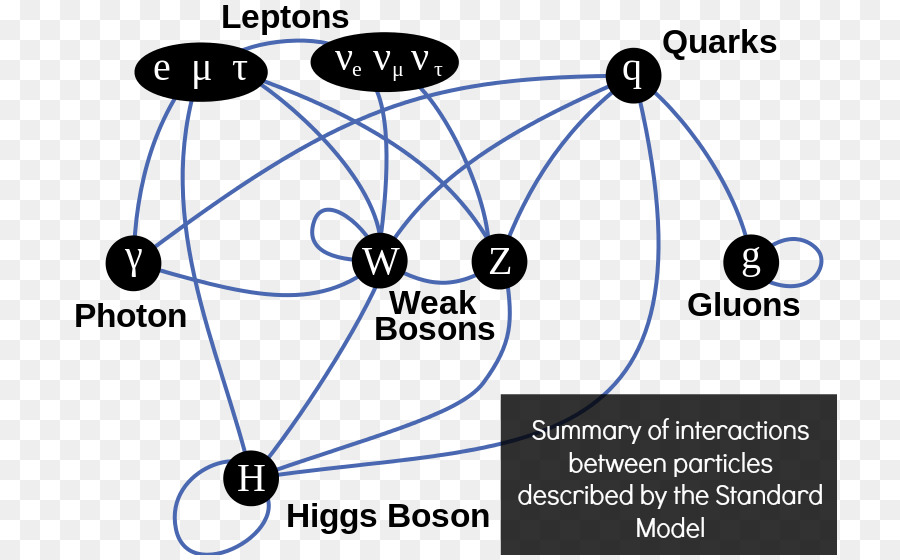

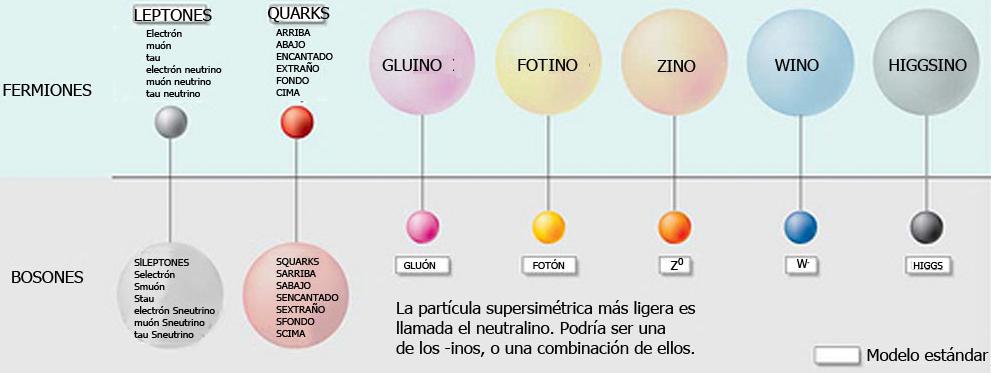

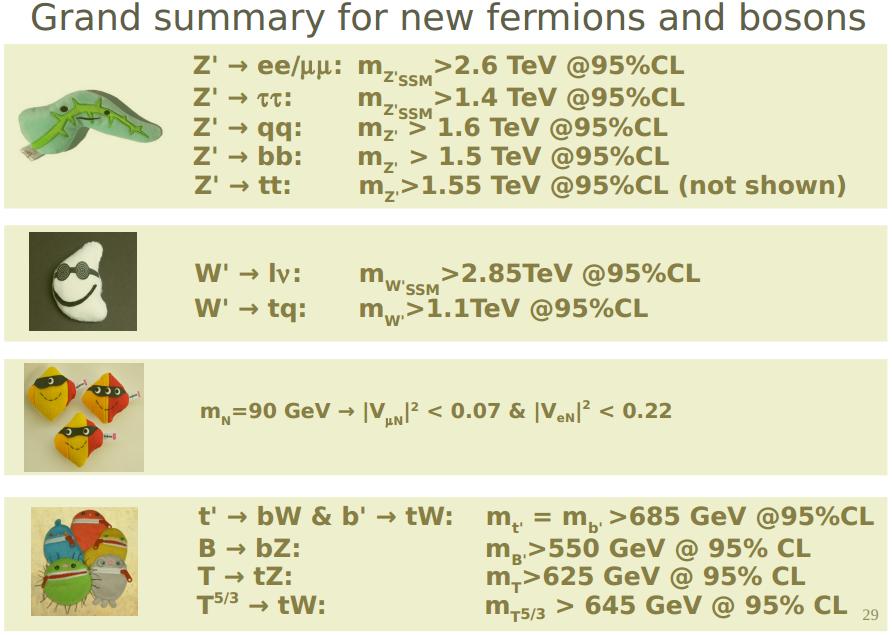

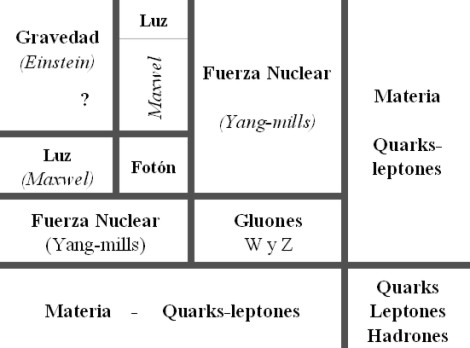

“El modelo estándar de la física de partículas es una teoría relativista de campos cuánticos desarrollada entre 1970 y 1973[cita requerida] basada en las ideas de la unificación y simetrías1 que describe la estructura fundamental de la materia y el vacío considerando las partículas elementales como entes irreducibles cuya cinemática está regida por las cuatro interacciones fundamentales conocidas (exceptuando la gravedad, cuya principal teoría, la relatividad general, no encaja con los modelos matemáticos del mundo cuántico). La palabra “modelo” en el nombre viene del período de los 70 cuando no había suficiente evidencia experimental que confirmara el modelo.1 Hasta la fecha, casi todas las pruebas experimentales de las tres fuerzas descritas por el modelo estándar están de acuerdo con sus predicciones. Sin embargo el modelo estándar no alcanza a ser una teoría completa de las interacciones fundamentales debido a varias cuestiones sin resolver.”

Han pasado 50 años desde que Steven Weinberg y Abdus Salam publicaran aquel artículo en el que formalizaron el llamado Modelo Estándar de las Interacciones Fundamentales. Han sido 5 décadas de actividad científica muy intensa en las que se han realizado toda clase de experimentos para someter a esta teoría a las más complicadas pruebas que nos dijeran si realmente era un modelo que reflejaba la realidad que la naturaleza nos quiere transmitir.

El Modelo Estándar está construido de manera imperfecta, y aunque ha sido y será una herramienta de un enorme rendimiento para los físicos, hay que reconocer que estaba construido con 20 parámetros aleatorios (metidos con calzador) y, de los cuales solo uno de ellos (el Bosón de Higgs) ha sido hallado.

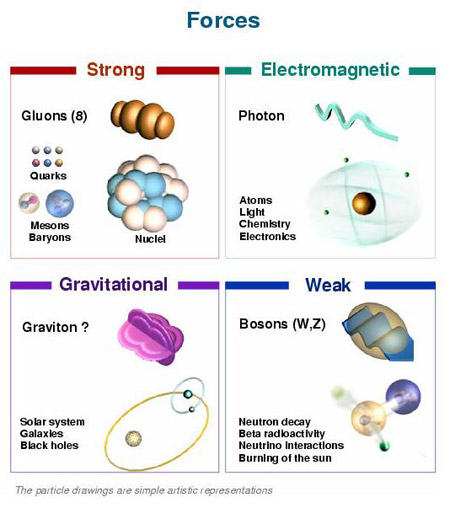

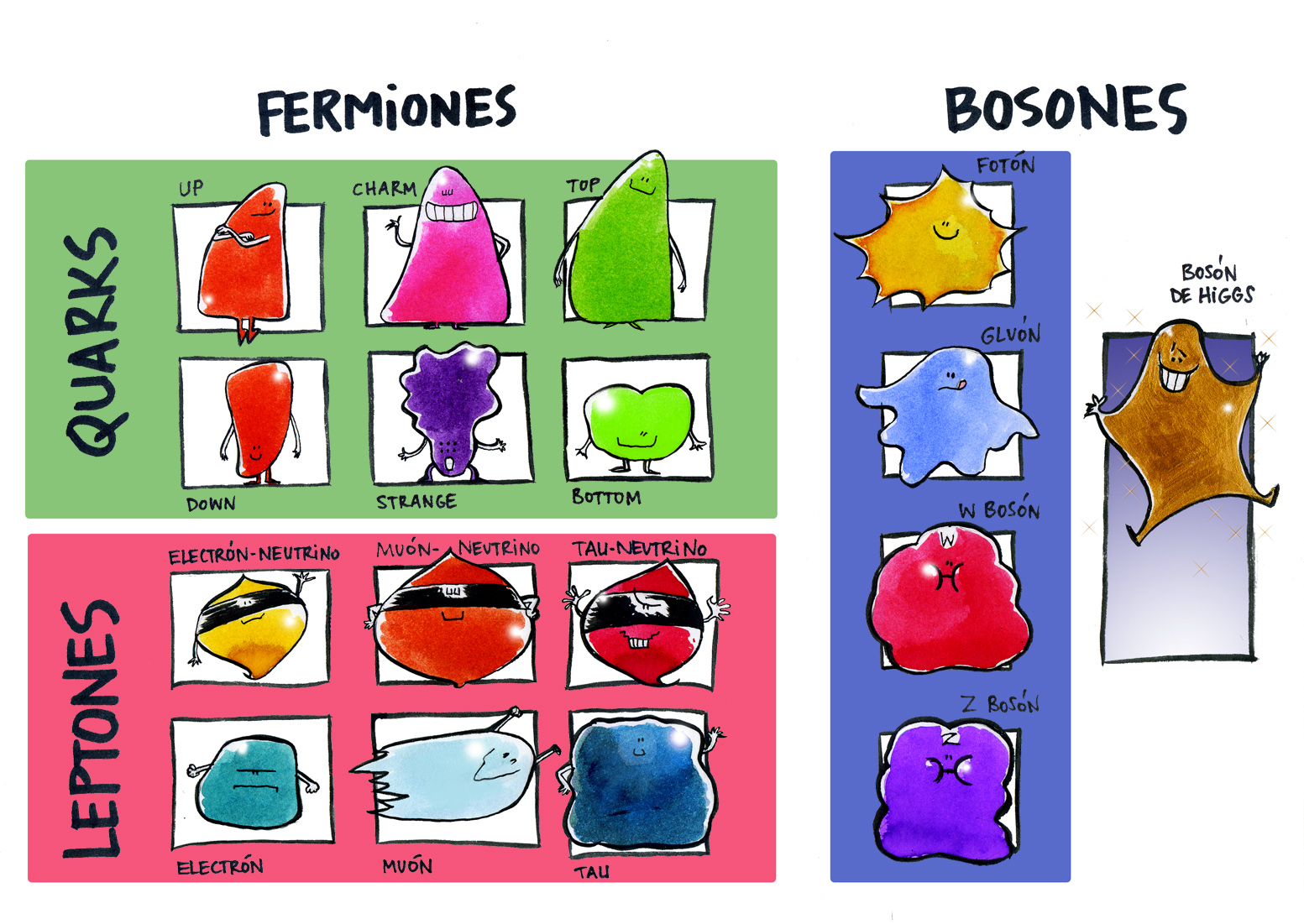

En el modelo estándar que nos habla de las familias de partículas subatómicas que conforman la materia y también de aquellas otras que son intermediarias en la transmisión de las fuerzas fundamentales. Las partículas están divididas en familias como los quarks, los lectones y los hadrones. En realidad, los hadrones que se dividen en bariones y mesones se consideran una clase de subpartículas al estar conformadas por tripletes de quarks los bariones, y, por quarks y antiquarks los mesones.

Además de las partículas mencionadas, en el Modelo Estándar están incluidas tres de las cuatro fuerzas fundamentales de la Naturaleza: Fuerza Nuclear Fuerte, Fuerza Nuclear Débil y, Electromagnetismo. La cuarta fuerza que es la Gravedad se resiste a reunirse en el modelo con las otras tres, y, precisamente por eso, los físicos están tratando de construir el modelo de la Gravedad Cuántica que por fin, reúna a todas las fuerzas.

Parece (aunque esto será objeto de un artículo a parte) que en la teoría de cuerdas (pendiente de ser verificada) puede subyacer esa teoría cuántica de la gravedad.

La teoría estándar constituye un logro científico de inmensa importancia. A partir de simples postulados de simetría, es posible deducir las propiedades dinámicas de las interacciones electrodébil y fuerte, es decir, el lagrangiano completo que rige las fuerzas entre los constituyentes básicos de la materia, prediciendo así el comportamiento del mundo microscópico, de forma muy precisa y en perfecto acuerdo con las observaciones experimentales.

Más aún, la consistencia matemática de la teoría hizo necesario introducir un nuevo campo de fuerza escalar, el campo de Higgs, del que no teníamos ninguna evidencia empírica hasta que los experimentos realizados en el acelerador de partículas LHC, encontraron el Bosón de Higgs y se consiguió añadir uno de los veinte parámetros aleatorios que tenía el modelo para convertirlo en un parámetro real y muy positivo, de tal manera que 50 años más tarde, lo que era una hipótesis teórica se ha convertido en una realidad tangible.

Desde la perspectiva actual, la Teoría Estándar se obtiene fácilmente a partir de un mínimo número de ingredientes: la existencia de constituyentes elementales de la materia con espín ½, quarks y lectones, y las propiedades de simetría de los campos cuánticos que los describen.

La derivación matemática de su estructura parece tan simple y elegante que se podría llegar a pensar que es el resultado de una idea brillante (¿por qué no se nos había ocurrido antes?). Nada más lejos de la realidad. El desarrollo histórico de la teoría se produjo mediante una concatenación de pequeños pasos, no siempre en la buena dirección, en los que poco a poco se fueron superando grandes dificultades técnicas y conceptuales.

El modelo que formularon Weinberg y Salam en 1967-1968 estaba basado en los desarrollos anteriores realizados por muchos otros científicos. Además, era un modelo solo de lectones y por lo tanto, tal como ahora sabemos, matemáticamente inconsistente debido a anomalías cuánticas. Harían falta todavía algunos años de profunda investigación y nuevas ideas para hacer posible la incorporación de los quarks, dando lugar al modelo definitivo. La celebración de este cincuentenario es una buena oportunidad para analizar retrospectivamente la evolución conceptual que ha permitido alcanzar este gran éxito científico.

Jun

20

Física, la era cuántica y otros fascinantes conceptos

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

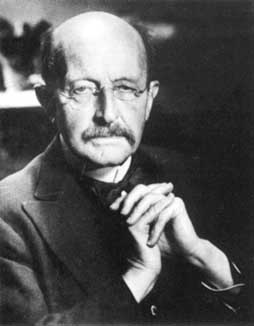

Los científicos para lograr conocer la estructura del universo a su escala más grande, deben retroceder en el tiempo, centrando sus teorías en el momento en que todo comenzó. Para ello, como todos sabeis, se han formulado distintas teorías unificadoras de las cuatro fuerzas de la naturaleza, con las cuales se han modelado acontecimiento y condiciones en el universo primitivo casi a todo lo largo del camino hasta el principio. Pero cómo se supone que debió haber habido un «antes», aparece una barrera que impide ir más allá de una frontera que se halla fijada a los 10-43 [s] después del Big Bang, un instante conocido como «momento de Planck», en homenaje al físico alemán Max Planck.

El momento de Planck es la unidad de momento, denotada por m P c {\displaystyle m_{P}c}

Se define como:

donde

es la longitud de Planck

es la constante de Planck racionalizada

es la velocidad de la luz en el vacío

es la constante gravitacional

En unidades del SI. el momento de Planck equivale a unos 6,5 kg m/s. Es igual a la masa de Planck multiplicada por la velocidad de la luz, con frecuencia asociada con el momento de los fotones primordiales en ciertos modelos del Big Bang que aún perduran.

Esta barrera existe debido a que antes del momento de Planck, durante el período llamado la «era de Planck o cuántica», se supone que las cuatro fuerza fundamentales conocidas de la naturaleza eran indistinguibles o se hallaban unificadas , que era una sola fuerza. Aunque los físicos han diseñado teorías cuánticas que unen tres de las fuerzas, una por una, a través de eras que se remontan al momento de Planck, hasta ahora les ha sido prácticamente imposible armonizar las leyes de la teoría cuántica con la gravedad de la relatividad general de Einstein, en un sólo modelo teórico ampliamente convincente y con posibilidades claras de ser contrastado en experimentos de laboratorio y, mucho menos, con observaciones.

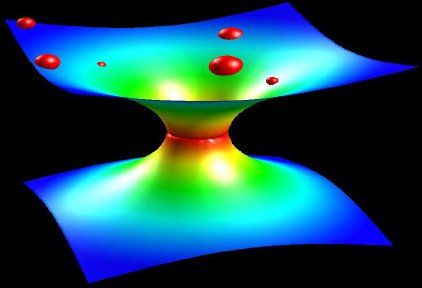

Si hablamos de singularidades en agujeros negros, debemos dejar la R.G. y acudir a la M.C. “…según las leyes de la Relatividad, el eje más horizontal siempre es espacio, mientras que el más vertical siempre es tiempo. Por tanto, al cruzar el horizonte lo que nosotros entendemos por tiempo y espacio ¡habrán intercambiado sus papeles! Puede sonar raro y, definitivamente, es algo completamente anti intuitivo, pero es la clave de que los agujeros negros sean como son y jueguen el papel tan importante que juegan en la física teórica actual. Al fin y al cabo, dentro no es lo mismo que fuera…”

Si ahora queremos cuantizar, es decir encontrar la versión cuántica, la gravedad escrita como RG lo que tenemos que hacer es encontrar la teoría cuántica para la métrica. Sin embargo, esto no conduce a una teoría apropiada, surgen muchos problemas para dar sentido a esta teoría, aparecen infinitos y peor que eso, muchos cálculos no tienen ni tan siquiera un sentido claro. Así que hay que buscar otra forma de intentar llegar a la teoría cuántica.

Como tantas veces hemos comentado, los trabajos que se han realizado sobre poder construir una teoría cuántica de la gravedad nos llevan a un número sorprendente de implicaciones. Por un lado, sólo se ha podido conceptuar a la gravedad cuántica, siempre y cuando, el universo tenga más de cuatro dimensiones. Además, se llega a considerar que en la era de Planck, tanto el universo como la gravedad pudieron ser una sola cosa compacta estructurada por objetos cuánticos infinitamente diminutos, como los que suponemos que conforman las supercuerdas. A esta escala, el mismísimo espaciotiempo estaría sometido a imprescindibles fluctuaciones muy semejantes a las que causan las partículas al nacer y desaparecer de la existencia en el espacio-tiempo ordinario. Esta noción ha conducido a los teóricos a describir el universo de la era cuántica como una especie de extremadamente densa y agitada espuma que pudo haber contenido las vibrantes cuerdecillas que propugnan los cosmólogos cuerdistas.

Los físicos especulan que el cosmos ha crecido a desde una «nada» primigenia que al nacer comenzó el principio del tiempo y que, en ese parto, contenía toda la materia y toda la energía.

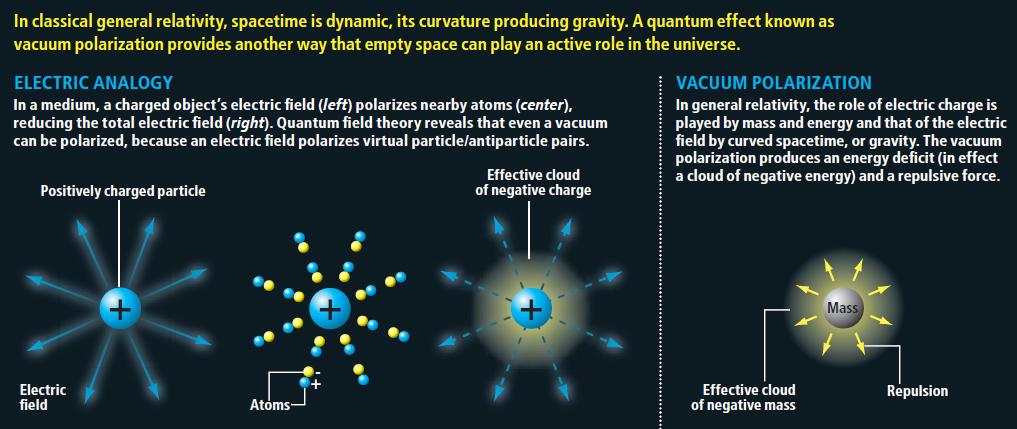

Según la física cuántica, “la nada” no existe. En vez de esto, en la escala más pequeña y elemental del universo hallamos una clase de “espuma cuántica”.

John Wheeler explicó el término de “espuma cuántica” en 1955. A este nivel subatómico, la energía se rige por el principio de Incertidumbre de Heisenberg; sin embargo, para comprender este principio y cualquier aseveración de física cuántica, es importante antes entender que el universo se rige por cuatro dimensiones: tres comprendidas por el espacio que un objeto ocupa (vectores “X”, “Y” y “Z”) y una última, que es el tiempo.

La Física actual no puede describir lo que sucedió en el Big Bang. La Teoría Cuántica y la Teoría de la Relatividad fracasan en éste estado inicial del Universo infinitamente denso y caliente. Tan solo una teoría de la Gravedad Cuántica que integre ambos pilares fundamentales de la Física, podría proporcionar una idea acerca de cómo comenzó el Universo.

Según los primeros trabajos sobre la teoría cuántica de la gravedad, el propio espaciotiempo varió en su topografía, dependiendo de las dimensiones del universo niño. Cuando el universo era del tamaño de un núcleo atómico (ver imagen de abajo), las condiciones eran relativamente lisas y uniformes; a los 10-30cm (centro) es evidente una cierta granulidad; y a la llamada longitud de Planck, todavía unas 1.000 veces más pequeño (abajo), el espacio tiempo fluctúa violentamente.

La Gravedad de Einstein y la Cuántica de Planck… ¡No casan!

Los físicos han intentado con denuedo elaborar una teoría completa de la gravedad que incluya la mecánica cuántica. Los cálculos de la mayoría de las teorías propuesta de la «gravedad cuántica» arrojan numerosos infinitos. Los físicos no están seguros si el problema es técnico o conceptual. No obstante, incluso prescindiendo de una teoría completa de gravedad cuántica, se puede deducir que los efectos de la teoría cuántica, habrían sido cruciales durante los primeros 10-43 segundos del inicio del universo, cuando éste tenía una densidad de 1093 gramos por centímetro cúbico y mayor. (El plomo sólido tiene una densidad de aproximadamente diez gramos por centímetro cúbico.) Este período, que es el que corresponde a la era de Planck, y a su estudio se le llama cosmología cuántica. Como el universo en su totalidad habría estado sujeto a grandes incertidumbres y fluctuaciones durante la era de Planck o era cuántica, con la materia y la energía apareciendo y desapareciendo de un vacío en grandes cantidades, el concepto de un principio del universo podría no tener un significado bien definido. En todo caso, la densidad del universo durante este período es de tal magnitud que escapa a nuestra comprensión. Para propósitos prácticos, la era cuántica podría considerarse el estado inicial, o principio, del universo. En consecuencia, los procesos cuánticos ocurridos durante este período, cualquiera sea su naturaleza, determinaron las condiciones iniciales del universo.

Observaciones astronómicas indican que el universo tiene una edad de 13,73 ± 0,12 millardos de años (entre 13 730 y 13 810 millones de años) y por lo menos … Sin embargo…

El universo estaba a 3.000° Hace doce mil quinientos millones de años; a 10 mil millones de grados (1010° K) un millón de años antes, y, tal vez, a 1028° K un par de millones más temprano. Pero, y antes de ese tiempo ¿qué pasaba? Los fósiles no faltan, pero no sabemos interpretarlos. Mientras más elevada se va haciendo la temperatura del universo primigenio, la situación se va complicando para los científicos. En la barrera fatídica de los 1033° K –la temperatura de Planck–, nada funciona. Nuestros actuales conocimientos de la física dejan de ser útiles. El comportamiento de la materia en estas condiciones tan extremas deja de estar a nuestro alcance de juicio. Peor aún, hasta nuestras nociones tradicionales pierden su valor. Es una barrera infranqueable para el saber de la física contemporánea. Por eso, lo que se suele decir cómo era el universo inicial en esos tempranos períodos, no deja de tener visos de especulación.

Los progresos que se han obtenido en física teórica se manifiestan a menudo en términos de síntesis de campos diferentes. Varios son los ejemplos que de ello encontramos en diversos estudios especializados, que hablan de la unificación de las fuerzas fundamentales de la naturaleza.

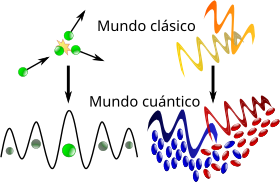

En física se cuentan con dos grandes teorías de éxito: la cuántica y la teoría de la relatividad general.

Cada una de ellas ha demostrado ser muy eficiente en aplicaciones dentro de los límites de su ámbito propio. La teoría cuántica ha otorgado resultados más que satisfactorios en el estudio de las radiaciones, de los átomos y de sus interacciones. La ciencia contemporánea se presenta como un conjunto de teorías de campos, aplicables a tres de las grandes interacciones: electromagnética, nuclear fuerte, nuclear débil. Su poder predictivo es bastante elocuente, pero no universal. Esta teoría es, por ahora, incapaz de describir el comportamiento de partículas inmersas en un campo de gravedad intensa. Ahora, no sabemos si esos fallos se deben a un problema conceptual de fondo o falta de capacidad matemática para encontrar las ecuaciones precisas que permitan la estimación del comportamiento de las partículas en esos ambientes.

La teoría de la relatividad general, a la inversa, describe con gran precisión el efecto de los campos de gravedad sobre el comportamiento de la materia, pero no sabe explicar el ámbito de la mecánica cuántica. Ignora todo acerca de los campos y de la dualidad onda-partícula, y en ella el «vacío» es verdaderamente vacío, mientras que para la física cuántica hasta la «nada» es «algo»…

Nada está vacío, ya que, de donde surge es porque había

Claro está, que esas limitaciones representativas de ambas teorías no suelen tener mucha importancia práctica. Sin embargo, en algunos casos, esas limitantes se hacen sentir con agresividad frustrando a los físicos. Los primeros instantes del universo son el ejemplo más elocuente.

El científico investigador, al requerir estudiar la temperatura de Planck, se encuentra con un cuadro de densidades y gravedades extraordinariamente elevadas. ¿Cómo se comporta la materia en esas condiciones? Ambas teorías, no dicen mucho al respecto, y entran en serias contradicciones e incompatibilidades. De ahí la resistencia de estas dos teorías a unirse en una sólo teoría de Gravedad-Cuantíca, ya que, cada una de ellas reina en un universo diferente, el de lo muy grande y el de lo muy pequeño.

Todo se desenvuelve alrededor de la noción de localización. La teoría cuántica limita nuestra aptitud para asignar a los objetos una posición exacta. A cada partícula le impone un volumen mínimo de localización. La localización de un electrón, por ejemplo, sólo puede definirse alrededor de trescientos fermis (más o menos un centésimo de radio del átomo de hidrógeno). Ahora, si el objeto en cuestión es de una mayor contextura másica, más débiles son la dimensión de este volumen mínimo. Se puede localizar un protón en una esfera de un décimo de fermi, pero no mejor que eso. Para una pelota de ping-pong, la longitud correspondiente sería de unos 10-15 cm, o sea, bastante insignificante.La física cuántica, a toda partícula de masa m le asigna una longitud de onda Compton: lc = h / 2p mc

Por su parte, la relatividad general igualmente se focaliza en la problemática del lugar que ocupan los objetos. La gravedad que ejerce un cuerpo sobre sí mismo tiende a confinarlo en un espacio restringido. El caso límite es aquel del agujero negro, que posee un campo de gravedad tan intenso que, salvo la radiación térmica, nada, ni siquiera la luz, puede escapársele. La masa que lo constituye está, según esta teoría, irremediablemente confinada en su interior.

En lo que hemos inmediatamente descrito, es donde se visualizan las diferencias entre esos dos campos del conocimiento. Uno alocaliza, el otro localiza. En general, esta diferencia no presenta problemas: la física cuántica se interesa sobre todo en los micro-objetos y la relatividad en los macro-objetos. Cada cual en su terreno.

Sin embargo, ambas teorías tienen una frontera común para entrar en dificultades. Se encuentran objetos teóricos de masa intermedia entre aquella de los micro-objetos como los átomos y aquella de los macro-objetos como los astros: las partículas de Planck. Su masa es más o menos la de un grano de sal: 20 microgramos. Equivale a una energía de 1028 eV o, más aún, a una temperatura de 1033° K. Es la «temperatura de Planck».

Ahora bien, si queremos estimar cuál debería ser el radio en que se debe confinar la masita de sal para que se vuelva un agujero negro, con la relatividad general la respuesta que se logra encontrar es de que sería de 10-33 cm, o sea ¡una cien mil millonésima de mil millonésima de la dimensión del protón! Esta dimensión lleva el nombre de «radio de Planck». La densidad sería de ¡1094 g/cm3! De un objeto así, comprimido en un radio tan, pero tan diminuto, la relatividad general sólo nos señala que tampoco nada puede escapar de ahí. No es mucha la información.

Si recurrimos a la física cuántica para estimar cuál sería el radio mínimo de localización para un objeto semejante al granito de sal, la respuesta que encontramos es de un radio de 10-33 cm. Según esta teoría, en una hipotética experiencia se lo encontrará frecuentemente fuera de ese volumen. ¡Ambos discursos no son coincidentes! Se trata de discrepancias que necesitan ser conciliadas para poder progresar en el conocimiento del universo. ¿Se trata de entrar en procesos de revisión de ambas teoría, o será necesaria una absolutamente nueva? Interrogantes que solamente el devenir de la evolución de la física teórica las podrá responder en el futuro.

No sabemos por qué existen los fermiones y los bosones gauge que han sido observados en los experimentos. Todas las piezas del puzzle encajan a la perfección, pero la imagen mostrada en el puzzle no la han elegido las leyes físicas que conocemos, nos viene impuesta por la Naturaleza. Lo único que podemos decir es que la Naturaleza es así y nos gustaría saber el porqué, pero aún estamos muy lejos de descubrirlo (si es que es posible hacerlo sin recurrir a un principio antrópico).

De todas las maneras, en lo que se refiere a una Teoría cuántica de la Gravedad, tendremos que esperar a que se confirmen las teorías de supergravedad, supersimetría, cuerdas, la cuerda heterótica, supercuerdas y, la compendiada por Witten Teoría M. Aquí, en estas teorías (que dicen ser del futuro), sí que están apasiblemente unidas las dos irreconcialbles teorías: la cuántica y la relativista, no sólo no se rechazan ni emiten infinitos, sino que, se necesitan y complementan para formar un todo armónico y unificador.

¡Si pudiéramos verificarla!

Pero, contar con la energía de Planck (1019 GeV), no parece que, al menos de momento, no sea de este mundo. Ni todos los aceleradores de partículas del mundo unidos, podrían llegar a conformar una energía semejante.

emilio silvera

Jun

20

¡El límite de las teorías!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (20)

Comments (20)

Presentado en la XIX Edición del

Siempre andamos a vueltas con las teorías, y, tenemos que ser conscientes que las teorías tienen unos límites que están bien determinados. Veamos:

¿Cuáles son los límites de la teoría cuántica y de la teoría de la relatividad general de Einstein? Afortunadamente, hay una respuesta simple y las unidades de Planck nos dicen cuales son.

Y precisamente esta constante es el segundo motivo por el que no encuentras los muebles en una posición diferente cada vez que entras en el salón.

Supongamos que tomamos toda la masa del universo visible y determinamos su longitud de onda cuántica. Podemos preguntarnos en qué momento esta longitud de onda cuántica del universo visible superará su tamaño. La respuesta es: cuando el universo sea más pequeño en tamaño que la longitud de Planck, es decir, 10-33 centímetros, más joven que el tiempo de Planck 10ˉ⁴³ segundos y supere la temperatura de Planck de 1032 grados. Las unidades de Planck marcan la frontera de aplicación de nuestras teorías actuales. Para comprender en que se parece el mundo a una escala menor que la longitud de Planck tenemos que comprender plenamente cómo se entrelaza la incertidumbre cuántica con la gravedad. Para entender lo que podría haber sucedido cerca del suceso que estamos tentados a llamar el principio del universo, o el comienzo del tiempo, tenemos que penetrar la barrera de Planck. Las constantes de la naturaleza marcan las fronteras de nuestro conocimiento existente y nos dejan al descubierto los límites de nuestras teorías.

La Gravedad Cuántica, el eslabón perdido para comprender la evolución del Universo. Los físicos teóricos la han encontrado, ellos saben que dicha teoría subyace en la Teoría de Supercuerdas que, desgraciadamente, es inverificable… ¡Por el momento! Se cree que llegar hasta las cuerdas requeriría disponer de la energía de Planck (1019 GeV).

En los intentos más recientes de crear una teoría nueva para describir la naturaleza cuántica de la gravedad ha emergido un nuevo significado para las unidades naturales de Planck. Parece que el concepto al que llamamos “información” tiene un profundo significado en el universo. Estamos habituados a vivir en lo que llamamos “la edad de la información”.

La información puede ser empaquetada en formas electrónicas, enviadas rápidamente y recibidas con más facilidad que nunca antes. Nuestra evolución en el proceso rápido y barato de la información se suele mostrar en una forma que nos permite comprobar la predicción de Gordon Moore, el fundador de Intel, llamada ley de Moore, en la que, en 1.965, advirtió que el área de un transistor se dividía por dos aproximadamente cada 12 meses. En 1975 revisó su tiempo de reducción a la mitad hasta situarlo en 24 meses. Esta es “la ley de Moore” cada 24 meses se obtiene una circuiteria de ordenador aproximadamente el doble, que corre a velocidad doble, por el mismo precio, ya que, el coste integrado del circuito viene a ser el mismo, constante.

Representación gráfica de la obtención experimental de la constante de Planck

Los límites últimos que podemos esperar para el almacenamiento y los ritmos de procesamiento de la información están impuestos por las constantes de la naturaleza. En 1981, el físico israelí, Jacob Bekenstein, hizo una predicción inusual que estaba inspirada en su estudio de los agujeros negros. Calculó que hay una cantidad máxima de información que puede almacenarse dentro de cualquier volumen. Esto no debería sorprendernos. Lo que debería hacerlo es que el valor máximo está precisamente determinado por el área de la superficie que rodea al volumen, y no por el propio volumen. El número máximo de bits de información que puede almacenarse en un volumen viene dado precisamente por el cómputo de su área superficial en unidades de Planck. Supongamos que la región es esférica. Entonces su área superficial es precisamente proporcional al cuadrado de su radio, mientras que el área de Planck es proporcional a la longitud de Planck al cuadrado, 10-66 cm2. Esto es muchísimo mayor que cualquier capacidad de almacenamiento de información producida hasta ahora. Asimismo, hay un límite último sobre el ritmo de procesamiento de información que viene impuesto por las constantes de la naturaleza.

No debemos descartar la posibilidad de que seamos capaces de utilizar las unidades de Planck-Stoney para clasificar todo el abanico de estructuras que vemos en el universo, desde el mundo de las partículas elementales hasta las más grandes estructuras astronómicas. Este fenómeno se puede representar en un gráfico que recree la escala logarítmica de tamaño desde el átomo a las galaxias. Todas las estructuras del universo existen porque son el equilibrio de fuerzas dispares y competidoras que se detienen o compensan las unas a las otras; la atracción y la repulsión. Ese es el equilibrio de las estrellas donde la repulsión termonuclear tiende a expandirla y la atracción (contracción) de su propia masa tiende a comprimirla; así, el resultado es la estabilidad de la estrella. En el caso del planeta Tierra, hay un equilibrio entre la fuerza atractiva de la gravedad y la repulsión atómica que aparece cuando los átomos se comprimen demasiado juntos. Todos estos equilibrios pueden expresarse aproximadamente en términos de dos números puros creados a partir de las constantes e, h, c, G y mprotón.

En nuestro Universo todo es energía y el resultado de dos fuerzas contrapuestas que, al ser iguales en potencia, equilibran el todo y hace posible la estabilidad que podemos contemplar en las estrellas y en los átomos.

| α = 2πe2 / hc ≈ 1/137 |

| αG = (Gmp2)2 / hc ≈ 10-38 |

La identificación de constantes adimensionales de la naturaleza como a (alfa) y aG, junto con los números que desempeñan el mismo papel definitorio para las fuerzas débil y fuerte de la naturaleza, nos anima a pensar por un momento en mundos diferentes del nuestro. Estos otros mundos pueden estar definidos por leyes de la naturaleza iguales a las que gobiernan el universo tal como lo conocemos, pero estarán caracterizados por diferentes valores de constantes adimensionales. Estos cambios numéricos alterarán toda la fábrica de los mundos imaginarios. Los átomos pueden tener propiedades diferentes. La gravedad puede tener un papel en el mundo a pequeña escala. La naturaleza cuántica de la realidad puede intervenir en lugares insospechados.

Lo único que cuenta en la definición del mundo son los valores de las constantes adimensionales de la Naturaleza (así lo creían Einstein y Planck). Si se duplica el valor de todas las masas no se puede llegar a saber, porque todos los números puros definidos por las razones de cualquier par de masas son invariables.

Nunca nadie ha explicado el valor numérico de ninguna de las constantes de la naturaleza. ¿Recordáis el 137? Ese número puro, adimensional, que guarda los …

Cuando surgen comentarios de números puros y adimensionales, de manera automática aparece en mi mente el número 137. Ese número encierra más de lo que estamos preparados para comprender; me hace pensar y mi imaginación se desboca en múltiples ideas y teorías. Einstein era un campeón en esta clase de ejercicios mentales que él llamaba “libre invención de la mente”. El gran físico creía que no podríamos llegar a las verdades de la naturaleza sólo por la observación y la experimentación. Necesitamos crear conceptos, teorías y postulados de nuestra propia imaginación que posteriormente deben ser explorados para averiguar si existe algo de verdad en ellos.

Para poner un ejemplo de nuestra ignorancia poco tendríamos que buscar, tenemos a mano miles de millones.

Hablamos de portales cuánticos, fluctuaciones de vacío… Cuerdas y de Taquiones pero…

Un gran Físico nos decía:

“Todos los físicos del mundo, deberían tener un letrero en el lugar más visible de sus casas, para que al mirarlo, les recordara lo que no saben. En el cartel sólo pondría esto: 137. Ciento treinta y siete es el inverso de algo que lleva el nombre de constante de estructura fina”.

Este número guarda relación con la posibilidad de que un electrón emita un fotón o lo absorba. La constante de estructura fina responde también al nombre de “alfa” y sale de dividir el cuadrado de la carga del electrón, por el producto de la velocidad de la luz y la constante de Planck. Tanta palabrería y numerología no significan otra cosa sino que ese solo numero, 137, encierra los misterios del electromagnetismo (el electrón, e–), la relatividad (la velocidad de la luz, c), y la teoría cuántica (la constante de Planck, h).

¡Sabemos aun tan poco!

emilio silvera

Jun

16

¿Qué es un bosón? y ¿qué es un bosón gauge?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Un bosón es una partícula elemtal (o estado ligado de partículas elementales, por ejemplo, un núcleo atómico o átomo) con espín entero, es decir, una partícula que obedece a la estadísitca de Bose-Einstein (estadísictica cuántica), de la cual deriva su nombre. Los bosones son importantes para el Modelo estándar de las partículas. Son bosones vectoriales de espín uno que hacen de intermediarios de las interacciones gobernadas por teorías gauge.

En física se ha sabido crear lo que se llama el Modelo estándar y, en él, los Bosones quedan asociados a las tres fuerzas que lo conforman, el fotón es el Bosón intermediario del electromagnetismo, los W+, w– y Zº son bosones gauge que transmiten la fuerza en la teoría electrodébil, mientras que los gluones son los bosones de la fuerza fuerte, los que se encargan de tener bien confinados a los Quarks conformando protones y neutrones para que el núcleo del átomo sea estable. La Gravedad, no se ha dejado meter en el modelo y, por eso su bosón no es de gauge. El gravitón que sería la partícula mediadora de la gravitación sería el hipotético cuanto de energía que se intercambia en la interacción gravitacional.

Ejemplos de los Bosones gauge son los fotones en electrodinámica cuántica (en física, el fotón se representa normalmente con el símbolo  , que es la letra griega gamma), los gluones en cromodinámica cuántica y los bosones W y Z en el modelo de Winberg-Salam en la teoría electrodébil que unifica el electromagnetismo con la fuerza débil. Si la simetría gauge de la teoría no está rota, el bosón gauge es no masivo. Ejemplos de bosones gauge no masivos son el fotón y el gluón.

, que es la letra griega gamma), los gluones en cromodinámica cuántica y los bosones W y Z en el modelo de Winberg-Salam en la teoría electrodébil que unifica el electromagnetismo con la fuerza débil. Si la simetría gauge de la teoría no está rota, el bosón gauge es no masivo. Ejemplos de bosones gauge no masivos son el fotón y el gluón.

Si la simetría gauge de la teoría es una simetría rota el bosón gauge tiene masa no nula, ejemplo de ello son los bosones W y Z . Tratando la Gravedad, descrita según la teoría de la relatividad general, como una teoría gauge, el bosón gauge sería el gravitón, partícula no masiva y de espín dos.

Diagrama de Feynman mostrando el intercambio de un fotón virtual (simbolizado por una línea ondulada y  ) entre un positrón y un electrón.De esta manera podemos llegar a comprender la construcción que se ha hecho de las interacciones que están siempre intermediadas por un nosón mensajero de la fuerza.

) entre un positrón y un electrón.De esta manera podemos llegar a comprender la construcción que se ha hecho de las interacciones que están siempre intermediadas por un nosón mensajero de la fuerza.

En el modelo estándar, como queda explicado, hay tres tipos de bosones de gauge: fotones, bosones W y Z y gluones. Cada uno corresponde a tres de las cuatro interacciones: fotones son los bosones de gauge de la interacciones electromagnética, los bosones W y Z traen la interacción débil, los gluones transportan la interacción fuerte. El gravitón, que sería responsable por la interacción gravitacional, es una proposición teórica que a la fecha no ha sido detectada. Debido al confinamiento del color, los gluones aislados no aparecen a bajas energías.

Aquí, en el gráfico, quedan representadas todas las partículas del Modelo estándar, las familias de Quarks y Leptones que conforman la materia y los bones que intermedian en las interacciones o fuerzas fundamentales que están presentes en el Universo. La Gravedad no ha podido ser incluida y se ha negado a estar unida a las otras fuerzas. Así el bosón que la transmite, tampoco está en el modelo que es incompleto al dejar fuera la fuerza que mantiene unidos los planetas en los sistemas solares, a las galaxias en los cúmulos y nuestros pies unidos a la superficie del planeta que habitamos. Se busca una teoría que permita esta unión y, los físicos, la laman gravedad cuántica pero… ¡no aparece por ninguna parte!

Llegados a este punto tendremos que retroceder, para poder comprender las cosas, hasta aquel trabajo de sólo ocho páginas que publicó Max Planck en 1.900 y lo cambió todo. El mismo Planck se dio de que, todo lo que él había tenido por cierto durante cuarenta años, se derrumbaba con ese trabajo suyo que, venía a decirnos que el mundo de la materia y la nergía estaba hecho a partir de lo que el llamaba “cuantos”.

Supuso el nacimiento de la Mecánica Cuántica (MC), el fin del determinismo clásico y el comienzo de una nueva física, la Física Moderna, de la que la Cuántica sería uno de sus tres pilares junto con la Relatividad y la Teoría del Caos. Más tarde, ha aparecido otra teoría más moderna aún por comprobar, ¿las cuerdas…?

El universo según la teoría de las cuerdas sería entonces una completa extensa polícroma SINFONIA ETERNA de vibraciones, un multiverso infinito de esferas, una de ellas un universo independiente causalmente, en una de esas esferas nuestra vía láctea, en ella nuestro sistema solar, en él nuestro planeta, el planeta tierra en el cual por una secuencia milagrosa de hechos se dió origen a la vida autoconsciente que nos permite preguntarnos del cómo y del por qué de todas las cosas que podemos observar y, también, de las que intiuimos que están ahí sin que se dejen ver.

Claro que, cuando nos adentramos en ese minúsculo “mundo” de lo muy pequeño, las cosas difieren y se apartan de lo que nos dicta el sentido común que, por otra parte, es posible que sea el común de los sentidos. Nos dejamos guiar por lo que observamos, por ese mundo macroscópico que nos rodea y, no somos consciente de ese otro “mundo” que está ahí formando parte del universo y que, de una manera muy importante incide en el mundo de lo grande, sin lo que allí existe, no podría existir lo que existe aquí.

Interacciones en la naturaleza

Albert Einstein habría dicho que “es más importante la imaginación que el conocimiento”, el filósofo Nelson Goodman ha dicho que “las formas y las leyes de nuestros mundos no se encuentran ahí, ante nosotros, listas ser descubiertas, sino que vienen impuestas por las versiones-del-mundo que nosotros inventamos – ya sea en las ciencias, en las artes, en la percepción y en la práctica cotidiana-.”

Sin embargo yo, humilde pensador, me decanto por el hecho cierto de que, nuestra especie, siempre llegó al conocimiento a través de la imaginación y la experiencia primero, a la que más tarde, acompañó largas secciones de estudio y muchas horas de mediatación y, al final de todo eso, llego la experimentación que hizo posible llegar a lugarés ignotos que antes nunca, habían podido ser visitados. De todo ello, pudieron surgir todos esos “nuevos mundos” que, como la Mecanica Cuántica y la Relatividad, nos describían el propio mundo que nos era desconocido.

Cuando comencé éste trabajo sólo quería dar una simple explicación de los bosones y su intervención en el mundo de lo muy pequeño pero…

Demócrito de Abdera

No estaría mal echar una mirada hacia atrás en el tiempo y recordar, en este momento, a Demócrito que, con sus postulados, de alguna manera venía a echar un poco de luz sobre el asunto, dado que él decía que para determinar si algo era un á-tomo habría que ver si era indivisible. En el modelo de los quarks, el protón, en realidad, un conglomerado pegajoso de tres quarks que se mueven rápidamente. Pero como esos quarks están siempre ineludiblemente encadenados los unos a los otros, experimentalmente el protón aparece indivisible.

Acordémonos aquí de que Boscovich decía que, una partícula elemental, o un “á-tomo”, tiene que ser puntual. Y, desde luego, esa , no la pasaba el protón. El equipo del MIT y el SLAC, con la asesoría de Feynman y Bjorken, cayó en la cuenta de que en este caso el criterio operativo era el de los “puntos” y no el de la indivisibilidad. La traducción de sus a un modelo de constituyentes puntuales requería una sutileza mucho mayor que el experimento de Rutherford.

Precisamente por eso era tan conveniente fue tan conveniente para Richard Edward Taylor y su equipo, tener a dos de los mejores teóricos del mundo en el equipo aportando su ingenio, agudeza e intuición en todas las fases del proceso experimental. El resultado fue que los indicaron, efectivamente, la presencia de objetos puntuales en movimiento dentro del protón.

En 1990 Taylor, Friedman y Kendall recogieron su premio Nobel por haber establecido la realidad de los quarks. Sin embargo, a mí lo que siempre me ha llamado más la atención es el hecho cierto de que, este descubrimiento como otros muchos (el caso del positrón de Dirac, por ejemplo), han posible gracias al ingenio de los teóricos que han sabido vislumbrar cómo era en realidad la Naturaleza.

A todo esto, una buena sería: ¿cómo pudieron ver este tipo de partículas de tamaño infinitesimal, si los quarks no están libres y están confinados -en este caso- dentro del protón? Hoy, la tiene poco misterio sabiendo lo que sabemos y hasta donde hemos llegado con el LHC que, con sus inmensas energías “desmenuza” un protón hasta dejar desnudos sus más íntimos secretos.

Este es, el resultado ahora de la colisión de protones en el LHC

Lo cierto es que, en su momento, la teoría de los Quarks hizo muchos conversos, especialmente a medida que los teóricos que escrutaban los fueron imbuyendo a los quarks una realidad creciente, conociendo mejor sus propiedades y convirtiendo la incapacidad de ver quarks libres en una virtud. La de moda en aquellos momentos era “confinamiento”. Los Quarks están confinados permanentemente porque la energía requerida para separarlos aumenta a medida que la distancia entre ellos crece. Esa es, la fuerza nuclear fuerte que está presente dentro del átomo y que se encarga de transmitir los ocho Gluones que mantienen confinados a los Quarks.

Así, cuando el intento de separar a los Quarks es demasiado intenso, la energía se vuelve lo bastante grande para crear un par de quark-anti-quark, y ya tenemos cuatro quarks, o dos mesones. Es como intentar un cabo de cuerda. Se corta y… ¡ya tenemos dos!

¿Cuerdas? Me parece que estoy confundiendo el principal objetivo de este trabajo y, me quiero situar en el tiempo futuro que va, desde los quarks de Gell-Mann hasta las cuerdas de Veneziano y John Schwarz y más tarde Witten. Esto de la Física, a veces te juega malas pasadas y sus complejos caminos te llevan a confundir conceptos y momentos que, en realidad, y de manera individualizada, todos han tenido su propio tiempo y lugar.

¿Cuántas veces no habré pensado, en la posibilidad de tomar el elixir de la sabiduría para poder comprenderlo todo? Sin embargo, esa pósima mágica no existe y, si queremos , el único camino que tenemos a nuestro alcance es la observación, el estudio, el experimento… ¡La Ciencia!, que en definitiva, es la única que nos dirá como es, y como se producen los fenómenos que podemos contemplar en la Naturaleza y, si de camino, podemos llegar a saber el por qué de su comportamiento… ¡mucho mejor!

El camino será largo y, a veces, penoso pero… ¡llegaremos!

Nuestra insaciable curiosidad nos llevará lejos en el saber del “mundo”. llegaremos al corazón mismo de la materia para conmprobar si allí, como algunos imaginan, habitan las cuerdas vibrantes escondidas tan profundamente que no se dejan ver. Sabremos de muchos mundos habitados y podremos hacer ese primer contacto tántas veces soñado con otros seres que, lejos de nuestro región del Sistema solar, también, de manera independiente y con otros nombres, descubrieron la cuántica y la relatividad. Sabremos al fín qué es la Gravedad y por qué no se dejaba juntar con la cuántica. Podremos realizar maravillas que ahora, aunque nuestra imaginación es grande, ni podemos intuir por no tener la información necesaria que requiere la imaginación.

En fín, como decía Hilbert: ¡”Tenemos que saber, sabremos”!

emilio silvera

Totales: 74.212.956

Totales: 74.212.956 Conectados: 23

Conectados: 23