Mar

5

El Micro Mundo de los Átomos

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (2)

Comments (2)

Sí, existe otro mundo que no vemos pero…, ¡está en éste!

La mecánica cuántica domina en el micromundo de los átomos y de las partículas “elementales”. Nos enseña que en la naturaleza cualquier masa, por sólida o puntual que pueda parecer, tiene un aspecto ondulatorio. Esta onda no es como una onda de agua. Es una onda de información. Nos indica la probabilidad de detectar una partícula. La longitud de onda de una partícula, la longitud cuántica, se hace menor cuanto mayor es la masa de esa partícula.

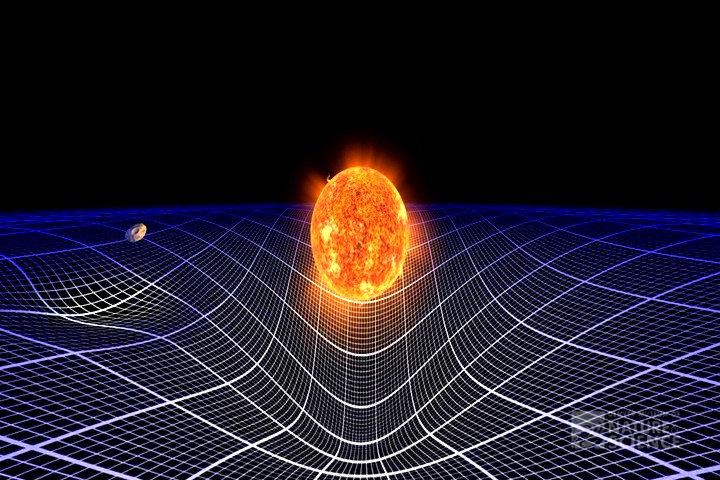

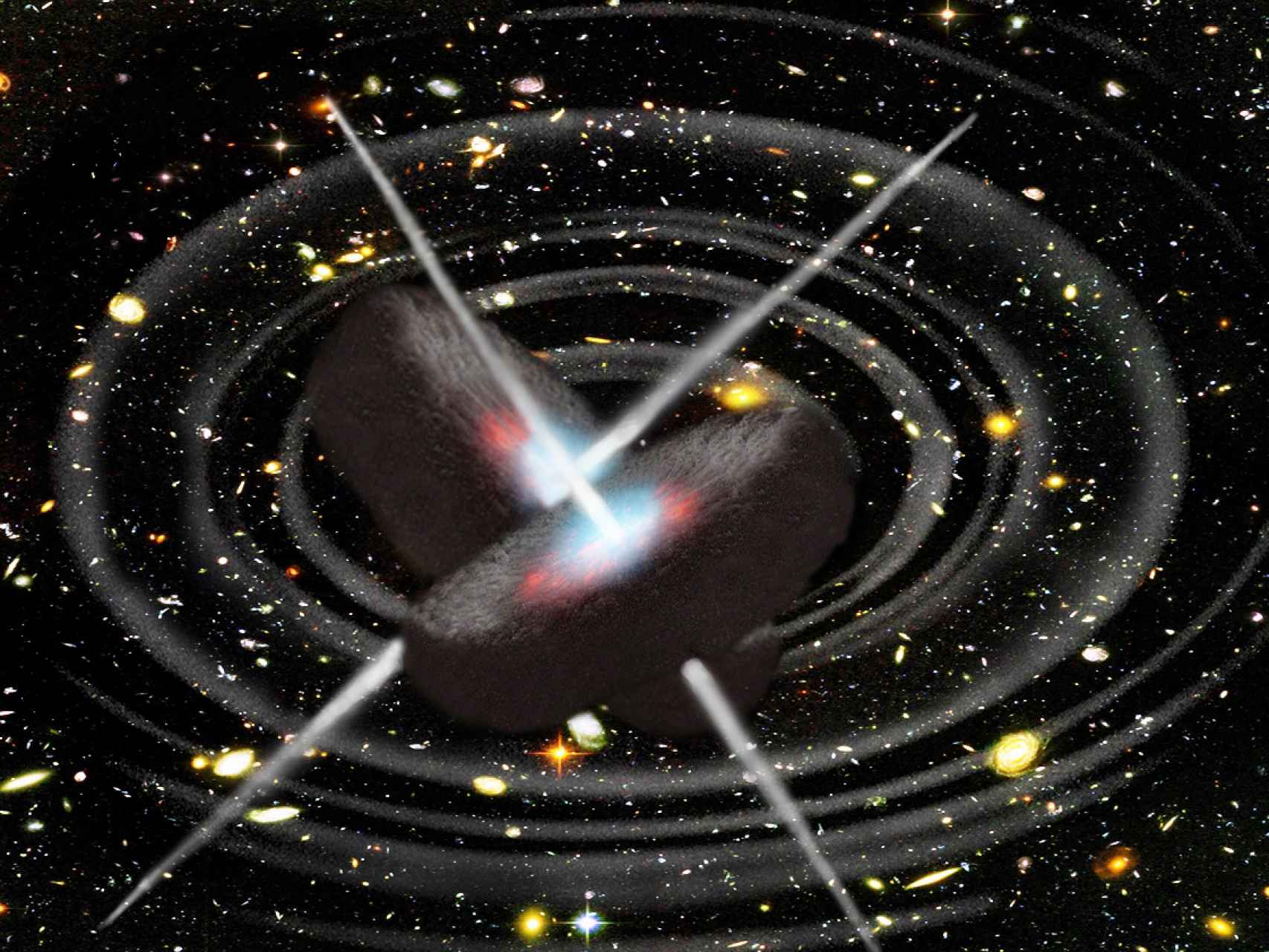

Por el contrario, la relatividad general era siempre necesaria cuando se trataba con situaciones donde algo viaja a la velocidad de la luz, o está muy cerca o donde la gravedad es muy intensa. Se utiliza para describir la expansión del universo o el comportamiento en situaciones extremas, como la formación de agujeros negros. Sin embargo, la gravedad es muy débil comparada con las fuerzas que unen átomos y moléculas y demasiado débil para tener cualquier efecto sobre la estructura del átomo o de partículas subatómicas, se trata con masas tan insignificantes que la incidencia gravitatoria es despreciable. Todo lo contrario que ocurre en presencia de masas considerables como planetas, estrellas y galaxias, donde la presencia de la gravitación curva el espacio y distorsiona el tiempo.

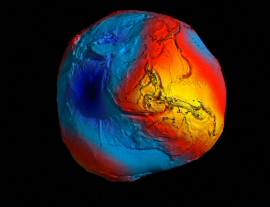

La Gravedad hace que la Tierra se vea como un mapa. Es una vista altamente exagerada, pero ilustra a las claras cómo la atracción gravitatoria que se manifiesta desde la masa de roca bajo nuestros pies no es la misma en todo lugar. La gravedad es más fuerte en áreas amarillas y más débil en las azules. (Imagen tomada por el satélite Goce)

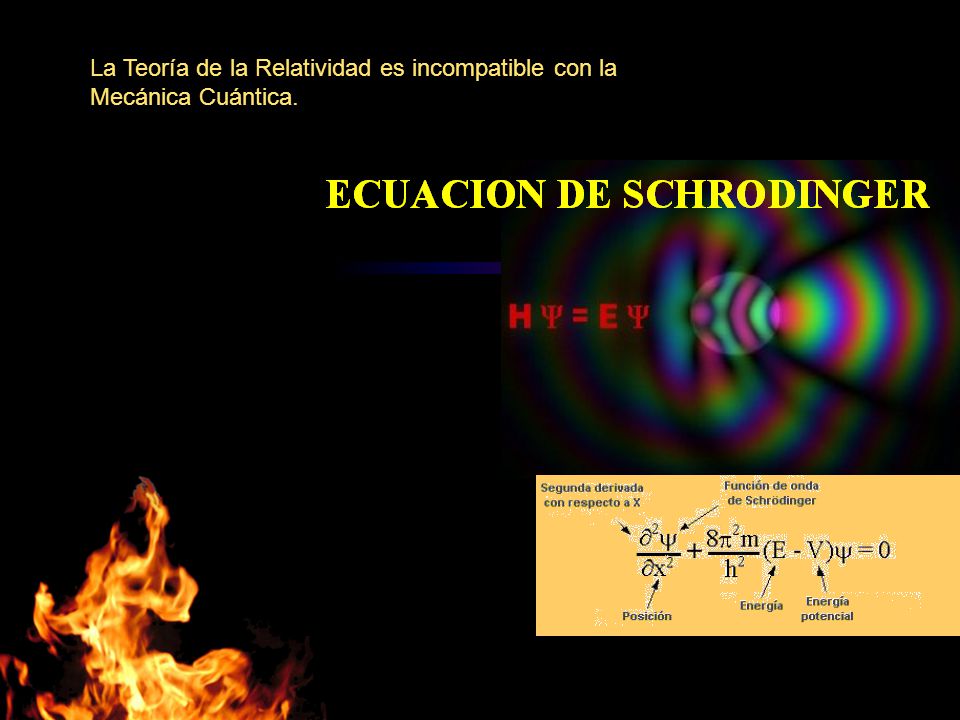

Como resultado de estas propiedades antagónicas, la teoría cuántica y la teoría relativista gobiernan reinos diferentes, muy dispares, en el universo de lo muy pequeño o en el universo de lo muy grande. Nadie ha encontrado la manera de unir, sin fisuras, estas dos teorías en una sola y nueva de Gravedad-Cuántica.

¿Cuáles son los límites de la teoría cuántica y de la teoría de la relatividad general de Einstein? Afortunadamente, hay una respuesta simple y las unidades de Planck nos dicen cuales son.

Supongamos que tomamos toda la masa del universo visible y determinamos su longitud de onda cuántica. Podemos preguntarnos en qué momento esta longitud de onda cuántica del universo visible superará su tamaño. La respuesta es: cuando el universo sea más pequeño en tamaño que la longitud de Planck, es decir, 10-33 centímetros, más joven que el Tiempo de Planck, 10-43 segundos y supere la temperatura de Planck de 1032 grados. Las unidades de Planck marcan la frontera de aplicación de nuestras teorías actuales. Para comprender en que se parece el mundo a una escala menor que la longitud de Planck tenemos que comprender plenamente cómo se entrelaza la incertidumbre cuántica con la gravedad. Para entender lo que podría haber sucedido cerca del suceso que estamos tentados a llamar el principio del universo, o el comienzo del tiempo, tenemos que penetrar la barrera de Planck. Las constantes de la naturaleza marcan las fronteras de nuestro conocimiento existente y nos dejan al descubierto los límites de nuestras teorías.

En los intentos más recientes de crear una teoría nueva para describir la naturaleza cuántica de la gravedad ha emergido un nuevo significado para las unidades naturales de Planck. Parece que el concepto al que llamamos “información” tiene un profundo significado en el universo. Estamos habituados a vivir en lo que llamamos “la edad de la información”. La información puede ser empaquetada en formas electrónicas, enviadas rápidamente y recibidas con más facilidad que nunca antes.

Los tiempos cambian y la manera de informar también, lejos nos queda ya aquellos toscos aparatos impresores del pasado, ahora, en espacios muy reducidos, tenemos guardada más información que antes había en una colección de libros.

Nuestra evolución en el proceso rápido y barato de la información se suele mostrar en una forma que nos permite comprobar la predicción de Gordon Moore, el fundador de Intel, llamada ley de Moore, en la que, en 1.965, advirtió que el área de un transistor se dividía por dos aproximadamente cada 12 meses. En 1.975 revisó su tiempo de reducción a la mitad hasta situarlo en 24 meses. Esta es “la ley de Moore” cada 24 meses se obtiene una circuiteria de ordenador aproximadamente el doble, que corre a velocidad doble, por el mismo precio, ya que, el coste integrado del circuito viene a ser el mismo, constante.

Los límites últimos que podemos esperar para el almacenamiento y los ritmos de procesamiento de la información están impuestos por las constantes de la naturaleza. En 1.981, el físico israelí, Jacob Bekenstein, hizo una predicción inusual que estaba inspirada en su estudio de los agujeros negros. Calculó que hay una cantidad máxima de información que puede almacenarse dentro de cualquier volumen. Esto no debería sorprendernos. Lo que debería hacerlo es que el valor máximo está precisamente determinado por el área de la superficie que rodea al volumen, y no por el propio volumen. El número máximo de bits de información que puede almacenarse en un volumen viene dado precisamente por el cómputo de su área superficial en unidades de Planck. Supongamos que la región es esférica. Entonces su área superficial es precisamente proporcional al cuadrado de su radio, mientras que el área de Planck es proporcional a la longitud de Planck al cuadrado, 10-66 cm2. Esto es muchísimo mayor que cualquier capacidad de almacenamiento de información producida hasta ahora. Asimismo, hay un límite último sobre el ritmo de procesamiento de información que viene impuesto por las constantes de la naturaleza.

La información llega a todos los rincones del Mundo

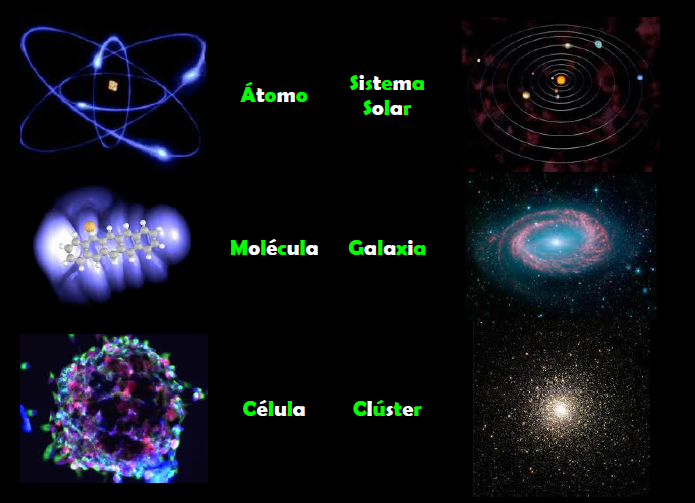

No debemos descartar la posibilidad de que seamos capaces de utilizar las unidades de Planck-Stoney para clasificar todo el abanico de estructuras que vemos en el universo, desde el mundo de las partículas elementales hasta las más grandes estructuras astronómicas. Este fenómeno se puede representar en un gráfico que recree la escala logarítmica de tamaño desde el átomo a las galaxias.

Todas las estructuras del universo existen porque son el equilibrio de fuerzas dispares y competidoras que se detienen o compensan las unas a las otras; la atracción y la repulsión. Ese es el equilibrio de las estrellas donde la repulsión termonuclear tiende a expandirla y la atracción (contracción) de su propia masa tiende a comprimirla; así, el resultado es la estabilidad de la estrella. En el caso del planeta Tierra, hay un equilibrio entre la fuerza atractiva de la gravedad y la repulsión atómica que aparece cuando los átomos se comprimen demasiado juntos. Todos estos equilibrios pueden expresarse aproximadamente en términos de dos números puros creados a partir de las constantes e, h, c, G y mprotón.

α = 2πe2 / hc ≈ 1/137

αG = (Gmp2)2 / hc ≈ 10-38

La identificación de constantes adimensionales de la naturaleza como a (alfa) y aG, junto con los números que desempeñan el mismo papel definitorio para las fuerzas débil y fuerte de la naturaleza, nos anima a pensar por un momento en mundos diferentes del nuestro.

Estos otros mundos pueden estar definidos por leyes de la naturaleza iguales a las que gobiernan el universo tal como lo conocemos, pero estarán caracterizados por diferentes valores de constantes adimensionales. Estos cambios numéricos alterarán toda la fábrica de los mundos imaginarios. Los átomos pueden tener propiedades diferentes. La gravedad puede tener un papel en el mundo a pequeña escala. La naturaleza cuántica de la realidad puede intervenir en lugares insospechados.

Lo único que cuenta en la definición del mundo son los valores de las constantes adimensionales de la naturaleza (así lo creían Einstein y Planck). Si se duplica el valor de todas las masas no se puede llegar a saber, porque todos los números puros definidos por las razones de cualquier par de masas son invariables.

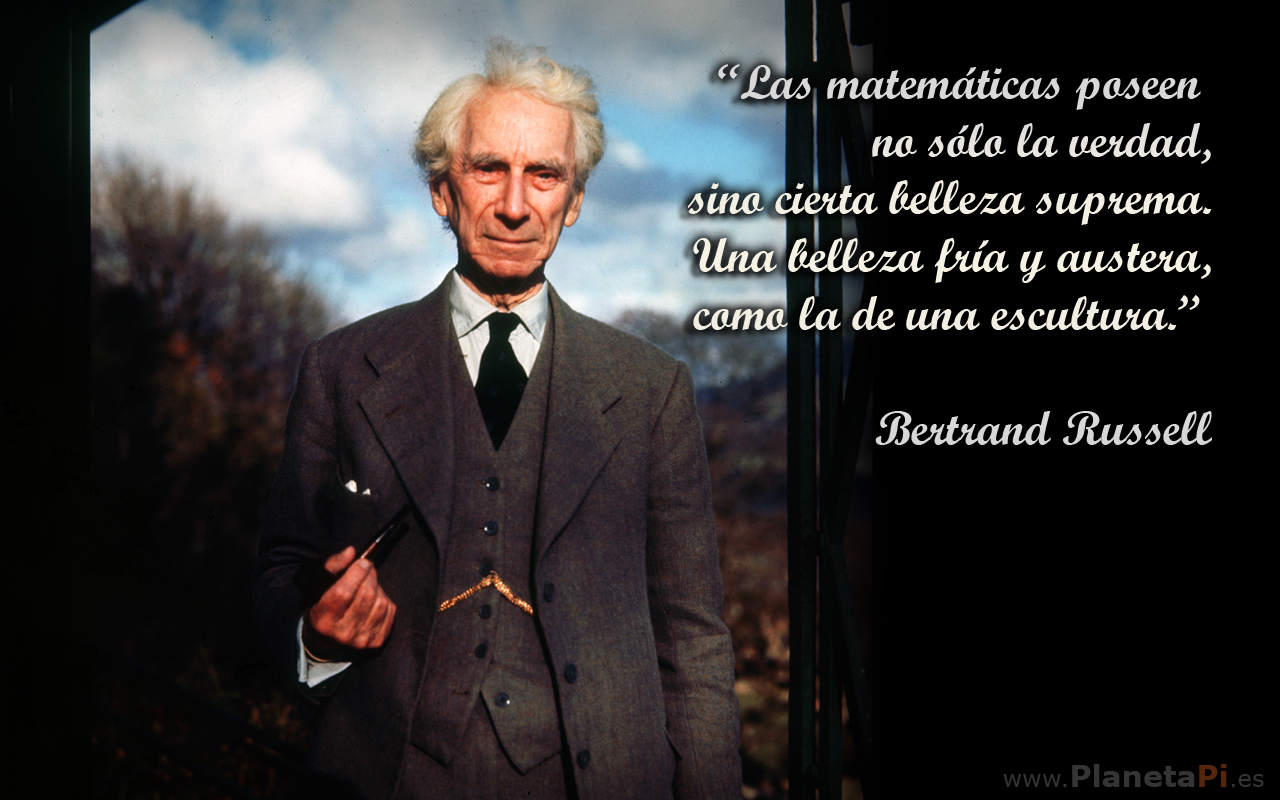

Cuando surgen comentarios de números puros y adimensionales, de manera automática aparece en mi mente el número 137. Ese número encierra más de lo que estamos preparados para comprender; me hace pensar y mi imaginación se desboca en múltiples ideas y teorías. Einstein era un campeón en esta clase de ejercicios mentales que él llamaba “libre invención de la mente”. El gran físico creía que no podríamos llegar a las verdades de la naturaleza sólo por la observación y la experimentación. Necesitamos crear conceptos, teorías y postulados de nuestra propia imaginación que posteriormente deben ser explorados para averiguar si existe algo de verdad en ellos. Con los adelantos actuales, estudiando la luz lejana de cuásares muy antiguos, se estudia si la constante de estructura fina (α) ha variado con el paso del tiempo.

El Universo es muy grande, inmensamente grande y, probablemente, todo lo que nuestras mentes puedan imaginar podrá exisitr en alguna parte de esas regiones perdidas en las profundidades cósmicas, en los confines del Espacio- Tiempo, en lugares ignotos de extraña belleza en los que otros mundos y otras criaturas tendrán, su propio habitat que, siendo diferente al nuestro, también, sus criaturas, estarán buscando el significado de las leyes del Universo.

emilio silvera

Feb

18

¡La misteriosa Mecánica cuántica! y, “sus alrededores”

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

¡Qué maravilla! Poder imaginar…y comprobar

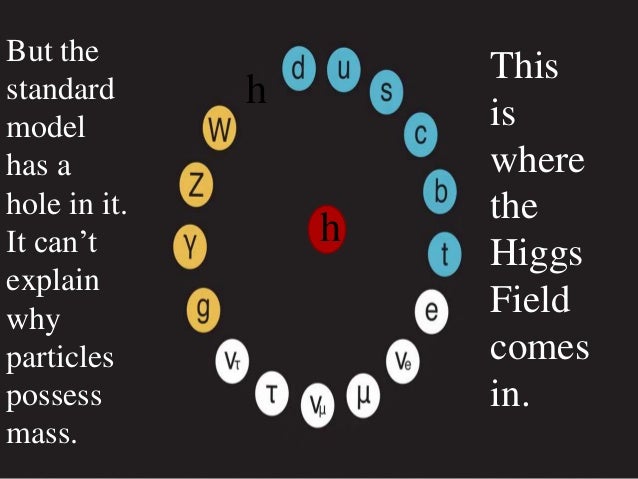

El modelo estándar de la física de partículas es una teoría que describe las relaciones entre las interacciones fundamentales conocidas y las partículas elementales que componen toda la materia. Es una teoría cuántica de campos desarrollada entre 1970 y 1973 que es consistente con la mecánica cuántica y la relatividad especial. Hasta la fecha, casi todas las pruebas experimentales de las tres fuerzas descritas por el modelo estándar están de acuerdo con sus predicciones. Sin embargo, el modelo estándar no alcanza a ser una teoría completa de las interacciones fundamentales debido a que no incluye la gravedad, la cuarta interacción fundamental conocida, y debido también al número elevado de parámetros numéricos (tales como masas y constantes que se juntan) que se deben poner a mano en la teoría (en vez de derivarse a partir de primeros principios).

Se que una vez Albert Einstein alagó al actor Charles Chaplin diciéndole: “Lo que siempre he admirado de usted es que su arte es universal, todo el mundo le comprende y admira”. A esto Chaplin respondió a Einstein: “Lo suyo es mucho más digno de respeto, todo el mundo le admira y prácticamente nadie le comprende”.

Es cierto lo que Chaplin decía, todos admiraban a Einstein y pocos comprendían sus postulados. De hecho, cuando estaba buscando la teoría de Todo, la gente se amontonaban, literalmente, ante los escaparates de la Quinta Avenida para ver las Ecuaciones que pocos entendían…¡Así somos los Humanos! Lo que no comprendemos nos produce temor o admiración, o, las dos cosas a la vez.

Gerad ´t Hooft

Hace algún tiempo, me desplace a Madrid invitado asistir a una Conferencia que sobre el LHC y el Bosón de Higgs impartía el físico y premio Nobel de Física Gerad ´t Hooft. La charla de ‘t Hooft se inscribía en el ciclo La ciencia y el cosmos, y, entre otras cosas nos decía a los presentes que, La física, en concreto la física de partículas, ha sido siempre su gran pasión. “cuando era joven, la física estaba cambiando el mundo radicalmente: la energía nuclear, la televisión, los ordenadores, las primeras misiones espaciales…. yo quería formar parte de todo eso”. Y las partículas elementales “eran el mayor misterio de todos”, añade. “En cierto modo aún lo son, aunque sabemos de ellas muchísimo más que entonces. Hoy los ordenadores siguen siendo emocionantes, la biología y el código del ADN, la astronomía y los vuelos espaciales… Sigue habiendo muchas cosas capaces de estimular la imaginación de jóvenes deseosos de aprender cosas nuevas impulsados por el deseo de estar ahí, en el momento en que se están haciendo los descubrimientos que cambian el mundo”.

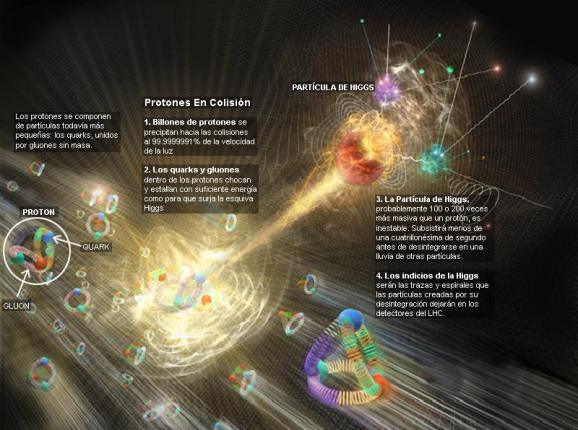

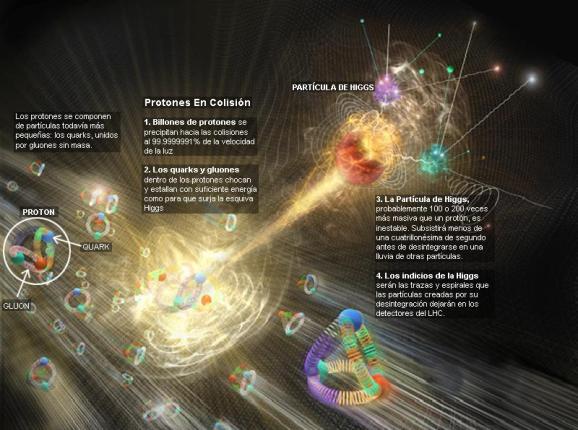

Gerard ‘t Hooft explicó lo que significa, en los modelos teóricos, el famoso bosón: “El campo de la partícula de Higgs actúa como una especie de árbitro; proyectado contra otras partículas, este campo determina su comportamiento, si tienen carga o masa y hasta qué punto se diferencian de otras partículas. Si no encontramos el Higgs, si realmente no está, necesitaremos algo más que haga ese papel de árbitro”. Eso significaría, continuaba el Nobel, que “nuestras teorías ya no funcionan, y han funcionado tan bien hasta que eso es difícil de imaginar”.

Claro que, después de aquello se encontró el Bosón de Higgs y todos contentos. Ahora se busca el Fotón oscuro en el LHC.

Sí al LHC se le resiste el Bosón de Higgs…, bueno, si es que anda por ahí

Fue en 199 cuando ‘t Hooft recibió el premio Nobel de Física 1999 (junto con su colega y director de tesis Martinus Veltman), por “dilucidar la estructura cuántica de las interacciones electrodébiles” -según palabras de la Academia sueca- de la física de las partículas elementales.

Acera del Gran Colisionador de Hadrones (el acelerador LHC situado en el Laboratorio Europeo de Física de partículas, CERN, junto a Ginebra), el científico holandés explica que se trata “de una máquina única en el mundo” y continúa: “Esperamos descubrir nuevas cosas con él y poner a prueba teorías que, hasta donde hemos podido comprobar hasta , funcionan muy bien, pero necesitamos ir más allá”.

El descubrimiento de la partícula de Higgs, o bosón de Higgs, era el objetivo número uno del LHC, y tras un largo período de funcionamiento del acelerador, los miles de físicos que trabajan en los detectores, han logrado acotar el terreno de búsqueda, aunque, insisten, seguramente necesitarán tomar muchos más para descubrirlo. O tal vez descubrir que no existe, lo que supondría una revolución en la física de partículas, al obligar a replantear el llamado Modelo Estándar, que describe todas las partículas elementales y sus interacciones, y que hasta ahora funciona con altísima precisión aunque, dicen los expertos, está incompleto.

Al fin, tras largo búsqueda y trabajo, nos hicieron partícipe del esperado descubrimiento que viene a refrendar el Modelo Estándar que, incompleto aún, con el dichoso Bosón queda mejor conformado al desaparecer uno de los casi veinte parámetros aleatorios que en él están presentes.

Gerard ‘t Hooft, uno de los grandes físicos teóricos de partículas elementales, considera que será muy difícil desarrollar una teoría del todo, un cuerpo teórico capaz de explicar todas las fuerzas que actúan en la naturaleza aunando la Relatividad General de Einstein y la Mecánica Cuántica, tan eficaces por separado en la descripción del macrocosmos y el microcosmos, respectivamente. “Mi impresión es que esta teoría unificadora, una teoría del todo, aún requerirá el trabajo de muchas nuevas generaciones de investigadores jóvenes y listos”, afirma. “No llegaremos a ella de un momento a otro por la simple razón de que el universo es demasiado complejo para que una única teoría lo abarque todo. Vale, no digo que sea imposible, pero me parece muy improbable. Y mientras llega, queda mucho por , incluso hallazgos espectaculares”.

El CERN, a la caza del misterioso Fotón oscuro

Por otra parte, el científico holandés ha señalado que el LHC realiza más actividades que intentar encontrar el bosón de Higgs. En este sentido, ha destacado que se buscan también partículas que podrían construir la materia oscura, un de materia de la que los físicos tienen la certeza de que es cinco veces más abundante que el universo que la materia ‘normal’, pero que no absorbe, refleja ni emite luz, lo que hace muy difícil su detección y, por tanto, estudiar su naturaleza. Del mismo modo, también se está desarrollando una teoría capaz de unificar la teoría de la relatividad general de Einstein y la mecánica cuántica que, según ha explicado Hooft, “permitiría lo que ocurre dentro de los átomos”.

Recuerdo un pasaje escrito por él al principio de su interesante e instructivo libro “Partículas Elemetales”, que decía:

“Mi intención es narrar los últimos 25 años de investigación sobre las partículas más pequeñas que constituyen la materia. Durante esos 25 años, yo empecé a ver la Naturaleza como un test de inteligencia para toda la humanidad en su conjunto, como un gigantesco con el que podemos jugar. Una y otra vez, nos tropezamos con nuevas piezas, grandes y pequeñas, que encajan maravillosamente con las que ya tenemos. Yo quiero compartir con ustedes la sensación de triunfo que sentimos en esos momentos.”

Tenía la intención (si se presentaba la oportunidad), de preguntarle sobre “su Principio Holográfico” pero, no pudo ser. Sólo pude saludarlo e intercambiar unas breves palabras junto con Ignacio Cirac presente en el evento.

Publicó el principio holográfico, el cual explica que la información de una dimensión extra es visible una curvatura del espacio tiempo con una menos dimensiones. Por ejemplo, los hologramas son imágenes de 3 dimensiones colocadas en una superficie de 2 dimensiones, el cual da a la imagen una curvatura cuando el observador se mueve. Similarmente, en relatividad general, la cuarta dimensión manifestada en 3 dimensiones observables como la curvatura de un sendero de un movimiento de partícula (criterio) infinitesimal. Hooft ha especulado que la quinta dimensión es realmente la fábrica del espacio-tiempo.

Acordaos de que, a mediados del año 2,003 apareció la noticia de que la “información sería el componente fundamental de la naturaleza” postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, basadas en el “Principio Holográfico”. teoría, por singular y chocante que pareciese en su momento ha tenido a lo largo de estos siete años una influencia notable tanto en la sociedad científica como en los círculos alternativos.

Personajes tan influyentes Deepak Chopra sin ir más lejos habla del ámbito cuántico como el campo de información de donde todo lo conocido, materia, emociones, pensamientos. El controvertido joven físico Nassam Haramein defiende un universo basado en el holograma. Científicos japoneses -al igual que del resto del mundo- investigan con hologramas creando imágenes 3D o explican el funcionamiento del mundo físico basado en los campos de energía e información. Hay hasta “farmacología holográfica” a cargo de empresas farmaceúticas. El año pasado el físico Craig Hogan tras la detección de un extraño ruido en el detector de ondas gravitacionalesel GEO 600, afirma que podría probar que, efectivamente, vivimos en un holograma.

La información sería el componente fundamental de la naturaleza. Es la que especifica el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia. El Big Bang que dio lugar al nacimiento del Universo tendría más que ver con una gigantesca “bajada” de bytes de información por parte de un superordenador, que con una explosión masiva de materia, según una nueva teoría que establece que en su origen la naturaleza está formada únicamente por pequeños paquetes de información pura que son los que especifican el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia.

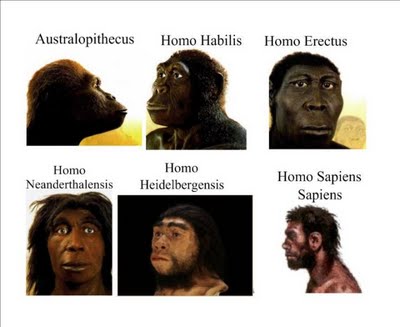

Mucho antes de que todos estos seres existieran ocurrieron muchas cosas que no sabemos. Nuestro origen no está en ninguno de ellos, sino que, partiendo de células replicantes que evolucionaron durante algunos millones de años, pudimos llegar a “SER”.

El Ser humano continúa con su carrera particular para lo que siempre ha querido saber: quiénes somos y de dónde venimos. Esas dos preguntas esenciales son, en realidad, el motor gracias al cual se mueve gran parte de la investigación científica de todos los tiempos.

En carrera por buscar certezas, cosas tan inquebrantables para explicar el origen del mundo como son los átomos o los quarks están quedando relegados a segundo término para dar paso a nuevas teorías.

Una de las más interesantes, postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, afirma que en el origen de la naturaleza podría haber únicamente ultrapequeños paquetes de información pura.

Aunque parezca raro la información no viaja en un bloque como lo haría una carta, sino que se divide en pequeños paquetes de información, viajando a través de los diferentes canales de la red y llegando todos al mismo punto. Para esto es preciso que todos los ordenadores hablen el mismo idioma, o lo que es decir el Protocolo TCP/IP, (que es el idioma) que en un principio empezó a usarse en 1983 para dirigir el tráfico de los paquetes de información por Arpanet, garantizando así que todos lleguen a su destino.

La @ que parece que nació a partir de internet se utilizaba en la antigüedad, como unidad de peso o incluso para decir a cuanto costaba algo en libros de contabilidad. Sin embargo se puso de moda gracias al ingeniero estadounidense Ray Tomilson, que diseñaba un sistema de correo electrónico para Arpanet, simplemente bajo los ojos al teclado y eligió un signo que no se utilizara en los nombres de usuario.

Según explica al respecto Newsfactor, teoría, basada en el “Principio holográfico”, establece que la información (“información” en este caso significa bits fundamentales de materia y las leyes físicas que los gobiernan) especifica el cuándo, dónde, cómo y cuánto del espacio, del tiempo y de la materia. La información sería pues, una variable para llegar a una “teoría del todo”.

Y, más allá de las cuerdas…

Según la teoría cuerdas, el espacio está descrito por la vibración, en miles de maneras, de diminutas cuerdas de una dimensión. Una cuerda vibrando arriba y abajo a cierta frecuencia podría crear un átomo de helio o una ola gravitacional, tal y las cuerdas de una guitarra crean diferentes sonidos a diferentes frecuencias.

Los teóricos de teoría han mantenido hace mucho tiempo que estas cuerdas son el componente fundamental de la naturaleza. El “Principio Holográfico”, sin embargo, cambia esta noción y mantiene que, mirando más de cerca una cuerda, se ven bits cuánticos, llamados “baldosas de Planck”, que, engarzados, dicen a las cuerdas como tienen que vibrar.

Una de las más interesentes, postulada por un grupo de físicos entre los que se incluyen el Premio Nóbel danés Gerard t´Hooft y el físico de la Universidad de California Raphael Bousso, afirma que en el origen de la naturaleza podría haber únicamente ultrapequeños paquetes de información pura.

Estas “baldosas de Planck” son bits cuadrados que delimitan un “área de Planck”, o lo que es lo mismo, un trillón de un trillón, de un trillón de un trillón de un trillón de un trillón de un centímetro cuadrado. Una cuerda de baldosas de Plank sería la versión natural de un byte.

El “Principio Holográfico”, descrito por Gerard t´Hooft y Leonard Susskind y refinado por Bousso, nos permite saber cuántos (bits y bytes) son necesarios para decirnos en detalle cada cosa que ocurre en cualquier región del espacio.

¡Por imaginación que no quede!

emilio silvera

Feb

6

Entrelazamiento cuántico

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (2)

Comments (2)

En 1935 un molesto Albert Einstein, junto con sus colegas Podolsky y Rosen, presentaron la llamada “paradoja EPR”, por sus iniciales. Esta quería servir de ejemplo para decir que la mecánica cuántica era una “teoría” incompleta y fallida. Que necesitaba de una profunda revisión. ¿Y por qué? Porque, según el propio Einstein, este conjunto de hipótesis violaba el universo tal y como lo conocemos. Por lo tanto, tenía que estar mal en algún punto. Sin embargo, lo que no sabía Einstein es que la paradoja presentada es en realidad una manifestación real de lo que ocurre en la naturaleza. Efectivamente, en los tiempos que corren hemos podido comprobar un fenómeno inquietante y extraordinario que permite que dos partículas separadas entre sí por una distancia monstruosa sean capaces de “comunicarse” sin que exista nada, ningún canal de transmisión, entre las dos. A este extraño fenómeno, que rompe por completo nuestra manera de entender el mundo, lo llamamos entrelazamiento cuántico.

Científicos del Instituto de Óptica Cuántica e Información Cuántica (IQOQI) de la Academia Austríaca de Ciencias, de la Universidad de Viena y de la Universidad Autónoma de Barcelona (UAB) han conseguido por primera vez entrelazar tres partículas de luz o fotones utilizando una propiedad cuántica relacionada con el retorcimiento (twist) de la estructura de sus frentes de onda.

De la misma manera que el famoso gato de Schrödinger está simultáneamente vivo y muerto, todas las demostraciones experimentales realizadas hasta ahora de entrelazamiento de varias partículas han sido llevadas a cabo con objetos cuánticos en dos dimensiones, dos niveles discretos posibles. Los fotones retorcidos utilizados en el experimento de Viena no tienen ese límite bidimensional y pueden existir en tres o más estados cuánticos vez.

El estado de entrelazamiento entre tres fotones creado por el grupo de Viena bate el récord previo de dimensionalidad, y da luz a una nueva forma de entrelazamiento asimétrico que nunca ha sido observado hasta ahora. Los resultados aparecen esta semana publicados en Nature Photonics.

![]()

![]()

El entrelazamiento es una propiedad antiintuitiva de la física cuántica que siempre ha desconcertado a los científicos y los filósofos. Los cuantos de luz entrelazados parecen ejercer una influencia entre ellos, no importa la distancia a la que se encuentren. De manera metafórica puede considerarse un patinador de hielo con la asombrosa habilidad de girar sobre sí mismo tanto en el sentido de las agujas del reloj como en el sentido contrario, al mismo tiempo.

Un par de patinadores entrelazados alejándose entre ellos mientras hacen este sorprendente giro tendrán las direcciones de giro perfectamente correlacionadas: si en un instante el primero gira en un sentido, también lo hace el otro, aunque estén tan lejos que terminen en pistas en continentes diferentes.

“Los fotones entrelazados de nuestro experimento se pueden ilustrar no con dos, sino con tres patinadores, danzando una coreografía cuántica pefectamente sincronizada”, explica Mehul Malik, el primer autor del artículo. “Su danza es un poco más compleja, con dos de los patinadores mostrando, además, otro movimiento correlacionado, además del giro mencionado. De hecho, somos los primeros que hemos conseguido este tipo de entrelazamiento cuántico asimétrico en el laboratorio”, continúa Malik.

Los investigadores han creado el estado de entrelazamiento entre tres fotones utilizando otro artificio cuántico: han combinado dos pares de fotones con entrelazamiento de alta dimensión de tal manera que era imposible saber de dónde procedía cada uno de los fotones. Aparte de servir como campo de pruebas para estudiar muchos conceptos fundamentales de la mecància cuántica, los estados de entrelazamiento de varios fotones vez, como este, tienen aplicaciones que van desde la computación cuántica hasta la encriptación cuántica.

En esta línea, los autores de la investigación proponen un nuevo tipo de protocolo de criptografía cuántica, basado en este estado de entrelazamiento asimétrico, que permite que diferentes capas de información se compartan de forma asimétrica entre varios emisores y destinatarios con total seguridad.

Los científicos consideran que, aunque todavía habrá que solventar muchos obstáculos técnicos antes de que este protocolo se pueda utilizar en la práctica, el rápido progreso de la tecnología cuántica hace que sea sólo cuestión de tiempo que esta tecnología encuentre su lugar en las redes cuánticas del futuro. “El experimento abre las puertas a un futuro Internet cuántico, con más de dos interlocutores, que permitiría una comunicación de más de dos bits por fotón”, añade Zeilinger.

En la investigación ha participado Mehul Malik, Manuel Erhard, Mario Krenn, Robert Fickler, Anton Zeilinger, del Instituto de Óptica Cuántica e Información Cuántica de la Academia Austríaca de Ciencia (IQOQI) y el investigador del Grupo de información y de Fenómenos Cuánticos del Departamento de Física de la UAB Marcus Huber, físico teórico que ha inventado las técnicas necesarias para analizar el experiemento. La investigación ha sido financiada por la Comisión Europea, el Consejo Europeo de Investigación (ERC) y la Austrian Science Fund (FWF). (Fuente: UAB)

Feb

5

Teorías, masas, partículas, dimensiones…

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Las Teorías:

Una nos habla del Cosmos y de como el espacio se curva ante la presencia de masas, la otra, nos habla de funciones de ondas, entrelazamientos cuánticos, de diminutos objetos que conforman la materia y hacen posibles los átomos y la vida.

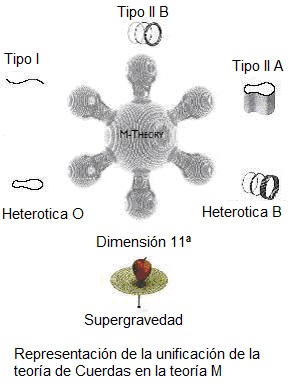

Entre los teóricos, el casamiento de la relatividad general y la teoría cuántica es el problema central de la física moderna. A los esfuerzos teóricos que se realizan con ese propósito se les llama “supergravedad”, “súpersimetría”, “supercuerdas” “teoría M” o, en último caso, “teoría de todo o gran teoría unificada”.

Ahí tenemos unas matemáticas exóticas que ponen de punta hasta los pelos de las cejas de algunos de los mejores matemáticos del mundo (¿y Perelman? ¿Por qué nos se ha implicado?). Hablan de 10, 11 y 26 dimensiones, siempre, todas ellas espaciales menos una que es la temporal. Vivimos en cuatro: tres de espacio (este-oeste, norte-sur y arriba-abajo) y una temporal. No podemos, ni sabemos o no es posible instruir, en nuestro cerebro (también tridimensional), ver más dimensiones. Pero llegaron Kaluza y Klein y compactaron, en la longitud de Planck las dimensiones que no podíamos ver. ¡Problema solucionado!

La longitud de Planck (ℓP) u hodón (término acuñado en 1926 por Robert Lévi) es la distancia o escala de longitud por debajo de la cual se espera que el espacio deje de tener una geometría clásica. Una medida inferior previsiblemente no puede ser tratada adecuadamente en los modelos de física actuales debido a la aparición de efectos de Gravedad Cuántica.

¿Quién puede ir a la longitud de Planck para verla? A distancias comparables con la longitud de Planck, se cree que están sucediendo cosas muy curiosas que rebasan ampliamente los límites de nuestra imaginación. A diferencia de la filosofía reduccionista que propone que lo más complejo está elaborado -axiomáticamente- a partir de lo más elemental, lo que está sucediendo en la escala de Planck no parece tener nada de elemental o sencillo. Se cree que a esta escala la continuidad del espacio-tiempo en vez de ir marchando sincronizadamente al parejo con lo que vemos en el macrocosmos de hecho stá variando a grado tal que a nivel ultra-microscópico el tiempo no sólo avanza o se detiene aleatoriamente sino inclusive marcha hacia atrás, una especie de verdadera máquina del tiempo. Las limitaciones de nuestros conocimientos sobre las rarezas que puedan estar ocurriendo en esta escala en el orden de los 10-35 metros, la longitud de Planck, ha llevado a la proposición de modelos tan imaginativos y tan exóticos como la teoría de la espuma cuántica que supuestamente veríamos aún en la ausencia de materia-energía si fuésemos ampliando sucesivamente una porción del espacio-tiempo plano.

La puerta de las dimensiones más altas quedó abierta y, a los teóricos, se les regaló una herramienta maravillosa. En el Hiperespacio, todo es posible. Hasta el matrimonio de la relatividad general y la mecánica cuántica, allí si es posible encontrar esa soñada teoría de la Gravedad cuántica.

Así que, los teóricos, se han embarcado a la búsqueda de un objetivo audaz: buscan una teoría que describa la simplicidad primigenia que reinaba en el intenso calor del universo en sus primeros tiempos, una teoría carente de parámetros, donde estén presentes todas las respuestas. Todo debe ser contestado a partir de una ecuación básica.

¿Dónde radica el problema?

El problema está en que la única teoría candidata no tiene conexión directa con el mundo de la observación, o no lo tiene todavía si queremos expresarnos con propiedad. La energía necesaria para ello, no la tiene ni el nuevo acelerador de partículas LHC que mencioné en páginas anteriores.

La verdad es que, la teoría que ahora tenemos, el Modelo Estándar, concuerda de manera exacta con todos los datos a bajas energías y contesta cosas sin sentido a altas energías.

¡Necesitamos algo más avanzado!

Cada partícula tiene encomendada una misión

Se ha dicho que la función de la partícula de Higgs es la de dar masa a las demás partículas. Cuando su autor lanzó la idea al mundo, resultó además de nueva muy extraña. El secreto de todo radica en conseguir la simplicidad: el átomo resulto ser complejo lleno de esas infinitesimales partículas electromagnéticas que bautizamos con el nombre de electrones, resultó que tenía un núcleo que contenía, a pesar de ser tan pequeño, casi toda la masa del átomo. El núcleo, tan pequeño, estaba compuesto de otros objetos más pequeños aún, los quarks que estaban instalados en nubes de otras partículas llamadas gluones y, ahora, queremos continuar profundizando, sospechamos, que después de los quarks puede haber algo más.

Bueno, la idea nueva que surgió es que el espacio entero contiene un campo, el campo de Higgs, que impregna el vacío y es el mismo en todas partes. Es decir, que si miramos a las estrellas en una noche clara estamos mirando el campo de Higgs. Las partículas influidas por este campo, toman masa. Esto no es por sí mismo destacable, pues las partículas pueden tomar energía de los campos (gauge) de los que hemos comentado, del campo gravitatorio o del electromagnético. Si llevamos un bloque de plomo a lo alto de la Torre Eiffel, el bloque adquiriría energía potencial a causa de la alteración de su posición en el campo gravitatorio de la Tierra.

Cuando los físicos hablan de la belleza de algunas ecuaciones, se refieren a las que, como ésta, dicen mucho con muy pocos caracteres. De hecho, puede que ésta sea la ecuación más famosa conocida en nuestro mundo.

Como E=mc2, ese aumento de la energía potencial equivale a un aumento de la masa, en este caso la masa del Sistema Tierra-bloque de plomo. Aquí hemos de añadirle amablemente un poco de complejidad a la venerable ecuación de Einstein. La masa, m, tiene en realidad dos partes. Una es la masa en reposo, m0, la que se mide en el laboratorio cuando la partícula está en reposo. La partícula adquiere la otra parte de la masa en virtud de su movimiento (como los protones en el acelerador de partículas, o los muones, que aumentan varias veces su masa cuando son lanzados a velocidades cercanas a c) o en virtud de su energía potencial de campo. Vemos una dinámica similar en los núcleos atómicos. Por ejemplo, si separamos el protón y el neutrón que componen un núcleo de deuterio, la suma de las masas aumenta.

Pero la energía potencial tomada del campo de Higgs difiere en varios aspectos de la acción de los campos familiares. La masa tomada de Higgs es en realidad masa en reposo. De hecho, en la que quizá sea la versión más apasionante de la teoría del campo de Higgs, éste genera toda la masa en reposo. Otra diferencia es que la cantidad de masa que se traga del campo es distinta para las distintas partículas.

Los teóricos dicen que las masas de las partículas de nuestro modelo estándar miden con qué intensidad se acoplan éstas al campo de Higgs.

La influencia de Higgs en las masas de los quarks y de los leptones, nos recuerda el descubrimiento por Pieter Zeeman, en 1.896, de la división de los niveles de energía de un electrón cuando se aplica un campo magnético al átomo. El campo (que representa metafóricamente el papel de Higgs) rompe la simetría del espacio de la que el electrón disfrutaba.

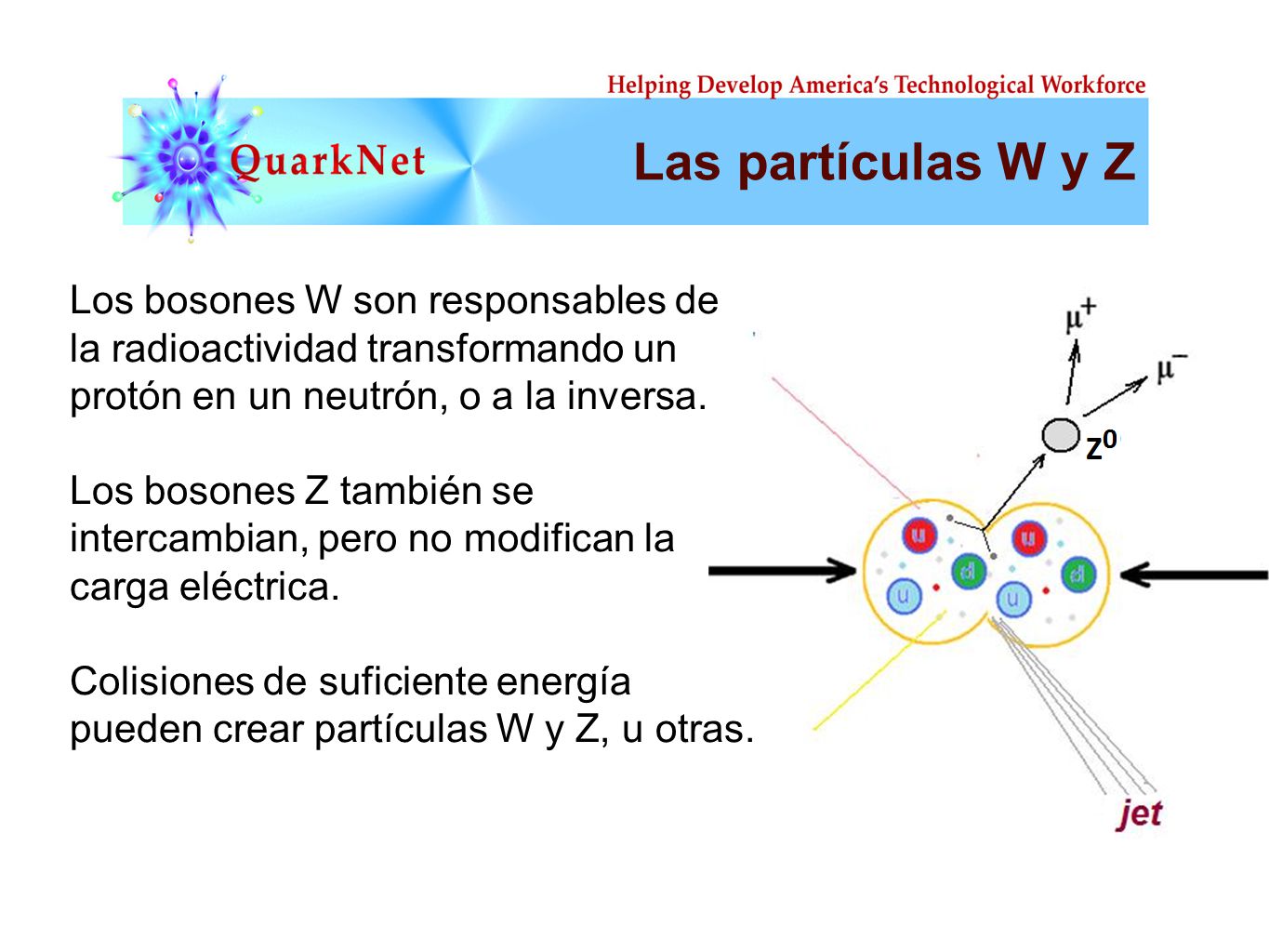

Hasta hace bien poco no teniamos ni idea de que reglas controlan los incrementos de masa generados por el Higgs (de ahí la expectación creada por el nuevo acelerador de partículas LHC cuando la buscaba). Pero el problema es irritante: ¿por qué sólo esas masas -Las masas de los W+, W–, y Zº, y el up, el down, el encanto, el extraño, el top y el bottom, así como los leptones – que no forman ningún patrón obvio?

Las masas van de la del electrón 0’0005 GeV, a la del top, que tiene que ser mayor que 91 GeV. Deberíamos recordar que esta extraña idea (el Higgs) se empleó con mucho éxito para formular la teoría electrodébil (Weinberg-salam). Allí se propuso el campo de Higgs como una forma de ocultar la unidad de las fuerzas electromagnéticas y débiles. En la unidad hay cuatro partículas mensajeras sin masa -los W+, W–, Zº y fotón que llevan la fuerza electrodébil. Además está el campo de Higgs, y, rápidamente, los W y Z chupan la esencia de Higgs y se hacen pesados; el fotón permanece intacto. La fuerza electrodébil se fragmenta en la débil (débil porque los mensajeros son muy gordos) y la electromagnética, cuyas propiedades determina el fotón, carente de masa. La simetría se rompe espontáneamente, dicen los teóricos. Prefiero la descripción según la cual el Higgs oculta la simetría con su poder dador de masa.

Las masas de los W y el Z se predijeron con éxito a partir de los parámetros de la teoría electrodébil. Y las relajadas sonrisas de los físicos teóricos nos recuerdan que Gerard ^t Hooft y Veltman dejaron sentado que la teoría entera esta libre de infinitos.

Pero, encierra tantos misterios la materia que, a veces me hace pensar en que la podríamos denominar de cualuquier manera menos de inerte ¡Parece que la materia está viva!

Son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

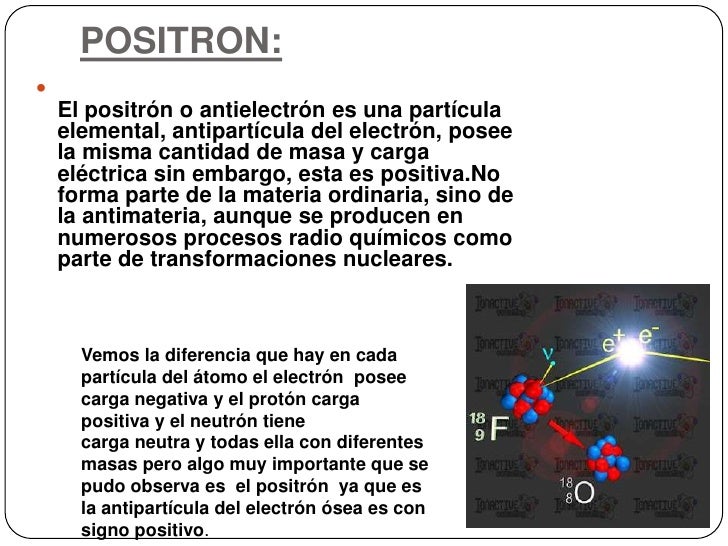

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lentos, que significa “delgado”).

Aunque el electrón fue descubierto en 1.897 por el físico británico Josepth John Thomson (1856-1940), el problema de su estructura, si la hay, no está resuelto. Conocemos su masa y su carga negativa que responden a 9,1093897 (54) x 10-31 Kg la primera y, 1,602 177 33 (49) x 10-19 culombios, la segunda, y también su radio clásico: r0 = e2/mc2 = 2’82 x 10-13 m. No se ha descubierto aún ninguna partícula que sea menos cursiva que el electrón (o positrón) y que lleve una carga eléctrica, sea lo que fuese (sabemos como actúa y cómo medir sus propiedades, pero aun no sabemos qué es), tenga asociada un mínimo de masa, y que esta es la que se muestra en el electrón.

Lo cierto es que, el electrón, es una maravilla en sí mismo. El Universo no sería como lo conocemos si el electrón (esa cosita “insignificante”), fuese distinto a como es, bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

¡No por pequeño, se es insignificante!

Recordémoslo, todo lo grande está hecho de cosas pequeñas.

En realidad, existen partículas que no tienen en absoluto asociada en ellas ninguna masa (es decir, ninguna masa en reposo). Por ejemplo, las ondas de luz y otras formas de radiación electromagnéticas se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones*.

Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda se denomina fotón, de la palabra griega que significa “luz”.

El fotón tiene una masa de 1, una carga eléctrica de o, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este termino se reserva para la familia formada por el electrón, el muón y la partícula Tau con sus correspondientes neutrinos: Ve, Vu y VT.

Existen razones teóricas para suponer que, cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitacionales. Esas ondas pueden así mismo poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

La fuerza gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón y, por tanto, ha de ser inimaginablemente difícil de detectar.

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm. De longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas), desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegare a captar la cienmillonésima parte de un centímetro.

Han llevado años captarlas, las ondas gravitatorias llevadas por el gravitón son débiles

Las débiles ondas de los gravitones, que producen del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitatorias. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaran el hallazgo de Weber.

De todas formas, no creo que, a estas alturas, nadie pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es o, su carga es o, y su espín de 2. Como el fotón, no tiene antipartícula, ellos mismos hacen las dos versiones.

Tenemos que volver a los que posiblemente son los objetos más misteriosos de nuestro Universo: Los agujeros negros. Si estos objetos son lo que se dice (no parece que se pueda objetar nada en contrario), seguramente serán ellos los que, finalmente, nos faciliten las respuestas sobre las ondas gravitacionales y el esquivo gravitón.

La onda gravitacional emitida por el agujero negro produce una ondulación en la curvatura del espacio-temporal que viaja a la velocidad de la luz transportada por los gravitones.

Hay aspectos de la física que me dejan totalmente sin habla, me obligan a pensar y me transporta de este mundo material nuestro a otro fascinante donde residen las maravillas del Universo. Hay magnitudes asociadas con las leyes de la gravedad cuántica. La longitud de Planck-Wheeler, ![]() es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro.

Me llama poderosamente la atención lo que conocemos como las fluctuaciones de vacío, esas oscilaciones aleatorias, impredecibles e ineliminables de un campo (electromagnético o gravitatorio), que son debidas a un tira y afloja en el que pequeñas regiones del espacio toman prestada momentáneamente energía de regiones adyacentes y luego la devuelven.

Ordinariamente, definimos el vacío como el espacio en el que hay una baja presión de un gas, es decir, relativamente pocos átomos o moléculas. En ese sentido, un vacío perfecto no contendría ningún átomo o molécula, pero no se puede obtener, ya que todos los materiales que rodean ese espacio tienen una presión de vapor finita. En un bajo vacío, la presión se reduce hasta 10-2 pascales, mientras que un alto vacío tiene una presión de 10-2-10-7 pascales. Por debajo de 10-7 pascales se conoce como un vacío ultraalto.

No puedo dejar de referirme al vaciotheta (vació θ) que, es el estado de vacío de un campo gauge no abeliano (en ausencia de campos fermiónicos y campos de Higgs).

El vacío theta es el punto de partida para comprender el estado de vacío de las teoría gauge fuertemente interaccionantes, como la cromodinámica cuántica. En el vacío theta hay un número infinito de estados degenerados con efecto túnel entre estos estados. Esto significa que el vacío theta es análogo a una fundón de Bloch* en un cristal.

Se puede derivar tanto como un resultado general o bien usando técnicas de instantón. Cuando hay un fermión sin masa, el efecto túnel entre estados queda completamente suprimido.

Cuando hay campos fermiónicos con masa pequeña, el efecto túnel es mucho menor que para campos gauge puros, pero no está completamente suprimido.

Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos pero que tampoco sabemos, en realidad, a que son debidos. Si, sabemos ponerles etiquetas como, por ejemplo, la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio y, con mayor frecuencia, en los elementos que conocemos como transuránidos.

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de ruptura, sobre pasando a la emisión de partículas alfa.

emilio silvera

Ene

12

¿Por qué Cuerdas?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Cerramos el comentario de ayer:

Podemos concluir diciendo que las simetrías que vemos a nuestro alrededor, desde un arco iris a las flores y a los cristales, pueden considerarse en última instancia como manifestaciones de fragmentos de la teoría decadimensional original. Riemann y Einstein habían confiado en llegar a una comprensión geométrica de por qué las fuerzas pueden determinar el movimiento y la naturaleza de la materia.

Dado el enorme poder de sus simetrías, no es sorprendente que la teoría de supercuerdas sea radicalmente diferente de cualquier otro tipo de física. De hecho, fue descubierta casi por casualidad. Muchos físicos han comentado que si este accidente fortuito no hubiese ocurrido, entonces la teoría no se hubiese descubierto hasta bien entrado el siglo XXI. Esto es así porque supone una neta desviación de todas las ideas ensayadas en este siglo. No es una extensión natural de tendencias y teorías populares en este siglo que ha pasado; permanece aparte.

Por el contrario, la teoría de la relatividad general de Einstein tuvo una evolución normal y lógica. En primer lugar, su autor, postula el principio de equivalencia. Luego reformuló este principio físico en las matemáticas de una teoría de campos de la gravitación basada en los campos de Faraday y en el tensor métrico de Riemann. Más tarde llegaron las “soluciones clásicas”, tales como el agujero negro y el Big Bang. Finalmente, la última etapa es el intento actual de formular una teoría cuántica de la gravedad. Por lo tanto, la relatividad general siguió una progresión lógica, desde un principio físico a una teoría cuántica.

Geometría → teoría de campos → teoría clásica → teoría cuántica.

“No es demasiado difícil para las personas familiarizadas con el cálculo integral. Euler describe las propiedades de la función, y no la búsqueda de aplicaciones prácticas, dos siglos función beta se ha olvidado.

En 1968, un joven físico Gabriel Veneziano, que trabaja en el CERN en Suiza, descubrió accidentalmente que todas las propiedades de las partículas que intervienen en la interacción nuclear, puede ser descrito por la función beta de Euler. La fórmula funciona muy bien para la descripción de las interacciones de partículas, pero nadie sabía por qué. Si tomamos la famosa fórmula de Einstein, su significado físico puede ser expresada por la frase “la energía es proporcional a la masa.” Un significado físico de la fórmula de Euler no era – sólo una variable al asignar valores específicos a los que para obtener resultados consistentes con los experimentos. Dos años más tarde, este significado se encontró – los físicos descubrieron que si reemplaza las partículas elementales oscilantes cadena unidimensional, la interacción de las cadenas sólo representa como fórmula de Euler. La unidimensionalidad significa que el espesor de una cadena tal se compara con la longitud de la infinitamente pequeño.

Lo cierto es que, la teoría de supercuerdas ha estado evolucionando hacia atrás desde su descubrimiento accidental en 1.968. Esta es la razón de que nos parezca extraña y poco familiar, estamos aún buscando un principio físico subyacente, la contrapartida del principio de equivalencia de Einstein.

La teoría nació casi por casualidad en 1.968 cuando dos jóvenes físicos teóricos, Gabriel Veneziano y Mahiko Suzuki, estaban hojeando independientemente libros de matemáticas. Figúrense ustedes que estaban buscando funciones matemáticas que describieran las interacciones de partículas fuertemente interactivas. Mientras estudiaban en el CERN, el Centro Europeo de Física Teórica en Ginebra, Suiza, tropezaron independientemente con la función beta de Euler, una función matemática desarrollada en el S. XIX por el matemático Leonhard Euler. Se quedaron sorprendidos al descubrir que la función beta de Euler ajustaba casi todas las propiedades requeridas para describir interacciones fuertes de partículas elementales.

Lawrence Berkeley National Laboratory

Berkeley, California

Según he leído, durante un almuerzo en el Lawrence Berkeley Laboratory en California, con una espectacular vista del Sol brillando sobre el puerto de San Francisco, Suzuki le explicó a Michio Kaku mientras almorzaban la excitación de descubrir, prácticamente por casualidad, un resultado parcialmente importante. No se suponía que la física se pudiera hacer de ese modo casual.

Tras el descubrimiento, Suzuki, muy excitado, mostró el hallazgo a un físico veterano del CERN. Tras oír a Suzuki, el físico veterano no se impresionó. De hecho le dijo a Suzuki que otro físico joven (Veneziano) había descubierto la misma función unas semanas antes. Disuadió a Suzuki de publicar su resultado. Hoy, esta función beta se conoce con el nombre de modelo Veneziano, que ha inspirado miles de artículos de investigación iniciando una importante escuela de física y actualmente pretende unificar todas las leyes de la física.

En 1.970, el Modelo de Veneziano-Suzuki (que contenía un misterio), fue parcialmente explicado cuando Yoichiro Nambu, de la Universidad de Chicago, y Tetsuo Goto, de la Nihon University, descubrieron que una cuerda vibrante yace detrás de sus maravillosas propiedades.

Así que, como la teoría de cuerdas fue descubierta hacia atrás y por casualidad, los físicos aún no conocen el principio físico que subyace en la teoría de cuerdas vibrantes y sus maravillosas propiedades.

El último paso en la evolución de la teoría de cuerdas (y el primer paso en la evolución de la relatividad general) aún está pendiente de que alguien sea capaz de darlo.

Así, Witten dice:

“Los seres humanos en el planeta tierra nunca dispusieron del marco conceptual que les llevara a concebir la teoría de supercuerdas de manera intencionada, surgió por razones del azar, por un feliz accidente. Por sus propios méritos, los físicos c del siglo XX no deberían haber tenido el privilegio de estudiar esta teoría muy avanzada a su tiempo y a su conocimiento. No tenían (ni tenemos ahora mismo) los conocimientos y los prerrequisitos necesarios para desarrollar dicha teoría, no tenemos los conceptos correctos y necesarios.”

Actualmente, como ha quedado dicho en este mismo trabajo, Edwar Witten es el físico teórico que, al frente de un equipo de físicos de Princeton, lleva la bandera de la teoría de supercuerdas con aportaciones muy importantes en el desarrollo de la misma.

De todas las maneras, aunque los resultados y avances son prometedores, el camino por andar es largo y la teoría de supercuerdas en su conjunto es un edificio con muchas puertas cerradas de las que no tenemos las llaves para acceder a su interior y mirar lo que allí nos aguarda.

Witten ha reunido en una sóla teoría todas las demás para unificarla en la Teoría M de supercuerdas

El problema está en que nadie es lo suficientemente inteligente para resolver la teoría de campos de cuerdas o cualquier otro enfoque no perturbativo de esta teoría. Se requieren técnicas que están actualmente más allá de nuestras capacidades.

Para encontrar la solución deben ser empleadas técnicas no perturbativas, que son terriblemente difíciles. Puesto que el 99 por ciento de lo que conocemos sobre física de altas energías se basa en la teoría de perturbaciones, esto significa que estamos totalmente perdidos a la hora de encontrar la verdadera solución de la teoría.

¿Por qué diez dimensiones? Lo cierto es que en nuestro Universo sólo vemos tres de espacio y una temporal y, para representar dimensiones más altas, hacemos uso de la imaginación y conformamos figuras que, aunque lo pretenden, nunca las representan… ¡Dies Dimensiones! ¿Dónde?

Uno de los secretos más profundos de la teoría de cuerdas, que aún no es bien comprendido, es por qué está definida sólo en diez, once y veintiséis dimensiones.

Si calculamos cómo se rompen y se vuelven a juntar las cuerdas en el espacio N-dimensional, constantemente descubrimos que pululan términos absurdos que destruyen las maravillosas propiedades de la teoría. Afortunadamente, estos términos indeseados aparecen multiplicados por (N-10). Por consiguiente, para hacer que desaparezcan estas anomalías, no tenemos otra elección cuántica que fijar N = 10. La teoría de cuerdas, de hecho, es la única teoría cuántica conocida que exige completamente que la dimensión del espacio-tiempo esté fijada en un número único, el diez.

Por desgracia, los teóricos de cuerdas están, por el momento, completamente perdidos para explicar por qué se discriminan las diez dimensiones. La respuesta está en las profundidades de las matemáticas, en un área denominada funciones modulares.

Al manipular los diagramas de lazos1 de Kikkawa, Sakita y Virasoro creados por cuerdas en interacción, allí están esas extrañas funciones modulares en las que el número 10 aparecen en los lugares más extraños.

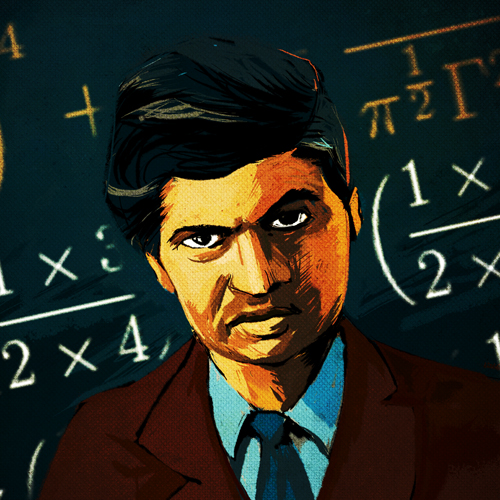

Estas funciones modulares son tan misteriosas como el hombre que las investigó, el místico del este. Quizá si entendiéramos mejor el trabajo de este genio indio, comprenderíamos por qué vivimos en nuestro universo actual.

El misterio de las funciones modulares podría ser explicado por quien ya no existe, Srinivasa Ramanujan, el hombre más extraño del mundo de los matemáticos. Igual que Riemann, murió antes de cumplir cuarenta años, y como Riemann antes que él, trabajó en total aislamiento en su universo particular de números y fue capaz de reinventar por sí mismo lo más valioso de cien años de matemáticas occidentales que, al estar aislado del mundo en las corrientes principales de los matemáticos, le eran totalmente desconocidos, así que los buscó sin conocerlos. Perdió muchos años de su vida en redescubrir matemáticas conocidas.

Cuando estaban en su lecho de muerte en 1920, Ramanujan escribió una carta a su mentor, el matemático inglés GH Hardy. La carta describía varias funciones nuevas que se comportaban de manera diferente de las conocidas funciones theta, o formas modulares, y sin embargo las imitaba muy estrechamente. Ramanujan conjeturó que sus formas modulares falsas correspondían a las formas modulares usuales, identificadas anteriormente por Carl Jacobi, y que ambas terminarían con resultados análogos para las raíces de 1.

Nadie en ese momento entendió de lo que hablaba Ramanujan. “No fue hasta el año 2002, a través de la obra de Sander Zwegers, que llegamos a una descripción de las funciones sobre las que Ramanujan escribió en 1920. Todavía aún hoy, no se han desvelado los mensajes de sus “Cuadernos Perdidos” y, algunos creen que sus funciones Modulares esconden el secreto de la Teioría de Cuerdas en 10 dimensiones.

Aunque en 1920 cuando Ramanujan por primera vez formuló la falsa función theta nadie hablaba de agujeros negros, ahora puede servir para revelar algunos de sus secretos. Crédito: Emory University

“Nadie hablaba de los agujeros negros en 1920 cuando Ramanujan por primera formuló las falsas funciones theta y, sin embargo, su trabajo puede revelar sus secretos”, dijo Ono.

La expansión de las formas modulares es una de las herramientas fundamentales para el cálculo de la entropía de un agujero negro modular. Algunos agujeros negros, sin embargo, no son modulares, pero la nueva fórmula, basada en la visión de Ramanujan, puede permitir que los físicos calculen su entropía como que si lo fueran.

Srinivasa Ramanujan trabajó principalmente en teoría de números, encontrando identidades relacionadas con el número pi y el número e o los números primos. Como decimos, en general sus fórmulas son muy enrevesadas, pero en su mayoría verdaderas (a posteriori se ha descubierto que algunos de sus resultados era incorrectos), y algunas de ellas se han convertido en potentes herramientas para calcular grandes cantidades de decimales de, principalmente, el número pi. Quizás la más conocida sea ésta:

que nos da 8 decimales exactos de pi en cada iteración. Tremendo, ¿verdad?

Comentando cuaderno perdido, el matemático Richard Askey dice:

“El de este año, mientras se estaba muriendo, era el equivalente a una vida entera de un matemático muy grande”. Lo que él consiguió era increíble. Los matemáticos Jonathan Borwien y Meter Borwein, en relación a la dificultad y la ardua tarea de descifrar los cuadernos perdidos, dijeron: “Que nosotros sepamos nunca se ha intentado una redacción matemática de este alcance o dificultad”.

Dispersas entre oscuras ecuaciones en sus cuadernos están estas funciones modulares, que figuran entre las más extrañas jamás encontradas en matemáticas. Ellas reaparecen en las ramas más distantes e inconexas de las matemáticas. Una función que aparece una y otra vez en la teoría de las funciones modulares se denomina (como ya he dicho otras veces) hoy día “función de Ramanujan” en su honor. Esta extraña función contiene un término elevado a la potencia veinticuatro.

El número 24 aparece repetidamente en la obra de Ramanujan. Este es un ejemplo de lo que las matemáticas llaman números mágicos, que aparecen continuamente donde menos se esperan por razones que nadie entiende. Milagrosamente, la función de Ramanujan aparece también en la teoría de cuerdas. El número 24 que aparece en la función de Ramanujan es también el origen de las cancelaciones milagrosas que se dan en la teoría de cuerdas. En la teoría de cuerdas, cada uno de los veinticuatro modos de la función de Ramanujan corresponde a una vibración física de la cuerda. Cuando quiera que la cuerda ejecuta sus movimientos complejos en el espacio-tiempo dividiéndose y recombinándose, deben satisfacerse un gran número de identidades matemáticas altamente perfeccionadas. Estas son precisamente las entidades matemáticas descubiertas por Ramanujan. Puesto que los físicos añaden dos dimensiones más cuando cuentan el número total de vibraciones que aparecen en una teoría relativista, ello significa que el espacio-tiempo debe tener 24 + 2 = 26 dimensiones espacio-temporales.

Para comprender este misterioso factor de dos (que añaden los físicos), consideramos un rayo de luz que tiene dos modos físicos de vibración. La luz polarizada puede vibrar, por ejemplo, o bien horizontal o bien verticalmente. Sin embargo, un campo de Maxwell relativista Aµ tiene cuatro componentes, donde µ = 1, 2, 3, 4. Se nos permite sustraer dos de estas cuatro componentes utilizando la simetría gauge de las ecuaciones de Maxwell. Puesto que 4 – 2 = 2, los cuatro campos de Maxwell originales se han reducido a dos. Análogamente, una cuerda relativista vibra en 26 dimensiones. Sin embargo, dos de estos modos vibracionales pueden ser eliminados cuando rompemos la simetría de la cuerda, quedándonos con 24 modos vibracionales que son las que aparecen en la función de Ramanujan.

Busto de Ramanujan en el jardín del Birla Industrial & Technological Museum. Allí permanecen algunos de los secretos que, aunque los dejó escritos ningún matemático hasta el momento ha sabido desvelar.

Cuando se generaliza la función de Ramanujan, el 24 queda reemplazado por el número 8. Por lo tanto, el número crítico para la supercuerda es 8+2=10. Este es el origen de la décima dimensión que exige la teoría. La cuerda vibra en diez dimensiones porque requiere estas funciones de Ramanujan generalizadas para permanecer auto consistente. Dicho de otra manera, los físicos no tienen la menor idea de por qué 10 y 26 dimensiones se seleccionan como dimensión de la cuerda. Es como si hubiera algún tipo de numerología profunda que se manifestara en estas funciones que nadie comprende. Son precisamente estos números mágicos que aparecen en las funciones modulares elípticas los que determinan que la dimensión del espacio-tiempo sea diez.

En el análisis final, el origen de la teoría decadimensional es tan misterioso como el propio Ramanujan. Si alguien preguntara a cualquier físico del mundo por qué la naturaleza debería existir en diez dimensiones, estaría obligado a responder “no lo sé”. Se sabe en términos difusos, por qué debe seleccionarse alguna dimensión del espacio tiempo (de lo contrario la cuerda no puede vibrar de una forma cuánticamente autoconsistente), pero no sabemos por qué se seleccionan estos números concretos.

emilio silvera

Totales: 71.788.786

Totales: 71.788.786 Conectados: 38

Conectados: 38