Nov

15

¿Una familia de partículas inmortales?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

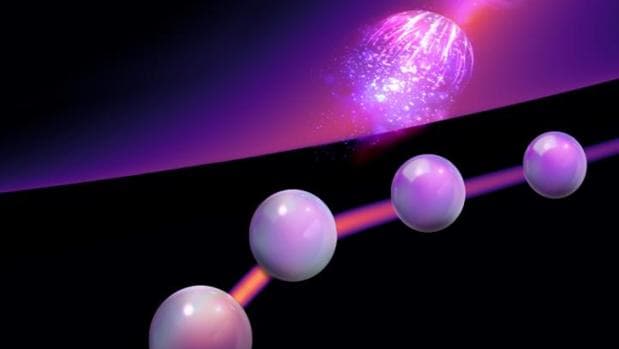

Las interacciones cuánticas convierten a las cuasipartículas en inmortales – K. Verresen / TUM

Por primera vez, un equipo de físicos comprueba que las cuasipartículas renacen de sus cenizas después de desintegrarse

Si hay algo en lo que todos estamos de acuerdo es que nada dura para siempre. Lo dicen las leyes de la Física, en concreto la segunda ley de la termodinámica, que es la que rige el destino del Universo: toda actividad o proceso incrementa la entropía de un sistema. O lo que es lo mismo, el desorden. Por eso envejecemos, por eso las estrellas se apagan, los átomos se descomponen y por eso, también, los cristales de un vaso que se ha roto jamás volverán a recomponerse.

Pero un equipo de investigadores de la Universidad Técnica de Munich, en el Instituto Max Planck para la Física de Sistemas Complejos, parece haber hallado una excepción a esta norma universal. De hecho, han descubierto que lo que parece inconcebible en nuestra experiencia cotidiana puede estar sucediendo en el misterioso mundo cuántico. Y que allí, unos extraños entes llamados “cuasipartículas” tienen la propiedad de desintegrarse y volver a renacer después de sus propias cenizas, en una serie de ciclos que no tienen fin y que las convierte, de hecho, en inmortales. El extraordinario hallazgo se acaba de publicar en Nature Physics.

Las cuasipartículas pueden describirse como un extraño fenómeno de “excitación colectiva” que sucede en el interior de los cuerpos sólidos. Cuando, por ejemplo, un electrón se mueve en el interior de un sólido, su movimiento se ve perturbado por las interacciones con otros muchos electrones, o núcleos atómicos, que también se están moviendo. Y eso hace que, a pesar de seguir comportándose como un electón libre, tenga una masa diferente, que recibe el nombre de “cuasipartícula de electrones”. Otras cuasipartículas incluyen a los fonones, que son partículas derivadas de las vibraciones de los átomos dentro de un sólido, a los plasmones, que son partículas derivadas de las oscilaciones de un plasma, y a muchas otras, como los famosos fermiones de Majorana, que son a la vez materia y antimateria, los fluxones, los plasmones o los solitones.

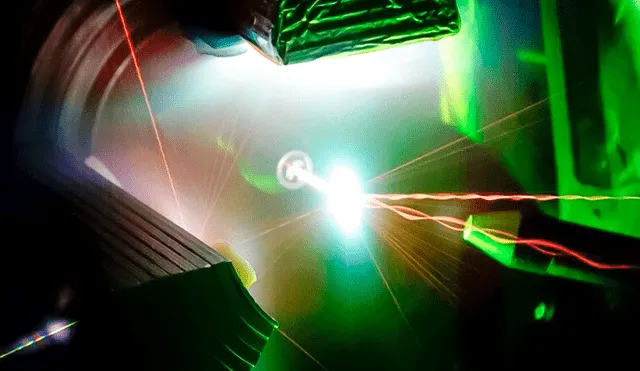

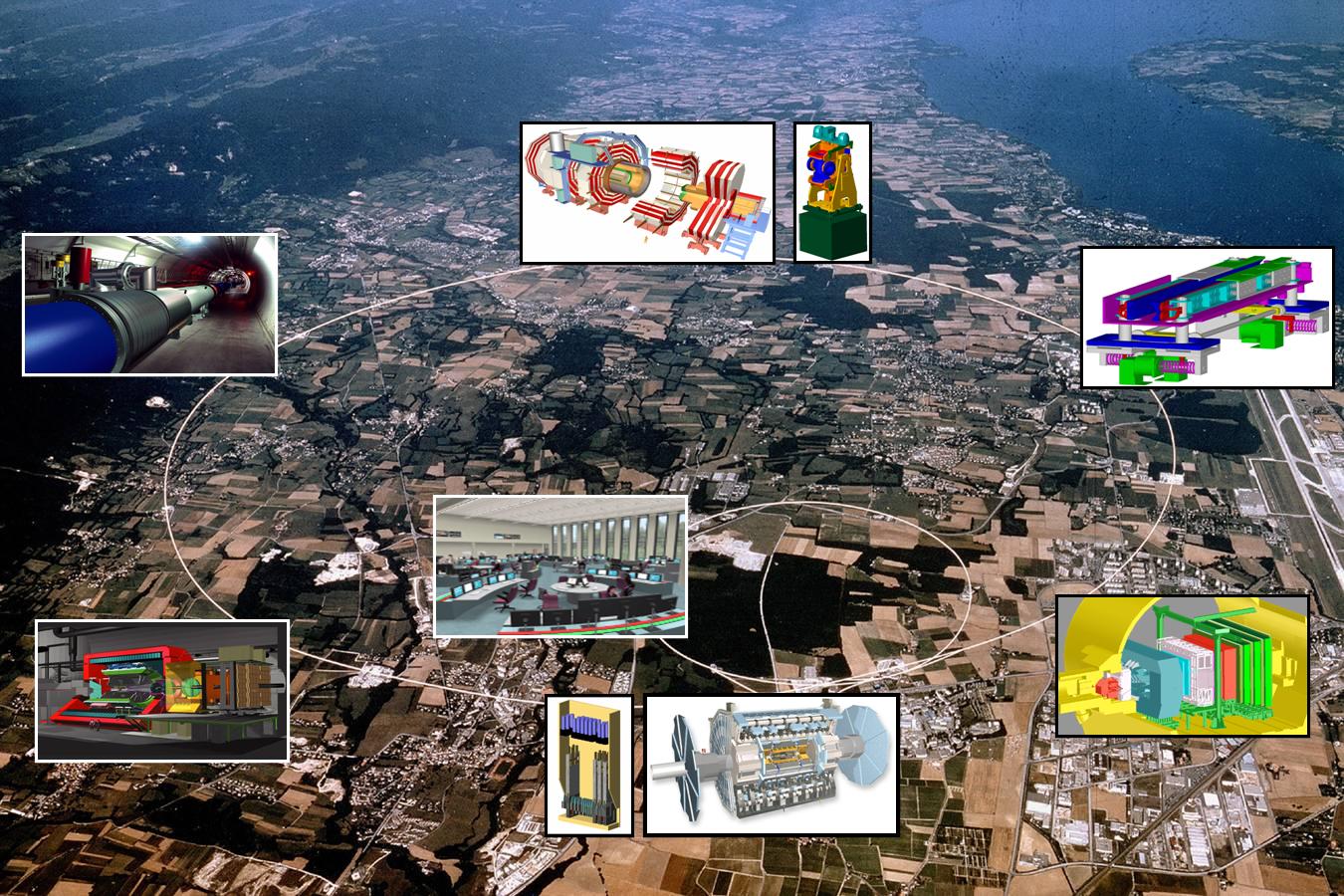

En los grandes aceleradores de partículas podemos observar sus comportamientos y desvelar sus secretos

A pesar de que una cuasipartícula implica a todas las partículas que, con sus movimientos, se afectan unas a otras, pueden ser consideradas como partículas individuales que se mueven en el interior de un sistema, rodeadas por una nube de otras partículas que se apartan de su camino o que son arrastradas por su movimiento. El concepto de cuasipartículas fue acuñado por el físico y ganador del premio Nobel Lev Davidovich Landau. Lo usó para describir estados colectivos de muchas partículas o más bien sus interacciones debido a fuerzas eléctricas o magnéticas. A causa de estas interacciones, varias partículas actúan como una sola.

“Hasta ahora -explica Frank Pollmann, uno de los autores del artículo- se suponía que las cuasipartículas en sistemas cuánticos interactivos decaen después de un cierto tiempo. Pero ahora sabemos que no es así: las interacciones fuertes pueden, incluso, detener la descomposición por completo”.

“Hasta el momento -prosigue el investigador- no se sabía con detalle qué procesos influyen en el destino de esas cuasipartículas en sistemas que interactúan. Pero ahora contamos con métodos numéricos con los que podemos calcular interacciones complejas, y computadoras con un rendimiento lo suficientemente alto como para resolver estas ecuaciones”.

Con estas armas a su disposición, los investigadores llevaron a cabo complejas simulaciones para “espiar” a las cuasipartículas. “Es cierto que se desintegran -explica por su parte Ruben Verresen, autor principal del estudio- pero nuevas entidades de partículas idénticas emergen de los escombros. Si el decaimiento se produce muy rápidamente, después de un cierto tiempo se produce una reacción inversa y los escombros vuelven a converger. Este proceso puede repetirse sin fin, como una oscilación sostenida en el tiempo entre decaimiento y renacimiento”.

Muerte y resurrección

La mecánica cuántica tiene muchas implicaciones que no llegamos a comprender

Desde el punto de vista de la Física, esa oscilación entre “muerte y resurrección” puede considerarse como una onda que se transforma en materia, en virtud de la dualidad onda-partícula que predice la mecánica cuántica. Por lo tanto, las cuasipartículas inmortales no violan la segunda ley de la termodinámica. Su entropía permanece constante, la decadencia se detiene.

Cada día damos un paso más en el conocimiento de lo muy pequeño

El descubrimiento, además, consigue también explicar una serie de fenómenos que hasta ahora habían desconcertado a los científicos. Los físicos experimentales, por ejemplo, han medido que el compuesto magnético Ba3CoSB2O9 es sorprendentemente estable, cuando no debería serlo. Ahora se sabe que los magnones, un tipo de cuasipartículas magnéticas, son las responsables de ello. Del mismo modo, otras cuasipartículas, los fotones hacen posible que el helio, que en la superficie de la Tierra es un gas, se convierta en un líquido a -273 grados centígrados (el cero absoluto, donde la actividad atómica se detiene) y pueda seguir fluyendo sin restricciones.

“Nuestro trabajo es pura investigación básica -enfatiza Pollmann-. Sin embargo, es perfectamente posible que algún día nuestros resultados permitan incluso aplicaciones, por ejemplo, la construcción de memorias de datos duraderas para futuras computadoras cuánticas”.

Noticias

Nov

9

¿Qué habrá más allá del Modeo Estándar de la Física de Partículas?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

Intentaremos viajar más allá del Modelo Estándar

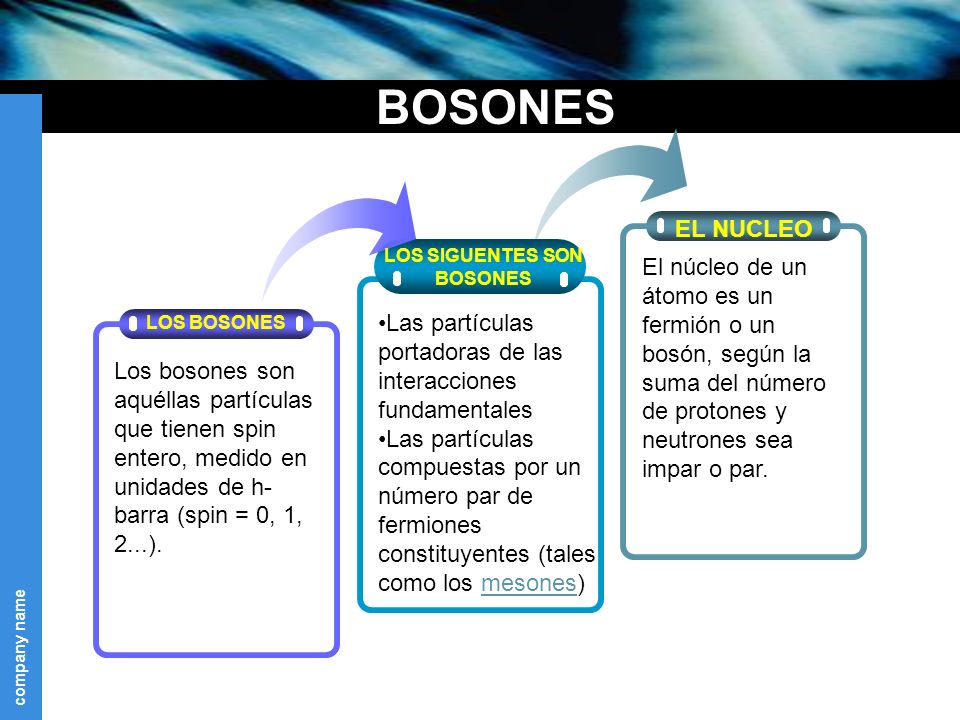

Para entrar en materia

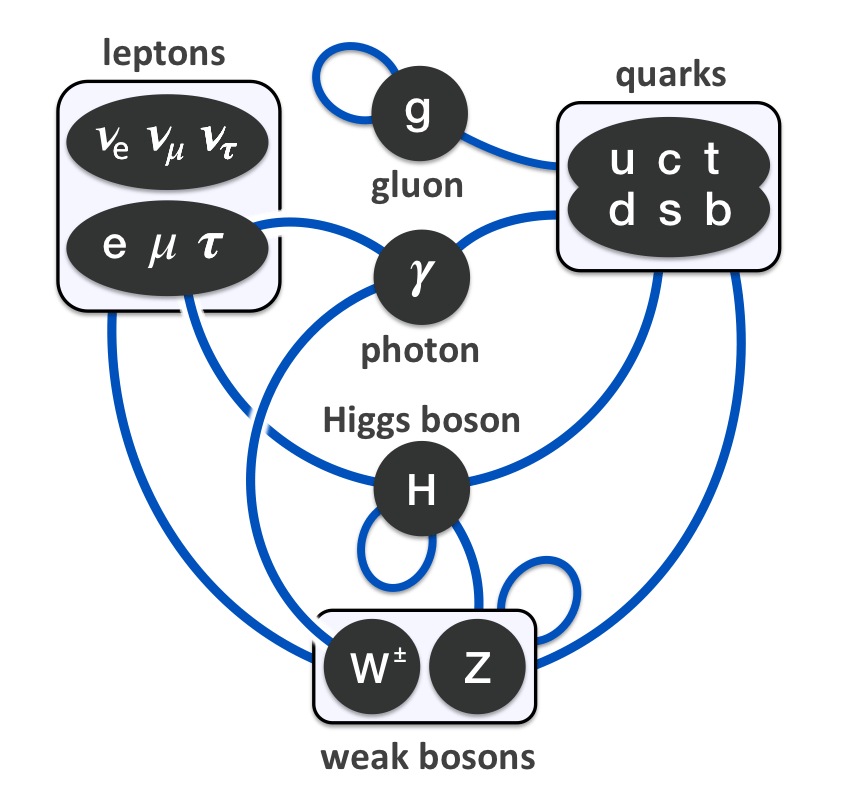

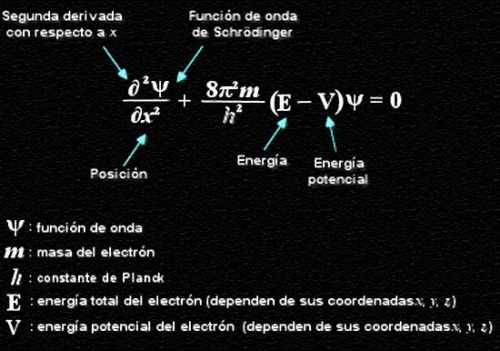

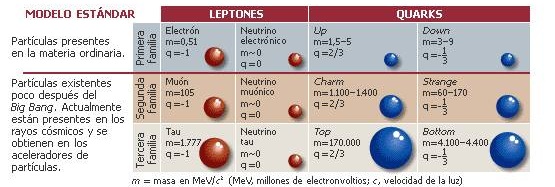

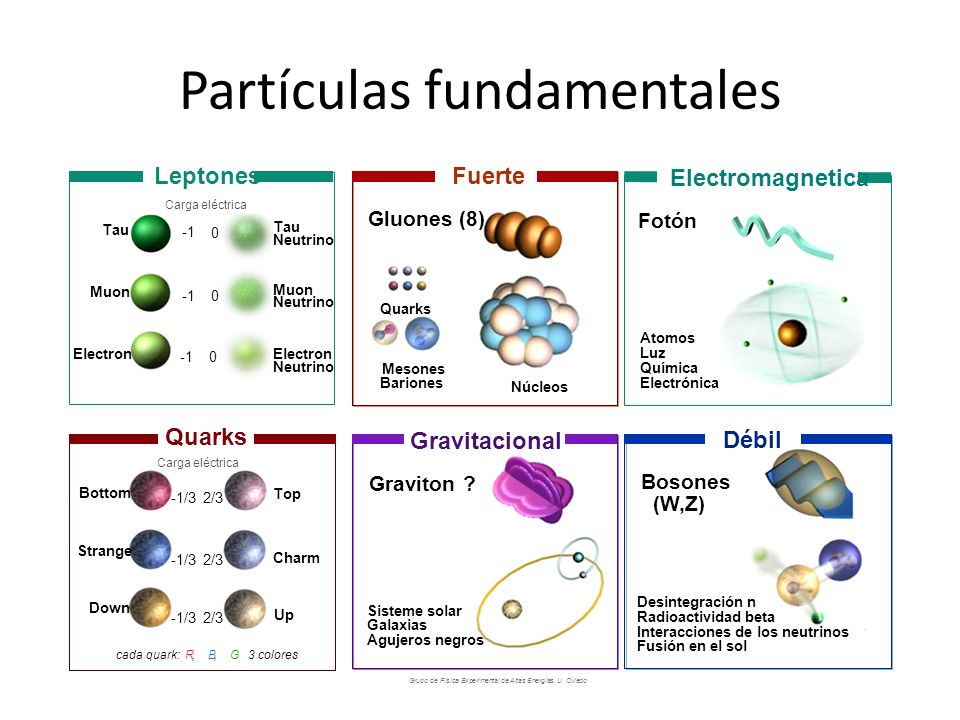

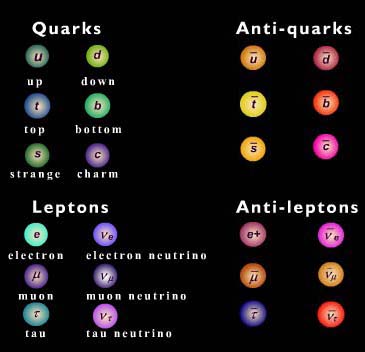

“Inicialmente, se presenta, de modo simplificado, el Modelo Estándar como una teoría sofisticada que identifica las partículas elementales y sus interacciones. Después, en el ámbito de esa teoría, se enfocan aspectos – el vacuo no es vacío; partículas desnudas y vestidas; materia oscura y viento oscuro; materia y antimateria; el campo y el bosón de Higgs; neutrinos oscilantes – que pueden ser motivadores desde el punto de vista de la enseñanza y del aprendizaje de la Física. Finalmente, se discute la probable superación de esa teoría por otra más completa.”

“… el Modelo Estándar es, en la historia, la más sofisticada teoría matemática sobre la naturaleza. A pesar de la palabra “modelo” en su nombre, el Modelo Estándar es una teoría comprensiva que identifica las partículas básicas y especifica cómo interactúan. Todo lo que pasa en nuestro mundo (excepto los efectos de la gravedad) es resultado de las partículas del Modelo Estándar interactuando de acuerdo con sus reglas y ecuaciones.”

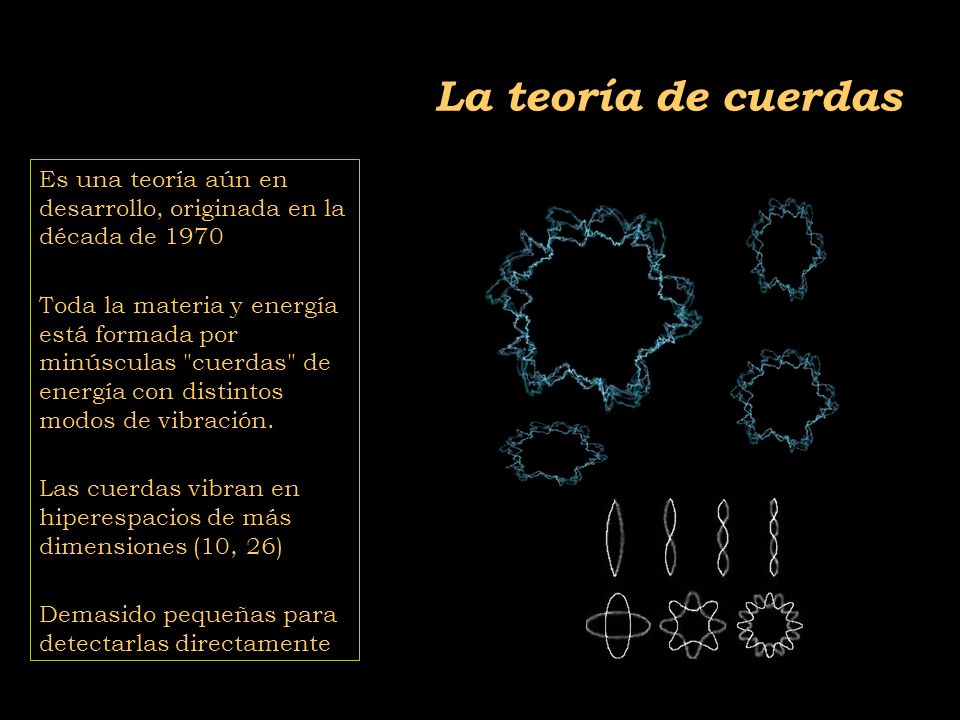

La Física actual busca una teoría más amplia que el modelo estándar . Una teoría que dé una descripción completa, unificada y consistente de la estructura fundamental del universo. ¿Será la compleja Teoría de cuerdas,que integra también la interacción gravitaroria?

El modelo estándar es una poderosa herramienta pero no cumple todas las expectativas; no es un modelo perfecto. En primer lugar, podríamos empezar por criticar que el modelo tiene casi veinte constantes que no se pueden calcular. Desde luego, se han sugerido numerosas ideas para explicar el origen de todos estos parámetros o números inexplicables y sus valores, pero el problema de todas estas teorías es que los argumentos que dan nunca han sido enteramente convincentes. ¿Por qué se iba a preocupar la naturaleza de una fórmula mágica si en ausencia de tal fórmula no hubiera contradicciones? Lo que realmente necesitamos es algún principio fundamental nuevo, tal como el principio de la relatividad, pero no queremos abandonar todos los demás principios que ya conocemos. Ésos, después de todo, han sido enormemente útiles en el descubrimiento del modelo estándar. El mejor lugar para buscar un nuevo principio es precisamente donde se encuentran los puntos débiles de la presente teoría y, construímos máquinas como el LHC para que nos diga lo que no sabemos.

Una regla universal en la física de partículas es que para partículas con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez más pequeñas en el espacio y en el tiempo. El modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero existen varias razones para sospechar que sus predicciones pueden, finalmente (cuando podamos emplear más energía en un nivel más alto), resultar equivocadas.

Vistas a través del microscopio, las constantes de la naturaleza parecen estar cuidadosamente ajustadas sin ninguna otra razón aparente que hacer que las partículas parezcan lo que son. Hay algo muy erróneo aquí. Desde un punto de vista matemático no hay nada que objetar, pero la credibilidad del modelo estándar se desploma cuando se mira a escalas de tiempo y longitud extremadamente pequeñas, o lo que es lo mismo, si calculamos lo que pasaría cuando las partículas colisionan con energías extremadamente altas. ¿Y por qué debería ser el modelo válido hasta aquí? Podrían existir muchas clases de partículas súper pesadas que no han nacido porque se necesitan energías aún inalcanzables. ¿Dónde está la partícula de Higgs? ¿Cómo se esconde de nosotros el gravitón?

Parece que el Modelo estándar no admite la cuarta fuerza y tendremos que buscar más profundamente, en otras teorías que nos hablen y describan además de las partículas conocidas de otras nuevas que están por nacer y que no excluya la Gravedad. Ese es el Modelo que necesitamos para conocer mejor la Naturaleza.

Claro que las cosas no son tan sencilla y si deseamos evitar la necesidad de un delicado ajuste de las constantes de la naturaleza, creamos un nuevo problema: ¿cómo podemos modificar el modelo estándar de tal manera que el ajuste fino no sea necesario? Está claro que las modificaciones son necesarias, lo que implica que muy probablemente haya un límite más allá del cual el modelo tal como está deja de ser válido. El modelo estándar no será nada más que una aproximación matemática que hemos sido capaces de crear, de forma que todos los fenómenos que hemos observado hasta el presente están reflejados en él, pero cada vez que se pone en marcha un aparato más poderoso, tenemos que estar dispuestos a admitir que puedan ser necesarias algunas modificaciones del modelo para incluir nuevos datos que antes ignorábamos.

Más allá del modelo estándar habrá otras respuestas que nos lleven a poder hacer otras preguntas que en este momento, no sabemos ni plantear por falta de conocimientos. Si no conociéramos que los protones están formados por Quarks, ¿cómo nos podríamos preguntar si habrá algo más allá de los Quarks?

El gobierno de Estados Unidos, después de llevar gastados miles de millones de dólares, suspendió la construcción del supercolisionador superconductor de partículas asestando un duro golpe a la física de altas energías, y se esfumó la oportunidad para obtener nuevos datos de vital importancia para el avance de este modelo, que de momento es lo mejor que tenemos.

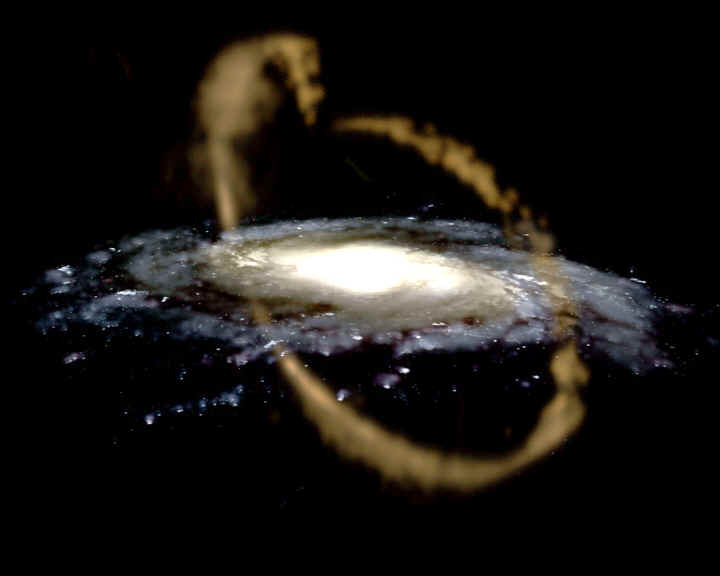

Se han estado inventando nuevas ideas, como la supersimetría y el technicolor. Los astrofísicos estarán interesados en tales ideas porque predicen una gran cantidad de nuevas partículas superpesadas, y también varios tipos de partículas que interaccionan ultradébilmente, los technipiones. Éstas podrían ser las WIMP’s (Weakly Interacting Massive Particles, o Partículas Masivas Débilmente Interactivas) que pueblan los huecos entre las galaxias, y serían así las responsables de la masa perdida que los astrofísicos siguen buscando y llaman “materia oscura”.

Que aparezcan “cosas” nuevas y además, imaginarlas antes, no es fácil. Recordemos cómo Paul Dirac se sintió muy incómodo cuando en 1931 dedujo, a partir de su ecuación del electrón, que debería existir una partícula con carga eléctrica opuesta. Esa partícula no había sido descubierta y le daba reparo perturbar la paz reinante en la comunidad científica con una idea tan revolucionaria, así que disfrazó un poco la noticia: “Quizá esta partícula cargada positivamente, tan extraña, sea simplemente el protón”, sugirió. Cuando poco después se identificó la auténtica antipartícula del electrón (el positrón) se sorprendió tanto que exclamó: “¡Mi ecuación es más inteligente que su inventor!”. Este último comentario es para poner un ejemplo de cómo los físicos trabajan y buscan caminos matemáticos mediante ecuaciones de las que, en cualquier momento (si están bien planteadas), surgen nuevas ideas y descubrimientos que ni se podían pensar. Así pasó también con las ecuaciones de Einstein de la relatividad general, donde Schwarzschild dedujo la existencia de los agujeros negros.

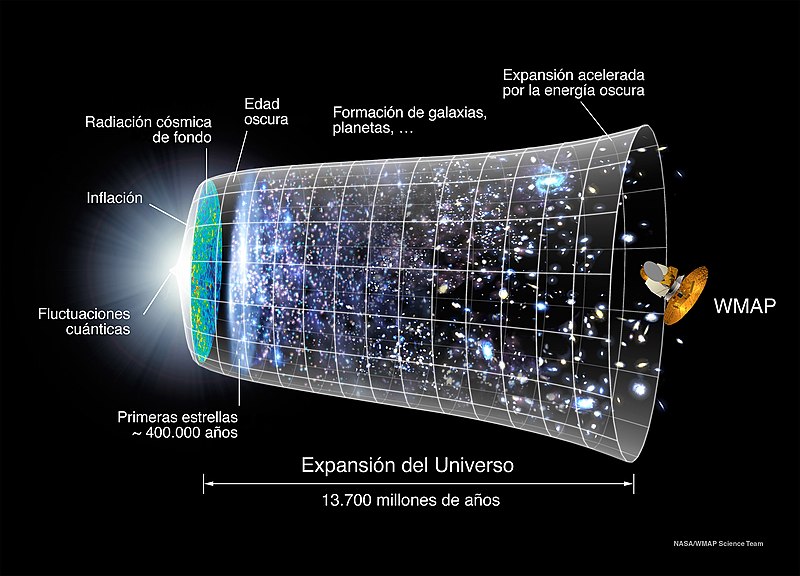

Se piensa que al principio del comienzo del tiempo, cuando surgió el Big Bang, las energías eran tan altas que allí reinaba la simetría total; sólo había una sola fuerza que todo lo englobaba. Más tarde, a medida que el universo se fue expandiendo y enfriando, surgieron las cuatro fuerzas que ahora conocemos y que todo lo rigen. Tenemos los medios, en los supercolisionadores de partículas, para viajar comenzando por 1.000 MeV, hasta finalizar en cerca de 1019 MeV, que corresponde a una escala de longitudes de aproximadamente 10–30 cm. Howard Georgi, Helen Quinn y Steven Weinberg descubrieron que ésta es la región donde las tres constantes de acoplamiento gauge se hacen iguales (U(1), SU(2) y SU(3)); resultan ser lo mismo. ¿Es una coincidencia que las tres se hagan iguales simultáneamente? ¿Es también una coincidencia que esto suceda precisamente en esa escala de longitud? Faltan sólo tres ceros más para alcanzar un punto de retorno. Howard Georgi y Sheldon Glashow descubrieron un modelo genuinamente unificado en el dominio de energías de 1019 MeV tal que, cuando se regresa de allí, espontáneamente surgen las tres fuerzas gauge tal como las conocemos. De hecho, ellos encontraron el modelo; la fórmula sería SU(5), que significa que el multiplote más pequeño debe tener cinco miembros.

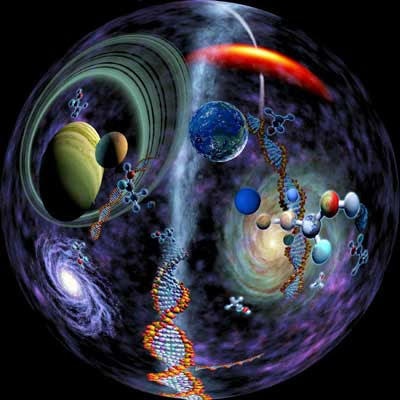

Materia y Energía Oscura… Un Misterio…Sin resolver.

Y, a todo esto, ¿dónde está esa energía oculta? ¿Y donde la materia? Podemos suponer que la primera materia que se creo en el Universo fue la que llamamos (algún nom,bre había que ponerle) “Materia Oscura”, esa clase de Ilem o sustancia primera del Universo que mejor sería llamarla invisible, ya que, de no ser así, difícil sería explicar cómo se pudieron formar las primeras estrellas y galaxias de nuestro Universo, ¿dónde está el origen de la fuerza de Gravedad que lo hizo posible, sino en esa materia escondida?

¡Lo dicho! Necesitamos saber, y, deseo que de una vez por todas, se cumpla lo que dejó dicho Hilbert en su tumba de Gotinga (Alemania): “Tenemos que saber, ¡sabremos!. Pero…

¡Que sea pronto!

Emilio Silvera Vázquez

Nov

5

¡La Hiperdimensionalidad! ¡Qué cosas nos cuentan!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (1)

Comments (1)

El 21 de diciembre de 2010 científicos estadounidenses descubrieron “un vimana atrapado en un pozo del tiempo“ (un campo gravitatorio electromagnético, que sólo puede ocurrir en una dimensión invisible del espacio) en la ciudad de Balkh, Afganistán, lugar que alguna vez Marco Polo catalogó como: “Una de las ciudades más nobles y grandiosas del mundo”.

Los intentos por retirar el misterioso Vimana de la cueva donde había estado oculto durante por lo menos 5.000 años, causaron la “desaparición” de por lo menos 8 soldados norteamericanos, atrapados por el vórtex temporal ( nuestros cuerpos no pueden desplazarse como si nada del presente al futuro y del futuro al pasado sin cargarse el peso destructivo de las leyes de la fìsica, salvo si se logra bloquear el campo magnético, algo que aparentemente los científicos norteamericanos tardaron ocho cadáveres en descubrir y solucionar, probablemente con jaulas de Faraday ).

La existencia de este tipo de fenómenos no está demostrado por los científicos (caso contrario estaríamos hablando de leyes), pero los físicos teóricos coinciden en general que podrían ser posibles si se acepta la teoría del Multi-universo (un universo de por lo menos 11 dimensiones espaciotemporales) como estructura lógica y matemática. Atravesando esa especie de plasma líquido, nos podríamos trasladar a otros mundos, a otras galaxias.

Theodor Kaluza, ya en 1921 conjeturaba que si ampliáramos nuestra visión del universo a 5 dimensiones, entonces no habría más que un solo campo de fuerza: la gravedad, y lo que llamamos electromagnetismo sería tan sólo la parte del campo gravitatorio que opera en la quinta dimensión, una realidad espacial que jamás reconoceríamos si persistiéramos en nuestros conceptos de realidad lineal, similar a un holograma.

Bueno, independientemente de que todo esto pueda ser una realidad, lo cierto es que, nosotros, ahora en nuestro tiempo, hablamos de un universo con más dimensiones y, la carrera de las más altas dimensiones la inicio (como arrtiba se menciona) en el año 1919 (no el 1921) por Theodor Kaluza, un oscuro y desconocido matemático, cuando le presentó a Einstein mediante un escrito una teoría unificada que podía unificar, las dos grandes teorías del momento, la Relatividad General con el Magnetismo y podía realizarse si elaboraba sus ecuaciones en un espacio-tiempo de cinco dimensiones.

Teoría de la Relatividad de Kaluza

Así estaban las cosas cuando en 1.919 recibió Einstein un trabajo de Theodor Kaluza, un privatdozent en la Universidad de Königsberg, en el que extendía la Relatividad General a cinco dimensiones. Kaluza consideraba un espacio con cuatro dimensiones, más la correspondiente dimensión temporal y suponía que la métrica del espacio-tiempo se podía escribir como:

![]()

Theodor Kaluza

En 1921, Einstein presentó en la Academia Prusiana un artículo de Theodor Kaluza… en el que el campo gravitacional y electromagnético están unificados geométricamente en cinco dimensiones.

Así que, como hemos dicho, ese mismo año, Oskar Klein publicaba un trabajo sobre la relación entre la teoría cuántica y la relatividad en cinco dimensiones. Uno de los principales defectos del modelo de Kaluza era la interpretación física de la quinta dimensión. La condición cilíndrica impuesta ad hoc hacía que ningún campo dependiera de la dimensión extra, pero no se justificaba de manera alguna.

Klein propuso que los campos podrían depender de ella, pero que ésta tendría la topología de un círculo con un radio muy pequeño, lo cual garantizaría la cuantización de la carga eléctrica. Su diminuto tamaño, R5 ≈ 8×10-31 cm, cercano a la longitud de Planck, explicaría el hecho de que la dimensión extra no se observe en los experimentos ordinarios, y en particular, que la ley del inverso del cuadrado se cumpla para distancias r » R5. Pero además, la condición de periodicidad implica que existe una isometría de la métrica bajo traslaciones en la quinta dimensión, cuyo grupo U(1), coincide con el grupo de simetría gauge del electromagnetismo.

Einstein al principio se burló de aquella disparatada idea pero, más tarde, habiendo leido y pensado con más atenci`´on en lo que aquello podía significar, ayudó a Kaluza a publicar su idea de un mundo con cinco dimensiones (allí quedó abierta la puerta que más tarde, traspasarían los teóricos de las teorías de más altas dimensiones). Algunos años más tarde, , el físico sueco Oskar Klein publicó una versión cuántica del artículo de Kaluza. La Teoría Kaluza-Klein que resultó parecía interesante, pero, en realidad, nadie sabía que hacer con ella hasta que, en los años setenta; cuando pareció beneficioso trabajar en la supersimetría, la sacaron del baúl de los recuerdos, la desempolvaron y la tomaron como modelo.

Pronto, Kaluza y Klein estuvieron en los labios de todo el mundo (con Murray Gell-Mann, en su papel de centinela lingüistico, regañando a sus colegas que no lo sabían pronunciar “Ka-wu-sah-Klein”.

Pero, ¿Existen en nuestro Universo dimensiones ocultas?

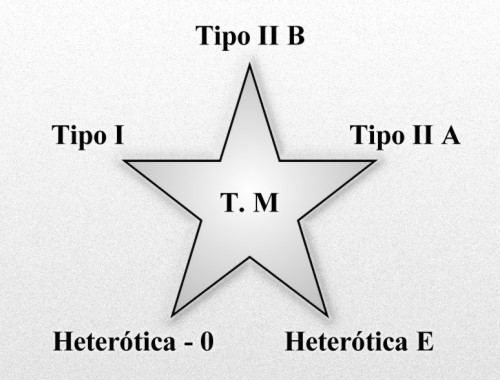

Aunque la teoría de cuerdas en particular y la supersimetría en general apelaban a mayores dimensiones, las cuerdas tenían un modo de seleccionar su dimensionalidad requerida. Pronto se hizo evidente que la Teoría de cuerdas sólo sería eficaz, en dos, diez y veintiséis dimensiones, y sólo invocaba dos posibles grupos de simetría: SO(32) o E8 x E8. Cuando una teoría apunta hacia algo tan tajante, los científicos prestan atención, y a finales de los años ochenta había decenas de ellos que trabajaban en las cuerdas. Por aquel entonces, quedaba mucho trabajo duro por hacer, pero las perspectivas era brillantes. “Es posible que las décadas futuras -escribieron Schwarz y sus colaboradores en supercuerdas Green y Edward Witten- sea un excepcional período de aventura intelectual.” Desde luego, la aventura comenzó y, ¡qué aventura!

La Constante de Estructura Fina (α)

Lo único que cuenta en la definición del mundo son los valores de las constantes adimensionales de la naturaleza (así lo creían Einstein y Planck). Si se duplica el valor de todas las masas no se puede llegar a saber, porque todos los números puros definidos por las razones de cualquier par de masas son invariables.

Puesto que el radio de compactificación es tan pequeño, el valor típico de las masas será muy elevado, cercano a la masa de Planck Mp = k-12 = 1’2 × 1019 GeV*, y por tanto, a las energías accesibles hoy día (y previsiblemente, tampoco en un futuro cercano – qué más quisieran E. Witten y los perseguidores de las supercuerdas -), únicamente el modo cero n = 0 será relevante. Esto plantea un serio problema para la teoría, pues no contendría partículas ligeras cargadas como las que conocemos.

¿Y si llevamos a Kaluza-Klein a dimensiones superiores para unificar todas las interacciones?

En este proceso llamado desintegración beta y debido a la interacción débil, un neutrón se transforma en un protón, un electrón y un (anti)neutrino electrónico cuando uno de los quarks del neutrón emite una partícula W–. Aquí queda claro que el término “interacción” es más general que “fuerza”; esta interacción que hace cambiar la identidad de las partículas no podría llamarse fuerza (todo representado en uno de los famosos diagramas de Feynman).

La descripción de las interacciones débiles y fuertes a través de teorías gauge no abelianas mostró las limitaciones de los modelos en cincodimensiones, pues éstas requerirían grupos de simetría mayores que el del electromagnetismo. En 1964 Bryce de UIT presentó el primer modelo de tipo Kaluza-Klein–Yang-Mills en el que el espacio extra contenía más de una dimensión.

El siguiente paso sería construir un modelo cuyo grupo de isometría contuviese el del Modelo Estándar SU(3)c × SU(2)l × U(1)y, y que unificara por tanto la gravitación con el resto de las interacciones.

Edward Witten demostró en 1981 que el número total de dimensiones que se necesitarían sería al menos de once. Sin embargo, se pudo comprobar que la extensión de la teoría a once dimensiones no podía contener fermiones quirales, y por tanto sería incapaz de describir los campos de leptones y quarks.

Por otra parte, la supersimetría implica que por cada bosón existe un fermión con las mismas propiedades. La extensión supersimétrica de la Relatividad General es lo que se conoce como supergravedad (supersimetría local).

Joël Scherk (1946-1980) (a menudo citado como Joel Scherk) fue un francés teórico físico que estudió la teoría de cuerdas ysupergravedad [1] . Junto con John H. Schwarz , pensaba que la teoría de cuerdas es una teoría de la gravedad cuántica en 1974. En 1978, junto con Eugène Cremmer y Julia Bernard , Scherk construyó el lagrangiano y supersimetría transformaciones parasupergravedad en once dimensiones, que es uno de los fundamentos de la teoría-M .

Unos años antes, en 1978, Cremmer, Julia y Scherk habían encontrado que la super-gravedad, precisamente en once dimensiones, tenía propiedades de unicidad que no se encontraban en otras dimensiones. A pesar de ello, la teoría no contenía fermiones quirales, como los que conocemos, cuando se compactaba en cuatro dimensiones. Estos problemas llevaron a gran parte de los teóricos al estudio de otro programa de unificación a través de dimensiones extra aún más ambicioso, la teoría de cuerdas.

No por haberme referido a ella en otros trabajos anteriores estará de más dar un breve repaso a las supercuerdas. Siempre surge algún matiz nuevo que enriquece lo que ya sabemos.

El origen de la teoría de supercuerdas data de 1968, cuando Gabriela Veneziano introdujo los modelos duales en un intento de describir las amplitudes de interacción hadrónicas, que en aquellos tiempos no parecía provenir de ninguna teoría cuántica de campos del tipo de la electrodinámica cuántica. Posteriormente, en 1979, Yaichiro Nambu, Leonard Susskind y Holger Nielsen demostraron de forma independiente que las amplitudes duales podían obtenerse como resultado de la dinámica de objetos unidimensionales cuánticos y relativistas dando comienzo la teoría de cuerdas.

En 1971, Pierre Ramona, André Neveu y otros desarrollaron una teoría de cuerdas con fermiones y bosones que resultó ser supersimétrica, inaugurando de esta forma la era de las supercuerdas.

David Jonathan Gross

Sin embargo, en 1973 David Gross, David Politzer y Frank Wilczek descubrieron que la Cromodinámica Cuántica, que es una teoría de campos gauge no abeliana basada en el grupo de color SU(3)c, que describe las interacciones fuertes en términos de quarks y gluones, poseía la propiedad de la libertad asintótica. Esto significaba que a grandes energías los quarks eran esencialmente libres, mientras que a bajas energías se encontraban confinados dentro de los hadrones en una región con radio R de valor R ≈ hc/Λ ≈ 10-13 cm.

Dicho descubrimiento, que fue recompensado con la concesión del Premio Nobel de Física a sus autores en 2.004, desvió el interés de la comunidad científica hacia la Cromodinámica Cuántica como teoría de las interacciones fuertes, relegando casi al olvido a la teoría de supercuerdas.

Se habla de cuerdas abiertas, cerradas o de lazos, de p branas donde p denota su dimensionalidad (así, 1 brana podría ser una cuerda y 2.Brana una membrana) o D-Branas (si son cuerdas abiertas) Y, se habla de objetos mayores y diversos que van incorporados en esa teoría de cuerdas de diversas familias o modelos que quieren sondear en las profundidades del Universo físico para saber, como es.

En la década de los noventa se creó una versión de mucho éxito de la teoría de cuerdas. Sus autores, los físicos de Princeton David Gross, Emil Martinec, Jeffrey Harvey y Ryan Rohn, a quienes se dio en llamar el cuarteto de cuerdas de Princeton.

El de más edad de los cuatro, David Gross, hombre de temperamento imperativo, es temible en los seminarios cuando al final de la charla, en el tiempo de preguntas, con su inconfundible vozarrón dispara certeros e inquisidoras preguntas al ponente. Lo que resulta sorprendente es el hecho de que sus preguntas dan normalmente en el clavo.

Gross y sus colegas propusieron lo que se denomina la cuerda heterótica. Hoy día, de todas las variedades de teorías tipo Kaluza-Klein que se propusieron en el pasado, es precisamente la cuerda heterótica la que tiene mayor potencial para unificar todas las leyes de la naturaleza en una teoría. Gross cree que la teoría de cuerdas resuelve el problema de construir la propia materia a partir de la geometría de la que emergen las partículas de materia y también la gravedad en presencia de las otras fuerzas de la naturaleza.

¿Por qué será que, cuando los físicos manejan las ecuaciones de la teoría de cuerdas, sin que nadie las llame, allí aparecen las ecuaciones de campo de la Relatividad General? ¿No será que que en esa teoría no verificada subyace una teoría de la Gr4avedad cuántica?

El caso curioso es que, la Relatividad de Einstein, subyace en la Teoría de cuerdas, y, si eliminamos de esta a aquella y su geometría de la Gravedad…todo resulta inútil. El gran Einstein está presente en muchos lugares y quizás, más de los que nos podamos imaginar.

Es curioso constatar que si abandonamos la teoría de la gravedad de Einstein como una vibración de la cuerda, entonces la teoría se vuelve inconsistente e inútil. Esta, de hecho, es la razón por la que Witten se sintió atraído inicialmente hacia la teoría de cuerdas. En 1.982 leyó un artículo de revisión de John Schwarz y quedó sorprendido al darse cuenta de que la gravedad emerge de la teoría de supercuerdas a partir solamente de los requisitos de auto consistencia. Recuerda que fue “la mayor excitación intelectual de mi vida”.

Gross se siente satisfecho pensando que Einstein, si viviera, disfrutaría con la teoría de supercuerdas que sólo es válida si incluye su propia teoría de la relatividad general, y amaría el hecho de que la belleza y la simplicidad de esa teoría proceden en última instancia de un principio geométrico, cuya naturaleza exacta es aún desconocida.atividad general de Einstein. Nos ayuda a estudiar las partes más grandes del Universo, como las estrellas y las galaxias. Pero los elementodiminutoso los átomos y las partículas subatómicas se rigen por unas leyes diferentes denominadas mecánica cuántica.

:format(jpg)/f.elconfidencial.com%2Foriginal%2F68c%2Fe14%2Fc51%2F68ce14c519946fca88d27a853ea6ce98.jpg)

Claro que, como todos sabemos, Einstein se pasó los últimos treinta años de su vida tratando de buscar esa teoría unificada que nunca pudo encontrar. No era consciente de que, en su tiempo, ni las matemáticas necesarias existían aún. En la historia de la física del siglo XX muchos son los huesos descoloridos de teorías que antes se consideraban cercanas a esa respuesta final que incansables buscamos.

Hasta el gran Wolfgang Pauli había colaborado con Heisenberg en la búsqueda de una teoría unificada durante algún tiempo, pero se alarmó al oir en una emisión radiofónica como Heisenberg decía: “Está a punto de ser terminada una Teoría unificada de Pauli-Heisenserg, en la que sólo nos queda por elaborar unos pocos detalles técnicos.”

Wolfgang Pauli

Enfadado por lo que consideraba una hipérbole de Heisenberg que se extralimitó con aquellas declaraciones en las que lo inviolucraba sin su consentimiento, Pauli envió a Gamow y otros colegas una simple hija de papel en blanco en la que había dibujado una caja vacía. Al pie del dibujo puso estas palabras: “Esto es para demostrar al mundo que yo puedo pintar con Tiziano. Sólo faltan algunos detalles técnicos.”

Los críticos del concepto de supercuerdas señalaron que las afirmaciones sobre sus posibilidades se basaban casi enteramente en su belleza interna. La teoría aún no había repetido siquiera los logros del Modelo Estándar, ni había hecho una sola predicción que pudiera someterse a prueba mediante el experimento. La Supersimetría ordenaba que el Universo debería estar repleto de familias de partículas nuevas, entre ellas los selectrones (equivalente al electrón supersimétrico) o el fotino (equivalente al fotón).

Lo cierto es que, nada de lo predicho ha podido ser comprobado “todavía” pero, sin embargo, la belleza que conlleva la teoría de cuerdas es tal que nos induce a creer en ella y, sólo podemos pensar que no tenemos los medios necesarios para comprobar sus predicciones, con razón nos dice E. Witten que se trata de una teoría fuera de nuestro tiempo, las supercuerdas pertenecen al futuro y aparecieron antes por Azar.

Y, a todo esto, ¿Dónde están esas otras dimensiones?

Bueno, una cosa es segura…. ¡Siempre hay más de lo que podemos ver! Ni subido en lo más alto podemos ver todo lo que hay.

Emilio Silvera Vázquez

Oct

26

El Electrón (el personaje más pequeño de la familia leptón)

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (1)

Comments (1)

Sí, el electrón es el más pequeño de la familia si no tenemos en cuenta los neutrinos acompañantes

En esta representación artística, un electrón orbita el núcleo de un átomo, girando alrededor de su eje mientras una nube de otras partículas subatómicas se emiten y reabsorben constantemente – Nicolle R. Fuller, Fundación Nacional de Ciencia

El Electrón sigue siendo la esfera más perfecta del Universo

El examen de esta partícula elemental con una precisión sin precedentes respalda, una vez más, el modelo estándar de la física

Investigadores del Imperial College de Londres concluyeron en 2011 que el electrón es la esfera más perfecta del Universo. Según anunciaron, lo que separa a esta partícula elemental de la redondez absoluta es menos de 0,000000000000000000000000001 cm, algo insignificante. En otras palabras, «si un electrón se inflara hasta el tener el tamaño del Sistema Solar, todavía parecería esférico».

Ahora, investigadores de las universidades estadounidenses de Northwestern, Harvard y Yale han examinado nuevamente la forma de la carga del electrón con una precisión sin precedentes. Y nada ha cambiado. Los investigadores han confirmado que es perfectamente esférico. Esta conclusión va mucho más allá de una mera curiosidad científica. Una carga ligeramente aplastada podría haber indicado partículas pesadas desconocidas y difíciles de detectar a su alrededor, un descubrimiento que, de haberse producido, habría afectado a la comunidad física mundial. Sin embargo, y aunque para algunos puede resultar decepcionante, todo parece seguir el guion del modelo estándar, la teoría que describe cómo funciona el Universo y que, pese a sus lagunas evidentes, todavía no ha podido ser desbancada.

Representación de un electrón- Nicolle R. Fuller, Fundación Nacional de Ciencia

«Si hubiéramos descubierto que la forma no era redonda, ese sería el mayor titular en física de las últimas décadas», dice Gerald Gabrielse, quien dirigió la investigación en Northwestern. «Pero nuestro descubrimiento sigue siendo igual de importante científicamente porque fortalece el modelo estándar de la física de partículas y excluye modelos alternativos». El estudio aparece publicado en la revista «Nature».

El modelo estándar describe la mayoría de las fuerzas y partículas fundamentales en el universo. Es una imagen matemática de la realidad, y ningún experimento de laboratorio realizado ha sido capaz de contradecirlo por el momento. Pero eso ha sido desconcertante para los físicos durante décadas. «El modelo estándar tal como está no puede ser correcto porque no puede predecir por qué existe el Universo», señala Gabrielse, profesor de física. «Esa es una laguna bastante grande».

Supersimetría

Al tratar de «arreglar» el modelo estándar, muchos modelos alternativos predicen que la esfera aparentemente uniforme de un electrón está en realidad aplastada asimétricamente. Uno de esos modelos, llamado supersimetría, postula que partículas subatómicas pesadas y desconocidas influyen en el electrón para alterar su forma perfectamente esférica, un fenómeno no probado llamado «momento dipolar eléctrico». Estas partículas más pesadas y sin descubrir podrían ser responsables de algunos de los misterios más deslumbrantes del Universo y posiblemente podrían explicar por qué está hecho de materia en lugar de antimateria.

«Casi todos los modelos alternativos dicen que la carga de electrones podría estar aplastada, pero simplemente no lo hemos visto con suficiente sensibilidad», apunta Gabrielse. «Es por eso que decidimos mirar allí con una precisión más alta de lo que nunca antes se había observado».

Crean un microscopio capaz de “ver” electrones en movimiento

Investigadores de la Universidad de Arizona desarrollan el microscopio más rápido del mundo que abre nuevas fronteras en la observación de procesos electrónicos ultrarrápidos.

En física, el electrón, comúnmente representado por el símbolo e−, es una partícula subatómica con una carga eléctrica elemental negativa. Un electrón no tiene componentes o subestructura conocidos; en otras palabras, generalmente se define como una partícula elemental.

Con este objetivo en mente, el equipo disparó un haz de moléculas de óxido de torio frías a una cámara del tamaño de un escritorio grande. Luego, los investigadores estudiaron la luz emitida por las moléculas. Una luz torcida indicaría un momento dipolo eléctrico. Como la luz no se torció, el equipo de investigación concluyó que la forma del electrón era, de hecho, redonda, confirmando la predicción del modelo estándar. Que no haya evidencia de un momento dipolo eléctrico significa que no hay evidencia de esas partículas hipotéticas más pesadas. Y si a pesar de todo estas partículas existen, sus propiedades difieren de las predichas por los teóricos.

«Nuestro resultado le dice a la comunidad científica que necesitamos repensar seriamente algunas de las teorías alternativas», asegura David DeMille, profesor de física en Yale y coautor del estudio.

En 2014, el equipo realizó la misma medición con un aparato más simple. Al utilizar métodos mejorados y diferentes frecuencias de láser, el experimento actual era un orden de magnitud más sensible que su predecesor. «Si un electrón fuera del tamaño de la Tierra, podríamos detectar si el centro del planeta está a una distancia un millón de veces más pequeña que un cabello humano», explica Gabrielse. «Así de sensible es nuestro aparato».

Los investigadores planean seguir afinando sus instrumentos para realizar mediciones cada vez más precisas. Hasta que los investigadores encuentren evidencias de lo contrario, la forma redonda de los electrones y los misterios del universo permanecerán como están.

«Sabemos que el modelo estándar está mal, pero parece que no podemos encontrar dónde está mal. Es como una gran novela de misterio», admite Gabrielse. «Debemos ser muy cuidadosos al hacer suposiciones de que estamos más cerca de resolver el misterio, pero tengo una gran esperanza de que nos estamos acercando a este nivel de precisión».

Para saber más: Marzio Nessi, físico del CERN: «Estamos a punto de dar el salto a una nueva física».

Oct

26

Velocidades inimaginables

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (0)

Comments (0)

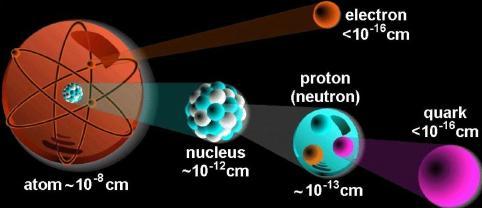

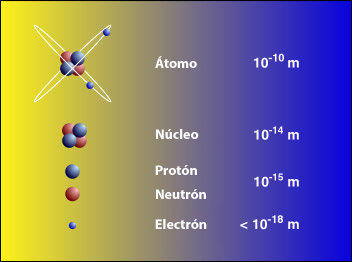

En el centro del átomo se encuentra un pequeño grano compacto aproximadamente 100.000 veces más pequeño que el propio átomo: el núcleo atómico. Su masa, e incluso más aún su carga eléctrica, determinan las propiedades del átomo del cual forma parte. Debido a la solidez del núcleo parece que los átomos, que dan forma a nuestro mundo cotidiano, son intercambiables entre sí, e incluso cuando interaccionan entre ellos para formar sustancias químicas (los elementos). Pero el núcleo, a pesar de ser tan sólido, puede partirse. Si dos átomos chocan uno contra el otro con gran velocidad podría suceder que los núcleos llegaran a chocar entre sí y entonces, o bien se rompen en trozos, o se funden liberando en el proceso partículas sub-nucleares. La nueva física de la primera mitad del siglo XX estuvo dominada por los nuevos acertijos que estas partículas planteaban.

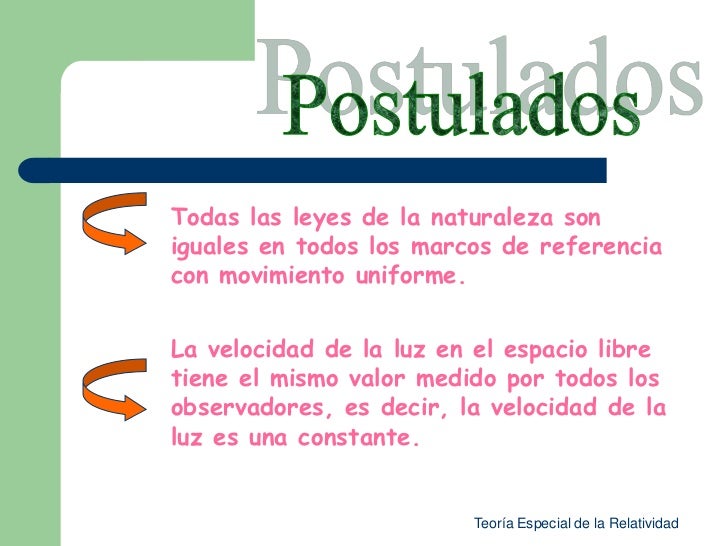

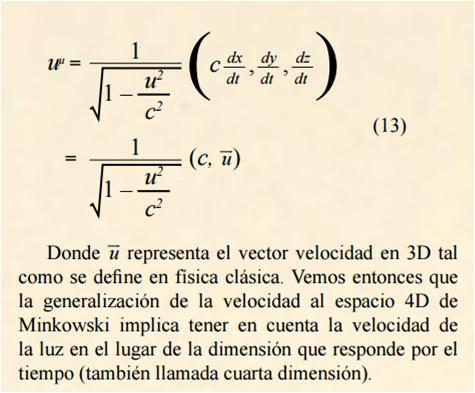

Pero tenemos la mecánica cuántica; ¿Es que no es aplicable siempre?, ¿Cuál es la dificultad? Desde luego, la mecánica cuántica es válida para las partículas subatómicas, pero hay más que eso. Las fuerzas con que estas partículas interaccionan y que mantienen el núcleo atómico unido son tan fuertes que las velocidades a las que tienen que moverse dentro y fuera del núcleo están cerca de la velocidad de la luz, c, que es de 299.792’458 Km/s. Cuando tratamos con velocidades tan altas se necesita una segunda modificación a las leyes de la física del siglo XIX; tenemos que contar con la teoría de la relatividad especial de Einstein.

Esta teoría también fue el resultado de una publicación de Einstein de 1905. en esta teoría quedaron sentadas las bases de que el movimiento y el reposo son conceptos relativos, no son absolutos, como tampoco habrá un sistema de referencia absoluto con respecto al cual uno pueda medir la velocidad de la luz.

Pero había más cosas que tenían que ser relativas. En este teoría, la masa y la energía también dependen de la velocidad, como lo hacen la intensidad del campo eléctrico y del magnético. Einstein descubrió que la masa de una partícula es siempre proporcional a la energía que contienen, supuesto que se haya tenido en cuenta una gran cantidad de energía en reposo de una partícula cualquiera, como se denota a continuación:

E = mc2

Pero ¿por qué nada puede superar a la velocidad de la luz en el vacío?

Supongamos un objeto acelerando, ganando velocidad y acercando su velocidad a la de la luz. Según la Teoría de la relatividad la energía necesaria para acelerar este objeto irá aumentando a medida que aumenta su velocidad como si su masa aumentará según la fórmula

Es fácil ver que a medida que v aumenta y se va acercando a c el valor de la raiza cuadrada del denominador va bajando hacia cero y por lo tanto el valor de la masa m va aumentando hacia infinito. El límite de esta expresión cuando v tiende a c es infinito.

Como la velocidad de la luz es muy grande, esta ecuación sugiere que cada partícula debe almacenar una cantidad enorme de energía, y en parte esta predicción fue la que hizo que la teoría de la relatividad tuviese tanta importancia para la física (¡y para todo el mundo!). Para que la teoría de la relatividad también sea auto-consistente tiene que ser holista, esto es, que todas las cosas y todo el mundo obedezcan a las leyes de la relatividad. No son sólo los relojes los que se atrasan a grandes velocidades, sino que todos los procesos animados se comportan de la forma tan inusual que describe esta teoría cuando nos acercamos a la velocidad de la luz. El corazón humano es simplemente un reloj biológico y latirá a una velocidad menor cuando viaje en un vehículo espacial a velocidades cercanas a la de la luz. Este extraño fenómeno conduce a lo que se conoce como la “paradoja de los gemelos”, sugerida por Einstein, en la que dos gemelos idénticos tienen diferente edad cuando se reencuentran después de que uno haya permanecido en la Tierra mientras que el otro ha viajado a velocidades relativistas.

Einstein comprendió rápidamente que las leyes de la gravedad también tendrían que ser modificadas para que cumplieran el principio relativista.

La formulación de newton es bien conocida, en la segunda imagen que se representan en este esquema dos partículas que se acercan entre sí siguiendo un movimiento acelerado. La interpretación newtoniana supone que el espacio-tiempo es llano y que lo que provoca la curvatura de las líneas de universo es la fuerza de interacción gravitatoria entre ambas partículas. Por el contrario, la interpretación einsteiniana supone que las líneas de universo de estas partículas son geodésicas (“rectas”), y que es la propia curvatura del espacio tiempo lo que provoca su aproximación progresiva.

Para poder aplicar el principio de la relatividad a la fuerza gravitatoria, el principio tuvo que ser extendido de la siguiente manera: no sólo debe ser imposible determinar la velocidad absoluta del laboratorio, sino que también es imposible distinguir los cambios de velocidad de los efectos de una fuerza gravitatoria.

Einstein comprendió que la consecuencia de esto era que la gravedad hace al espacio-tiempo lo que la humedad a una hoja de papel: deformar la superficie con desigualdades que no se pueden eliminar. Hoy en día se conocen muy bien las matemáticas de los espacios curvos, pero en el época de Einstein el uso de estas nociones matemáticas tan abstractas para formular leyes físicas era algo completamente nuevo, y le llevó varios años encontrar la herramienta matemática adecuada para formular su teoría general de la relatividad que describe cómo se curva el espacio en presencia de grandes masas como planetas y estrellas.

Einstein tenía la idea en su mente desde 1907 (la relatividad especial la formuló en 1905), y se pasó 8 años buscando las matemáticas adecuadas para su formulación.

Leyendo el material enviado por un amigo al que pidió ayuda, Einstein quedó paralizado. Ante él, en la primera página de una conferencia dada ante el Sindicato de Carpinteros, 60 años antes por un tal Riemann, tenía la solución a sus desvelos: el tensor métrico de Riemann, que le permitiría utilizar una geometría espacial de los espacios curvos que explicaba su relatividad general.

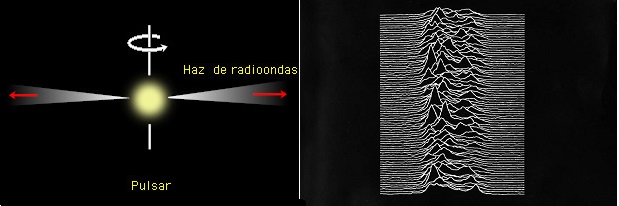

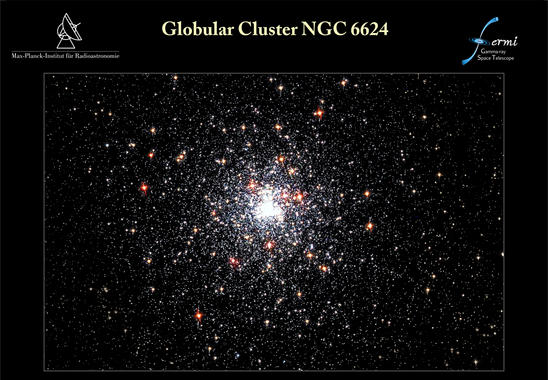

Desde que se puso en órbita el telescopio espacial de rayos gamma Fermi, el 11 de junio de 2008, ha detectado poblaciones enteras de objetos nunca antes vistos. El último hallazgo de Fermi afecta al púlsar J1823-3021A, avistado en 1994 con el radiotelescopio Lovell, en Inglaterra. Un equipo internacional de expertos se ha dado cuenta de que esta estrella pulsante emite rayos gamma y gracias a Fermi ha podido caracterizar sus inusuales propiedades. Los resultados de su investigación se publican en el último número de Science. Lo cierto es que han descubierto el púlsar de milisegundos más joven y con la fuerza magnética más potente

No está mal que en este punto recordemos la fuerza magnética y gravitatoria que nos puede ayudar a comprender mejor el comportamiento de las partículas subatómicas.

El electromagnetismo, decíamos al principio, es la fuerza con la cual dos partículas cargadas eléctricamente se repelen (si sus cargas son iguales) o se atraen (si tienen cargas de signo opuesto).

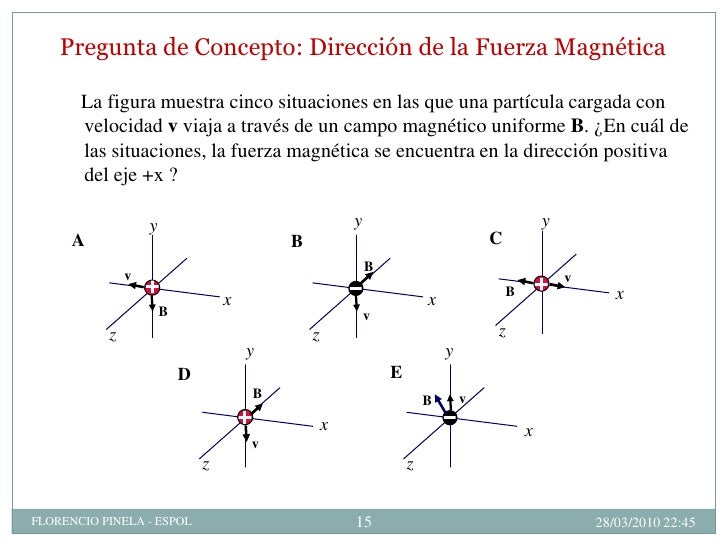

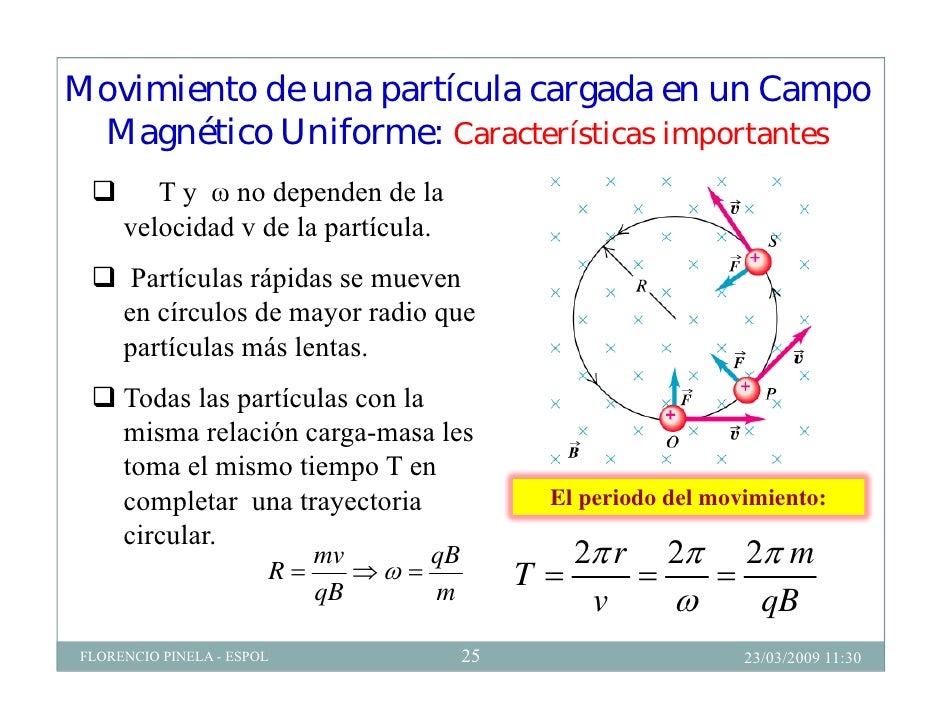

La interacción magnética es la fuerza que experimenta una partícula eléctricamente cargada que se mueve a través de un campo magnético. Las partículas cargadas en movimiento generan un campo magnético como, por ejemplo, los electrones que fluyen a través de las espiras de una bobina.

Las fuerzas magnéticas y eléctricas están entrelazadas. En 1873, James Clerk Maxwell consiguió formular las ecuaciones completas que rigen las fuerzas eléctricas y magnéticas, descubiertas experimentalmente por Michael Faraday. Se consiguió la teoría unificada del electromagnetismo que nos vino a decir que la electricidad y el magnetismo eran dos aspectos de una misma cosa.

La interacción es universal, de muy largo alcance (se extiende entre las estrellas), es bastante débil. Su intensidad depende del cociente entre el cuadrado de la carga del electrón y 2hc (dos veces la constante de Planck por la velocidad de la luz). Esta fracción es aproximadamente igual a 1/137’036…, o lo que llamamos α y se conoce como constante de estructura fina.

En general, el alcance de una interacción electromagnética es inversamente proporcional a la masa de la partícula mediadora, en este caso, el fotón, sin masa.

También antes hemos comentado sobre la interacción gravitatoria de la que Einstein descubrió su compleja estructura y la expuso al mundo en 1915 con el nombre de teoría general de la relatividad, y la relacionó con la curvatura del espacio y el tiempo. Sin embargo, aún no sabemos cómo se podrían reconciliar las leyes de la gravedad y las leyes de la mecánica cuántica (excepto cuando la acción gravitatoria es suficientemente débil).

La teoría de Einstein nos habla de los planetas y las estrellas del cosmos. La teoría de Planck, Heisemberg, Schrödinger, Dirac, Feynman y tantos otros, nos habla del comportamiento del átomo, del núcleo, de las partículas elementales en relación a estas interacciones fundamentales. La primera se ocupa de los cuerpos muy grandes y de los efectos que causan en el espacio y en el tiempo; la segunda de los cuerpos muy pequeños y de su importancia en el universo atómico. Cuando hemos tratado de unir ambos mundos se produce una gran explosión de rechazo. Ambas teorías son (al menos de momento) irreconciliables.

La Gravedad es la más débil de las cuatro fuerzas fundamentales

- La interacción gravitatoria actúa exclusivamente sobre la masa de una partícula.

- La gravedad es de largo alcance y llega a los más lejanos confines del universo conocido.

- Es tan débil que, probablemente, nunca podremos detectar esta fuerza de atracción gravitatoria entre dos partículas elementales. La única razón por la que podemos medirla es debido a que es colectiva: todas las partículas (de la Tierra) atraen a todas las partículas (de nuestro cuerpo) en la misma dirección.

El minúsculo y juguetón “gravitón” se ríe de todos y juega al escondite con los físicos del mundo

Un equipo de científicos asegura que, por primera vez en la histroria, está cerca de ver un gravitón, la partícula cuántica teórica de la gravedad

La partícula mediadora es el hipotético gravitón. Aunque aún no se ha descubierto experimentalmente, sabemos lo que predice la mecánica cuántica: que tiene masa nula y espín 2.

La ley general para las interacciones es que, si la partícula mediadora tiene el espín par, la fuerza entre cargas iguales es atractiva y entre cargas opuestas repulsiva. Si el espín es impar (como en el electromagnetismo) se cumple a la inversa.

Pero antes de seguir profundizando en estas cuestiones hablemos de las propias partículas subatómicas, para lo cual la teoría de la relatividad especial, que es la teoría de la relatividad sin fuerza gravitatoria, es suficiente.

Si viajamos hacia lo muy pequeño tendremos que ir más allá de los átomos, que son objetos voluminosos y frágiles comparados con lo que nos ocupará a continuación: el núcleo atómico y lo que allí se encuentra. Los electrones, que ahora vemos “a gran distancia” dando vueltas alrededor del núcleo, son muy pequeños y extremadamente robustos. El núcleo está constituido por dos especies de bloques: protones y neutrones. El protón (del griego πρώτος, primero) debe su nombre al hecho de que el núcleo atómico más sencillo, que es el hidrógeno, está formado por un solo protón. Tiene una unidad de carga positiva. El neutrón recuerda al protón como si fuera su hermano gemelo: su masa es prácticamente la misma, su espín es el mismo, pero en el neutrón, como su propio nombre da a entender, no hay carga eléctrica; es neutro.

La masa de estas partículas se expresa en una unidad llamada mega-electrón-voltio o MeV, para abreviar. Un MeV, que equivale a 106 electrón-voltios, es la cantidad de energía de movimiento que adquiere una partícula con una unidad de carga (tal como un electrón o un protón) cuando atraviesa una diferencia de potencial de 106 (1.000.000) voltios. Como esta energía se transforma en masa, el MeV es una unidad útil de masa para las partículas elementales.

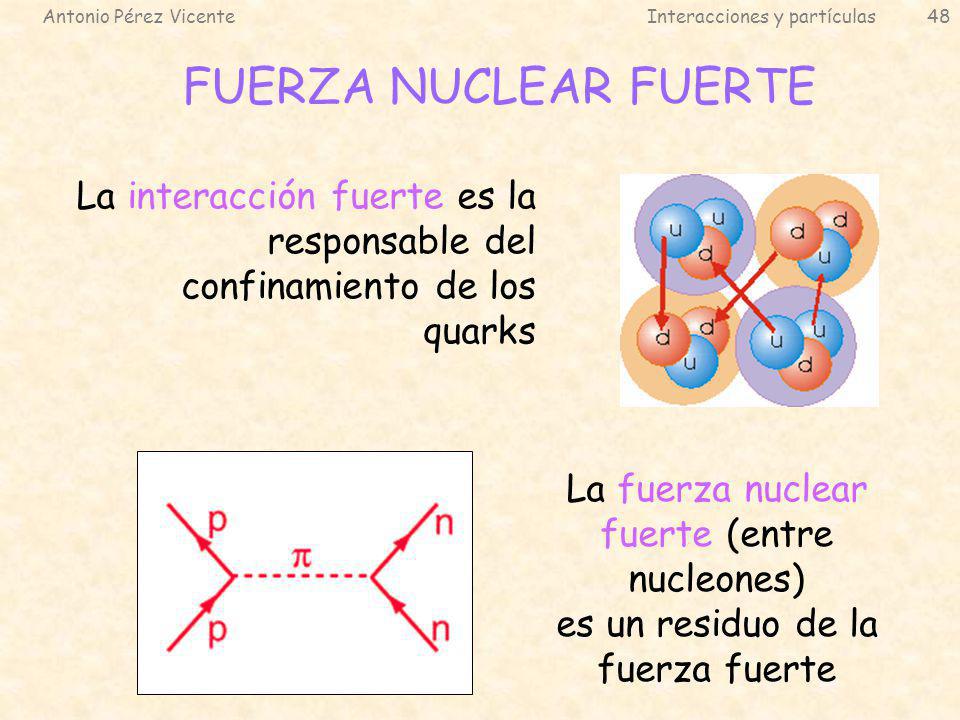

![]()

La mayoría de los núcleos atómicos contienen más neutrones que protones. Los protones se encuentran tan juntos en el interior de un núcleo tan pequeño que se deberían repeles entre sí fuertemente, debido a que tienen cargas eléctricas del mismo signo. Sin embargo, hay una fuerza que los mantiene unidos estrechamente y que es mucho más potente e intensa que la fuerza electromagnética: la fuerza o interacción nuclear fuerte, unas 102 veces mayor que la electromagnética, y aparece sólo entre hadronespara mantener a los nucleones confinados dentro del núcleo. Actúa a una distancia tan corta como 10-15 metros, o lo que es lo mismo, 0’000000000000001 metros.

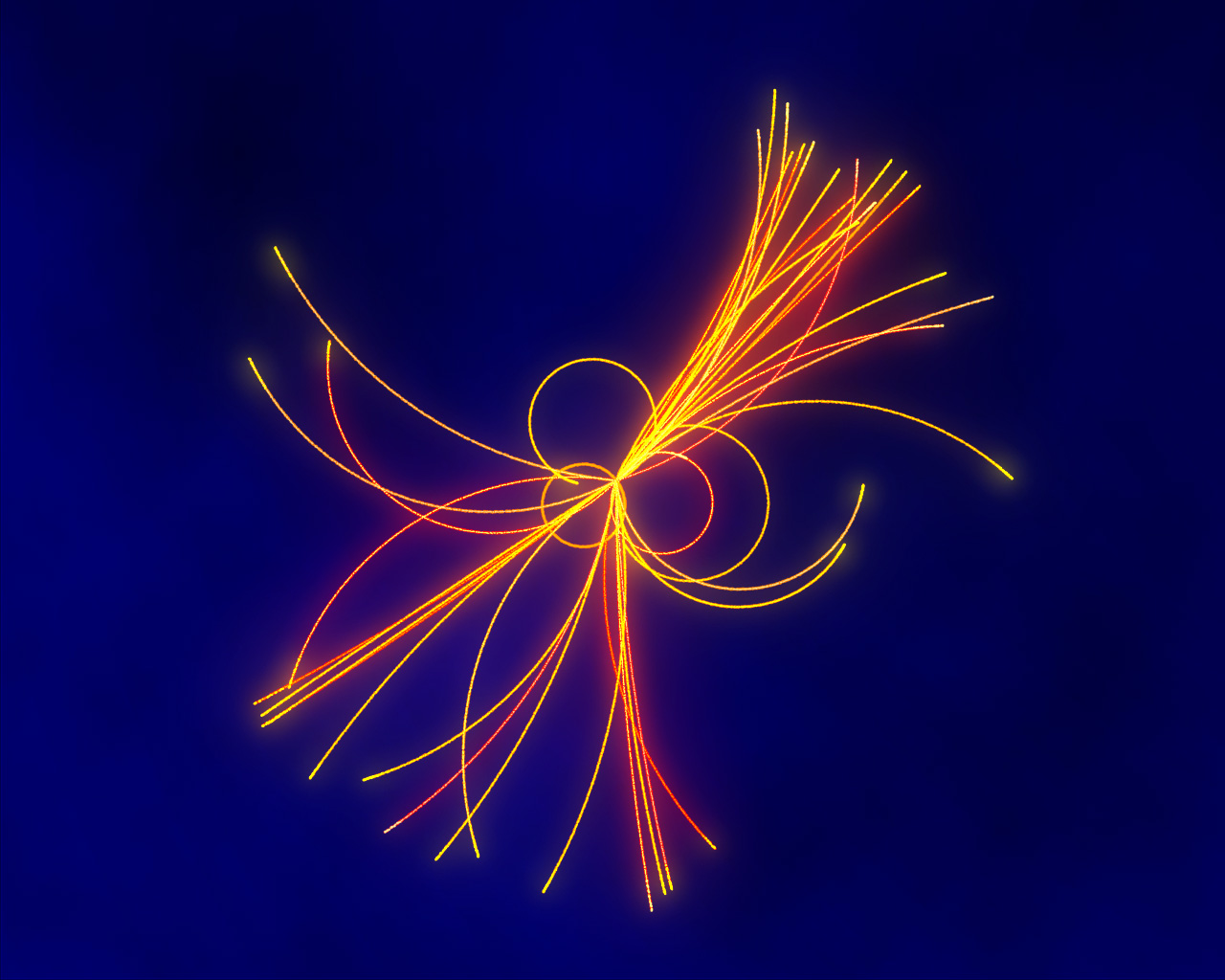

La interacción fuerte está mediada por el intercambio de mesones virtuales, 8 gluones que, como su mismo nombre indica (glue en inglés es pegamento), mantiene a los protones y neutrones bien sujetos en el núcleo, y cuanto más se tratan de separar, más aumenta la fuerza que los retiene, que crece con la distancia, al contrario que ocurre con las otras fuerzas.

La luz es una manifestación del fenómeno electromagnético y está cuantizada en “fotones”, que se comportan generalmente como los mensajeros de todas las interacciones electromagnéticas. Así mismo, como hemos dejado reseñado en el párrafo anterior, la interacción fuerte también tiene sus cuantos (los gluones). El físico japonés Hideki Yukawa (1907 – 1981) predijo la propiedad de las partículas cuánticas asociadas a la interacción fuerte, que más tarde se llamarían piones. Hay una diferencia muy importante entre los piones y los fotones: un pión es un trozo de materia con una cierta cantidad de “masa”. Si esta partícula está en reposo, su masa es siempre la misma, aproximadamente 140 MeV, y si se mueve muy rápidamente, su masa parece aumentar en función E = mc2. Por el contrario, se dice que la masa del fotón en reposo es nula. Con esto no decimos que el fotón tenga masa nula, sino que el fotón no puede estar en reposo. Como todas las partículas de masa nula, el fotón se mueve exclusivamente con la velocidad de la luz, 299.792’458 Km/s, una velocidad que el pión nunca puede alcanzar porque requeriría una cantidad infinita de energía cinética. Para el fotón, toda su masa se debe a su energía cinética.

Los físicos experimentales buscaban partículas elementales en las trazas de los rayos cósmicos que pasaban por aparatos llamados cámaras de niebla. Así encontraron una partícula coincidente con la masa que debería tener la partícula de Yukawa, el pión, y la llamaron mesón (del griego medio), porque su masa estaba comprendida entre la del electrón y la del protón. Pero detectaron una discrepancia que consistía en que esta partícula no era afectada por la interacción fuerte, y por tanto, no podía ser un pión. Actualmente nos referimos a esta partícula con la abreviatura μ y el nombre de muón, ya que en realidad era un leptón, hermano gemelo del electrón, pero con 200 veces su masa.

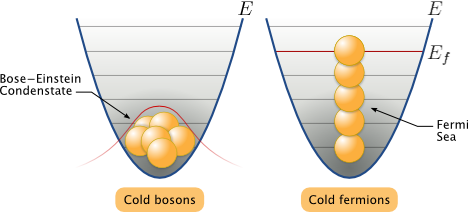

Antes de seguir veamos las partículas elementales de vida superior a 10-20 segundos que eran conocidas en el año 1970.

| Nombre | Símbolo | Masa (MeV) | Carga | Espín | Vida media (s) |

| Fotón | γ | 0 | 0 | 1 | ∞ |

| Leptones (L = 1, B = 0) | |||||

| Electrón | e– | 0’5109990 | – | ½ | ∞ |

| Muón | μ– | 105’6584 | – | ½ | 2’1970 × 10-6 |

| Tau | τ | ||||

| Neutrino electrónico | νe | ~ 0 | 0 | ½ | ~ ∞ |

| Neutrino muónico | νμ | ~ 0 | 0 | ½ | ~ ∞ |

| Neutrino tauónico | ντ | ~ 0 | 0 | ½ | ~ ∞ |

| Mesones (L = 0, B = 0) | |||||

| Pión + | π+ | 139’570 | 2’603 × 10-8 | ||

| Pión – | π– | 139’570 | 2’603 × 10-8 | ||

| Pión 0 | π0 | 134’976 | 0’84 × 10-16 | ||

| Kaón + | k+ | 493’68 | 1’237 × 10-8 | ||

| Kaón – | k– | 493’68 | 1’237 × 10-8 | ||

| Kaón largo | kL | 497’7 | 5’17 × 10-8 | ||

| Kaón corto | kS | 497’7 | 0’893 × 10-10 | ||

| Eta | η | 547’5 | 0 | 0 | 5’5 × 10-19 |

| Bariones (L = 0, B = 1) | |||||

| Protón | p | 938’2723 | + | ½ | ∞ |

| Neutrón | n | 939’5656 | 0 | ½ | 887 |

| Lambda | Λ | 1.115’68 | 0 | ½ | 2’63 × 10-10 |

| Sigma + | Σ+ | 1.189’4 | + | ½ | 0’80 × 10-10 |

| Sigma – | Σ– | 1.1974 | – | ½ | 7’4× 10-20 |

| Sigma 0 | Σ0 | 0 | ½ | 1’48 × 10-10 | |

| Ksi 0 | Ξ0 | 1.314’9 | 0 | ½ | 2’9 × 10-10 |

| Ksi – | Ξ– | 1.321’3 | – | ½ | 1’64 × 10-10 |

| Omega – | Ω– | 1.672’4 | – | 1½ | 0’82 × 10-10 |

Para cada leptón y cada barión existe la correspondiente antipartícula, con exactamente las mismas propiedades a excepción de la carga que es la contraria. Por ejemplo, el antiprotón se simboliza con y el electrón con e+. Los mesones neutros son su propia antipartícula, y el π+ es la antipartícula del π–, al igual que ocurre con k+ y k–. El símbolo de la partícula es el mismo que el de su antipartícula con una barra encima. Las masas y las vidas medias aquí reflejadas pueden estar corregidas en este momento, pero de todas formas son muy aproximadas.

![53 - TEORÍA CUÁNTICA de CAMPOS [ ISOSPIN - SU(2) ]](https://i.ytimg.com/vi/aukgd8NBO_E/hq720.jpg?sqp=-oaymwEhCK4FEIIDSFryq4qpAxMIARUAAAAAGAElAADIQj0AgKJD&rs=AOn4CLDhPy7Cl5O2LZ8GZHAfx1mCydUPuw)

Los símbolos que se pueden ver algunas veces, como s (extrañeza) e i (isoespín) están referidos a datos cuánticos que afectan a las partículas elementales en sus comportamientos.

Debo admitir que todo esto tiene que sonar algo misterioso. Es difícil explicar estos temas por medio de la simple palabra escrita sin emplear la claridad que transmiten las matemáticas, lo que, por otra parte, es un mundo secreto para el común de los mortales, y ese lenguaje es sólo conocido por algunos privilegiados que, mediante un sistema de ecuaciones pueden ver y entender de forma clara, sencilla y limpia, todas estas complejas cuestiones.

Si hablamos del espín (o, con más precisión, el momento angular, que es aproximadamente la masa por el radio por la velocidad de rotación) se puede medir como un múltiplo de la constante de Planck, h, dividido por 2π. Medido en esta unidad y de acuerdo con la mecánica cuántica, el espín de cualquier objeto tiene que ser o un entero o un entero más un medio. El espín total de cada tipo de partícula – aunque no la dirección del mismo – es fijo.

El electrón, por ejemplo, tiene espín ½. Esto lo descubrieron dos estudiantes holandeses, Samuel Gondsmit (1902 – 1978) y George Uhlenbeck (1900 – 1988), que escribieron sus tesis conjuntamente sobre este problema en 1972. Fue una idea audaz que partículas tan pequeñas como los electronespudieran tener espín, y de hecho, bastante grande. Al principio, la idea fue recibida con escepticismo porque la “superficie del electrón” se tendría que mover con una velocidad 137 veces mayor que la de la luz, lo cual va en contra de la teoría de la relatividad general en la que está sentado que nada en el universo va más rápido que la luz, y por otra parte, contradice E=mc2, y el electrón pasada la velocidad de la luz tendría una masa infinita.

Hoy día, sencillamente, tal observación es ignorada, toda vez que el electrón carece de superficie.

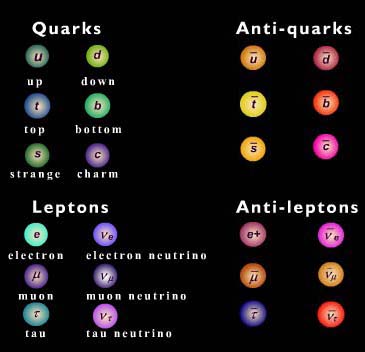

Las partículas con espín entero se llaman bosones, y las que tienen espín entero más un medio se llaman fermiones. Consultado los valores del espín en la tabla anterior podemos ver que los leptones y los bariones son fermiones, y que los mesones y los fotones son bosones. En muchos aspectos, los fermionesse comportan de manera diferente de los bosones. Los fermiones tienen la propiedad de que cada uno de ellos requiere su propio espacio: dos fermiones del mismo tipo no pueden ocupar o estar en el mismo punto, y su movimiento está regido por ecuaciones tales que se evitan unos a otros. Curiosamente, no se necesita ninguna fuerza para conseguir esto. De hecho, las fuerzas entre los fermiones pueden ser atractivas o repulsivas, según las cargas. El fenómeno por el cual cada fermión tiene que estar en un estado diferente se conoce como el principio de exclusión de Pauli. Cada átomo está rodeado de una nube de electrones, que son fermiones (espín ½). Si dos átomos se aproximan entre sí, los electrones se mueven de tal manera que las dos nubes se evitan una a otra, dando como resultado una fuerza repulsiva. Cuando aplaudimos, nuestras manos no se atraviesan pasando la uno a través de la otra. Esto es debido al principio de exclusión de Pauli para los electrones de nuestras manos que, de hecho, los de la izquierda rechazan a los de la derecha.

En contraste con el característico individualismo de los fermiones, los bosones se comportan colectivamente y les gusta colocarse todos en el mismo lugar. Un láser, por ejemplo, produce un haz de luz en el cual muchísimos fotones llevan la misma longitud de onda y dirección de movimiento. Esto es posible porque los fotones son bosones.

Cuando hemos hablado de las fuerzas fundamentales que, de una u otra forma, interaccionan con la materia, también hemos explicado que la interacción débil es la responsable de que muchas partículas y también muchos núcleos atómicos exóticos sean inestables. La interacción débil puede provocar que una partícula se transforme en otra relacionada, por emisión de un electrón y un neutrino. Enrico Fermi, en 1934, estableció una fórmula general de la interacción débil, que fue mejorada posteriormente por George Sudarshan, Robert Marschak, Murray Gell-Mann, Richard Feynman y otros. La fórmula mejorada funciona muy bien, pero se hizo evidente que no era adecuada en todas las circunstancias.

Uno de los protones se transmuta en un neutrón por medio de la interacción débil, transformando un quark “up”, en “down”. Este proceso consume energía (el neutrón tiene ligeramente más masa que..

En 1970, de las siguientes características de la interacción débil sólo se conocían las tres primeras:

- La interacción actúa de forma universal sobre muchos tipos diferentes de partículas y su intensidad es aproximadamente igual para todas (aunque sus efectos pueden ser muy diferentes en cada caso). A los neutrinos les afecta exclusivamente la interacción débil.

- Comparada con las demás interacciones, ésta tiene un alcance muy corto.

- La interacción es muy débil. Consecuentemente, los choques de partículas en los cuales hay neutrinos involucrados son tan poco frecuentes que se necesitan chorros muy intensos de neutrinos para poder estudiar tales sucesos.

- Los mediadores de la interacción débil, llamados W+, W– y Z0, no se detectaron hasta la década de 1980. al igual que el fotón, tienen espín 1, pero están eléctricamente cargados y son muy pesados (esta es la causa por la que el alcance de la interacción es tan corto). El tercer mediador, Z0, que es responsable de un tercer tipo de interacción débil que no tiene nada que ver con la desintegración de las partículas llamada “corriente neutra”, permite que los neutrinos puedan colisionar con otras partículas sin cambiar su identidad.

A partir de 1970, quedó clara la relación de la interacción débil y la electromagnética (electrodébil de Weinberg-Salam).

La interacción fuerte (como hemos dicho antes) sólo actúa entre las partículas que clasificamos en la familia llamada de los hadrones, a los que proporciona una estructura interna complicada. Hasta 1972 sólo se conocían las reglas de simetría de la interacción fuerte y no fuimos capaces de formular las leyes de la interacción con precisión.

Como apuntamos, el alcance de esta interacción no va más allá del radio de un núcleo atómico ligero (10-13 cm aproximadamente).

La interacción es fuerte. En realidad, la más fuerte de todas. Actúa como un muelle de Acero, cuanto más lo estiramos más se resiste. La Interacción fuerte es la única de las cuatro fuerzas que crece con la distancia. Si los Gluones se quieren separar, son agarros por los Gluones y los retienen allí confinados (son las entrañas de los nucleones).

Lo dejaré aquí, en verdad, eso que el Modelo Estándar de la Física, es feo, complejo e incompleto y, aunque hasta el momento es una buena herramienta con la que trabajar, la verdad es que, se necesita un nuevo modelo más avanzado y que incluya la Gravedad.

Y, a todo esto, esperemos que el LHC, dotado de más energía, pueda por fin encontrar al Gravitón

Emilio Silvera Vázquez

Totales: 74.898.513

Totales: 74.898.513 Conectados: 39

Conectados: 39