Mar

4

¿Dónde estaba la materia perdida?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (13)

Comments (13)

Los físicos se vieron durante mucho tiempo turbados por el hecho de que a menudo, la partícula beta emitida en una desintegración del núcleo no alberga energía suficiente para compensar la masa perdida por el núcleo. En realidad, los electrones no eran igualmente deficitarios. Emergían con un amplio espectro de energías, y el máximo (conseguido por muy pocos electrones), era casi correcto, pero todos los demás no llegaban a alcanzarlo en mayor o menor grado. Las partículas alfa emitidas por un nucleido particular poseían iguales energías en cantidades inesperadas. En ese caso, ¿Qué era errónea en la emisión de partículas beta? ¿Qué había sucedido con la energía perdida?

En 1.922, Lise Maitner se hizo por primera vez esta pregunta, y, hacia 1.930, Niels Bohr estaba dispuesto a abandonar el gran principio de conservación de la energía, al menos en lo concerniente a partículas subatómicas. En 1.931, Wolfgang Pauli sugirió una solución para el enigma de la energía desaparecida.

El investigador austriaco Wolfgang Pauli propuso en 1930 la idea de que había una partícula que no tenía carga, y él pensaba que también una masa despreciable, y que era la que se llevaba la parte de energía que faltaba. La llamó neutrino.

Tal solución era muy simple: junto con la partícula beta del núcleo se desprendía otra, que se llevaba la energía desaparecida. Esa misteriosa segunda partícula tenía propiedades bastante extrañas. No poseía carga ni masa. Lo único que llevaba mientras se movía a la velocidad de la luz era cierta cantidad de energía. A decir verdad, aquello parecía un cuerpo ficticio creado exclusivamente para equilibrar el contraste de energías.

Sin embargo, tan pronto como se propuso la posibilidad de su existencia, los físicos creyeron en ella ciegamente. Y esta certeza se incrementó al descubrirse el neutrón y al saberse que se desintegraba en un protón y se liberaba un electrón, que, como en la decadencia beta, portaba insuficientes cantidades de energía. Enrico Fermi dio a esta partícula putativa el nombre de “neutrino”, palabra italiana que significa “pequeño neutro”.

Mar

1

¿Qué será la materia?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (7)

Comments (7)

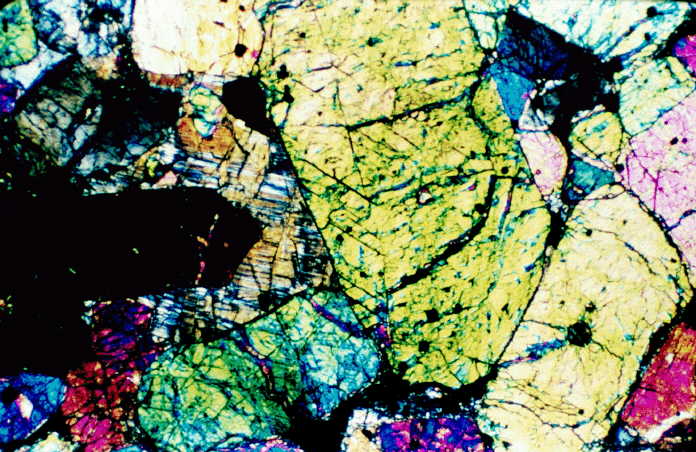

¿Estábamos muy atrasados en el conocimiento de la materia?

Bueno tenemos unas reglas que nos dicen de qué está hecha. Sin embargo, otros hablan de unas cuerdas vibrantes que serían los componentes primigenios, situados más allá de los Quarks

en los colegios, cuando estábamos en primaria nos decían que la materia estaba en tres estados: Sólido, Líquido y Gaseoso. No contaban con el estado más abundante de la materia en el Universo que era el Plasma.

Sí, la materia conforma maravillas, la vida la mayor de ellas

No podemos dejar de asombrarnos de la presencia de la Vida en el Universo

¿Cómo pudo surgir la Vida a partir de la materia “inerte”

¿Cómo ha podido surgir la Conciencia de la materia?

Tiene y encierra tantos misterios la materia que estamos aún y años-luz de saber y conocer sobre su verdadera naturaleza. Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos pero que tampoco sabemos, en realidad, a que son debidos. Si, sabemos ponerles etiquetas como, por ejemplo, la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio y, con mayor frecuencia, en los elementos que conocemos como transuránicos.

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de ruptura, sobrepasando a la emisión de partículas alfa.

¡Parece que la materia está viva!

Son muchas las cosas que desconocemos y, nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

Si se encuentran electrón y positrón… ¡Se aniquilan!

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o antineutrón), y, por lo tanto, han sido denominados leptones (de la voz griega lepto que significa “delgado”).

El electrón es onda y partícula

Aunque el electrón fue descubierto en 1.897 por el físico británico Josepth John Thomson (1856-1940), el problema de su estructura, si la hay, no está resuelto. Conocemos su masa y su carga negativa que responden a 9,1093897 (54)x10-31kg la primera y, 1,602 177 33 (49)x10-19 culombios, la segunda, y también su radio clásico. No se ha descubierto aún ninguna partícula que sea menos masiva que el electrón (o positrón) y que lleve una carga eléctrica, sea lo que fuese (sabemos como actúa y cómo medir sus propiedades, pero aun no sabemos qué es), tenga asociada un mínimo de masa, y que esta es la que se muestra en el electrón.

Mar

1

La perfección imperfecta

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Cuántica ~

Clasificado en Física Cuántica ~

Comments (5)

Comments (5)

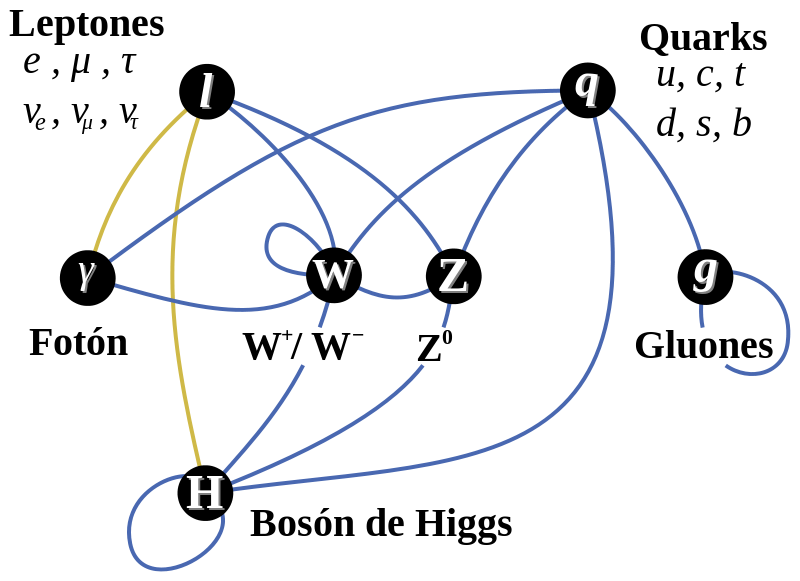

Me refiero al Modelo estándar y, algunos han llegado a creer que sólo faltan algunos detalles técnicos y, con ellos, la física teórica está acabada. Tenemos un modelo que engloba todo lo que desamos saber acerca de nuestro mundo físico. ¿Qué más podemos desear?

Bueno, lo que hasta el momento hemos logrado no está mal del todo pero, no llega, ni con mucho, a la perfección que la Naturaleza refleja y que, nosotros perseguimos sin llegar a poder agarrar sus múltiples entresijos y parámetros que conforman ese todo en el que, sin ninguna clase de excusas, todo debe encajar y, de momento, no es así.

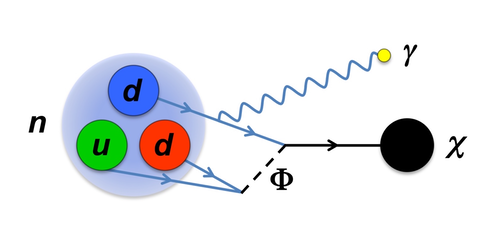

Fuente: Prog. Part. Nucl. Phys. 106: 68-119 (2019).

Para la mayoría de los físicos el modelo estándar es una teoría efectiva: el límite a baja energía de una teoría más fundamental desconocida. El lagrangiano ℒ del modelo estándar es un operador de dimensión cuatro (ya que la acción es S = ∫ℒ d⁴x). La física más allá del modelo estándar modificará dicho lagrangiano añadiendo términos de mayor dimensión; por ejemplo, ℒ + ∑ Cᵢ ?ᵢ /Λ², donde el sumatorio recorre los 2499 operadores ?ᵢ de dimensión seis y Λ es una nueva escala de energía (que será mucho mayor que la masa del quark top). El físico John Ellis (CERN) nos recuerda que ajustar estos 2500 parámetros (los ?ᵢ y Λ) usando las colisiones del LHC y otros colisionadores es imposible. La única solución es asumir simetrías que reduzcan dicho número parámetros. En su último artículo nos propone usar las simetrías SU(3)⁵ y SU(2)²×SU(3)³. Por supuesto, hay muchas otras alternativas.

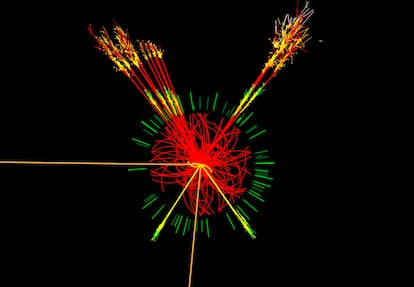

La física de partículas se suele separar en física experimental (observacional), física teórica (fundamental) y física fenomenológica; las teorías efectivas son parte de esta última, siendo su objetivo desvelar los primeros indicios (lo que inglés se llama evidences) de física más allá del modelo estándar. Hoy en día disponemos de un conocimiento en teoría cuántica de campos suficiente para desarrollar de forma sistemática todas las teorías efectivas posibles; un elemento clave a tener en cuenta son las redefiniciones de campos, una redundancia cuya eliminación nos permite obtener lo que se llama una base de operadores. Una vez obtenida podemos ajustar sus parámetros con los datos de colisiones que se recaban en los grandes colisionadores de partículas (como el LHC en el CERN).

Por desgracia, el número de parámetros de estas teorías efectivas más allá del modelo estándar es enorme. John von Neumann decía que «con cuatro parámetros puedo ajustar un elefante, y con cinco puedo lograr que mueva su trompa» [LCMF, 27 may 2010]. Ajustar muchos parámetros, incluso cuando se dispone de una vasta cantidad de observaciones, requiere lidiar con el problema estadístico de las comparaciones múltiples (que en física de partículas se suele llamar look-elsewhere effect): pueden aparecer indicios espurios (señales con más de tres sigmas de significación estadística) que solo son falsos positivos. En un espacio de 2500 parámetros es muy fácil caer en este problema; incluso cuando se usa un espacio paramétrico mucho más pequeño (por ejemplo, la extensión supersimétrica mínima del modelo estándar, el modelo MSSM, tiene 124 parámetros libres).

Nadie dijo nunca que la búsqueda de física más allá del modelo estándar fuera sencilla. Y tampoco que fuera fácil de automatizar. La intuición física (que a veces se llama «búsqueda de la belleza») juega y jugará un papel fundamental en la labor de los físicos fenomenológicos (al menos hasta que no se les pueda sustituir por futuras inteligencias artificiales). El nuevo artículo es John Ellis, «SMEFT Constraints on New Physics Beyond the Standard Model,» arXiv:2105.14942 [hep-ph] (31 May 2021), que resume los resultados de John Ellis, Maeve Madigan, …, Tevong You, «Top, Higgs, Diboson and Electroweak Fit to the Standard Model Effective Field Theory,» Journal of High Energy Physics 2021: 279 (29 Apr 2021), doi: https://doi.org/10.1007/JHEP04(2021)279, arXiv:2012.02779 [hep-ph] (04 Dec 2020). También muestro resultados del artículo de Jens Erler, Matthias Schott, «Electroweak Precision Tests of the Standard Model after the Discovery of the Higgs Boson,» Progress in Particle and Nuclear Physics 106: 68-119 (2019), doi: https://doi.org/10.1016/j.ppnp.2019.02.007, arXiv:1902.05142 [hep-ph] (13 Feb 2019).

“El número de parámetros del modelo estándar, que está basado en interacciones gauge con simetrías SU(3)×SU(2)×U(1), depende de la física de los neutrinos (ignoramos si son fermiones de Dirac o de Majorana). Si los neutrinos no tuvieran masa serían 18 parámetros (llamados electrodébiles); en esta figura se añaden dos parámetros adicionales al final que están relacionados con la cromodinámica cuántica en régimen no perturbativo. Como los neutrinos tienen masa hay que añadir sus 3 masas y los parámetros de la mezcla de sus sabores en la matriz PMNS, que serían 4 para neutrinos de Dirac y 6 para Majorana. Además, habría que añadir un parámetro relacionado con la violación de la simetría CP en la interacción fuerte (que estaría relacionado con la masa de los axiones, si estos existieran). Así el número de parámetros del modelo estándar estaría entre 25 y 28.

Es cierto que, el Modelo estándar es casi (en algunos momentos), pero no permanentemente, perfecto. En primer lugar, podríamos empezar a quejarnos de las casi veinte constantes que no se pueden calcular. Pero si esta fuese la única queja, habría poco que hacer. Desde luego, se han sugerido numerosas ideas para explicar el origen de estos números y se han propuesto varias teorías para “predecir” sus valores. El problema con todas estas teorías es que los argumentos que dan nunca llegan a ser convincentes.”

Fuente: Ciencia de la Mula Francis.

¿Por qué se iba a preocupar la Naturaleza de una fórmula mágica si en ausencia de tal fórmula no hubiera contradicciones? Lo que realmente necesitamos es algún principio fundamental nuevo, tal como el principio de la relatividad, pero nos resistimos a abandonar todos los demás principios que ya conocemos; ¡esos, después de todo, han sido enormemente útiles en el descubrimiento del Modelo estándar! una herramienta que posibilitado a todos los físicos del mundo, construir sus trabajos en ese fascinante mundo de la mecánica cuántica, donde partículas infinitesimales interactúan con las fuerzas y podemos ver, como se comporta la materia en determinadas circunstancias. El mejor lugar para buscar nuevos principios es precisamente donde se encuentran los puntos débiles de la presente teoría.

Es cierto que la materia le habla al Espacio y el espacio le habla a la materia

La regla universal en la física de partículas es que cuando las partículas chocan con energías cada vez mayores, los efectos de las colisiones están determinados por estructuras cada vez menores, más pequeñas en el espacio y en el tiempo. Supongamos por un momento que tenemos a nuestra disposición un Acelerador de Partículas 10.000 veces más potente que el LHC, donde las partículas pueden adquirir esas tantas veces más energías de las alcanzadas actualmente. Las colisiones que tendrían lugar nos dirían algo acerca de los detalles estructurales de esas partículas que ahora no conocemos, que serían mucho más pequeños que los que ahora podemos contemplar. En este punto se me ocurre la pregunta: ¿Seguiría siendo correcto el Modelo estándar? 0, por el contrario, a medida que nos alejemos en las profundidades de lo muy pequeño, también sus normas podrían variar al mismo tiempo que varían las dimensiones de los productos hallados. Recordad que, el mundo no funciona de la misma manera ante lo grande que ante lo infinitesimal.

El LHC consiguió en menos de un mes el Bosón W

¿Podéis imaginar conseguir colisiones a 70.000 TeV? ¿Qué podrías ver? Y, entonces, seguramente, las protestas de algunas de que “ese monstruo” podría abrir un agujero de gusano en el espacio tiempo…¡tendría algún fundamento! No sabemos lo que puede pasar si andamos con fuerzas que no podemos dominar.

Hoy, el Modelo estándar es una construcción matemática que predice sin ambigüedad cómo debe ser el mundo de las estructuras aún más pequeñas. Pero tenemos algunas razones para sospechar que tales predicciones resultan estar muy alejadas de la realidad, o, incluso, ser completamente falsas.

Encendamos nuestro super-microscopio imaginario y enfoquémoslo directamente en el centro de un protón o de cualquier otra partícula. Veremos hordas de partículas fundamentales desnudas pululando. Vistas a través del super-microscopio, el Modelo Estándar que contiene veinte constantes naturales (o algunas más), describen las fuerzas que rigen la forma en que se mueven. Sin embargo, ahora esas fuerzas no sólo son bastante fuertes sino que también se cancelan entre ellas de una forma muy especial; están ajustadas para conspirar de tal manera que las partículas se comportan como partículas ordinarias cuando se vuelven a colocar el microscopio en la escala de ampliación ordinaria. Si en nuestras ecuaciones matemáticas cualquiera de estas constantes fueran reemplazadas por un número ligeramente diferente, la mayoría de las partículas obtendrían inmediatamente masas comparables a las gigantescas energías que son relevantes en el dominio de las muy altas energías. El hecho de que todas las partículas tengan masa que corresponden a energías mucho menores repentinamente llega a ser bastante poco natural.

Los ajustes finos del universo

“Si uno se pone a examinarlo con detalle, resulta que el universo está maravillosamente ajustado para poder permitir la vida. A esto se le llama el problema del fine tuning o ajuste fino del universo. Normalmente, por ajuste fino se suele entender el hecho de que los valores de ciertas constantes, de ser ligeramente modificados, incluso muy ligeramente modificados, tendrían como resultado que la vida compleja como nosotros sería imposible.

Hugh Ross

Quizá el ejemplo más claro sea el de los valores de las fuerzas fundamentales (gravitatoria, nuclear débil, nuclear fuerte y electromagnética). Según Hugh Ross, una fuerza gravitatoria un poco más débil impediría estrellas como nuestro Sol; todas las estrellas que podrían formarse serían bastante más masivas y consumirían su combustible muchísimo antes de que la vida compleja pudiera emerger. Por otro lado, una fuerza de la gravedad más intensa no permitiría estrellas como el Sol, todas las estrellas serían muy ligeras e incapaces de sintetizar los elementos más pesados que la vida necesita. La fuerza nuclear fuerte también está increíblemente bien ajustada: un poco más fuerte y todo el hidrógeno se habría consumido al principio del universo, impidiendo la formación de estrellas con una vida larga; un poco más débil y muchos de los elementos químicos actuales serían radiactivos, con evidentes consecuencias negativas para la vida. Pueden encontrarse más ejemplos en la página de Wikipedia sobre el problema del ajuste fino (donde he sacado mucha información). El astrofísico Martin Rees, en su libro Solo seis números, determinó que en esencia eran 6 los parámetros (constantes universales o combinación de ellas) que si hubiesen variado siquiera un mínimo habrían impedido la vida:

–

, la relación entre la fuerza electromagnética y la gravitatoria. Además de los problemas asociados con la evolución estelar ya mencionados, si N fuera más pequeña, el universo se hubiera expandido y re-contraído muy rápidamente, sin permitir la formación de entidades complejas.

–

, mide la eficiencia del hidrógeno para convertirse en helio en las reacciones nucleares en las estrellas. Cuatro átomos de hidrógeno se convierten en uno de helio y se libera un 0.7 % de energía. Si

fuera 0.006 (una variación de una parte en diez mil) solo existiría el hidrógeno, con lo que toda química mínimamente compleja sería imposible. Por encima de un valor de 0.008 no existiría hidrógeno ya que la reacción sería «demasiado eficiente» y se habría fusionado todo poco después del Big Bang (con respecto a este valor de 0.008 hay que decir que hay autores que consideran que la horquilla es un poco más amplia).

no es una constante fundamental del universo, viene determinada por el valor de la fuerza nuclear fuerte (la que mantiene ligados a los protones y neutrones, es decir, a los quarks en el interior de los átomos).

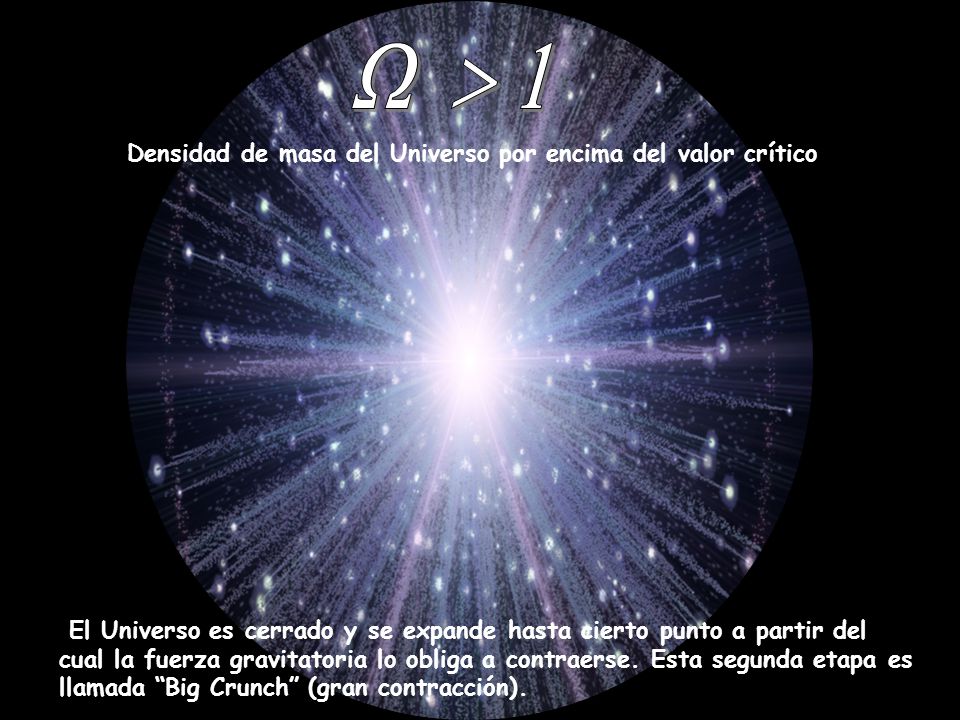

–

. La letra griega omega indica la densidad del universo. Es el cociente entre la fuerza de contracción (la gravedad) y la energía de expansión. Con una

el universo se habría contraído rápidamente sobre sí mismo, volviendo a un estado similar al del Big Bang; con una

la gravedad es tan débil que no se forman estrellas. El valor medido está increíblemente próximo a 1, es decir, a la planitud.

–

.

mide el valor de la constante cosmológica (la energía que hay en el vacío) dividida por la densidad crítica del universo (la

de antes, que en su valor crítico es 1). En unidades naturales (las llamadas unidades de Planck) la constante cosmológica tiene un valor increíblemente pequeño, de modo tal que la expansión del universo es irrelevante para las escalas habituales en las que vivimos (no vemos que en nuestro mundo los objetos estén cada día más lejos de donde los dejamos la noche anterior). Con un valor no tan pequeño, las estrellas no podrían formarse. Curioso: si seguimos la teoría cuántica de campos, obtenemos para la energía del vacío un valor 120 órdenes de magnitud (

) más alto que lo que medimos para la constante cosmológica; si esto fuera así no habría estrellas y el universo se estaría expandiendo a una velocidad alucinante (de hecho, no estaríamos aquí para observarlo); a esto se le llama el problema de los 120 órdenes de magnitud y se ha dicho que es la peor predicción de la historia de la Física.

–

, Rees introdujo este poco conocido parámetro para estimar cuánta energía habría que usar para disociar por completo una galaxia utilizando su masa como energía (

). Más pequeño indicaría que no se podrían formar estrellas, más grande y el universo sería demasiado violento como para poder sobrevivir en él.

–

. El número de dimensiones espaciales es, como todos sabemos, de 3. Con más o menos dimensiones la vida no podría existir; entre otros argumentos, las órbitas de los planetas, por ejemplo, solo son estables en 3 dimensiones, de lo contrario los planetas acabarían colapsando sobre las estrellas. (Esto no excluye las dimensiones microscópicas que postulan algunas teorías como la teoría de cuerdas).

Este maravilloso ajuste del universo es un problema bastante complejo de resolver. Por un lado, uno puede apelar a la presencia de un Ser Superior que ha favorecido la vida. Desde una perspectiva más secular, algunos apelan al multiverso, esto es, una infinidad de universos de entre los cuales la vida solo es capaz de prosperar en unos pocos. En esta línea va el pensamiento que se conoce como Principio Antrópico, que viene a decir algo así como que el universo es como es porque si fuera de otra manera no tendría observadores para preguntarse por qué es como es. Este razonamiento circular, tautológico, no gusta a casi nadie, y con razón. Algunos científicos, como David Deutsch, creen que existe una explicación, aunque nosotros no podemos ni imaginarla ahora mismo. Otros son algo más escépticos.”

La doble hélice, es una especie de cuerda de dos hilos enredados uno alrededor del otro, ambos constituidos por 4 moléculas llamadas: adenina (A), timina (T), guanina (G) y citosina (C). Sin el ajuste fino no podría ser posible.

¿Implica el ajuste fino un diseño con propósito? Hay tantos parámetros que deben tener un ajuste fino y el grado de ajuste fino es tan alto, que no parece posible ninguna otra conclusión.

Bueno, quizá en la imagen y el comentario que lleva abajo, me he podido pasar un poco. Lo que antes decía: “El hecho de que todas las partículas tengan masa que corresponden a energías mucho menores repentinamente llega a ser bastante poco natural”, es lo que se llama el “problema del ajuste fino”. Vistas a través del microscopio, las constantes de la Naturaleza parecen estar cuidadosamente ajustadas sin ninguna otra razón aparente que hacer que las partículas parezcan lo que son. Hay algo muy erróneo aquí. Desde un punto de vista matemático, no hay nada que objetar, pero la credibilidad del Modelo estándar se desploma cuando se mira a escalas de tiempo y longitud extremadamente pequeñas o, lo que es lo mismo, si calculamos lo que pasaría cuando las partículas colisionan con energías extremadamente altas.

¿Y por qué debería ser el modelo válido hasta ahí? Podrían existir muchas clases de partículas súper pesadas que no han nacido porque se necesitan energías aún inalcanzables, e ellas podrían modificar completamente el mundo que Gulliver planeaba visitar. Si deseamos evitar la necesidad de un delicado ajuste fino de las constantes de la Naturaleza, creamos un nuevo problema:

Tres tipo de Ajuste Fino para la vida

La evidencia para el ajuste fino del universo es de tres tipos:

- El ajuste fino de las leyes de la naturaleza.

- El ajuste fino de las constantes físicas.

- El ajuste fino de la distribución inicial de la masa-energía del universo en el momento del Big Bang.

El Ajuste Fino de las Leyes de la Naturaleza

Cuando hablamos sobre el ajuste fino de las leyes de la naturaleza queremos decir que el universo debe tener precisamente el conjunto adecuado de leyes con el fin de que exista vida altamente compleja.

Ejemplos:

- Existencia de la Gravedad.

- Existencia de la Fuerza Electromagnética.

- Existencia de la Fuerza Nuclear Fuerte.

- Existencia del Principio de Cuantificación.

- Existencia del Principio de Exclusión de Pauli.

El Ajuste Fino de las constantes físicas

Por las constantes físicas, nos referimos a los números fundamentales que se producen en las leyes de la física, los cuales muchos de éstos deben estar ajustados con precisión en un grado extraordinario para que la vida se produzca.

Por ejemplo, tomemos la Constante Gravitacional —designado por G— la cual determina la fuerza de la gravedad a través de la Ley de la Gravedad de Newton:

Donde F es la fuerza entre dos masas, m1 y m2, que están a una distancia r de diferencia. Si aumentas o disminuyes G entonces la fuerza de la gravedad correspondientemente aumentará o disminuirá. (El valor real de G es 6,67 x 10-11 Nm2 / kg2.)

Ahora, para darnos una idea de qué tan finamente ajustada es la fuerza de la gravedad indicada por G debemos primero mirar el rango de las fuerzas fundamentales en la naturaleza:

Observa que la Fuerza Nuclear Fuerte es de 10 000 sextillones[1] de veces la Fuerza de la Gravedad. ¿Demasiado complicado? Bien, hagamos esto más digerible. Imagina que tienes una regla lo suficientemente grande para extenderla a través de todo el universo, ahora colocaremos los puntos en donde se localizarían la Fuerza de Gravedad y la Fuerza Nuclear Fuerte. Tendríamos algo así:

Retomemos el hilo que veo pasar una mosca y la sigo, la sigo, la sigo hasta no saber donde estoy.

¿Cómo podemos modificar el Modelo Estándar de tal manera que el ajuste-fino no sea necesario? Está claro que las modificaciones son necesarias , lo que implica que muy probablemente hay un límite más allá del cual el modelo deja de ser válido. El Modelo Estándar no será más que una aproximación matemática que hemos sido capaces de crear, tal que todos los fenómenos observados hasta el presente están de acuerdo con él, pero cada vez que ponemos en marcha un aparato más poderoso, debemos esperar que sean necesarias nuevas modificaciones para ir ajustando el modelo, a la realidad que descubrimos.

El hallazgo de una partícula que crearía nueva Física

¿Cómo hemos podido pensar de otra manera? ¿Cómo hemos tenido la “arrogancia” de pensar que podemos tener la teoría “definitiva”? Mirando las cosas de esta manera, nuestro problema ahora puede muy bien ser el opuesto al que plantea la pregunta de dónde acaba el modelo estándar: ¿Cómo puede ser que el modelo estándar funcione tan extraordinariamente bien? y ¿por qué aún no hemos sido capaces de percibir nada parecido a otra generación de partículas y fuerzas que no encajen en el modelo estándar?

Asistentes escuchan la presentación de los resultados del experimento ATLAS, durante el seminario del Centro Europeo de Física de Partículas (CERN) para presentar los resultados de los dos experimentos paralelos que buscan la prueba de la existencia de la “partícula de Higgs”, base del modelo estándar de física, hoy miércoles 4 de julio en Meyrin, Suiza.

La pregunta “¿Qué hay más allá del Modelo estándar”? ha estado fascinando a los físicos durante años. Y, desde luego, todos sueñan con llegar a saber, qué es lo que realmente es lo que conforma el “mundo” de la materia, qué partículas, cuerdas o briznas vibrantes. En realidad, lo cierto es que, la Física que conocemos no tiene que ser, necesariamente, la verdadera física que conforma el mundo y, sí, la física que conforma “nuestro mundo”, es decir, el mundo al que hemos podido tener acceso hasta el momento y que, no necesariamente tiene que tratarse del mundo real.

O, como decía aquél: ¡Que mundo más hermoso, parece de verdad!

No todo lo que vemos es, necesariamente, un reflejo de la realidad de la Naturaleza que, puede tener escondidos más allá de nuestras percepciones, otros escenarios y otros objetos, a los que, por ahora, no hemos podido acceder, toda vez que, físicamente tenemos carencias, intelectualmente también, y, nuestros conocimientos avanzar despacio para conseguir, nuevas máquinas y tecnologías nuevas que nos posibiliten “ver” lo que ahora nos está “prohibido” y, para ello, como ocurre siempre, necesitamos energías de las que no disponemos.

Hay dos direcciones a lo largo de las cuales se podría extender el Modelo estándar, tal como lo conocemos actualmente, que básicamente se caracterizan así:

– Nuevas partículas raras y nuevas fuerzas extremadamente débiles, y

– nuevas partículas pesadas y nuevas estructuras a muy altas energías.

Podrían existir partículas muy difíciles de producir y de detectar y que, por esa razón, hayan pasado desapercibidas hasta ahora. La primera partícula adicional en la que podríamos pensares un neutrino rotando a derecha. Recordaremos que si se toma el eje de rotación paralelo a la dirección del movimiento los neutrinos sólo rotan a izquierdas pero, esa sería otra historia.

En un artículo editado en Ciencia Kanija, pude leer:

“Los interferómetros atómicos tienen ahora la sensibilidad para observar nuevas fuerzas más allá del modelo estándar de la física de partículas. “Las nuevas fuerzas a corta distancia son una predicción frecuente de las teorías más allá del Modelo Estándar y la búsqueda de estas nuevas fuerzas es un canal prometedor para descubrir una nueva física”, dice Jay Wackerdel Laboratorio del Acelerador Nacional SLAC en California. La pregunta es cómo encontrarlas”

Los neutrinos siempre me han fascinado. Siempre se han manifestado como si tuvieran masa estrictamente nula. Parece como si se movieran exactamente con la velocidad de la luz. Pero hay un límite para la precisión de nuestras medidas. Si los neutrinos fueran muy ligeros, por ejemplo, una cienmillonésima parte de la masa del electrón, seríamos incapaces de detectar en el laboratorio la diferencia entre éstos y los neutrinos de masa estrictamente nula. Pero, para ello, el neutrino tendría que tener una componente de derechas.

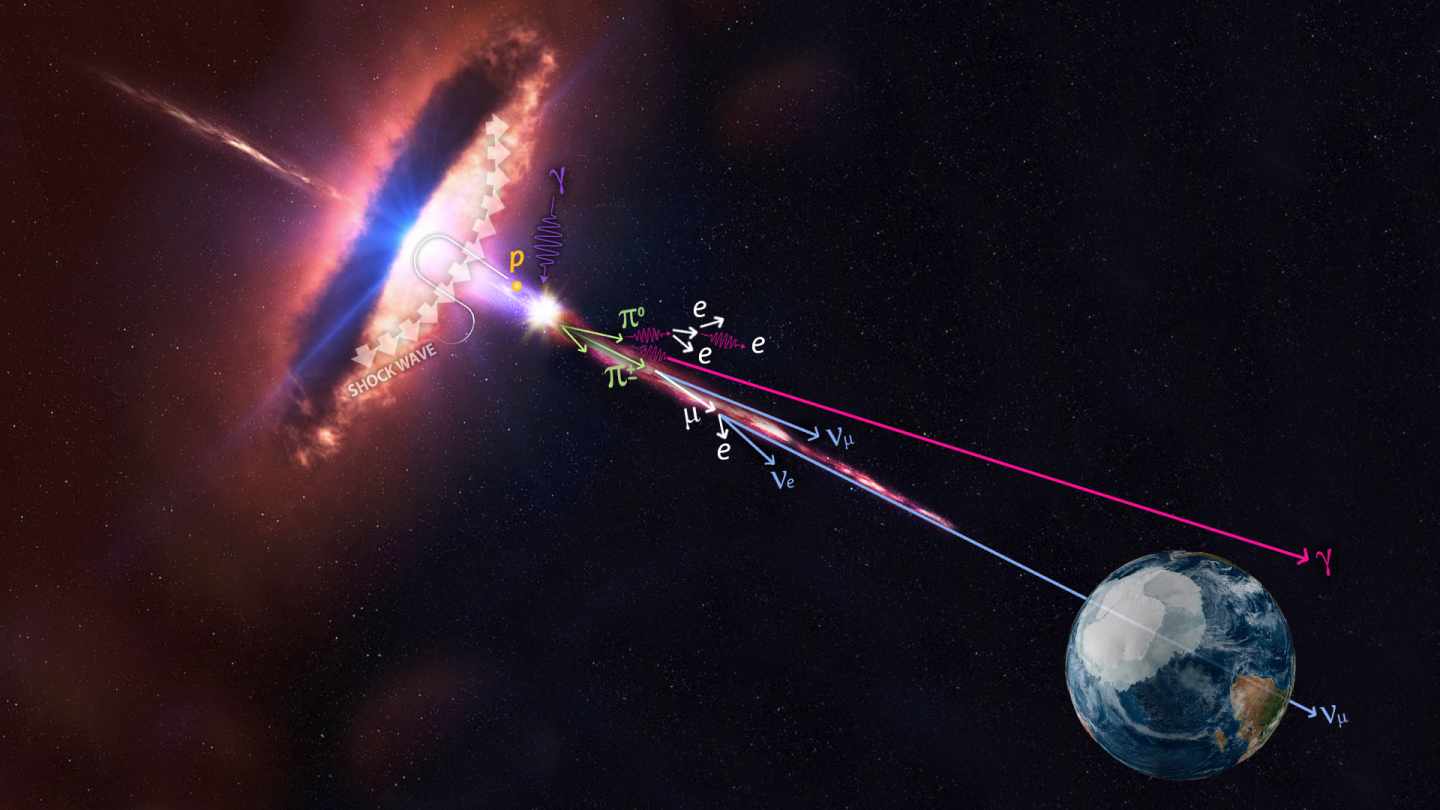

En este punto, los astrónomos se unen a la discusión. No es la primera vez, ni será la última, que la astronomía nos proporciona información esencial en relación a las partículas elementales. Por ejemplo, debido a las interacciones de corriente neutra (las interacciones débiles originadas por un intercambio Zº), los neutrinos son un facto crucial en la explosión supernova de una estrella. Ahora sabemos que debido a las interacciones por corriente neutra, pueden colisionar con las capas exteriores de la estrella y volarlas con una fuerza tremenda.

En realidad, los neutrinos nos tienen mucho que decir, todavía y, no lo sabemos todo acerca de ellos, sino que, al contrario, son muchos los datos y fenómenos que están y subyacen en ellos de los que no tenemos ni la menor idea que existan o se puedan producir. Nuestra ignorancia es grande, y, sin embargo, no nos arredra hablar y hablar de cuestiones que, la mayoría de las veces…ni comprendemos.

Aquí lo dejaré por hoy, el tema es largo y de una fascinación que te puede llevar a lugares en los que no habías pensado al comenzar a escribir, lugares maravillosos donde reinan objetos exóticos y de fascinante porte que, por su pequeñez, pueden vivir en “mundos” muy diferentes al nuestro en los que, ocurren cosas que, nos llevan hacia el asombro y también, a ese mundo mágico de lo fascinante y maravilloso.

¡Cuanta complejidad para que nuestra limitada capacidad intelectual la pueda desmenuzar! Pero, se hace lo que se puede.

Emilio Silvera Vázquez

Feb

28

Desde la materia “inerte”… ¡Hasta los pensamientos!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (2)

Comments (2)

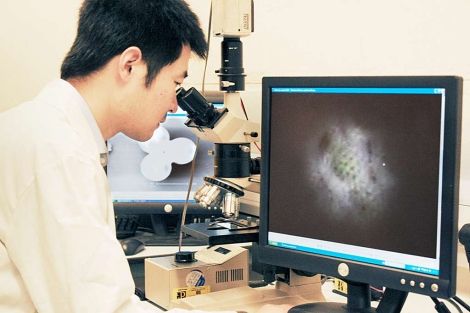

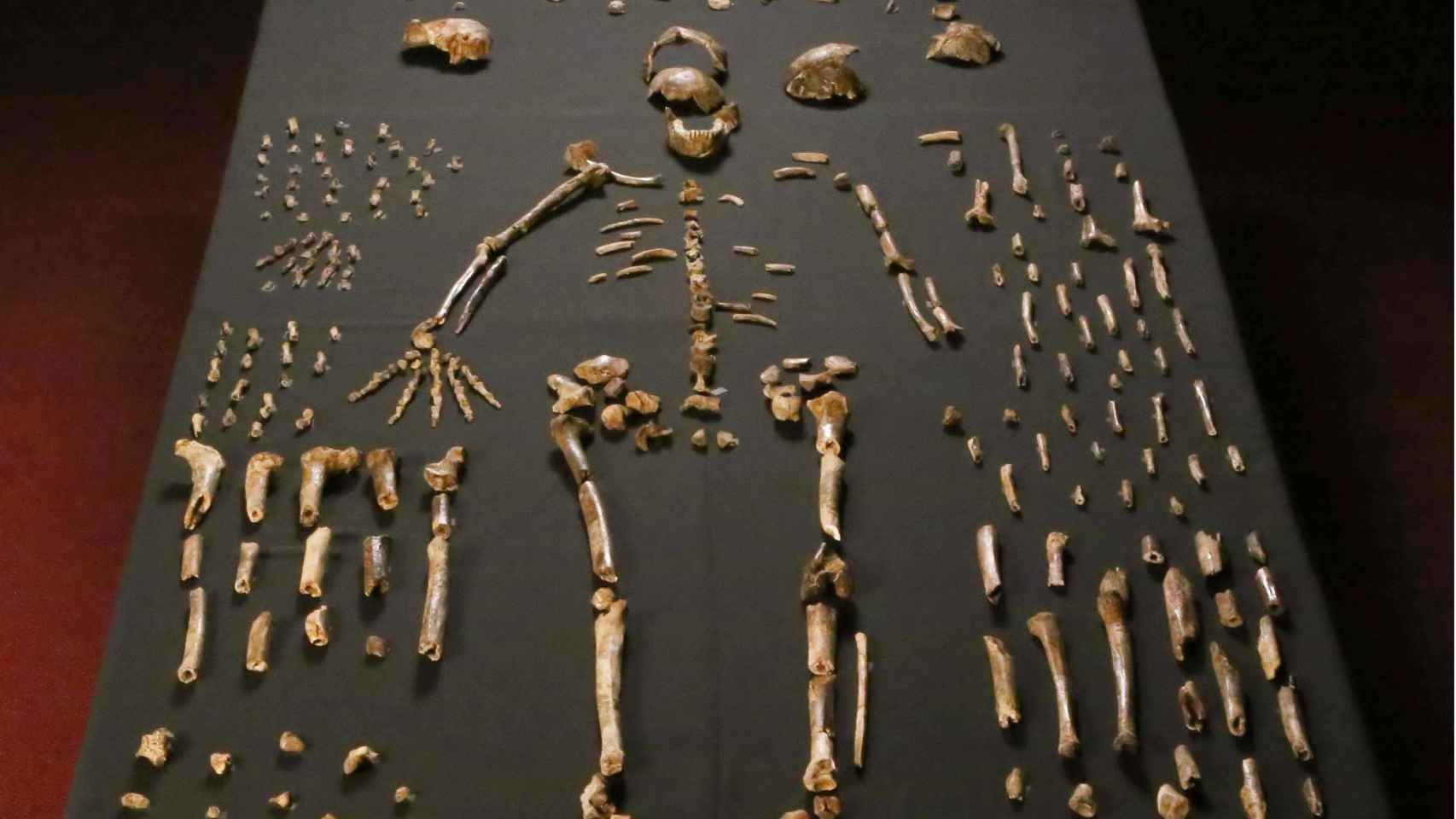

Agua, luz y calor, sustancia cósmica… ¡El surgir de la vida!

Pero no está muerto lo que duerme eternamente

¿Cómo es posible que, a partir de la materia “inerte”, hayan podido surgir seres vivos e incluso, algunos que, como nosotros, puedan pensar? Que cosa mágica se pudo producir en el corazón de las estrellas para que, materiales sencillos como el Hidrógeno se convirtieran a miles de millones de grados de calor en otros que, como el Carbono, Oxigeno y Nitrógeno, muchos miles de Millones de años más tardes, en mundos perdidos en sistemas planetarios como el nuestro, dieran lugar a la formación de Protoplasma vivo del que surgieron aquellos infinitesimales seres que llamamos bacterias y que, posibilitaron la evolución hacia formas de vida superiores?

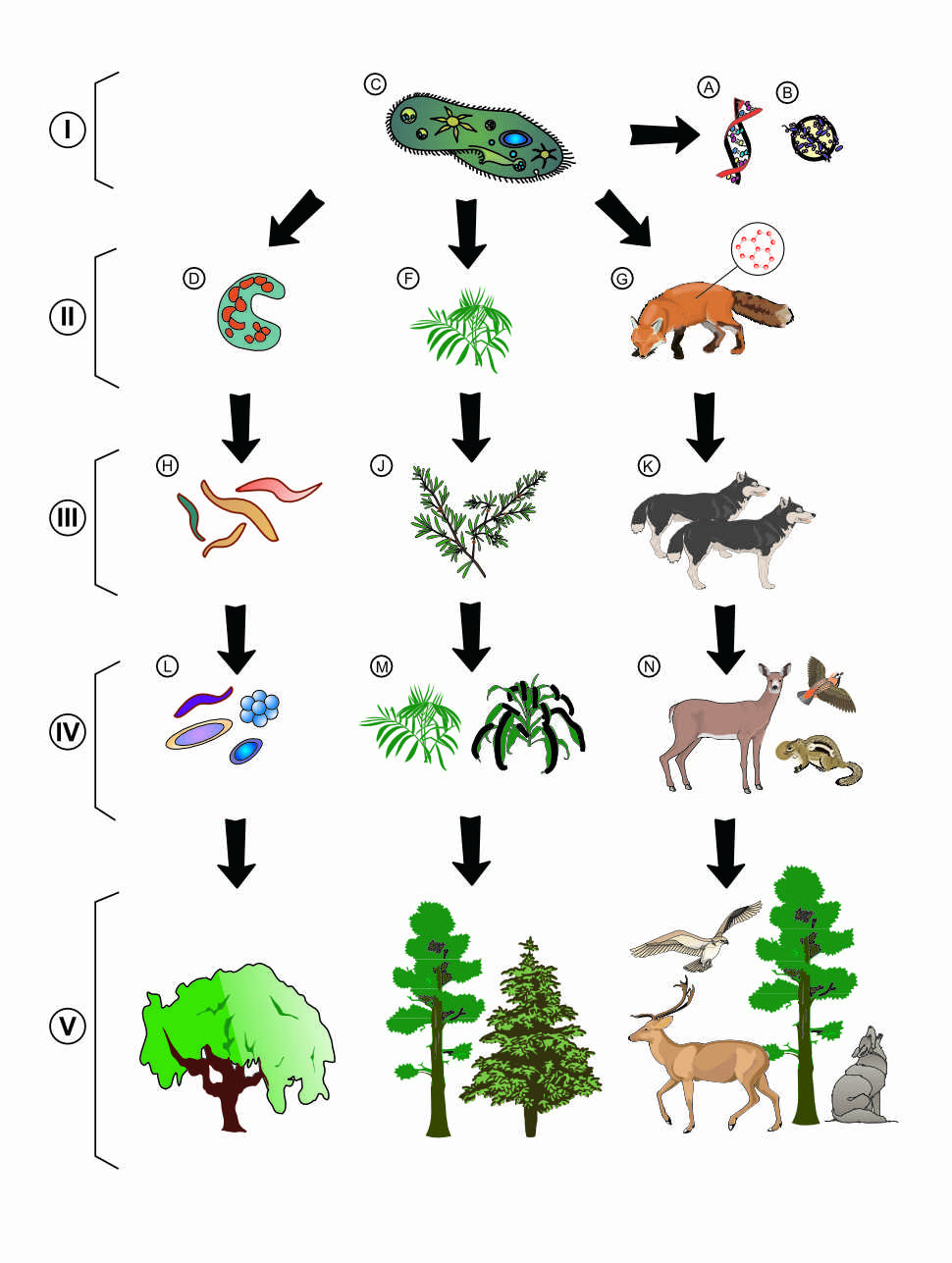

“La generación de una nueva especie a partir de una especie anterior es un proceso que necesita centenares de miles de años de evolución. Desde una perspectiva evolutiva se piensa que la biodiversidad es la respuesta de los seres vivos, mediante la evolución adaptativa de las especies, a la multitud de ambientes que han ido apareciendo a lo largo de la historia de la vida en la Tierra. Cada especie tiene una serie de características, muchas veces únicas, que los humanos, en ocasiones, hemos sabido aprovechar para nuestra alimentación o para curar nuestras enfermedades. Por todo ello vale la pena mantener amplios espacios naturales dónde puedan continuar viviendo todas las especies.”

Los sentidos: las herramientas que utiliza el cerebro para estar comunicado con el exterior

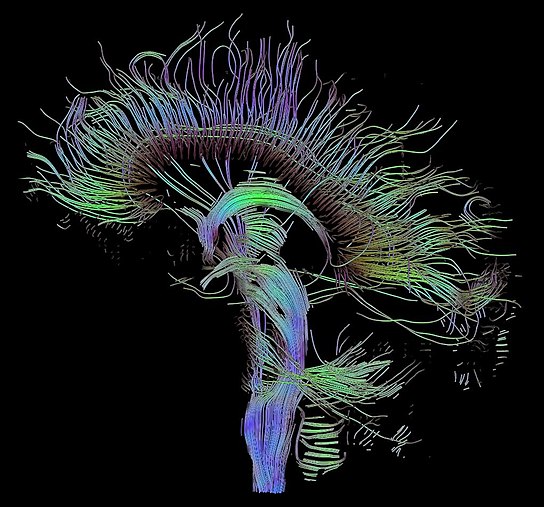

La percepción, los sentidos y los pensamientos… Para poder entender la conciencia como proceso es preciso que entendamos cómo funciona nuestro cerebro, su arquitectura y desarrollo con sus funciones dinámicas. Lo que no está claro es que la conciencia se encuentre causalmente asociada a ciertos procesos cerebrales pero no a otros.

:format(jpg)/f.elconfidencial.com%2Foriginal%2F1a4%2Faae%2F9f5%2F1a4aae9f54865c4bd6fbdb7a34be1c43.jpg)

El cerebro humano ¿es especial?, su conectividad, su dinámica, su forma de funcionamiento, su relación con el cuerpo y con el mundo exterior, no se parece a nada que la ciencia conozca. Tiene un carácter único y ofrecer una imagen fidedigna del cerebro no resulta nada fácil; es un reto tan extraordinario que no estamos preparados para cumplir en este momento. Estamos lejos de ofrecer esa imagen completa, y sólo podemos dar resultados parciales de esta enorme maravilla de la Naturaleza.

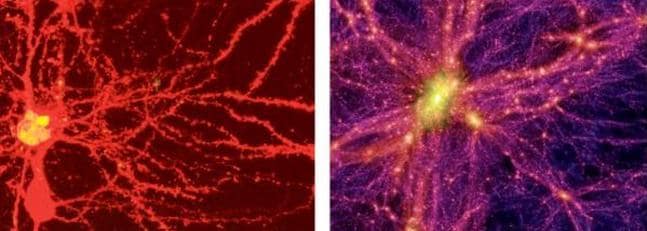

Nuestro cerebro adulto, con poco más de 1.300 gr de peso, contiene unos ochenta y seis mil mil millones de células nerviosas o neuronas. La parte o capa ondulada más exterior o corteza cerebral, que es la parte del cerebro de evolución más reciente, contiene alrededor de treinta millones de neuronas y un billón de conexiones o sinapsis. Si contáramos una sinapsis cada segundo, tardaríamos 32 millones de años en acabar el recuento. Si consideramos el número posible de circuitos neuronales, tendremos que habérnoslas con cifras hiper-astronómicas. Un 10 seguido de, al menos, un millón de ceros (en comparación, el número de partículas del universo conocido asciende a “tan sólo” un 10 seguido de 79 ceros). ¡A que va a resultar que no somos tan insignificantes!

El suministro de datos que llega en forma de multitud de mensajes procede de los sentidos, que detectan el entorno interno y externo, y luego envía el resultado a los músculos para dirigir lo que hacemos y decimos. Así pues, el cerebro es como un enorme ordenador que realiza una serie de tareas basadas en la información que le llega de los sentidos. Pero, a diferencia de un ordenador, la cantidad de material que entra y sale parece poca cosa en comparación con la actividad interna. Seguimos pensando, sintiendo y procesando información incluso cuando cerramos los ojos y descansamos.

Con tan enorme cantidad de circuitos neuronales, ¿Cómo no vamos a ser capaces de descifrar todos los secretos de nuestro universo? ¿De qué seremos capaces cuando podamos disponer de un rendimiento cerebral del 80 ó 90 por ciento? Algunas veces hemos oido comentar: “Sólo utilizamos un diez por ciento del cerebro…” En realidad, la frase no indica la realidad, se refiere al hecho de que, aunque utilizamos el cerebro en su totalidad, se estima que está al diez por ciento de su capacidad real que, será una realidad a medida que evolucione y, en el futuro, esa capacidad de hoy será un 90 por ciento mayor.

Aún no conocemos bien la direccionalidad de los circuitos neuronales

El límite de lo que podremos conseguir tiene un horizonte muy lejano. Y, llega un momento en el cual, se puede llegar a pensar que no existen limites en lo que podemos conseguir: Desde hablar sin palabras sonoras a la auto-transportación. Si -como pienso- somos pura energía pensante, no habrá límite alguno; el cuerpo que ahora nos lleva de un lugar a otro, ya no será necesario, y como los fotones que no tienen masa, podremos desplazarnos a velocidades lumínicas.

Creo que estoy corriendo demasiado en el tiempo, volvamos a la realidad. A veces mi mente se dispara. Lo mismo visito mundos extraordinarios con mares luminosos de neón líquido poblados por seres transparentes, que viajo a galaxias muy lejanas pobladas de estrellas de fusión fría circundadas por nubes doradas compuestas de antimateria en la que, los positrones medio congelados, se mueven lentamente formando un calidoscopio de figuras alucinantes de mil colores. ¡La mente, qué tesoro!

¿Quién podría decir, si no se les explicara, que son “universos diferentes”

La unidad a partir de la cual se configuran todas las fabulosas actividades del cerebro es una célula del mismo, la neurona. Las neuronas son unas células fantásticamente ramificadas y extendidas, pero diminutas que, sin embargo y en sentido figurado, podríamos decir que son tan grandes como el universo mismo.

Cuando seamos capaces de convertir en realidad todo aquello en lo que podamos pensar, entonces, habremos alcanzado la meta. Para que eso pueda llegar a ocurrir, aún falta mucho tiempo. Sin embargo, si el Universo no lo impide y nuestro transcurrir continúa, todo lo que podamos imaginar… podrá ser posible. Incluso imposibilidades físicas de hoy, dejarán de existir mañana y, ¡la Mente! posiblemente (al igual que hoy ordena a las distintas partes del cuerpo que realice esta o aquella función), se encargará de que todo funcione bien, erradicará cualquier enfermedad que nos pueda atacar y, tendrá el conjunto del “sistema” en perfectas condiciones de salud, lo cual me lleva a pensar que, para cuando eso llegue, los médicos serán un recuerdo del pasado.

Es curioso y sorprendente la evolución alcanzada por la Mente Humana. El mundo físico se representa gobernado de acuerdo a leyes matemáticas. Desde este punto de vista, todo lo que hay en el universo físico está realmente gobernado en todos sus detalles por principios matemáticos, quizá por ecuaciones tales que aún no hemos podido llegar a comprender y, ni que sabemos que puedan existir.

Lo más seguro es que la descripción real del mundo físico esté pendiente de matemáticas futuras, aún por descubrir, fundamentalmente distintas de las que ahora tenemos. Llegarán nuevos Gauss, Riemann, Euler, o, Ramanujans… que, con sus nuevas ideas transformarán el pensamiento matemático para hacer posible que podamos, al fin, comprender lo que realmente somos.

Son nuestras Mentes, productos de la evolución del Universo que, a partir de la materia inerte, ha podido alcanzar el estadio bio-químico de la consciencia y, al ser conscientes, hemos podido descubrir que existen “números misteriosos” dentro de los cuales subyacen mensajes que tenemos que desvelar.

Antes tendremos que haber descifrado las funciones modulares de los cuadernos perdidos de Ramanujan, o por ejemplo, el verdadero significado del número 137, ése número puro adimensional que encierra los misterios del electrón (e) – electromagnetismo -, de la constante de Planck (h) – el cuando te acción – y de la luz (c) – la relatividad -.

Las primeras proto-estrellas, grandes grumos e gas y polvo

Los resultados son lentos, no se avanza con la rapidez que todos deseamos. Sin embargo, eso ocurre por algo, el ritmo del Universo considerado como Naturaleza, podríamos decir que es “sabio” y, si actúa de esa manera…Por algo será. Deja que de vez en cuando, sobresalgan algunas mentes y se eleven por encima del común, de ejemplos tenemnos la historia llena. Esos “saltos” de la conciencia son los tiempos que marca el Universo para que, poco a poco, se produzca nuestra evolución, es la única forma de que todo se haga de manera correcta y de que, los nuevos pensamientos se vayan asentando debidamente en las Mentes futuras. Pongamos un ejemplo: Poincaré expuso su conjetura y, más de un siglo después, Perelman la resolvió. Riemann expuso su geometría del espacio curvo, y hasta 60 años más tarde no fue descubierta por Einstein para hacer posible su formulación de la relatividad general, donde describe cómo las grandes masas distorsionan el espacio y el tiempo por medio de la fuerza de gravedad que generan. El conocimiento humano avanza al ritmo que le impone la Naturaleza.

![[dark-matter-625x450.jpg]](http://3.bp.blogspot.com/_gLo7v9af5Sg/SWXgCyeo8cI/AAAAAAAABTE/p3tYMUr7GAc/s1600/dark-matter-625x450.jpg)

¡Son tantos los secretos que nos quedan por desvelar! la Naturaleza es la portadora de todas las respuestas…Observémosla con atención y, aprendamos de ella y, de ser posible, procuremos no molestarla, “Ella” nos permite estar aquí para que evolucionemos y, algún día, cuando seamos mayores…quizás nos deje formar parte de algo más…¿mental?

Visto así…. ¡No parece que seamos gran cosa!

No, no será nada fácil imitar a la Naturaleza…¡Esa perfección! Sin embargo, llegados a ese punto, debemos pensar que nosotros también formamos parte de ella, la parte que piensa y, si es así, ¿Qué cometido tendremos asignado en este Universo? Esa es la pregunta que ninguno de los grandes pensadores de la Historia, han podido contestar.

Pensar, por ejemplo, en las complejas matemáticas topológicas requeridas por la teoría de supercuerdas puede producir incomodidad en muchas personas que, aún siendo físicos, no están tan capacitados como para entender tan profundas ideas (me incluyo).

Bernhard Riemann introdujo muchas nuevas ideas y fue uno de los más grandes matemáticos. En su corta vida (1.826 – 1.866) propuso innumerables propuestas matemáticas que cambiaron profundamente el curso del pensamiento de los números en el planeta Tierra, como el que subyace en la teoría relativista en su versión general de la gravedad, entre otras muchas (superficie de Riemann, etc.). Riemann les enseñó a todos a considerar las cosas de un modo diferente.

La geometría de las espacios curvos. Superficie de Riemann que aparece al extender el dominio de la función

.

La superficie de Riemann asociada a la función holomorfa “tiene su propia opinión” y decide por sí misma cuál debería ser el, o mejor, su dominio, con independencia de la región del plano complejo que nosotros podamos haberle asignado inicialmente.

Podríamos encontrar otros muchos tipos de superficies de Riemann.

Este bello concepto desempeña un papel importante en algunos de los intentos modernos de encontrar una nueva base para la física matemática (muy especialmente en la teoría de cuerdas), y al final, seguramente se descubrirá el mensaje que encierra.

El caso de las superficies de Riemann es fascinante, aunque desgraciadamente sólo es para iniciados. Proporcionaron los primeros ejemplos de la noción general de variedad, que es un espacio que puede pensarse “curvado” de diversas maneras, pero que localmente (por ejemplo, en un entorno pequeño de cualquiera de sus puntos), parece un fragmento de espacio euclídeo ordinario.

En matemática, la esfera de Riemann (o plano complejo extendido), llamado en honor al matemático del siglo XIX del mismo nombre, es una esfera obtenida del plano complejo mediante la adición de un punto del infinito. La esfera es la representación geométrica de los números complejos extendidos  , (véase fig.1 y fig.2), la cual consiste en los números complejos ordinarios en conjunción con el símbolo

, (véase fig.1 y fig.2), la cual consiste en los números complejos ordinarios en conjunción con el símbolo  para representar el infinito.

para representar el infinito.

La esfera de Riemann, superficie de Riemann compacta, el teorema de la aplicación de Riemann, las superficies de Riemann y aplicaciones complejas… He tratado de exponer en unas líneas la enorme importancia de este personaje para las matemáticas en general y la geometría y para la física en particular. Es uno de esos casos a los que antes me refería. Después de él, la Humanidad ha tenido un parón en el desarrollo de las ideas hasta que asimilaron las suyas y, después, llegó Einstein y otros que supieron aplicarlas. Einstein, sin el Tensor métrico de Riemann, nunc habría podido finalizar su Teoría de la Relatividad General.

La Geometría de Riemann de los espacios curvos que Einstein aprovechó

Tenemos que convenir que todo, sin excepción, es relativo y resulta ya evidente la gran crisis de la noción de realidad “veritas” que el mundo padece, la ciencia BASE, la matemática, sufrió el varapalo a partir de la matemática topológica de Poincaré, y el desarrollo sorpresivo de la matemática del caos; de pronto el idealismo de la ecuación diferencial queda derribado : el mundo que funciona como un reloj de Tolomeo queda finiquitado; ¿donde puñetas está la materia perdida?; de pronto nuestras consciencias “comprenden” que la “verdad” no existe, es decir, que no existe nuestra realidad del mundo.

Y, mientras tanto, nuestras mentes siguen su camino, siempre queriendo ir más allá y siempre profundizando en los secretos de la Naturaleza de lo que tenemos muchos ejemplos, tales como nuestras consideraciones sobre los dos aspectos de la relatividad general de Einstein, a saber, el principio de la relatividad, que nos dice que las leyes de la física son ciegas a la distinción entre reposo y movimiento uniforme; y el principio de equivalencia, que nos dice de qué forma sutil deben modificarse estas ideas para englobar el campo gravitatorio.

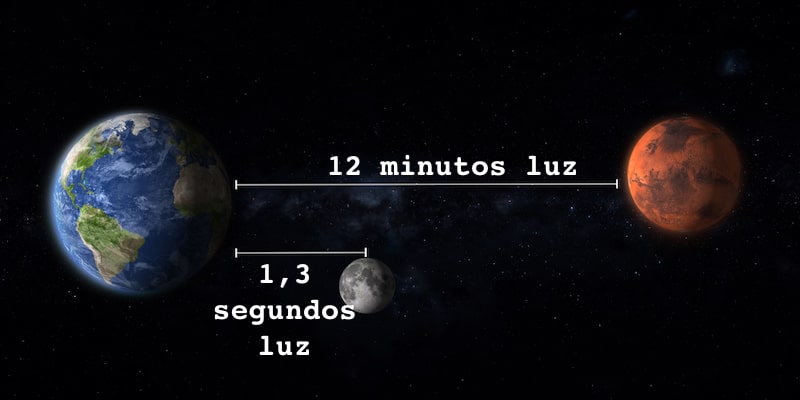

Todo es finito, es decir, que tiene un fin, y la velocidad de la luz no podía ser una excepción

Ahora hay que hablar del tercer ingrediente fundamental de la teoría de Einstein, que está relacionada con la finitud de la velocidad de la luz. Es un hecho notable que estos tres ingredientes básicos puedan remontarse a Galileo; en efecto, parece que fue también Galileo el primero que tuvo una expectativa clara de que la luz debería viajar con velocidad finita, hasta el punto de que intentó medir dicha velocidad. El método que propuso (1.638), que implica la sincronización de destellos de linternas entre colinas distantes, era, como sabemos hoy, demasiado tosco (otro ejemplo de la evolución que, con el tiempo, se produce en nuestras mentes). Él no tenía forma alguna de anticipar la extraordinaria velocidad de la luz.

Parece que tanto Galileo como Newton tenían poderosas sospechas respecto a un profundo papel que conecta la naturaleza de la luz con las fuerzas que mantienen la materia unida y, si consideramos que esa fuerza que hace posible la unión de la materia reside en el corazón de los átomos (en sus núcleos), podemos hacernos una clara idea de lo ilimitado que puede ser el pensamiento humano que, ya en aquellos tiempos -en realidad mucho anters- pudo llegar a intuir las fuerzas que están presentes en nuestro Universo.

Los Quarks están confinados dentro de los nucleones (protones y neutrones)

En los núcleos atómicos reside la fuerza (nuclear fuerte) que hace posible la existencia de la materia que comienza por los átomos que, al juntarse y formar células, hace posible que éstas se junten y formen moléculas que a su vez, se reunen para formar sustancias y cuerpos.

Pero la comprensión adecuada de estas ideas tuvo que esperar hasta el siglo XX, cuando se reveló la verdadera naturaleza de las fuerzas químicas y de las fuerzas que mantienen unidos los átomos individuales. Ahora sabemos que tales fuerzas tienen un origen fundamentalmente electromagnético (que vincula y concierne a la implicación del campo electromagnético con partículas cargadas) y que la teoría del electromagnetismo es también la teoría de la luz.

Para entender los átomos y la química se necesitan otros ingredientes procedentes de la teoría cuántica, pero las ecuaciones básicas que describen el electromagnetismo y la luz fueron propuestas en 1.865 por el físico escocés James Clark Maxwell, que había sido inspirado por los magníficos descubrimientos experimentales de Michael Faraday unos treinta años antes y que él plasmó en una maravillosa teoría.

El escudo magnético de la tierra nos defiende de los campos magnéticos del Sol

El electromagnetismo es una rama de la Física que estudia y unifica los fenómenos eléctricos y magnéticos en una sola teoría. El electromagnetismo es una teoría de campos; es decir, las explicaciones y predicciones que provee se basan en magnitudes físicas vectoriales dependientes de la posición en el espacio y del tiempo.

Esta teoría del electromagnetismo de Maxwell tenía la particularidad de que requería que la velocidad de la luz tuviera un valor fijo y definido, que normalmente se conoce como c, y que en unidades ordinarias es aproximadamente 3 × 108 metros por segundo. Maxwell, guiado por los experimentos de Faraday, hizo posible un hecho que cambió la historia de la humanidad para siempre. Un hecho de la misma importancia que el descubrimiento del fuego, la rueda o los metales. El matemático y poeta escocés unificó los campos eléctrico y magnético a través de unas pocas ecuaciones que describen como estos campos se entretejen y actúan sobre la materia.

Claro que, estos importantísimos avances han sido simples escalones de la “infinita” escalera que tenemos que subir y, la misma relatividad de Einstein no ha sido (después de un siglo) aún comprendido en su plenitud y muchos de sus mensajes están escondidos en lo más profundo de nuestras mentes que, ha sabido parcialmente descubrir el mensaje de Einstein pero, seguimos buscando.

Sin embargo, esto nos presenta un enigma si queremos conservar el principio de relatividad. El sentido común nos diría que si se mide que la velocidad de la luz toma el valor concreto c en el sistema de referencia del observador, entonces un segundo observador que se mueva a una velocidad muy alta con respecto al primero medirá que la luz viaja a una velocidad diferente, aumentada o disminuida, según sea el movimiento del segundo observador.

Estaría bueno que, al final se descubriera que alfa (α) tuviera un papel importante en la compleja teoría de cuerdas, ¿Por qué no? En realidad alfa, la constante de estructura fina, nos habla del magnetismo, de la constante de Planck y de la relatividad especial, es decir, la velocidad de la luz y, todo eso, según parece, emergen en las ecuaciones topológicas de la moderna teoría de cuerdas. ¡Ya veremos!

Pero el principio de relatividad exigiría que las leyes físicas del segundo observador (que definen en particular la velocidad de la luz que percibe el segundo observador) deberían ser idénticas a las del primer observador. Esta aparente contradicción entre la constancia de la velocidad de la luz y el principio de relatividad condujo a Einstein (como de hecho, había llevado previamente al físico holandés Hendrick Antón Lorentz y muy en especial al matemático francés Henri Poincaré) a un punto de vista notable por el que el principio de relatividad del movimiento puede hacerse compatible con la constancia de una velocidad finita de la luz.

¿Cómo funciona esto? Sería normal que cualquier persona creyera en la existencia de un conflicto irresoluble entre los requisitos de una teoría como la de Maxwell, en la que existe una velocidad absoluta de la luz, y un principio de relatividad según el cual las leyes físicas parecen las mismas con independencia de la velocidad del sistema de referencia utilizado para su descripción.

¿No podría hacerse que el sistema de referencia se moviera con una velocidad que se acercara o incluso superara a la de la luz? Y según este sistema, ¿no es cierto que la velocidad aparente de la luz no podría seguir siendo la misma que era antes? Esta indudable paradoja no aparece en una teoría, tal como la originalmente preferida por Newton (y parece que también por Galileo), en la que la luz se comporta como partículas cuya velocidad depende de la velocidad de la fuente. En consecuencia, Galileo y Newton podían seguir viviendo cómodamente con un principio de relatividad.

La velocidad de la luz en el vacío es una constante de la Naturaleza y, cuando cientos de miles de millones de millones salen disparados de esta galaxia hacia el vacío espacial, su velocidad de 299.792.450 metros por segundo, es constante independientemente de la fuente que pueda emitir los fotones y de si ésta está en reposo o en movimiento.

Así que, la antigua imagen de la naturaleza de la luz entró en conflicto a lo largo de los años, como era el caso de observaciones de estrellas dobles lejanas que mostraban que la velocidad de la luz era independiente de la de su fuente. Por el contrario, la teoría de Maxwell había ganado fuerza, no sólo por el poderoso apoyo que obtuvo de la observación (muy especialmente en los experimentos de Heinrich Hertz en 1.888), sino también por la naturaleza convincente y unificadora de la propia teoría, por la que las leyes que gobiernan los campos eléctricos, los campos magnéticos y la luz están todos subsumidos en un esquema matemático de notable elegancia y simplicidad.

Las ondas luminosas como las sonoras, actúan de una u otra manera dependiendo del medio en el que se propagan.

En la teoría de Maxwell, la luz toma forma de ondas, no de partículas, y debemos enfrentarnos al hecho de que en esta teoría hay realmente una velocidad fija a la que deben viajar las ondas luminosas.

El punto de vista geométrico-espaciotemporal nos proporciona una ruta particularmente clara hacia la solución de la paradoja que presenta el conflicto entre la teoría de Maxwell y el principio de relatividad.

Este punto de vista espaciotemporal no fue el que Einstein adoptó originalmente (ni fue el punto de vista de Lorentz, ni siquiera, al parecer, de Poincaré), pero, mirando en retrospectiva, podemos ver la potencia de este enfoque. Por el momento, ignoremos la gravedad y las sutilezas y complicaciones asociadas que proporciona el principio de equivalencia y otras complejas cuestiones, que estimo aburrirían al lector no especialista, hablando de que en el espacio-tiempo se pueden concebir grupos de todos los diferentes rayos de luz que pasan a ser familias de íneas de universo.

La maravilla de los cuantos llamados fotones

Baste saber que, como quedó demostrado por Einstein, la luz, independientemente de su fuente y de la velocidad con que ésta se pueda mover, tendrá siempre la misma velocidad en el vacío, c, o 299.792.458 metros por segundo. Cuando la luz atraviesa un medio material, su velocidad se reduce. Precisamente, es la velocidad c el límite alcanzable de la velocidad más alta del universo. Es una constante universal y, como hemos dicho, es independiente de la velocidad del observador y de la fuente emisora.

El Universo está dentro de nuestras Mentes

¡La Mente! Qué caminos puede recorrer y, sobre todo ¿Quién la guía? Comencé este trabajo con la imagen del ojo humano y hablando de los sentidos y de la consciencia y mira donde he finalizado…Sí, nos falta mucho camino por recorrer para llegar a desvelar los misterios de la Mente que, en realidad, es la muestra más alta que el Universo nos puede mostrar de lo que puede surgir a partir de la sencillez de los átomos de hidrógeno que, evolucionados, primero en las entrañas de las estrellas y después en los circuitos de nuestras mentes, llega hasta los pensamientos y la imaginación que…son palabras mayores de cuyo alcance, aún no tenemos una idea que realmente refleje su realidad.

Todo en nuestro universo ambia, comienza siendo una cosa y finaliza siendo otra

Pero, ¿existe alguna realidad?, o, por el contrario todo es siempre cambiante y lo que hoy es mañana no existirá, si “realmente” es así, ocurre igual que con el tiempo. La evolución es algo que camina siempre hacia adelante, es inexorable, nunca se para y, aunque como el tiempo pueda ralentizarse, finalmente sigue su camino hacia esos lugares que ahora, sólo podemos imaginar y que, seguramente, nuestros pensamientos no puedan (por falta de conocimientos) plasmar en lo que será esa realidad futura.

Emilio Silvera Vázquez

Feb

27

En nuestro Universo: ¡La Eternidad no existe

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (3)

Comments (3)

Resulta imposible frenar el cáncer y a la vez impedir la acumulación de células defectuosas – FOTOLIA

Una fórmula matemática desmonta la idea de que se puede detener el envejecimiento.

Se puede ralentizar, pero no hay ninguna vía de escape para evitarlo: es una característica propia de los organismos multicelulares

Investigadores de la Universidad de Arizona han probado que es matemáticamente imposible detener el envejecimiento en organismos multicelulares, entre los que están las plantas y los animales. De hecho, han concluido que la senescencia es una característica propia de los seres vivos complejos.

«El envejecimiento es matemáticamente y totalmente inevitable. No hay ninguna vía de escape lógica, teórica ni matemática», ha dicho en un comunicado Joanna Masel, profesora de ecología y biología evolutiva en la Universidad de Arizona y coautora de la investigación.

En un artículo publicado en la revista Proceedings of the National Academy of Sciences, Masel y su colaborador Paul Nelson han aplicado un modelo matemático para simular la evolución de las células de un organismo y han encontrado pruebas de por qué el envejecimiento es «una verdad incontrovertible» y «una propiedad intrínseca de ser multicelular».

Para ello, han simulado el proceso de selección natural, a través del cual los individuos que son más aptos sobreviven con mayor frecuencia que los menos aptos. La idea que trataron de poner a prueba es si se podría evitar el envejecimiento de un organismo complejo si cada una sus células pasara por un fenómeno de selección natural «perfecto» que permitiera «depurar» a todas y cada una de las que son defectuosas o viejas.

Por desgracia, según Masel y Nelson no es posible hacerlo.

Los dos motivos del envejecimiento

El principal impedimento es que el envejecimiento consiste en dos procesos distintos que el organismo no puede frenar a la vez: si bloquease uno, se dispararía el otro, y viceversa. El primero de ellos es la disminución de la velocidad de crecimiento de las células y la pérdida de función de los tejidos: por ejemplo, cuando las células epiteliales envejecen dejan de producir pigmentos y el cabello se blanquea; cuando ocurre lo mismo en el tejido conjuntivo, el organismo deja de regenerar las redes de colágeno y la piel pierde elasticidad y se arruga. El segundo proceso es que algunas células quedan fuera de control y disparan su crecimiento, a veces generando tumores.

No hay forma de frenar ambos fenómenos a la vez: «Si te deshaces de las células que funcionan mal, entonces las células cancerosas proliferan. Pero si te deshaces de las cancerosas, o simplemente las frenas, entonces permites que se acumulen las células defectuosas (…). Puedes hacer una cosa u otra, pero no las dos a la vez», ha dicho Paul Nelson, coautor de la investigación.

«No es nada nuevo que todos vamos a morir; muchas cosas son obvias y muy familiares para todos, pero realmente, ¿por qué envejecemos?», se ha preguntado Masel.

«Nosotros hemos investigado por qué ocurre el envejecimiento, desde la perspectiva de por qué la selección natural no lo ha detenido aún», ha continuado el investigador. La respuesta que ellos han encontrado es que al final, según las matemáticas, tratar de arreglar las cosas solo empeora el proceso.

«Quizás puedas ralentizar el envejecimiento, pero no puedes detenerlo», ha dicho Masel. «Tenemos una demostración matemática de por qué es imposible solucionar los dos problemas (la eliminación de las células defectuosas e impedir el crecimiento de las cancerosas). Puedes arreglar uno pero el otro permanecerá. (…) Y la razón básica es que las cosas se rompen. No importa cuánto lo intentes, no puedes evitarlo».

Quizás no sea un consuelo, pero según este investigador, es algo que todos debemos afrontar: «Es sencillamente algo con lo que lidiar si “quieres” ser un organismo multicelular». A diferencia de ellos, las bacterias son capaces de reparar sus daños en el ADN y cada cierto tiempo se reproducen y generan clones para garantizarse la inmortalidad. Pero, ¿quién querría ser una bacteria?

Totales: 74.975.125

Totales: 74.975.125 Conectados: 19

Conectados: 19