Feb

22

El “universo” de las Partículas II

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (3)

Comments (3)

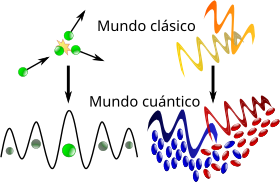

El movimiento rotacional puro se da cuando cada partícula del cuerpo se mueve en un círculo alrededor de una sola línea. Esta línea se llama eje de rotación. En consecuencia, los radios vectores desde el eje a todas las partículas experimentan el mismo desplazamiento angular al mismo tiempo.

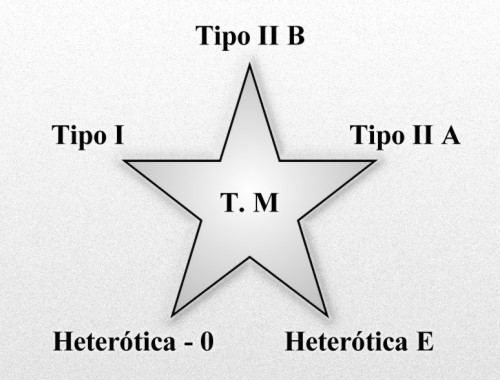

Estamos hablando de las partículas y no podemos dejar a un lado el tema del movimiento rotatorio de las mismas. Usualmente se ve cómo la partícula gira sobre su eje, a semejanza de un trompo, o como la Tierra o el Sol, o nuestra galaxia o, si se me permite decirlo, como el propio universo. En 1.925, los físicos holandeses George Eugene Uhlenbeck y Samuel Abraham Goudsmit aludieron por primera vez a esa rotación de las partículas. Éstas, al girar, generan un minúsculo campo electromagnético; tales campos han sido objeto de medidas y exploraciones, principalmente por parte del físico alemán Otto Stern y el físico norteamericano Isaac Rabi, quienes recibieron los premios Nobel de Física en 1.943 y 1.944 respectivamente, por sus trabajos sobre dicho fenómeno.

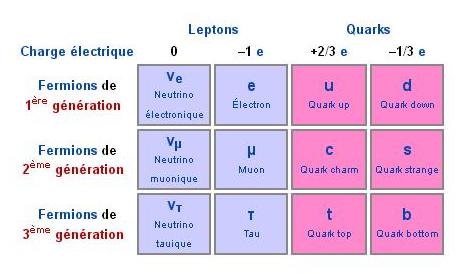

Esas partículas (al igual que el protón, el neutrón y el electrón), que poseen espines que pueden medirse en números mitad, se consideran según un sistema de reglas elaboradas independientemente, en 1.926, por Fermi y Dirac; por ello, se las llama y conoce como estadísticas Fermi-Dirac. Las partículas que obedecen a las mismas se denominan fermiones, por lo cual el protón, el electrón y el neutrón son todos fermiones.

Hay también partículas cuya rotación, al duplicarse, resulta igual a un número par. Para manipular sus energías hay otra serie de reglas, ideadas por Einstein y el físico indio S. N. Bose. Las partículas que se adaptan a la estadística Bose-Einstein son bosones, como por ejemplo la partícula alfa.

Las reglas de la mecánica cuántica tienen que ser aplicadas si queremos describir estadísticamente un sistema de partículas que obedece a reglas de esta teoría en vez de los de la mecánica clásica. En estadística cuántica, los estados de energía se considera que están cuantizados. La estadística de Bose-Einstein se aplica si cualquier número de partículas puede ocupar un estado cuántico dad. Dichas partículas (como dije antes) son bosones, que tienden a juntarse.

Los bosones tienen un momento angular nh/2π, donde n es 0 o un entero, y h es la constante de Planck. Para bosones idénticos, la función de ondas es siempre simétrica. Si sólo una partícula puede ocupar un estado cuántico, tenemos que aplicar la estadística Fermi-Dirac y las partículas (como también antes dije) son los fermiones que tienen momento angular (n + ½)h / 2π y cualquier función de ondas de fermiones idénticos es siempre antisimétrica. La relación entre el espín y la estadística de las partículas está demostrada por el teorema espín-estadística.

El espacio euclidiano bidimensional o simplemente espacio bidimensional (también conocido como espacio 2D o plano euclidiano) es un entorno geométrico en el que se requieren dos valores (llamados parámetros) para determinar la posición de un elemento (es decir, punto) en el plano.

En un espacio de dos dimensiones es posible que haya partículas (o cuasipartículas) con estadística intermedia entre bosones y fermiones. Estas partículas se conocen con el nombre de aniones; para aniones idénticos, la función de ondas no es simétrica (un cambio de fase de +1) o antisimétrica (un cambio de fase de -1), sino que interpola continuamente entre +1 y -1. Los aniones pueden ser importantes en el análisis del efecto Hall cuántico fraccional y han sido sugeridos como un mecanismo para la superconductividad de alta temperatura.

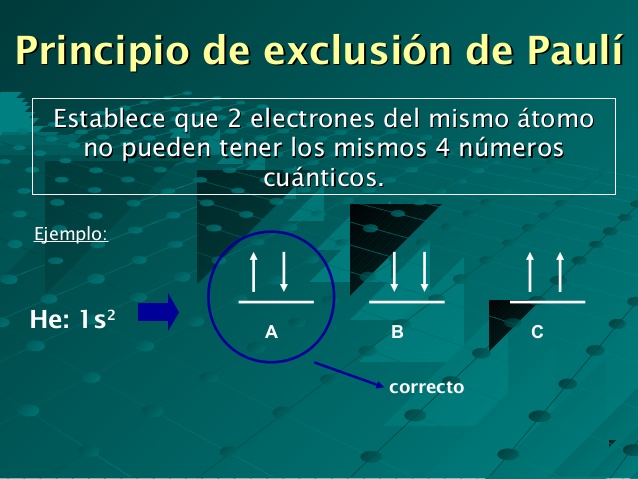

Este principio es el que permite que existan estrellas enanas blancas y de neutrones

Debido al principio de exclusión de Pauli, es imposible que dos fermiones ocupen el mismo estado cuántico (al contrario de lo que ocurre con los bosones). La condensación Bose-Einstein es de importancia fundamental para explicar el fenómeno de la super-fluidez. A temperaturas muy bajas (del orden de 2×10-7K) se puede formar un condensado de Bose-Einstein, en el que varios miles de átomos forman una única entidad (un super-átomo). Este efecto ha sido observado con átomos de rubidio y litio. Como ha habréis podido suponer, la condensación Bose-Einstein es llamada así en honor al físico Satyendra Nath Bose (1.894 – 1.974) y a Albert Einstein. Así que, el principio de exclusión de Pauli tiene aplicación no sólo a los electrones, sino también a los fermiones; pero no a los bosones.

Si nos fijamos en todo lo que estamos hablando aquí, es fácil comprender cómo forma un campo magnético la partícula cargada que gira, pero ya no resulta tan fácil saber por qué ha de hacer lo mismo un neutrón descargado. Lo cierto es que cuando un rayo de neutrones incide sobre un hierro magnetizado, no se comporta de la misma forma que lo haría si el hierro no estuviese magnetizado. El magnetismo del neutrón sigue siendo un misterio; los físicos sospechan que contiene cargas positivas y negativas equivalente a cero, aunque por alguna razón desconocida, logran crear un campo magnético cuando gira la partícula.

El momento magnético del neutrón

En unidades SI, el momento magnético del neutrón es aproximadamente −9.6623640 × 10−27 J/T

Particularmente creo que, si el neutrón tiene masa, si la masa es energía (E = mc2), y si la energía es electricidad y magnetismo (según Maxwell), el magnetismo del neutrón no es tan extraño, sino que es un aspecto de lo que en realidad es materia. La materia es la luz, la energía, el magnetismo, en definitiva, la fuerza que reina en el universo y que está presente de una u otra forma en todas partes (aunque no podamos verla).

Sea como fuere, la rotación del neutrón nos da la respuesta a esas preguntas:

Partículas, antipartículas, fuerzas… :

Blog de Emilio Silvera V.

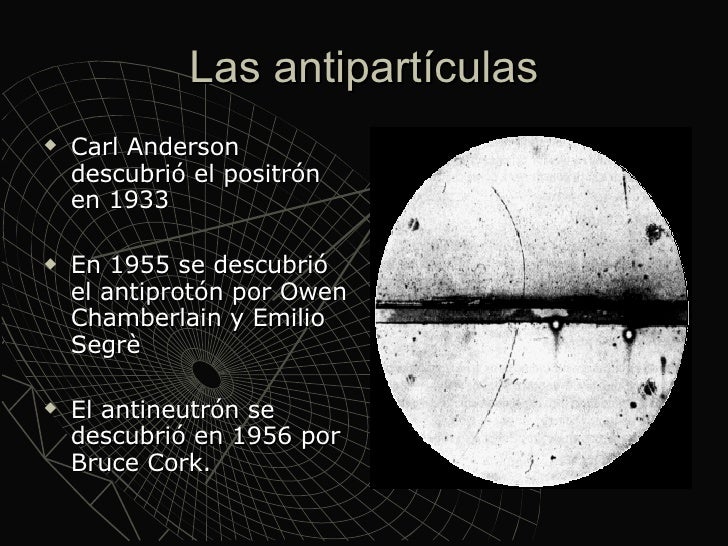

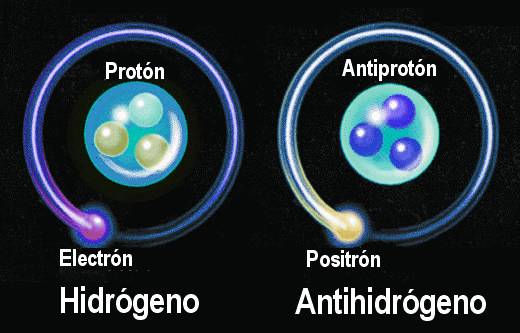

¿Qué es el antineutrón? Pues, simplemente, un neutrón cuyo movimiento rotatorio se ha invertido; su polo sur magnético, por decirlo así, está arriba y no abajo. En realidad, el protón y el antiprotón, el electrón y el positrón, muestran exactamente el mismo fenómeno de los polos invertidos.

Es indudable que las antipartículas pueden combinarse para formar la antimateria, de la misma forma que las partículas corrientes forman la materia ordinaria.

La primera demostración efectiva de antimateria se tuvo en Brookhaven en 1.965, donde fue bombardeado un blanco de berilio con 7 protones BeV y se produjeron combinaciones de antiprotones y antineutrones, o sea, un anti-deuterón. Desde entonces se ha producido el antihelio 3, y no cabe duda de que se podría crear otros anti-núcleos más complicados aún si se abordara el problema con más interés.

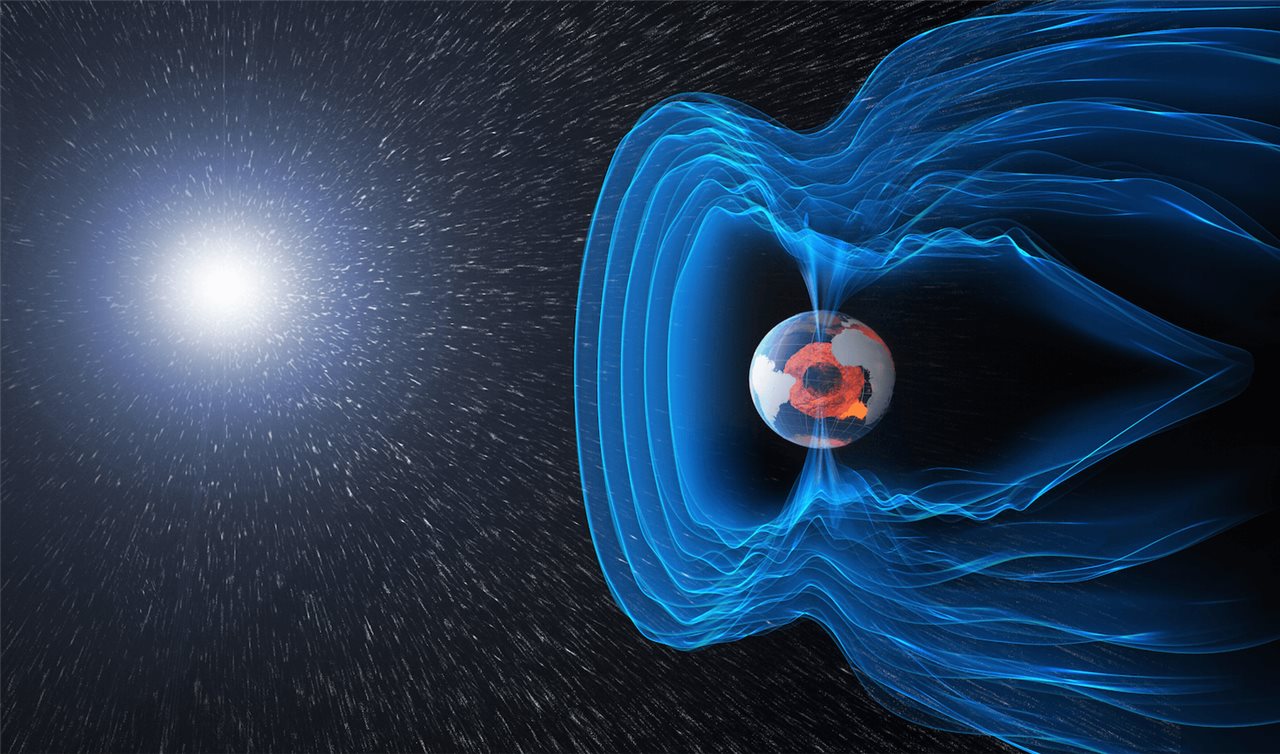

Pero, ¿existe en realidad la antimateria? ¿Hay masas de antimateria en el universo? Si las hubiera, no revelarían su presencia a cierta distancia. Sus efectos gravitatorios y la luz que produjeran serían idénticos a los de la materia corriente. Sin embargo, cuando se encontrasen las masas de las distintas materias, deberían ser claramente perceptibles las reacciones masivas del aniquilamiento mutuo resultante del encuentro. Así pues, los astrónomos observan especulativamente las galaxias, para tratar de encontrar alguna actividad inusual que delate interacciones materia-antimateria.

No parece que dichas observaciones fuesen un éxito. ¿Es posible que el universo esté formado casi enteramente por materia, con muy poca o ninguna antimateria? Y si es así, ¿por qué? Dado que la materia y la antimateria son equivalente en todos los aspectos, excepto en su oposición electromagnética, cualquier fuerza que crease una originaría la otra, y el universo debería estar compuesto de iguales cantidades de la una y de la otra.

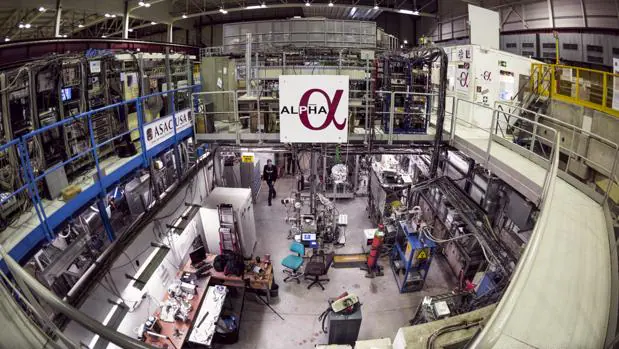

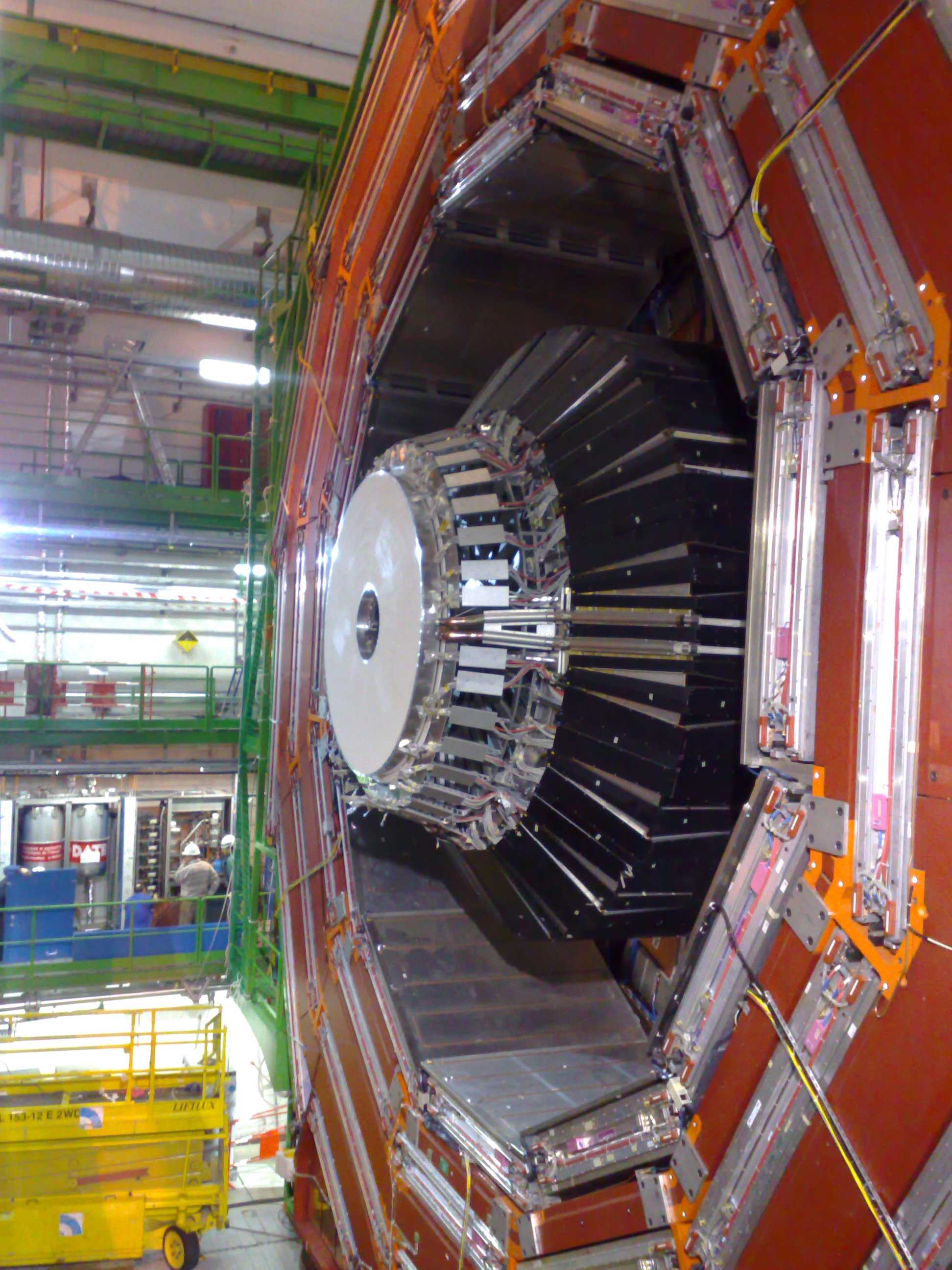

Aquí detectaron lograron encontrar la anti-materia por primera vez

Este es el dilema. La teoría nos dice que debería haber allí antimateria, pero las observaciones lo niegan, no lo respaldan. ¿Es la observación la que falla? ¿Y qué ocurre con los núcleos de las galaxias activas, e incluso más aún, con los quásares? ¿Deberían ser estos fenómenos energéticos el resultado de una aniquilación materia-antimateria? ¡No creo! Ni siquiera ese aniquilamiento parece ser suficiente, y los astrónomos prefieren aceptar la noción de colapso gravitatorio y fenómenos de agujeros negros, como el único mecanismo conocido para producir la energía requerida.

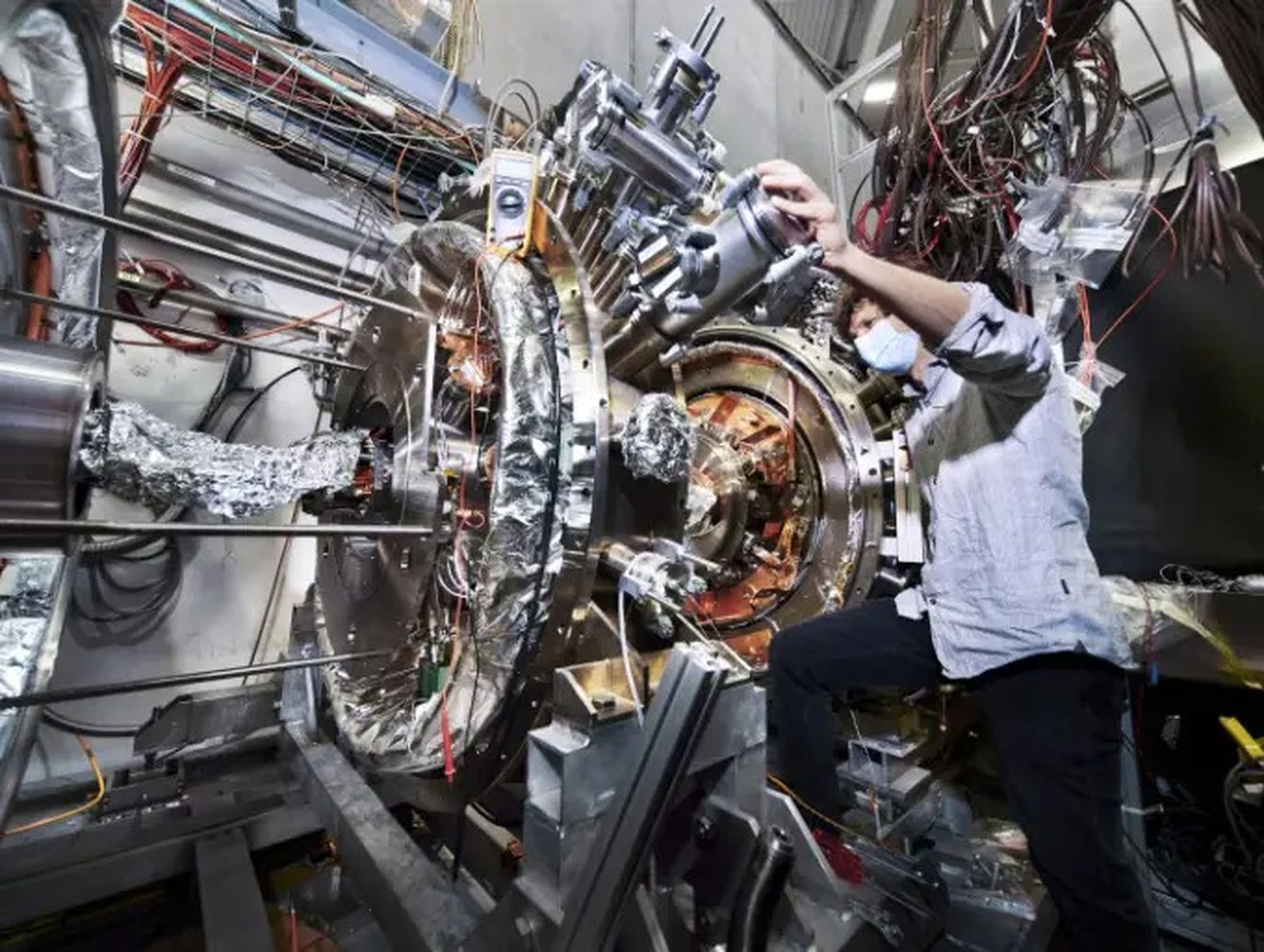

Así es por dentro la única fábrica de antimateria del mundo, donde los científicos crean la sustancia más explosiva del universo para entender por qué existimos.

Con esto de la antimateria me ocurre igual que con el hecho, algunas veces planteado, de la composición de la materia en lugares lejanos del universo. “Ha caído una nave extraterrestre y nuestros científicos han comprobado que está hecha de un material desconocido, casi indestructible”. Este comentario se ha podido oír en alguna película de ciencia ficción. Podría ser verdad (un material desconocido), sin embargo, no porque la nave esté construida por una materia distinta, sino porque la aleación es distinta y más avanzada a partir de los materiales conocidos del universo. En cualquier parte del universo, por muy lejana que pueda estar, rigen los mismos principios y las mismas fuerzas: la materia y la energía son las mismas en cualquier parte. Lo único que puede diferir es la forma en que se utilice, el tratamiento que se le pueda dar, y sobre todo, el poseer el conocimiento y la tecnología necesarios para poder obtener el máximo resultado de las propiedades que dicha materia encierra, porque, en última instancia, ¿es en verdad inerte la materia?

“Ha sido en uno de ellos, en un experimento que se desarrolla desde hace veinte años en el Centro Europeo de Física de Partículas (CERN), que los investigadores han conseguido un logro que puede ayudar a desentrañar el misterio. Por primera vez en la historia, se ha conseguido observar el espectro de luz de la antimateria, en concreto, del anti-hidrógeno.

No se trata de un descubrimiento sencillo. El hidrógeno, al contar con un solo protón y un único electrón, es el átomo del Universo que mejor se conoce y el más abundante, pero a su opuesto, el anti-hidrógeno, se le entiende de manera muy limitada y producirlo en condiciones de laboratorio es extremadamente difícil.”

Todo lo que podemos ver en el Universo, sin excepción, está hecho de materia mientras que no se demuestre lo contrario. Dicen que si pudiéramos ver una galaxia de antimateria, nos parecería igual a las otras de materia.

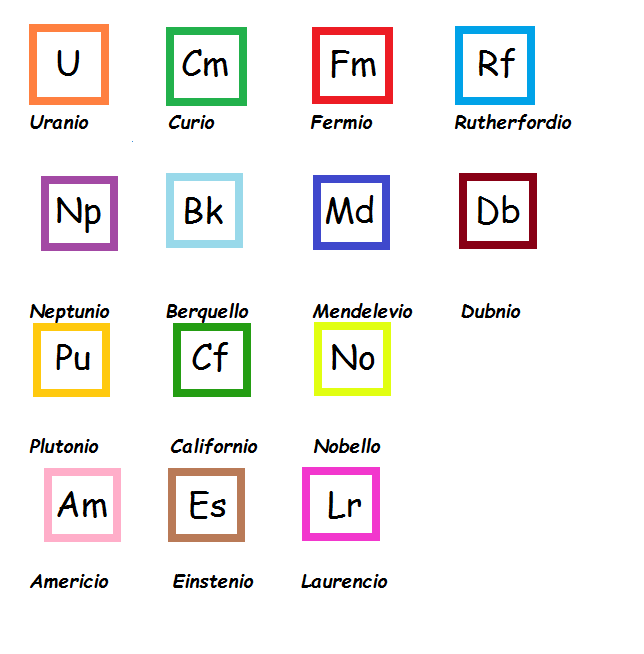

Tiene y encierra tantos misterios la materia que estamos aún a años luz de saber y conocer sobre su verdadera naturaleza. Nos podríamos preguntar miles de cosas que no sabríamos contestar. Nos maravillan y asombran fenómenos naturales que ocurren ante nuestros ojos, pero que tampoco sabemos, en realidad, a qué son debidas. Sí, sabemos ponerles etiquetas como la fuerza nuclear débil, la fisión espontánea que tiene lugar en algunos elementos como el protactinio o el torio, y con mayor frecuencia, en los elementos que conocemos como trans-uránidos. (Más allá del Uranio).

A medida que los núcleos se hacen más grandes, la probabilidad de una fisión espontánea aumenta. En los elementos más pesados de todos (einstenio, fermio y mendelevio), esto se convierte en el método más importante de su ruptura, sobrepasando a la emisión de partículas alfa. ¡Parece que la materia está viva! Son muchas las cosas que desconocemos, y nuestra curiosidad nos empuja continuamente a buscar esas respuestas.

El electrón y el positrón son notables por sus pequeñas masas (sólo 1/1.836 de la del protón, el neutrón, el antiprotón o el antineutrón), y por lo tanto, han sido denominados leptones (de la voz griega leptos, que dignifica “delgado”).

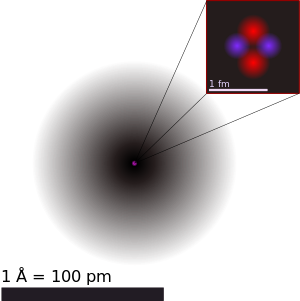

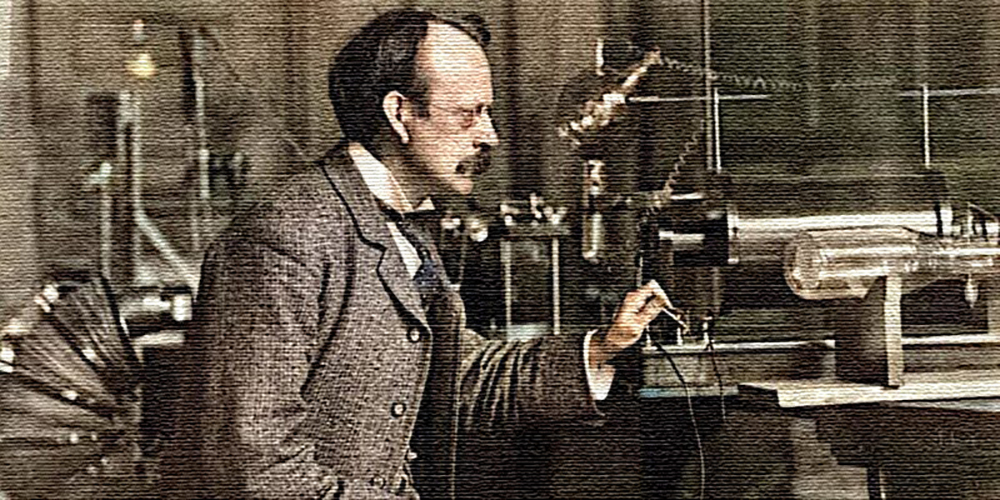

Aunque el electrón fue descubierto en 1.897 por el físico británico Joseph John Thomson (1.856 – 1.940), el problema de su estructura, si la hay, aún no está resuelto. Conocemos su masa y su carga negativa que responden a 9’1093897 (54) × 10-31 Kg la primera, y 1’60217733 (49) × 10-19 culombios la segunda, y también su radio clásico r0 igual a e2/(mc2) = 2’82 × 10-13 cm. No se ha descubierto aún ninguna partícula que sea menos masiva que el electrón (o positrón) y que lleve una carga eléctrica, sea la que fuese (sabemos cómo actúa y cómo medir sus propiedades, pero aún no sabemos qué es), que tenga asociada un mínimo de masa.

Lo cierto es que el electrón es una maravilla en sí mismo. El universo no sería como lo conocemos si el electrón fuese distinto a como es; bastaría un cambio infinitesimal para que, por ejemplo, nosotros no pudiéramos estar aquí ahora.

Muchos granos de arena conforman una inmensa playa

¡No por pequeño se es insignificante!

Claro que, no debemos olvidarnos de que, ¡Todo lo grande está hecho de cosas pequeñas! Una inmensa galaxia se conforma de un conjunto inmenso de átomos …

En realidad, existen partículas que no tiene asociada ninguna masa en absoluto, es decir, ninguna masa en reposo. Por ejemplo, las ondas de luz y otras formas de radiación electromagnética se comportan como partículas (Einstein en su efecto fotoeléctrico y De Broglie en la difracción de electrones*). Esta manifestación en forma de partículas de lo que, de ordinario, concebimos como una onda, se denomina fotón, de la palabra griega que significa “luz”.

El fotón tiene una masa de 1, una carga eléctrica de 0, pero posee un espín de 1, por lo que es un bosón. ¿Cómo se puede definir lo que es el espín? Los fotones toman parte en las reacciones nucleares, pero el espín total de las partículas implicadas antes y después de la reacción deben permanecer inmutadas (conservación del espín). La única forma de que esto suceda en las reacciones nucleares que implican a los fotones radica en suponer que el fotón tiene un espín de 1. El fotón no se considera un leptón, puesto que este término se reserva para la familia formada por el electrón, el muón y la partícula tau, con sus correspondiente neutrinos: υe, υμ y υτ.

Existen razones teóricas para suponer que cuando las masas se aceleran (como cuando se mueven en órbitas elípticas en torno a otra masa o llevan a cabo un colapso gravitacional), emiten energía en forma de ondas gravitaciones. Esas ondas pueden, así mismo, poseer aspecto de partícula, por lo que toda partícula gravitacional recibe el nombre de gravitón.

La forma gravitatoria es mucho, mucho más débil que la fuerza electromagnética. Un protón y un electrón se atraen gravitacionalmente con sólo 1/1039 de la fuerza en que se atraen electromagnéticamente. El gravitón (aún sin descubrir) debe poseer, correspondientemente, menos energía que el fotón, y por tanto, ha de ser inimaginablemente difícil de detectar.

No será fácil detectar gravitones

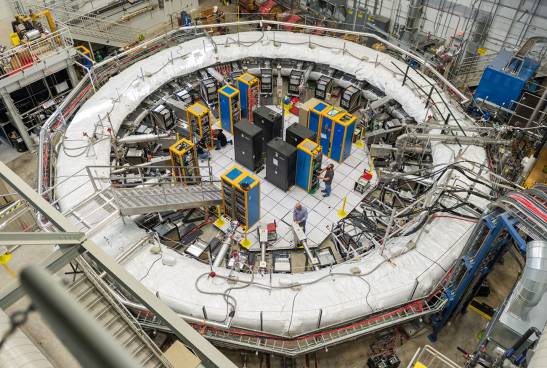

De todos modos, el físico norteamericano Joseph Weber emprendió en 1.957 la formidable tarea de detectar el gravitón. Llegó a emplear un par de cilindros de aluminio de 153 cm de longitud y 66 de anchura, suspendidos de un cable en una cámara de vacío. Los gravitones (que serían detectados en forma de ondas) desplazarían levemente esos cilindros, y se empleó un sistema para detectar el desplazamiento que llegase a captar la cien-billonésima parte de un centímetro. Las débiles ondas de los gravitones, que proceden del espacio profundo, deberían chocar contra todo el planeta, y los cilindros separados por grandes distancias se verán afectados de forma simultánea. En 1.969, Weber anunció haber detectado los efectos de las ondas gravitacionales. Aquello produjo una enorme excitación, puesto que apoyaba una teoría particularmente importante (la teoría de Einstein de la relatividad general). Desgraciadamente, nunca se pudo comprobar mediante las pruebas realizadas por otros equipos de científicos que duplicaron el hallazgo de Weber.

Dibujo 20150310 de stuart marongwe – mathematical model nexus gravitón

En cualquier caso, no creo que a estas alturas alguien pueda dudar de la existencia de los gravitones, el bosón mediador de la fuerza gravitatoria. La masa del gravitón es 0, su carga es 0, y su espín es 2. Como el fotón, no tiene antipartícula; ellos mismos hacen las dos versiones.

Solo de una cosa estoy seguro: Conocemos muy poco del Universo, nuestra ignorancia es…. ¡Infinita!

Emilio Silvera V.

Feb

10

La Gravedad… ¡Esa fuerza misteriosa!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física Relativista ~

Clasificado en Física Relativista ~

Comments (2)

Comments (2)

Un equipo de científicos considera que la gravedad no es solo una fuerza, es además un campo cuántico que completaría la gran Teoría Unificada de la Física.

Dos nuevos estudios realizados por investigadores de Australia, Austria y Alemania han puesto en entredicho la forma en la que entendemos la física de la gravedad. Los descubrimientos, publicados en las revistas Astrophysical Journal y Monthly Notices of the Royal Astronomical Society, se basan en observaciones de galaxias enanas satélite o galaxias más pequeñas que se encuentran en el extrarradio de la gran galaxia espiral que es la Vía Láctea.

Las dos se atraen, ¿será alguna forma de gravedad? ¿Estará, de alguna manera presente el magnetismo?

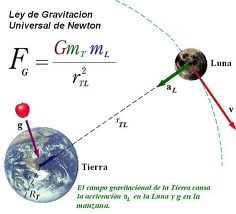

La Ley de la gravitación universal de Newton, publicada en 1687, sirve para explicar cómo actúa la gravedad en la Tierra, por ejemplo por qué cae una manzana de un árbol. El profesor Pavel Kroupa del Instituto de Astronomía Argelander de la Universidad de Bonn (Alemania) explicó que «a pesar de que su ley describe los efectos cotidianos de la gravedad en la Tierra, las cosas que podemos ver y medir, cabe la posibilidad de que no hayamos sido capaces de comprender en absoluto las leyes físicas que rigen realmente la fuerza de la gravedad.

La ley de Newton ha sido puesta en entredicho por distintos cosmólogos modernos, los cuales han redactado teorías contradictorias sobre la gravitación que intentan explicar la gran cantidad de discrepancias que se dan entre las mediciones reales de los sucesos astronómicos y las predicciones basadas en los modelos teóricos. La idea de que la «materia oscura» pueda ser la responsable de estas discrepancias ha ganado muchos adeptos durante los últimos años. No obstante, no existen pruebas concluyentes de su existencia.

En esta investigación, el profesor Kroupa y varios colegas examinaron «galaxias enanas satélite», cientos de las cuales deberían existir en la cercanía de las principales galaxias, incluida la Vía Láctea, según indican los modelos teóricos. Se cree que algunas de estas galaxias menores contienen tan sólo unos pocos millares de estrellas (se estima que la Vía Láctea, por ejemplo, contiene más de 200.000 millones de estrellas).

Al día de hoy sólo se ha logrado detectar treinta de estas galaxias alrededor de la Vía Láctea. Esta situación se atribuye al hecho de que, al contener tan pocas estrellas, su luz es demasiado débil como para que podamos observarlas desde una distancia tan lejana. Lo cierto es que este estudio tan detallado ha deparado resultados sorprendentes.

«En primer lugar, hay algo extraño en su distribución», indicó el profesor Kroupa. «Estas galaxias satélite deberían estar distribuidas uniformemente alrededor de su galaxia madre, pero no es el caso.» Nadie puede dar una explicación de tan atípica distribución que no concuerda con lo que, según la Ley de Newton, debería ser. Claro que, como era de esperar, uno de los científicos de la investigación se dejó caer con aquello de: “Nuestra investigación muestra que las galaxias enanas están dominadas por materia oscura” , es decir, buscan una explicación basándose en algo que aún, no está explicado y no se dan cuenta de que, la Ciencia, no es cosa de fe.

Las galaxias enanas esferoidales son pequeñas y muy débiles, conteniendo pocas estrellas en relación con su masa total. Los astrónomos encontraron difícil explicar el origen de este tipo de galaxias. Teorías previas proponían que estas galaxias orbitan cerca de galaxias mayores como la Vía Láctea, pero esto no explica cómo se formaron estas galaxias enanas que han sido observadas en las afueras del llamado “Grupo Local” de galaxias.

Los investigadores descubrieron que la totalidad de los satélites clásicos de la Vía Láctea (las once galaxias enanas más brillantes) están situados prácticamente en un mismo plano que dibuja una especie de disco. También observaron que la mayoría de estas once galaxias rotan en la misma dirección en su movimiento circular alrededor de la Vía Láctea, de forma muy similar a como lo hacen los planetas alrededor del Sol.

La explicación de los físicos a estos fenómenos es que los satélites debieron surgir de una colisión entre galaxias más jóvenes. «Los fragmentos resultantes de un acontecimiento así pueden formar galaxias enanas en rotación», explicó el Dr. Manuel Metz, también del Instituto de Astronomía Argelander. Éste añadió que «los cálculos teóricos nos indican la imposibilidad de que los satélites creados contengan materia oscura».

Las grandes galaxias como nuestra Vía Láctea, siempre han tenido galaxias enanas satélites a su alrededor

Estos cálculos contradicen otras observaciones del equipo. «Las estrellas contenidas en los satélites que hemos observado se mueven a mucha más velocidad que la predicha por la Ley de la gravitación universal. Si se aplica la física clásica, esto sólo puede atribuirse a la presencia de materia oscura», aseveró el Dr. Metz.

Este enigma nos indica que quizás se hayan interpretado de forma incorrecta algunos de los principios fundamentales de la física. «La única solución posible sería desechar la Ley de la gravitación de Newton», indicó el profesor Kroupa. «Probablemente habitemos un universo no Newtoniano. De ser cierto, nuestras observaciones podrían tener explicación sin necesidad de recurrir a la materia oscura.»

Hasta ahora, la Ley de la gravitación de Newton sólo ha sido modificada en tres ocasiones: para incluir los efectos de las grandes velocidades (la teoría especial de la relatividad), la proximidad de grandes masas (la teoría general de la relatividad) y las escalas subatómicas (la mecánica cuántica). Ahora, las graves inconsistencias reveladas por los datos obtenidos sobre las galaxias satélite respaldan la idea de que hay que adoptar una «dinámica newtoniana modificada» (MOND) para el espacio. Se ha llegado a publicar:

Datos recientes de galaxias ricas en gas coinciden exactamente con las predicciones de una teoría de la gravedad modificada conocida como MOND, según un nuevo análisis realizado por el profesor de Astronomía de la Universidad de Maryland, Stacy McGaugh. Ésta -la última de varias predicciones MOND exitosas- plantea nuevas preguntas sobre la exactitud del modelo cosmológico actual del Universo, escribe McGaugh en un artículo que será publicado en marzo en la revista Physical Review Letters.

La cosmología moderna dice que para que el universo se comporte como lo hace, la masa-energía del Universo debe ser dominada por materia oscura y energía oscura. Sin embargo, la evidencia directa de la existencia de estos componentes invisibles sigue siendo insuficiente. Una alternativa, aunque impopular, posibilidad es que la actual teoría de la gravedad no es suficiente para describir la dinámica de los sistemas cósmicos.

La teoría MOND, propuesta en 1981, modifica la segunda ley de la dinámica de Newton para que con ella se pueda explicar la rotación a velocidad uniforme de las galaxias, que contradice las predicciones newtonianas que afirman que la velocidad de los objetos separados del centro será menor.

Por supuesto, verificar la gravedad es extremadamente difícil (es una fuerza extraordinariamente débil). En muchos rangos experimentales verificar la teoría de Einstein es muy difícil, por lo que hay hueco para teorías alternativas. Lo cierto es que, a pesar de todo, Einstein sigue más “vivo” que nunca, su Teoría con la edad de más de 100 años, es la que predomina en el Universo, y seguramentre, él sonríe en cualquier sitio que esté.

Los nuevos descubrimientos poseen implicaciones de gran calado para la física fundamental y para las teorías sobre el Universo. Según el astrofísico Bob Sanders de la Universidad de Groningen (Países Bajos), «los autores de este artículo aportan argumentos contundentes. Sus resultados coinciden plenamente con lo predicho por la dinámica newtoniana modificada, pero completamente contrarios a la hipótesis de la materia oscura. No es normal encontrarse con observaciones tan concluyentes.»

Como se puede ver, la falta de conocimiento de la Gravedad es palpable y cada Investigación realizada exponen unos resultados dispares, unos a favor y otros en contra de la Ley de Newton y, los que están en contra de ella se agarran a la “materia oscura” como si de un clavo ardiendo se tratara para el que se ahoga.

Una de las predicciones de MOND especifica la relación relativa entre la masa de una galaxia y su velocidad de rotación plana. Sin embargo, las incertidumbres en las estimaciones de las masas de las estrellas en las galaxias espirales dominadas por estrellas (como nuestra propia Vía Láctea), habían impedido una prueba definitiva.

Para evitar este problema, McGaugh examinó galaxias ricas en gas, que tienen relativamente pocas estrellas y una preponderancia de la masa en forma de gas interestelar. “Nosotros entendemos la física de la absorción y liberación de energía por los átomos en el gas interestelar, de modo que contar fotones es como contar átomos. Esto nos da una estimación precisa de la masa de estas galaxias”, dijo McGaugh.

Utilizando el trabajo recientemente publicado que él y otros científicos habían hecho para determinar tanto la masa y la velocidad de rotación de las galaxias planas ricas en gas, McGaugh recopiló una muestra de 47 y comparó la masa de cada galaxia y la velocidad de rotación con la relación esperada por MOND. Las 47 galaxias coincidieron sobre o muy cerca de la predicción MOND. No hay un modelo de materia oscura realizado tan bien.

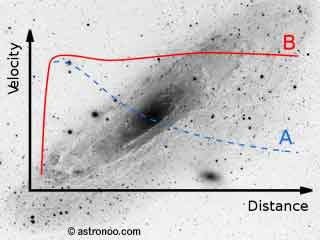

Imagen: curva de rotación de las galaxias espirales. En color azul (A), la curva de rotación calculada usando las ecuaciones de Newton, en color rojo (B), la curva observada en función de la distancia de las estrellas en relación al centro de la galaxia.

Crédito imagen: www.astronoo.com

“Me parece sorprendente que la predicción hecha por Milgrom hace más de un cuarto de siglo funcione tan bien en la adecuación de estos hallazgos para las galaxias ricas en gas”, dijo McGaugh.

Casi todos coinciden en que en las escalas de cúmulos de galaxias grandes y superiores, el Universo está bien descrito por la materia oscura, la teoría de la energía oscura. Sin embargo, según McGaugh esta cosmología no tiene en cuenta lo que sucede en las escalas de galaxias y entes más pequeños.

“MOND es todo lo contrario”, dijo. “Representa la pequeña “escala de las galaxias individuales, pero MOND no te dice mucho sobre el universo más grande”.

La “materia oscura” podría ser una licencia de la imaginación

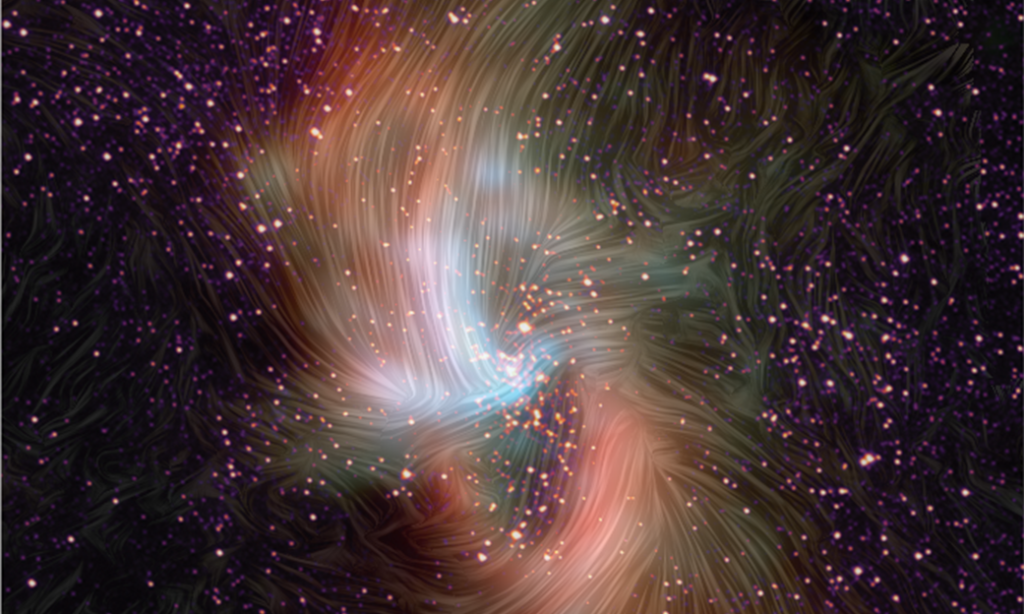

Eso sí, imágenes de todo tipo mediante las cuáles se nos quiere hacer ver que, la materia oscura (dicen) está ahí presente, sin embargo, nada de lo que estamos viendo es materia oscura son filamentos de plasma, polvo y gas interestelar, y otros objetos y sustancias que en el Universo se producen mediante la química de la energía de las estrellas presente en esos lugares pero, “materia oscura” me parece que no.

¡Qué Locura! Después de tantos años, aún andamos a vueltas con la Gravedad que…no se entiende con la plenitud que cabría esperar y, lo cierto es que, por muchas leyes (como por ejemplo MOND) que quieran sacar al escenario de la Astronomía, Newton y Einstein siguen vigentes -cada cual en su plano- y, lo que falta por explicar, aún no ha sido explicado simplemente porque nadie sabe lo que es.

Algunas veces oímos a “reputados” Astrónomos y Astrofísicos hablar de la gravedad y se refieren a ella como si, los mundos, tuvieran agujeros y estuvieran vacíos, no saben explicar algunas anomalías que se encuentran en sus investigaciones y al no encontrar la causa, acuden a la socorrida materia oscura, esa alfombra debajo de la que barremos nuestra ignorancia.

¡Habrá que esperar!

Emilio Silvera Vázquez

Feb

9

¡Interacciones fundamentales de la Naturaleza! Una reseña breve

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

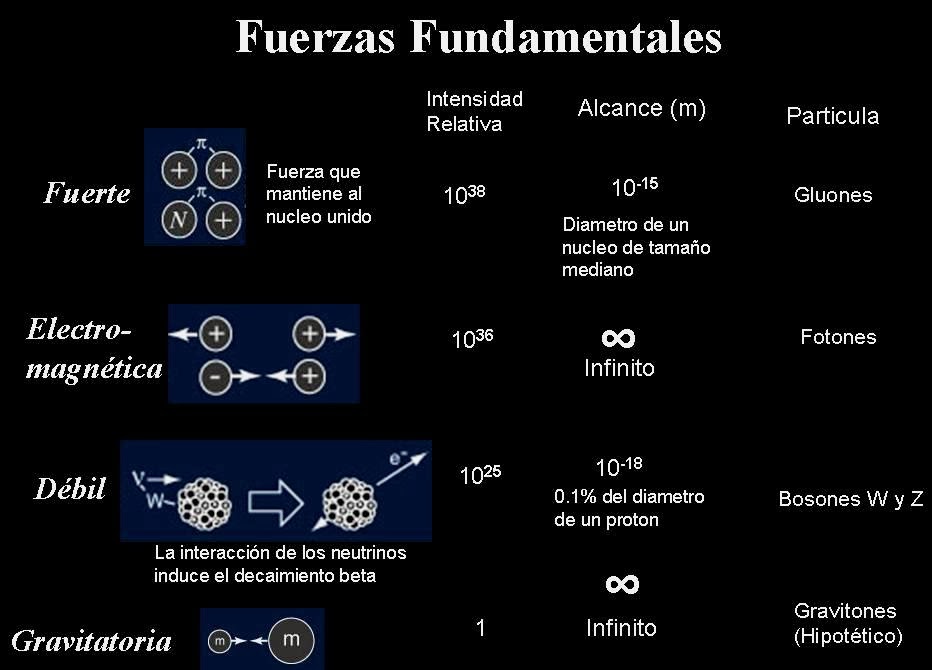

“Las fuerzas fundamentales son aquellas fuerzas del Universo que no se pueden explicar en función de otras más básicas. Las fuerzas o interacciones fundamentales conocidas hasta ahora son cuatro: gravitatoria, electromagnética, nuclear fuerte y nuclear débil.”

Como pueden haber deducido por el título, me estoy refiriendo a cualquiera de los cuatro tipos diferentes de interacciones que pueden ocurrir entre los cuerpos. Estas interacciones pueden tener lugar incluso cuando los cuerpos no están en contacto físico y juntas pueden explicar todas las fuerzas que se observan en el universo.

Todos recordamos lecturas en las que nos hablaban sobre aquellos pensadores del pasado que como Empédocles, Leucipo o demócrito nos hablaban de sustancias y elementos y hasta de átomos, ellos tenían la intuición de que la materia, estaba compuesta por esos minúsculos objetos que hoy llamamos partículas elementales. Pasado mucho tiempo y cerca ya del siglo XX, llegaron científicos como Dalton, J.J Tomson (que descubrió el electrón) y propuso en modelo atómico con el electrón dentro del átomo, Eugen Goldstein descubrió los rayos canales (con carga positiva) y después Rutherford el nombre del proón, esa partícula positiva generada a partir del hidrógeno y se completaron la presencia de las partículas fundamentales en la que cada una tenía un tipo de carga (la del protón y la del electrón eran idénticas para nivelar la simetría del átomo con esa igualdad de fuerzas). Ya en el siglo XX se postuló la existencia del neutrón algo más masivo que el protón pero sin carga eléctrica, su existencia se confirmó en 1932.

Poco a poco se fueron comprendiendo las interacciones entre las partículas de materia

A comienzos del siglo XX, el desarrollo del modelo atómico de Rutherford, coloca a los protones y neutrones en el núcleo del átomo y a los electrones en su corteza. Las investigaciones sobre el efecto fotoeléctrico llevan a Einstein a formular su teoría corpuscular de la luz y predecir la existencia del fotón, que sería una partícula sin masa ni carga eléctrica. Así pues, hasta 1932 podía explicarse la constitución de la materia sólo con cuatro partículas elementales: el electrón, el protón, el neutrón y el fotón. Sin embargo, pronto se comprobó que el número de partículas elementales era mucho mayor.

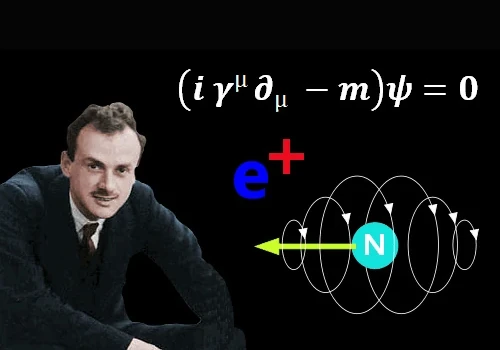

“”En 1928, trabajando en los spines no relativistas de Pauli, halló la ecuación de Dirac, una ecuación relativista que describe al electrón. Este trabajo permitió a Dirac predecir la existencia del positrón, la antipartícula del electrón, que interpretó para formular el mar de Dirac.”

Investigando sobre una hipótesis de Paul Dirac, se descubrió en ese año el positrón por Carl Anderson. Es esta una partícula con la misma masa que el electrón y el mismo valor absoluto de carga, sólo que positiva (e+) . También se denomina antielectrón.

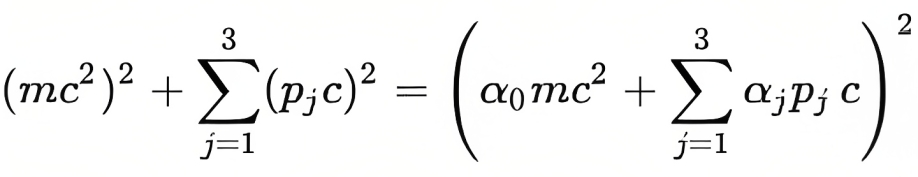

La formulación matemática del teorema de Dirac

A la izquierda de la ecuación tenemos la ecuación relativista de energía: E^2 = p^2c^2+m^2+c^4 y la derecha la definición de operador energía de la ecuación de Schrödinger.

El truco que aplicó Dirac (como vemos en la siguiente ecuación) fue encontrar una expresión matemática que al cuadrado fuera equivalente a la ecuación de Klein-Gordon.

Esta expresión depende de dos parámetros que Dirac encontró que eran matrices y no números reales o complejos.

Desarrollando las ecuaciones y utilizando la notación relativista covariante llegamos a la famosa ecuación de Dirac: (∂ – m) ψ = 0.

https://youtu.be/d416FptekWA

Otra partícula descubierta a principio de los años treinta del pasado siglo fue el neutrino, que ya había sido postulado por W. Pauli, para poder explicar una aparente violación en el principio de conservación del principio de conservación de la energía cuando se producía una desintegración b. Fue detectado en 1956 por un equipo de físicos de la universidad de Berkeley, entre los cuales se encontraban Segre y Chamberlain, que posteriormente fueron galardonados con el premio Nobel por su descubrimiento.

Los piones de Huideki eran en realidad Gluones

En 1935 Hideki Yukawa propone la existencia de una partícula para explicar las fuerzas que mantienen unidos a los nucleones. Esta partícula se denominó mesón, ya que tenía una masa intermedia entre la del protón y la del electrón (unas 200 veces la masa de éste). Actualmente esta partícula se denomina pión o mesón p y se detectó por primera vez en la radiación cósmica que llega a la Tierra (1947).

El muon fue la primera partícula elemental descubierta que no pertenecía a los átomos convencionales. Fue descubierto por Carl Anderson y Seth Neddermeyer en 1936, y confirmada su existencia posteriormente por J. C. Street y E. C.

En 1937 se descubre el muón, una partícula con la misma carga que el electrón, pero con una masa de una 200 veces la de éste. A partir de 1940 se descubrieron cientos de partículas elementales y además las correspondientes antipartículas, idénticas en masa y vida media, pero con carga opuesta. Esta proliferación de partículas hizo que los físicos desarrollasen unos criterios para clasificarlas y llegar a comprender tanto la estructura interna de la materia como la naturaleza de las interacciones que existen entre ellas.

El electromagnetismo está presente en todo el Universo

De todos aquellas ideas similares y trabajos pioneros, hemos llegado a discernir lo que, en realidad, son las interacciones fundamentales y viene de lejos el deseo de muchos físicos que han tratado de unificar en una teoría o modelo a las cuatro fuerzas, que pudieran expresarse mediante un conjunto de ecuaciones. Einstein se pasó los últimos años de su vida intentándolo, pero igual que otros antes y después de él, aún no se ha conseguido dicha teoría unificadora de los cuatro interacciones fundamentales del universo. Se han hecho progresos en la unificación de interacciones electromagnéticas y débiles. Veamos donde estamos hoy:

La Interacción electromagnética

Es la fuerza con la cual las partículas cargadas se repelen (si sus cargas son iguales) o se atraen (si sus cargas sis diferentes, de signos opuestos). La Interacciones magnética es la fuerza que experimenta una partícula eléctricamente cargada que se mueve a través de un campo magnético. Las partículas cargadas en movimiento generan un campo magnético como, por ejemplo, los electrones que fluyen a través de las espiras de una bobina.

Un electrón y un protón se atraen de dos maneras, por un lado a causa de que el primero tiene carga eléctrica positiva y el segundo negativa, y ya se sabe que cargas contrarias se atraen. Por el otro, a causa de sus propias masas, como efecto de la fuerza de la gravedad. Se puede calcular que la atracción causada por las cargas eléctricas es aproximadamente “1040” veces mayor que la atracción gravitatoria.

Las fuerzas magnéticas y eléctricas están entrelazadas. En 1873, James Clerk Maxwell consiguió formular las ecuaciones completas que rigen las fuerzas eléctricas y magnéticas, descubiertas experimentalmente por Michael Faraday. Se consiguió la teoría unificada del electromagnetismo que nos vino a decir que la electricidad y el magnetismo eran dos aspectos de una misma cosa.

La interacción es universal, de muy largo alcance (se extiende entre las estrellas), es bastante débil. Su intensidad depende del cociente entre el cuadrado de la carga del electrón y 2hc (dos veces la constante de Planck por la velocidad de la luz). Esta fracción es aproximadamente igual a 1/137’036…, o lo que llamamos α y se conoce como constante de estructura fina.

En general, el alcance de una interacción electromagnética es inversamente proporcional a la masa de la partícula mediadora, en este caso, el fotón, sin masa.

La Interacción Gravitatoria que mantiene unidos los planetas alrededor del Sol y las galaxias en los Cúmulos, También nuestros pies unidos al suelo de la Tierra. Sin la Gravedad, todo el Universo sería un gran Caos de objetos dispersos y flotando de manera aleatoria por todas partes.

Así que la Gravedad es una Interacción fundamental de la Que Newton y después Einstein, nos dejaron bien claras sus complejas estructuras (al menos las que al momento creemos que son) que fueron relacionadas a partir de 1915 con las estructuras del espacio-tiempo. Sin embargo, aún no sabemos como poder conciliar las leyes de la gravedad, con las leyes de la mecánica cuántica (excepto cuando la interacción gravitatoria es extremadamente débil -entre dos partículas por ejemplo).

– La interacción gravitatoria actúa exclusivamente sobre la masa de las partículas.

– La interacción es de largo alcance (probablemente llegue a los más lejanos confines del Universo conocido).

– La Interacción es tan debido que probablemente nunca podremos detectar experimentalmente la atracción gravitatoria entre dos partículas elementales. La única razón por la que podemos medir esta interacción es porque es colectiva: todas las partículas (de la Tierra) atraen a todas las partículas (de nuestro cuerpo) en la misma dirección.

. La partícula mediadora es el hipotético “Gravitón”. Aunque aún nos e ha descubierto experimentalmente, sabemos lo que predice la mecánica cuántica: que tiene una masa nula y espín 2.

Una ley general para las interacciones es que, si el mediador tiene espín par, la fuerza entre cargas iguales es atractiva y entre cargas opuestas repulsivas. Si el Espín es impar (como en el electromagnetismo) se cumple la inversa.

La Interacción fuerte

Hasta 1972, sólo se conocían las reglas de simetría de las interacción fuerte y nio fuimos capaces de formulas las leyes de esta Interacción con la debida precisión.:

– El alcance de esta interacción no se extiende más allá del radio del núcleo atómico (10-13 cm aproximadamente)..

-La interacción es fuerte. Bajo la influencia de esta interacción, las partículas que pueden desintegrarse, las “resonancias” lo hacen muy rápidamente. Un ejemplo es la resonancia Δ, con una vida media de solamente 0,6 x 10-23 s Esta colisión es extremadamente probable cuando dos hadrones se encuentran a una distancia cercana a 10-13 cm.

Hasta 1972 se pensaba que los mediadores de las interacciones fuertes eran piones, que tienen espín 0 y masa comprendida entre 135 y 140 MeV. Por ejemplo, la fuerte atracción entre dos protones se debe fundamentalmente al intercambio de un pión. Hoy día se dice que esto obedece al hecho que de que los piones son los hadrones más ligeros y que como los demás adrones, están formados por “Quarks”. La interacciones fuerte es entonces un efecto secundario de una interacción más fuerte incluso entre Quarks. Los mediadores de esta interacción más fuerte son los gluones.

La interacción fuerte es unas 102 veces mayor que la interacción electromagnética y, como ya se dijo antes, aparece sólo entre los hadrones y es la responsable de las fuerzas entre nucleones que confiere a los núcleos de los átomos su gran estabilidad. Actúa a muy corta distancia dentro del núcleo (10-15 metros) y se puede interpretar como una interacción mediada por el intercambio de mesones virtuales llamados Gluones. Está descrita por una teoría gauge llamada Cromodinámica cuántica.

La interacción fuerte, como se ha explicado muchas veces, es la más fuerte de todas las fuerzas fundamentales de la Naturaleza, es la responsable de mantener unidos los protones y neutrones en el núcleo del átomo. Como los protones y neutrones están compuestos de Quarks, éstos dentro de dichos bariones, están sometidos o confinados en aquel recinto, y, no se pueden separar por impedirlo los gluones que ejercen la fuerza fuerte, es decir, esta fuerza, al contrario que las demás, cuando más se alejan los quarks los unos de los otros más intensa se vuelve. Aumenta con la distancia.

El concepto de campo de Faraday ha dado mucho juego en Física, es un concepto ideal para explicar cierttos fenómenos que se han podido observar en las investigaciones de las fuerzas fundamentales y otros. El campo no se ve, sin embargo, está ahí, rodea los cuerpos como, por ejemplo, un electrón o el planeta Tierra que emite su campo electromagnético a su alrededor y que tan útil nos resulta para evitar problemas.

Me he referido a una teoría gauge que son teorías cuánticas de campo creadas para explicar las interacciones fundamentales. Una teoría gauge requiere un grupo de simetría para los campos y las potenciales (el grupo gauge). En el caso de la electrodinámica, el grupo es abeliano, mientras que las teorías gauge para las interacciones fuertes y débiles utilizan grupos no abelianos. Las teorías gauge no abelianas son conocidas como teorías de Yang–Mills. Esta diferencia explica por qué la electrodinámica cuántica es una teoría mucho más simple que la cromodinámica cuántica, que describe las interacciones fuertes, y la teoría electrodébil que unifica la fuerza débil con la electromagnética. En el caso de la gravedad cuántica, el grupo gauge es mucho más complicado que los anteriores necesarios para la fuerza fuerte y electrodébil.

En las teorías gauge, las interacciones entre partículas se pueden explicar por el intercambio de partículas (bosones vectoriales intermediarios o bosones gante), como los gluones, fotones y los W y Z.

Interacción débil

La Interacción débil es la responsable de que muchas partículas y también muchos núcleos atómicos exóticos sean inestables. Esta interacción piede provocar que una partícula se transforme en otra relacionada, por emisión de un electrón y un neutrino. Enrico Fermi en 1934 estableció una regla general de la interacción débil, que fue mejorada posteriormente por George Sudarshan, Robert Marshak, Murray Gell Mann, Rychard Feymann y otros. La fórmula mejorada funcionaba muy bien, pero hizo evidente que no era adecuada en todas las circunstancias. En 1970 de las siguientes características de las interacciones débiles sólo se conocían las tres primeras:

– La interacción actúa de forma universal sobre muchos tipos diferentes de partículas y su intensidad es aproximadamente igual para todas (aunque sus efectos pueden ser muy diferentes en cada caso). A los neutrinos les afecta exclusicamente la interacción débil.

– Comparada con las demás interacciones, ésta tiene un alcance muy corto.

– La interacción es muy débil. Consecuentemente, los choques en partículas de los cuales los neutrinos involucrados son tan poco frecuentes que se necesitan chorros muy intensos de neutrinos para poder estudiar los sucesos.

– Los mediadores de las interacción débil, llamados W+ y W–, no se detectaron hasta la década de 1980. Al igual que el fotón tienen espín 1, pero están eléctricamente cargados y son muy pesados (esta es la causa por el que el alcance de la interacción es tan corto). Hay un tercer mediador Zº, que es responsable de un tercer tipo de interacción débil que no tiene nada que ver con la desintegración de las partículas.; la “corriente neutra”. Permite que los neutrinos puedan colisionar con otras partículas sin cambiar su identidad.

A partir de 1970, quedó clara la relación entre la interacción débil y la interacción electromagnética, que dio lugar a la teoría electrodébil tan conocida hoy.

Así, estas cuatro fuerzas fundamentales de la Naturaleza son las leyes que rigen en el Universo y, están presentes en todos sus campos y regiones por muy alejados que estos se puedan encontrar e inciden en los comportamientos de todos los objetos que conocemos como los mundos, las estrellas, los seres vivos, las galaxias y las Nebulosas y, también, en aquellos que no podemos ver pero que, de seguro están ahí supeditados a esas interacciones que todo lo rigen y hacen de nuestro mundo el que todos conocemos.

:format(jpg)/f.elconfidencial.com%2Foriginal%2F2af%2F29e%2F4f2%2F2af29e4f29f75d82a780b0f96b351035.jpg)

Todo ello lo hemos podido discernir a lo largo de un proceso largo de observación y experimento y mucha intuición de mentes privilegiadas que presintieron donde se encontraban las respuestas. Nosotros, tenemos la suerte de encontrarnos ahora en una época más o menos avanzada y en la que contamos con tecnologías que nos llevarían mucho más allá del mundo que conocemos para adentrarnos en ese otro del futuro en el que, la Física, no tenga tantos secretos para nosotros y, si eso lo conseguimos, estaremos en un mundo mejor y conoceremos por fín, nuestro Universo y, de camino también a nosotros mismos…¡que falta hace!

Emilio Silvera Vázquez

Feb

6

¡La Hiperdimensionalidad! ¡Qué cosas nos cuentan!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (0)

Comments (0)

El “universo” de lo muy pequeño. ¡Resulta fasciante!

El cerebro tiene secretos que… ¡Nunca nos contará! Es parte de nosotros pero…

¡Un gran desconocido!

El 21 de diciembre de 2010 científicos estadounidenses descubrieron “un vimana atrapado en un pozo del tiempo“ (un campo gravitatorio electromagnético, que sólo puede ocurrir en una dimensión invisible del espacio) en la ciudad de Balkh, Afganistán, lugar que alguna vez Marco Polo catalogó como “una de las ciudades más nobles y grandiosas” del mundo”.

Los intentos por retirar el misterioso Vimana de la cueva donde había estado oculto durante por lo menos 5.000 años, causaron la “desaparición” de por lo menos 8 soldados norteamericanos, atrapados por el vórtex temporal ( nuestros cuerpos no pueden desplazarse como si nada del presente al futuro y del futuro al pasado sin cargarse el peso destructivo de las leyes de la física, salvo si se logra bloquear el campo magnético, algo que aparentemente los científicos norteamericanos tardaron ocho cadáveres en descubrir y solucionar, probablemente con jaulas de Faraday ).

La existencia de este tipo de fenómenos no está demostrado por los científicos (caso contrario estaríamos hablando de leyes), pero los físicos teóricos coinciden en general que podrían ser posibles si se acepta la teoría del Multiuniverso (un universo de por lo menos 11 dimensiones espaciotemporales) como estructura lógica y matemática. Atravesando esa especie de plasma líquido, nos podríamos trasladar a otros mundos, a otras galaxias.

Theodor Kaluza, ya en 1921 conjeturaba que si ampliáramos nuestra visión del universo a 5 dimensiones, entonces no habría más que un solo campo de fuerza: la gravedad, y lo que llamamos electromagnetismo sería tan sólo la parte del campo gravitatorio que opera en la quinta dimensión, una realidad espacial que jamás reconoceríamos si persistiéramos en nuestros conceptos de realidad lineal, similar a un holograma.

Bueno, independientemente de que todo esto pueda ser una realidad, lo cierto es que, nosotros, ahora en nuestro tiempo, hablamos de un universo con más dimensiones y, la carrera de las más altas dimensiones la inicio (como más arriba se menciona) en el año 1919 (no el 1921) por Theodor Kaluza, un oscuro y desconocido matemático, cuando le presentó a Einstein mediante un escrito una teoría unificada que podía unificar, las dos grandes teorías del momento, la Relatividad General con el Magnetismo y podía realizarse si elaboraba sus ecuaciones en un espacio-tiempo de cinco dimensiones.

Kaluza y la quinta dimensión

Así estaban las cosas cuando en 1.919 recibió Einstein un trabajo de Theodor Kaluza, un privatdozent en la Universidad de Königsberg, en el que extendía la Relatividad General a cinco dimensiones. Kaluza consideraba un espacio con cuatro dimensiones, más la correspondiente dimensión temporal y suponía que la métrica del espacio-tiempo se podía escribir como:

![]()

Así que, como hemos dicho, ese mismo año, Oskar Klein publicaba un trabajo sobre la relación entre la teoría cuántica y la relatividad en cinco dimensiones. Uno de los principales defectos del modelo de Kaluza era la interpretación física de la quinta dimensión. La condición cilíndrica impuesta ad hoc hacía que ningún campo dependiera de la dimensión extra, pero no se justificaba de manera alguna.

Klein propuso que los campos podrían depender de ella, pero que ésta tendría la topología de un círculo con un radio muy pequeño, lo cual garantizaría la cuantización de la carga eléctrica. Su diminuto tamaño, R5 ≈ 8×10-31 cm, cercano a la longitud de Planck, explicaría el hecho de que la dimensión extra no se observe en los experimentos ordinarios, y en particular, que la ley del inverso del cuadrado se cumpla para distancias r » R5. Pero además, la condición de periodicidad implica que existe una isometría de la métrica bajo traslaciones en la quinta dimensión, cuyo grupo U(1), coincide con el grupo de simetría gauge del electromagnetismo.

Einstein al principio se burló de aquella disparatada idea pero, más tarde, habiendo leido y pensado con más atenci`´on en lo que aquello podía significar, ayudó a Kaluza a publicar su idea de un mundo con cinco dimensiones (allí quedó abierta la puerta que más tarde, traspasarían los teóricos de las teorías de más altas dimensiones). Algunos años más tarde, , el físico sueco Oskar Klein publicó una versión cuántica del artículo de Kaluza. La Teoría Kaluza-Klein que resultó parecía interesante, pero, en realidad, nadie sabía que hacer con ella hasta que, en los años setenta; cuando pareció beneficioso trabajar en la supersimetría, la sacaron del baúl de los recuerdos, la desempolvaron y la tomaron como modelo.

Pronto, Kaluza y Klein estuvieron en los labios de todo el mundo (con Murray Gell-Mann, en su papel de centinela lingüístico, regañando a sus colegas que no lo sabían pronunciar “Ka-wu-sah-Klein”.

Pero, ¿Existen en nuestro Universo dimensiones ocultas?

Aunque la teoría de cuerdas en particular y la supersimetría en general apelaban a mayores dimensiones, las cuerdas tenian un modo de seleccionar su dimensionalidad requerida. Pronto se hizo evidente que la Teoría de cuerdas sólo sería eficaz, en dos, diez y veintiseis dimensiones, y sólo invocaba dos posibles grupos de simetría: SO(32) o E8 x E8. Cuando una teoría apunta hacia algo tan tajante, los científicos prestan atención, y a finales de los años ochenta había decenas de ellos que trabajaban en las cuerdas. Por aquel entonces, quedaba mucho trabajo duro por hacer, pero las perspectivas era brillantes. “Es posible que las décadas futuras -escribieron Schwarz y sus colaboradores en supercuerdas Green y Edward Witten- sea un excepcional período de aventura intelectual.” Desde luego, la aventura comenzó y, ¡qué aventura!

:format(jpg)/f.elconfidencial.com%2Foriginal%2F18c%2F14a%2F67e%2F18c14a67e5ebdacb39c531c9328ef1aa.jpg)

El mundo está definido por las Constantes adimensionales de la Naturaleza que hace el Universo que conocemos. Sin las Constantes sería otro Universo y la vida no estaría presente: El Ajuste Fino del Universo para que la vida esté en ´él.

Lo único que cuenta en la definición del mundo son los valores de las constantes adimensionales de la naturaleza (así lo creían Einstein y Planck). Si se duplica el valor de todas las masas no se puede llegar a saber, porque todos los números puros definidos por las razones de cualquier par de masas son invariables.

Puesto que el radio de compactificación es tan pequeño, el valor típico de las masas será muy elevado, cercano a la masa de Planck Mp = k-12 = 1’2 × 1019 GeV*, y por tanto, a las energías accesibles hoy día (y previsiblemente, tampoco en un futuro cercano – qué más quisieran E. Witten y los perseguidores de las supercuerdas -), únicamente el modo cero n = 0 será relevante. Esto plantea un serio problema para la teoría, pues no contendría partículas ligeras cargadas como las que conocemos.

¿Y si llevamos a Kaluza-Klein a dimensiones superiores para unificar todas las interacciones?

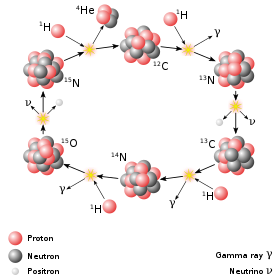

En este proceso llamado desintegración beta y debido a la interacción débil, un neutrón se transforma en un protón, un electrón y un (anti)neutrino electrónico cuando uno de los quarks del neutrón emite una partícula W–. Aquí queda claro que el término “interacción” es más general que “fuerza”; esta interacción que hace cambiar la identidad de las partículas no podría llamarse fuerza (todo representado en uno de los famosos diagramas de Feyman).

La descripción de las interacciones débiles y fuertes a través de teorías gauge no abelianas mostró las limitaciones de los modelos en cincodimensiones, pues éstas requerirían grupos de simetría mayores que el del electromagnetismo. En 1964 Bryce de UIT presentó el primer modelo de tipo Kaluza-Klein–Yang-Mills en el que el espacio extra contenía más de una dimensión.

El siguiente paso sería construir un modelo cuyo grupo de isometría contuviese el del Modelo Estándar SU(3)c × SU(2)l × U(1)y, y que unificara por tanto la gravitación con el resto de las interacciones.

Edward Witten demostró en 1981 que el número total de dimensiones que se necesitarían sería al menos de once. Sin embargo, se pudo comprobar que la extensión de la teoría a once dimensiones no podía contener fermiones quirales, y por tanto sería incapaz de describir los campos de leptones y quarks.

Por otra parte, la supersimetría implica que por cada bosón existe un fermión con las mismas propiedades. La extensión supersimétrica de la Relatividad General es lo que se conoce como supergravedad (supersimetría local).

Joël Scherk (1946-1980) (a menudo citado como Joel Scherk) fue un francés teórico físico que estudió la teoría de cuerdas ysupergravedad [1] . Junto con John H. Schwarz , pensaba que la teoría de cuerdas es una teoría de la gravedad cuántica en 1974. En 1978, junto con Eugène Cremmer y Julia Bernard , Scherk construyó el lagrangiano y supersimetría transformaciones parasupergravedad en once dimensiones, que es uno de los fundamentos de la teoría-M .

Unos años antes, en 1978, Cremmer, Julia y Scherk habían encontrado que la super-gravedad, precisamente en once dimensiones, tenía propiedades de unicidad que no se encontraban en otras dimensiones. A pesar de ello, la teoría no contenía fermiones quirales, como los que conocemos, cuando se compactaba en cuatro dimensiones. Estos problemas llevaron a gran parte de los teóricos al estudio de otro programa de unificación a través de dimensiones extra aún más ambicioso, la teoría de cuerdas.

No por haberme referido a ella en otros trabajos anteriores estará de más dar un breve repaso a las supercuerdas. Siempre surge algún matiz nuevo que enriquece lo que ya sabemos.

El origen de la teoría de supercuerdas data de 1968, cuando Gabriela Veneziano introdujo los modelos duales en un intento de describir las amplitudes de interacción hadrónicas, que en aquellos tiempos no parecía provenir de ninguna teoría cuántica de campos del tipo de la electrodinámica cuántica. Posteriormente, en 1979, Yaichiro Nambu, Leonard Susskind y Holger Nielsen demostraron de forma independiente que las amplitudes duales podían obtenerse como resultado de la dinámica de objetos unidimensionales cuánticos y relativistas dando comienzo la teoría de cuerdas.

En 1971, Pierre Ramona, André Neveu y otros desarrollaron una teoría de cuerdas con fermiones y bosones que resultó ser super-simétrica, inaugurando de esta forma la era de las supercuerdas.

David Jonathan Gross

Sin embargo, en 1973 David Gross, David Politzer y Frank Wilczek descubrieron que la Cromodinámica Cuántica, que es una teoría de campos gauge no abeliana basada en el grupo de color SU(3)c, que describe las interacciones fuertes en términos de quarks y gluones, poseía la propiedad de la libertad asintótica. Esto significaba que a grandes energías los quarks eran esencialmente libres, mientras que a bajas energías se encontraban confinados dentro de los hadrones en una región con radio R de valor R ≈ hc/Λ ≈ 10-13 cm.

Dicho descubrimiento, que fue recompensado con la concesión del Premio Nobel de Física a sus autores en 2.004, desvió el interés de la comunidad científica hacia la Cromodinámica Cuántica como teoría de las interacciones fuertes, relegando casi al olvido a la teoría de supercuerdas.

Se habla de cuerdas abiertas, cerradas o de lazos, de p branas donde p denota su dimensionalidad (así, 1 brana podría ser una cuerda y 2.Brana una membrana) o D-Branas (si son cuerdas abiertas) Y, se habla de objetos mayores y diversos que van incorporados en esa teoría de cuerdas de diversas familias o modelos que quieren sondear en las profundidades del Universo físico para saber, como es.

En la década de los noventa se creó una versión de mucho éxito de la teoría de cuerdas. Sus autores, los físicos de Princeton David Gross, Emil Martinec, Jeffrey Harvey y Ryan Rohn, a quienes se dio en llamar el cuarteto de cuerdas de Princeton.

El de más edad de los cuatro, David Gross, hombre de temperamento imperativo, es temible en los seminarios cuando al final de la charla, en el tiempo de preguntas, con su inconfundible vozarrón dispara certeros e inquisidoras preguntas al ponente. Lo que resulta sorprendente es el hecho de que sus preguntas dan normalmente en el clavo.

Gross y sus colegas propusieron lo que se denomina la cuerda heterótica. Hoy día, de todas las variedades de teorías tipo Kaluza-Klein que se propusieron en el pasado, es precisamente la cuerda heterótica la que tiene mayor potencial para unificar todas las leyes de la naturaleza en una teoría. Gross cree que la teoría de cuerdas resuelve el problema de construir la propia materia a partir de la geometría de la que emergen las partículas de materia y también la gravedad en presencia de las otras fuerzas de la naturaleza.

Cuando los Físicos de cuerdas trabajan con las ecuaciones de campo de esta teoría, sin que nadie las llame, como por arte de magia… ¡Allí aparecen las ecuaciones de campo de la Relatividad General!

El caso curioso es que, la Relatividad de Einstein, subyace en la Teoría de cuerdas, y, si eliminamos de esta a aquella y su geometría de la Gravedad…todo resulta inútil. El gran Einstein está presente en muchos lugares y quizás, más de los que nos podamos imaginar.

Es curioso constatar que si abandonamos la teoría de la gravedad de Einstein como una vibración de la cuerda, entonces la teoría se vuelve inconsistente e inútil. Esta, de hecho, es la razón por la que Witten se sintió atraído inicialmente hacia la teoría de cuerdas. En 1.982 leyó un artículo de revisión de John Schwarz y quedó sorprendido al darse cuenta de que la gravedad emerge de la teoría de supercuerdas a partir solamente de los requisitos de auto consistencia. Recuerda que fue “la mayor excitación intelectual de mi vida”.

Gross se siente satisfecho pensando que Einstein, si viviera, disfrutaría con la teoría de supercuerdas que sólo es válida si incluye su propia teoría de la relatividad general, y amaría el hecho de que la belleza y la simplicidad de esa teoría proceden en última instancia de un principio geométrico, cuya naturaleza exacta es aún desconocida.atividad general de Einstein. Nos ayuda a estudiar las partes más grandes del Universo, como las estrellas y las galaxias. Pero los elementos diminutos o los átomos y las partículas subatómicas se rigen por unas leyes diferentes denominadas mecánica cuántica.

Einstein se aventuró a la búsqueda de la Teoría del Todo

Claro que, como todos sabemos, Einstein se pasó los últimos treinta años de su vida tratando de buscar esa teoría unificada que nunca pudo encontrar. No era consciente de que, en su tiempo, ni las matemáticas necesarias existían aún. En la historia de la física del siglo XX muchos son los huesos descoloridos de teorías que antes se consideraban cercanas a esa respuesta final que incansables buscamos.

Hasta el gran Wolfgang Pauli había colaborado con Heisenberg en la búsqueda de una teoría unificada durante algún tiempo, pero se alarmó al oir en una emisión radiofónica como Heisenberg decía: “Está a punto de ser terminada una Teoría unificada de Pauli-Heisenserg, en la que sólo nos queda por elaborar unos pocos detalles técnicos.”

Wolfgang Pauli

Enfadado por lo que consideraba una hipérbole de Heisenberg que se extralimitó con aquellas declaraciones en las que lo inviolucraba sin su consentimiento, Pauli envió a Gamow y otros colegas una simple hija de papel en blanco en la que había dibujado una caja vacía. Al pie del dibujo puso estas pablabras: “Esto es para demostrar al mundo que yo puedo pintar con Tiziano. Sólo faltan algunos detalles técnicos.”

Los críticos del concepto de supercuerdas señalaron que las afirmaciones sobre sus posibilidades se basaban casi enteramente en su belleza interna. La teoría aún no había repetido siquiera los logros del Modelo Estándar, ni había hecho una sola predicción que pudiera someterse a prueba mediante el experimento. La Supersimetría ordenaba que el Universo debería estar repleto de familias de partículas nuevas, entre ellas los selectrones (equivalente al electrón supersimétrico) o el fotino (equivalente al fotón).

Lo cierto es que, nada de lo predicho ha podido ser comprobado “todavía” pero, sin embargo, la belleza que conlleva la teoría de cuerdas es tal que nos induce a creer en ella y, sólo podemos pensar que no tenemos los medios necesarios para comprobar sus predicciones, con razón nos dice E. Witten que se trata de una teoría fuera de nuestro tiempo, las supercuerdas pertenecen al futuro y aparecieron antes por Azar.

Y, a todo esto, ¿Dónde están esas otras dimensiones?

¿Compactadas en el límite de Planck?

Emilio Silvera Vázquez

Feb

6

Unidades Adimensionales

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en Física ~

Clasificado en Física ~

Comments (2)

Comments (2)

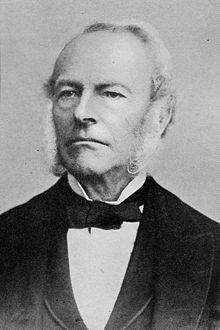

George Johnstone Stoney (º825-1911) nació el 15 de febrero del año 1826 en Londres. Es un físico y matemático irlandés. Estudió la estructura de la materia, y se dedicó a realizar una primera evaluación del número de Avogadro. En 1874 estableció la hipótesis según la cual la electricidad era creada por unos corpúsculos elementales que llamó electrones, cuya carga intentó calcular.

Su trabajo científico más importante fue el cálculo de la magnitud del «átomo de electricidad». En 1891 propuso el término electrón para describir la unidad fundamental de carga eléctrica, el electrón mismo fue descubierto por JJ Thomson en 1897.

En 1891, Stoney sugirió un nombre para la unidad fundamental de electricidad, fuese o no una partícula. Sugirió el nombre de electrón (nombre griego del ámbar, resina fósil que adquiere una carga eléctrica negativa al ser frotada con un paño), al analizar fenómenos electrolíticos y que se refería a las unidades de electricidad que un átomo perdía al transformarse en un ión. Stoney identificó las unidades naturales de las cantidades físicas.

En 1897 el físico británico Joseph John Thomson descubrió el electrón, cuya existencia había predicho ya en 1891 su compatriota George Johnstone Stoney.

Stoney falleció el 5 de julio del año 1911.

Sus fórmulas fueron:

Stoney, podemos decir con seguridad, fue el primer que señaló el camino para encontrar lo que más tarde conoceríamos como constantes fundamentales, esos parámetros de la física que son invariantes, aunque su entorno se transforme, ellas, las constantes, continúan inalterables, como sucede, por ejemplo, con la velocidad de la luz c, que sea medida en la manera que sea, esté en reposo o esté en movimiento quien la mide o la fuente de donde parte, su velocidad será siempre la misma, 299.792.458 m/s. Algo análogo ocurre con la Gravedad, G, que en todas partes mide el mismo parámetro o valor: G = 6,67259 × 10-11 m3 s-2 Kg-1. Es la fuerza de atracción que actúa entre todos los cuerpos y cuya intensidad depende de la masa de los cuerpos y de la distancia entre ellos; la fuerza gravitacional disminuye con el cuadrado de la distancia de acuerdo a la ley de la inversa del cuadrado.

Profesor de filosofía natural (así llamaban antes a la Física) en el Queen’s Collegue Galway en 1860, tras su retiro se trasladó a Hornsey, al norte de Londres, y continuó publicando un flujo de artículos en la revista científica de la Royal Dublín Society, siendo difícil encontrar alguna cuestión sobre la que no haya un artículo firmado por él.

Stoney recibió el encargo de hacer una exposición científica del tema que el mismo eligiera para algún fenómeno físico que él mismo eligiera para el programa de la reunión de Belfast de la Asociación Británica. Pensando en que tema elegir, se dio cuenta de que existían medidas y patrones e incluso explicaciones diferentes para unidades que median cosas distancias o fómeno: Se preguntaba la manera de cómo definirlos mejor y como interrelacionarlos. Vio una oportunidad para tratar de simplificar esta vasta confusión de patrones humanos de medida de una manera tal que diese más peso a su hipótesis del electrón.

En tal situación, Stoney centró su trabajo en unidades naturales que transcienden los patrones humanos, así que trabajó en la unidad de carga electrónica (según su concepto), inspirado en los trabajos de Faraday como hemos dicho en otras ocasiones.

En su charla de la Reunión de Belfast, Stoney se refirió al electrón como el “electrino” como hemos comentado antes. También, como unidades naturales escogió G y C que responde, como se ha explicado, a la Gravedad Universal y la velocidad de la luz en el vacío.

Totales: 75.009.437

Totales: 75.009.437 Conectados: 2

Conectados: 2