May

29

Velocidades asombrosas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

Lo cierto es que hablamos de ellas pero… ¡Sin llegar a comprender!

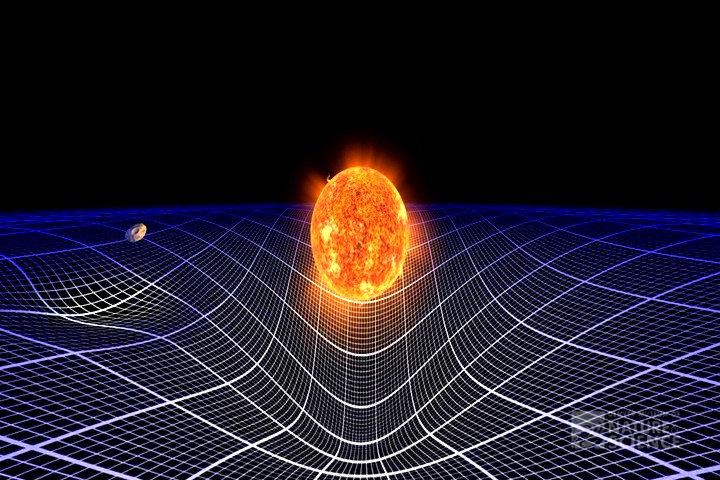

Las velocidades en el universo se dividen principalmente en dos categorías: el movimiento de objetos dentro del espacio y la expansión del propio espacio. El movimiento de los objetos está limitado por la velocidad de la luz (300.000 km/s), pero la expansión del universo en sí mismo puede superar esta velocidad, lo que hace que el espacio entre galaxias se expanda de forma acelerada, un concepto que no viola las leyes de la relatividad.

No siempre hablamos de lo que realmente comprendemos.

¿Cómo tener en la Mente de la “imagen” de algo que se mueve a velocidades que ni podemos imaginar?

Y, si nos detenemos a pensar en la expansión del Universo… ¡Es para volverse loco!

¡La Física! Lo que busca la física fundamental es reducir las leyes de la naturaleza a una teoría final sencilla que lo explique todo. El físico y premio Nobel Steven Weinberg señala que las reglas fundamentales son lo más satisfactorio (al menos para él). Las leyes básicas de Isaac Newton, que predicen el comportamiento de los planetas, son más satisfactorias, por ejemplo, que un almanaque en el que se indique la posición de todos los planetas en cada momento. Weinberg nos dice que la Física no puede explicarlo todo, matizando que sólo puede explicar los sucesos relacionándolos con otros sucesos y con las reglas existentes.

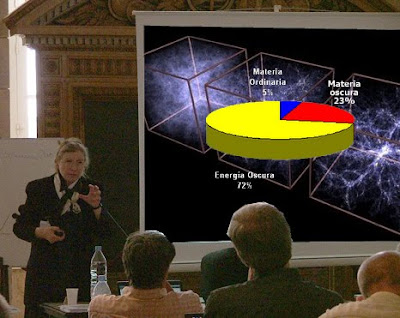

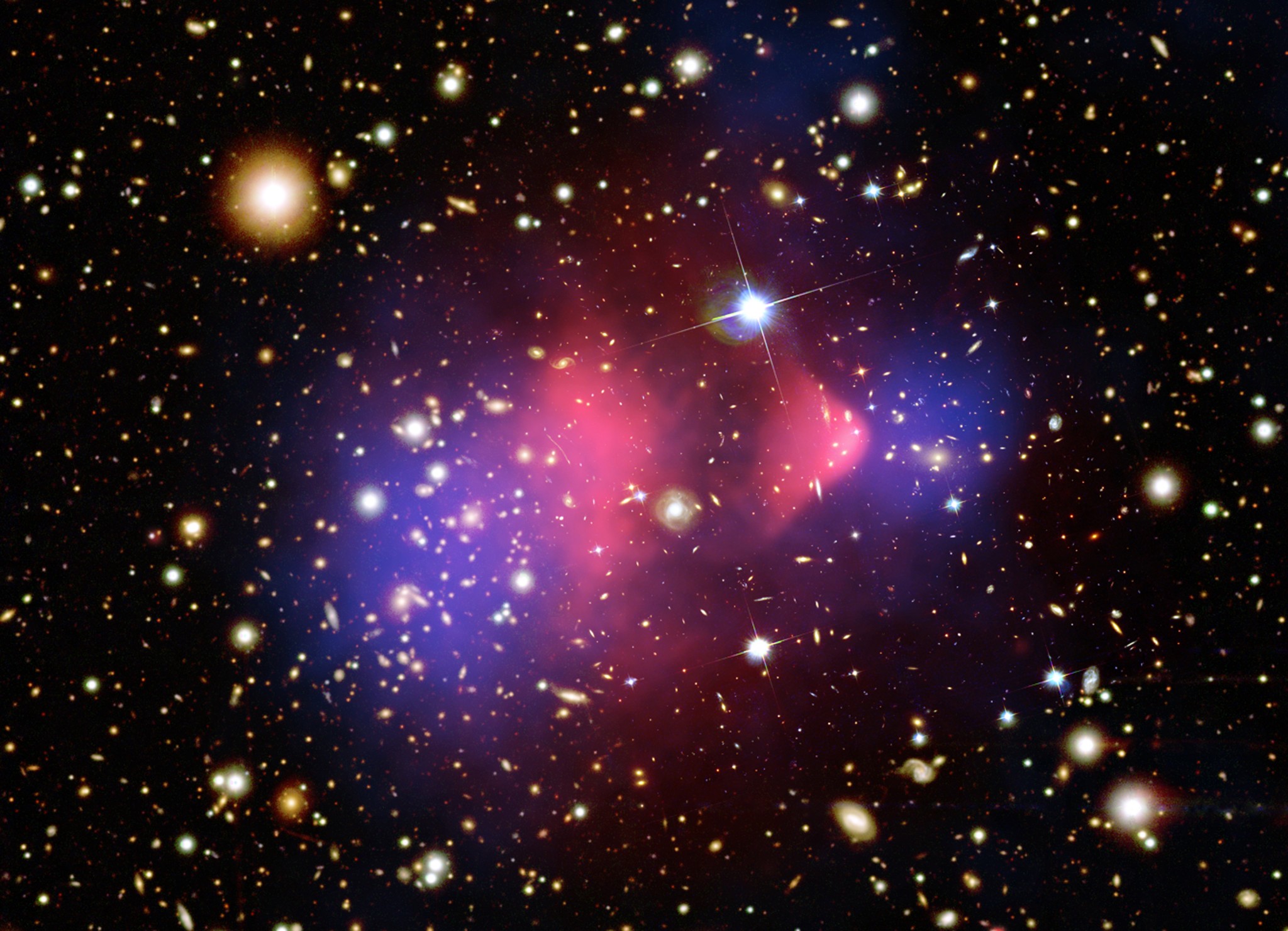

¿La “materia oscura”? Como decía un gran físico: “Es la alfombra bajo la cual, los cosmólogos, barren su ignorancia”.

En relación al Universo, los cosmólogos también echan mano de conjeturas que les salve la cara, es decir, que disimule su gran ignorancia, y, se inventaron la “materia oscura” para explicar lo que para ellos, era inexplicable, es decir, el movimiento de las estrellas y el por qué se alejan las galaxias las unas de las otras y qué fuerza es la que las atrae y, no encontraron nada mejor que la materia oscura.

Por ejemplo, las órbitas de los planetas son el resultado de unas reglas, pero las distancias de los planetas al Sol son accidentales, y no son consecuencia de ley fundamental alguna. Claro que, también las leyes podrían ser fruto de casualidades. Lo que sí es cierto es que los físicos están más interesados por descubrir las reglas que por los sucesos que dichas reglas determinan, y más por los hechos que son independientes del tiempo; por ejemplo, les interesa más la masa del electrón que un tornado que se pueda producir en un lugar determinado.

Nunca podremos saberlo todo

La ciencia, como nos dice Weinberg, no puede explicarlo todo y, sin embargo, algunos físicos tienen la sensación de que nos estamos acercando a “una explicación del mundo” y, algún día, aunando todos los esfuerzos de muchos, las ideas de las mejores mentes que han sido, y las nuevas que llegarán, podremos, al fin, construir esa Teoría final tan largamente soñada que, para que sea convincente, deberá también, incluirnos a nosotros. Pero, paradójicamente y a pesar de estos pensamientos, existen hechos que los contradicen, por ejemplo, conocemos toda la física fundamental de la molécula de agua desde hace 7 decenas de años, pero todavía no hay nadie que pueda explicar por qué el agua hierve a los 100 ºC. ¿Qué ocurre? ¿Somos acaso demasiado tontos? Bueno, me atrevería a pronosticar que seguiremos siendo “demasiado tontos” incluso cuando los físicos consigan (por fin) esa teoría final que nos pueda dar una “explicación del mundo”. Siempre seguiremos siendo aprendices de la naturaleza que, sabia ella, nos esconde sus secretos para que persista el misterio.

Cuanto más puedo saber, más consciente soy de lo poco que se. Estoy continuamente planteándome nuevas preguntas, y, si no las puedo contestar, busco las respuestas y no descanso hasta encontrar alguna explicación convincente. En caso contrario, a seguir buscando.

¿Qué sería de nosotros si lo supiéramos todo?

Si supiéramos absolutamente todo, es muy probable que la experiencia humana tal como la conocemos —impulsada por la búsqueda, el asombro y el aprendizaje— se detuviera. La mayoría de los análisis filosóficos y reflexiones sugieren que caeríamos en una forma profunda de hastío, perdiendo la curiosidad, ya que esta se alimenta de la incertidumbre.

La explicación que dan los físicos actualmente sobre la subestructura de la materia se llama “el modelo estándar”. En este modelo están incluidas las doce partículas elementales y las tres fuerzas que, cuando se mezclan y se encajan, sirven para construir todo lo que hay en el universo, desde un redondo pan de pueblo hecho en un horno de leña, hasta las más complejas galaxias, y puede explicar todos los mecanismos de acción, es decir, la mecánica del mundo.

Entre las partículas figuran los seis Quarks famosos: arriba, abajo, extraño, encanto, fondo y cima. Las otras seis partículas son Leptones: el electrón y sus dos parientes más pesados, el muón y el tau y los tres neutrinos a ellos asociados. Las tres fuerzas son la electromagnética, la fuerza nuclear fuerte (que mantiene unidos a los quarks) y la fuerza nuclear débil (responsable de la radioactividasd). Hay una cuarta fuerza: la Gravedad que, aunque tan importante como las demás, nadie ha sabido como encajarla en el modelo estándar. Todas las partículas y fuerzas de este modelo son cuánticas; es decir, siguen las reglas de la mecánica cuántica. Aún no existe una teoría de la gravedad cuántica.

En realidad, la región que denominamos Gravedad cuántica nos lleva y comprende preguntas sobre el origen del universo observable que nadie ha sabido contestar. Nos lleva a complejos procesos cuánticos situados en las épocas más cercanas imaginables en un espacio-tiempo clásico, es decir, en lo que se conoce como Tiempo de Planck a 10-43 segundos del supuesto Big Bang, cuando reinaba una temperatura del orden de 10 x 1031 K. Pero, como hemos dicho, al no existir una teoría auto-consistente de la Gravedad cuántica, lo único que podemos hacer (como en tantas otras áreas de la Ciencia) es especular.

El Modelo Estándar no es, ni mucho menos, satisfactorio. Los científicos piensan que no sólo es incompleto, sino que es demasiado complicado y, desde hace mucho tiempo, buscan, incansables, otro modelo más sencillo y completo que explique mejor las cosas y que, además, no tenga (como tiene el modelo actual) una veintena de parámetros aleatorios y necesarios para que cuadren las cuentas…, un ejemplo: el bosón de Higgs necesario para dar masa a las partículas.

¡La masa! ese gran problema. Todas las partículas tienen masa diferentes pero nadie sabe de donde salen sus valores. No existe fórmula alguna que diga, por ejemplo, que el quark extraño debería pesar el doble (o lo que sea) del quark arriba, o que el electrón deba tener 1/200 (u otra proporción) de la masa del muón. Las masas son de todo tipo y es preciso “ponerlas a mano”, como se suele decir: cada una ha de ser medida experimental e individualmente. En realidad, ¿por qué han de tener masa las partículas? ¿de dónde viene la masa?

Sí, ya sabemos lo del Bosón de Higgs y que las partículas (según nos han dicho) adquieren su masa en el campo de Higgs pero…

No puedo evitarlo ni tampoco me puedo quedar callado, cuando he asistido a alguna conferencia sobre la materia y, el ponente de turno se agarra a la “materia oscura” para justificar lo que no sabe, si al final hay debate, entro en escena para discutir sobre la existencia de esa “materia fantasma” que quiere tapar nuestra enorme ignorancia.

Pero, sigamos con el problema de la masa. Para resolverlo, muchos expertos en física de partículas creen actualmente en algo que llaman “campo de Higgs”. Se trata de un campo misterioso, invisible y etéreo que está permeando todo el espacio (¿habrán vuelto al antiguo éter pero cambiándole el nombre?). Hace que la materia parezca pesada, como cuando tratamos de correr por el fondo de la piscina llena de agua pero que el agua no se pudiera ver. Si pudiéramos encontrar ese campo, o más bien la partícula la partícula que se cree es la manifestación de ese campo (llamada el bosón de Higgs), avanzaríamos un largo trecho hacia el conocimiento del universo. Sí, ya se que hace un par de años dijeron haberla encontrado y, sin embargo yo, todavía tengo dudas al respecto, no acabo de convencerme de su existencia y de cómo da la masa a las otras partículas, el mecanismo para mí no ha quedado nada claro.

Aquí, en este imponente artilugio inventiva de nuestras mentes, se quiere dar respuesta a una serie de interrogantes que se espera solucionar con este experimento:

• Qué es la masa.

• El origen de la masa de las partículas

• El origen de la masa para los bariones.

• El número exacto de partículas del átomo.

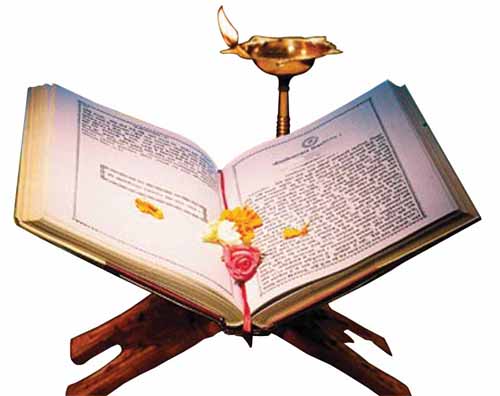

Claro que, si no fuera tan largo de contar, os diría que, en realidad, el Campo de Higgs se descubrió hace ya muchos siglos en la antigua India, con el nombre de maya, que sugiere la idea de un velo de ilusión para dar peso a los objetos del mundo material. Pocos conocen que, los hindúes fueron los que más se acercaron a las ideas modernas sobre el átomo, la física cuántica y otras teorías actuales. Ellos desarrollaron muy temprano sólidas teorías atomistas sobre la materia. Posiblemente, el pensamiento atomista griega recibió las influencias del pensamiento de los hindúes a través de las civilizaciones persas. El Rig-Veda, que data de alguna fecha situada entre el 2000 y el 1500 a. C., es el primer texto hindú en el que se exponen unas ideas que pueden considerarse leyes naturales universales. La ley cósmica está realcionada con la luz cósmica.

Anteriores a los primeros Upanishads tenemos en la India la creación de los Vedas, visiones poéticas y espirituales en las que la imaginación humana ve la Naturaleza y la expresa en creación poética, y después va avanzando hacia unidades más intensamente reales que espirituales hasta llegar al Brahmán único de los Upanishads.

Hacia la época de Buda (500 a, C.), los Upanishad, escritos durante un período de varios siglos, mencionaban el concepto de svabhava, definido como “la naturaleza inherente de los distintos materiales”; es decir, su eficacia causal única, , tal como la combustión en el caso del fuego, o el hecho de fluir hacia abajo en el caso dela agua. El pensador Jainí Bunaratna nos dijo: “Todo lo que existe ha llegado a existir por acción de la svabhava. Así… la tierra se transforma en una vasija y no en paño… A partir de los hilos se produce el paño y no la vasija”.

También aquellos pensadores, manejaron el concepto de yadrccha, o azar desde tiempos muy remotos. Implicaba la falta de orden y la aleatoriedad de la causalidad. Ambos conceptos se sumaron a la afirmación del griego Demócrito medio siglo más tarde: “Todo lo que hay en el universo es fruto del azar y la necesidad”. El ejemplo que que dio Demócrito -similar al de los hilos del paño- fue que, toda la materia que existe, está formada por a-tomos o átomos.

Bueno, no lo puedo evitar, mi imaginación se desboca y corre rápida por los diversos pensamientos que por la mente pasan, de uno se traslada a otros y, al final, todo resulta un conglomerado de ideas que, en realidad, quieren explicar, dentro de esa diversidad, la misma cosa.

¿Qué sabemos nosotros? Si, hemos logrado saber un poquito de algunas cosas. Sin embargo, ignoramos una gran cantidad de otras, y, como somos seres muy curiosos, nos proponemos perseguir esas respuestas que nadie nos sabe dar y que están profundamente escondidas en las entrañas de la Naturaleza.

Emilio Silvera V.

May

29

Se cuentan cosas que… ¡Están cuajadas de “Licencias...

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

Hasta donde sabemos, las estrellas han estado diez mil millones de años fusionando elementos simples en otros más complejos, hasta que la materia “inerte” evolucionó hasta las ideas, pensamientos, y, sobre todo, hasta los sentimientos.

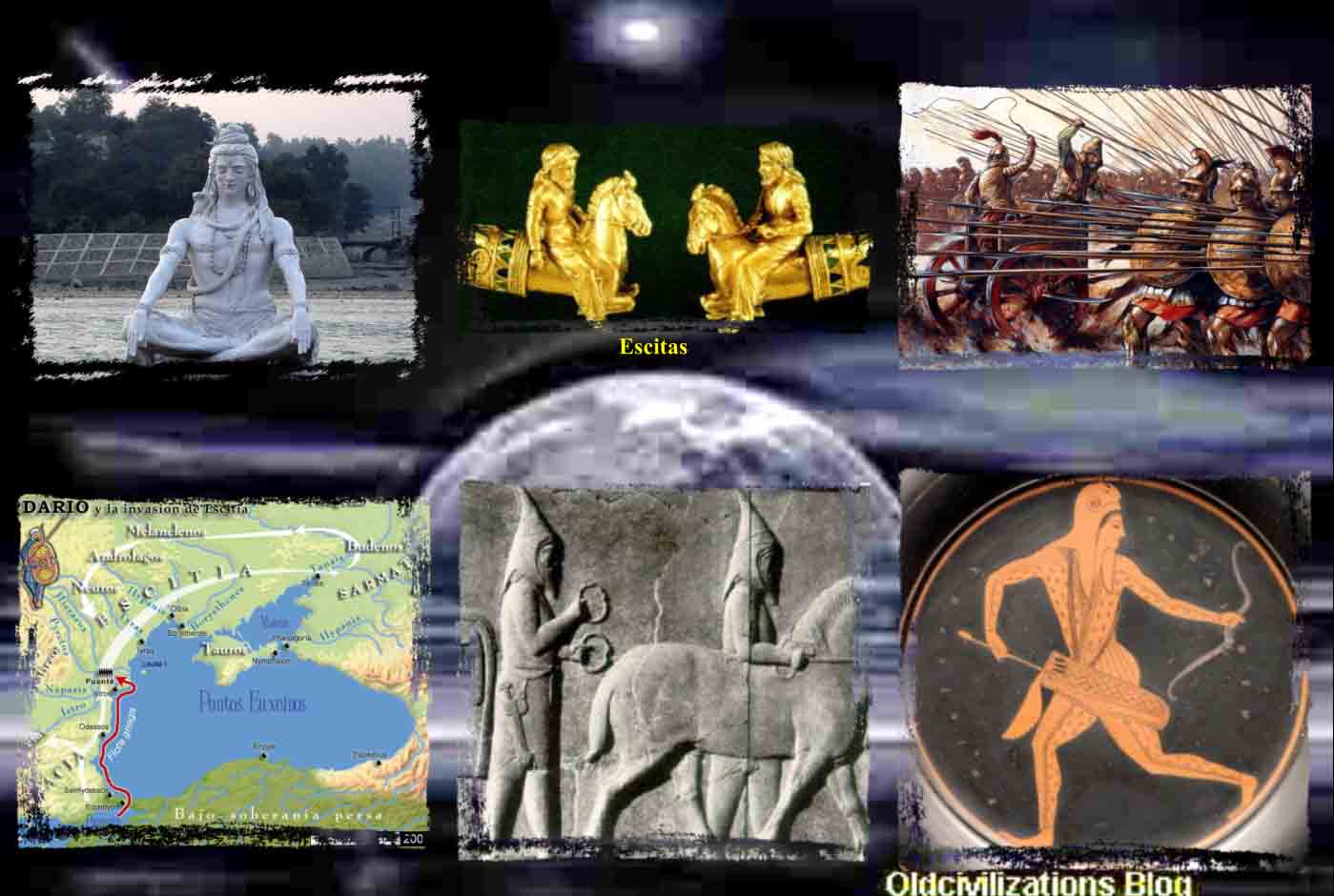

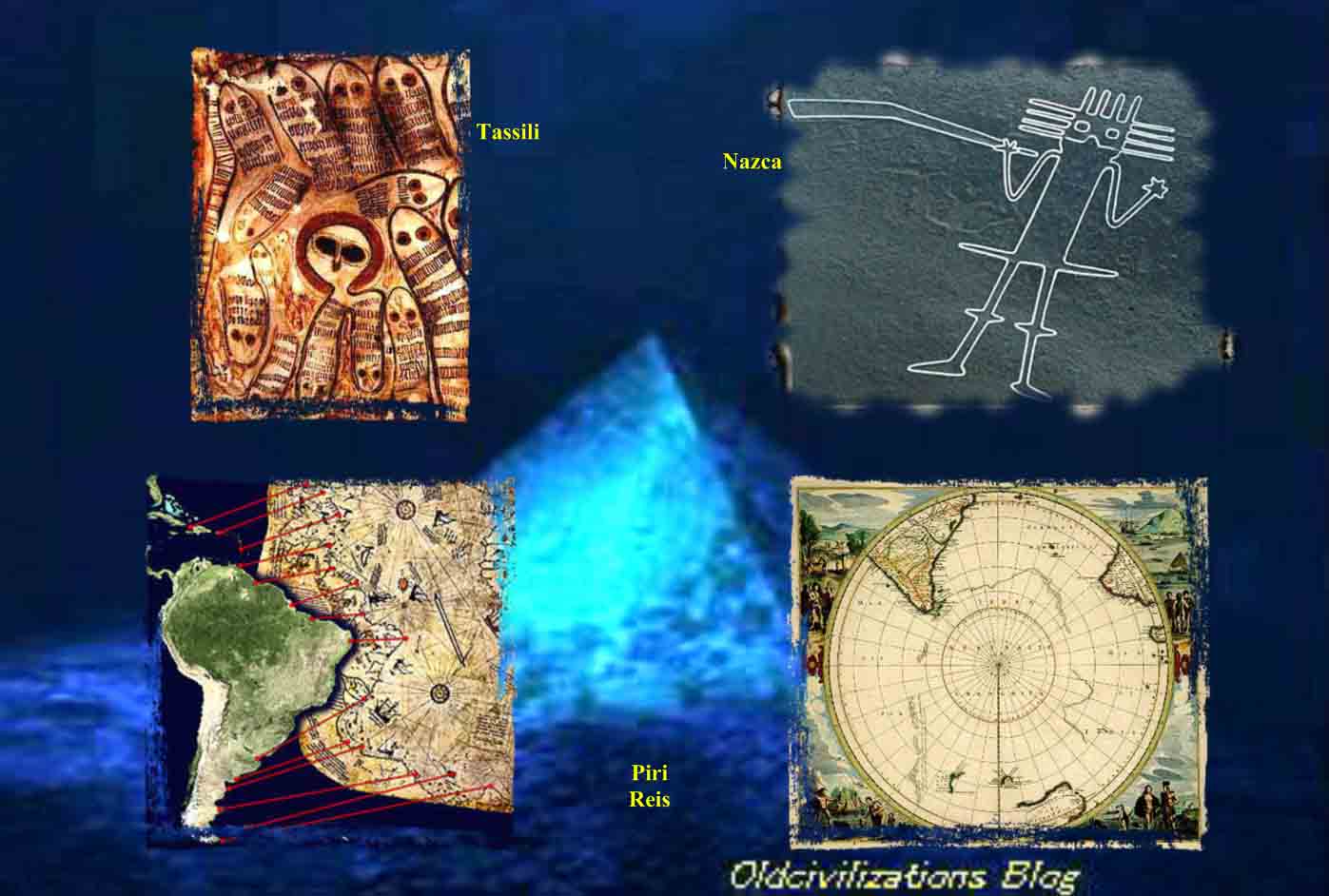

De las Civilizaciones anteriores a nosotros, ya sabemos de aquellos pueblos:

Han existido innumerables civilizaciones a lo largo del mundo, pero algunas de las más destacadas incluyen las antiguas Mesopotamia, Egipto, India y China, conocidas como “civilizaciones fluviales” por su desarrollo a la orilla de grandes ríos. También son notables la Antigua Grecia, Antigua Roma, la civilización Maya y la Inca, además de otras como los fenicios y los hititas.

Más allá de estos pueblos de los que tenemos pruebas materiales de su existencia y de sus costumbres e intelectos en los diferentes órdenes del saber humano… No tenemos más datos que nos lleven a la existencia de otras civilizaciones inteligentes.

También hemos podido estudiar los restos fósiles de nuestros ancestros, y hemos seguido la intrincada y larga senda recorrida hasta llegar a nuestros días. ¿Qué en toda este viaje de la evolución existen algunos rincones oscuros? Ninguna duda nos puede caber.

Hasta donde podemos saber : El comienzo de la especie humana se remonta al Continente Africano, donde el Homo Sapiens evolucionó, según parece, hace unos 300.000 años. Este proceso es parte de una evolución más larga que comenzó hace millones de años con ancestros comunes a los grandes simios, como los primeros homínidos del género Homo. La evolución del Homo sapiens en África y su posterior migración a otras partes del mundo marcan la historia de la humanidad.

Se ha confirmado que el Chimpancé y el Humano tuvieron un ancestro común que no era ni Homo ni Pan. Y, no podemos explicar el por qué, mientras el uno está pensando en viajar a las estrellas, el otro continúa en la copa de los árboles.

Existieron de verdad aquellas Civilizaciones de la Atlántida y Tartessos

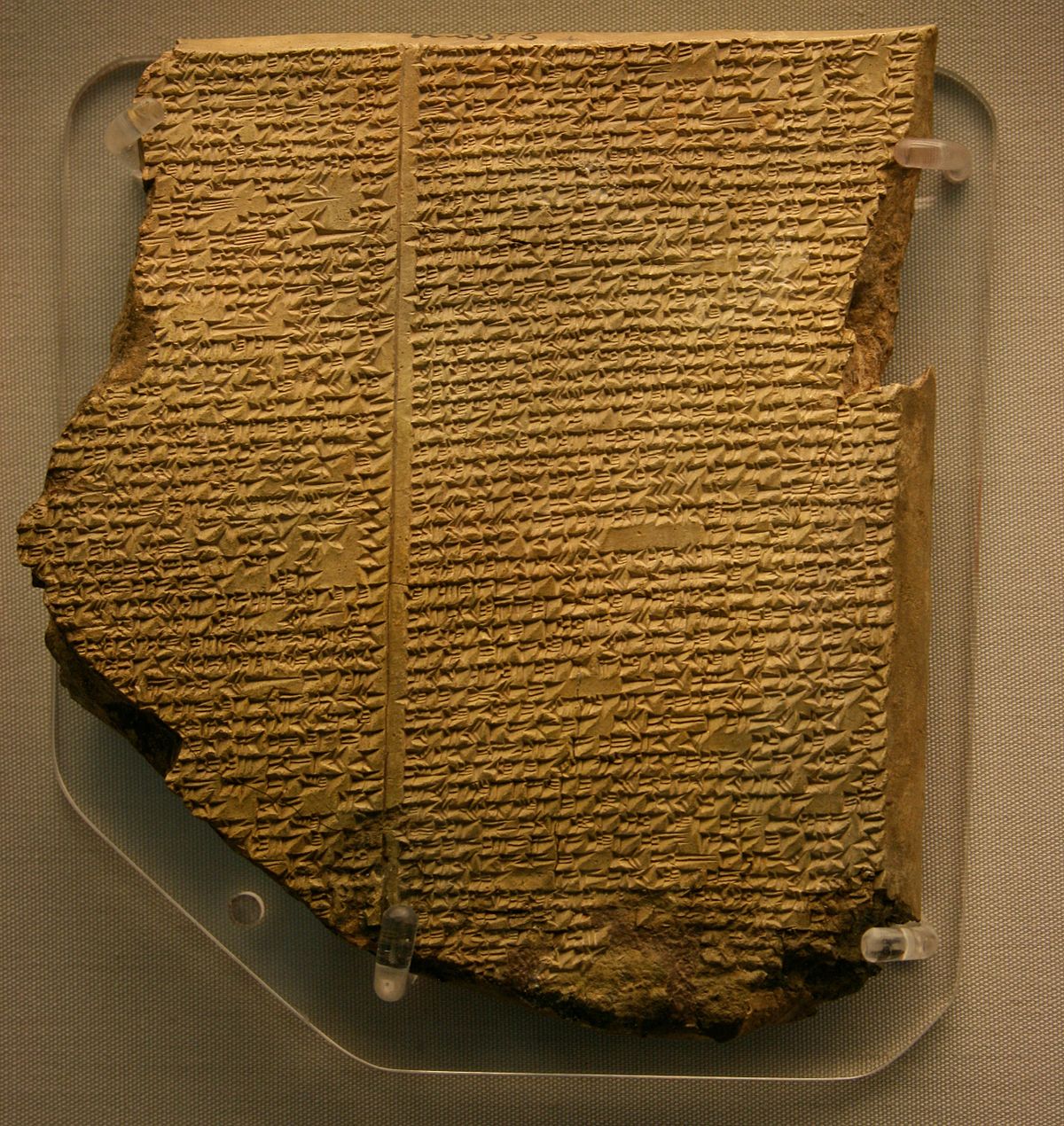

Todos, alguna vez, hemos oído contar “historias” referidas a esta ciudad mágica. Historias de la Epopeya de Gilgamesh y la Atlántida. Seres que surcaban los cielos en grandes naves, el Diluvio, el hundimiento de la gran ciudad…

Me maravilla la riqueza que atesoramos y la experiencia que la Humanidad ha podido tener a lo largo y a lo ancho de sus milenarias vivencias sobre este planeta.

Mi debilidad está en leer y enterarme de las cosas, sin límite de cuestiones a tratar, aunque sí con preferencias. Lo he tocado todo de manera más o menos profunda, y una vez pude leer (no recuerdo ahora dónde) que la mitología y los escritos antiguos nos hacen saber que el último día de la Atlántida se vio marcado por una inmensa catástrofe. Olas tan altas como montañas, huracanes, explosiones volcánicas… sacudieron el planeta entero. La civilización sufrió un retroceso y la Humanidad superviviente quedó reducida a un estado de barbarie.

Las leyendas de las distintas Civilizaciones Humanas, nos hablan de Diluvios

Las tablas sumerias de Gilgamés hablan de Utnapichtiun, primer antepasado de la Humanidad actual, que fue, con su familia, el único superviviente de un inmenso diluvio. Encontró refugio en un arca para sus parientes, para animales y pájaros. El relato bíblico del Arca de Noé parece ser una versión tardía de esa misma historia.

El Zend-Avesta iranio nos proporciona otro relato de la misma leyenda del diluvio. El dios Ahuramazda ordenó a Yima, patriarca persa, que se preparara para el diluvio. Yima abrió una cueva, donde durante la inundación, fueron encerrados los animales y las plantas necesarias para los hombres. Así fue como pudo renacer la civilización después de las destrucciones ocasionadas por el diluvio.

Según algunos estudiosos, la salida del país condenado de la Atlántida fue realizada en barco y por los aires. De apariencia fantástica, esta teoría se apoya en numerosas tradiciones históricas.

Existe entre los esquimales una curiosa leyenda, según la cual habrían sido transportados al norte glacial por gigantescos pájaros metálicos. ¿No es pasa pensar en la existencia de una especie de aviones en aquella época prehistórica? ¡Qué locura!

En esta tablilla se cuenta la Historia de aquel Diluvio

“Una nube negra se elevó de los confines del cielo.

Todo lo que era claro se volvió oscuro.

El hermano no ve a su hermano.

Los habitantes del cielo no se reconocen.

Los dioses temían al diluvio.

Huyeron y ascendieron al cielo de Anu.”

:format(jpg)/f.elconfidencial.com%2Foriginal%2Fc85%2Fc47%2Ff8b%2Fc85c47f8b51f09fddea608fd53ed5b5d.jpg)

En el 95 por ciento de más de doscientas leyendas del diluvio, el diluvio fue universal; en el 88 por ciento, una familia fue salva; en el 70 por ciento, la supervivencia fue por medio de un barco; en el 67 por ciento, también se salvó a los animales; en el 66 por ciento, el diluvio se debió a la maldad del hombre; en el 66 por ciento, los sobrevivientes habían sido prevenidos; en el 57 por ciento, terminaron en una montaña; en el 35 por ciento, se enviaron aves del barco; y en el 9 por ciento, exactamente ocho personas se salvaron.”

¿Quiénes eran esos habitantes del cielo? ¿Quiénes eran los dioses que temían al diluvio y se refugiaron en los cielos? Si hubieran sido seres etéreos no se habrían sentido aterrorizados por el furor de los elementos. Cabe suponer que estos habitantes no eran otros que los jefes atlantes que tenían ingenios voladores, o incluso astronaves, a su disposición. ¡Una locura!

Según la religión sumeria, el cielo de Anu era la sede de Anu, padre de los dioses. Su significado estaba asociado con las palabras “grandes alturas” y “profundidades”, lo que hoy llamamos “el espacio”. Los hombres del cielo partieron al espacio; tal es nuestra interpretación hoy de este desconcertante pasaje del canto épico.

El libro de Dzyan, recibido hace más de cien años por Hélène Blavatsky en un ermita del Himalaya, podría ser una página perdida de la historia de la Humanidad:

“Sobrevinieron las primeras grandes aguas y devoraron las siete grandes islas. Todo lo que era santo fue salvado; todo lo que era impuro fue aniquilado.”

Un antiguo comentario de este libro explica con perfecta claridad el modo en que se produjo el éxodo de la Atlántida.

Todos huyeron y quedó abandonado el imperio

En previsión de la catástrofe inevitable, el Gran Rey, “de rostro deslumbrante”, jefe de los hombres esclarecidos de la Atlántida, envió sus navíos del aire a los jefes, sus hermanos, con el mensaje siguiente: Levantaos y preparaos, hombres de la Buena Ley, y atravesad la Tierra mientras todavía está seca.

La ejecución de este plan debió mantenerse secreta a los poderosos y malvados jefes del imperio. Entonces, durante una noche oscura, mientras el pueblo de la Buena Ley se hallaba ya a salvo del peligro de la inundación, el Gran Rey reunió a sus vasallos, escondió su “rostro deslumbrante” y lloró. Cuando sonó la hora, los príncipes embarcaron en vimanas (naves aéreas) y siguieron a sus tribus a los países del este y del norte, a África y a Europa. Entretanto, gran número de meteoritos cayeron en masa, como bolas de fuego, sobre el reino de la Atlántida, donde dormían los “impuros”.

Si bien que, la posibilidad de un éxodo de la Atlántida por vía aérea no debe ser necesariamente aceptada, merece, no obstante, ser objeto de examen profundo y científico.

Es curioso constatar que en la Enciclopedia de los viajes interplanetarios, publicada en la URSS por el profesor N. A. Rynin, una ilustración en la misma refleja a los grandes sacerdotes atlantes elevándose en avión, mientras al fondo, la Atlántida se hunde en los mares.

Los babilonios han conservado el recuerdo de astronautas o de aviadores prehistóricos en la persona de Etana, el hombre volador. El museo de Berlín posee un sello cilíndrico en el que aparece atravesando los aires a lomos de un águila, entre el Sol y la Luna.

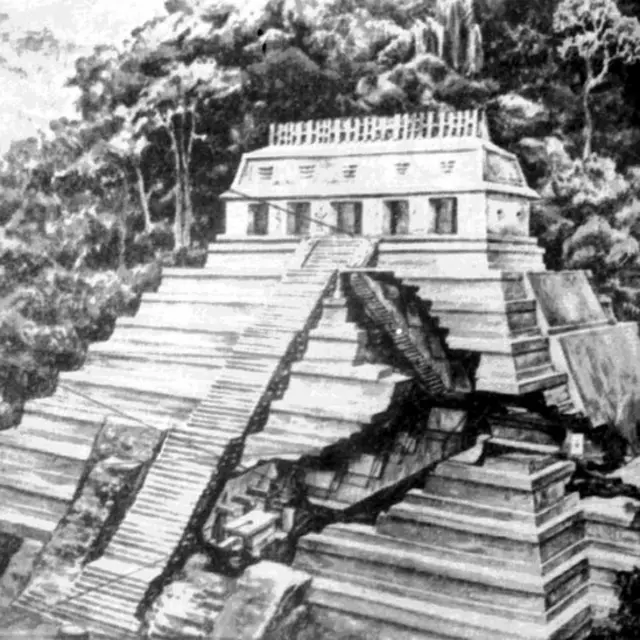

En Palenque, Méjico, puede verse el curioso dibujo de un sarcófago extraído de una pirámide descubierta por el arqueólogo Ruz-Lhuillier. Representa, en estilo maya, un hombre sentado sobre una máquina semejante a un cohete que despide llamaradas por un tubo de escape. El hombre está inclinado hacia delante: sus manos reposan sobre una barras. El cono del proyectil contiene gran número de misteriosos objetos que podrían ser parte de su mecanismo. Después de haber analizado numerosos códices mayas, los franceses Tarade y Millou han llegado a la conclusión de que se trata de un astronauta a bordo de una nave espacial, tal como la concebía este pueblo.

Los jeroglíficos existentes en el borde significan el Sol, la Luna y la Estrella Polar, lo que vendría a apoyar la interpretación cósmica. Mas, por otra parte, las dos flechas marcadas sobre la tumba (603 y 663 d. C.) no dejan de generar dudas. Sin embargo, en el caso de que el sacerdote enterrado en la tumba no fuera simplemente un sacerdote astronauta, sino un guardián de la tradición de los “dioses astrales” de la América central, el ornamento podría explicarse como una evocación de viajes espaciales del pasado.

Todo indica que los atlantes llegaron a tener una sociedad de nivel muy elevado.

Si nos sumergimos en historias perdidas en textos muy antiguos, la sorpresa y el asombro están asegurados. Para mi caso también incluyo la fascinación, aunque con cierta reserva. Todas estas historias tienen un origen real que se pasó de generación a generación y, aunque nos puedan llegar alteradas, en los entresijos de esas historias subyace la verdad donde tienen su origen.

Hace muchos años, el doctor Lao-Tsin publicó en un periódico de la ciudad de Shanghai un artículo dedicado a su viaje a una extraña región de Asia central. En su pintoresco relato, que prefiguró Horizontes perdidos (James Hilton), este médico describe la peligrosa caminata que realizó por las alturas del Tíbet en compañía de un yogui oriundo de Nepal. En una región desolada, en el fondo de las montañas, los dos peregrinos llegaron a un valle escondido, protegido de los vientos septentrionales y gozan de un clima mucho más cálido que el del territorio circundante.

Este doctor evoca en su relato “la torre de Shambhala” y los laboratorios que provocaron su asombro. Allí, amablemente, además de darles hospitalidad, por su condición de doctor le pusieron al tanto de grandes resultados científicos obtenidos en el valle. También fue testigo, según contaba, de experiencias telepáticas efectuadas a grandes distancias. Decía conocer muchas otras cosas que, haciendo honor a la palabra dada, no podía contar.

La tradición actual cuenta que en Shambhala ocurrieron en el pasado remoto cosas extraordinarias y grandes acontecimientos.

Un mahatma en una carta, para definir sus actividades, escribió:

“Durante generaciones innumerables, el adepto ha construido un templo con rocas imperecederas, una torre gigantesca del pensamiento infinito, convertida en morada de un titán que permanecerá en ella solo, si es necesario, y únicamente saldrá al final de cada ciclo para invitar a los elegidos de la Humanidad a cooperar con él y contribuir, a su vez, a la ilustración de los hombres supersticiosos.”

El texto fue escrito por el mahatma Koot Humi en julio de 1.881.

Los mahatmas (grandes sacerdotes de estas comunidades secretas) no quieren ser molestados en su contemplación, y cuando consienten en recibir a visitantes muy especiales es bajo la firme promesa de no revelar lo que allí se les muestre.

Analizando estos mitos se llega a la conclusión de que por aquellas épocas remotas en que los dioses se mezclaban con los humanos, se producía un tráfico en los dos sentidos a través del espacio.

A partir del momento en que se encaminó desde el salvajismo a los rudimentos de la civilización, la Humanidad creyó en la existencia de dioses poderosos y bienhechores. De alguna manera debían buscar el equilibrio y la fuerza necesaria para sobrevivir en aquellos peligrosos tiempos; creer en algo.

En la antigua Grecia se consideraban el Parnaso y el Olimpo como los lugares en que moraban los dioses.

Podría continuar hablando de estos temas de los que en su momento profundicé bastante, pero como el presente trabajo es aleatorio y sin un rumbo fijo, no es cosa de hacer ningún tratado de un tema concreto, así que dejémoslo aquí como una curiosidad muy interesante (con un fondo – siempre – de verdad).

¡Me falta tiempo! Quisiera hacer tantas cosas, quisiera aprender tantas cosas, quisiera arreglar tantas cosas, quisiera, quisiera, quisiera… mucho trabajo para uno solo.

Algún día, cuando me sienta con ánimo, os hablaré de los muchos mundos que existen dentro de este mundo nuestro.

¿Otras Civilizaciones además de las que “conocemos”? Lo dudo mucho.

¿Qué existen algunas que no sabemos a ciencia cierta si existieron? Seguro que sí.

Ante tanta incertidumbre, nos acordamos de aquel filósofo que decía:

“Cambiaría todo lo que se, por la mitad de lo que no se”.

Emilio Silvera V.

May

28

El “mundo” de lo muy pequeño… ¡Es tan extraño!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

Muchas veces hemos hablado del electrón que rodea el núcleo, de su carga eléctrica negativa que complementa la positiva de los protones y hace estable al átomo; tiene una masa de solamente 1/1.836 de la del núcleo más ligero (el del hidrógeno). La importancia del electrón es vital en el universo. Simplemente con que su carga fuera distinta en una pequeña fracción… ¡El mundo que nos rodea sería muy diferente! Y, ni la vida estaría presente en el Universo.

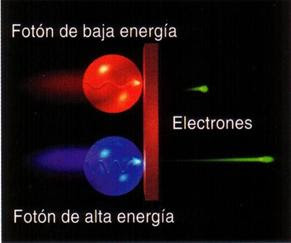

Experimentos con electrones y positrones nos enseñaron cómo funciona el universo

Pero busquemos los “cuantos”. La física del siglo XX empezó exactamente en el año 1900, cuando el físico alemán Max Planck propuso una posible solución a un problema que había estado intrigando a los físicos durante años. Es el problema de la luz que emiten los cuerpos calentados a una cierta temperatura, y también la radiación infrarroja emitida, con menor intensidad, por los objetos más fríos (radiación de cuerpo negro).

Estaba bien aceptado entonces que esta radiación tenía un origen electromagnético y que se conocían las leyes de la naturaleza que regían estas ondas electromagnéticas. También se conocían las leyes para el frío y el calor, la así llamada “termodinámica”, o al menos eso parecía. Pero si utilizamos las leyes de la termodinámica para calcular la intensidad de una radiación, el resultado no tiene ningún sentido. Los cálculos nos dicen que se emitiría una cantidad infinita de radiación en el ultravioleta más lejano y, desde luego, esto no es lo que sucede.

Acero al rojo vivo

Lo que se observa es que la intensidad de la radiación muestra un pico a una cierta longitud de onda característica, y que la intensidad disminuye tanto para longitudes mayores como para menores. Esta longitud de onda característica es inversamente proporcional a la temperatura absoluta de objeto radiante (la temperatura absoluta se define por una escala de temperatura que empieza a 273º bajo cero). Cuando a 1.000º C un objeto se pone al “rojo vivo”, el objeto está radiando en la zona de luz visible.

Lo que Planck propuso fue simplemente que la radiación sólo podía ser emitida en paquetes de un tamaño dado. La cantidad de energía de uno de esos paquetes, o cuantos, es inversamente proporcional a la longitud de onda, y por tanto, proporcional a la frecuencia de radiación emitida. La fórmula es E = hν, donde E es la energía del paquete, ν es la frecuencia y h es una nueva constante fundamental de la naturaleza, la constante de Planck. Cuando Planck calculó la intensidad de la radiación térmica imponiendo esta nueva condición, el resultado coincidió perfectamente con las observaciones.

Con esta idea fue sembrada la semilla de lo que, más tarde, sería la mecánica cuántica

Poco tiempo después, en 1905, Einstein formuló esta teoría de una manera mucho más tajante: él sugirió que los objetos calientes no son los únicos que emiten radiación en paquetes de energía, sino que toda la radiación consiste en múltiplos del paquete de energía de Planck. El príncipe francés Louis-Victor de Broglie, dándole otra vuelta a la teoría, propuso que no sólo cualquier cosa que oscila tiene energía, sino que cualquier cosa con energía se debe comportar como una “onda” que se extiende en una cierta región del espacio, y que la frecuencia ν de la oscilación verifica la ecuación de Planck. Por lo tanto, los cuantos asociados con los rayos de luz deberían verse como una clase de partículas elementales: el fotón. Todas las demás clases de partículas llevan asociadas diferentes ondas oscilantes de campos de fuerza, pero esto lo veremos más adelante.

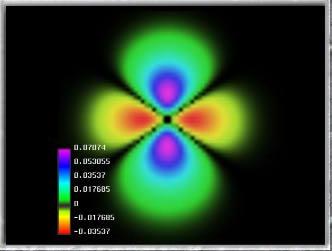

Las dos primeras son la imagen obtenida por los físicos en el laboratorio de cómo se vería un electrón y, la segunda es la Imagen ilustrativa de la dualidad onda-partícula, con la cual se quiere significar cómo un mismo fenómeno puede tener dos percepciones distintas. Lo cierto es que, el mundo de lo muy pequeño es extraño y no siempre lo podemos comprender.

El curioso comportamiento de los electrones en el interior del átomo, descubierto y explicado por el famoso físico danés Niels Bohr, se pudo atribuir a las ondas de de Broglie. Poco después, en 1926, Edwin Schrödinger descubrió cómo escribir la teoría ondulatoria de de Broglie con ecuaciones matemáticas exactas. La precisión con la cual se podían realizar cálculos era asombrosa, y pronto quedó claro que el comportamiento de todos los objetos pequeños quedaba exactamente determinado por las recién descubiertas “ecuaciones de ondas cuánticas”.

La función de onda de Schrödinger nos acercó a ese mundo infinitesimal

Está bien comprobado que la mecánica cuántica funciona de maravilla…, pero, sin embargo, surge una pregunta muy formal: ¿Qué significan realmente estas ecuaciones?, ¿Qué es lo que están describiendo? Cuando Isaac Newton, allá en 1867 formuló cómo debían moverse los planetas alrededor del Sol, estaba claro para todo el mundo qué significaban sus ecuaciones: que los planetas estaban siempre en una posición bien definida des espacio y que sus posiciones y sus velocidades en un momento concreto determinan inequívocamente cómo evolucionarán las posiciones y las velocidades en el tiempo.

Sin importar que estén a mucha distancia la una de la otra, están conectadas

Pero para los electrones todo es diferente. Su comportamiento parece estar envuelto en misterio. Es como si pudieran “existir” en diferentes lugares simultáneamente, como si fueran una nube o una onda, y esto no es un efecto pequeño. Si se realizan experimentos con suficiente precisión, se puede determinar que el electrón parece capaz de moverse simultáneamente a lo largo de trayectorias muy separadas unas de otras. ¿Qué puede significar todo esto?

El “universo de las partículas nunca ha sido fácil de comprender y su rica diversidad, nos habla de un vasto “mundo” que se rige por su propias reglas que hemos tenido que ir conocimiento y seguimos tratando de saber, el por qué de esos comportamientos extraños y a veces misteriosos. Así, la pregunta anterior, de ¿Qué puede significar todo eso?…

La pudo contestar Niels Bohr, de forma tal que, con su explicación se pudo seguir trabajando, y muchos físicos siguen considerando su respuesta satisfactoria. Se conoce como la interpretación de Copenhague de la mecánica cuántica.

Las leyes de la mecánica cuántica han sido establecidas con mucha precisión; permite cómo calcular cualquier cosa que queramos saber. Pero si queremos “interpretar” el resultado, nos encontramos con una curiosa incertidumbre fundamental: que varias propiedades de las partículas pequeñas no pueden estar bien definidas de manera simultánea. Por ejemplo, podemos determinar la velocidad de una partícula con mucha precisión, pero entonces no sabremos exactamente dónde se encuentra; o a la inversa, podemos determinar la posición con precisión, pero entonces su velocidad queda mal definida. Si una partícula tiene espín (rotación alrededor de su eje), la dirección alrededor de la cual está rotando (la orientación del eje) no puede ser definida con gran precisión.

No es fácil explicar de forma sencilla de dónde viene esta incertidumbre, pero existen ejemplos en la vida cotidiana que tienen algo parecido. La altura de un tono y la duración en el tiempo durante el cual oímos el tono tienen una incertidumbre mutua similar. Para afinar un instrumento musical se debe escuchar una nota durante un cierto intervalo de tiempo y compararla, por ejemplo, con un diapasón que debe vibrar también durante un tiempo. Notas muy breves no tienen bien definido el tono.

Para que las reglas de la mecánica cuántica funcionen, es necesario que todos los fenómenos naturales en el mundo de las cosas pequeñas estén regidos por las mismas reglas. Esto incluye a los virus, bacterias e incluso a las personas. Sin embargo, cuando más grande y más pesado es un objeto, más difícil es observar las desviaciones de las leyes del movimiento “clásicas” debidas a la mecánica cuántica. Me gustaría referirme a esta exigencia tan importante y tan peculiar de la teoría con la palabra “holismo”. Esto no es exactamente lo mismo que entienden algunos filósofos por holismo, y que podría definir como “el todo es más que la suma de sus partes”. Si la física nos ha enseñado algo es justo lo contrario.

Miramos la imagen y sabemos exactamente lo que significa cada imagen y lo que hay en el núcleo central

Un objeto compuesto de un gran número de partículas puede ser entendido exactamente si se conocen las propiedades de sus partes (partículas); basta que sepamos sumar correctamente (¡y esto no es nada fácil en mecánica cuántica!). Lo que entiendo por holismo es que, efectivamente, el todo es la suma de las partes, pero sólo se puede hacer la suma si todas las partes obedecen a las mismas leyes. Por ejemplo, la constante de Planck, h, que es igual a 6’626075… × 10-34 Julios segundo, debe ser exactamente la misma para cualquier objeto en cualquier sitio, es decir, debe ser una constante universal.

Mucho ha sido el camino andado hasta nuestros tratando de conocer los secretos de la naturaleza que, poco a poco, nos van siendo familiares. Sin embargo, es más el camino que nos queda por recorrer. Es mucho lo que no sabemos y, tanto el micro-mundo como en el vasto mundo de muy grande, hay que cosas que aún, no hemos llegado a comprender.

El detector ATLAS funcionó, y rastrearon las partículas subatómicas…

Las reglas de la mecánica cuántica funcionan tan bien que refutarlas resulta realmente difícil. Los “trucos” ingeniosos descubiertos por Werner Heisenberg, Paul Dirac y muchos otros mejoraron y completaron las reglas generales. Pero Einstein y otros pioneros como Erwin Schrödinger siempre presentaron serias objeciones a esta interpretación. Quizá funcione bien, pero ¿Dónde está exactamente el electrón?, ¿en el punto x o en el punto y? En pocas palabras, ¿Dónde está en realidad?, y ¿Cuál es la realidad que hay detrás de nuestras fórmulas? Si tenemos que creer a Bohr, no tiene sentido buscar tal realidad. Las reglas de la mecánica cuántica, por sí mismas, y las observaciones realizadas con detectores son las únicas realidades de las que podemos hablar.

Es cierto que, localizar y saber en qué punto exacto están esas pequeñas partículas… no es fácil

La mecánica cuántica puede ser definida o resumida así: en principio, con las leyes de la naturaleza que conocemos ahora se puede predecir el resultado de cualquier experimento, en el sentido que la predicción consiste en dos factores: el primer factor es un cálculo definido con exactitud del efecto de las fuerzas y estructuras, tan riguroso como las leyes de Isaac Newton para el movimiento de los planetas en el Sistema Solar; el segundo factor es una arbitrariedad estadística e incontrolable definida matemáticamente de forma estricta. Las partículas seguirán una distribución de probabilidades dadas, primero de una forma y luego de otra. Las probabilidades se pueden calcular utilizando la ecuación de Schrödinger de función de onda (Ψ) que, con muchas probabilidades nos indicará el lugar probable donde se encuentra una partícula en un momento dado.

Muchos estiman que esta teoría de las probabilidades desaparecerá cuando se consiga la teoría que explique, de forma completa, todas las fuerzas; la buscada teoría del todo, lo que implica que nuestra descripción actual incluye variables y fuerzas que (aún) no conocemos o no entendemos. Esta interpretación se conoce como hipótesis de las variables ocultas.

Albert Einstein, Nathan Rosen y Boris Podolski idearon un “Gedankenexperiment”, un experimento hipotético, realizado sobre el papel, para el cual la mecánica cuántica predecía como resultado algo que es imposible de reproducir en ninguna teoría razonable de variables ocultas. Más tarde, el físico irlandés John Stewar Bell consiguió convertir este resultado en un teorema matemático; el teorema de imposibilidad.

(“El teorema de Bell o desigualdades de Bell se aplica en mecánica cuántica para cuantificar matemáticamente las implicaciones planteadas teóricamente en la paradoja de Einstein-Podolsky-Rosen y permitir así su demostración experimental. Debe su nombre al científico norirlandés John S. Bell, que la presentó en 1964.

El teorema de Bell es un meta-teorema que muestra que las predicciones de la mecánica cuántica (MC) no son intuitivas, y afecta a temas filosóficos fundamentales de la física moderna. Es el legado más famoso del físico John S. Bell. El teorema de Bell es un teorema de imposibilidad, que afirma que:

Ninguna teoría física de variables ocultas locales puede reproducir todas las predicciones de la mecánica cuántica.”)

¿Cómo saber el número que saldrá cuando lanzamos los dados?

¡¡La mecánica cuántica!!, o, la perplejidad de nuestros sentidos ante lo que ese “universo cuántico” nos ofrece que, generalmente, se sale de lo que entendemos por sentido común. Ahí, en el “mundo” de los objetos infinitesimales, suceden cosas que no siempre podemos comprender. Y, como todo tiene una razón, no dejamos de buscarla en cada uno de aquellos sorprendentes sucesos que en ese lugar se producen. Podríamos llegar a la conclusión de que, la razón está en todo y solo la encontramos una vez que llegamos a comprender, mientras tanto, todo nos resulta extraño, irrazonable, extra-mundano y, algunas veces…imposible. Sin embargo, ahí está.

Cualquier perturbación en su camino, hará que todo sea distinto en la trayectoria

Dos elementos actúan de común acuerdo para garantizar que no podamos descorrer el velo del futuro, de lo que será después (podemos predecir aproximaciones, nunca certezas), el principal de esos elementos es la ignorancia nunca podremos saber el resultado final de éste o aquél suceso sin tener la certeza de las condiciones iniciales. En la mayoría de los sistemas físicos son, en mayor o menor medida dada su complejidad, del tipo caótico es tal que, el resultado de las interacciones entre elementos son sumamente sensibles a pequeñísimas variaciones de los estados iniciales que, al ser perturbados mínimamente, hacen que el suceso final sea y esté muy alejado del que se creía al comienzo.

¿El Futuro? Es el Tiempo por venir, lo que no existe, lo que sólo podemos imaginar y nunca tendremos la certeza de saber como será. Lo podemos presentir, incluso atisbar algunos rasgos de cómo podría ser. Sin embargo, como nos pasa con el horizonte si navegamos hacia él, nunca lo podremos alcanzar.

Estamos confinados en un eterno Presente previa visita al Pasado.

Emilio Silvera V.

May

28

Las estrellas y la Vida

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (2)

Comments (2)

Algunas veces, al oír noticias sin sentido científico alguno ¿Pequeñas galaxias de materia oscura? ¿Qué puñetas quieren decir con eso? Nadie sabe, a ciencia cierta si la “materia oscura puede existir, no sabemos de qué estará hecha, ni por qué no se deja ver, o, por qué motivo no radia como la materia ordinaria. Es una “materia” que una vez supuso un físico que debería existir para explicar el movimiento de las estrellas y las galaxias, y, como nadie sabía por qué de ese movimiento anómalo (se mueven más rápidamente de lo que deberían hacerlo teniendo en cuenta la materia que vemos), se agarraron a esa solución y, ahí andamos que, lo dicen y hasta ellos se lo creen.

Conociendo la materia

En realidad, todo lo que podemos saber (que es menos de lo que nos creemos que sabemos), es debido a la Observación, el estudio, los experimentos, en definitiva al Método Científico que nos lleva a la verdad de las cosas.

Hay una veintena de estrellas que se encuentran dentro de un radio de acción marcado por los doce años-luz de distancia al Sol. ¿Cuál de ella se nos presenta como la más probable para que, algunos de sus planetas pudieran albergar alguna clase de vida, incluso Vida Inteligente? La estrella más cercana a nosotros es Alfa Centauri que, en realidad es un sistema estelar situado a unos 4.37 años-luz de nosotros (unos 42 billones de kilómetros). En realidad, se trata de un sistema de tres estrellas.

Alfa Centauri contiene al menos un planeta del tamaño terrestre con algo más de la masa de la Tierra que está orbitando a Alfa Centauri B. Sin embargo, su cercanía a la estrella, unos 6 millones de kilómetros lo hace tener una temperatura de más de 1.ooo ºC lo que parece ser muy caliente para albergar alguna clase de vida.

Alfa Centauri, seguramente por su cercanía a nosotros, ha ejercido siempre una sugestiva atracción para nosotros cuando miramos el cielo nocturno. Resulta ser, en su conjunto, la tercera estrella más brillante de todas, y junto con Hadar (Beta Centauri), las dos en la imagen de arriba, es una muy importante y útil referencia para la localización de la Cruz del Sur. Además, y como se trata de una estrella triple, Alpha Centauri A, la componente principal, se constituye en una buena candidata para la búsqueda de planetas del mismo tipo que la Tierra.

El Sistema Alfa Centauri

Las tres estrellas se formaron a partir de la misma nebulosa de materia interestelar. El trio de estrellas se van orbitando las unas a las otras a un ritmo como de vals, unidas por los lazos invisibles de la fuerza gravitatoria que generan y con la que se influyen mutuamente. Lo cierto es que las estrellas triples gozan de pocas probabilidades para albergar la vida, porque no pueden mantener a sus planetas en una órbita estable y segura, la inestabilidad que producen las tres estrellas en esos posibles planetas, parece que sería insoportable para formas de vida inteligente. Claro que, las distancias a las que se encuentran unas estrellas de otras es grande y… ¿Quién sabe? Nunca podemos afirmar nada sin haberlo confirmado.

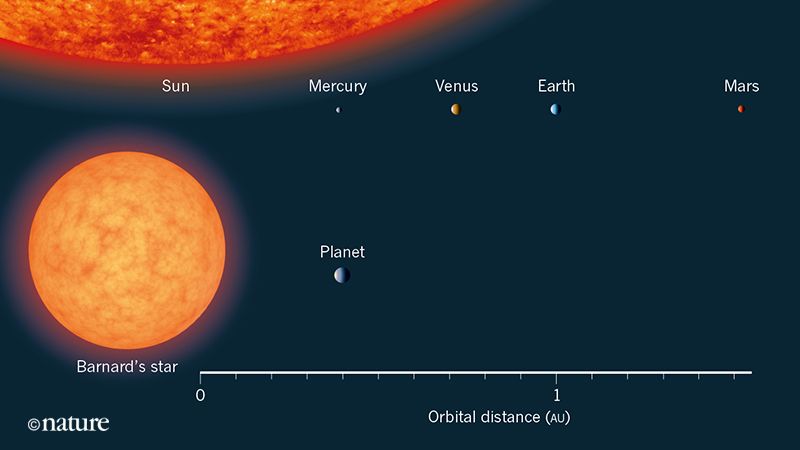

La siguiente estrella más allá de Alfa Centauri es la estrella de Barnard, situada a 6 años-luz aproximadamente de nuestro Sol, o, lo que es lo mismo, a unos sesenta mil billones de kilómetros de distancia. Esta estrella parece contar con una familia de planetas. Sin embargo, es una estrella muy vieja, casi tanto como el propio universo, y, por tanto, es deficitaria en la mayoría de los elementos químicos esenciales para la vida. Es poco prometedora para buscar vida en sus alrededores.

Las 10 estrellas más cercanas al Sol se encuentran en un rango de distancia entre los 4 y 10 años luz. Para tener una idea, la Vía Láctea mide unos 100.000 años luz, lo cual convierte a estas estrellas en verdaderas vecinas:

En un radio de 12,5 años-luz

- Alfa Centauri (que, en realidad, es un sistema de tres estrellas): a 4,2 años luz.

- Estrella de Barnard: a 5,9 años luz.

- Wolf 359: a 7,7 años luz.

- Lalande 21185: a 8,2 años luz

- Sirio (un sistema binario de estrellas): a 8,6 años luz

- Luyten 726-8 (otro sistema binario): a 8,7 años luz.

- Ross 154: a 9,7 años luz

- Ross 248: a 10,3 años luz

- Epsilon Eridani: a 10,5 años luz.

- Lacaille 9352: a 10,7 años luz

Más allá de Barnard existe un cierto numero de estrellas, todas ellas poco prometedoras para la existencia de vida y de inteligencia porque, o son demasiado pequeñas y frías para emitir la clase de luz que la vida tal como la conocemos requiere, o demasiado jóvenes como para que haya aparecido la vida inteligente en los planetas que las circundan. No encontraremos otra estrella que pueda albergar la vida y seres inteligentes hasta que no viajemos a una distancia próxima a los once años-luz del Sol.

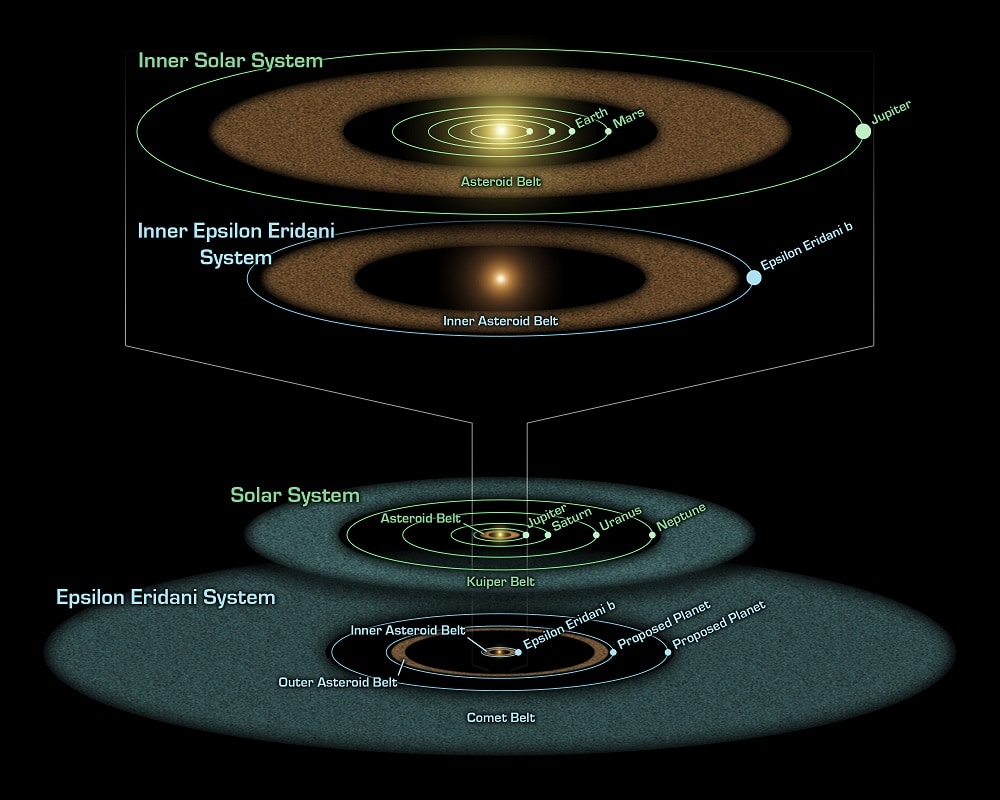

Épsilon Eridani está situada a unos 10,5 años-luz del Sol, es una de las estrellas más cercanas al Sistema Solar y la tercera más próxima visible a simple vista. Está en la secuencia principal, de tipo espectral K2, muy parecida a nuestro Sol y con una masa algo menor que éste, de unas 0,83 masas solares. Es joven, sólo tiene unos 600 millones de años de edad mientras que el Sol tiene 4.600 millones de años.

Épsilon emite menos luz visible y luz ultravioleta que nuestra estrella, pero probablemente sea suficiente para permitir allí el comienzo de la vida que, si tenemos en cuenta el corto tiempo que ha pasado, no llegaría a poder ser inteligente. Claro que, los cálculos realizados sobre la vida de las estrellas en general y sobre esta en particular… ¡No son fiables! Y, siendo así (que los), tampoco podemos estar seguro de lo que en sus alrededores pueda estar presente. Se le descubrió un planeta orbitando a su alrededor, Épsilon Eridani b, que se descubrió en el año 2000. La masa del planeta está en 1,2 ± 0,33 de la de Júpiter y está a una distancia de 3,3 Unidades Astronómicas. Se cree que existen algunos planetas de reciente formación que orbitan esta estrella.

El sol (izquierda) es de mayor tamaño y algo más caliente que Tau Ceti (derecha).

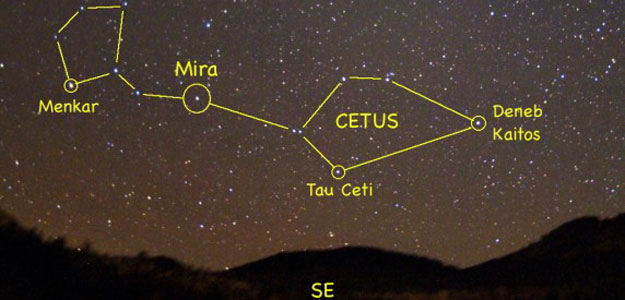

Más allá de Épsilon Eridani hay nueve estrellas que se encuentran todavía dentro de un margen de distancia del Sol que no sobrepasan los 12 años-luz. Sin embargo, todas ellas, menos una, son demasiado jóvenes, demasiado viejas, demasiado pequeñas o demasiado grandes para poder albergar la vida y la inteligencia. La excepción se llama Tau Ceti.

![]()

Tau Ceti es la estrella, similar al Sol, más cercana al Sistema Solar. Así que no es sorprendente que sea un objeto de estudio. Ahora, un nuevo estudio, plantea que podría tener cuatro planetas, similares a la Tierra, a su alrededor…

Tau Ceti está situada exactamente a doce años-luz de nosotros y satisface todas las exigencias básicas para que en ella (en algún planeta de su entorno) haya podido evolucionar la vida inteligente: Se trata de una estrella solitaria como el Sol -al contrario que Alfa Centauri- no tendría dificultad alguna en conservar sus planetas que no serían distorsionados por la gravedad generada por estrellas cercanas. La edad de Tau Ceti es la misma que la de nuestro Sol y también tiene su mismo tamaño y existen señales de que posee una buena familia de planetas. No parece descabellado pensar que, de entre todas las estrellas próximas a nosotros, sea Tau Ceti la única con alguna probabilidad de albergar la vida inteligente.

La noticia que publicaron los medios decía: ¡Descubren un nuevo planeta extrasolar que se encuentra en una zona habitable! El planeta orbita en torno a la estrella Tau Ceti, a doce años luz del Sol. Hay cinco cuerpos cuya masa oscila entre dos y seis veces la de la Tierra.

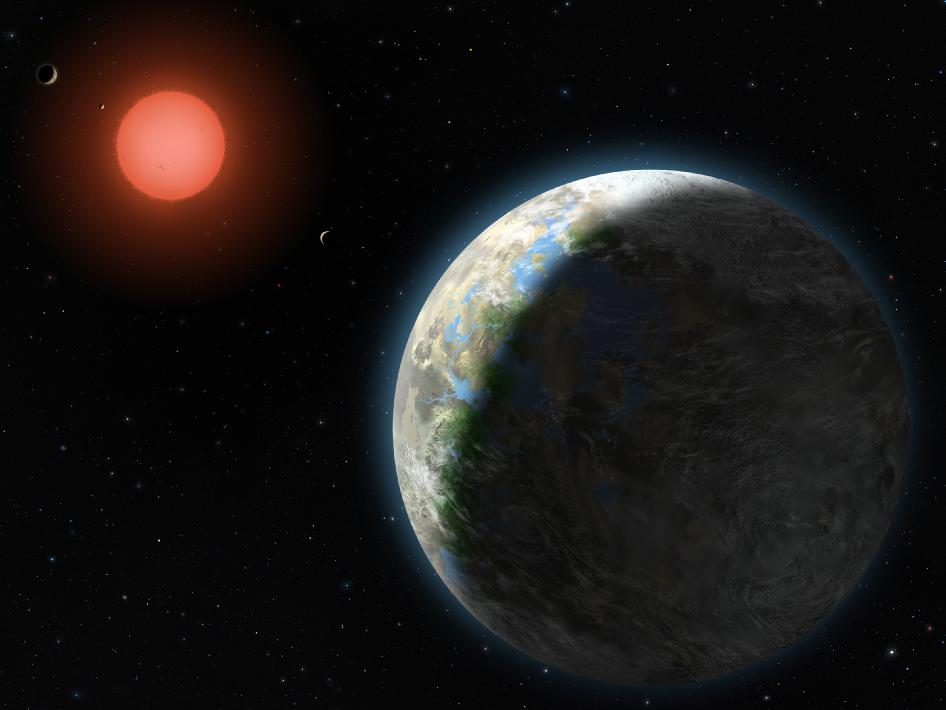

¿Quién sabe lo que en algunos de esos planetas que orbitan la estrella Tau Ceti pudiera estar pasando? Y, desde luego, dadas las características de su sistema planetario y la cercanía que parece existir entre alguno de los mundos allí presentes, si algún ser vivo inteligente pudiera contemplar el paisaje al amanecer, no sería extraño que pudiera ser testigo de una escena como la que arriba contemplamos. ¿Es tan bello el Universo! Cualquier escena que podamos imaginar en nuestras mentes… ¡Ahí estará! en alguna parte.

Es cierto que la vida, podría estar cerca de nosotros y que, por una u otra circunstancia que no conocemos, aún no hayamos podido dar con ella. Sin embargo, lo cierto es que podría estar mucho más cerca de lo que podemos pensar y, desde luego, es evidente que el Sol y su familia de planetas y pequeños mundos (que llamamos lunas), son también lugares a tener en cuenta para encontrarla aunque, posiblemente, no sea inteligente.

Con certeza, ni sabemos cuentos cientos de miles de millones de estrellas puede haber en nuestra propia Galaxia, la Vía Láctea. Sabemos más o menos la proporción de estrellas que pueden albergar sistemas planetarios y, sólo en nuestro entorno galáctico podrían ser cuarenta mil millones de estrellas las que pudieran estar habilitadas para poder albergar la vida en sus planetas.

Estas cifras asombrosas nos llevan a plantear muchas preguntas, tales como: ¿Estarán todas esas estrellas prometedoras dando luz y calor a planetas que tengan presente formas de vida, unas inteligentes y otras no? ¿O sólo lo están algunas? ¿O ninguna a excepción del Sol y su familia. Algunos astrónomos dicen que la ciencia ya conoce la respuesta a esas preguntas. Razonan que la Tierra es una clase de planeta ordinario, que contiene materiales también ordinarios que pueden encontrarse por todas las regiones del Universo, ya que, la formación de estrellas y planetas siempre tienen su origen en los mismos materiales y los mismos mecanismos y, en todas las regiones del Universo, por muy alejadas que estén, actúan las mismas fuerzas, las mismas constantes, los mismos ritmos y las mismas energías.

Gliese 581 ¿Otra promesa vida?

Planetas como la Tierra y muy parecidos los hay en nuestra propia Galaxia a miles de millones y, si la vida hizo su aparición en esta paradisíaca variedad de planeta, estos astrónomos se preguntan, ¿por qué no habría pasado lo mismo en otros planetas similares al nuestro? ¿Tiene acaso nuestro planeta algo especial para que sólo en él esté presente la vida? La Naturaleza, amigos míos, no hace esa clase de elecciones y su discurrir está regido por leyes inamovibles que, en cualquier circunstancia y lugar, siempre emplea los caminos más “simples” y lógicos para que las cosas resulten como nosotros las podemos contemplar a nuestro alrededor. Y, siendo así (que lo es), nada aconseja a nuestro sentido común creer que estamos solos en tan vasto Universo.

El célebre astrónomo, con una sonrisa oía la pregunta del joven periodista:

– ¿Verdad señor que sería un milagro encontrar vida en otros planetas?

– El milagro joven, ¡sería que no la encontráramos!

Algún día muy lejano aún en el futuro (si es que seguimos por aquí)), nos veremos obligados a viajar a varias de las estrellas que más arriba han quedado reseñadas como posibles aposentos para la Humanidad que tendrá que buscar refugio en otros mundos.

Las estrellas nos trajeron aquí. Durante más de 10.000 millones de años fabricaron los elementos de los que estamos hechos los seres vivos. La vida evolucionó a partir de la materia “inerte”. Un buen día, en un planeta priv8ilegiado, surgió aquella primera célula replicante que dio lugar al comienzo de la fascinante historia de la Vida.

Emilio Silvera V.

May

28

Los pies en el suelo y la mente en las estrellas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en General ~

Clasificado en General ~

Comments (0)

Comments (0)

Es una de las grandezas del ser humano, el Amor, es el que salva la especie de tantos y tantos defectos como tiene… (al menos de momento es lo más real de sus vidas): La familia que es lo que nos motiva para luchar y solucionar problemas. Ya lo dijo aquel hombre sabio:

“Un hombre so0lo, está en muy mala compañía.”

¿Cómo se puede explicar el amor? El materialismo no puede hacerlo. Ni los átomos, ni las moléculas, ni las células resuelven el problema. ¿Quién está capacitado para explicar el sentir de las neuronas? ¿Qué mecanismo nos mueve al amor? ¿Cómo es ese vínculo tan fuerte?

¡El Amor es el deseo irrefrenable de fusionarse con el Ser amado!

Al igual que la fuerza invisible y poderosa del electromagnetismo y la gravedad, la del amor también está ahí, y cuando es verdadero el sentimiento, la fuerza es mayor que las cuatro fuerzas de la naturaleza juntas. Si estamos dispuestos a entregar la vida, ¿hay algo más fuerte que eso en el universo? Creo que no.

¿Qué caricia explica su turbadora resonancia “espiritual”?

El amor es una emoción compleja y fundamental que vincula a las personas y se manifiesta como una conexión profunda que va más allá de la pasión, incluyendo respeto, apoyo y aceptación. A nivel biológico, es producto de la liberación de hormonas como la oxitocina, dopamina y estrógenos, generando sensaciones de bienestar, felicidad y mejora física. En cuanto a los sentimientos, el Amor nos transforma y tenemos comportamientos que, en otras circunstancias serían muy diferentes, es tan fuerte lo que sentimos por el Ser Amado que lo daríamos todo a cambio de nada. Es una conexión emocional inexplicable, vemos en la otra persona la perfección que realmente no existe,

Como antes he dicho, el Amor es ese deseo irrefrenable de fusión.

¿Qué caricia explica su turbadora resonancia “espiritual”?

¡Ninguna!, pero ocurre. Al igual que el suave pasar de los dedos sobre el teclado del piano nos ofrece una melodía que eleva nuestra alma, una caricia del ser amado no sólo nos hace sentirnos bien, es algo más grande y más elevado, nos hace mejores.

La verdadera experiencia del amor es misteriosa y está más allá de la mera sexualidad e incluso de la misma razón; es tan grande y profundo este misterio que en realidad se escapa de nuestro entendimiento, y de ningún modo puede expresarse en términos de biogenética. Son cuestiones de la mente que no hemos llegado a comprender y que está muy por encima de las simples cuestiones materiales.

Qué razón tenía aquel que dijo: “No sólo de pan vive el hombre”. La metáfora lo dice todo.

Platón también negó rotundamente esa reducción a lo físico y hablaba de un infinito inventado, algo transfigurado a través del amor, la llave que abre el corazón humano.

En el ámbito humano, después del amor con mayúsculas (no todos son capaces de amar), la ética es el arte de lo mejor y la cultura es su cultivo, que tiene un medio ideal en los libros que, desde las historias infantiles, de fantasía, de conocimiento científico o de cualquier temática, siempre, en cada momento de nuestras vidas, nos aportan algo para que seamos mejores.

La verdad es que en los tiempos que vivimos, la cultura es difícil y encuentra poca tierra de cultivo. Prima la zafiedad. Programas de televisión de los que podemos sentir vergüenza. Se ha perdido el pudor y el respeto, y los valores tradicionales se están perdiendo, y vamos, si alguien no lo remedia, hacia una sociedad del vale todo.

No existe moralidad colectiva, y en aquellos casos aislados en que está presente, sus poseedores son mirados por los demás como bichos raros y llegan a procurar aislarlos en ese mundo de moral y honestidad que ellos ni entienden ni quieren.

Aunque somos libres de elegir, la verdad es que la mayoría está condicionada por el medio; una realidad que les arrastra y no tienen ni la personalidad ni la fuerza para escapar del torbellino que irremisiblemente los engulle.

Desgraciadamente existen los matrimonios de conveniencia. El Amor queda en segundo plano

Tenemos que enseñar a los niños a leer, aprender a decir no en el momento oportuno. Un no en ese momento delicado de sus vidas puede ser la diferencia entre ser feliz o ser un desgraciado.

La educación tiene su seno en el núcleo familiar; allí es donde todo se cuece, y los niños se miran en el espejo de los padres. Aquellos que dejan sus obligaciones y trasladan la responsabilidad a los maestros y la escuela, mal lo llevan.

Cariño, que los niños vivan un comportamiento ejemplar, que comprendan que el trabajo es el camino

No existen soluciones mágicas. Todo es disciplina y trabajo. Sin sacrificio nada conseguimos nunca. Es la constancia y el querer conseguirlo lo que finalmente nos trae el resultado. Lo que tú hagas es lo que recibirás; ésa es la única y cruda realidad.

¿Hacer lo que queremos, o, hacer lo que debemos?

¿Qué es la libertad? Yo la entiendo como el poder de hacer en todo momento lo que desees, y la verdad, en ese sentido la libertad no existe. ¿Quién puede hacer eso? Los padres estamos supeditados a los hijos; la mujer y el hombre están supeditados a sus estudios y a sus trabajos. El banquero está supeditado a conservar e incrementar su dinero. El gobernante está sometido (es un decir) a procurar el bien común y, siendo así, la libertad que tenemos es parcial e intermitente, nunca general y continua. Sí, tenemos un amplio margen para elegir nuestro camino en la vida, y algunos, ni eso hemos tenido.

Muchos esquivaron el camino al confundir el bien con el placer que, mal entendido, nos puede llevar a la ruina. El deseo constante de placer artificial puede convertir el equilibrio de la mente humana en algo peligroso e inestable.

Lo más importante para todo Ser humano: Que sus hijos sean felices

Estas cosas que aquí comento ahora, creo que en el fondo son conocidas por todos, y sin embargo, pocos las cumplen, y por no prescindir de sus pequeños placeres (el bar y los amigos, el Rocío y la fiesta, acompañar a su equipo, etc.) dejan arruinar las vidas de sus hijos que dejan acompañados de esa fatídica maquinita de juegos infernales que, aun costando una pequeña fortuna, les compran para que les dejen tranquilos.

En fin, menos mal que no todos actúan así, pero sí más de los que desearíamos.

Cambiemos a un tema más físico.

Los átomos y moléculas de las que estamos formados, es probable que sean comunes a organismos de cualquier otro lugar del universo. Pero la manera específica en que estas moléculas se juntan y las formas específicas y fisiológicas de los organismos terrestres pueden ser sumamente diferentes de lo que es corriente en nuestro planeta, a consecuencia de sus diferentes historias evolutivas.

Cuando tratamos de considerar cuáles han de ser las estrellas a estudiar y examinar buscando posibles señales de radio dirigidas a nosotros desde planetas lejanos, generalmente se presta más atención a estrellas semejantes a nuestro Sol, alegando, con razón, que la búsqueda e investigación deben iniciarse con un tipo de estrella en la que sepamos con certeza que hay vida (la estrella que tiene un sistema planetario y que en uno de sus planetas ha surgido la vida, la única conocida, es nuestro Sol). De esta manera, se buscan signos de vida inteligente en estrellas como (y parecidas a) la nuestra. El proyecto Ozma fue el primer intento para buscar señales de radio en las estrellas Tau Ceti y Épsilon Eridani, ambas estrellas con masa, radio, edad y composición muy parecidas a las de nuestro Sol.

Pero limitar la búsqueda a una exclusividad de este tipo de estrellas sería un error. Hay estrellas con menos masa y luminosidad que la de nuestro Sol que tienen existencias más antiguas, y por tanto evolucionadas en un mayor grado. Estas estrellas diminutas o “enanas” K y M pueden tener miles de millones de años más que el Sol.

Si suponemos que cuanto más larga sea la vida de un planeta, más inteligentes serán (por evolución) los organismos que en él se han desarrollado, entonces debemos dirigir nuestra atención a las estrellas no sólo G, sino también a las K y M, evitando el impulso ególatra de que la única vida existente en el universo, por fuerza, será como la nuestra. ¡Un error enorme!

Es verdad que este tipo de estrellas con planetas a su alrededor, podría objetarse que son mundos más fríos que la Tierra, y que la vida en ellos es menos probable. Claro que este diagnóstico parte de un error muy común en nosotros; pensamos en un tipo de vida similar o muy parecido al nuestro, y además, al ser las estrellas más pequeñas, generan una fuerza de gravedad menor y los planetas están mucho más cerca del Sol que los de nuestro sistemas solar, con lo cual, puede que la cercanía equilibrase la balanza y no los haga tan fríos como creemos. En realidad, en el cosmos existen muchas más estrellas K y M que estrellas G.

Carl Sagan, enamorado de todos estos problemas del universo, nunca descartaba nada. Decía que la mayor parte de la vida surge en los planetas y allí reside. Sin embargo, se preguntaba:

“¿Acaso pudiera ver organismos que habitan en las profundidades del espacio interestelar, superficies o interiores de estrellas, o incluso otros objetos cósmicos incluso más exóticos?”

Es tan difícil responder a esa pregunta como a tantas otras que, con nuestra actual ignorancia, es imposible dar respuesta. Si evolucionamos hasta seres de pura energía, podríamos estar en cualquier parte del universo.

Los seres vivos tal y como los conocemos, necesitan de la materia para reproducirse y, por lógica, se deben asentar en aquellos lugares que, estando presente la energía, puedan reproducirse en un tiempo prudencial y adecuado a la especie de que se trate, y acorde con la complejidad del individuo que está surgiendo a la vida.

Claro que no podríamos negar y sí imaginar organismo desarrollándose en planetas con atmósferas que lentamente vayan alejándose en el espacio, permitiendo que los organismos se adapten gradualmente a unas condiciones cada vez más duras, hasta llegar a la adaptación total de un medio interestelar. Seres así podrían vivir casi en cualquier parte del universo.

Lo más probable, sin descartar nada, será una especie diferente de organismo interestelar mucho más posible: seres inteligentes de planetas parecidos al nuestro, pero que han trasladado su campo de actividad al volumen mucho más vasto del espacio interestelar.

Los seres, en nuestro lejano futuro tecnológico, deberán poseer capacidades que hoy en día ni siquiera podemos imaginar. Es verdad que el hombre moderno (nosotros), es casi idéntico al hombre de hace 50.000 años. Sin embargo, cuando pasen algunos millones de años, todo será distinto. Aparecerán nuevas formas humanas evolucionadas por pequeñas y paulatinas mutaciones encaminadas a sobrevivir en otros medios.

No puedo dudar de que tales sociedades futuras deberán dominar la materia y la energía de las estrellas y de las galaxias, y tendrán la sabiduría suficiente para explotar la radiación y la energía de los agujeros negros para ponerla a su servicio.

Pensemos en el largo viaje que unos organismos hicieron para evolucionar del mar a la tierra firme. Ahora esos organismos que tienen su origen en las profundidades marinas, sólo se sientes “en casa” en la tierra, su nuevo medio conquistado a través de mil peripecias y peligros. De la misma manera, en el futuro, dejaremos la tierra firme para habitar en enormes ciudades volantes por las profundidades del universo, e innumerables mundos serán poblados con sociedades nuevas que llenarán de ruidos el ahora silencioso universo.

¡Quién sabe!

Todo lo que podamos imaginar y mucho más

Las maravillas del universo son inagotables, y muy lentamente tenemos acceso a ellas. Hay lugares con tres soles de distintos colores: amarillo (como el nuestro), azul y verde, o blanco y rojo. Hay dos que casi se están tocando, sólo los separa una ligera y brillante materia cósmica que parece pura luz. Hay un mundo que tiene miles de lunas, y no muy lejos de él brilla un Sol que no es mayor que nuestro planeta Tierra. He podido ver un núcleo atómico de 3.000 m de diámetro que gira 160 veces por segundo. Hay soles que se desplazan por el universo a velocidades enormes y bacterias que escapan de las galaxias y vagan por el cosmos hasta encontrar un planeta donde instalarse. Las nubes de gas y polvo inundan los espacios entre las galaxias, y después de girar durante miles de millones de años, se juntan y forman nuevas galaxias de estrellas y planetas.

También, quién sabe, pueden existir lugares fuera de nuestro universo (algunos científicos así lo creen).

Para nosotros, insignificantes criaturas de una grandeza enorme, el universo resulta pavoroso. Pero también fascinante y maravilloso. ¡Qué paradoja!

¿Cómo puede algo dar miedo y placer o fascinación al mismo tiempo?

Pues así es. Nos produce miedo su enormidad y nuestra ignorancia. Nos produce placer lo que vamos descubriendo y fascinación los misterios que encierra y a los que nuestra curiosidad y osadía no resiste la necesidad de desvelar.

No parece que nuestra evolución sea debida a senderos evolutivos predeterminados que conducían infaliblemente, desde formas simples, a lo que somos, al hombre; más bien, la evolución procede de un modo convulsivo, sin un plan determinado, y la mayor parte de formas de vida conducen a callejones sin salida en la evolución. Así se han extinguido tantas, y continuarán extinguiéndose. Esperemos que no estemos en la lista.

En realidad, somos el producto de una larga serie de accidentes biológicos. En la perspectiva cósmica no tememos razones de pero para pensar que seamos los primeros, que seremos los últimos o los mejores.

Sin embargo, esa seria de accidentes biológicos, ¿fueron fortuitos? Ya me gustaría poder responder a esta pregunta.

Quizás con el tiempo salga lo que hay dentro de nosotros. A menudo, las circunstancias y el paso del tiempo son los que terminan revelando nuestra verdadera condición, nuestros valores o aquello que realmente llevamos dentro.

A lo que sí puedo responder es al hecho innegable de que, en lo más profundo de nuestro ser habita un ente superior, algo grande capaz de lo más sublime. ¿Puede algo así surgir de la nada?

Me gustaría estar en ese tiempo futuro en el que la ciencia es tan avanzada que tiene como reliquias antiguas teorías como la relatividad, la mecánica cuántica y la teoría de supercuerdas. ¿Qué maravillas no tendrán entonces?

La ciencia avanza despacio, no porque no interese a la gente, sino porque los gobiernos no le destinan los presupuestos necesarios para que su avance esté relacionado con el conocimiento que ya poseemos. Tenemos magníficos físicos, astrofísicos, astrónomos, matemáticos y otros científicos de las distintas disciplinas que viven en la inseguridad de que el político o el organismo de turno le conceda la subvención necesaria para realizar sus proyectos. Es una vergüenza.

A pesar de todos los inconvenientes, los avances científicos y del conocimiento no pueden ser frenados. El querer saber y descubrir está asociado con una especie de energía inagotable que finalmente vencerá.

En realidad, la ciencia es el poder. Por tal motivo, todos los políticos tratan de manejar el ámbito científico por si surge algo que puedan utilizar en beneficio propio.

Nada es como era, todo ha cambiado

La gente sencilla sí se interesa por los temas científicos, lo que ocurre es que en la niñez, en las escuelas, la enseñanza es muy deficiente, y cuando llegan a mayores, son unos incultos científicos que, de manera interesada, han sido dejados en la ignorancia por algunos.

Todos deberíamos tener un mínimo de conocimientos sobre las cuestiones importantes de nuestro mundo y nuestro universo. Saber cuestiones básicas como el por qué brillan las estrellas, cómo se expande el universo y que la Tierra es una nave espacial que nos lleva en un viaje alrededor del Sol a 30 Km/s.

No puedo olvidar la fascinación que sentí (sin entenderlo) cuando vi por vez primera ante mis ojos E = mc2, su sencillez y la enormidad del mensaje que encierra, me dejaron totalmente sorprendido y al mismo tiempo, maravillado.

¡Qué cantidad de ingenio humano está reflejado en todas esas ecuaciones!

Pues bien, lo mismo que me ocurrió a mí, seguramente le ocurrirá a muchos otros si les damos la oportunidad de conocer, de saber sobre las cosas que les rodea y con las que conviven, sin que tengan la menor idea de qué son y cómo funcionan. La gravedad, el electromagnetismo, las fuerzas nucleares… creo que todo esto, sin tecnicismos ni profundidades científicas, puede ser explicado para dar un conocimiento básico que, al menos, evite la actual ignorancia, y para conseguirlo, el único camino es la divulgación.

Emilio Silvera V.

Totales: 88.967.201

Totales: 88.967.201 Conectados: 48

Conectados: 48