Mar

23

¡Son muchas las cosas que no sabemos!

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El Universo misterioso ~

Clasificado en El Universo misterioso ~

Comments (0)

Comments (0)

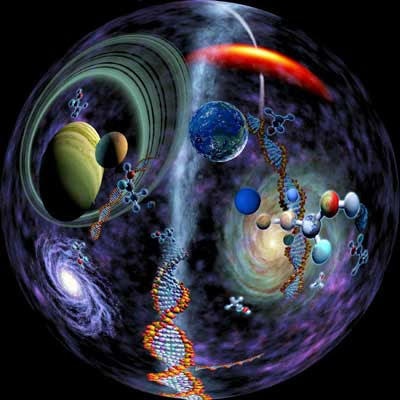

Hemos hablado aquí otras veces sobre el hecho cierto de que, el material del que estamos hechos se “fabricaron” en las estrellas, y, alguna supernova, hace ya miles de millones de años, sembró el espacio interestelar para que se formara nuestro Sistema Solar. Claro que los procesos de la alquimia estelar necesitan tiempo: miles de millones de años de tiempo. Y debido a que nuestro universo se está expandiendo, tiene que tener un tamaño de miles de millones de años-luz para que durante ese periodo de tiempo necesario pudiera haber fabricado los componentes y elementos complejos para la vida. Un universo que fuera sólo del tamaño de nuestra Vía Láctea, con sus cien mil millones de estrellas resultaría insuficiente, su tamaño sería sólo de un mes de crecimiento-expansión y no habría producido esos elementos básicos para la vida.

que se formara nuestro Sistema Solar. Claro que los procesos de la alquimia estelar necesitan tiempo: miles de millones de años de tiempo. Y debido a que nuestro universo se está expandiendo, tiene que tener un tamaño de miles de millones de años-luz para que durante ese periodo de tiempo necesario pudiera haber fabricado los componentes y elementos complejos para la vida. Un universo que fuera sólo del tamaño de nuestra Vía Láctea, con sus cien mil millones de estrellas resultaría insuficiente, su tamaño sería sólo de un mes de crecimiento-expansión y no habría producido esos elementos básicos para la vida.

Ahí, en la Nebulosa Orión, aparecen marcados los lugares donde se están formando nuevos sistemas planetarios

El universo tiene la curiosa propiedad de hacer que los seres vivos piensen que sus inusuales propiedades son poco propicias para la vida, para la existencia de vida, cuando de hecho, es todo lo contrario; las propiedades del universo son esenciales para la vida. Lo que ocurre es que en el fondo tenemos miedo; nos sentimos muy pequeños ante la enorme extensión y tamaño del universo que nos acoge. Sabemos aún muy poco sobre sus misterios, nuestras capacidades son limitadas y al nivel de nuestra tecnología actual estamos soportando el peso de una gran ignorancia sobre muchas cuestiones que necesitamos conocer. Hemos llegado a ser conscientes de que no sabemos y, ese conocimiento, es precisamente el que nos pone en la línea de salida hacia la conquista del saber.

que los seres vivos piensen que sus inusuales propiedades son poco propicias para la vida, para la existencia de vida, cuando de hecho, es todo lo contrario; las propiedades del universo son esenciales para la vida. Lo que ocurre es que en el fondo tenemos miedo; nos sentimos muy pequeños ante la enorme extensión y tamaño del universo que nos acoge. Sabemos aún muy poco sobre sus misterios, nuestras capacidades son limitadas y al nivel de nuestra tecnología actual estamos soportando el peso de una gran ignorancia sobre muchas cuestiones que necesitamos conocer. Hemos llegado a ser conscientes de que no sabemos y, ese conocimiento, es precisamente el que nos pone en la línea de salida hacia la conquista del saber.

Ni siquiera sabemos con con seguridad, si existe la ” materia oscura” que, por otra parte, debería llamarse sustancia cósmica que de esa, sí que hay por todas partes y, seguramente fue, la que dio origen a la materia que podemos ver. Esa sustancia cósmica (según creo), es la que da origen al surgir de las partículas de materia que, bajo ciertas condiciones de radiación y energía, hacen acto de presencia en nuestro universo material.

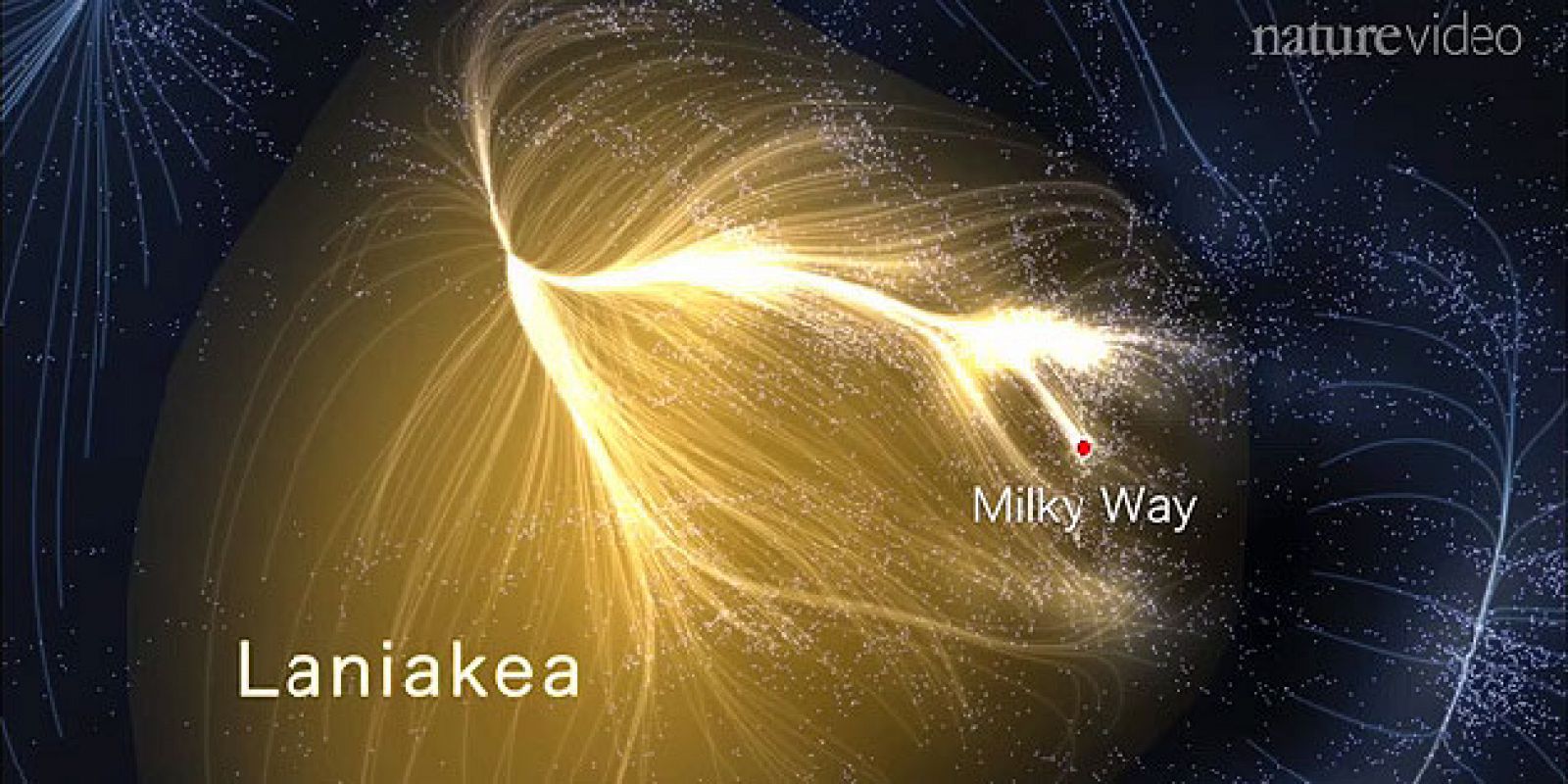

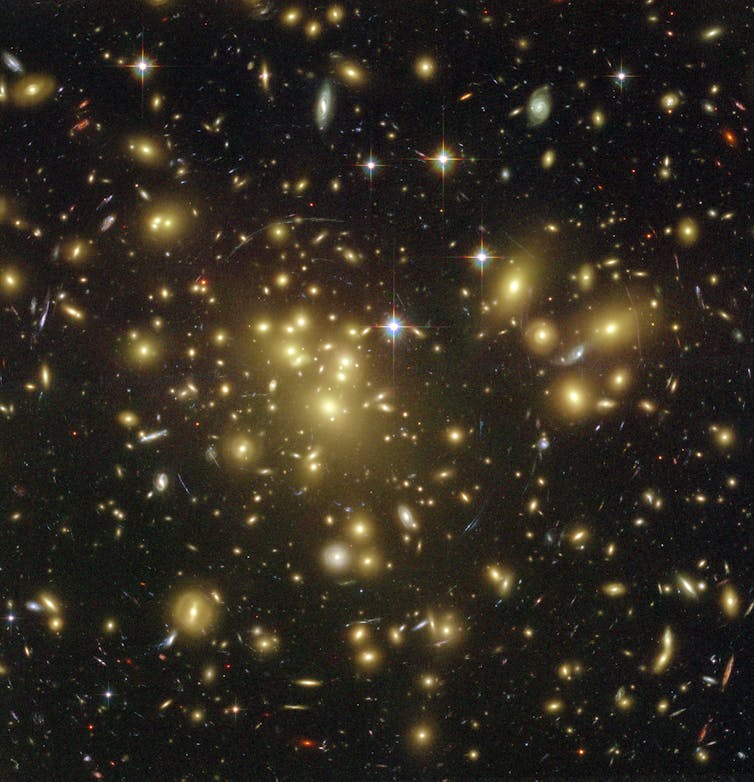

“Laniakea”, el renombrado ‘vecindario’ de 100.000 galaxias donde está la Vía Láctea

Con sus miles de millones de galaxias y sus cientos de miles de millones de estrellas, si niveláramos todo el material del universo para conseguir un mar uniforme de materia, nos daríamos cuenta de lo poco que existe de cualquier cosa. La media de materia del universo está en aproximadamente 1 átomo por cada metro cúbico de espacio. Ningún laboratorio de la Tierra podría producir un vacío artificial que fuera remotamente parecido al vacío del espacio estelar. El vacío más perfecto que hoy podemos alcanzar en un laboratorio terrestre contiene aproximadamente mil millones de átomos por m3.

de lo poco que existe de cualquier cosa. La media de materia del universo está en aproximadamente 1 átomo por cada metro cúbico de espacio. Ningún laboratorio de la Tierra podría producir un vacío artificial que fuera remotamente parecido al vacío del espacio estelar. El vacío más perfecto que hoy podemos alcanzar en un laboratorio terrestre contiene aproximadamente mil millones de átomos por m3.

Esta nueva manera de mirar el universo nos da nuevas ideas, no todo el espacio son agujeros negros, estrellas de neutrones, galaxias y desconocidos planetas; la verdad es que casi todo el universo está vacío y sólo en algunas regiones tiene agrupaciones de materia en forma de estrellas y otros objetos estelares y cosmológicos; muchas de sus propiedades y características más sorprendentes (su inmenso tamaño y su enorme edad, la soledad y oscuridad del espacio) son condiciones

nueva manera de mirar el universo nos da nuevas ideas, no todo el espacio son agujeros negros, estrellas de neutrones, galaxias y desconocidos planetas; la verdad es que casi todo el universo está vacío y sólo en algunas regiones tiene agrupaciones de materia en forma de estrellas y otros objetos estelares y cosmológicos; muchas de sus propiedades y características más sorprendentes (su inmenso tamaño y su enorme edad, la soledad y oscuridad del espacio) son condiciones necesarias para que existan observadores inteligentes como nosotros.

necesarias para que existan observadores inteligentes como nosotros.

Esta imagen circula mucho por los medios como posible observador inteligente fuera de la Tierra. Claro que, algunos creen que somos nosotros mismos en el futuro, han pasado muchos miles de años y, como todo en el universo, también hemos evolucionado y mutado para adaptarnos a los tiempos y a los diversos mundos que, para entonces habitamos.

posible observador inteligente fuera de la Tierra. Claro que, algunos creen que somos nosotros mismos en el futuro, han pasado muchos miles de años y, como todo en el universo, también hemos evolucionado y mutado para adaptarnos a los tiempos y a los diversos mundos que, para entonces habitamos.

Ni afirmar ni negar podemos. Como decía el gran cosmólogo: “La ausencia de pruebas no es prueba de ausencia.”

No debería sorprendernos la vida extraterrestre; si existe, pudiera ser tan rara y lejana para nosotros como en realidad nos ocurre aquí mismo en la Tierra, donde compartimos hábitat con otros seres vivos con los que hemos sido incapaces de comunicarnos, a pesar de que esas formas de vida, como la nuestra, están basadas también en el carbono. No se puede descartar formas de vida inteligente basadas en otros elementos, como por ejemplo, el silicio.

nosotros como en realidad nos ocurre aquí mismo en la Tierra, donde compartimos hábitat con otros seres vivos con los que hemos sido incapaces de comunicarnos, a pesar de que esas formas de vida, como la nuestra, están basadas también en el carbono. No se puede descartar formas de vida inteligente basadas en otros elementos, como por ejemplo, el silicio.

La baja densidad media de materia en el universo significa que si agregáramos material en estrellas o galaxias, deberíamos esperar que las distancias medias entre objetos fueran enormes.

objetos fueran enormes.

| El universo visible contiene sólo: |

| 1 átomo por metro cúbico |

1 Tierra por (10 años luz)3 luz)3 |

| 1 Estrella por (103 años luz)3 |

| 1 Galaxia por (107 años luz)3 |

| 1 “Universo” por (1010 años luz)3 |

El cuadro expresa la densidad de materia del universo de varias maneras diferentes que muestran el alejamiento que cabría esperar entre los planetas, estrellas y galaxias. No debería sorprendernos que encontrar vida extraterrestre sea tan raro.

Karl Jaspers

El filósofo existencialista que arriba aparece se sintió provocado por los escritos de Eddington a considerar el significado de nuestra existencia en un lugar particular en una época particular de la historia cósmica En su influyente libro “Origen y meta de la historia”, escrito en 1.949, poco después de la muerte de Eddington, pregunta:

“¿Por qué vivimos y desarrollamos nuestra historia en este punto concreto del espacio infinito, en un minúsculo grano de polvo en el universo, un rincón marginal? ¿Por qué precisamente ahora

en el tiempo infinito? Estas son cuestiones cuya insolubilidad nos hace conscientes de un enigma.

El hecho fundamental de nuestra existencia es que parecemos estar aislados en el cosmos. Somos los únicos seres racionales capaces de expresarse en el silencio del universo. En la historia del Sistema Solar se ha dado en la Tierra, durante un periodo de tiempo infinitesimalmente corto, una situación en la que los seres humanos evolucionan y adquieren conocimientos que incluye el ser conscientes de sí mismos y de existir… Dentro del Cosmos ilimitado, en un minúsculo planeta, durante un minúsculo periodo de tiempo de unos pocos milenios, algo ha tenido lugar como si este planeta fura lo que abarca todo, lo auténtico. Este es el lugar, una mota de polvo en la inmensidad del cosmos, en el que el ser ha despertado con el hombre”.

pocos milenios, algo ha tenido lugar como si este planeta fura lo que abarca todo, lo auténtico. Este es el lugar, una mota de polvo en la inmensidad del cosmos, en el que el ser ha despertado con el hombre”.

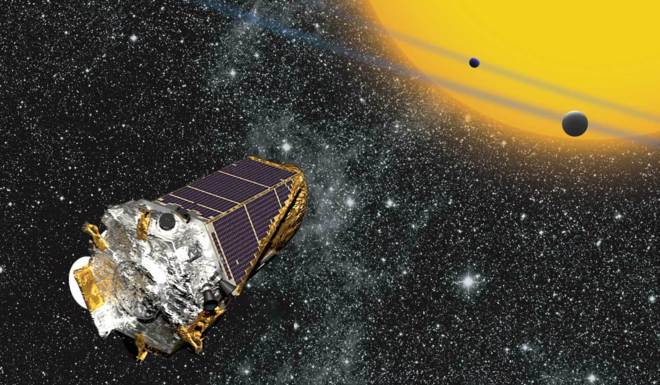

Sí, están muy lejos pero …¿están ahí realmente? Creo que sí, sólo falta saben como son

…¿están ahí realmente? Creo que sí, sólo falta saben como son

Hay aquí algunas grandes hipótesis sobre el carácter único de la vida humana en el universo (creo que equivocada). En cualquier caso se plantea la pregunta, aunque no se responde, de por qué estamos aquí en el tiempo y lugar en que lo hacemos. Hemos visto que la cosmología moderna puede ofrecer algunas respuestas esclarecedoras a estas preguntas.

ofrecer algunas respuestas esclarecedoras a estas preguntas.

En mi anterior trabajo quedaron reflejadas todas las respuestas a estas preguntas. Nada sucede porque sí, todo es consecuencia directa de la causalidad. Cada suceso tiene su razón de ser en función de unos hechos anteriores, de unas circunstancias, de unos fenómenos concretos que de no haberse producido, tampoco el tal suceso se habría significado, simplemente no existiría. Con la vida en nuestro planeta, ocurrió igual.

quedaron reflejadas todas las respuestas a estas preguntas. Nada sucede porque sí, todo es consecuencia directa de la causalidad. Cada suceso tiene su razón de ser en función de unos hechos anteriores, de unas circunstancias, de unos fenómenos concretos que de no haberse producido, tampoco el tal suceso se habría significado, simplemente no existiría. Con la vida en nuestro planeta, ocurrió igual.

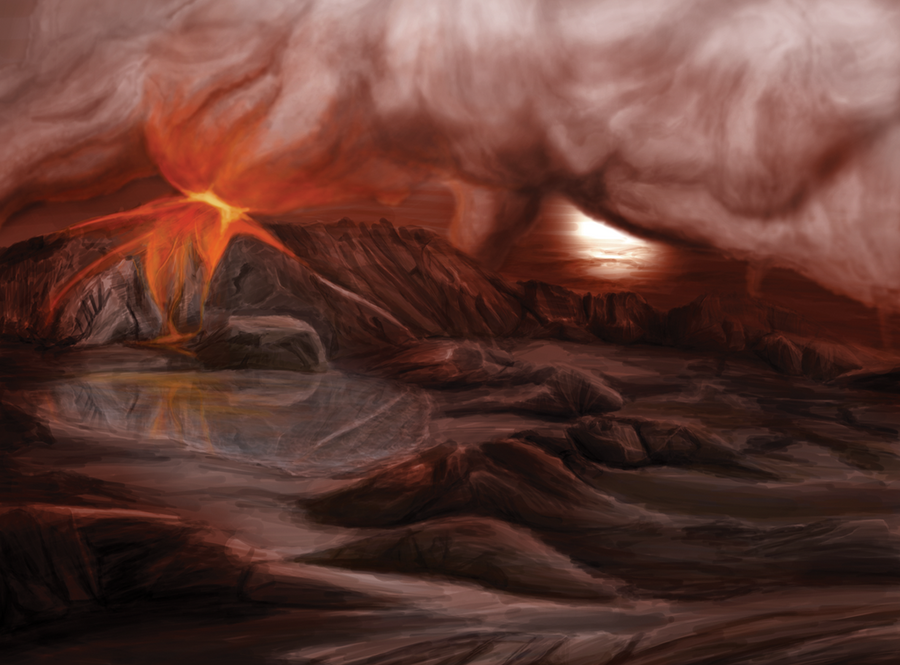

La actividad volcánica era intensa en los comienzos

Una atmósfera primitiva evolucionada, la composición primigenia de los mares y océanos con sus compuestos, expuestos al bombardeo continuo de radiación del espacio exterior que llegaba en ausencia de la capa de ozono, la temperatura ideal en relación a la distancia del Sol a la Tierra y otra serie de circunstancias muy concretas, como la edad del Sistema Solar y los componentes con elementos complejos del planeta Tierra, hecho del material estelar evolucionado a partir de supernovas, todos estos elementos y circunstancias especiales en el espacio y en el tiempo, hicieron posible el nacimiento de esa primera célula que fue capaz de reproducirse a sí misma y que, miles de años después, hizo posible que evolucionara hasta lo que hoy es el hombre que, a partir de materia inerte, se convirtió en un ser pensante que ahora es capaz de exponer aquí mismo estas cuestiones. ¡Es verdaderamente maravilloso!

es capaz de exponer aquí mismo estas cuestiones. ¡Es verdaderamente maravilloso!

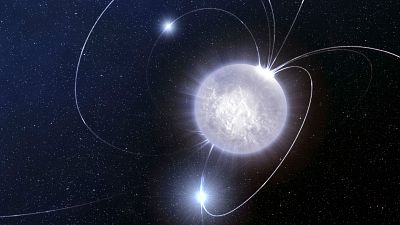

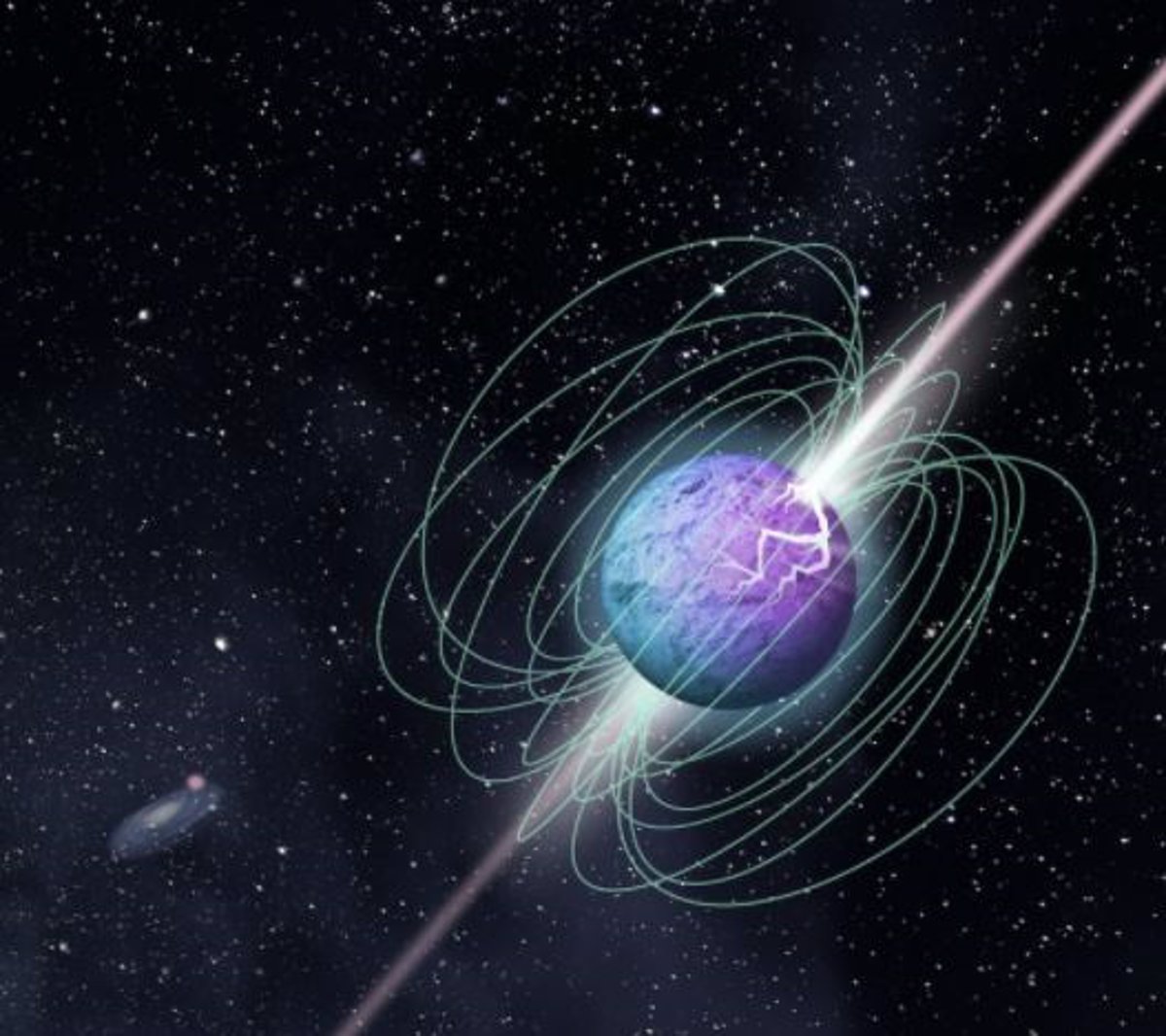

El entorno cambiante en un universo en expansión como el nuestro, a medida que se enfría y envejece (la entropía) es posible que se formen átomos, moléculas, galaxias, estrellas, planetas y organismos vivos. En el futuro, las estrellas agotaran su combustible nuclear y morirán todas. En función de sus masas serán estrellas enanas blancas (como nuestro Sol), estrellas de neutrones (a partir de 1’5 masas sobre hasta

el nuestro, a medida que se enfría y envejece (la entropía) es posible que se formen átomos, moléculas, galaxias, estrellas, planetas y organismos vivos. En el futuro, las estrellas agotaran su combustible nuclear y morirán todas. En función de sus masas serán estrellas enanas blancas (como nuestro Sol), estrellas de neutrones (a partir de 1’5 masas sobre hasta 3 masas solares) y agujeros negros a partir de 3 masas solares. Hay un recorrido de historia cósmica en el que nuestro tipo

3 masas solares) y agujeros negros a partir de 3 masas solares. Hay un recorrido de historia cósmica en el que nuestro tipo de evolución biológica debe ocurrir bajo esas circunstancias especiales a las que antes me referí.

de evolución biológica debe ocurrir bajo esas circunstancias especiales a las que antes me referí.

Imagen de la emisión en radio de un magnetar

No podemos saber cuándo, pero sí tenemos una idea muy clara de cómo será dicho final. El universo es todo lo que existe, incluyendo el espacio, el tiempo y la materia. El estudio del universo es la cosmología, que distingue entre el Universo con “U” mayúscula, significando el cosmos y su contenido, y el universo con “u” minúscula, que es normalmente un modelo matemático deducido de alguna teoría. El universo real está constituido en su mayoría por espacios aparentemente vacios, existiendo materia concentrada en galaxias formadas por estrellas y gas. El universo se está expandiendo, de manera que el espacio entre las galaxias está aumentando gradualmente, provocando un desplazamiento al rojo cosmológico en la luz procedente de los objetos distantes.*

el Universo con “U” mayúscula, significando el cosmos y su contenido, y el universo con “u” minúscula, que es normalmente un modelo matemático deducido de alguna teoría. El universo real está constituido en su mayoría por espacios aparentemente vacios, existiendo materia concentrada en galaxias formadas por estrellas y gas. El universo se está expandiendo, de manera que el espacio entre las galaxias está aumentando gradualmente, provocando un desplazamiento al rojo cosmológico en la luz procedente de los objetos distantes.*

Dicen algunos que existe una evidencia creciente de que el espacio está o puede estar lleno de una materia invisible, “materia oscura”, que puede constituir muchas veces la masa total de las galaxias visibles (materia bariónica). Sabemos que el origen más probable del universo está en al teoría conocida como

estar lleno de una materia invisible, “materia oscura”, que puede constituir muchas veces la masa total de las galaxias visibles (materia bariónica). Sabemos que el origen más probable del universo está en al teoría conocida como del Big Bang que, a partir de una singularidad de una densidad y energía infinita, hace ahora

del Big Bang que, a partir de una singularidad de una densidad y energía infinita, hace ahora unos 15 mil millones de años, surgió una inmensa bola de fuego que desde entonces no ha dejado de expandirse y enfriarse.

unos 15 mil millones de años, surgió una inmensa bola de fuego que desde entonces no ha dejado de expandirse y enfriarse.

Nos dicen que todo el Universo está impregnado de “materia oscura”. Pero ¿Dónde está?

¿Cómo se puede significar la proporción de materia oscura en la imagen, si, en realidad, ni sabemos que pueda existir. De todas las maneras, la proporción estaría mal reflejada en función de lo que dicen del 4% y del 23% más la “energía oscura… ¡una locura!

En el proceso, nació el tiempo y el espacio, surgieron las primeros quarks que pudieron unirse para formar protones y electrones que formaron los primeros núcleos y, cuando estos núcleos fueron rodeados por los electrones, nacieron los átomos que evolucionando y juntándose hicieron posible la materia; todo ello, interaccionado por cuatro fuerzas fundamentales que, desde

formar protones y electrones que formaron los primeros núcleos y, cuando estos núcleos fueron rodeados por los electrones, nacieron los átomos que evolucionando y juntándose hicieron posible la materia; todo ello, interaccionado por cuatro fuerzas fundamentales que, desde entonces, por la rotura de la simetría original divididas en cuatro parcelas distintas, rigen el universo. La fuerza nuclear fuerte responsable de mantener unidos los nucleones, la fuerza nuclear débil, responsable de la radiactividad natural desintegrando elementos como el uranio, el electromagnetismo que es el responsable de todos los fenómenos eléctricos y magnéticos, y la fuerza de gravedad que mantiene unidos los planetas y las galaxias.

entonces, por la rotura de la simetría original divididas en cuatro parcelas distintas, rigen el universo. La fuerza nuclear fuerte responsable de mantener unidos los nucleones, la fuerza nuclear débil, responsable de la radiactividad natural desintegrando elementos como el uranio, el electromagnetismo que es el responsable de todos los fenómenos eléctricos y magnéticos, y la fuerza de gravedad que mantiene unidos los planetas y las galaxias.

Pero hemos llegado a saber que el universo podrá ser abierto o cerrado. Un universo que siempre se expande y tiene una vida infinita es abierto. Esto es un universo de Friedmann que postuló que el nuestro tenía una densidad menor que la densidad crítica.

El universo cerrado es el que es finito en tamaño, tiene una vida finita y en el que el espacio está curvado positivamente. Un universo de Friedman con la densidad mayor que la densidad crítica.

El universo en expansión es el que el espacio entre los objetos está aumentando continuamente. En el universo real, los objetos vecinos como los pares de galaxias próximas entre sí no se separan debido a que su atracción gravitatoria mutua supera los efectos de la expansión cosmológica (el caso de la Vía Láctea y Andrómeda). No obstante, la distancia entre dos galaxias muy separadas, o entre dos cúmulos de galaxias, aumenta con el paso del tiempo y la expansión imparable del universo.

los objetos está aumentando continuamente. En el universo real, los objetos vecinos como los pares de galaxias próximas entre sí no se separan debido a que su atracción gravitatoria mutua supera los efectos de la expansión cosmológica (el caso de la Vía Láctea y Andrómeda). No obstante, la distancia entre dos galaxias muy separadas, o entre dos cúmulos de galaxias, aumenta con el paso del tiempo y la expansión imparable del universo.

El universo real está en función de la densidad crítica que es la densidad media de materia requerida para que la gravedad detenga la expansión del universo. Un universo con una densidad muy baja se expandirá para siempre, mientras que uno con densidad muy alta colapsara finalmente. Un universo con exactamente la densidad crítica, alrededor de 10-29g/cm3, es descrito por el modelo de universo de Einstein-de Sitter, que se encuentra en la línea divisoria de estos dos extremos. Pero la densidad media de materia que puede

que la gravedad detenga la expansión del universo. Un universo con una densidad muy baja se expandirá para siempre, mientras que uno con densidad muy alta colapsara finalmente. Un universo con exactamente la densidad crítica, alrededor de 10-29g/cm3, es descrito por el modelo de universo de Einstein-de Sitter, que se encuentra en la línea divisoria de estos dos extremos. Pero la densidad media de materia que puede ser observada directamente en nuestro universo no representa la cantidad necesaria para generar la fuerza de gravedad que se observa en la velocidad de alejamiento de las galaxias, que necesita mucha más materia que la observada para generar esta fuerza gravitatoria, lo que nos da una prueba irrefutable de que ahí fuera, en el espacio entre galaxias, está oculta esa otra materia invisible, la “materia oscura”, que nadie sabe lo que es, cómo se genera o de qué esta

ser observada directamente en nuestro universo no representa la cantidad necesaria para generar la fuerza de gravedad que se observa en la velocidad de alejamiento de las galaxias, que necesita mucha más materia que la observada para generar esta fuerza gravitatoria, lo que nos da una prueba irrefutable de que ahí fuera, en el espacio entre galaxias, está oculta esa otra materia invisible, la “materia oscura”, que nadie sabe lo que es, cómo se genera o de qué esta hecha. Así que, cuando seamos capaces de abrir esa puerta cerrada ante nuestras narices, podremos por fin saber la clase de universo en el que vivimos; si es plano, si es abierto e infinito, o si es un universo que, por su contenido enorme de materia es curvo y cerrado.

hecha. Así que, cuando seamos capaces de abrir esa puerta cerrada ante nuestras narices, podremos por fin saber la clase de universo en el que vivimos; si es plano, si es abierto e infinito, o si es un universo que, por su contenido enorme de materia es curvo y cerrado.

Claro que saber la cantidad de materia que pueda contener nuestro universo, no resultará tan fácil como mirar a las estrellas. Aunque alguna idea tenemos…, con certeza nada sabemos en relación a infinut de cuestiones con el Universo relacionadas…, a otras sí hemos podido acercarnos algo más. Pero la respuesta a la pregunta, aún sin saber exactamente cuál es la densidad crítica del universo, sí podemos contestarla en dos vertientes, en la seguridad de que al menos una de las dos es la verdadera.

una de las dos es la verdadera.

El destino final será:

a) Si el universo es abierto y se expande para siempre, cada

vez se hará más frio, las galaxias se alejarán las unas de las otras, la entropía hará desaparecer la energía y el frio será tal que la temperatura alcanzará el cero absoluto, -273ºK. La vida no podrá estar presente.

b) Si el universo es cerrado por contener una mayor cantidad de materia, llegará un momento en que la fuerza de gravedad detendrá la expansión de las galaxias, que poco a poco se quedarán quietas y muy lentamente, comenzaran a moverse en el sentido inverso; correrán ahora

las unas hacia las otras hasta que un día, a miles de millones de años en el futuro, todo la materia del universo se unirá en una enorme bola de fuego, el Big Crunch. Se formará una enorme concentración de materia de energía y densidad infinitas. Habrá dejado de existir el espacio y el tiempo. Nacerá una singularidad que, seguramente, dará lugar a otro Big Bang. Todo empezará de nuevo

, otro universo, otro ciclo ¿pero aparecemos también nosotros en ese nuevo universo?

c) Nadie lo sabe.

Claro que, esa  pregunta nadie la sabe contestar.

pregunta nadie la sabe contestar.

Aquí sabemos de la infinitud de galaxias que conforma nuestro universo, de la entropía que acompaña al inexorable pasar del tiempo, el espacio que nos separa de los objetos del cosmos, de cómo está formada la materia conocida…y, sin embargo, no sabemos muchas de las cosas que nos rodean y, tampoco de nosotros mismos.

Contemplamos en la imagen de más arriba como muchas galaxias terminan por fusionarse. Así podría ser el futuro de la Vía Láctea y Andrómeda. ¿Y nosotros, dónde estaremos para cuando eso ocurra? Y, ¿Cuándo el Sol se convierta en Gigante roja primero y Nebulosa planetaria después, si hemos podido sobrevivir, ¿Dónde nos habremos instalados? ¿Qué nuevos mundos serán nuestros hogares?

cuando eso ocurra? Y, ¿Cuándo el Sol se convierta en Gigante roja primero y Nebulosa planetaria después, si hemos podido sobrevivir, ¿Dónde nos habremos instalados? ¿Qué nuevos mundos serán nuestros hogares?

En el futuro, si seguimos aquí, tendremos que buscar nuevos mundos para alojar a la Humanidad

Así las cosas, no parece que el futuro de la Humanidad sea muy alentador. Claro que los optimistas nos hablan de hiperespacio y universos paralelos a los que, para ese tiempo, ya habremos podido desplazarnos garantizando la continuidad de la especie Humana. Bien pensado, si no fuera así ¿para qué tantas dificultades vencidas y tantas calamidades pasadas? ¿Para terminar congelados o consumidos por un fuego abrasador?

¡Quién pudiera contestar a eso!

Cuando pensamos en la edad y el tamaño del universo lo hacemos generalmente utilizando medidas de tiempo y espacio como años, kilómetros o años-luz. Como ya hemos visto, estas medidas son extraordinariamente antropomórficas. ¿Por qué medir la edad del universo con un “reloj” que hace “tic” cada vez que nuestro planeta completa una órbita alrededor de su estrella madre, el Sol? ¿Por qué medir su densidad en términos de átomos por metro cúbico? Las respuestas a estas preguntas son por supuesto la misma: porque es conveniente y siempre lo hemos hecho así.

vez que nuestro planeta completa una órbita alrededor de su estrella madre, el Sol? ¿Por qué medir su densidad en términos de átomos por metro cúbico? Las respuestas a estas preguntas son por supuesto la misma: porque es conveniente y siempre lo hemos hecho así.

Nada en nuestro Universo es eterno, todo tiene un comienzo y un final, el Sol no es una excepción

Si para entonces hemos aguantado, sabremos lo que tenemos que hacer para que nuestra especie perdure. Y, espero con fuerzas que, para cuando eso llegue a pasar, todos tengamos consciencia de que, el dolor del otro es nuestro dolor.

para que nuestra especie perdure. Y, espero con fuerzas que, para cuando eso llegue a pasar, todos tengamos consciencia de que, el dolor del otro es nuestro dolor.

Ésta es una situación en donde resulta especialmente apropiado utilizar las unidades “naturales”; la masa, longitud y tiempo de Stoney y Planck, las que ellos introdujeron en la ciencia física para ayudarnos a escapar de la camisa de fuerza que suponía la perspectiva centrada e el ser humano.

ayudarnos a escapar de la camisa de fuerza que suponía la perspectiva centrada e el ser humano.

Es fácil caer en la tentación de mirarnos el ombligo y no hacerlo al entorno que nos rodea. Muchas más cosas habríamos evitado y habríamos descubierto si por una sola vez hubiésemos dejado el ego a un lado y, en lugar de estar pendientes de nosotros mismos, lo hubiéramos hecho con respecto a la naturaleza que, en definitiva, es la que nos enseña el camino a seguir.

Hemos aprendido a utilizar las herramientas que nos facilita la Naturaleza y hemos desentrañado sus números mágicos, sus unidades puras y sin dimensión que nos hablan del limite de las teorías actuales pero… ¿Podremos ir mucho más allá? ¿Sabremos alguna vez plantear una teoría cuántica de la gravedad si eso fuera posible? ¿Llegaremos algún día a dominar “de verdad” los viajes espaciales” para poder situarnos en otros mundos? ¿Podríamos…

La edad actual del universo visible ≈ 1060 tiempos de Planck

Tamaño actual del Universo visible ≈ 1060 longitudes de Planck

La masa actual del Universo visible ≈ 1060 masas de Planck

Vemos así que la bajísima densidad de materia en el universo es un reflejo del hecho de que:

Densidad actual del universo visible ≈10-120 de la densidad de Planck

Y la temperatura del espacio, a 3 grados sobre el cero absoluto es, por tanto

Temperatura actual del Universo visible ≈ 10-30 de la Planck

Estos números extraordinariamente grandes y estas fracciones extraordinariamente pequeñas nos muestran inmediatamente que el universo está estructurado en una escala sobrehumana de proporciones asombrosas cuando la sopesamos en los balances de su propia construcción.

la sopesamos en los balances de su propia construcción.

Con respecto a sus propios patrones, el universo es viejo. El tiempo de vida natural de un mundo gobernado por la gravedad, la relatividad y la mecánica cuántica es el fugaz breve tiempo de Planck. Parece que es mucho más viejo de lo que debería ser.

Pero , pese a la enorme edad del universo en “tics” de Tiempo de Planck, hemos aprendido que casi todo este tiempo es necesario para producir estrellas y los elementos químicos que traen la vida.

, pese a la enorme edad del universo en “tics” de Tiempo de Planck, hemos aprendido que casi todo este tiempo es necesario para producir estrellas y los elementos químicos que traen la vida.

¿Por qué nuestro universo no es mucho más viejo de lo que parece ser? Es fácil entender por qué el universo no es mucho más joven. Las estrellas tardan mucho tiempo en formarse y producir elementos más pesados que son las que requiere la complejidad biológica. Pero los universos viejos también tienen sus problemas. Conforme para el tiempo en el universo el proceso de formación de estrellas se frena. Todo el gas y el polvo cósmico que constituyen las materias primas de las estrellas habrían sido procesados por las estrellas y lanzados al espacio intergaláctico donde no pueden enfriarse y fundirse en nuevas estrellas. Pocas estrellas hacen que, a su vez, también sean pocos los sistemas solares y los planetas. Los planetas que se forman son menos activos que los que se formaron antes, la entropía va debilitando la energía del sistema para realizar trabajo

el tiempo en el universo el proceso de formación de estrellas se frena. Todo el gas y el polvo cósmico que constituyen las materias primas de las estrellas habrían sido procesados por las estrellas y lanzados al espacio intergaláctico donde no pueden enfriarse y fundirse en nuevas estrellas. Pocas estrellas hacen que, a su vez, también sean pocos los sistemas solares y los planetas. Los planetas que se forman son menos activos que los que se formaron antes, la entropía va debilitando la energía del sistema para realizar trabajo .

.

La producción de elementos radiactivos en las estrellas disminuirá, y los que se formen tendrán semividas más largas. Los nuevos planetas serán menos activos geológicamente y carecerán de muchos de los movimientos internos que impulsan el vulcanismo, la deriva continental y la elevación de las montañas en el planeta. Si esto también hace menos probable la presencia de un campo magnético en un planeta, entonces será muy poco probable que la vida evolucione hasta formas complejas.

formas complejas.

Emilio Silvera Vázquez

* Los objetos que se alejan, desplazan su luz hacia el rojo. Si se acercan, su luz se desplaza hacia el azul. (Efecto Doppler)

el rojo. Si se acercan, su luz se desplaza hacia el azul. (Efecto Doppler)

Mar

23

¡Fluctuaciones de vacío! ¿Que son?

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en ¡Tenemos que saber! ~

Clasificado en ¡Tenemos que saber! ~

Comments (1)

Comments (1)

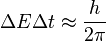

En física cuántica, la fluctuación cuántica es un cambio temporal en la cantidad de energía en un punto en el espacio como resultado del Principio de Incertidumbre que imaginó Werner Heisenberg. De acuerdo a una formulación de este principio energía y tiempo se relacionan de la siguiente forma:

Esto significa que la conservación de la energía puede parecer violada, pero sólo por breves lapsos. Esto permite la creación de pares partícula-antipartícula de partículas virtuales. El efecto de esas partículas es medible, por ejemplo, en la carga efectiva del electrón, diferente de su carga “desnuda”. En una formulación actual, la energía siempre se conserva, pero los estados propios del Hamiltoniano no son los mismos que los del operador del número de partículas, esto es, si está bien definida la energía del sistema no está bien definido el número de partículas del mismo, y viceversa, ya que estos dos operadores no conmutan.

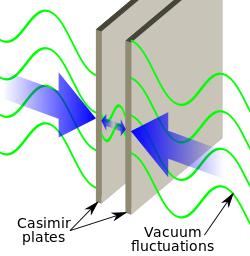

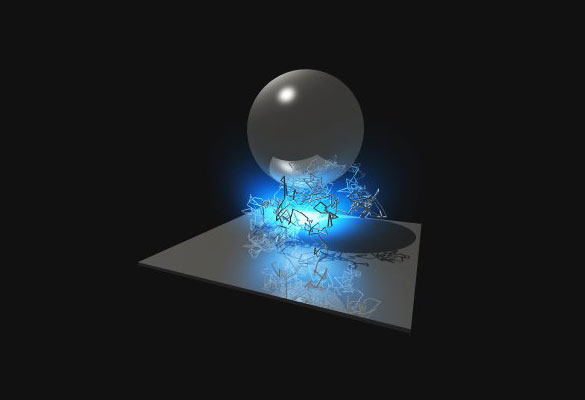

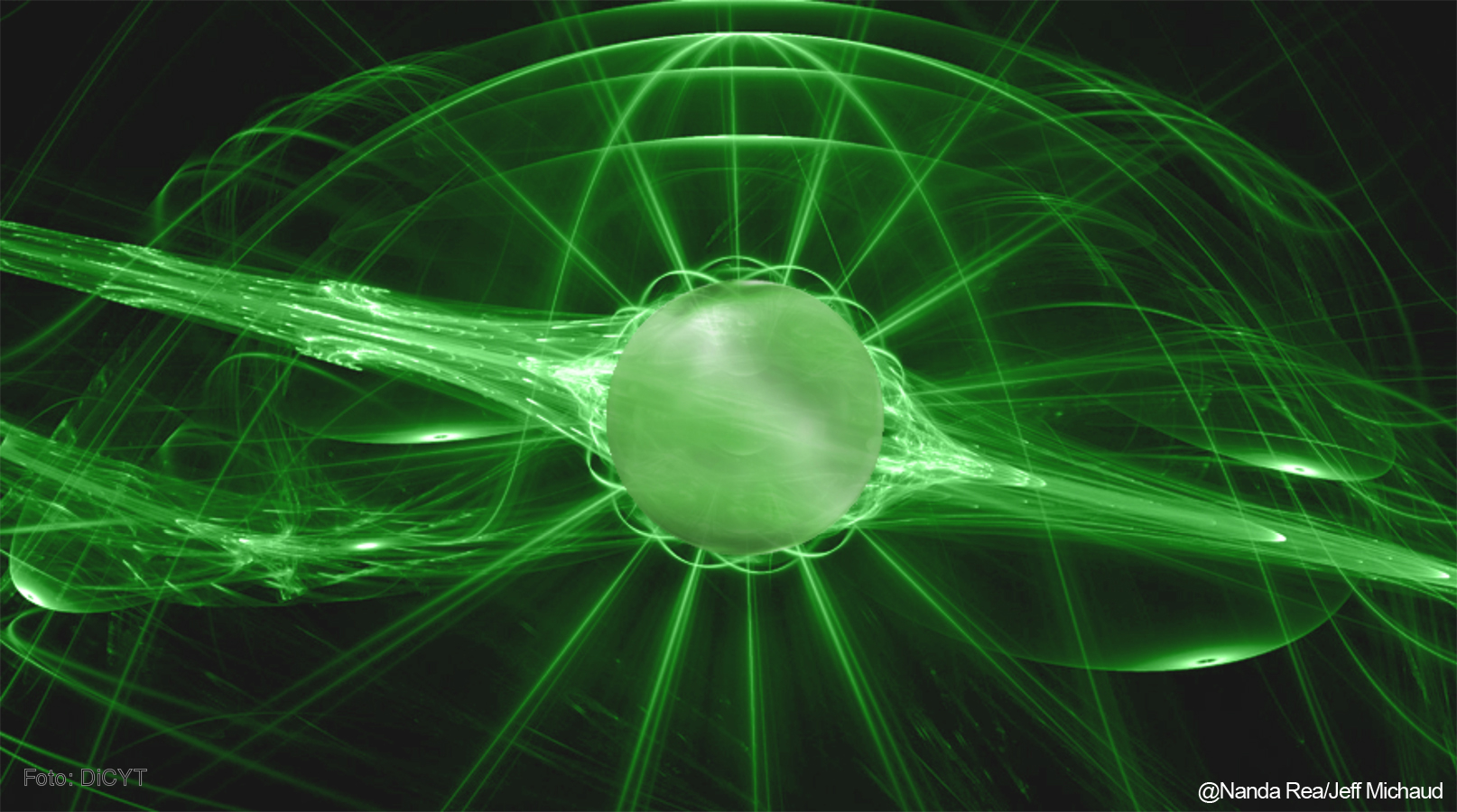

Las fluctuaciones del vacío entre una esfera y una superficie plana

En un estudio realizado por un equipo de físicos con avanzados aparatos, han hallado un resultado del que nos dicen:

“La materia se construye sobre fundamentos frágiles. Los físicos acaban de confirmar que la materia, aparentemente sustancial, es en realidad nada más que fluctuaciones en el vació cuántico. Los investigadores simularon la frenética actividad que sucede en el interior de los protones y neutrones, que como sabéis son las partículas que aportan casi la totalidad de la masa a la materia común.

Cada protón (o neutrón) se compone de tres quarks – véase ilustración – pero las masas individuales de estos quarks apenas comprenden el 1% del total de la masa del protón ¿Entonces de dónde sale el resto? La teoría sostiene que esta masa es creada por la fuerza que mantiene pegados a los quarks, y que se conoce como fuerza nuclear fuerte. En términos cuánticos, la fuerza fuerte es contenida por un campo de partículas virtuales llamadas gluones, las cuales irrumpen aleatoriamente en la existencia para desaparecer de nuevo. La energía de estas fluctuaciones del vacío debe sumarse a la masa total del neutrón y del protón.”

Tiene y encierra tantos misterios la materia que estamos aún y años-luz de saber y conocer sobre su verdadera naturaleza. Es algo que vemos en sus distintas formas materiales que configuran y conforman todo lo material desde las partículas elementales hasta las montañas y los océanos. Unas veces está en estado “inerte” y otras, se eleva hasta la vida que incluso, en ocasiones, alcanza la consciencia de SER. Sin embargo, no acabamos de dilucidar de dónde viene su verdadero origen, su esencia, lo que era antes de “ser” materia. ¿Existe acaso una especie de sustancia cósmica anterior a la materia? Y, si realmente existe esa sustancia… ¿Dónde está?

y conocer sobre su verdadera naturaleza. Es algo que vemos en sus distintas formas materiales que configuran y conforman todo lo material desde las partículas elementales hasta las montañas y los océanos. Unas veces está en estado “inerte” y otras, se eleva hasta la vida que incluso, en ocasiones, alcanza la consciencia de SER. Sin embargo, no acabamos de dilucidar de dónde viene su verdadero origen, su esencia, lo que era antes de “ser” materia. ¿Existe acaso una especie de sustancia cósmica anterior a la materia? Y, si realmente existe esa sustancia… ¿Dónde está?

Claro que hemos llegado a saber que las llamadas fluctuaciones del vacío son oscilaciones aleatorias, impredecibles e in-eliminables de un campo de fuerza (electromagnético o gravitatorio) que son debidas a un “tira y afloja” en el que pequeñas regiones del espacio toman prestada, momentáneamente, energía de regiones adyacentes y luego las devuelven. Pero…

– ¿Qué regiones adyacentes?

Acaso universos paralelos, acaso defomaciones del espacio-tiempo a escalas microscópicas, micros agujeros negros que pasan a ser agujeros blancos salidos de estas regiones o campos de fuerza que no podemos ver pero sí sentir, y, en última instancia, ¿por qué se forman esas partículas virtuales que de inmediato se aniquilan y desaparecen antes de que puedan ser capturadas? ¿Qué sentido tiene todo eso?

Las consecuencias de la existencia del cuanto mínimo de acción fueron revolucionarios para la comprensión del vacío. Mientras la continuidad de la acción clásica suponía un vacío plano, estable y “realmente” vacío, la discontinuidad que supone el cuanto nos dibuja un vacío inestable, en continuo cambio y muy lejos de poder ser considerado plano en las distancias atómicas y menores. El vacío cuántico es de todo menos vacío, en él la energía nunca puede quedar estabilizada en valor cero, está fluctuando sobre ese valor, continuamente se están creando y aniquilando todo tipo de partículas, llamadas por eso virtuales, en las que el producto de su energía por el tiempo de su existencia efímera es menor que el cuanto de acción. Se llaman fluctuaciones cuánticas del vacío y son las responsables de que exista un campo que lo inunda todo llamado campo de punto cero.

que lo inunda todo llamado campo de punto cero.

Pero volvamos de nuevo a las fluctuaciones de vacío, que al igual que las ondas “reales” de energía positiva, están sujetas a las leyes de la dualidad onda/partícula; es decir, tienen tanto aspectos de onda como aspectos de partícula.

Las ondas fluctúan de forma aleatoria e impredecible, con energía positiva momentáneamente aquí, energía negativa momentáneamente allí, y energía cero en promedio. El aspecto de partícula está incorporado en el concepto de partículas virtuales, es decir, partículas que pueden nacer en pares (dos partículas a un tiempo), viviendo temporalmente de la energía fluctuacional tomada prestada de regiones “vecinas” del espacio , y que luego se aniquilan y desaparecen, devolviendo la energía a esas regiones “vecinas”. Si hablamos de fluctuaciones electromagnéticas del vacío, las partículas virtuales son fotones virtuales; en el caso de fluctuaciones de la gravedad en el vacío, son gravitones virtuales.

, y que luego se aniquilan y desaparecen, devolviendo la energía a esas regiones “vecinas”. Si hablamos de fluctuaciones electromagnéticas del vacío, las partículas virtuales son fotones virtuales; en el caso de fluctuaciones de la gravedad en el vacío, son gravitones virtuales.

De las llamadas fluctuaciones de vacío pueden surgir, partículas virtuales y quién sabe que cosas más… Hasta un nuevo Universo.

Son muchas las preguntas que no tienen respuestas

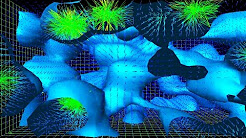

Parece que las fluctuaciones ocurren en cualquier lugar, pero que, son tan minúsculas que ningún observador o experimentador las ha detectado de una manera franca hasta la fecha y, se sabe que están ahí por experimentos que lo han confirmado. Estas fluctuaciones son más poderosas cuanto menos escala se considera en el espacio y, por debajo de la longitud de Planck-Wheeler las fluctuaciones de vacío son tan enormes que el espacio tal como lo conocemos “pareciera estar hirviendo” para convertirse en una especie de espuma cuántica que parece que en realidad, cubre todo el espacio “vacío cuántico” que sabemos que está ahí y es el campo del que surgen esas partículas virtuales que antes mencionaba.

¿Espuma cuántica? Si profundizamos mucho en la materia… Podríamos ver otro universo distinto al nuestro. Las cosas miles de millones de veces más pequeñas que en nuestro mundo cotidiano, no parecen las mismas cosas.

Hay magnitudes asociadas con las leyes de la gravedad cuántica. La longitud de Planck-Wheeler, ![]() es la escala de longitud por debajo de la cual el espacio

es la escala de longitud por debajo de la cual el espacio tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro. ¡Qué locura!

tal como lo conocemos deja de existir y se convierte en espuma cuántica. El tiempo de Planck-Wheeler (1/c veces la longitud de Planck-Wheeler o aproximadamente 10-43 segundos), es el intervalo de tiempo más corto que puede existir; si dos sucesos están separados por menos que esto, no se puede decir cuál sucede antes y cuál después. El área de Planck-Wheeler (el cuadrado de la longitud de Planck-Wheeler, es decir, 2,61×10-66cm2) juega un papel clave en la entropía de un agujero negro. ¡Qué locura!

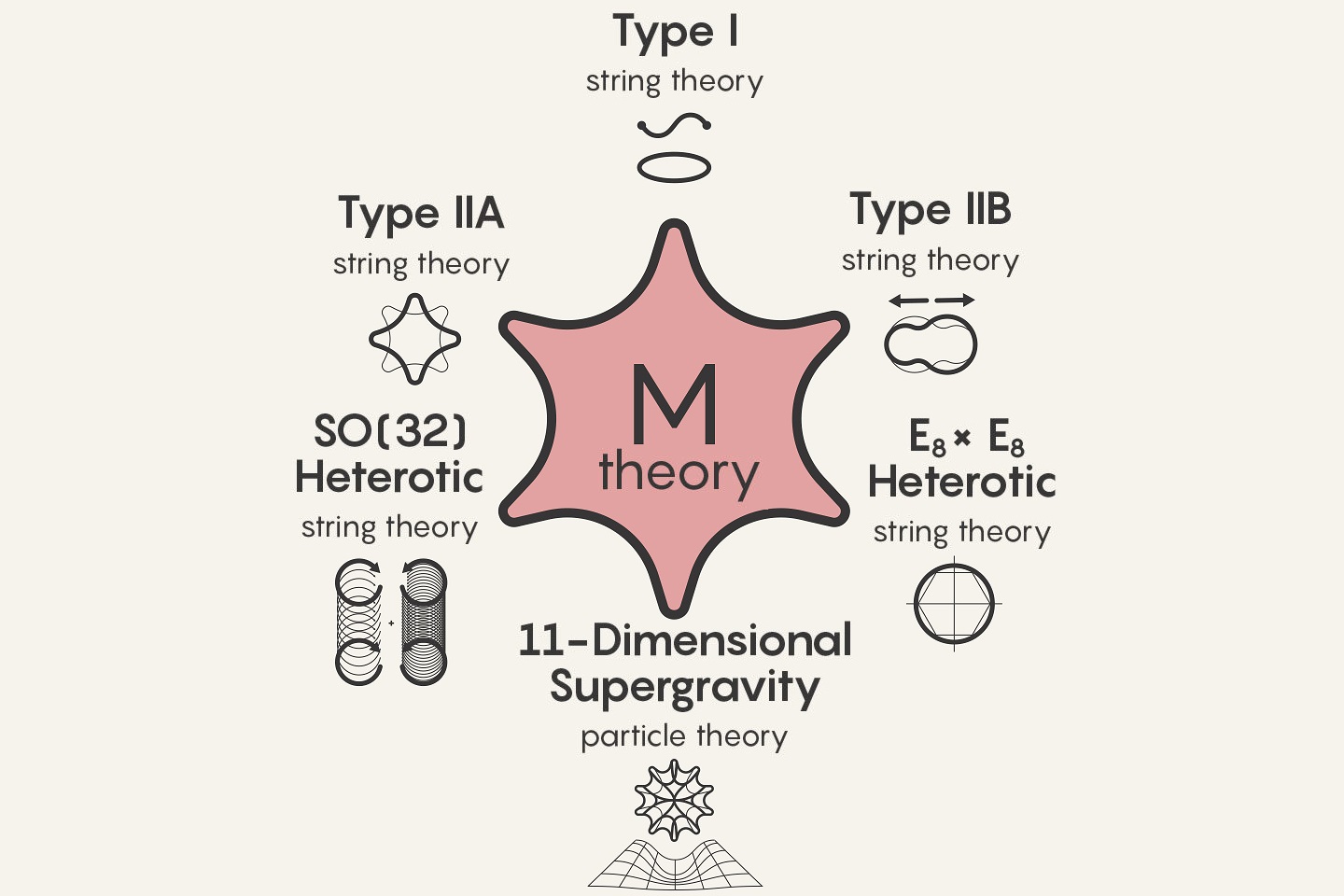

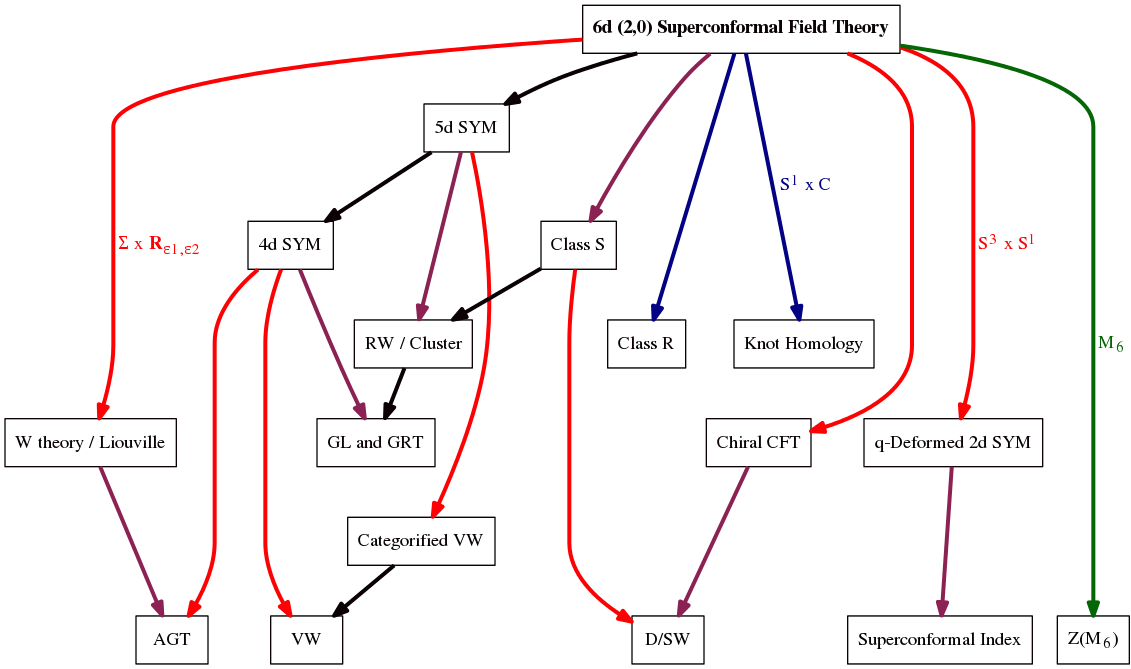

Una teoría que junte esas dos teorías de la cuántica y la relatividad

Como tantas veces hemos comentado, los trabajos que se han realizado sobre poder construir una teoría cuántica de la gravedad nos llevan a un número sorprendente de implicaciones. Por un lado, sólo se ha podido conceptuar a la gravedad cuántica, siempre y cuando, el universo tenga más de cuatro dimensiones. Además, se llega a considerar que en la era de Planck, tanto el universo como la gravedad pudieron ser una sola cosa compacta estructurada por objetos cuánticos infinitamente diminutos, como los que suponemos que conforman las supercuerdas. A esta escala, el mismísimo espacio-tiempo estaría sometido a imprescindibles fluctuaciones muy semejantes a las que causan las partículas al nacer y desaparecer de la existencia en el espacio-tiempo ordinario. Esta noción ha conducido a los teóricos a describir el universo de la era cuántica como una especie de extremadamente densa y agitada espuma que pudo haber contenido las vibrantes cuerdecillas que propugnan los cosmólogos cuerdistas.

sorprendente de implicaciones. Por un lado, sólo se ha podido conceptuar a la gravedad cuántica, siempre y cuando, el universo tenga más de cuatro dimensiones. Además, se llega a considerar que en la era de Planck, tanto el universo como la gravedad pudieron ser una sola cosa compacta estructurada por objetos cuánticos infinitamente diminutos, como los que suponemos que conforman las supercuerdas. A esta escala, el mismísimo espacio-tiempo estaría sometido a imprescindibles fluctuaciones muy semejantes a las que causan las partículas al nacer y desaparecer de la existencia en el espacio-tiempo ordinario. Esta noción ha conducido a los teóricos a describir el universo de la era cuántica como una especie de extremadamente densa y agitada espuma que pudo haber contenido las vibrantes cuerdecillas que propugnan los cosmólogos cuerdistas.

Los físicos especulan que el cosmos ha crecido a desde una «nada» primigenia que al nacer comenzó el principio del tiempo y que, en ese parto, contenía toda la materia y toda la energía.

En física como en todas las demás disciplinas científicas, los conocimientos avanzan y las teorías que sostuvieron los cimientos de nuestros conocimientos se van haciendo viejas y van teniendo que ser reforzadas con las nuevas y más poderosas “vigas” de las nuevas ideas y los nuevos hallazgos científicos que hacen posible ir perfeccionando lo que ya teníamos.

Recientemente se han alzado algunas voces contra el Principio de Incertidumbre de Heisenberg. He podido leer en un artículo de la prestigiosa Revista Nature, un artículo del premio Nobel de Física Gerald ´t Hoofft, en el que propone que la naturaleza probabilística de la mecánica cuántica, desaparecería a la escala de Planck, en la que el comportamiento de la materia sería determinista; a longitudes mayores, energías más pequeñas.

El mundo de lo muy pequeño (el micro espacio), a nivel atómico y subatómico, es el dominio de la física cuántica, así nunca podríamos saber, de acuerdo m con el principio de incertidumbre, y, en un momento determinado, la posición y el estado de una partícula. Este estado podría ser una función de la escala espacio-temporal. A esta escala tamaños todo sucede demasiado deprisa para nosotros.

El “universo cuántico” nada es lo que parece a primera vista, allí entramos en otro mundo que en nada, se parece al nuestro

Cuando hablamos de la mecánica cuántica, tenemos mirar un poco hacia atrás en el tiempo y podremos darnos cuenta del gran impacto que tuvo en el devenir del mundo desde que, en nuestras vidas, apareció el átomo y, más tarde, sus contenidos. Los nombres de Planck, Einstein, Bohr, Heisenberg, Schrödinger, Pauli, Bardeen, Roentgen, Dirac y muchos otros, se pudieron a la cabeza de la lista de las personas más famosas. Aquel primer premio Nobel de Física otorgado en 1900 a Roentgen por descubrir los rayos X, en el mismo año llegaría el ¡cuanto! De Planck que inspiró a Einstein para su trabajo sobre el Efecto fotoeléctrico que también, le valdría el Nobel, y, a partir de ese momento, se desencadenó una especie de carrera

del gran impacto que tuvo en el devenir del mundo desde que, en nuestras vidas, apareció el átomo y, más tarde, sus contenidos. Los nombres de Planck, Einstein, Bohr, Heisenberg, Schrödinger, Pauli, Bardeen, Roentgen, Dirac y muchos otros, se pudieron a la cabeza de la lista de las personas más famosas. Aquel primer premio Nobel de Física otorgado en 1900 a Roentgen por descubrir los rayos X, en el mismo año llegaría el ¡cuanto! De Planck que inspiró a Einstein para su trabajo sobre el Efecto fotoeléctrico que también, le valdría el Nobel, y, a partir de ese momento, se desencadenó una especie de carrera alucinante por saber sobre el átomo, sus contenidos, y, de qué estaba hecha la materia.

alucinante por saber sobre el átomo, sus contenidos, y, de qué estaba hecha la materia.

La conocida como Paradoja EPR y los conceptos de Tiempo y Espacio , presente, pasado y futuro

, presente, pasado y futuro

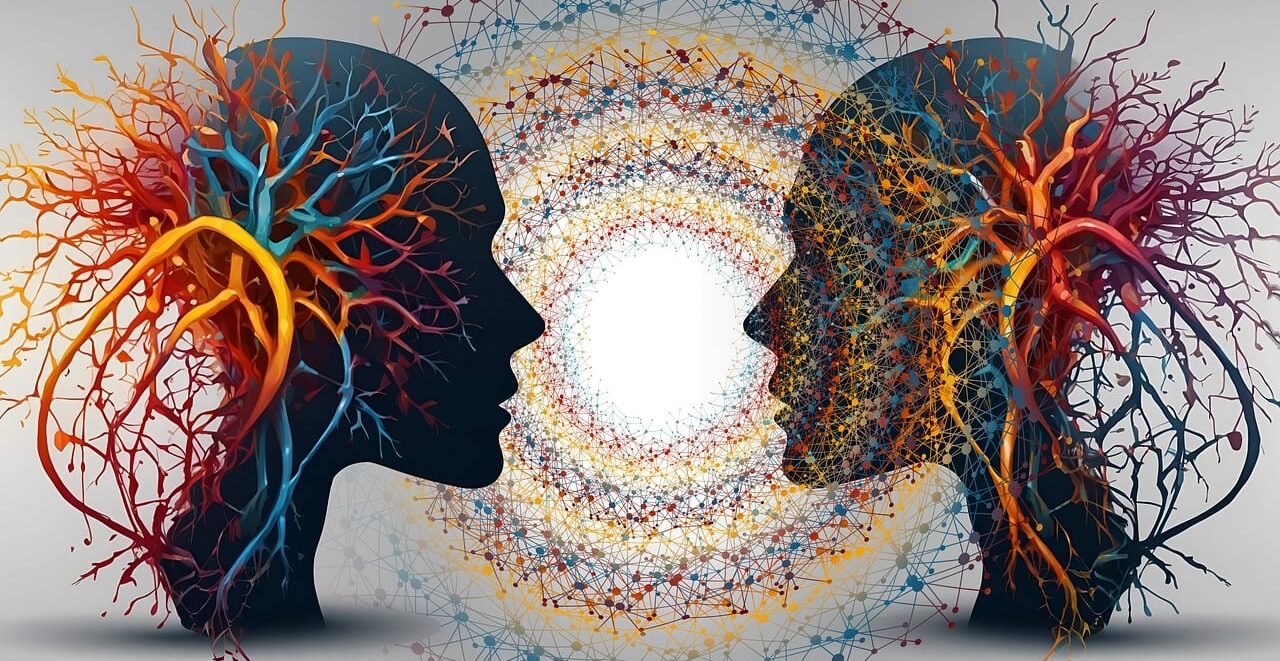

Fueron muchas las polémicas desatadas a cuenta de las aparentes incongruencias de la moderna Mecánica Cuántica. La paradoja de Einstein-Podolsky-Rosen, denominada “Paradoja EPR”, trata de un experimento mental propuesto por Albert Einstein, Boris Podolsky y Nathan Rosen en 1935. Es relevante, pues pone de manifiesto un problema aparente de la mecánica cuántica, y en las décadas siguientes se dedicaron múltiples esfuerzos a desarrollarla y resolverla.

A Einstein (y a muchos otros científicos), la idea del entrelazamiento cuántico le resultaba extremadamente perturbadora. Esta particular característica de la mecánica cuántica permite preparar estados de dos o más partículas en los cuales es imposible obtener información útil sobre el estado total del sistema haciendo sólo mediciones sobre una de las partículas.

útil sobre el estado total del sistema haciendo sólo mediciones sobre una de las partículas.

Por otro lado, en un estado entrelazado, manipulando una de las partículas, se puede modificar el estado total. Es decir, operando sobre una de las partículas se puede modificar el estado de la otra a distancia de manera instantánea. Esto habla de una correlación entre las dos partículas que no tiene paralaje en el mundo de nuestras experiencias cotidianas. Cabe enfatizar pues que cuando se mide el estado de una partícula, enseguida sabemos el estado de la otra, lo cual aparentemente es instantáneo, es decir, sin importar las distancias a las que se encuentren las partículas, una de la otra, ambas saben instantáneamente el estado de la otra.

entrelazado, manipulando una de las partículas, se puede modificar el estado total. Es decir, operando sobre una de las partículas se puede modificar el estado de la otra a distancia de manera instantánea. Esto habla de una correlación entre las dos partículas que no tiene paralaje en el mundo de nuestras experiencias cotidianas. Cabe enfatizar pues que cuando se mide el estado de una partícula, enseguida sabemos el estado de la otra, lo cual aparentemente es instantáneo, es decir, sin importar las distancias a las que se encuentren las partículas, una de la otra, ambas saben instantáneamente el estado de la otra.

El experimento planteado por EPR consiste en dos partículas que interactuaron en el pasado y que quedan en un estado entrelazado. Dos observadores reciben cada una de las partículas. Si un observador mide el momento de una de ellas, sabe cuál es el momento de la otra. Si mide la posición, gracias al entrelazamiento cuántico y al principio de incertidumbre, puede saber la posición de la otra partícula de forma instantánea, lo que contradice el sentido común.

la posición de la otra partícula de forma instantánea, lo que contradice el sentido común.

Animación que muestra dos átomos de oxígeno fusionándose para formar una molécula de O2 en su estado cuántico fundamental. Las nubes de color representan los orbitales atómicos. Los orbitales 2s y 2p de cada átomo se combinan para formar los orbitales σ y π de la molécula, que la mantienen unida. Los orbitales 1s, más interiores, no se combinan y permiten distinguir a cada núcleo. Lo que ocurre a escalas tan pequeñas es fascinante.

Si nos pudiéramos convertir en electrones, por ejemplo, sabríamos dónde y cómo estamos en cada momento y podríamos ver asombrados, todo lo que estaba ocurriendo a nuestro alrededor que, entonces sí, veríamos transcurrir a un ritmo más lento del que podemos detectar en los electrones desde nuestro macro-estado espacio temporal. El electrón, bajo nuestro punto de vista se mueve alrededor del núcleo atómico a una velocidad de 7 millones de km/h.

A medida que se asciende en la escala de tamaños, hasta el tiempo se va ajustando a esta escala, los objetos, a medida que se hacen mayores se mueven más despacio y, además, tienen más duración que los pequeños objetos infinitesimales del micro mundo cuántico. La vida media de un neutrón es de unos 15 minutos, por ejemplo, mientras que la vida media de una estrellas se puede contar en miles de millones de años.

En nuestra macroescala, los acontecimientos y ,los objetos se mueven a velocidades que a nosotros nos parecen normales. Si se mueven con demasiada lentitud nos parece que no se mueven. Así hablamos de escala de tiempo geológico, para referirnos al tiempo y velocidad de la mayor parte de los acontecimientos geológicos que afectan a la Tierra, el tiempo transcurre aquí en millones de años y nosotros ni lo apreciamos; nos parece que todo está inmóvil. Nosotros, los humanos, funcionamos en la escala de años (tiempo biológico).

El Tiempo Cosmológico es aún mucho más dilatado y los objetos cósmicos (mundos, estrellas y galaxias), tienen una mayor duración aunque su movimiento puede ser muy rápido debido a la inmensidad del espacio universal en el que se mueven. La Tierra, por ejemplo, orbita alrededor del Sol a una velocidad media de 30 Km/s., y, el Sol, se desplaza por la Galaxia a una velocidad de 270 km/s. Y, además, se puede incrementar el tiempo y el espacio en su andadura al estar inmersos y ligados en una misma maya elástica.

Así, el espacio dentro de un átomo, es muy pequeño; dentro de una célula, es algo mayor; dentro de un animal, mayor aún y así sucesivamente… hasta llegar a los enormes espaciosa que separan las estrellas y las galaxias en el Universo.

Distancias astronómicas separan a las estrellas entre sí, a las galaxias dentro del cúmulo, y a los cúmulos en los supe-rcúmulosa u

Las distancias que separan a los objetos del Cosmos se tienen que medir con unidades espaciales, tal es su inmensa magnitud que, nuestras mentes, aunque podamos hablar de ellas de manera cotidiana, en realidad, no han llegado a asimilarlas.Y, a todo ésto, los físicos han intentado con denuedo elaborar una teoría completa de la gravedad que incluya la mecánica cuántica. Los cálculos de la mayoría de las teorías propuesta de la «gravedad cuántica» arrojan numerosos infinitos. Los físicos no están seguros si el problema es técnico o conceptual. No obstante, incluso prescindiendo de una teoría completa de gravedad cuántica, se puede deducir que los efectos de la teoría cuántica, habrían sido cruciales durante los primeros 10-43 segundos del inicio del universo, cuando éste tenía una densidad de 1093 gramos por centímetro cúbico y mayor. (El plomo sólido tiene una densidad de aproximadamente diez gramos por centímetro cúbico.) Este período, que es el que corresponde a la era de Planck, y a su estudio se le llama cosmología cuántica. Como el universo en su totalidad habría estado sujeto a grandes incertidumbres y fluctuaciones durante la era de Planck o era cuántica, con la materia y la energía apareciendo y desapareciendo de un vacío en grandes cantidades, el concepto de un principio del universo podría no tener un significado bien definido. En todo caso, la densidad del universo durante este período es de tal magnitud que escapa a nuestra comprensión. Para propósitos prácticos, la era cuántica podría considerarse el estado inicial, o principio, del universo. En consecuencia, los procesos cuánticos ocurridos durante este período, cualquiera sea su naturaleza, determinaron las condiciones

cruciales durante los primeros 10-43 segundos del inicio del universo, cuando éste tenía una densidad de 1093 gramos por centímetro cúbico y mayor. (El plomo sólido tiene una densidad de aproximadamente diez gramos por centímetro cúbico.) Este período, que es el que corresponde a la era de Planck, y a su estudio se le llama cosmología cuántica. Como el universo en su totalidad habría estado sujeto a grandes incertidumbres y fluctuaciones durante la era de Planck o era cuántica, con la materia y la energía apareciendo y desapareciendo de un vacío en grandes cantidades, el concepto de un principio del universo podría no tener un significado bien definido. En todo caso, la densidad del universo durante este período es de tal magnitud que escapa a nuestra comprensión. Para propósitos prácticos, la era cuántica podría considerarse el estado inicial, o principio, del universo. En consecuencia, los procesos cuánticos ocurridos durante este período, cualquiera sea su naturaleza, determinaron las condiciones iniciales del universo.

iniciales del universo.

Una cosa nos ha podido quedar clara: Los científicos para lograr conocer la estructura del universo a su escala más grande, deben retroceder en el tiempo, centrando sus teorías en el momento en que todo comenzó. Para ello, como todos sabeis, se han formulado distintas teorías unificadoras de las cuatro fuerzas de la naturaleza, con las cuales se han modelado acontecimiento y condiciones en el universo primitivo casi a todo lo largo del camino hasta el principio. Pero cómo se supone que debió haber habido un «antes», aparece una barrera que impide ir más allá de una frontera que se halla fijada a los 10-43 [s] después del Big Bang, un instante conocido como «momento de Planck», en homenaje al físico alemán Max Planck

en el universo primitivo casi a todo lo largo del camino hasta el principio. Pero cómo se supone que debió haber habido un «antes», aparece una barrera que impide ir más allá de una frontera que se halla fijada a los 10-43 [s] después del Big Bang, un instante conocido como «momento de Planck», en homenaje al físico alemán Max Planck

Muro en la Era de Planck Comienzo del Tiempo 0,0

Esta barrera existe debido a que antes del momento de Planck, durante el período llamado la «era de Planck o cuántica», se supone que las cuatro fuerza fundamentales conocidas de la naturaleza eran indistinguibles o se hallaban unificadas , que era una sola fuerza. Aunque los físicos han diseñado teorías cuánticas que unen tres de las fuerzas, una por una, a través de eras que se remontan al momento de Planck, hasta ahora les ha sido prácticamente imposible armonizar las leyes de la teoría cuántica con la gravedad de la relatividad general

prácticamente imposible armonizar las leyes de la teoría cuántica con la gravedad de la relatividad general de Einstein, en un sólo modelo teórico ampliamente convincente y con posibilidades claras de ser contrastado en experimentos de laboratorio y, mucho menos, con observaciones.

de Einstein, en un sólo modelo teórico ampliamente convincente y con posibilidades claras de ser contrastado en experimentos de laboratorio y, mucho menos, con observaciones.

El relato del Big Bang empieza después de la era de Planck, y el muro de Planck es la frontera. El muro de Planck es el límite del conocimiento del universo. Cuando se construyó el Telescopio Espacial James West, se pensaba en que se podría llegar al instante mismo del Big Bang. Sin embargo, nos tropezamos con el llamado !Muro de Planck”, esa Época en la que en el Universo todo era oscuridad, los fotones estaban confinados y no se habían liberados, por lo que el Universo era opaco, y, cuando surgieron los fotones se hizo transparente. Así que el Telescopio (los telescopios), que captan las imagen que les trae la Luz, solo pueden legar a captar los objetos cuya luz les llega, y, en ausencia de luz…

Y después de todo esto, sólo una caso me queda clara: ¡Lo poco que sabemos! A pesar de la mucha imaginación que ponemos en las cosas que creemos conocer.

Catherine Heymans: «No sabemos nada del 95% del Universo»

“En el Universo nada es lo que parece. Y la inmensidad que nos rodea, con billones de estrellas repartidas en cientos de miles de millones de galaxias es, en realidad, solo una pequeña parte de lo que realmente hay «ahí fuera». O, para ser más concretos, menos del 5% del total. El restante 95% nos es totalmente desconocido . Es lo que los científicos llaman «el Universo oscuro», y cientos de investigadores están, literalmente, obsesionados por comprenderlo.”

Con razón decía aquel Filósofo:

“Cambiaría todo lo que se, por la mitad de lo que desconozco.”

Emilio Silvera Vázquez

Mar

22

Nuestra percepción y la realidad: Dos cosas distintas

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en El saber del mundo ~

Clasificado en El saber del mundo ~

Comments (3)

Comments (3)

Nebulosa de Orión, M42 que es de “relativa” reciente creación

“Al principio todo era opacidad, las estrellas no llegaron al universo hasta después de pasados 200 millones de años desde el Big Bang, y, hasta que no se liberaron los fotones, no se hizo la luz.”

Al principio, cuando el universo era simétrico, sólo existía una sola fuerza que unificaba a todas las que ahora conocemos, la gravedad, las fuerzas electromagnéticas y las nucleares débil y fuerte, todas emergían de aquel plasma opaco de alta energía que lo inundaba todo. Más tarde, cuando el universo comenzó a enfriarse, se hizo transparente y apareció la luz, las fuerzas se separaron en las cuatro conocidas, emergieron los primeros quarks para unirse y formar protones y neutrones, los primeros núcleos aparecieron para atraer a los electrones que formaron aquellos primeros átomos. Doscientos millones de años más tarde, se formaron las primeras estrellas y y las galaxias. Con el paso del tiempo, las estrellas sintetizaron los elementos pesados de nuestros cuerpos, fabricados en supernovas que estallaron, incluso antes de que se formase el Sol. Podemos decir, sin temor a equivocarnos, que una supernova anónima explotó hace miles de millones de años y sembró la nube de gas que dio lugar a nuestro sistema solar, poniendo allí los materiales complejos y necesarios para que algunos miles de millones de años más tarde, tras la evolución, apareciéramos nosotros.

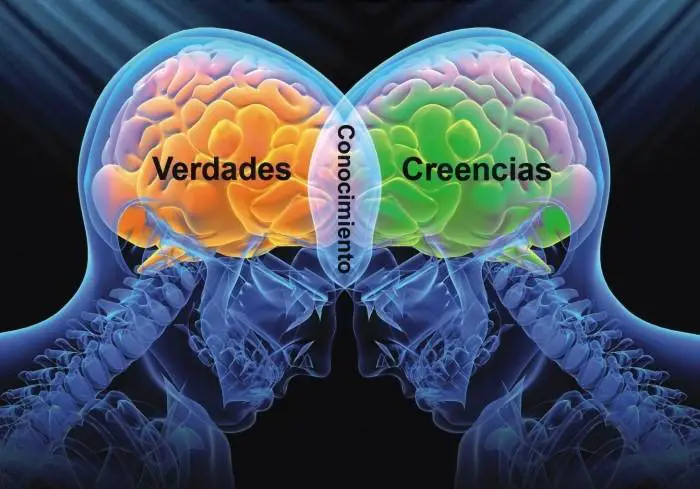

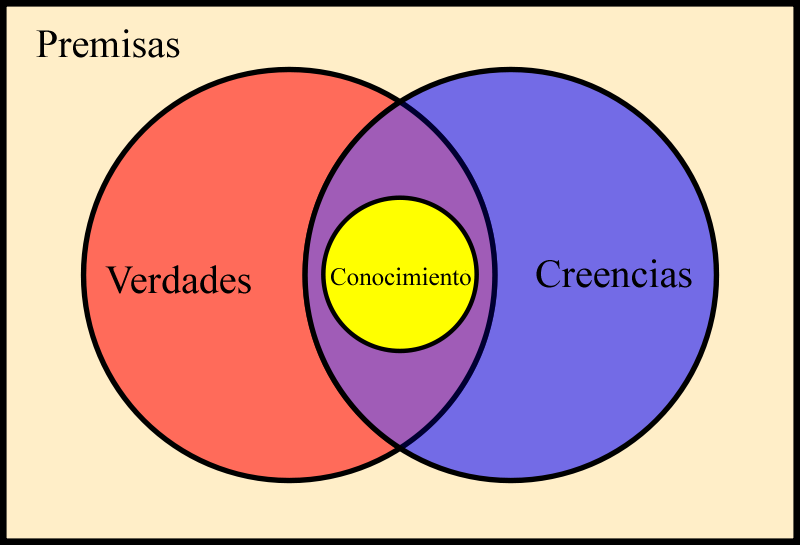

Nuestra percepción y la realidad: Dos cosas distintas

Nuestra realidad es que cada uno de nosotros percibimos, entendemos y actuamos de manera diferente en la vida. Cada uno posee su propia realidad del mundo y de él mismo. Estamos construidos a base de creencias, y esas creencias son las que influyen de manera decisiva en nuestra realidad y en nuestra conducta, por lo tanto, son las “culpables” de que consigamos o no nuestros objetivos. Básicamente nuestra realidad está formada por nuestra educación, nuestro entorno, nuestra preparación, nuestra capacidad intelectual…

“Nuestra tarea más urgente es dejar de identificarnos con el pensamiento, dejar de estar poseídos por él”

Eso nos aconseja Eckhart Tolle, y, no siempre resulta ser de esa manera, Hay ocasiones en la que, nuestros pensamientos son la guía que nos pueden llevar al buen destino, y, si lo que dice (que no lo aclara) está referido a los pensamientos de los otros, simplemente se trata de discernir dónde radica la verdad, en lo que nos dicen o en lo que nosotros creemos. Claro que, no todos creen siempre en lo correcto.

Nosotros los humanos, nunca estamos seguros de nada y, buscando esa seguridad, creamos modelos con los que tratamos de acercarnos más y más a esa realidad que presentimos, y de esa manera encontramos la forma de aproximarnos a esa realidad intuida. En la vida cotidiana, en el hombre de la calle, se halla muy extendido el Practicismo o Realismo ingenuo, se admite, sin más reflexión, que la realidad existe y no se plantean el problema de cuestionar tal existencia. Sin embargo, para los filósofos, el problema de la existencia o no de la Realidad Metafísica y la certeza sobre el conocimiento que sobre ella extraen nuestros sentidos (Epistemología) ha sido, desde los primeros filósofos griegos (pre-socráticos), y continua siendo, uno de los grandes problemas filosóficos que todavía no ha sido resuelto. Es decir, una cuestión sobre la que no tenemos respuesta unánimemente aceptada por todos los pensadores.

Los humanos, desde que fuimos conscientes de nuestro Ser, hemos estado desarrollando diferentes corrientes de pensamientos filosóficos (o doctrinas) que han tratado de responder al problema de si existe o no la realidad fuera de nuestra mente. Películas actuales como “Matrix” es una buena muestra de que el problema de la realidad todavía nos tiene intrigados a los seres humanos de hoy.

La epistemología es una rama de la filosofía que se ocupa de la validez y fiabilidad de los conocimientos que obtenemos los humanos. Viene a ser como una teoría crítica del conocimiento. Desde el punto de vista epistemológico se han planteado cuestiones tales como:

- ¿Se corresponde la realidad con la representación mental que el hombre tiene? ¿O el mundo psíquico es un producto inventado por la mente humana?

- ¿Es fiable y válida la información que los órganos sensoriales captan? ¿O nos engañan nuestros sentidos?

- ¿Cómo llegamos a tener conciencia de la existencia de un espacio poblado de objetos y sujetos (mundo)?

- ¿Es realmente el Universo, como nosotros lo percibimos, o, siendo nuestros sentidos imperfectos nos muestra un universo diferente al que es?

No todos perciben “el mundo” de la misma manera. Tampoco resuelven sus problemas de igual forma

Pero vayamos a algo concreto y pensemos, por ejemplo, en la técnica reiterativa que se utiliza para obtener “soluciones” en casos como el problema de los tres cuerpos (por ejemplo) tiene un inconveniente. A veces no funciona, no siempre podemos decir a priori si va a funcionar o no. La técnica que se aplica para “resolver” las ecuaciones diferenciales pertinentes (recordemos que no se pueden resolver analíticamente) implica realizar aproximaciones sucesivas, en las cuales, como es sabido, el primer paso del proceso de cálculo sólo da una solución aproximada; el segundo paso añade (con un poco de suerte) una corrección para obtener una aproximación más precisa de la realidad; el tercer paso nos da una aproximación aún mejor, y así sucesivamente hasta que nos parezca que la aproximación es lo suficientemente buena para el objetivo que nos hayamos propuesto. Pero nunca podremos conseguir con exactitud la “respuesta” que encaja a la perfección con el comportamiento de los objetos del mundo real en lo que se centra nuestro interés en ese determinado y sobre ese objetivo en particular.

Ninguna idea nos ha llegado de manera instantánea y depurada en todos sus conceptos, sino que, han sido ideas que han tenido que ir siendo depuradas más y más a conseguir esa realidad que buscábamos haciendo que, el esquema encontrado, se parezca lo más posible al mundo que nos rodea y que podemos observar. Esa es, en pocas palabras la historia de la Relatividad de Einstein que juntó muchas ideas y conceptos conseguir sus teorías que están muy cercas de lo que el mundo es.

Hablando de la suma infinita de los números naturales 1+2+3… = -1/12

Lo que hacemos es sumar una serie de números -en principio, una serie de números infinitamente larga- A los matemáticos les interesa estas series infinitas para sus propios objetivos, independientemente de la importancia que puedan tener para los estudios del comportamiento de las cosas tales como los planetas que orbitan alrededor del Sol, y conocen una gran cantidad de series infinitas cuyas sumas se comportan lo suficientemente bien como para ofrecer una aproximación cada vez mejor de un concreto.

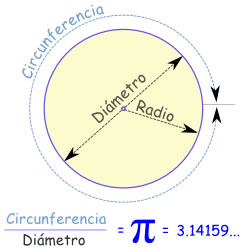

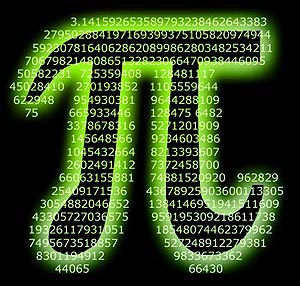

El eterno e irracional número Pi

Un buen ejemplo lo constituye uno de los procedimientos que se utilizan habitualmente para calcular el valor aproximado de π, el cociente la circunferencia de un círculo y su diámetro. Se puede calcular realmente el valor de π/4, con tanta precisión como se desee, sumando la serie numérica:

1 – 1/3 + 1/5 – 1/7 ….

Esto nos da una primera aproximación del valor de π que sería (4 x 1), que no es muy brillante; una segunda aproximación cuyo valor sería 2,6666… (4 x 2/3), que es algo mejor, y que, curiosamente, se encuentra al otro lado de la respuesta «correcta»; una tercera aproximación que sería 3,46666…, y así sucesivamente. Estas aproximaciones van siendo cada vez mejores y convergen en el verdadero valor de π, en este caso concreto ambos lados. Pero el proceso es tedioso -la suma del primer millón de términos de la serie nos da para pi (π) un valor de 3,1415937, que sólo es correcto en sus cinco primeras cinco cifras decimales, No obstante, se puede calcular π de este modo hasta el grado de precisión que se desee (hasta alguna cifra de los decimales), si tienes la paciencia necesaria.

Hacemos una parada aquí para dejar una nota que nos dice que independientemente de cualquier otra consdideración, lo cierto es que, en matemáticas y la teoría del caos y entre otros temas. Si hablamos de “Pi” nos topamos con múltiples sorpresas y él está representado en el diseño de la doble espiral de ADN, el Efecto mariposa y la Torah, entre otras muchísimas cosas que se escriben con Pi. Es un número tan misterioso que lo podemos ver por todas partes representado de una u otra manera. Desde la más remota antigüedad, fascinó a los más grandes pensadores.

No pocos están convencisos de la existencia de patrones que se repiten en los distintos órdenes de la vida. Descubrirlos implicaría, nada más y nada , que deducir el mundo. Yo no dejaría de lado, en todo esto la teoría del Caos que podría definirse (¡en forma muy simplona!) como el estudio de sistemas complejos siempre cambiantes. Los resultados que consideramos ´impredecibles´ ocurrirán en sistemas que son sensibles a los cambios pequeños en sus inicios. El ejemplo más común es conocido como “Efecto mariposa”. La teoría supone que el batir de alas de una mariposa en la China en un determinado período de tiempo podría causar cambios atmosféricos imperceptibles en el clima de New York.

Pi (π) es la decimosexta letra del alfabeto griego y el símbolo que representa el misterio matemático más viejo del mundo: la proporción de la circunferencia de un círculo a su diámetro.

El escrito conocido más temprano de la proporción viene del año 1650 antes de Cristo en Egipto, donde un escriba calculó el valor como 3.16 (con un pequeñísimo error). Aunque ahora, nosotros tenemos métodos para calcular los dígitos de pi (3.1415…) sus restos de valor exacto todavía son un misterio.

Desde 1794, cuando se estableció que Pi era irracional e infinita, las personas han buscando un patrón en el cordón interminable de números.

Cosa curiosa, Pi puede encontrarse por todas partes, en la astronomía, en la física, en la luz, en el sonido, en el suelo, etc. Algunos cálculos advierten que tendría más de 51 mil millones de dígitos, pero hasta el momento no se ha detectado un patrón discernible que surja de sus números. De hecho, la primera sucesión 123456789 aparece muy cerca de los 500 millones de dígitos en la proporción.

En la actualidad hay algunas computadoras super-poderosas tratando de resolver la cuestión. En el film, la computadora bautizada por Max Euclid literalmente “estalla” al acercarse a la verdad del cálculo. ¿Y entonces?… Azar, fe, creencias, ciencia, métodos…y siempre un misterio último sin resolver.

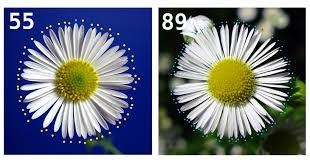

¿El hallazgo de patrones será la respuesta? Tal vez por eso los pitagóricos amaban la /patrón espiral… porque ella está por todas partes en la naturaleza: en los caracoles, en los cuernos del carnero, en las volutas de humo, en la leche sobre el café, en la cara de un girasol, en las huellas digitales, en el ADN y en la Vía Láctea.

3.1415926535897932384626433832795028841971693993…

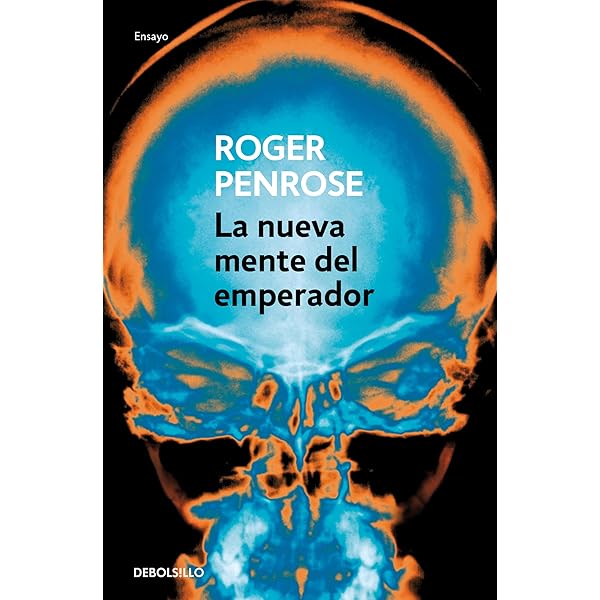

Sí, son muchas las mentes más claras que se han interesado por este fascinante π. En su libro de 1989 “La nueva mente del emperador”, Roger Penrose comentó sobre las limitaciones en el conocimiento humano con un sorprendente ejemplo: Él conjeturó que nunca más probable es saber si una cadena de 10 7s consecutivo aparece en la expansión digital del número pi . A tan sólo 8 años más tarde, Yasumasa Kanada utiliza una computadora para encontrar exactamente esa cadena, empezando por el dígito de pi …. 17387594880th

El valor numérico al que responde es el 1.618033988… Una forma de entender mejor cómo funciona la proporción áurea es a través de la sucesión de Fibonacci, una serie de cifras en la que la suma de dos números consecutivos siempre da como resultado el siguiente y, además, la relación entre cada número se aproxima siempre al número de áureo. Es decir, la sucesión se define como:

0,1,1,2,3,5,8,13,21,34… donde el tercer número es la suma del primero y el segundo, el cuarto es la suma del segundo y el tercero, el quinto es la suma del tercero y el cuarto… Y para encontrar el número áureo solo tenemos que dividir cada número entre el anterior, eso sí, mejor que empieces en el 5, pues debes dejar a la sucesión formarse bien.

Hay un número que está en todas partes, y hace las cosas más bellas. Es el número “phi”, también llamado “número dorado” o “proporción áurea”. ¿Qué es? ¿En qué consiste? ¿Dónde aparece?

Muchos son los números mágicos que, como Phi, al que llaman ¡El Mágico Número del Oro! Están relacionados con las cosas del mundo, del universo y de nosotros mismos. Como decían enm la Escuela pitagórica: ¡Todo es número!

1, 2, 2+1= 3, 3+2= 5, 5+3= 8, 5+8= 13 , etc.

¿Por qué los huracanes, remolinos, galaxias y agujeros negros desarrollan su dinámica en base a la proporción aúrea?

¿Saben que las dimensiones físicas del cuerpo humano cumplen también las relaciones de aspecto dadas por 1,6180…?

¿Cómo es posible que el vuelo de una rapaz al acecho también describa la elipse marcada por esta serie?

¿Por qué la ciudad de La Meca está ubicada en la posición geográfica cuya distancia a los Polos y a los solsticios cumple la relación PHI?

Podemos incluso encontrar esta asombrosa serie en la relación de aspecto de la espiral de ADN y en los latidos del corazón.

Sin embargo, al final, algunos creen que, como todo esta relacionado, sabremos reconocer el mensaje que trata de enviarnos π y que, hasta el momento no hemos sabido comprender. Y, por otra , existen otras cuestiones que también estamos tratando de dilucidar para aproximarnos a esa realidad incomprendida que, estando aquí, no podemos ver. Por ejemplo:

Roger Penrose dedicó bastante más tinta en defender los argumentos de Shadows of Mind que en escribir dicha obra. En una de sus contrarréplicas, publicada en la revista Psyche (Enero, 1996), nos ofrece una de las versiones más claras de su famoso argumento.

Supongamos que todos los métodos de razonamiento matemático humanamente asequibles válidos la demostración de cualquier tesis están contenidos en el conjunto F. Es más, en F no sólo introducimos lo que entenderíamos por lógica matemática (axiomas y reglas de inferencia) sino todo lo matemáticamente posible para tener un modelo matemático del cerebro que utiliza esa lógica (todos los algoritmos necesarios para simular un cerebro). F es, entonces, el modelo soñado por cualquier ingeniero de AI: un modelo del cerebro y su capacidad para realizar todo cálculo lógico imaginable para el hombre. Y, precisamente, ese es el modelo soñado porque la AI Fuerte piensa que eso es un ser humano inteligente. Así, cabe preguntarse: ¿Soy F? Y parece que todos contestaríamos, a priori, que sí.

¿Es la verdad inalcanzable?

Sin embargo, Roger Penrose, piensa que no, y demostrarlo utiliza el celebérrimo teorema de Gödel, que venimos a recordar a muy grosso modo: un sistema axiomático es incompleto si contiene enunciados que el sistema no puede demostrar ni refutar (en lógica se llaman enunciados indecidibles). Según el teorema de incompletitud, todo sistema axiomático consistente y recursivo para la aritmética tiene enunciados indecidibles. Concretamente, si los axiomas del sistema son verdaderos, puede exhibirse un enunciado verdadero y no decidible dentro del sistema.

Kurt Gödel

“En 1931, el matemático austríaco Kurt Gödel, con sólo 25 años, publicó un artículo titulado Sobre proposiciones formalmente no decidibles en Principia Mathematica y sistemas relacionados. Allí demostraba que para cualquier conjunto de axiomas siempe es posible hacer enunciados que, a partir de esos axiomas, no puede demostrarse ni que son así no que no son así. En ese sentido, es imposible elaborar jamás un conjunto de axiomas a partir de los cuales se pueda deducir un sistema matemático completo.”

Puede ser que la verdad, nuestra verdad, sólo sea una parte de una gran mentira.

Si yo soy F, como soy un conjunto de algoritmos (basados en sistemas axiomáticos consistentes y recursivos), contendré algún teorema (proposiciones que se infieren de los axiomas de mi sistema) que es indecidible. Los seres humanos nos damos , somos conscientes de que ese teorema es indecidible. De repente nos encontraríamos con algo dentro de nosotros mismos con lo que no sabríamos qué hacer. Pero en esto hay una contradicción con ser F, porque F, al ser un conjunto de algoritmos, no sería capaz de demostrar la indecibilidad de ninguno de sus teoremas por lo dicho por Gödel… Una máquina nunca podría darse cuenta de que está ante un teorema indecidible. Ergo, si nosotros somos capaces de descubrir teoremas indecidibles es porque, algunas veces, actuamos mediante algo diferente a un algoritmo: no sólo somos lógica matemática.

Claro que, ¿cómo podría un robot imitar nuestros múltiples, locos y dispares pensamientos?:

- Los Computadores nunca podrán reemplazar la estupidez humana.

- El hombre nace ignorante, la educación lo idiotiza.

- Una persona inteligente resuelve problemas, el genio los evita.

- Las consideran que guardar un secreto, es no revelar la fuente.

- Todas las mujeres tienen algo bonito… así sea una prima lejana.

- La felicidad es una lata de atún, con el abrelatas un poco distante.

- El único animal que no resiste aplausos es el mosquito.

- El amor está en el cerebro, no en el corazón.

- Definición de nostalgia “es la alegría de estar triste”.

- “Mi segundo órgano favorito es el cerebro”.

Vale, ¿y qué consecuencias tiene eso? la AI muy graves. Penrose piensa no sólo que no somos computadores sino que ni siquiera podemos tener un computador que pueda simular matemáticamente nuestros procesos mentales. Con esto Penrose no está diciendo que en múltiples ocasiones no utilicemos algoritmos (o no seamos algoritmos) cuando pensemos, sólo dice (lo cual es más que suficiente) que, habrá al menos algunas ocasiones, en las que no utilizamos algoritmos o, dicho de otro modo, hay algún componente en nuestra mente del cual no podemos construir un modelo matemático, qué menos que intentar replicarlo computacionalmente en un ordenador.

Además el asunto se hace más curioso cuanto más te adentras en él. ¿Cuáles podrían ser esos elementos no computables de nuestra mente? La respuesta ha de ser un rotundo no tenemos ni idea, porque no hay alguna de crear un método matemático para saber qué elementos de un sistema serán los indecidibles. Esto lo explicaba muy bien Turing con el famoso problema de la parada: si tenemos un ordenador que está procesando un problema matemático y vemos que no se para, es decir, que tarda un tiempo en resolverlo, no hay manera de saber si llegará un en el que se parará o si seguirá eternamente funcionando (y tendremos que darle al reset que termine). Si programamos una máquina para que vaya sacando decimales a pi, no hay forma de saber si pi tiene una cantidad de decimales tal que nuestra máquina tardará una semana, seis meses o millones de años en sacarlos todos o si los decimales de pi son infinitos.

De misma forma, no podemos saber, por definición, qué elementos de nuestra mente son no computables. A pesar de ello, Penrose insiste en que lo no computable en nuestra mente es, nada más y nada menos, que la conciencia, ya que, explica él, mediante ella percibimos la indecibilidad de los teoremas. Es posible, ya que, aunque a priori no pudiéramos saber qué elementos no son deducibles, podríamos encontrarnos casualmente con alguno de ellos y podría ser que fuera la conciencia. Pero, ¿cómo es posible que nuestro cerebro genere conciencia siendo el cerebro algo aparentemente sujeto a computación? Penrose tiene que irse al mundo cuántico, en el que casi todo lo extraño sucede, para encontrar fenómenos no modelizables por las matemáticas y, de paso, resolver el problema del origen físico de la conciencia.

Las neuronas no nos valen. Son demasiado grandes y pueden ser modelizadas por la mecánica clásica. Hace falta algo más pequeño, algo que, por su naturaleza, exprese la in-computabilidad de la conciencia. Penrose se fija en el citoesqueleto de las neuronas formado por unas estructuras llamadas microtúbulos. micro-nivel está empapado de fenómenos cuánticos no computables, siendo el funcionamiento a nivel neuronal, si acaso, una sombra amplificadora suya, un reflejo de la auténtica actividad generadora de conciencia. ¡Qué emocionante! Pero, ¿Cómo generan estos microtúbulos empapados de efectos cuánticos la conciencia? Penrose dice que no lo sabe, que ya bastante ha dicho…

O sea señor Penrose, que después de todo el camino hecho, al final, estamos cómo al principio: no tenemos ni idea de qué es lo que genera la conciencia. Sólo hemos cambiado el problema de lugar. Si antes nos preguntábamos cómo cien mil millones de neuronas generaban conciencia, nos preguntamos cómo los efectos cuánticos no computables generan conciencia. Penrose dice que habrá que esperar a que la mecánica cuántica se desarrolle más. Crick o Searle nos dicen que habrá que esperar a ver lo que nos dice la neurología… ¡Pero yo no puedo esperar!

Además, ¿no parece extraño que la conciencia tenga algo que ver con el citoesqueleto de las neuronas? La función del citoesqueleto celular suele ser sustentar la célula, hacerla estable en su locomoción… ¿Qué tendrá que ver eso con ser consciente? Claro que en el actual de la ciencia igual podría decirse: ¿Qué tendrá que ver la actividad eléctrica de cien mil millones de neuronas con que yo sienta que me duele una muela?

Todo eso está bien pero, ¿Qué es PI?

“Corta 1/9 del diámetro y construye un cuadrado sobre la longitud restante. cuadrado tiene el mismo área que el circulo”.

Mar

22

¡Conjeturar! Tratando de saber

por Emilio Silvera ~

por Emilio Silvera ~

Clasificado en ¡Tenemos que saber! ~

Clasificado en ¡Tenemos que saber! ~

Comments (2)

Comments (2)

El principio antrópico y otras cuestiones